概述

Apache Flume是一个分布式,可靠且可用的系统,用于有效地从许多不同的source收集,聚合和移动大量日志数据到集中式数据存储。

Apache Flume的使用不仅限于日志数据聚合。由于数据source是可定制的,因此Flume可用于传输大量event 数据,包括但不限于网络流量数据,社交媒体生成的数据,电子邮件消息以及几乎任何可能的数据source。

Apache Flume是Apache Software Foundation的顶级项目。

系统要求

- Java运行时环境 - Java 1.8或更高版本

- 内存 - 为source,channel或 sink 配置的内存

- 磁盘空间 - channel或sink配置的磁盘空间

- 目录权限 - agent使用的目录的读/写权限

架构

数据流模型

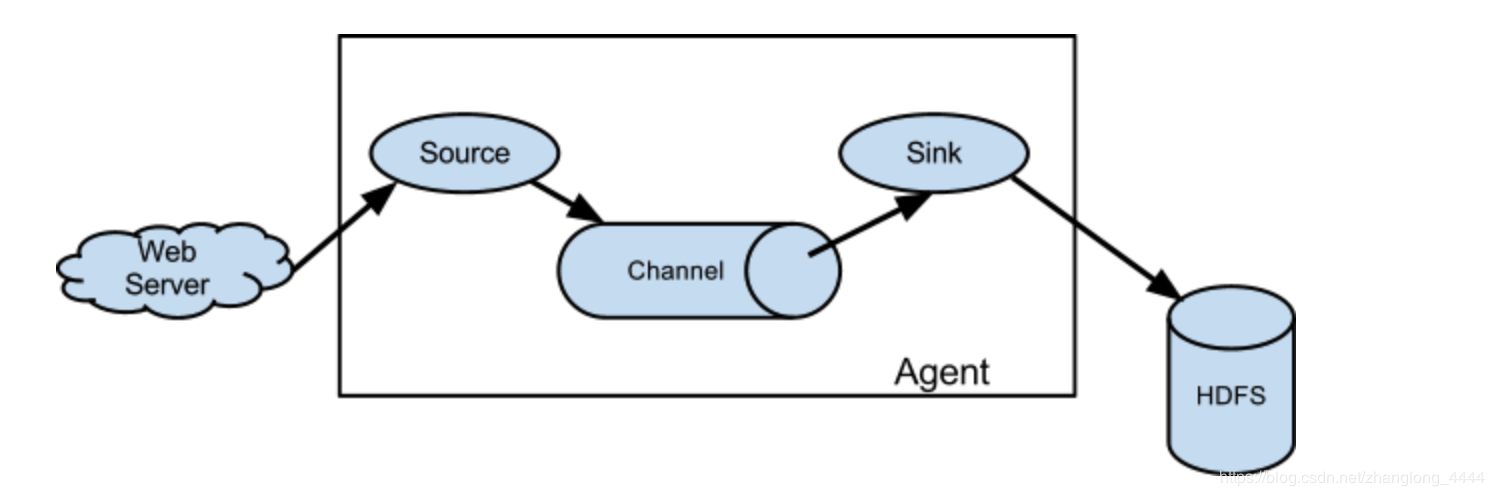

Flume event 被定义为具有字节有效负载和可选字符串属性集的数据流单元。Flume agent 是一个(JVM)进程,它承载event 从外部source流向下一个目标(跃点)的组件。

Flume source消耗由外部 source(如Web服务器)传递给它的 event 。外部source以目标Flume source识别的格式向Flume发送event 。例如,Avro Flume source可用于从Avro客户端或从Avrosink发送event 的流中的其他Flume agent 接收Avroevent 。可以使用Thrift Flume Source定义类似的流程,以接收来自Thrift Sink或Flume Thrift Rpc客户端或Thrift客户端的event ,这些客户端使用Flume thrift协议生成的任何语言编写。当Flume source接收event 时,它将其存储到一个或多个channels 。该channel是一个被动存储器,可以保持event 直到它被Flume sink消耗。文件channel就是一个例子 - 它由本地文件系统支持。sink从channel中移除event 并将其放入外部存储库(如HDFS(通过Flume HDFS sink))或将其转发到流中下一个Flume agent (下一跳)的Flume source。给定 agent 中的source和sink与channel中暂存的event 异步运行。

复杂的流程

Flume允许用户构建多跳流,其中event 在到达最终目的地之前经过多个 agent 。它还允许fan-in 和fan-out,上下文路由和故障跳跃的备份路由(故障转移)。

可靠性

event 在每个 agent 的channel中进行。然后将event 传递到流中的下一个 agent 或终端存储库(如HDFS)。只有将event 存储在下一个 agent 的channel或终端存储库中后,才会从channel中删除这些event 。这就是Flume中的单跳消息传递语义如何提供流的端到端可靠性。

Flume使用事务方法来保证event 的可靠传递。source和sink分别在事务中封装由channel 提供的事务中放置或提供的event 的存储/检索。这可确保event 集在流中从一个点到另一个点可靠地传递。在多跳流的情况下,来自前一跳的sink和来自下一跳的source都运行其事务以确保数据安全地存储在下一跳的channel 中。

可恢复性

event 在channel中进行,该channel管理从故障中恢复。Flume支持由本地文件系统支持的持久文件channel。还有一个内存channel,它只是将event 存储在内存中的队列中,这更快,但是当 agent 进程死亡时仍然留在内存channel中的任何event 都无法恢复。

设置

设置 agent

Flume agent 配置存储在本地配置文件中。这是一个遵循Java属性文件格式的文本文件。可以在同一配置文件中指定一个或多个 agent 的配置。配置文件包括 agent 中每个source,sink和channel的属性以及它们如何连接在一起以形成数据流。

配置单个组件

流中的每个组件(source,sink或channel)都具有特定于类型和实例化的名称,类型和属性集。例如,Avrosource需要主机名(或IP地址)和端口号来接收数据。内存channel可以具有最大队列大小(“容量”),HDFS sink需要知道文件系统URI,创建文件的路径,文件轮换频率(“hdfs.rollInterval”)等。组件的所有此类属性需要在托管Flume agent 的属性文件中设置。

将各个部分连接在一起

agent 需要知道要加载哪些组件以及它们如何连接以构成流程。这是通过列出 agent 中每个source,sink和channel的名称,然后为每个sink和source指定连接channel来完成的。例如, agent 通过名为file-channel的文件channel将event 从名为avroWeb的Avrosource流向HDFS sink hdfs-cluster1。配置文件将包含这些组件的名称和文件channel,作为avroWebsource和hdfs-cluster1 sink的共享channel。

启动 agent

使用名为flume-ng的shell脚本启动 agent 程序,该脚本位于Flume发行版的bin目录中。您需要在命令行上指定 agent 名称,config目录和配置文件:

$ bin/flume-ng agent -n $agent_name -c conf -f conf/flume-conf.properties.template

现在, agent 将开始运行在给定属性文件中配置的source和sink。

一个简单的例子

在这里,我们给出一个示例配置文件,描述单节点Flume部署。此配置允许用户生成event ,然后将其记录到控制台。

# example.conf: A single-node Flume configuration

# Name the components on this agent

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# Describe/configure the source

a1.sources.r1.type = netcat

a1.sources.r1.bind = localhost

a1.sources.r1.port = 44444

# Describe the sink

a1.sinks.k1.type = logger

# Use a channel which buffers events in memory

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

# Bind the source and sink to the channel

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

此配置定义名为a1的单个 agent 。a1有一个监听端口44444上的数据的source,一个缓冲内存中event 数据的channel,以及一个将event 数据记录到控制台的sink。配置文件命名各种组件,然后描述其类型和配置参数。给定的配置文件可能会定义几个命名的 agent 当一个给定的Flume进程启动时,会传递一个标志,告诉它要显示哪个命名 agent。

鉴于此配置文件,我们可以按如下方式启动Flume:

$ bin/flume-ng agent --conf conf --conf-file example.conf --name a1 -Dflume.root.logger=INFO,console

请注意,在完整部署中,我们通常会包含一个选项: --conf=<conf-dir> 。所述 <conf-dir> 目录将包括一个shell 脚本f lume-env.sh 和潜在的一个log4j的属性文件。在这个例子中,我们传递一个Java选项来强制Flume登录到控制台,我们没有自定义环境脚本。

从一个单独的终端,我们可以telnet端口44444并向Flume发送一个event :

$ telnet localhost 44444

Trying 127.0.0.1...

Connected to localhost.localdomain (127.0.0.1).

Escape character is '^]'.

Hello world! <ENTER>

OK

原始的Flume终端将在日志消息中输出event 。

12/06/19 15:32:19 INFO source.NetcatSource: Source starting

12/06/19 15:32:19 INFO source.NetcatSource: Created serverSocket:sun.nio.ch.ServerSocketChannelImpl[/127.0.0.1:44444]

12/06/19 15:32:34 INFO sink.LoggerSink: Event: { headers:{} body: 48 65 6C 6C 6F 20 77 6F 72 6C 64 21 0D Hello world!. }

恭喜 - 您已成功配置并部署了Flume agent !后续部分更详细地介绍了 agent 配置。

在配置文件中使用环境变量

Flume能够替换配置中的环境变量。例如:

a1.sources = r1

a1.sources.r1.type = netcat

a1.sources.r1.bind = 0.0.0.0

a1.sources.r1.port = ${NC_PORT}

a1.sources.r1.channels = c1

注意:它目前仅适用于values ,不适用于 keys 。 (Ie. only on the “right side” of the = mark of the config lines.)

通过设置propertiesImplementation = org.apache.flume.node.EnvVarResolverProperties,可以通过 agent 程序调用上的Java系统属性启用此功能。

例如:

$ NC_PORT=44444 bin/flume-ng agent –conf conf –conf-file example.conf –name a1 -Dflume.root.logger=INFO,console -DpropertiesImplementation=org.apache.flume.node.EnvVarResolverProperties

请注意,上面只是一个示例,可以通过其他方式配置环境变量,包括在 conf/flume-env.sh.

记录原始数据

在许多生产环境中记录流经摄取 pipeline 的原始数据流不是所希望的行为,因为这可能导致泄漏敏感数据或安全相关配置(例如密钥)泄漏到Flume日志文件。默认情况下,Flume不会记录此类信息。另一方面,如果数据管道被破坏,Flume将尝试提供调试DEBUG的线索。

调试event 管道问题的一种方法是设置 连接到Logger Sink的附加内存channel,它将所有event 数据输出到Flume日志。但是,在某些情况下,这种方法是不够的。

为了能够记录event 和配置相关的数据,除了log4j属性外,还必须设置一些Java系统属性。

要启用与配置相关的日志记录,请设置Java系统属性-Dorg.apache.flume.log.printconfig=true 。这可以在命令行上传递,也可以在flume-env.sh中的JAVA_OPTS变量中设置。

要启用数据记录,请 按照上述相同方式设置Java系统属性 -Dorg.apache.flume.log.rawdata=true 。对于大多数组件,还必须将log4j日志记录级别设置为DEBUG或TRACE,以使特定于event 的日志记录显示在Flume日志中。

下面是启用配置日志记录和原始数据日志记录的示例,同时还将Log4j日志级别设置为DEBUG以用于控制台输出:

$ bin/flume-ng agent --conf conf --conf-file example.conf --name a1 -Dflume.root.logger=DEBUG,console -Dorg.apache.flume.log.printconfig=true -Dorg.apache.flume.log.rawdata=true

基于Zookeeper的配置

Flume通过Zookeeper支持 agent 配置。这是一个实验性功能。配置文件需要在可配置前缀下的Zookeeper中上传。配置文件存储在Zookeeper节点数据中。以下是 agent 商a1和a2的Zookeeper节点树的外观

- /flume

|- /a1 [Agent config file]

|- /a2 [Agent config file]

上载配置文件后,使用以下选项启动 agent

$ bin/flume-ng agent –conf conf -z zkhost:2181,zkhost1:2181 -p /flume –name a1 -Dflume.root.logger=INFO,console

| Argument Name | Default | Description |

|---|---|---|

| z | – | Zookeeper连接字符串。以逗号分隔的主机名列表:port |

| p | /flume | Zookeeper中的基本路径,用于存储 agent 配置 |

Flume拥有完全基于插件的架构。虽然Flume附带了许多开箱即用的 source,channels,sink,serializers 等,但许多实现都与Flume分开运行。安装第三方插件

虽然通过将自己的jar包添加到flume-env.sh文件中的FLUME_CLASSPATH变量中,始终可以包含自定义Flume组件,但Flume现在支持一个名为plugins.d的特殊目录,该目录会自动获取以特定格式打包的插件。这样可以更轻松地管理插件打包问题,以及更简单的调试和几类问题的故障排除,尤其是库依赖性冲突。

目录

该plugins.d 目录位于 $FLUME_HOME/plugins.d 。在启动时,flume-ng 启动脚本在plugins.d目录中查找符合以下格式的插件,并在启动java时将它们包含在正确的路径中。

插件的目录布局

plugins.d 中的每个插件(子目录)最多可以有三个子目录:

- lib - the plugin’s jar(s)

- libext - the plugin’s dependency jar(s)

- native - any required native libraries, such as .so files

plugins.d目录中的两个插件示例:

plugins.d/

plugins.d/custom-source-1/

plugins.d/custom-source-1/lib/my-source.jar

plugins.d/custom-source-1/libext/spring-core-2.5.6.jar

plugins.d/custom-source-2/

plugins.d/custom-source-2/lib/custom.jar

plugins.d/custom-source-2/native/gettext.so

数据摄取

Flume支持许多从外部来source摄取数据的机制。

RPC

Flume发行版中包含的Avro客户端可以使用avro RPC机制将给定文件发送到Flume Avrosource:

$ bin/flume-ng avro-client -H localhost -p 41414 -F /usr/logs/log.10

上面的命令会将 /usr/logs/log.10 的内容发送到监听该端口的Flume source。

执行命令

有一个exec source执行给定的命令并消耗输出。输出的单“行” 即。文本后跟回车符('\ r')或换行符('\ n')或两者一起。

网络流

Flume支持以下机制从常用日志流类型中读取数据,例如:

- Avro

- Thrift

- Syslog

- Netcat

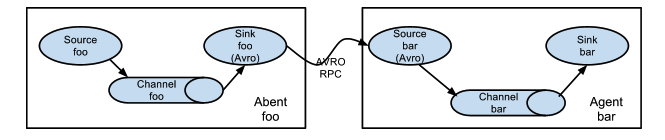

设置多 agent 流程

为了跨多个 agent 或跳数据流,先前 agent 的sink和当前跳的source需要是avro类型,sink指向source的主机名(或IP地址)和端口。

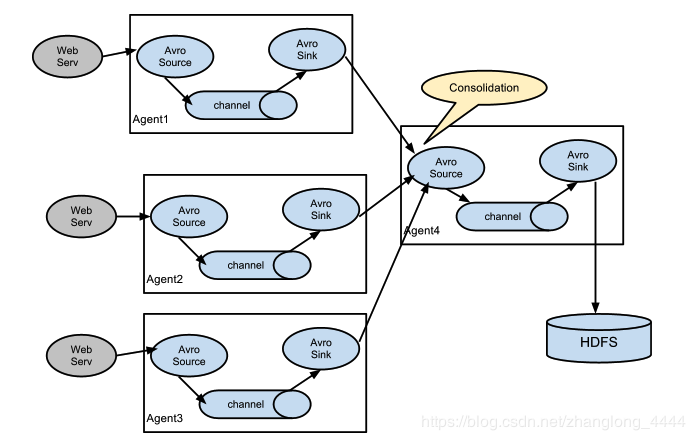

合并

日志收集中非常常见的情况是大量日志生成客户端将数据发送到连接到存储子系统的少数消费者 agent 。例如,从数百个Web服务器收集的日志发送给写入HDFS集群的十几个 agent 。

这可以通过使用avrosink配置多个第一层 agent 在Flume中实现,所有这些 agent 都指向单个 agent 的avrosource(同样,您可以在这种情况下使用thriftsource/sink/客户端)。第二层 agent 上的此source将接收的event 合并到单个信道中,该信道由信宿器消耗到其最终目的地。

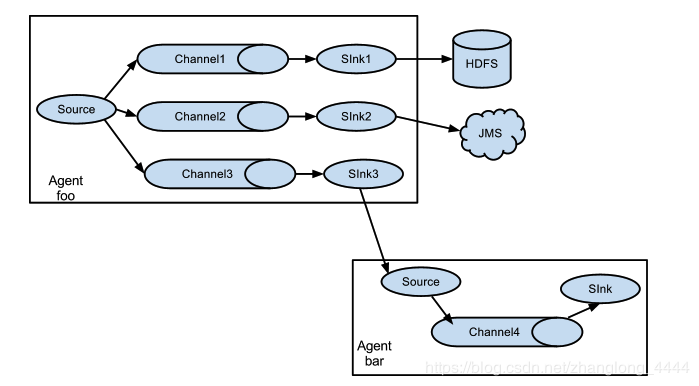

多路复用流程

Flume支持将event 流多路复用到一个或多个目的地。这是通过定义可以复制或选择性地将event 路由到一个或多个信道的流复用器来实现的。

上面的例子显示了来自 agent “foo”的source代码将流程扩展到三个不同的channel。扇出可以复制或多路复用。在复制流的情况下,每个event 被发送到所有三个channel。对于多路复用情况,当event 的属性与预配置的值匹配时,event 将被传递到可用channel的子集。例如,如果一个名为“txnType”的event 属性设置为“customer”,那么它应该转到channel1和channel3,如果它是“vendor”,那么它应该转到channel2,否则转到channel3。可以在 agent 的配置文件中设置映射。

配置

如前面部分所述,Flume agent 程序配置是从类似于具有分层属性设置的Java属性文件格式的文件中读取的.

定义流程

要在单个 agent 中定义流,您需要通过channel链接source和sink。您需要列出给定 agent 的source,sink和channel,然后将source和sink指向channel。source实例可以指定多个channel,但sink实例只能指定一个channel。格式如下:

# list the sources, sinks and channels for the agent

<Agent>.sources = <Source>

<Agent>.sinks = <Sink>

<Agent>.channels = <Channel1> <Channel2>

# set channel for source

<Agent>.sources.<Source>.channels = <Channel1> <Channel2> ...

# set channel for sink

<Agent>.sinks.<Sink>.channel = <Channel1>

例如,名为agent_foo的 agent 正在从外部avro客户端读取数据并通过内存channel将其发送到HDFS。

配置文件weblog.config可能如下所示:

# list the sources, sinks and channels for the agent

agent_foo.sources = avro-appserver-src-1

agent_foo.sinks = hdfs-sink-1

agent_foo.channels = mem-channel-1

# set channel for source

agent_foo.sources.avro-appserver-src-1.channels = mem-channel-1

# set channel for sink

agent_foo.sinks.hdfs-sink-1.channel = mem-channel-1

这将使event 从avro-AppSrv-source流向hdfs-Cluster1-sink,通过内存channelmem-channel-1。

当使用weblog.config作为其配置文件启动 agent 程序时,它将实例化该流程。

配置单个组件

定义流后,您需要设置每个source,sink和channel的属性。这是以相同的分层命名空间方式完成的,您可以在其中设置组件类型以及特定于每个组件的属性的其他值:

# properties for sources

<Agent>.sources.<Source>.<someProperty> = <someValue>

# properties for channels

<Agent>.channel.<Channel>.<someProperty> = <someValue>

# properties for sinks

<Agent>.sources.<Sink>.<someProperty> = <someValue>

需要为Flume的每个组件设置属性“type”,以了解它需要什么类型的对象。每个source,sink和channel类型都有自己的一组属性,使其能够按预期运行。所有这些都需要根据需要进行设置。在前面的示例中,我们有一个从avro-AppSrv-source到hdfs-Cluster1-sink的流程通过内存channelmem-channel-1。这是一个显示每个组件配置的示例:

agent_foo.sources = avro-AppSrv-source

agent_foo.sinks = hdfs-Cluster1-sink

agent_foo.channels = mem-channel-1

# set channel for sources, sinks

# properties of avro-AppSrv-source

agent_foo.sources.avro-AppSrv-source.type = avro

agent_foo.sources.avro-AppSrv-source.bind = localhost

agent_foo.sources.avro-AppSrv-source.port = 10000

# properties of mem-channel-1

agent_foo.channels.mem-channel-1.type = memory

agent_foo.channels.mem-channel-1.capacity = 1000

agent_foo.channels.mem-channel-1.transactionCapacity = 100

# properties of hdfs-Cluster1-sink

agent_foo.sinks.hdfs-Cluster1-sink.type = hdfs

agent_foo.sinks.hdfs-Cluster1-sink.hdfs.path = hdfs://namenode/flume/webdata

#...

在 agent 中添加多个流

单个Flume agent 可以包含多个独立流。您可以在配置中列出多个source,sink和channel。可以链接这些组件以形成多个流:

# list the sources, sinks and channels for the agent

<Agent>.sources = <Source1> <Source2>

<Agent>.sinks = <Sink1> <Sink2>

<Agent>.channels = <Channel1> <Channel2>

然后,您可以将source和sink链接到channel(用于sink)的相应channel(用于source),以设置两个不同的流。例如,如果您需要在 agent 中设置两个流,一个从外部avro客户端到外部HDFS,另一个从尾部输出到avrosink,那么这是一个配置来执行此操作:

# list the sources, sinks and channels in the agent

agent_foo.sources = avro-AppSrv-source1 exec-tail-source2

agent_foo.sinks = hdfs-Cluster1-sink1 avro-forward-sink2

agent_foo.channels = mem-channel-1 file-channel-2

# flow #1 configuration

agent_foo.sources.avro-AppSrv-source1.channels = mem-channel-1

agent_foo.sinks.hdfs-Cluster1-sink1.channel = mem-channel-1

# flow #2 configuration

agent_foo.sources.exec-tail-source2.channels = file-channel-2

agent_foo.sinks.avro-forward-sink2.channel = file-channel-2

配置多 agent 流程

要设置多层流,您需要有 sink 指向下一跳的 avro/thrift source。这将导致第一个Flume agent 将event 转发到下一个Flume agent 。例如,如果您使用avro客户端定期向本地Flume agent 发送文件(每个event 1个文件),则此本地 agent 可以将其转发到另一个已安装存储的 agent

Weblog agent 配置:

# list sources, sinks and channels in the agent

agent_foo.sources = avro-AppSrv-source

agent_foo.sinks = avro-forward-sink

agent_foo.channels = file-channel

# define the flow

agent_foo.sources.avro-AppSrv-source.channels = file-channel

agent_foo.sinks.avro-forward-sink.channel = file-channel

# avro sink properties

agent_foo.sinks.avro-forward-sink.type = avro

agent_foo.sinks.avro-forward-sink.hostname = 10.1.1.100

agent_foo.sinks.avro-forward-sink.port = 10000

# configure other pieces

#...

HDFS agent 配置:

# list sources, sinks and channels in the agent

agent_foo.sources = avro-collection-source

agent_foo.sinks = hdfs-sink

agent_foo.channels = mem-channel

# define the flow

agent_foo.sources.avro-collection-source.channels = mem-channel

agent_foo.sinks.hdfs-sink.channel = mem-channel

# avro source properties

agent_foo.sources.avro-collection-source.type = avro

agent_foo.sources.avro-collection-source.bind = 10.1.1.100

agent_foo.sources.avro-collection-source.port = 10000

# configure other pieces

#...

在这里,我们将weblog agent 的avro-forward-sink链接到hdfs agent 的avro-collection-source。这将导致来自外部应用程序服务器source的event 最终存储在HDFS中。

扇出流量

如前一节所述,Flume支持扇出从一个source到多个channel的流量。扇出有两种模式 : 复制和多路复用。在复制流程中,event 将发送到所有已配置的channel。在多路复用的情况下,event 仅被发送到合格 channels 的子集。为了散开流量,需要指定source的channel列表以及扇出它的策略。这是通过添加可以复制或多路复用的channel“选择器”来完成的。如果它是多路复用器,则进一步指定选择规则。如果您没有指定选择器,那么默认情况下它会复制:

# List the sources, sinks and channels for the agent

<Agent>.sources = <Source1>

<Agent>.sinks = <Sink1> <Sink2>

<Agent>.channels = <Channel1> <Channel2>

# set list of channels for source (separated by space)

<Agent>.sources.<Source1>.channels = <Channel1> <Channel2>

# set channel for sinks

<Agent>.sinks.<Sink1>.channel = <Channel1>

<Agent>.sinks.<Sink2>.channel = <Channel2>

<Agent>.sources.<Source1>.selector.type = replicating

多路复用选择具有另一组属性以分流流。这需要指定event 属性到channel集的映射。选择器检查event 头中的每个已配置属性。如果它与指定的值匹配,则该event 将发送到映射到该值的所有channel。如果没有匹配项,则将event 发送到配置为默认值的channel集:

# Mapping for multiplexing selector

<Agent>.sources.<Source1>.selector.type = multiplexing

<Agent>.sources.<Source1>.selector.header = <someHeader>

<Agent>.sources.<Source1>.selector.mapping.<Value1> = <Channel1>

<Agent>.sources.<Source1>.selector.mapping.<Value2> = <Channel1> <Channel2>

<Agent>.sources.<Source1>.selector.mapping.<Value3> = <Channel2>

#...

<Agent>.sources.<Source1>.selector.default = <Channel2>

映射允许为每个值重叠channel。

以下示例具有多路复用到两个路径的单个流。名为agent_foo的 agent 具有单个avrosource和两个链接到两个sink的channel:

# list the sources, sinks and channels in the agent

agent_foo.sources = avro-AppSrv-source1

agent_foo.sinks = hdfs-Cluster1-sink1 avro-forward-sink2

agent_foo.channels = mem-channel-1 file-channel-2

# set channels for source

agent_foo.sources.avro-AppSrv-source1.channels = mem-channel-1 file-channel-2

# set channel for sinks

agent_foo.sinks.hdfs-Cluster1-sink1.channel = mem-channel-1

agent_foo.sinks.avro-forward-sink2.channel = file-channel-2

# channel selector configuration

agent_foo.sources.avro-AppSrv-source1.selector.type = multiplexing

agent_foo.sources.avro-AppSrv-source1.selector.header = State

agent_foo.sources.avro-AppSrv-source1.selector.mapping.CA = mem-channel-1

agent_foo.sources.avro-AppSrv-source1.selector.mapping.AZ = file-channel-2

agent_foo.sources.avro-AppSrv-source1.selector.mapping.NY = mem-channel-1 file-channel-2

agent_foo.sources.avro-AppSrv-source1.selector.default = mem-channel-1

选择器检查名为“State”的标头。如果该值为“CA”,则将其发送到mem-channel-1,如果其为“AZ”,则将其发送到文件channel-2,或者如果其为“NY”则为两者。如果“状态”标题未设置或与三者中的任何一个都不匹配,则它将转到mem-channel-1,其被指定为“default”。

选择器还支持可选channel。要为标头指定可选channel,可通过以下方式使用config参数“optional”:

# channel selector configuration

agent_foo.sources.avro-AppSrv-source1.selector.type = multiplexing

agent_foo.sources.avro-AppSrv-source1.selector.header = State

agent_foo.sources.avro-AppSrv-source1.selector.mapping.CA = mem-channel-1

agent_foo.sources.avro-AppSrv-source1.selector.mapping.AZ = file-channel-2

agent_foo.sources.avro-AppSrv-source1.selector.mapping.NY = mem-channel-1 file-channel-2

agent_foo.sources.avro-AppSrv-source1.selector.optional.CA = mem-channel-1 file-channel-2

agent_foo.sources.avro-AppSrv-source1.selector.mapping.AZ = file-channel-2

agent_foo.sources.avro-AppSrv-source1.selector.default = mem-channel-1

选择器将首先尝试写入所需的channel,如果其中一个channel无法使用event ,则会使事务失败。在所有渠道上重新尝试交易。一旦所有必需的channel消耗了event ,则选择器将尝试写入可选channel。任何可选channel使用该event 的失败都会被忽略而不会重试。

如果可选信道与特定报头的所需信道之间存在重叠,则认为该信道是必需的,并且信道中的故障将导致重试所有必需信道集。例如,在上面的示例中,对于标题“CA”,mem-channel-1被认为是必需的channel,即使它被标记为必需和可选,并且写入此channel的失败将导致该event 在为选择器配置的所有channel上重试。

请注意,如果标头没有任何所需的channel,则该event 将被写入默认channel,并将尝试写入该标头的可选channel。如果未指定所需的channel,则指定可选channel仍会将event 写入默认channel。如果没有将channel指定为默认channel且没有必需channel,则选择器将尝试将event 写入可选channel。在这种情况下,任何失败都会被忽略。

支持

多个Flume组件支持SSL / TLS协议,以便安全地与其他系统通信。

| Component | SSL server or client |

|---|---|

| Avro Source | server |

| Avro Sink | client |

| Thrift Source | server |

| Thrift Sink | client |

| Kafka Source | client |

| Kafka Channel | client |

| Kafka Sink | client |

| HTTP Source | server |

| JMS Source | client |

| Syslog TCP Source | server |

| Multiport Syslog TCP Source | server |

SSL兼容组件具有若干配置参数来设置SSL,例如启用SSL标志,密钥库/信任库参数(位置,密码,类型)和其他SSL参数(例如禁用的协议)

始终在 agent 配置文件的组件级别指定为组件启用SSL。因此,某些组件可能配置为使用SSL,而其他组件则不配置(即使具有相同的组件类型)

密钥库/信任库设置可以在组件级别或全局指定。

在组件级别设置的情况下,通过组件特定参数在 agent 配置文件中配置密钥库/信任库。此方法的优点是组件可以使用不同的密钥库(如果需要)。缺点是必须为 agent 配置文件中的每个组件复制密钥库参数。组件级别设置是可选的,但如果已定义,则其优先级高于全局参数。

使用全局设置,只需定义一次密钥库/信任库参数,并对所有组件使用相同的设置,这意味着更少和更集中的配置。

可以通过系统属性或通过环境变量来配置全局设置。

| 系统属性 | 环境变量 | 描述 |

|---|---|---|

| javax.net.ssl.keyStore | FLUME_SSL_KEYSTORE_PATH | 密钥库位置 |

| javax.net.ssl.keyStorePassword | FLUME_SSL_KEYSTORE_PASSWORD | 密钥库密码 |

| javax.net.ssl.keyStoreType | FLUME_SSL_KEYSTORE_TYPE | 密钥库类型(默认为JKS) |

| javax.net.ssl.trustStore | FLUME_SSL_TRUSTSTORE_PATH | 信任库位置 |

| javax.net.ssl.trustStorePassword | FLUME_SSL_TRUSTSTORE_PASSWORD | 信任库密码 |

| javax.net.ssl.trustStoreType | FLUME_SSL_TRUSTSTORE_TYPE | 信任库类型(默认为JKS) |

| flume.ssl.include.protocols | FLUME_SSL_INCLUDE_PROTOCOLS | 计算启用的协议时要包括的协议。逗号(,)分隔列表。如果提供,排除的协议将从此列表中排除。 |

| flume.ssl.exclude.protocols | FLUME_SSL_EXCLUDE_PROTOCOLS | 计算启用的协议时要排除的协议。逗号(,)分隔列表。 |

| flume.ssl.include.cipherSuites | FLUME_SSL_INCLUDE_CIPHERSUITES | 在计算启用的密码套件时包含的密码套件。逗号(,)分隔列表。如果提供,排除的密码套件将被排除在此列表之外。 |

| flume.ssl.exclude.cipherSuites | FLUME_SSL_EXCLUDE_CIPHERSUITES | 在计算启用的密码套件时要排除的密码套件。逗号(,)分隔列表。 |

可以在命令行上传递SSL系统属性,也可以在conf / flume-env.sh中设置JAVA_OPTS环境变量(尽管使用命令行是不可取的,因为包含密码的命令将保存到命令历史记录中。)

export JAVA_OPTS="$JAVA_OPTS -Djavax.net.ssl.keyStore=/path/to/keystore.jks"

export JAVA_OPTS="$JAVA_OPTS -Djavax.net.ssl.keyStorePassword=password"

Flume使用JSSE(Java安全套接字扩展)中定义的系统属性,因此这是设置SSL的标准方法。另一方面,在系统属性中指定密码意味着可以在进程列表中看到密码。对于不可接受的情况,也可以在环境变量中定义参数。在这种情况下,Flume在内部从相应的环境变量初始化JSSE系统属性。

SSL环境变量可以在启动Flume之前在shell环境中设置,也可以在conf / flume-env.sh中设置(尽管使用命令行是不可取的,因为包含密码的命令将保存到命令历史记录中。)

export FLUME_SSL_KEYSTORE_PATH=/path/to/keystore.jks

export FLUME_SSL_KEYSTORE_PASSWORD=password

** 请注意:**

- 必须在组件级别启用SSL。仅指定全局SSL参数不会产生任何影响。

- 如果在多个级别指定全局SSL参数,则优先级如下(从高到低):

- agent 配置中的组件参数

- 系统属性

- 环境变量

- 如果为组件启用了SSL,但未以上述任何方式指定SSL参数,则

- 在密钥库的情况下:配置错误

- 在truststores的情况下:将使用默认信任库(Oracle JDK中的jssecacerts / cacerts)

- 在所有情况下,可信任密码都是可选的。如果未指定,则在JDK打开信任库时,不会对信任库执行完整性检查。

source 和接收批量大小和channel事务容量

source和sink可以具有批量大小参数,该参数确定它们在一个批次中处理的最大event 数。这发生在具有称为事务容量的上限的channel事务中。批量大小必须小于渠道的交易容量。有一个明确的检查,以防止不兼容的设置。只要读取配置,就会进行此检查。

Flume Source

Avro Source

监听Avro端口并从外部Avro客户端流接收event 。当与另一个(上一跳)Flume agent 上的内置Avro Sink配对时,它可以创建分层集合拓扑。必需属性以粗体显示

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channels | - | |

| type | - | 组件类型名称,需要是avro |

| bind | - | 要侦听的主机名或IP地址 |

| port | - | 要绑定的端口号 |

| threads | - | 生成的最大工作线程数 |

| selector.type | ||

| selector.* | ||

| interceptors | - | 以空格分隔的拦截器列表 |

| interceptors.* | ||

| compression-type | none | 这可以是“none”或“deflate”。压缩类型必须与匹配AvroSource的压缩类型匹配 |

| SSL | false | 将其设置为true以启用SSL加密。如果启用了SSL,则还必须通过组件级参数(请参阅下文)或全局SSL参数(请参阅SSL / TLS支持部分)指定“密钥库”和“密钥库密码” 。 |

| keysore | - | 这是Java密钥库文件的路径。如果未在此处指定,则将使用全局密钥库(如果已定义,则配置错误)。 |

| keystore-password | - | Java密钥库的密码。如果未在此处指定,则将使用全局密钥库密码(如果已定义,则配置错误)。 |

| keystore-type | JKS | Java密钥库的类型。这可以是“JKS”或“PKCS12”。如果未在此处指定,则将使用全局密钥库类型(如果已定义,则默认为JKS)。 |

| exclude-protocols | SSLv3 | 要排除的以空格分隔的SSL / TLS协议列表。除指定的协议外,将始终排除SSLv3。 |

| include-protocols | - | 要包含的以空格分隔的SSL / TLS协议列表。启用的协议将是包含的协议,没有排除的协议。如果包含协议为空,则它包括每个支持的协议。 |

| exclude-cipher-suites | - | 要排除的以空格分隔的密码套件列表。 |

| include-cipher-suites | - | 以空格分隔的密码套件列表。启用的密码套件将是包含的密码套件,不包括排除的密码套件。如果included-cipher-suites为空,则包含每个支持的密码套件。 |

| ipFilter | false | 将此设置为true以启用ipFiltering for netty |

| ipFilterRules | - | 使用此配置定义N netty ipFilter模式规则。 |

agent 名为a1的示例:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = avro

a1.sources.r1.channels = c1

a1.sources.r1.bind = 0.0.0.0

a1.sources.r1.port = 4141

ipFilterRules的示例

ipFilterRules定义由逗号分隔的N个netty ipFilters模式规则必须采用此格式。

<’allow’ or deny>:<’ip’ or ‘name’ for computer name>:<pattern> or allow/deny:ip/name:pattern

example: ipFilterRules=allow:ip:127.*,allow:name:localhost,deny:ip:*

请注意,匹配的第一个规则将适用,如下例所示,来自localhost上的客户端

这将允许localhost上的客户端拒绝来自任何其他ip的客户端“allow:name:localhost,deny:ip:这将拒绝localhost上的客户端允许来自任何其他ip的客户端“deny:name:localhost,allow:ip:

Thrift Source

侦听Thrift端口并从外部Thrift客户端流接收event 。当与另一个(上一跳)Flume agent 上的内置ThriftSink配对时,它可以创建分层集合拓扑。可以通过启用kerberos身份验证将Thriftsource配置为以安全模式启动。agent-principal和agent-keytab是Thriftsource用于向kerberos KDC进行身份验证的属性。必需属性以粗体显示

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channels | - | |

| type | - | 组件类型名称,需要节俭 |

| bind | - | 要侦听的主机名或IP地址 |

| port | - | 要绑定的端口号 |

| threads | - | 生成的最大工作线程数 |

| selector.type | ||

| selector.* | ||

| interceptors | - | 空格分隔的拦截器列表 |

| interceptors.* | ||

| SSL | false | 将其设置为true以启用SSL加密。如果启用了SSL,则还必须通过组件级参数(请参阅下文)或全局SSL参数(请参阅SSL / TLS支持部分)指定“密钥库”和“密钥库密码”。 |

| keystore | - | 这是Java密钥库文件的路径。如果未在此处指定,则将使用全局密钥库(如果已定义,则配置错误)。 |

| keystore-password | - | Java密钥库的密码。如果未在此处指定,则将使用全局密钥库密码(如果已定义,则配置错误)。 |

| keystore-type | JKS | Java密钥库的类型。这可以是“JKS”或“PKCS12”。如果未在此处指定,则将使用全局密钥库类型(如果已定义,则默认为JKS)。 |

| exclude-protocols | 要排除的以空格分隔的SSL / TLS协议列表。除指定的协议外,将始终排除SSLv3。 | |

| include-protocols | - | 要包含的以空格分隔的SSL / TLS协议列表。启用的协议将是包含的协议,没有排除的协议。如果包含协议为空,则它包括每个支持的协议。 |

| exclude-cipher-suites | - | 要排除的以空格分隔的密码套件列表。 |

| include-cipher-suites | - | 以空格分隔的密码套件列表。启用的密码套件将是包含的密码套件,不包括排除的密码套件。 |

| kerberos | 设置为true以启用kerberos身份验证。在kerberos模式下,成功进行身份验证需要agent-principal和agent-keytab。安全模式下的Thriftsource仅接受来自已启用kerberos且已成功通过kerberos KDC验证的Thrift客户端的连接。 | |

| agent-principal | - | Thrift Source使用的kerberos主体对kerberos KDC进行身份验证。 |

| agent-keytab | - | Thrift Source与 agent 主体结合使用的keytab位置,用于对kerberos KDC进行身份验证。 |

agent 名为a1的示例:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = thrift

a1.sources.r1.channels = c1

a1.sources.r1.bind = 0.0.0.0

a1.sources.r1.port = 4141

Exec Source

Exec source在启动时运行给定的Unix命令,并期望该进程在标准输出上连续生成数据(stderr被简单地丢弃,除非属性logStdErr设置为true)。如果进程因任何原因退出,则source也会退出并且不会生成其他数据。这意味着cat [named pipe] 或tail -F [file]等配置将产生所需的结果,而日期 可能不会 - 前两个命令产生数据流,而后者产生单个event 并退出。必需属性以粗体显示

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channels | - | |

| type | - | 组件类型名称,需要是exec |

| command | - | 要执行的命令 |

| shell | - | 用于运行命令的shell调用。例如 /bin/sh -c 。仅适用于依赖shell功能的命令,如通配符,后退标记,管道等。 |

| restartThrottle | 10000 | 尝试重新启动之前等待的时间(以毫秒为单位) |

| restart | false | 是否应该重新执行已执行的cmd |

| logStdErr | false | 是否应记录命令的stderr |

| BATCHSIZE | 20 | 一次读取和发送到channel的最大行数 |

| batchTimeout | 3000 | 在向下游推送数据之前,如果未达到缓冲区大小,则等待的时间(以毫秒为单位) |

| selector.type | replication | 复制或多路复用 |

| selector.* | 取决于selector.type值 | |

| interceptors | - | 以空格分隔的拦截器列表 |

| interceptors.* |

警告

Exec Source和其他异步source的问题在于,如果无法将event 放入Channel中,则source无法保证客户端知道它。在这种情况下,数据将丢失。例如,最常请求的功能之一是 tail -F [file] 类似用例,其中应用程序写入磁盘上的日志文件,Flume将文件作为尾部发送,将每一行作为event 发送。虽然这是可能的,但是有一个明显的问题; 如果channel 填满并且Flume无法发送event ,会发生什么?由于某种原因,Flume无法向编写日志文件的应用程序指示它需要保留日志或event 尚未发送。如果这没有意义,您只需要知道:当使用Exec Source等单向异步接口时,您的应用程序永远无法保证已收到数据!

作为此警告的延伸 - 并且完全清楚 - 使用此source时,event 传递绝对没有保证。

为了获得更强的可靠性保证,请考虑Spooling Directory Source,Taildir Source或通过SDK直接与Flume集成。

agent 名为a1的示例:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = exec

a1.sources.r1.command = tail -F /var/log/secure

a1.sources.r1.channels = c1

'shell'配置用于通过命令shell(例如Bash或Powershell)调用'命令'。'command'作为参数传递给'shell'执行。这允许'命令'使用shell中的功能,例如通配符,后退标记,管道,循环,条件等。如果没有'shell'配置,将直接调用'command'。'shell'的常用值: ‘/bin/sh -c’, ‘/bin/ksh -c’, ‘cmd /c’, ‘powershell -Command’, etc.

a1.sources.tailsource-1.type = exec

a1.sources.tailsource-1.shell = /bin/bash -c

a1.sources.tailsource-1.command = for i in /path/*.txt; do cat $i; done

JMS Source

JMS Source从JMS目标(例如队列或主题)读取消息。作为JMS应用程序,它应该与任何JMS提供程序一起使用,但仅使用ActiveMQ进行测试。JMSsource提供可配置的批量大小,消息选择器,用户/传递和消息到水槽event 转换器。请注意,供应商提供的JMS jar应该包含在Flume类路径中,使用plugins.d目录(首选),命令行上的-classpath或flume-env.sh中的FLUME_CLASSPATH变量。必需属性以粗体显示

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channels | - | |

| type | - | 组件类型名称,需要是jms |

| initialContextFactory | - | Inital Context Factory,例如:org.apache.activemq.jndi.ActiveMQInitialContextFactory |

| connectionFactory | - | 连接工厂应显示为的JNDI名称 |

| providerURL | - | JMS提供程序URL |

| destinationName | - | 目的地名称 |

| destinationType | - | 目的地类型(队列或主题) |

| messageSelector | - | 创建使用者时使用的消息选择器 |

| userName | - | 目标/提供商的用户名 |

| PASSWORDFILE | - | 包含目标/提供程序密码的文件 |

| BATCHSIZE | 100 | 一批中要使用的消息数 |

| converter.type | DEFAULT | 用于将消息转换为水槽event 的类。见下文。 |

| converter.* | - | 转换器属性。 |

| converter.charset | UTF-8 | 仅限默认转换器。在将JMS TextMessages转换为字节数组时使用的字符集。 |

| createDurableSubscription | false | 是否创建持久订阅。持久订阅只能与destinationType主题一起使用。如果为true,则必须指定“clientId”和“durableSubscriptionName”。 |

| clientId | - | JMS客户端标识符在创建后立即在Connection上设置。持久订阅必需。 |

| durableSubscriptionName | - | 用于标识持久订阅的名称。持久订阅必需。 |

消息转换器

JMSsource允许可插拔转换器,尽管默认转换器可能适用于大多数用途。默认转换器能够将字节,文本和对象消息转换为FlumeEvents。在所有情况下,消息中的属性都将作为标题添加到FlumeEvent中。

BytesMessage:

消息的字节被复制到FlumeEvent的主体。每封邮件无法转换超过2GB的数据。

TextMessage的:

消息文本转换为字节数组并复制到FlumeEvent的主体。默认转换器默认使用UTF-8,但这是可配置的。

ObjectMessage:

Object被写入包含在ObjectOutputStream中的ByteArrayOutputStream,并将生成的数组复制到FlumeEvent的主体。

agent 名为a1的示例:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = jms

a1.sources.r1.channels = c1

a1.sources.r1.initialContextFactory = org.apache.activemq.jndi.ActiveMQInitialContextFactory

a1.sources.r1.connectionFactory = GenericConnectionFactory

a1.sources.r1.providerURL = tcp://mqserver:61616

a1.sources.r1.destinationName = BUSINESS_DATA

a1.sources.r1.destinationType = QUEUE

SSL 和 JMS Source

JMS客户端实现通常支持通过JSSE(Java安全套接字扩展)定义的某些Java系统属性来配置SSL / TLS。为Flume的JVM指定这些系统属性,JMSsource(或更准确地说是JMSsource使用的JMS客户端实现)可以通过SSL连接到JMS服务器(当然,仅当JMS服务器也已设置为使用SSL时)。它应该可以与任何JMS提供程序一起使用,并且已经过ActiveMQ,IBM MQ和Oracle WebLogic的测试。

以下部分仅介绍Flume方面所需的SSL配置步骤。您可以在Flume Wiki上找到有关不同JMS提供程序的服务器端设置以及完整工作配置示例的更详细说明。

** SSL 传输/服务器身份验证:**

如果JMS服务器使用自签名证书或其证书由不受信任的CA(例如公司自己的CA)签名,则需要设置信任库(包含正确的证书)并传递给Flume。它可以通过全局SSL参数完成。有关全局SSL设置的更多详细信息,请参阅SSL / TLS支持部分。

使用SSL时,某些JMS提供程序需要SSL特定的JNDI初始上下文工厂和/或提供程序URL设置(例如,ActiveMQ使用ssl:// URL前缀而不是tcp://)。在这种情况下,必须在 agent 配置文件中调整source属性(initialContextFactory和/或providerURL)

客户端证书身份验证(双向SSL):

JMS Source可以通过客户端证书身份验证而不是通常的用户/密码登录来对JMS服务器进行身份验证(使用SSL并且JMS服务器配置为接受此类身份验证时)。

包含用于身份验证的Flume密钥的密钥库需要再次通过全局SSL参数进行配置。有关全局SSL设置的更多详细信息,请参阅SSL / TLS支持部分。

密钥库应该只包含一个密钥(如果存在多个密钥,则将使用第一个密钥)。密钥密码必须与密钥库密码相同。

在客户端证书身份验证的情况下,不需要在Flume agent 配置文件中为JMSsource指定userName / passwordFile属性。

请注意:

与其他组件不同,JMS Source没有组件级别的配置参数。也没有启用SSL标志。SSL设置由JNDI / Provider URL设置(最终是JMS服务器设置)以及truststore / keystore的存在/不存在控制。

Spooling Directory Source

此source允许您通过将要摄取的文件放入磁盘上的“spooling ”目录来摄取数据。此source将查看新文件的指定目录,并将在新文件出现时解析event 。event 解析逻辑是可插入的。在给定文件完全读入channel后,默认情况下通过重命名文件来指示完成,或者可以删除它或使用trackerDir来跟踪已处理的文件。

与Exec source不同,即使Flume重新启动或被杀死,此source也是可靠的并且不会遗漏数据。作为这种可靠性的交换,只有不可变的,唯一命名的文件必须被放入spooling directory.中。Flume试图检测这些问题,如果违反则会声明失败:

- 如果在放入 spooling directory 后写入文件,Flume会将错误打印到其日志文件并停止处理。

- 如果稍后重复使用文件名,Flume将在其日志文件中输出错误并停止处理。

为避免上述问题,在将文件名移动到 spooling directory 中时,添加唯一标识符(例如时间戳)可能很有用。

尽管该source的可靠性保证,但仍存在如果发生某些下游故障则可能重复event 的情况。这与其他Flume组件提供的保证一致。

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channels | - | |

| type | - | 组件类型名称需要是spooldir。 |

| spoolDir | - | 从中读取文件的目录。 |

| fileSuffix | .COMPLETED | 后缀附加到完全摄取的文件 |

| deletePolicy | never | 何时删除已完成的文件:从never 或 immediate |

| FileHeader | false | 是否添加存储绝对路径文件名的标头。 |

| fileHeaderKey | file | 将绝对路径文件名附加到event 标题时使用的标题键。 |

| basenameHeader | false | 是否添加存储文件基本名称的标头。 |

| basenameHeaderKey | basename | 标题将文件的基本名称附加到event 标题时使用的标题。 |

| includePattern | .*$ | 正则表达式,指定要包含的文件。它可以与ignorePattern一起使用。如果一个文件同时匹配ignorePattern和includePattern正则表达式,该文件将被忽略。 |

| ignorePattern | $ | 正则表达式,指定要忽略的文件(跳过)。它可以与includePattern一起使用。如果一个文件同时匹配ignorePattern和includePattern正则表达式,该文件将被忽略。 |

| trackerDir | .flumespool | 用于存储与文件处理相关的元数据的目录。如果此路径不是绝对路径,则将其解释为相对于spoolDir。 |

| trackingPolicy | rename | 跟踪策略定义如何跟踪文件处理。它可以是“重rename”或“tracker_dir”。此参数仅在deletePolicy为“never”时有效。“重rename” - 处理完文件后,会根据fileSuffix参数重命名。“tracker_dir” - 不重命名文件,但会在trackerDir中创建新的空文件。新的跟踪器文件名source自摄取的文件名和fileSuffix。 |

| consumeOrder | oldest | spooling directory 中的文件将以 oldest, youngest和 random 的方式使用。如果是oldest和youngest的,文件的最后修改时间将用于比较文件。如果出现相同,将首先消耗具有最小字典顺序的文件。在 random的情况下,任何文件将被随机挑选。当使用oldest和youngest时,整个目录将被扫描以选择oldest/youngest的文件,如果存在大量文件,这可能会很慢,而使用random可能会导致旧文件在新文件不断进入时很晚被消耗 spooling directory。 |

| pollDelay | 500 | 轮询新文件时使用的延迟(以毫秒为单位)。 |

| recursiveDirectorySearch | false | 是否监视子目录以查找要读取的新文件。 |

| maxBackoff | 4000 | 如果channel已满,则在连续尝试写入channel之间等待的最长时间(以毫秒为单位)。source将以低退避开始,并在每次channel抛出ChannelException时以指数方式增加,直到此参数指定的值。 |

| BATCHSIZE | 100 | 批量传输到channel的粒度 |

| inputCharset | UTF-8 | 反序列化器使用的字符集,将输入文件视为文本。 |

| decodeErrorPolicy | FAIL | 当我们在输入文件中看到不可解码的字符时该怎么办。FAIL:抛出异常并且无法解析文件。 REPLACE:用“替换字符”char替换不可解析的字符,通常是Unicode U+FFFD 。 IGNORE:删除不可解析的字符序列。 |

| deserializer | LINE | 指定用于将文件解析为event 的反序列化程序。默认将每行解析为event 。指定的类必须实现EventDeserializer.Builder。 |

| deserializer.* | 每个event 反序列化器不同。 | |

| bufferMaxLines | - | (Obselete)此选项现在被忽略。 |

| bufferMaxLineLength | 5000 | (已弃用)提交缓冲区中行的最大长度。请改用deserializer.maxLineLength。 |

| selector.type | replicating | replicating or multiplexing |

| selector.* | 取决于selector.type值 | |

| interceptors | - | 以空格分隔的拦截器列表 |

| interceptors.* |

名为agent-1的 agent 示例:

a1.channels = ch-1

a1.sources = src-1

a1.sources.src-1.type = spooldir

a1.sources.src-1.channels = ch-1

a1.sources.src-1.spoolDir = /var/log/apache/flumeSpool

a1.sources.src-1.fileHeader = true

Event Deserializers

以下event 反序列化器随Flume一起提供。

LINE

此解串器为每行文本输入生成一个event

| 物业名称 | 默认 | 描述 |

|---|---|---|

| deserializer.maxLineLength | 2048 | 单个event 中包含的最大字符数。如果一行超过此长度,则会被截断,并且该行上的其余字符将出现在后续event 中。 |

| deserializer.outputCharset | UTF-8 | 用于编码放入channel的event 的字符集。 |

AVRO

此解串器能够读取Avro容器文件,并在文件中为每个Avro记录生成一个event 。每个event 都使用标头进行注释,该标头指示所使用的模式。event 的主体是二进制Avro记录数据,不包括模式或容器文件元素的其余部分。

请注意,如果假脱机目录source必须重试将其中一个event 放入channel(例如,因为channel已满),则它将重置并从最新的Avro容器文件同步点重试。为了减少此类故障情况下的潜在event 重复,请在Avro输入文件中更频繁地写入同步标记。

| 物业名称 | 默认 | 描述 |

|---|---|---|

| deserializer.schemaType | HASH | 如何表示模式。默认情况下,或者 指定值HASH时,会对Avro架构进行哈希处理,并将哈希值存储在event 头“flume.avro.schema.hash”中的每个event 中。如果指定了LITERAL,则JSON编码的模式本身存储在event 头“flume.avro.schema.literal”中的每个event 中。与HASH模式相比,使用LITERAL模式效率相对较低。 |

BlobDeserializer>

此反序列化器为每个event 读取二进制大对象(BLOB),通常每个文件一个BLOB。例如PDF或JPG文件。请注意,此方法不适用于非常大的对象,因为整个BLOB都缓存在RAM中。

| 物业名称 | 默认 | 描述 |

|---|---|---|

| 解串器 | - | 此类的FQCN:org.apache.flume.sink.solr.morphline.BlobDeserializer$Builder |

| deserializer.maxBlobLength | 100000000 | 要读取的最大字节数和给定请求的缓冲区 |

Taildir Source

注意: 此source作为预览功能提供。它不适用于Windows。

观察指定的文件,并在检测到添加到每个文件的新行后几乎实时地拖尾它们。如果正在写入新行,则此source将重试读取它们以等待写入完成。

此source是可靠的,即使tail文件旋转也不会丢失数据。它定期以JSON格式写入给定位置文件上每个文件的最后读取位置。如果Flume由于某种原因停止或停止,它可以从写在现有位置文件上的位置重新开始tail。

在其他用例中,此source也可以使用给定的位置文件从每个文件的任意位置开始拖尾。当指定路径上没有位置文件时,默认情况下它将从每个文件的第一行开始拖尾。

文件将按修改时间顺序使用。将首先使用具有最早修改时间的文件。

此source不会重命名或删除或对正在挂载的文件执行任何修改。目前此source不支持tail二进制文件。它逐行读取文本文件。

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channels | - | |

| type | - | 组件类型名称,需要是TAILDIR。 |

| filegroups | - | 以空格分隔的文件组列表。每个文件组都指示一组要挂起的文件。 |

| filegroups. | - | 文件组的绝对路径。正则表达式(而不是文件系统模式)只能用于文件名。 |

| positionFile | ~/.flume/taildir_position.json | 以JSON格式文件以记录每个尾部文件的inode,绝对路径和最后位置。 |

| headers. | - | 标题值,使用标题键设置。可以为一个文件组指定多个标头。 |

| byteOffsetHeader | false | 是否将tailed line 的字节偏移量添加到名为“byteoffset”的标头中。 |

| skipToEnd | false | 在未写入位置文件的文件的情况下是否跳过位置到EOF。 |

| idleTimeout | 120000 | 关闭非活动文件的时间(毫秒)。如果关闭的文件附加了新行,则此source将自动重新打开它。 |

| writePosInterval | 3000 | 写入位置文件上每个文件的最后位置的间隔时间(ms)。 |

| BATCHSIZE | 100 | 一次读取和发送到channel的最大行数。使用默认值通常很好。 |

| maxBatchCount | Long.MAX_VALUE | 控制从同一文件连续读取的批次数。如果source正在拖尾多个文件,并且其中一个文件以快速写入,则可以防止处理其他文件,因为繁忙文件将在无限循环中读取。在这种情况下,降低此值。 |

| backoffSleepIncrement | 1000 | 在最后一次尝试未找到任何新数据时,重新尝试轮询新数据之前的时间延迟增量。 |

| maxBackoffSleep | 5000 | 每次重新尝试轮询新数据时的最大时间延迟,当最后一次尝试未找到任何新数据时。 |

| cachePatternMatching | true | 对于包含数千个文件的目录,列出目录并应用文件名正则表达式模式可能非常耗时。缓存匹配文件列表可以提高性能。消耗文件的顺序也将被缓存。要求文件系统以至少1秒的粒度跟踪修改时间。 |

| FileHeader | false | 是否添加存储绝对路径文件名的标头。 |

| fileHeaderKey | file | 将绝对路径文件名附加到event 标题时使用的标题键。 |

agent 名为a1的示例:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = TAILDIR

a1.sources.r1.channels = c1

a1.sources.r1.positionFile = /var/log/flume/taildir_position.json

a1.sources.r1.filegroups = f1 f2

a1.sources.r1.filegroups.f1 = /var/log/test1/example.log

a1.sources.r1.headers.f1.headerKey1 = value1

a1.sources.r1.filegroups.f2 = /var/log/test2/.*log.*

a1.sources.r1.headers.f2.headerKey1 = value2

a1.sources.r1.headers.f2.headerKey2 = value2-2

a1.sources.r1.fileHeader = true

a1.sources.ri.maxBatchCount = 1000

Kafka Source

Kafka Source是一个Apache Kafka消费者,它从Kafka主题中读取消息。如果您运行了多个Kafka source,则可以使用相同的使用者组配置它们,以便每个source都读取一组唯一的主题分区。这目前支持Kafka服务器版本0.10.1.0或更高版本。测试完成了2.0.1,这是发布时最高的可用版本。

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channels | - | |

| type | - | 组件类型名称,需要是org.apache.flume.source.kafka.KafkaSource |

| kafka.bootstrap.servers | - | source代码使用的Kafka集群中的 agent 列表 |

| kafka.consumer.group.id | flume | 独特的消费者群体。在多个source或 agent 中设置相同的ID表示它们是同一个使用者组的一部分 |

| kafka.topics | - | 以逗号分隔的主题列表,kafka消费者将从中读取消息。 |

| kafka.topics.regex | - | 正则表达式,用于定义source订阅的主题集。此属性具有比kafka.topics更高的优先级,并覆盖kafka.topics(如果存在)。 |

| BATCHSIZE | 1000 | 一批中写入Channel的最大消息数 |

| batchDurationMillis | 1000 | 将批次写入channel之前的最长时间(以毫秒为单位)只要达到第一个大小和时间,就会写入批次。 |

| backoffSleepIncrement | 1000 | Kafka Topic 显示为空时触发的初始和增量等待时间。等待时间将减少对空kafka Topic 的激进ping操作。一秒钟是摄取用例的理想选择,但使用拦截器的低延迟操作可能需要较低的值。 |

| maxBackoffSleep | 5000 | Kafka Topic 显示为空时触发的最长等待时间。5秒是摄取用例的理想选择,但使用拦截器的低延迟操作可能需要较低的值。 |

| useFlumeEventFormat | false | 默认情况下,event 将从Kafka Topic 直接作为字节直接进入event 主体。设置为true以读取event 作为Flume Avro二进制格式。与Kafka Sink上的相同属性或Kafka Channel上的parseAsFlumeEvent属性一起使用时,这将保留在生成端发送的任何Flume标头。 |

| setTopicHeader | true | 设置为true时,将检索到的消息的主题存储到由topic Header属性定义的标头中 。 |

| topicHeader | topic | 如果setTopicHeader属性设置为true,则定义用于存储接收消息主题名称的标头名称。如果与Kafka SinktopicHeader属性结合使用,应该小心,以避免将消息发送回循环中的同一主题。 |

| kafka.consumer.security.protocol | PLAINTEXT | 如果使用某种级别的安全性写入Kafka,则设置为SASL_PLAINTEXT,SASL_SSL或SSL。有关安全设置的其他信息,请参见下文。 |

| more consumer security props | 如果使用SASL_PLAINTEXT,SASL_SSL或SSL,请参阅Kafka安全性以获取需要在使用者上设置的其他属性。 | |

| Other Kafka Consumer Properties | - | 这些属性用于配置Kafka Consumer。可以使用Kafka支持的任何消费者财产。唯一的要求是使用前缀kafka.consumer添加属性名称 。例如:kafka.consumer.auto.offset.reset |

** 注意 **

Kafka Source会覆盖两个Kafka使用者参数:source 和每次batch 提交的时候会将auto.commit.enable设置为“false”,并提交每个批处理。Kafka Source至少保证一次消息检索策略。

source启动时可以存在重复项。

Kafka Source还提供了key.deserializer(org.apache.kafka.common.serialization.StringSerializer)和value.deserializer(org.apache.kafka.common.serialization.ByteArraySerializer)的默认值。

不建议修改这些参数。

不推荐使用的属性

| 属性名称 | 默认 | 描述 |

|---|---|---|

| topic | - | 使用kafka.topics |

| groupId | flume | 使用kafka.consumer.group.id |

| zookeeperConnect | - | 自0.9.x起不再受kafka消费者客户端的支持。使用kafka.bootstrap.servers与kafka集群建立连接 |

| migrateZookeeperOffsets | true | 如果找不到Kafka存储的偏移量,请在Zookeeper中查找偏移量并将它们提交给Kafka。这应该是支持从旧版本的Flume无缝Kafka客户端迁移。迁移后,可以将其设置为false,但通常不需要这样做。如果未找到Zookeeper偏移量,则Kafka配置kafka.consumer.auto.offset.reset定义如何处理偏移量。 有关详细信息,请查看Kafka文档 |

通过逗号分隔的主题列表进行主题订阅的示例:

tier1.sources.source1.type = org.apache.flume.source.kafka.KafkaSource

tier1.sources.source1.channels = channel1

tier1.sources.source1.batchSize = 5000

tier1.sources.source1.batchDurationMillis = 2000

tier1.sources.source1.kafka.bootstrap.servers = localhost:9092

tier1.sources.source1.kafka.topics = test1, test2

tier1.sources.source1.kafka.consumer.group.id = custom.g.id

正则表达式主题订阅的示例:

ier1.source.source1.type = org.apache.flume.source.kafka.KafkaSource

tier1.source.source1.channel = channel1

tier1.source.source1.kafka.bootstrap.servers = 本地主机:9092

tier1.source.source1.kafka .topics.regex = ^ topic [0-9] $

#默认使用kafka.consumer.group.id = flume

** Security 和 Kafka Source:**

Flume和Kafka之间的通信渠道支持安全认证和数据加密。对于安全身份验证,可以使用Kafka 0.9.0版中的SASL / GSSAPI(Kerberos V5)或SSL(即使该参数名为SSL,实际协议是TLS实现)

截至目前,数据加密仅由SSL / TLS提供。

将kafka.consumer.security.protocol设置为以下任何值意味着:

- SASL_PLAINTEXT - 无数据加密的Kerberos或纯文本身份验证

- SASL_SSL - 使用数据加密的Kerberos或纯文本身份验证

- SSL - 基于TLS的加密,带有可选的身份验证

** 警告 **

启用SSL时性能会下降,其大小取决于CPU类型和JVM实现。参考:Kafka安全概述 和跟踪此问题的jira: KAFKA-2561

** TLS 和 Kafka Source:**

请阅读配置Kafka客户端SSL中描述的步骤, 以了解用于微调的其他配置设置,例如以下任何一项:安全提供程序,密码套件,启用的协议,信任库或密钥库类型。

配置服务器端身份验证和数据加密的示例:

a1.sources.source1.type = org.apache.flume.source.kafka.KafkaSource

a1.sources.source1.kafka.bootstrap.servers = kafka-1:9093,kafka-2:9093,kafka-3:9093

a1.sources.source1.kafka.topics = mytopic

a1.sources.source1.kafka.consumer.group.id = flume-consumer

a1.sources.source1.kafka.consumer.security.protocol = SSL

# optional, the global truststore can be used alternatively

a1.sources.source1.kafka.consumer.ssl.truststore.location=/path/to/truststore.jks

a1.sources.source1.kafka.consumer.ssl.truststore.password=<password to access the truststore>

在此处指定信任库是可选的,可以使用全局信任库。有关全局SSL设置的更多详细信息,请参阅SSL / TLS支持部分

注意:默认情况下, 未定义属性ssl.endpoint.identification.algorithm,因此不会执行主机名验证。要启用主机名验证,请设置以下属性

a1.sources.source1.kafka.consumer.ssl.endpoint.identification.algorithm=HTTPS

启用后,客户端将根据以下两个字段之一验证服务器的完全限定域名(FQDN):

- 通用名称(CN)https://tools.ietf.org/html/rfc6125#section-2.3

- 主题备选名称(SAN)https://tools.ietf.org/html/rfc5280#section-4.2.1.6

如果还需要客户端身份验证,则还需要将以下内容添加到Flume agent 配置中,或者可以使用全局SSL设置(请参阅SSL / TLS支持部分)。每个Flume agent 都必须拥有其客户证书,Kafka经纪人必须单独或通过其签名链来信任。常见示例是由单个根CA签署每个客户端证书,而后者又由Kafka经纪人信任。

# optional, the global keystore can be used alternatively

a1.sources.source1.kafka.consumer.ssl.keystore.location=/path/to/client.keystore.jks

a1.sources.source1.kafka.consumer.ssl.keystore.password=<password to access the keystore>

** Kerberos 和 Kafka source **

要将Kafka source与使用Kerberos保护的Kafka群集一起使用,请为消费者设置上面提到的consumer.security.protocol属性。与Kafka agent 一起使用的Kerberos密钥表和主体在JAAS文件的“KafkaClient”部分中指定。“客户端”部分描述了Zookeeper连接(如果需要)。有关 JAAS文件内容的信息,请参阅Kafka doc。可以通过flume-env.sh中的JAVA_OPTS指定此JAAS文件的位置以及可选的系统范围的kerberos配置:

JAVA_OPTS="$JAVA_OPTS -Djava.security.krb5.conf=/path/to/krb5.conf"

JAVA_OPTS="$JAVA_OPTS -Djava.security.auth.login.config=/path/to/flume_jaas.conf"

使用SASL_PLAINTEXT的示例安全配置:

a1.sources.source1.type = org.apache.flume.source.kafka.KafkaSource

a1.sources.source1.kafka.bootstrap.servers = kafka-1:9093,kafka-2:9093,kafka-3:9093

a1.sources.source1.kafka.topics = mytopic

a1.sources.source1.kafka.consumer.group.id = flume-consumer

a1.sources.source1.kafka.consumer.security.protocol = SASL_PLAINTEXT

a1.sources.source1.kafka.consumer.sasl.mechanism = GSSAPI

a1.sources.source1.kafka.consumer.sasl.kerberos.service.name = kafka

使用SASL_SSL的安全配置示例:

a1.sources.source1.type = org.apache.flume.source.kafka.KafkaSource

a1.sources.source1.kafka.bootstrap.servers = kafka-1:9093,kafka-2:9093,kafka-3:9093

a1.sources.source1.kafka.topics = mytopic

a1.sources.source1.kafka.consumer.group.id = flume-consumer

a1.sources.source1.kafka.consumer.security.protocol = SASL_SSL

a1.sources.source1.kafka.consumer.sasl.mechanism = GSSAPI

a1.sources.source1.kafka.consumer.sasl.kerberos.service.name = kafka

# optional, the global truststore can be used alternatively

a1.sources.source1.kafka.consumer.ssl.truststore.location=/path/to/truststore.jks

a1.sources.source1.kafka.consumer.ssl.truststore.password=<password to access the truststore>

示例JAAS文件。有关其内容的参考,请参阅SASL配置的 Kafka文档中所需认证机制(GSSAPI / PLAIN)的客户端配置部分。由于Kafka Source也可能连接到Zookeeper以进行偏移迁移,因此“Client”部分也添加到此示例中。除非您需要偏移迁移,否则不需要这样做,或者您需要此部分用于其他安全组件。另外,请确保Flume进程的操作系统用户对jaas和keytab文件具有读权限。

Client {

com.sun.security.auth.module.Krb5LoginModule required

useKeyTab=true

storeKey=true

keyTab="/path/to/keytabs/flume.keytab"

principal="flume/flumehost1.example.com@YOURKERBEROSREALM";

};

KafkaClient {

com.sun.security.auth.module.Krb5LoginModule required

useKeyTab=true

storeKey=true

keyTab="/path/to/keytabs/flume.keytab"

principal="flume/flumehost1.example.com@YOURKERBEROSREALM";

};

NetCat TCP source

类似于netcat的source,它侦听给定端口并将每行文本转换为event 。像nc -k -l [host] [port]这样的行为。换句话说,它打开一个指定的端口并监听数据。期望是提供的数据是换行符分隔的文本。每行文本都转换为Flume event ,并通过连接的channel发送。必需属性以 粗体显示

| Property Name | Default | Description |

|---|---|---|

| channels | – | |

| type | – | The component type name, needs to be netcat |

| bind | – | Host name or IP address to bind to |

| port | – | Port # to bind to |

| max-line-length | 512 | Max line length per event body (in bytes) |

| ack-every-event | true | Respond with an “OK” for every event received |

| selector.type | replicating | replicating or multiplexing |

| selector.* | Depends on the selector.type value | |

| interceptors | – | Space-separated list of interceptors |

| interceptors.* |

Example for agent named a1:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = netcat

a1.sources.r1.bind = 0.0.0.0

a1.sources.r1.port = 6666

a1.sources.r1.channels = c1

NetCat UDP source

根据原始的Netcat(TCP)source,该source监听给定端口并将每行文本转换为event 并通过连接的channel发送。像nc -u -k -l [host] [port]这样的行为。必需属性以 粗体显示

| Property Name | Default | Description |

|---|---|---|

| channels | – | |

| type | – | The component type name, needs to be netcatudp |

| bind | – | Host name or IP address to bind to |

| port | – | Port # to bind to |

| remoteAddressHeader | – | |

| selector.type | replicating | replicating or multiplexing |

| selector.* | Depends on the selector.type value | |

| interceptors | – | Space-separated list of interceptors |

| interceptors.* |

agent 名为a1的示例:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = netcatudp

a1.sources.r1.bind = 0.0.0.0

a1.sources.r1.port = 6666

a1.sources.r1.channels = c1

Sequence Generator Source

一个简单的sequence 生成器,它使用从0开始的计数器连续生成event ,递增1并在totalEvents处停止。无法向channel 发送event 时重试。主要用于测试。在重试期间,它使重试消息的主体保持与以前相同,以便在目的地重复数据删除之后,唯一event 的数量应等于指定的totalEvents。必需属性以粗体显示

| Property Name | Default | Description |

|---|---|---|

| channels | – | |

| type | – | The component type name, needs to be seq |

| selector.type | replicating or multiplexing | |

| selector.* | replicating | Depends on the selector.type value |

| interceptors | – | Space-separated list of interceptors |

| interceptors.* | ||

| batchSize | 1 | Number of events to attempt to process per request loop. |

| totalEvents | Long.MAX_VALUE | Number of unique events sent by the source. |

Example for agent named a1:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = seq

a1.sources.r1.channels = c1

Syslog Source

读取syslog数据并生成Flume event 。UDP source将整个消息视为单个event 。TCPsource为每个由换行符('n')分隔的字符串创建一个新 event

必需属性以粗体显示

Syslog TCPsource

原始的,经过验证的syslog TCPsource代码

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channels | - | |

| type | - | 组件类型名称,需要是 syslogtcp |

| host | - | 要绑定的主机名或IP地址 |

| port | - | 要绑定的端口号 |

| eventSize | 2500 | 单个event 行的最大大小(以字节为单位) |

| keepFields | none | 将此设置为“all”将保留event 正文中的Priority,Timestamp和Hostname。还允许包含间隔开的字段列表。目前,可以包括以下字段:优先级,版本,时间戳,主机名。值'true'和'false'已被弃用,采用'all'和'none'。 |

| clientIPHeader | - | 如果指定,客户端的IP地址将使用此处指定的标头名称存储在每个event 的标头中。这允许拦截器和channel选择器基于客户端的IP地址定制路由逻辑。不要在此处使用标准Syslog标头名称(如_host_),因为在这种情况下将覆盖event 标头。 |

| clientHostnameHeader | - | 如果指定,则客户端的主机名将使用此处指定的标头名称存储在每个event 的标头中。这允许拦截器和channel选择器基于客户端的主机名自定义路由逻辑。检索主机名可能涉及名称服务反向查找,这可能会影响性能。不要在此处使用标准Syslog标头名称(如_host_),因为在这种情况下将覆盖event 标头。 |

| selector.type | replicating or multiplexing | |

| selector.* | replicating | 取决于selector.type值 |

| interceptors | - | 以空格分隔的拦截器列表 |

| interceptors.* | ||

| SSL | false | 将其设置为true以启用SSL加密。如果启用了SSL,则还必须通过组件级参数(请参阅下文)或全局SSL参数(请参阅SSL / TLS支持部分)指定“密钥库”和“密钥库密码” 。 |

| keystore | - | 这是Java密钥库文件的路径。如果未在此处指定,则将使用全局密钥库(如果已定义,则配置错误)。 |

| keystore-password | - | Java密钥库的密码。如果未在此处指定,则将使用全局密钥库密码(如果已定义,则配置错误)。 |

| keystore-type | JKS | Java密钥库的类型。这可以是“JKS”或“PKCS12”。如果未在此处指定,则将使用全局密钥库类型(如果已定义,则默认为JKS)。 |

| exclude-protocols | SSLv3 | 要排除的以空格分隔的SSL / TLS协议列表。除指定的协议外,将始终排除SSLv3。 |

| include-protocols | - | 要包含的以空格分隔的SSL / TLS协议列表。启用的协议将是包含的协议,没有排除的协议。如果包含协议为空,则它包括每个支持的协议。 |

| exclude-cipher-suites | - | 要排除的以空格分隔的密码套件列表。 |

| include-cipher-suites | - | 以空格分隔的密码套件列表。启用的密码套件将是包含的密码套件,不包括排除的密码套件。如果included-cipher-suites为空,则包含每个支持的密码套件。 |

For example, a syslog TCP source for agent named a1:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = syslogtcp

a1.sources.r1.port = 5140

a1.sources.r1.host = localhost

a1.sources.r1.channels = c1

多端口Syslog TCP source

这是Syslog TCPsource的更新,更快,多端口版本。请注意,端口配置设置已替换端口。多端口功能意味着它可以以有效的方式一次监听多个端口。此source使用Apache Mina库来执行此操作。提供对RFC-3164和许多常见RFC-5424格式消息的支持。还提供了配置基于每个端口的字符集的功能。

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channels | - | |

| type | - | 组件类型名称,需要是multiport_syslogtcp |

| host | - | 要绑定的主机名或IP地址。 |

| ports | - | 要绑定到的空格分隔列表(一个或多个)。 |

| eventSize | 2500 | 单个event 行的最大大小(以字节为单位)。 |

| keepFields | none | 将此设置为“all”将保留event 正文中的Priority,Timestamp和Hostname。还允许包含间隔开的字段列表。目前,可以包括以下字段:优先级,版本,时间戳,主机名。值'true'和'false'已被弃用,采用'all'和'none'。 |

| portHeader | - | 如果指定,端口号将使用此处指定的标头名称存储在每个event 的标头中。这允许拦截器和channel选择器基于传入端口定制路由逻辑。 |

| clientIPHeader | - | 如果指定,客户端的IP地址将使用此处指定的标头名称存储在每个event 的标头中。这允许拦截器和channel选择器基于客户端的IP地址定制路由逻辑。不要在此处使用标准Syslog标头名称(如_host_),因为在这种情况下将覆盖event 标头。 |

| clientHostnameHeader | - | 如果指定,则客户端的主机名将使用此处指定的标头名称存储在每个event 的标头中。这允许拦截器和channel选择器基于客户端的主机名自定义路由逻辑。检索主机名可能涉及名称服务反向查找,这可能会影响性能。不要在此处使用标准Syslog标头名称(如_host_),因为在这种情况下将覆盖event 标头。 |

| charset.default | UTF-8 | 将syslogevent 解析为字符串时使用的默认字符集。 |

| charset.port | - | 字符集可基于每个端口进行配置。 |

| BATCHSIZE | 100 | 每个请求循环尝试处理的最大event 数。使用默认值通常很好。 |

| readBufferSize | 1024 | 内部Mina读缓冲区的大小。提供性能调整。使用默认值通常很好。 |

| numProcessors | (auto-detected) | 处理消息时系统上可用的处理器数量。默认是使用Java Runtime API自动检测CPU数量。Mina将为每个检测到的CPU生成2个请求处理线程,这通常是合理的。 |

| selector.type | replicating | replicating, multiplexing, or custom |

| selector.* | - | 取决于selector.type值 |

| interceptors | - | 以空格分隔的拦截器列表。 |

| interceptors.* | ||

| SSL | false | 将其设置为true以启用SSL加密。如果启用了SSL,则还必须通过组件级参数(请参阅下文)或全局SSL参数(请参阅SSL / TLS支持部分)指定“密钥库”和“密钥库密码” 。 |

| keystore | - | 这是Java密钥库文件的路径。如果未在此处指定,则将使用全局密钥库(如果已定义,则配置错误)。 |

| keystore-password | - | Java密钥库的密码。如果未在此处指定,则将使用全局密钥库密码(如果已定义,则配置错误)。 |

| keystore-type | JKS | Java密钥库的类型。这可以是“JKS”或“PKCS12”。如果未在此处指定,则将使用全局密钥库类型(如果已定义,则默认为JKS)。 |

| exclude-protocols | SSLv3 | 要排除的以空格分隔的SSL / TLS协议列表。除指定的协议外,将始终排除SSLv3。 |

| include-protocols | - | 要包含的以空格分隔的SSL / TLS协议列表。启用的协议将是包含的协议,没有排除的协议。如果包含协议为空,则它包括每个支持的协议。 |

| exclude-cipher-suites | - | 要排除的以空格分隔的密码套件列表。 |

| include-cipher-suites | - | 以空格分隔的密码套件列表。启用的密码套件将是包含的密码套件,不包括排除的密码套件。如果included-cipher-suites为空,则包含每个支持的密码套件。 |

For example, a multiport syslog TCP source for agent named a1:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = multiport_syslogtcp

a1.sources.r1.channels = c1

a1.sources.r1.host = 0.0.0.0

a1.sources.r1.ports = 10001 10002 10003

a1.sources.r1.portHeader = port

Syslog UDPsource

| Property Name | Default | Description |

|---|---|---|

| channels | – | |

| type | – | The component type name, needs to be syslogudp |

| host | – | Host name or IP address to bind to |

| port | – | Port # to bind to |

| keepFields | false | Setting this to true will preserve the Priority, Timestamp and Hostname in the body of the event. |

| clientIPHeader | – | If specified, the IP address of the client will be stored in the header of each event using the header name specified here. This allows for interceptors and channel selectors to customize routing logic based on the IP address of the client. Do not use the standard Syslog header names here (like _host_) because the event header will be overridden in that case. |

| clientHostnameHeader | – | If specified, the host name of the client will be stored in the header of each event using the header name specified here. This allows for interceptors and channel selectors to customize routing logic based on the host name of the client. Retrieving the host name may involve a name service reverse lookup which may affect the performance. Do not use the standard Syslog header names here (like _host_) because the event header will be overridden in that case. |

| selector.type | replicating or multiplexing | |

| selector.* | replicating | Depends on the selector.type value |

| interceptors | – | Space-separated list of interceptors |

| interceptors.* |

For example, a syslog UDP source for agent named a1:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = syslogudp

a1.sources.r1.port = 5140

a1.sources.r1.host = localhost

a1.sources.r1.channels = c1

HTTP Source<

通过HTTP POST和GET接受Flumeevent 的source。GET应仅用于实验。HTTP请求由可插入的“处理程序”转换为flume event ,该处理程序必须实现HTTPSourceHandler接口。该处理程序获取HttpServletRequest并返回flume event 列表。从一个Http请求处理的所有event 都在一个事务中提交给channel,从而允许在诸如文件channel之类的channel上提高效率。如果处理程序抛出异常,则此source将返回HTTP状态400.如果channel已满,或者source无法将event 附加到channel,则source将返回HTTP 503 - 暂时不可用状态

在一个发布请求中发送的所有event 都被视为一个批处理,并在一个事务中插入到channel中

此source基于Jetty 9.4,并提供了设置其他Jetty特定参数的功能,这些参数将直接传递给Jetty组件

| 属性名称 | 默认 | 描述 |

|---|---|---|

| type | 组件类型名称需要为http | |

| port | - | source应绑定的端口。 |

| bind | 0.0.0.0 | 要侦听的主机名或IP地址 |

| handler | org.apache.flume.source.http.JSONHandler | 处理程序类的FQCN。 |

| handler.* | - | 配置处理程序的参数 |

| selector.type | replicating | replicating or multiplexing |

| selector.* | 取决于selector.type值 | |

| interceptors | - | 以空格分隔的拦截器列表 |

| interceptors.* | ||

| SSL | 假 | 将属性设置为true,以启用SSL。HTTP Source不支持SSLv3。 |

| exclude-protocols | 在SSLv3 | 要排除的以空格分隔的SSL / TLS协议列表。除指定的协议外,将始终排除SSLv3。 |

| include-protocols | - | 要包含的以空格分隔的SSL / TLS协议列表。启用的协议将是包含的协议,没有排除的协议。如果包含协议为空,则它包括每个支持的协议。 |

| exclude-cipher-suites | - | 要排除的以空格分隔的密码套件列表。 |

| include-cipher-suites | - | 以空格分隔的密码套件列表。启用的密码套件将是包含的密码套件,不包括排除的密码套件。 |

| keystore | 密钥库的位置,包括密钥库文件名。如果启用了SSL但未在此处指定密钥库,则将使用全局密钥库(如果已定义,则配置错误)。 | |

| keystore-password | 密钥库密码。如果启用了SSL但未在此处指定密钥库密码,则将使用全局密钥库密码(如果已定义,则配置错误)。 | |

| keystore-type | JKS | 密钥库类型。这可以是“JKS”或“PKCS12”。 |

| QueuedThreadPool.* | 要在org.eclipse.jetty.util.thread.QueuedThreadPool上设置的Jetty特定设置。NB QueuedThreadPool仅在设置了此类的至少一个属性时使用。 | |

| HttpConfiguration.* | 要在org.eclipse.jetty.server.HttpConfiguration上设置Jetty特定设置 | |

| SslContextFactory.* | 要在org.eclipse.jetty.util.ssl.SslContextFactory上设置的Jetty特定设置(仅在ssl设置为true时适用)。 | |

| ServerConnector.* | 要在org.eclipse.jetty.server.ServerConnector上设置的Jetty特定设置 |

不推荐使用的属性

| 物业名称 | 默认 | 描述 |

|---|---|---|

| keystorePassword | - | 使用密钥库密码。不推荐的值将被新的值覆盖。 |

| excludeProtocols | SSLv3 | 使用exclude-protocols。不推荐的值将被新的值覆盖。 |

| enableSSL | false | 使用ssl。不推荐的值将被新的值覆盖。 |

NB使用上面列出的对象上的setter-methods设置Jetty特定设置。有关完整的详细信息,请参阅这些类的Javadoc(QueuedThreadPool, HttpConfiguration,SslContextFactory和 ServerConnector)

使用特定于Jetty的设置时,上面命名的属性将优先(例如,excludeProtocols将优先于SslContextFactory.ExcludeProtocols)。所有房产都是小写的。

An example http source for agent named a1:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = http

a1.sources.r1.port = 5140

a1.sources.r1.channels = c1

a1.sources.r1.handler = org.example.rest.RestHandler

a1.sources.r1.handler.nickname = random props

a1.sources.r1.HttpConfiguration.sendServerVersion = false

a1.sources.r1.ServerConnector.idleTimeout = 300

JSONHandler

开箱即用的处理程序可以处理以JSON格式表示的event ,并支持UTF-8,UTF-16和UTF-32字符集。处理程序接受一个event 数组(即使只有一个event ,event 必须在数组中发送),并根据请求中指定的编码将它们转换为Flumeevent 。如果未指定编码,则假定为UTF-8。JSON处理程序支持UTF-8,UTF-16和UTF-32。event 表示如下。

[{

"headers" : {

"timestamp" : "434324343",

"host" : "random_host.example.com"

},

"body" : "random_body"

},

{

"headers" : {

"namenode" : "namenode.example.com",

"datanode" : "random_datanode.example.com"

},

"body" : "really_random_body"

}]

要设置charset,请求必须具有指定为application/json的 内容类型 ; charset = UTF-8(根据需要用UTF-16或UTF-32替换UTF-8)

以此处理程序所期望的格式创建event 的一种方法是使用Flume SDK中提供的JSONEvent并使用Google Gson使用Gson#fromJson(Object,Type)方法创建JSON字符串。要作为event 列表的此方法的第二个参数传递的类型标记可以通过以下方式创建:

Type type = new TypeToken<List<JSONEvent>>() {}.getType();

BlobHandler

默认情况下,HTTPSource将JSON输入拆分为Flumeevent 。作为替代方案,BlobHandler是HTTPSource的处理程序,它返回包含请求参数的event 以及使用此请求上载的二进制大对象(BLOB)。例如PDF或JPG文件。请注意,此方法不适用于非常大的对象,因为它会将整个BLOB缓存在RAM中。

| 属性名称 | 默认 | 描述 |

|---|---|---|

| handler | - | 此类的FQCN:org.apache.flume.sink.solr.morphline.BlobHandler |

| handler.maxBlobLength | 100000000 | 要读取的最大字节数和给定请求的缓冲区 |

Stress source

StressSource是一个内部负载生成source实现,对压力测试非常有用。它允许用户使用空标头配置event 有效负载的大小。用户可以配置要发送的event 总数以及要传递的最大成功event 数。

必需属性以粗体显示

| 物业名称 | 默认 | 描述 |

|---|---|---|

| type | - | 组件类型名称,需要是org.apache.flume.source.StressSource |

| size | 500 | 每个event 的有效载荷大小。单位:字节 |

| maxTotalEvents | -1 | 要发送的最大event 数 |

| maxSuccessfulEvents | -1 | 成功发送的最大event 数 |

| BATCHSIZE | 1 | 一批中要发送的event 数 |

| maxEventsPerSecond | 0 | 设置为大于零的整数时,在source上强制执行速率限制。 |

Example for agent named a1:

a1.sources = stresssource-1

a1.channels = memoryChannel-1

a1.sources.stresssource-1.type = org.apache.flume.source.StressSource

a1.sources.stresssource-1.size = 10240

a1.sources.stresssource-1.maxTotalEvents = 1000000

a1.sources.stresssource-1.channels = memoryChannel-1

Legacy Sources

legacy source允许Flume 1.x agent 从Flume 0.9.4 agent 接收event 。它接受Flume 0.9.4格式的event ,将它们转换为Flume 1.0格式,并将它们存储在连接的channel中。0.9.4event 属性(如timestamp,pri,host,nanos等)将转换为1.xevent 头属性。旧版source支持Avro和Thrift RPC连接。要在两个Flume版本之间使用此桥接,您需要使用avroLegacy或thriftLegacysource启动Flume 1.x agent 。0.9.4 agent 应该让 agent Sink指向1.x agent 的主机/端口。

注意

Flume 1.x的可靠性语义与Flume 0.9.x的可靠性语义不同。旧版source不支持Flume 0.9.x agent 的E2E或DFO模式。唯一支持的0.9.x模式是尽力而为,尽管1.x流的可靠性设置将适用于传统source保存到Flume 1.xchannel后的event

必需属性以粗体显示

Avro Legacy Source

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channels | - | |

| type | - | 组件类型名称,需要是org.apache.flume.source.avroLegacy.AvroLegacySource |

| host | - | 要绑定的主机名或IP地址 |

| port | - | 要听的端口# |

| selector.type | replicating or multiplexing | |

| selector.* | replicating | 取决于selector.type值 |

| interceptors | - | 以空格分隔的拦截器列表 |

| interceptors.* |

Example for agent named a1:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = org.apache.flume.source.avroLegacy.AvroLegacySource

a1.sources.r1.host = 0.0.0.0

a1.sources.r1.bind = 6666

a1.sources.r1.channels = c1

Thrift Legacy Source

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channels | - | |

| type | - | 组件类型名称,需要是org.apache.flume.source.thriftLegacy.ThriftLegacySource |

| host | - | 要绑定的主机名或IP地址 |

| port | - | 要听的端口# |

| selector.type | replicating or multiplexing | |

| selector.* | replicating | 取决于selector.type值 |

| interceptors | - | 以空格分隔的拦截器列表 |

| interceptors.* |

Example for agent named a1:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = org.apache.flume.source.thriftLegacy.ThriftLegacySource

a1.sources.r1.host = 0.0.0.0

a1.sources.r1.bind = 6666

a1.sources.r1.channels = c1

Custom Source

自定义source是您自己的Source接口实现。启动Flume agent 时,自定义source的类及其依赖项必须包含在 agent 程序的类路径中。自定义source的类型是其FQCN。

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channels | - | |

| type | - | 组件类型名称,需要是您的FQCN |

| selector.type | replicating or multiplexing | |

| selector.* | replicating | 取决于selector.type值 |

| interceptors | - | 以空格分隔的拦截器列表 |

| interceptors.* |

Example for agent named a1:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = org.example.MySource

a1.sources.r1.channels = c1

Scribe Source

Scribe是另一种摄取系统。要采用现有的Scribe摄取系统,Flume应该使用基于Thrift的ScribeSource和兼容的传输协议。要部署Scribe,请遵循Facebook的指南。必需属性以粗体显示

| 属性名称 | 默认 | 描述 |

|---|---|---|

| type | - | 组件类型名称,需要是org.apache.flume.source.scribe.ScribeSource |

| port | 1499 | 应该连接Scribe的端口 |

| maxReadBufferBytes | 16384000 | Thrift默认FrameBuffer大小 |

| workerThreads | 5 | 在Thrift中处理线程数 |

| selector.type | ||

| selector.* |

Example for agent named a1:

a1.sources = r1

a1.channels = c1

a1.sources.r1.type = org.apache.flume.source.scribe.ScribeSource

a1.sources.r1.port = 1463

a1.sources.r1.workerThreads = 5

a1.sources.r1.channels = c1

Flume Sinks

HDFS Sink

此sink将event 写入Hadoop分布式文件系统(HDFS)。它目前支持创建文本和序列文件。它支持两种文件type的压缩。可以根据经过的时间或数据大小或event 数量定期滚动文件(关闭当前文件并创建新文件)。它还根据 event source自的时间戳或机器等属性对数据进行分区/分区。HDFS目录路径可能包含格式转义序列,将由HDFS sink 替换,以生成用于存储event 的目录/文件名。使用此sink需要安装hadoop,以便Flume可以使用Hadoop jar与HDFS集群进行通信。请注意,需要支持sync()调用的Hadoop版本。

以下是支持的转义序列:

| 别号 | 描述 |

|---|---|

| %{host} | 名为“host”的event 标头的替换值。支持任意标题名称。 |

| %T | Unix时间,以毫秒为单位 |

| %a | locale的工作日短名称(周一,周二,......) |

| %A | locale的完整工作日名称(周一,周二......) |

| %b | locale的短月名(Jan,Feb,...) |

| %B | locale的长月名(1月,2月......) |

| %C | locale的日期和时间(2005年3月3日23:05:25) |

| %d | 每月的一天(01) |

| %E | 没有填充的月份日(1) |

| %d | 日期; 与%m /%d /%y相同 |

| %H | 小时(00..23) |

| %I | 小时(01..12) |

| %j | 一年中的一天(001..366) |

| %K | 小时(0..23) |

| %M | 月(01..12) |

| %N | 没有填充的月份(1..12) |

| %M | 分钟(00..59) |

| %p | locale相当于am或pm |

| %S | 自1970-01-01 00:00:00 UTC以来的秒数 |

| %S | 第二(00..59) |

| %Y | 年份的最后两位数(00..99) |

| %Y | 年(2010年) |

| %Z | + hhmm数字时区(例如,-0400) |

| %[localhost] | 替换运行 agent 程序的主机的hostname |

| %[IP] | 替换运行 agent 程序的主机的IP地址 |

| %[FQDN] | 替换运行 agent 程序的主机的规范hostname |

注意:转义字符串%[localhost],%[IP]和%[FQDN]都依赖于Java获取hostname的能力,这在某些网络环境中可能会失败。

正在使用的文件将在名称末尾包含“.tmp”。文件关闭后,将删除此扩展程序。这允许排除目录中的部分完整文件。必需属性以粗体显示

注意

对于所有与时间相关的转义序列,event 标题中必须存在带有“timestamp”键的标头(除非hdfs.useLocalTimeStamp设置为true)。自动添加此方法的一种方法是使用TimestampInterceptor。

| 名称 | 默认 | 描述 |

|---|---|---|

| channel | - | |

| type | - | 组件type名称,需要是hdfs |

| hdfs.path | - | HDFS目录路径( eg hdfs://namenode/flume/webdata/ ) |

| hdfs.filePrefix | FlumeData | 名称前缀为Flume在hdfs目录中创建的文件 |

| hdfs.fileSuffix | - | 附加到文件的后缀(例如.avro - 注意:不会自动添加句点) |

| hdfs.inUsePrefix | - | 用于水槽主动写入的临时文件的前缀 |

| hdfs.inUseSuffix | .TMP | 用于临时文件的后缀,flume主动写入 |

| hdfs.emptyInUseSuffix | false | 如果为false,则在写入输出时使用hdfs.inUseSuffix。关闭输出后,hdfs.inUseSuffix将从输出文件名中删除。如果为true,则忽略hdfs.inUseSuffix参数,而是使用空字符串。 |

| hdfs.rollInterval | 30 | 滚动当前文件之前等待的秒数(0 =根据时间间隔从不滚动) |

| hdfs.rollSize | 1024 | 触发滚动的文件大小,以字节为单位(0:永不基于文件大小滚动) |

| hdfs.rollCount | 10 | 在滚动之前写入文件的event 数(0 =从不基于event 数滚动) |

| hdfs.idleTimeout | 0 | 超时后非活动文件关闭(0 =禁用自动关闭空闲文件) |

| hdfs.batchSize | 100 | 在将文件刷新到HDFS之前写入文件的event 数 |

| hdfs.codeC | - | 压缩编解码器。以下之一:gzip,bzip2,lzo,lzop,snappy |

| hdfs.fileType | SequenceFile | 文件格式:当前SequenceFile,DataStream或CompressedStream (1)DataStream不会压缩输出文件,请不要设置codeC(2)CompressedStream需要使用可用的codeC设置hdfs.codeC |

| hdfs.maxOpenFiles | 5000 | 仅允许此数量的打开文件。如果超过此数量,则关闭最旧的文件。 |

| hdfs.minBlockReplicas | - | 指定每个HDFS块的最小副本数。如果未指定,则它来自类路径中的默认Hadoop配置。 |

| hdfs.writeFormat | 可写 | 序列文件记录的格式。一个文本或可写。在使用Flume创建数据文件之前设置为Text,否则Apache Impala(孵化)或Apache Hive无法读取这些文件。 |

| hdfs.threadsPoolSize | 10 | HDFS IO操作的每个HDFS sink的线程数(open, write, etc. ) |

| hdfs.rollTimerPoolSize | 1 | 每个HDFS sink用于调度定时文件滚动的线程数 |

| hdfs.kerberosPrincipal | - | 用于访问安全HDFS的Kerberos用户主体 |

| hdfs.kerberosKeytab | - | 用于访问安全HDFS的Kerberos密钥表 |

| hdfs.proxyUser | ||

| hdfs.round | false | 是否应将时间戳向下舍入(如果为true,则影响除%t之外的所有基于时间的转义序列) |

| hdfs.roundValue | 1 | 舍入到此最高倍(在使用hdfs.roundUnit配置的单位中),小于当前时间。 |

| hdfs.roundUnit | second | 舍入值的单位 - second, minute or hour. |

| hdfs.timeZone | Local Time | 应该用于解析目录路径的时区名称,例如America/Los_Angeles。 |

| hdfs.useLocalTimeStamp | false | 替换转义序列时,请使用本地时间(而不是event 头中的时间戳)。 |

| hdfs.closeTries | 0 | 启动近距离尝试后,sink必须尝试重命名文件的次数。如果设置为1,则此sink将不会重新尝试失败的重命名(例如,由于NameNode或DataNode失败),并且可能使文件处于打开状态,扩展名为.tmp。如果设置为0,sink将尝试重命名该文件,直到最终重命名该文件(它将尝试的次数没有限制)。如果关闭调用失败但数据将保持不变,则文件可能仍保持打开状态,在这种情况下,只有在Flume重启后文件才会关闭。 |

| hdfs.retryInterval | 180 | 连续尝试关闭文件之间的时间(以秒为单位)。每次关闭调用都会花费多次RPC往返Namenode,因此将此设置得太低会导致名称节点上的大量负载。如果设置为0或更小,则如果第一次尝试失败,sink将不会尝试关闭文件,并且可能使文件保持打开状态或扩展名为“.tmp”。 |

| serializer | TEXT | 其他可能的选项包括avro_event或EventSerializer.Builder接口的实现的完全限定类名 。 |

| serializer.* |

不推荐使用的属性:

| 名称 | 默认 | 描述 |

| hdfs.callTimeout | 30000 | HDFS操作允许的毫秒数,例如open,write,flush,close。 如果发生许多HDFS超时操作,则应增加此数量。 |

Example for agent named a1:

a1.channels = c1

a1.sinks = k1

a1.sinks.k1.type = hdfs

a1.sinks.k1.channel = c1

a1.sinks.k1.hdfs.path = /flume/events/%y-%m-%d/%H%M/%S

a1.sinks.k1.hdfs.filePrefix = events-

a1.sinks.k1.hdfs.round = true

a1.sinks.k1.hdfs.roundValue = 10

a1.sinks.k1.hdfs.roundUnit = minute

以上配置将时间戳向下舍入到最后10分钟。例如,时间戳为2012年6月12日上午11:54:34的event 将导致hdfs路径变为

/flume/events/2012-06-12/1150/00.

Hive Sink

此sink将包含分隔文本或JSON数据的event 直接流式传输到Hive表或分区。event 使用Hive事务编写。一旦将一组event 提交给Hive,它们就会立即显示给Hive查询。水槽将流入的分区既可以预先创建,也可以选择Flume创建它们,如果它们缺失的话。传入event 数据中的字段将映射到Hive表中的相应列

| 名称 | 默认 | 描述 |

|---|---|---|

| channel | - | |

| type | - | 组件type名称需要是hive |

| hive.metastore | - | Hive Metastore URI( eg thrift://a.b.com:9083 ) |

| hive.database | - | Hive数据库名称 |

| hive.table | - | Hive表名 |

| hive.partition | - | 逗号分隔标识要写入的分区的分区值列表。可能包含转义序列。例如:如果表格被分区(大陆:字符串,国家:字符串,时间:字符串),那么'亚洲,印度,2014-02-26-01-21'将表示大陆=亚洲,国家=印度,时间= 2014 -02-26-01-21 |

| hive.txnsPerBatchAsk | 100 | Hive向Flume等流媒体客户端授予一批交易而非单笔交易。此设置配置每个事务批处理所需的事务数。来自单个批次中所有事务的数据最终都在一个文件中。Flume将在批处理中的每个事务中写入最多batchSizeevent 。此设置与batchSize一起提供对每个文件大小的控制。请注意,最终Hive会将这些文件透明地压缩为更大的文件。 |

| heartBeatInterval | 240 | (以秒为单位)发送到Hive的连续心跳之间的间隔,以防止未使用的事务过期。将此值设置为0可禁用心跳。 |

| autoCreatePartitions | true | Flume将自动创建必要的Hive分区以进行流式传输 |

| BATCHSIZE | 15000 | 在单个Hive事务中写入Hive的最大event 数 |

| maxOpenConnections | 500 | 仅允许此数量的打开连接。如果超过此数量,则关闭最近最少使用的连接。 |

| callTimeout | 10000 | (以毫秒为单位)Hive和HDFS I/O操作的超时,例如openTxn,write,commit,abort。 |

| serializer | Serializer负责解析event 中的字段并将它们映射到hive表中的列。serializer器的选择取决于event 中数据的格式。支持的序列化程序:DELIMITED和JSON | |

| roundUnit | minute | 舍入值的单位 - 秒,分钟或小时。 |

| roundValue | 1 | 舍入到此最高倍数(在使用hive.roundUnit配置的单位中),小于当前时间 |

| 时区 | Local Time | 应该用于解析分区中转义序列的时区名称,例如America / Los_Angeles。 |

| useLocalTimeStamp | false | 替换转义序列时,请使用本地时间(而不是event 头中的时间戳)。 |

为Hive sink提供了以下序列化程序:

JSON:处理UTF8编码的Json(严格语法)event ,不需要配置。JSON中的对象名称直接映射到Hive表中具有相同名称的列。内部使用org.apache.hive.hcatalog.data.JsonSerDe,但独立于Hive表的Serde。此序列化程序需要安装HCatalog。

DELIMITED:处理简单的分隔文本event 。内部使用LazySimpleSerde,但独立于Hive表的Serde。

| 名称 | 默认 | 描述 |

|---|---|---|

| serializer.delimiter | , | (type:字符串)传入数据中的字段分隔符。要使用特殊字符,请用双引号括起来,例如“\t” |

| serializer.fieldnames | - | 从输入字段到hive表中的列的映射。指定为hive表列名称的逗号分隔列表(无空格),按发生顺序标识输入字段。要跳过字段,请保留未指定的列名称。例如。'time ,, ip,message'表示输入映射到hive表中的time,ip和message列的第1,第3和第4个字段。 |

| serializer.serdeSeparator | Ctrl-A | (type:字符)自定义基础serde使用的分隔符。如果serializer.fieldnames中的字段与表列的顺序相同,则serializer.delimiter与serializer.serdeSeparator相同,并且serializer.fieldnames中的字段数小于或等于表的数量,可以提高效率列,因为传入event 正文中的字段不需要重新排序以匹配表列的顺序。对于'\t'这样的特殊字符使用单引号。确保输入字段不包含此字符。注意:如果serializer.delimiter是单个字符,最好将其设置为相同的字符 |

以下是支持的转义序列:

| 别号 | 描述 |

|---|---|

| %{host} | 名为“host”的event 标头的替换值。支持任意标题名称。 |

| %T | Unix时间,以毫秒为单位 |

| %a | locale的工作日短名称(周一,周二,......) |

| %A | locale的完整工作日名称(周一,周二......) |

| %b | locale的短月名(Jan,Feb,...) |

| %B | locale的长月名(1月,2月......) |

| %C | locale的日期和时间(2005年3月3日23:05:25) |

| %d | 每月的一天(01) |

| %d | 日期; 与%m /%d /%y相同 |

| %H | 小时(00..23) |

| %I | 小时(01..12) |

| %j | 一年中的一天(001..366) |

| %K | 小时(0..23) |

| %M | 月(01..12) |

| %M | 分钟(00..59) |

| %p | locale相当于am或pm |

| %S | 自1970-01-01 00:00:00 UTC以来的秒数 |

| %S | 第二(00..59) |

| %Y | 年份的最后两位数(00..99) |

| %Y | 年(2010年) |

| %Z | + hhmm 数字时区(例如,-0400) |

注意

对于所有与时间相关的转义序列,event 标题中必须存在具有键“timestamp”的标头(除非useLocalTimeStamp设置为true)。自动添加此方法的一种方法是使用TimestampInterceptor。

示例Hive表:

create table weblogs ( id int , msg string )

partitioned by (continent string, country string, time string)

clustered by (id) into 5 buckets

stored as orc;

Example for agent named a1:

a1.channels = c1

a1.channels.c1.type = memory

a1.sinks = k1

a1.sinks.k1.type = hive

a1.sinks.k1.channel = c1

a1.sinks.k1.hive.metastore = thrift://127.0.0.1:9083

a1.sinks.k1.hive.database = logsdb

a1.sinks.k1.hive.table = weblogs

a1.sinks.k1.hive.partition = asia,%{country},%y-%m-%d-%H-%M

a1.sinks.k1.useLocalTimeStamp = false

a1.sinks.k1.round = true

a1.sinks.k1.roundValue = 10

a1.sinks.k1.roundUnit = minute

a1.sinks.k1.serializer = DELIMITED

a1.sinks.k1.serializer.delimiter = "\t"

a1.sinks.k1.serializer.serdeSeparator = '\t'

a1.sinks.k1.serializer.fieldnames =id,,msg

以上配置将时间戳向下舍入到最后10分钟。例如,将时间戳标头设置为2012年6月12日上午11:54:34且“country”标头设置为“india”的event 将评估为分区(continent ='asia',country ='india',time ='2012-06-12-11-50'。序列化程序配置为接受包含三个字段的制表符分隔输入并跳过第二个字段。

Logger Sink

在INFO级别记录event 。通常用于测试/调试目的。必需属性以粗体显示。此sink是唯一的例外,它不需要在“ 记录原始数据”部分中说明的额外配置。

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channel | - | |

| type | - | 组件type名称,需要是 logger |

| maxBytesToLog | 16 | 要记录的event 主体的最大字节数 |

Example for agent named a1:

a1.channels = c1

a1.sinks = k1

a1.sinks.k1.type = logger

a1.sinks.k1.channel = c1

Avro Sink

这个Sink形成了Flume的分层收集支持的一半。发送到此sink的Flume event 将转换为Avro event 并发送到配置的hostname/port pair 。event 将从配置的channel中批量获取配置的批处理大小。必需属性以粗体显示

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channel | - | |

| type | - | 组件type名称,需要是avro。 |

| hostname | - | 要绑定的hostname或IP地址。 |

| port | - | 要听的端口#。 |

| batch-size | 100 | 要一起批量发送的event 数。 |

| connect-timeout | 20000 | 允许第一个(握手)请求的时间量(ms)。 |

| request-timeout | 20000 | 在第一个之后允许请求的时间量(ms)。 |

| reset-connection-interval | none | 重置连接到下一跳之前的时间量。这将迫使Avro Sink重新连接到下一跳。这将允许sink在添加新闻主机时连接到硬件负载平衡器后面的主机,而无需重新启动 agent 。 |

| compression-type | none | 这可以是“ none ”或“ deflate ”。压缩type必须与匹配AvroSource的压缩type匹配 |

| compression-level | 6 | 压缩event 的压缩级别。0 =无压缩,1-9是压缩。数字越大,压缩越多 |

| SSL | false | 设置为true以启用此AvroSink的SSL。配置SSL时,您可以选择设置“truststore”,“truststore-password”,“truststore-type”,并指定是否“trust-all-certs”。 |

| trust-all-certs | false | 如果将此设置为true,则不会检查远程服务器(Avrosource)的SSL服务器证书。这不应该在生产中使用,因为它使攻击者更容易执行中间人攻击并“监听”加密连接。 |

| truststore | - | 自定义Java信任库文件的路径。Flume使用此文件中的证书颁发机构信息来确定是否应该信任远程Avro Source的SSL身份验证凭据。如果未指定,则将使用全局密钥库。如果未指定全局密钥库,则将使用缺省Java JSSE证书颁发机构文件(通常为Oracle JRE中的“jssecacerts”或“cacerts”)。 |

| truststore-password | - | 信任库的密码。如果未指定,则将使用全局密钥库密码(如果已定义)。 |

| truststore-type | JKS | Java信任库的type。这可以是“JKS”或其他受支持的Java信任库type。如果未指定,则将使用全局密钥库type(如果已定义,则defautl为JKS)。 |

| exclude-protocols | 在SSLv3 | 要排除的以空格分隔的SSL/TLS协议列表。除指定的协议外,将始终排除SSLv3。 |

| maxIoWorkers | 2 *机器中可用处理器的数量 | I / O工作线程的最大数量。这是在NettyAvroRpcClient NioClientSocketChannelFactory上配置的。 |

Example for agent named a1:

a1.channels = c1

a1.sinks = k1

a1.sinks.k1.type = avro

a1.sinks.k1.channel = c1

a1.sinks.k1.hostname = 10.10.10.10

a1.sinks.k1.port = 4545

Thrift Sink

这个水槽形成了Flume的分层收集支持的一半。发送到此sink的Flume event 将转换为Thrift event 并发送到配置的hostname/port pair。event 将从配置的channel中批量获取配置的批处理大小。

可以通过启用kerberos身份验证将Thrift sink配置为以安全模式启动。要与以安全模式启动的Thriftsource通信,Thriftsink也应该以安全模式运行。client-principal和client-keytab是Thriftsink用于向kerberos KDC进行身份验证的属性。server-principal表示Thriftsource的主体,此sink配置为以安全模式连接。必需属性以粗体显示

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channel | - | |

| type | - | 组件type名称,需要节俭。 |

| hostname | - | 要绑定的hostname或IP地址。 |

| port | - | 要听的端口#。 |

| batch-size | 100 | 要一起批量发送的event 数。 |

| connect-timeout | 20000 | 允许第一个(握手)请求的时间量(ms)。 |

| request-timeout | 20000 | 在第一个之后允许请求的时间量(ms)。 |

| connection-reset-interval | none | 重置连接到下一跳之前的时间量。这将迫使Thrift Sink重新连接到下一跳。这将允许sink在添加新闻主机时连接到硬件负载平衡器后面的主机,而无需重新启动 agent 。 |

| SSL | false | 设置为true以为此ThriftSink启用SSL。配置SSL时,您可以选择设置“truststore”,“truststore-password”和“truststore-type” |

| truststore | - | 自定义Java信任库文件的路径。Flume使用此文件中的证书颁发机构信息来确定是否应该信任远程Thrift Source的SSL身份验证凭据。如果未指定,则将使用全局密钥库。如果未指定全局密钥库,则将使用缺省Java JSSE证书颁发机构文件(通常为Oracle JRE中的“jssecacerts”或“cacerts”)。 |

| truststore-password | - | 信任库的密码。如果未指定,则将使用全局密钥库密码(如果已定义)。 |

| truststore-type | JKS | Java信任库的type。这可以是“JKS”或其他受支持的Java信任库type。如果未指定,则将使用全局密钥库type(如果已定义,则defautl为JKS)。 |

| exclude-protocols | SSLv3 | 要排除的以空格分隔的SSL / TLS协议列表 |

| Kerberos的 | false | 设置为true以启用kerberos身份验证。在kerberos模式下,需要client-principal,client-keytab和server-principal才能成功进行身份验证并与启用kerberos的Thrift Source进行通信。 |

| client-principal | - | Thrift Sink使用的kerberos校长对kerberos KDC进行身份验证。 |

| client-keytab | - | Thrift Sink与客户端主体结合使用的keytab位置,用于对kerberos KDC进行身份验证。 |

| server-principal | - | Thrift Sink配置为连接到的Thrift Source的kerberos主体。 |

Example for agent named a1:

a1.channels = c1

a1.sinks = k1

a1.sinks.k1.type = thrift

a1.sinks.k1.channel = c1

a1.sinks.k1.hostname = 10.10.10.10

a1.sinks.k1.port = 4545

IRC Sink

IRC sink从附加channel接收消息,并将这些消息中继到已配置的IRC目标。必需属性以粗体显示

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channel | - | |

| type | - | 组件type名称,需要是irc |

| hostname | - | 要连接的hostname或IP地址 |

| port | 6667 | 要连接的远程主机的端口号 |

| nick | - | 昵称 |

| user | - | 用户名 |

| password | - | 用户密码 |

| chan | - | channel |

| name | ||

| splitlines | - | (布尔值) |

| splitChars中 | n | 行分隔符(如果你要在配置文件中输入默认值,那么你需要转义反斜杠,如下所示:“\ n”) |

Example for agent named a1:

a1.channels = c1

a1.sinks = k1

a1.sinks.k1.type = irc

a1.sinks.k1.channel = c1

a1.sinks.k1.hostname = irc.yourdomain.com

a1.sinks.k1.nick = flume

a1.sinks.k1.chan = #flume

File Roll Sink

在本地文件系统上存储event 。必需属性以粗体显示

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channel | - | |

| type | - | 组件type名称,需要是file_roll。 |

| sink.directory | - | 将存储文件的目录 |

| sink.pathManager | DEFAULT | 要使用的PathManager实现。 |

| sink.pathManager.extension | - | 如果使用默认的PathManager,则为文件扩展名。 |

| sink.pathManager.prefix | - | 如果使用默认PathManager,则添加到文件名开头的字符串 |

| sink.rollInterval | 30 | 每30秒滚动一次文件。指定0将禁用滚动并导致所有event 都写入单个文件。 |

| sink.serializer | TEXT | 其他可能的选项包括avro_event或EventSerializer.Builder接口实现的FQCN。 |

| sink.batchSize | 100 |

Example for agent named a1:

a1.channels = c1

a1.sinks = k1

a1.sinks.k1.type = file_roll

a1.sinks.k1.channel = c1

a1.sinks.k1.sink.directory = /var/log/flume

Null Sink

丢弃从channel收到的所有event 。必需属性以粗体显示

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channel | - | |

| type | - | 组件type名称必须为null。 |

| BATCHSIZE | 100 |

Example for agent named a1:

a1.channels = c1

a1.sinks = k1

a1.sinks.k1.type = null

a1.sinks.k1.channel = c1

HBase Sink

此sink将数据写入HBase。Hbase配置是从类路径中遇到的第一个hbase-site.xml中获取的。实现由配置指定的HbaseEventSerializer的类用于将event 转换为HBase put和/或 increments 。然后将这些put 和increments 写入HBase。该sink提供与HBase相同的一致性保证,HBase是当前行的原子性。如果Hbase无法写入某些event ,则sink将重播该事务中的所有event

HBase Sink支持将数据写入安全HBase。要写入安全HBase, agent 程序正在运行的用户必须具有对sink配置为写入的表的写入权限。可以在配置中指定用于对KDC进行身份验证的主体和密钥表。Flume agent 程序类路径中的hbase-site.xml必须将身份验证设置为kerberos(有关如何执行此操作的详细信息,请参阅HBase文档)

为方便起见,Flume提供了两个序列化器。

SimpleHbaseEventSerializer(org.apache.flume.sink.hbase.SimpleHbaseEventSerializer)按原样将event 主体写入HBase,并可选择增加Hbase中的列。这主要是一个示例实现。

RegexHbaseEventSerializer(org.apache.flume.sink.hbase.RegexHbaseEventSerializer)根据给定的正则表达式打破event 体,并将每个部分写入不同的列。

type是FQCN:org.apache.flume.sink.hbase.HBaseSink。

必需属性以粗体显示

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channel | - | |

| type | - | 组件type名称,需要是hbase |

| table | - | Hbase中要写入的表的名称。 |

| ColumnFamily | - | Hbase中的列族写入。 |

| zookeeperQuorum | - | 法定人数规格。这是hbase-site.xml中属性hbase.zookeeper.quorum的值 |

| znodeParent | /hbase | -ROOT-区域的znode的基本路径。价值zookeeper.znode.parent在HBase的-site.xml中 |

| BATCHSIZE | 100 | 每个txn要写入的event 数。 |

| coalesceIncrements | false | 如果sink将多个增量合并到每个批次的单元格中。如果有限数量的单元格有多个增量,这可能会提供更好的性能。 |

| serializer | org.apache.flume.sink.hbase.SimpleHbaseEventSerializer | 默认增量列=“iCol”,有效负载列=“pCol”。 |

| serializer.* | - | 要传递给序列化程序的属性。 |

| kerberosPrincipal | - | 用于访问安全HBase的Kerberos用户主体 |

| kerberosKeytab | - | 用于访问安全HBase的Kerberos密钥表 |

Example for agent named a1:

a1.channels = c1

a1.sinks = k1

a1.sinks.k1.type = hbase

a1.sinks.k1.table = foo_table

a1.sinks.k1.columnFamily = bar_cf

a1.sinks.k1.serializer = org.apache.flume.sink.hbase.RegexHbaseEventSerializer

a1.sinks.k1.channel = c1

HBase2 Sink

HBase2Sink相当于HBase版本2的HBaseSink。提供的功能和配置参数与HBaseSink的情况相同(除了sinktype中的hbase2标签和包/类名称)

type是FQCN:org.apache.flume.sink.hbase2.HBase2Sink

必需属性以粗体显示

| 属性名称 | 默认 | 描述 |

|---|---|---|

| channel | - | |

| type | - | 组件type名称,需要是hbase2 |

| table | - | HBase中要写入的表的名称。 |

| ColumnFamily | - | HBase中的列族写入。 |

| zookeeperQuorum | - | 这是hbase-site.xml中属性hbase.zookeeper.quorum的值 |

| znodeParent | /hbase | -ROOT-区域的znode的基本路径。价值zookeeper.znode.parent在HBase的-site.xml中 |

| BATCHSIZE | 100 | 每个txn要写入的event 数。 |

| coalesceIncrements | false | 如果sink将多个增量合并到每个批次的单元格中。如果有限数量的单元格有多个增量,这可能会提供更好的性能。 |

| serializer | org.apache.flume.sink.hbase2.SimpleHBase2EventSerializer | 默认增量列=“iCol”,有效负载列=“pCol”。 |

| serializer.* | - | 要传递给序列化程序的属性。 |

| kerberosPrincipal | - | 用于访问安全HBase的Kerberos用户主体 |

| kerberosKeytab | - | 用于访问安全HBase的Kerberos密钥表 |

Example for agent named a1:

a1.channels = c1

a1.sinks = k1

a1.sinks.k1.type = hbase2

a1.sinks.k1.table = foo_table

a1.sinks.k1.columnFamily = bar_cf

a1.sinks.k1.serializer = org.apache.flume.sink.hbase2.RegexHBase2EventSerializer

a1.sinks.k1.channel = c1

AsyncHBaseSink