一、需求分析

爬取百度词条Python页面的相关100个页面,分析目标:分析(url格式 数据格式 网页编码 )。url格式限定了爬取的网页格式避免一些不相干的网页的爬取。数据格式主要是内容中相关的标签,网页编码则是为了正确解析网页。

参考视频中的内容简介如下:入口URL在我们打开的Python词条的地址栏中可以得到,为: http://baike.baidu.com/view/21087.html数据格式则是在页面上右键审查元素后选择edit as

HTML可以看到。网页编码在选择审查元素后上拉找到head标签下的<meta charset="UTF-8">可得为万国码。

二、示例代码

2.1 调度程序

在eclipse中创建一个package然后创建对应的module。在前两篇文章中提到的

-

spider_main

-

html_parser

-

html_downloader,

-

url_manager

-

html_outputer

如图:

2.2 spider_main代码编写:

if __name__ == '__main__':

root_url = #将此作为入口URL

obj_spider = SpiderMain()

obj_spider.craw(root_url)#调用spider里的craw方法来开始爬虫总调度程序的编写

class SpiderMain(object):

def __init__(self): #初始化构造函数

self.urls = url_manager.UrlManager()

self.downloader = html_downloader.HtmlDownloader()

self.parser = html_parser.HtmlParser()

self.output = html_outputer.HtmlOutputer()#初始化各个对象

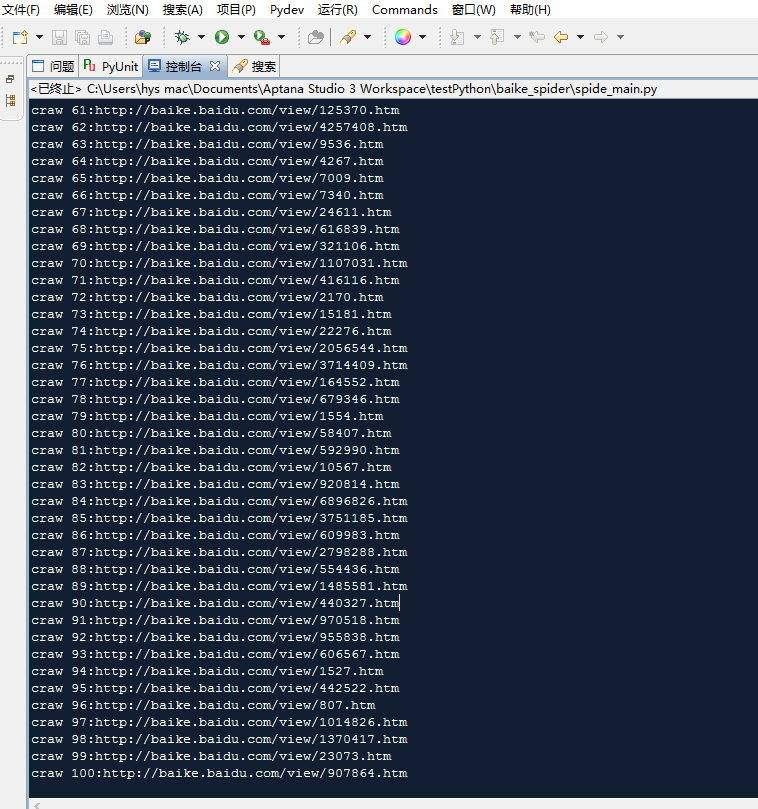

编写完成后还要记得将各个对象和方法在各个模块中初始化 def craw(self, root_urls):

count = 1 #记录当前爬取的URL个数

self.urls.add_new_url(root_urls)

while self.urls.has_new_url():

try:

new_url = self.urls.get_new_url()

print('craw %d:%s' %(count, new_url))

html_cout = self.downloader.downloader(new_url)

new_urls, new_data = self.parser.parse(new_url, html_cout)

self.urls.add_new_urls(new_urls)

self.output.collect_data(new_data)

if count == 100:

break

count += 1

except Exception as e:

print('craw fails--', e)#这里一个小小的改写能将爬取遇到的问题能及时打印出来

self.output.output()

也要及时在对应模块中创建相应的方法2.3URL管理器模块代码的编写

首先再想一想该模块要提供的方法:

-

添加一个新的未爬取的URL

-

添加新的未爬取一系列URL

-

判断管理器中是否有待爬取的URL

-

从管理器中获取一个新的URL

之前提到过要在该模块中初始化两个列表来保存已经爬取过的URL和待爬取的URL

-

def __init__(self): self.new_urls = set()#新的URL列表 self.old_urls = set()#已经爬取过的URL列表

添加新的URL:

def add_new_url(self, url):

if url is None:

return

if url not in self.new_urls and url not in self.old_urls:#参数判断

self.new_urls.add(url)批量添加的方法类似:

def add_new_urls(self, urls):

if urls is None or len(urls) == 0:

return

for url in urls:

self.add_new_url(url)判断是否有待爬取的URL:

def has_new_url(self):

return len(self.new_urls) != 0从管理器获取URL并删除后添加到已爬取列表

def get_new_url(self):

new_url = self.new_urls.pop()

self.old_urls.add(new_url)

return new_url2.4 html_downloader 相关代码的编写

html_downloader只需要对外提供一个downloader方法,参照上面的代码可得:

def downloader(self, url):

if url is None:

return None #参数判断

response = urllib.request.urlopen(url)

if response.getcode() != 200:

return None

return response.read()2.5 html_parser相关代码的编写

主要实现包括新的URL的解析和内容的解析:

def _get_new_urls(self, page_url, soup):

new_urls = set()

# 词条url

links = soup.find_all("a", href=re.compile(r"/view/\d+\.htm"))#模糊正则匹配

for link in links:

new_url = link['href']

new_full_url = urllib.parse.urljoin(page_url, new_url)

new_urls.add(new_full_url)

return new_urls

def _get_new_data(self, page_url, soup):

res_data = {}

# url

res_data['url'] = page_url

# <dd class="lemmaWgt-lemmaTitle-title">

title_node = soup.find('dd', class_ = "lemmaWgt-lemmaTitle-title").find("h1")

res_data['title'] = title_node.get_text()

# <div class="lemma-summary" label-module="lemmaSummary">

summary_node = soup.find("div", class_="lemma-summary")

res_data['summary'] = summary_node.get_text()

return res_data

def parse(self, page_url, html_cout):

if page_url is None or html_cout is None: #参数判断

return

soup = BeautifulSoup(html_cout, 'html.parser', from_encoding='utf-8')

new_data = self._get_new_data(page_url, soup)

new_urls = self._get_new_urls(page_url, soup)

return new_urls, new_data2.6 html_outputer相关代码的编写

这里要提供两个方法,收集数据和输出数据。

def output(self):

fout = open('output.html', 'w')

fout.write("<html>")

fout.write("<body")

fout.write("<table")

for data in self.datas:

fout.write("<tr>")

fout.write("<td>%s</td>" % data['url'])

fout.write("<td>%s</td>" % data['title'].encode('utf-8'))

fout.write("<td>%s</td>" % data['summary'].encode('utf-8'))

fout.write("</tr>")

fout.write("</table>")

fout.write("</body>")

fout.write("</html>")

fout.close()

def collect_data(self, data):

if data is None:

return

self.datas.append(data)2.7 运行爬虫

在这里就回到总调度程序选择run就可以运行我们简单的爬虫了。

至此爬虫就顺利完成了,现在在考虑如何将爬取的文件写入文本文件中,各位大神还望赐教哦,看到这各位看官都是好样的,有问题欢迎交流,知乎ID御前带刀攻城狮https://www.zhihu.com/people/dou-wo-45,转载请联系本人,保留一切权利,谢谢。

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?