本文由码农场同步,最新版本请查看原文:http://www.hankcs.com/nlp/cs224n-9-nmt-models-with-attention.html

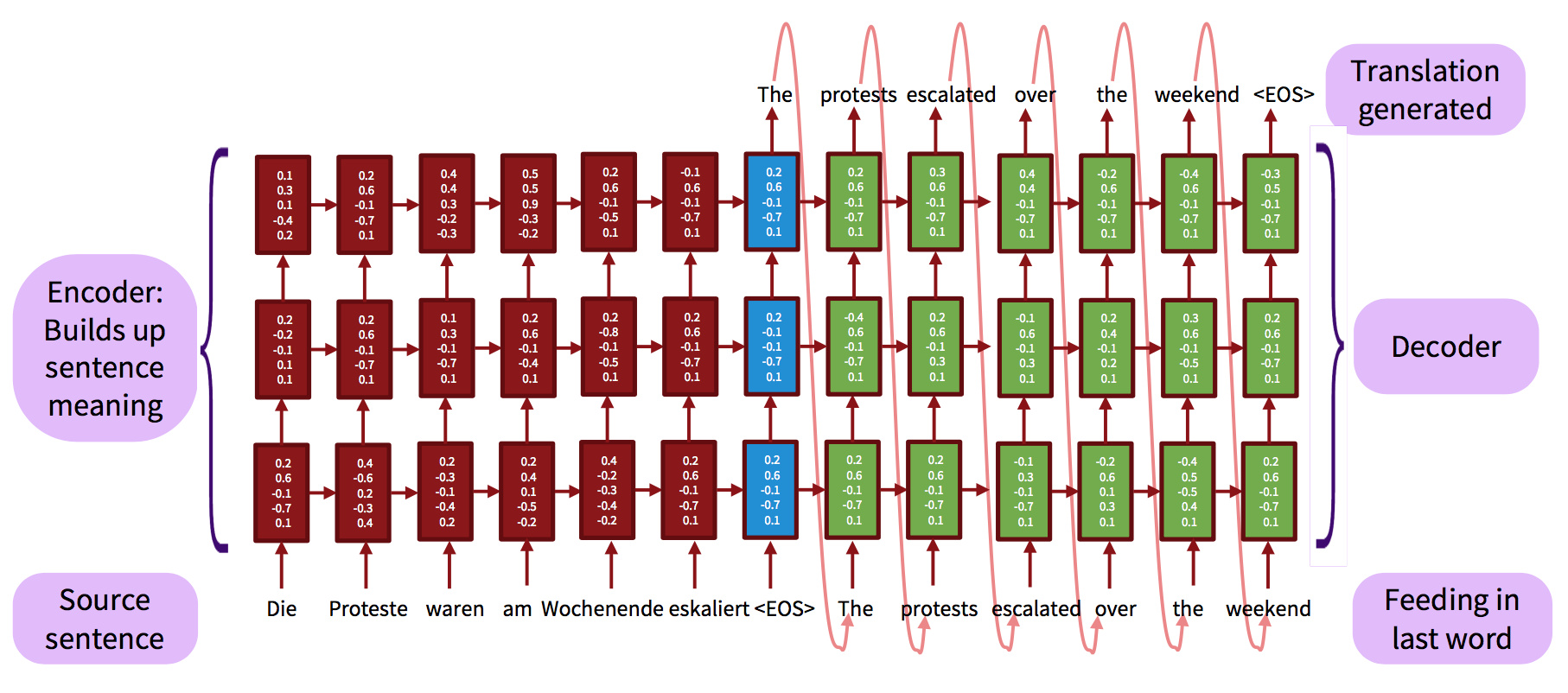

从NMT的历史谈到现代,讲解了attention机制的动机、原理及最新的拓展。通过实例展示谷歌翻译的变化,直言不讳指出其过度炒作。Manning今天还换上了新MBP,挺潮的。机器翻译传统衡量机器对语言理解的测试之一同时涉及到语言分析与理解一个每年400亿美金的产业主要在欧洲,亚洲也在兴起机器翻译的需求Google每天翻译1000亿单词Facebook研发了自己的翻译系统,因为通用的机器翻译系统无法适应社交领域eBay用机器翻译来促进跨境交易什么是NMT用一个大型神经网络建模整个翻译过程的系统。架构抽象的架构...

继续阅读:码农场 » CS224n笔记10 NMT与Attention

原文链接:http://www.hankcs.com/nlp/cs224n-9-nmt-models-with-attention.html

1096

1096

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?