生成对抗网络可以生成高度逼真的图像,通常与真实图像是无法区分的。这样生成的大多数图像都没有包含在训练数据集中,说明用GAN生成的数据对增强数据集的能力很强。尽管在数据有限的情况下这种情况特别重要,但是基于有限数据训练GAN的问题仍然存在。为了弥补这一缺陷,本文结合迁移学习的概念,利用在大规模数据集上经过预训练的现有GAN模型,引入其他知识。通过自然图像生成的演示,证明了预训练GAN的生成器和生成器的低级过滤器可以迁移以促进在训练数据有限的情况下,在感知上不同的目标域中生成图像。为了使传输的滤波器进一步适应目标域,本文提出了自适应滤波器调制(AdaFM)。

1.引言

生成对抗网络生成高质量样本的能力日益增强;展示了GAN在基础数据分布中利用有价值的信息的能力。尽管已发布了许多在大规模数据集上进行了预训练的强大GAN模型,但很少有人利用该模型中有价值的信息,以促进下游任务;这与用于判别性任务的迁移学习(重用预训练分类器的特征提取器)和自然语言处理中的迁移学习(重用昂贵的预训练的BERT模型)形成鲜明对比。

受到已发布的预训练GAN模型的重要价值的激励,本文提出利用其中的信息进而利用有限的训练数据来促进目标域中的下游任务。当有限的训练数据可用时,将专注于GAN模型开发的挑战性场景。启发本文方法的一个关键发现是受过训练的GAN可以生成训练数据集中未观察到的逼真的图像,证明GAN具有捕获训练数据流形的泛化能力。 GAN的这种概括很可能是由于信息/属性/样式的新颖组合而产生的,对于数据有限的情况而言,GAN的这种概括非常有吸引力。例如,GAN可以用于通过现实的数据生成来扩充训练集,以减轻过拟合或为分类,分割或检测提供正则化。

由于GAN通常需要大量的训练数据,因此目标域中有限的数据在学习基础GAN模型时会出现问题。当可用的数据量有限时,训练GAN容易过拟合,因为GAN模型具有许多对于实际生成必不可少的参数。为了减轻过拟合,可以考虑通过迁移学习从其他领域转移信息。但是,大多数迁移学习工作都集中在判别性任务上,基于这样的基础,即在大规模源数据集上经过预训练的分类器的低级过滤器(接近输入观测值的过滤器)相当笼统(如Gabor过滤器),因此可以转移到不同的目标域;低级过滤器提供了附加信息,迁移学习通常会带来更好的性能。与在判别任务上进行迁移学习相比,生成任务上所做的工作较少。

利用上述关于判别任务的迁移学习的见解,假设在大规模源数据集上经过预训练的GAN判别器的低级过滤器可能是通用的,因此可以转移到各种目标域。对于预训练的GAN生成器,它表明低层(接近输出观测值的那些层)捕获了通常适用的局部图案(如材料,边缘和颜色)的属性,而高层(远离观测值的)则与数据的更多特定领域语义方面相关联。考虑迁移/冻结预训练GAN模型的生成器和判别器的低级滤波器,以帮助在训练数据有限的情况下在感知上不同的目标域中生成数据。本文考虑了自然图像生成GAN场景,所提出的技术是通用的,并且可能适用于其他领域,例如医学或生物学领域。本文的主要贡献如下。

本文凭经验证明,在大规模数据集上经过预训练的GAN模型的低级过滤器(在生成器和鉴别器内)可以转移到感知上截然不同的目标域,从而在以下训练数据有限的情况下提高GAN性能

1.量身定制了一个领域专用网络,以与迁移的低级过滤器协作,从而可以进行样式混合以实现多种合成。

2.为了更好地使传输的滤波器适应目标域,引入了一种称为自适应滤波器调制(AdaFM)的方法,该方法可提高性能。

3.进行了广泛的实验,以验证所提出技术的有效性。

2.方法

对于在目标域中数据有限的GAN训练,通过利用在大规模源数据集上进行了预训练的现有GAN的低级过滤器(接近观察值)来转移其他信息。结合低级过滤器中的先验知识,从而提高GAN性能,但是需要进行数据训练的人可能会期望减少过拟合。 具体来说,给定一个经过预训练的GAN模型,在目标域中重用其低层过滤器(称为模型的通用部分或通用部分),并用另一个较小的网络替换高层(称为域特定部分),然后训练使用有限的目标数据的特定零件,同时保持传输的通用零件冻结(请参见图1(f)和(g))。通过这种方法,利用在更大的源数据集上进行训练的迁移的通用部分,并使用简化的领域特定部分,大大减少了需要学习的参数总数,从而与有限的目标域数据保持一致。

接下来,以自然图像生成为例,并回答三个问题来介绍本文的方法

1.如何指定适合转让的通用零件?

2.如何定制特定的零件以使其简化?

3.如何更好地适应已迁移的通用部分?

在详细介绍提出的技术之前,首先讨论源数据集,预训练GAN模型和评估指标。为了实现通用的低级过滤器,希望拥有丰富的多样性的大规模源数据集,其中包含来自1000个类别的120万个高分辨率图像。本文认为这是源数据集。 关于在ImageNet上预训练的公开可用GAN模型,可用的选择包括SNGAN,GP-GAN和BigGAN;本文选择了预训练的GP-GAN模型(分辨率为128×128)。 为了评估生成性能,采用了Frechet起始距离(FID,越低越好),该指标可评估生成样本的真实性和变异性。

图 1

2.1 关于指定通用零件

如引言中所述,生成图像图像和判别式图像模型都具有相似的模式:**较高级别的卷积过滤器描绘更多特定于领域的语义信息,而较低级别的过滤器描绘普遍适用的信息。**给定在ImageNet上经过预先训练的GP-GAN模型,问题是如何指定要迁移到目标域的低级过滤器(即模型的通用部分)。一般而言,根据可用的目标域数据,最佳解决方案可能是一个折衷方案。如果提供了大量数据,则应传输较少的低级过滤器(需要传输的先验知识较少),但是当目标域数据受到限制时,最好传输更多的过滤器(以更多的先验信息为基础)。通过将预训练的GP-GAN模型迁移到CelebA数据集来解决该问题,这与源ImageNet完全不同(请参见图2)。此处发现的一般部分在其他三个数据集上也能提供出色的结果。

图2

2.1.1 生成器的通用部分

为了确定要迁移到目标CelebA数据集的GP-GAN生成器的通用部分,采用GP-GAN体系结构和设计实验,在生成器的迁移/冻结常规部分中包含越来越多的较低层;生成器的其余特定部分(未转移)(参见图1(f))和判别器,将重新初始化并通过CelebA进行训练。

测试了生成器通用部分的四个设置,即要传输的2个,4个,5个和6个较低的组(分别称为G2,G4,G5和G6; G4在图1(f)中进行了说明)。经过60,000次训练迭代(此时,生成质量趋于稳定),在图3中显示了四种设置的生成的样本和FID。转移G2 / G4发生器的通用部分可提供不错的生成质量(请参见眼睛的详细信息,头发纹理和脸颊光滑度)。在预训练的GP-GAN生成器的多达4个较低的组中有低级别过滤器(在实验中的其他三个数据集上也进行了验证)。 G4的FID比G2的FID低表明,在大规模源数据集上接受更多预训练的低级过滤器可能会在目标域中带来更好的性能。但是,当迁移并冻结更多组作为生成器的通用部分时,(即G5和G6),生成质量迅速下降;这是预期的,因为高级过滤器是更特定于源ImageNet的,可能无法满足目标数据CelebA。通过查看图3,选择G4作为要生成的通用零件的设置。

图 3

2.1.2 判别器的通用部分

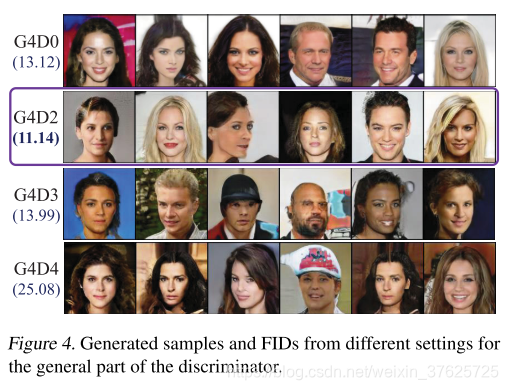

接下来,基于生成器的G4通用部分,进行实验以指定判别器的通用部分。考虑迁移/冻结0、2、3和4个较低级别的预训练GP-GAN判别器(分别称为D0,D2,D3和D4)。图4显示了每个设置生成的样本和FID。与生成器观察到的类似,经过预训练的GP-GAN鉴别器具有更好的生成性能(将D0的FID与D2的FID进行比较);但是,由于更高级别的过滤器更特定于源数据ImageNet,因此迁移它们可能会导致生成质量下降(请参阅D3和D4的结果)。

图 4

2.2 定制高级特定部分

即使使用了迁移/冻结的G4D2通用部分,其余的特定(目标相关)部分对于有限的目标域数据也可能包含太多可训练的参数(例如,图1(f)中的GPHead模型显示了模式崩溃(请见图 5)在小花数据集上进行训练时);另一个考虑因素是,当使用GAN进行合成增强时,对于数据量有限的应用程序,样式混合具有很高的吸引力。基于这些考虑,本文提出用定制的较小网络替换GP-GAN的高级特定部分(见图1(g)),以减轻过拟合,实现样式混合并降低计算/内存成本。

图5

具体来说,定制的特定部分被构造为一个全连接(FC)层,后面是两个连续的样式块(借鉴StyleGAN,请见图1(c))。 与Style-GAN相似,样式块可实现无监督地分解高级属性,有益于对底层数据流形的有效探索。 它们还可以生成具有新属性组合(样式混合)的样本,扩大了生成多样性。 将由定制的特定部分和G4D2通用部分组成的模型称为SmallHead。 本文的特定部分也用于本文的方法中(参见图1(h))。 与GPHead不同,SmallHead被证明可以以稳定的方式进行训练,而Flowers上不会出现模式崩溃(见图5)。 在实验中,发现SmallHead在其他小型数据集上运行良好。

2.3更好地适应迁移的通用部分

根据上述迁移的通用部分和量身定制的特定部分,本文接下来提出一种称为自适应滤波器调制(AdaFM)的新技术,以使迁移的低级滤波器更好地适应目标域以提高性能。 在这种方法中,不再只是在迁移时“冻结”过滤器,而是以目标依赖的方式增强它们。

受样式迁移文献的启发,在该文献中,通过修改图像的潜在特征图的统计量(例如均值或方差)来操纵图像的样式,因此,本文考虑了操纵函数样式(即转移的样式)的变体。 通用部分),通过AdaFM修改其卷积滤波器的统计信息

具体来说,给定一个转移卷积滤波器 W ∈ R C o u t × C i n × K 1 × K 2 W∈R^{C_{out}×C_{in}×K_1×K_2} W∈RCout×C

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1785

1785

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?