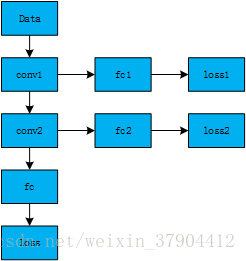

1.Deeply-Supervised Nets

网络结构如下图所示。在DSN中,每一个卷积层/全连接层后,模型都会为他们接一个旁路的全连接层,并用输出的结果和数据的真实结果做比较,计算预测结果和真实结果的误差,并将由此产生的梯度回传给前面的参数。

另外,模型中间的旁路目标函数需要降权(提升各模型层的合作能力,弱化独立能力。因为如果不降权,每一层和目标函数近距离相连,模型层会具备独立完成任务的能力),即每个目标函数在计算时加上一个权重。越靠近真正的目标函数,权重越大。

中间的目标函数设置有一个阈值(模型容忍中间目标函数存在一些小偏差),只有目标函数的损失超过了这个阈值,梯度才会被传导,如果没有超过,那么这一层模型正常。

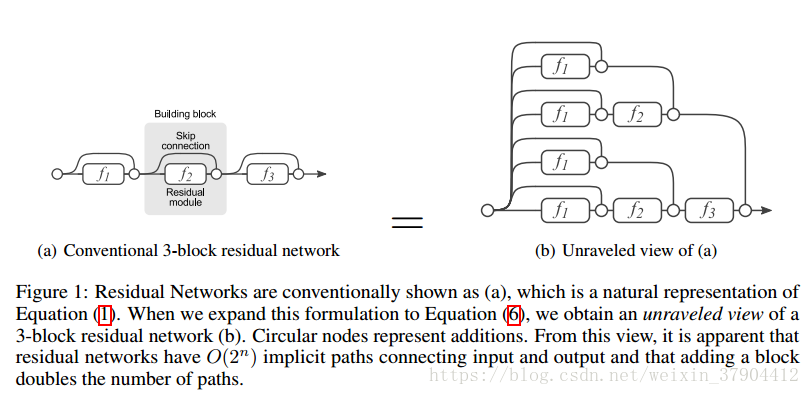

2 Residual Networks Behave Like Ensembles of Relatively Shallow Networks

上图左边是一个残差网络结构,一个残差网络可以定义为:

yi=fi(yi−1)+yi−1(1) (1) y i = f i ( y i − 1 ) + y i − 1

其中 fi f i 是一个模块,它中间可能经过了卷积、batch normalization、ReLU。

右边是把左边网络展开后的结构,即多个block的运算。从这个角度来看,残差网络显式连接路径有 O(2n) O ( 2 n ) 个。它的数学表示为:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

7547

7547

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?