在这篇文章中主要是讲解TensorFlow的基础,常用的session,常量的定义,模型的生成,以及模型的保存,并且如何查看模型 中的实际保存的内容。

一、 TensorFlow 模型

TensorFlow的命名来源于本身的运行原理。tensor(张量)表示的是N维数组,Flow(流)意味着基于数据流图的计算。

Tensorflow是张量从图像的一端流动到另一端的计算(编程模型)。

二、 模型的运行机制

TensorFlow的运行机制属于“定义”与“运行”相分离的。从操作来看分两层:模型构建和模型运行

模型构建所需概念如下:

以上的定义就是一个“图”:

- 一个“图”就是一个计算任务

- 模型在运行时,“图”会在会话(session)中被启动,

- session将图的op分发到CPU或GPU的设备上,然后提供执行op的方法。执行之后,会返回一个Tensor值,在python中,返回的Tensor是numpy ndarry对象;在C或者C++中返回的是Tensor实例。

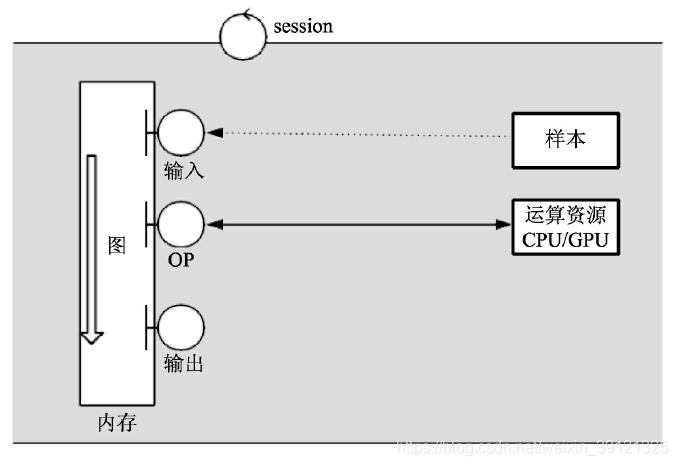

session 与图的工作关系如下图:

在实际环境中,上图的运行情况分3种,训练场景,测试场景,使用场景。训练场景与其他两个场景不同。

(1) 训练场景: 实现模型从无到有的过程,通过对样本的学习训练,调整学习参数,形成最终的模型。

过程:将给定的样本和标签作为输入节点,通过大量的循环迭代,将图中的正向运算(从输入的样本通过op运算得到输出的方向)得到的值,在反向运算(从输出到输入的方向),以此来更新模型中的学习参数,最终得到模型产生的正向结果最大化的接近样本标签。

(2) 测试场景和应用场景: 测试场景利用图的正向运算得到结果与真实值进行对比,得到误差值;使用场景也是利用图的正向运算得到结果,并直接使用。在函数中,可以分为实参,形参,函数体与返回值。在模型中,实参就是输入的样本,形参就是占位符,运算过程就相当于函数体,得到的结果就相当于返回值。

session与图的交互下定义的其他的数据流向:

- 注入机制(feed):通过占位符向模式中传入数据

- 取回机制(fetch):从模式中得到结果

三、 实例

1. session的作用,以及使用例子

# -*- coding: utf-8 -*-

# !/usr/bin/env python

# @Time : 2019/5/15 11:32

# @Author : xhh

# @Desc : session的演示

# @File : tensor_tf4.py

# @Software: PyCharm

import tensorflow as tf

hello = tf.constant('hello, tensorflow') # 定义一个常量

sess = tf.Session() # 建立一个session

print(sess.run(hello)) # 通过sess中的run函数来运行结果

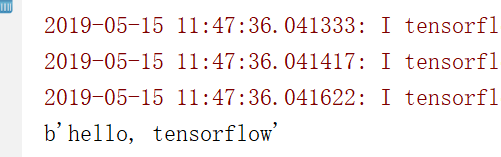

sess.close() # 关闭session运行结果:

注意: 如果你定义的常量里面是含有中文的话,

hello = tf.constant('你好, tensorflow') # 定义一个常量是这样的,会出现编码问题

在上面的代码中tf.constant定义的是一个常量,hello的内容只有在session的run内才可以返回。

2. with session的使用

with session是我们以后会经常用的,他沿用了python中的with用法,当程序结束之后会自动关闭session,二不需要在手动的close

例:使用with session方法建立session,并在session中计算两个变量(3和4)的相加与相乘值

import tensorflow as tf

a = tf.constant(3) # 定义常量3

b = tf.constant(4) # 定义常量4

with tf.Session() as sess: # 建立session

print("相加: %i"%sess.run(a+b))

print("相乘: %i"%sess.run(a*b))运行结果:

3. 注入机制

将具体的实参注入到相对应的placeholder中。feed只在调用它的方法内有效,方法结束后feed就消失。

定义占位符,使用feed机制将具体数值通过占位符传入,并进行相加相乘。

import tensorflow as tf

a = tf.placeholder(tf.int16)

b = tf.placeholder(tf.int16)

add = tf.add(a, b)

mul = tf.multiply(a, b)

with tf.Session() as sess:

# 计算具体数值

print("feed相加:%i"%sess.run(add, feed_dict={a:3, b:4}))

print("feed相乘:%i"%sess.run(mul, feed_dict={a:3, b:4}))运行结果:

标记的方法:使用tf.placeholder为这些操作创建占位符,然后使用feed_dict把具体的值放到占位符里。

4. 保存/载入线性回归模型

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

plotdata = {"batchsize":[], "loss":[]}

def moving_average(a, w=10):

if len(a)<w:

return a[:]

return [val if idx < w else sum(a[(idx-w):idx])/w for idx, val in enumerate(a)]

# 模拟数据

train_X = np.linspace(-1, 1, 100)

train_Y = 2*train_X + np.random.randn(*train_X.shape)*0.3 # 加入了噪声

# 图形展示

plt.plot(train_X,train_Y,'ro',label="original data") # label数据标签

plt.legend()

plt.show()

tf.reset_default_graph() # 重置会话

# 创建模型

# 占位符

X = tf.placeholder("float")

Y = tf.placeholder("float")

# 模型参数

W = tf.Variable(tf.random_normal([1]), name="weight")

b = tf.Variable(tf.zeros([1]), name="bias")

# 前向结构

z = tf.multiply(X, W) +b

# 反向优化

cost = tf.reduce_mean(tf.square(Y-z))

learning_rate = 0.01

optimizer = tf.train.GradientDescentOptimizer(learning_rate).minimize(cost)

# 初始化变量

init = tf.global_variables_initializer()

# 参数设置

training_epochs = 20

display_step = 2

saver = tf.train.Saver() # 模型生成,并保存

savedir = "log/"

# 启动session

with tf.Session() as sess:

sess.run(init)

for epoch in range(training_epochs):

for (x, y) in zip(train_X,train_Y):

sess.run(optimizer, feed_dict={X:x, Y:y})

# 显示训练中的详细信息

if epoch % display_step == 0:

loss = sess.run(cost, feed_dict={X:train_X, Y:train_Y})

print("Epoch:",epoch+1,"cost=", loss,"W=",sess.run(W),"b=",sess.run(b))

if not (loss=="NA"):

plotdata["batchsize"].append(epoch)

plotdata["loss"].append(loss)

print("finished!")

saver.save(sess, savedir+"linermodel.cpkt")

print("cost=",sess.run(cost, feed_dict={X:train_X, Y:train_Y}),"W=", sess.run(W),"b=",sess.run(b))

# 图形显示

plt.plot(train_X, train_Y, 'ro', label='Original data')

plt.plot(train_X, sess.run(W) * train_X + sess.run(b), label='Fitted line')

plt.legend()

plt.show()

plotdata["avgloss"] = moving_average(plotdata["loss"])

plt.figure(1)

plt.subplot(211)

plt.plot(plotdata["batchsize"], plotdata["avgloss"], 'b--')

plt.xlabel('Minibatch number')

plt.ylabel('Loss')

plt.title('Minibatch run vs. Training loss')

plt.show()

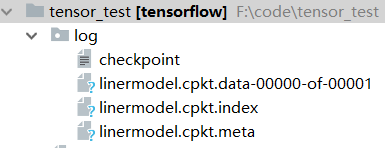

在同级目录下的log文件夹下生成了模型:

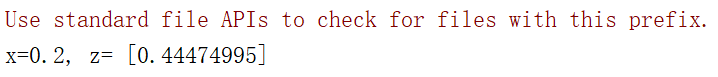

在重启一个session,并命名为sess2,通过saver的restore函数将模型载入

# 重启一个Session

with tf.Session() as sess2:

sess2.run(tf.global_variables_initializer())

saver.restore(sess2, savedir+"linermodel.cpkt")

print("x=0.2, z=",sess2.run(z, feed_dict={X: 0.2}))

测试结果:

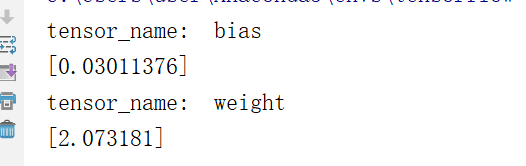

5. 查看模型中的内容

查看已经保存的模型内部内容

from tensorflow.python.tools.inspect_checkpoint import print_tensors_in_checkpoint_file

savedir = "log/"

print_tensors_in_checkpoint_file(savedir+"linermodel.cpkt",None,True)

运行结果:

通过运行的结果可以看到模型中保存的就是创建的变量名,以及它的数值。

大家可以关注我和小伙伴的公众号~~~这里有我和我的小伙伴不定时的更新一些python技术资料哦!!大家也可以留言,讨论一下技术问题,希望大家多多支持,关注一下,点一下小广告,谢谢大家啦~~

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?