题目5.1

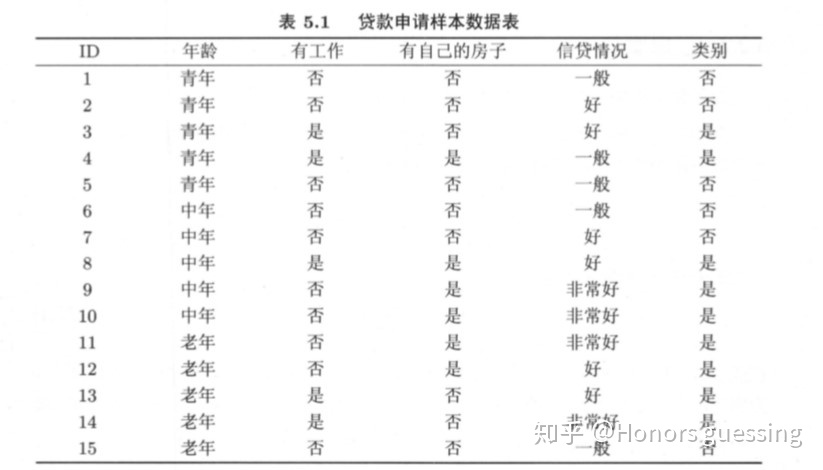

题目描述: 根据表(5.1)所给的训练数据集, 利用信息增益比 (C4.5算法)生成决策树

解答:

信息增益率的公式是:

首先回顾一下表(5.1)的结构:

根据书上已经计算提供的数据, 我们有:

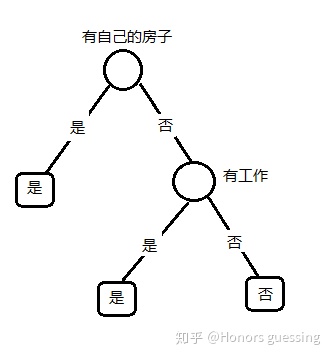

所以根据信息增益比的原则, 我们选择特征"有自己的房子"为切分点.

在左结点里, 所有"有自己的房子==是"的实例数据的类别均为"是", 所以左结点为叶结点, 结点类别为"是".

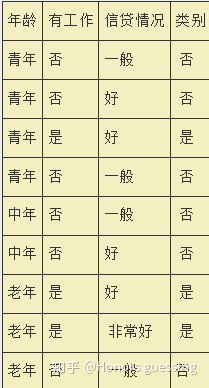

在右结点里, 我们首先整理出子数据集

所以在右结点选择特征"有工作", 以此切分后, 左右结点的实例数据子集都是单一类别的.

由此, 我们完成了根据信息增益比的C4.5决策树构造, 见下图.

题目5.2

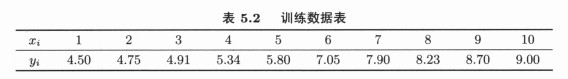

题目叙述: 己知如表 5.2 所示的训练数据,试用平方误差损失准则生成一棵二叉回归树

解答:

回归树的平方损失准则是: 选择一个切分点, 将训练数据集分为小于等于

我们用python代码帮助我们便捷快速地选择最优切分点:

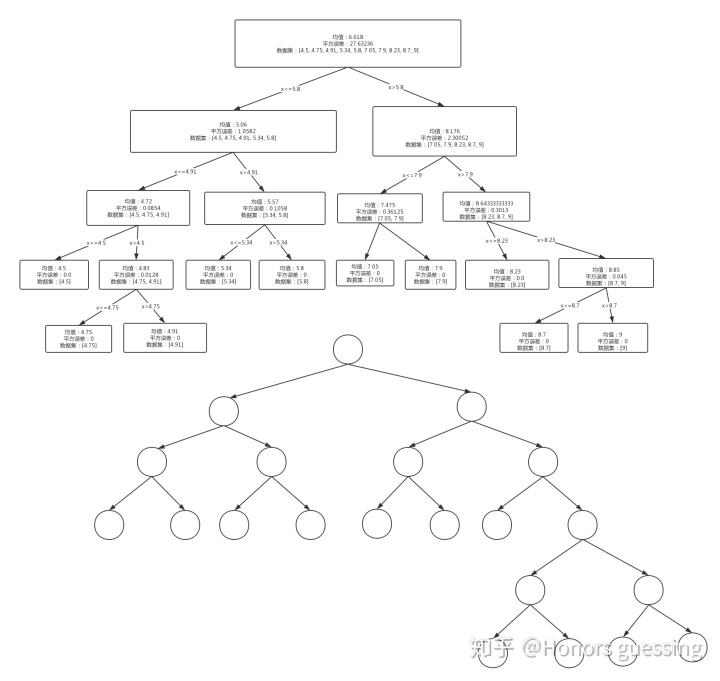

import 运行如上代码, 不断地对数据进行二叉切分后, 最终得到如下图的二叉回归决策树, 由于没有设置最小阈值, 所以我们是对每个点分到了叶结点.

题目5.3

题目叙述: 证明CART剪枝算法中, 当

解答:

采用反证法:

存在性易证, 在特征有限、数据集有限的情况下, 由于能生成的决策树数量有限, 每一棵都对应某一个

唯一性: 对于决策树生成算法生成原始数

由于两棵子树不相同, 所以它们的剪枝方法

由此, 得证.

题目5.4

题目叙述: 证明CART剪枝算法中求出的子树序列

解答:

首先我们需要回顾一下CART剪枝算法中, 我们对

我们想要证明

首先

而排序在后的结点

由此, 得证

欢迎大家指出不足或错误, 进行提问和讨论.

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?