前言:真的非常抱歉,Hadoop安装已经折腾很久了,还有问题没有解决,虽然是个失败的案例(只能运行部分),我先把思路写下来,希望不管是成功还是失败,希望对大家有所帮助。下面进入正文吧!

1.安装java和Hadoop

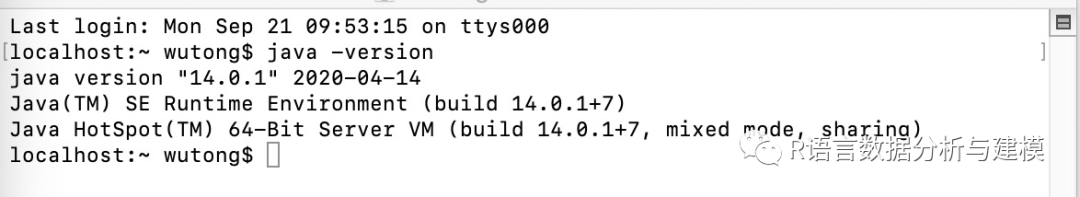

java 我是事前就安装好的,可以java -version 查看Java 版本。

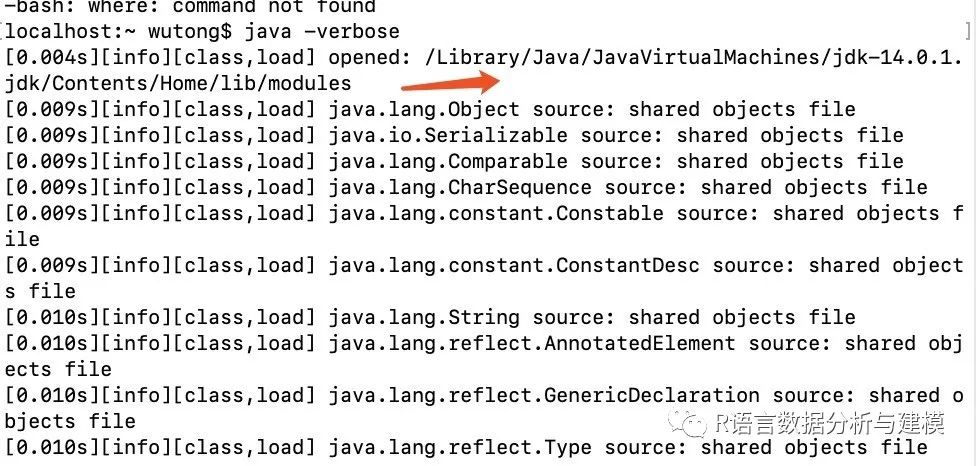

查看java的路径:java -verbose

安装hadoop我是通过brew 安装的

代码:brew install Hadoop

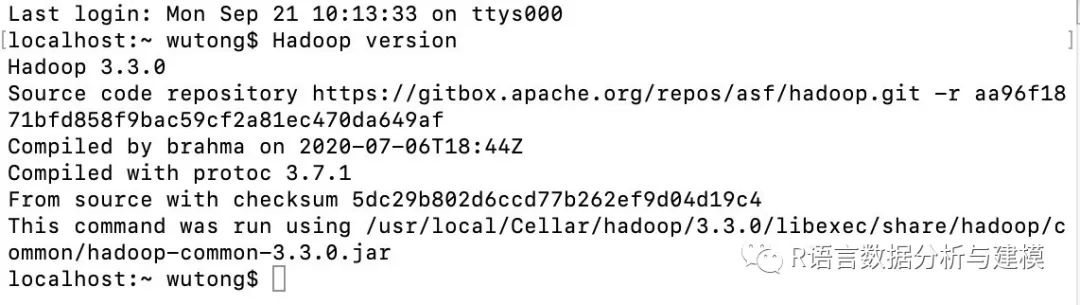

然后安装提示进行安装即可,如果安装成功了,输入:hadoop version

2. 配置ssh localhost(免密登陆)

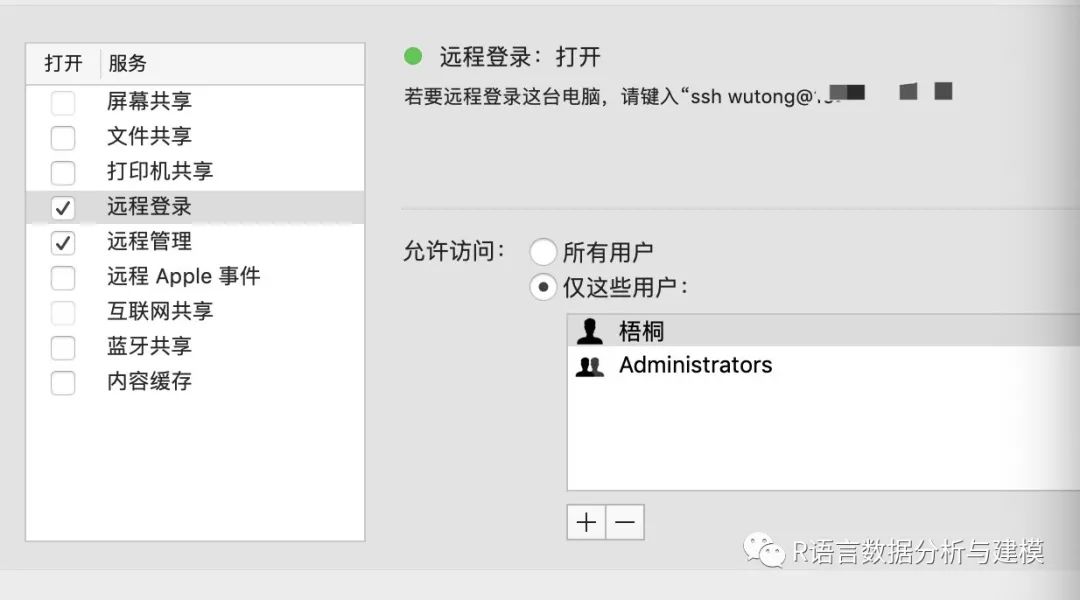

(1)在mac电脑上打开远程登陆

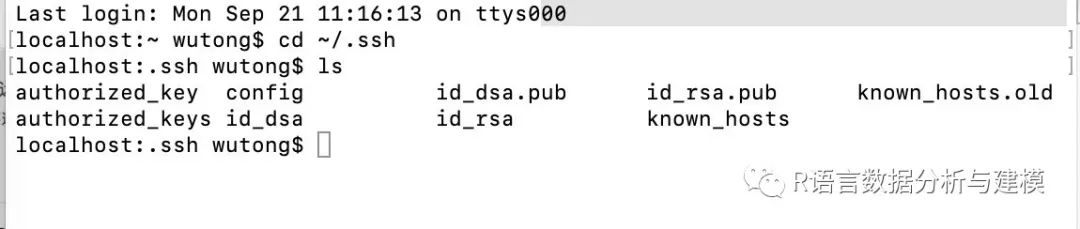

(2)观察钥匙情况

接下来我们来查看一下ssh是否本身存在私钥

cd~/.ssh

$ls

如果有.pub代表是公钥,没有就是私钥

如果没有以上的文件,那么进行ssh-keygen -t dsa

生成公私钥队

(3)上传到服务器

ssh-copy-id -i [公钥文件] user@host

for example:

ssh-copy-id -i id_rsa.pub wutong@111.111.111.111

(4)mac这里有个坑

一般的电脑这样就可以了,但是mac不行!!还有第四步

ssh-add- k[不加.pub的文件]

for example:ssh-add-k id_rsa

这样应该就可以了,我的还不行!

接下来,看一下ssh的版本

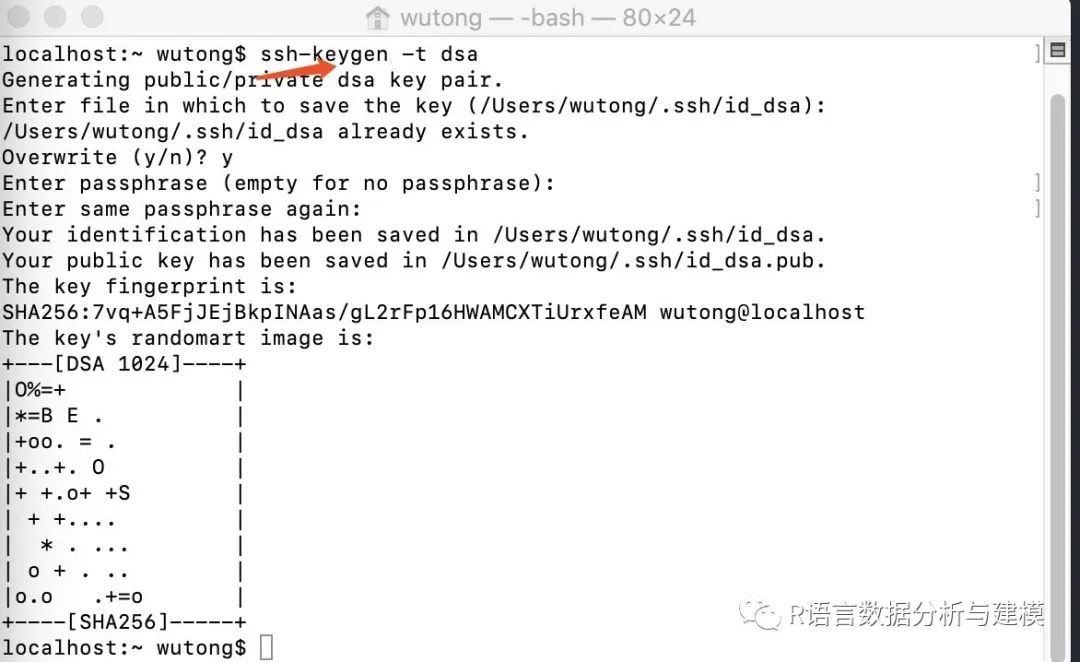

输入ssh-keygen -t dsa ,然后安装提示进行操作即可

这里有个坑,从openssh7.0开始,ssh-dss密钥被默认禁用!!!

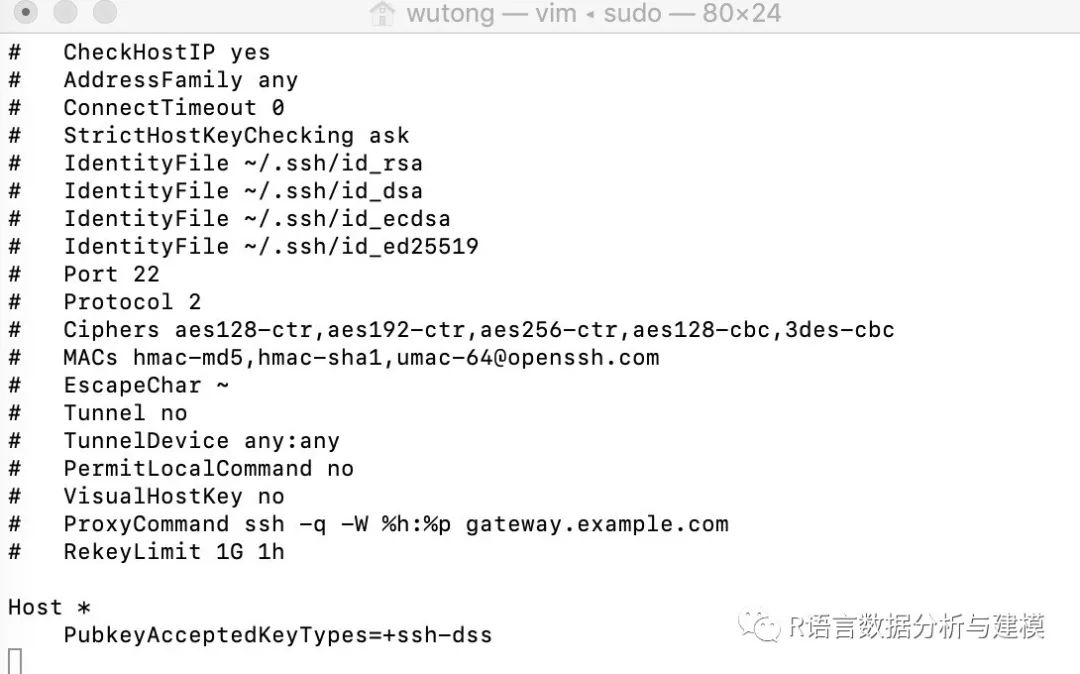

这里需要修改 ssh_config文件

vim /etc/sshd/sshd_config

在最后添加

PubkeyAcceptedKeyTypes=+ssh-dss

ssh的坑基本到这里就结束了

3.配置环境

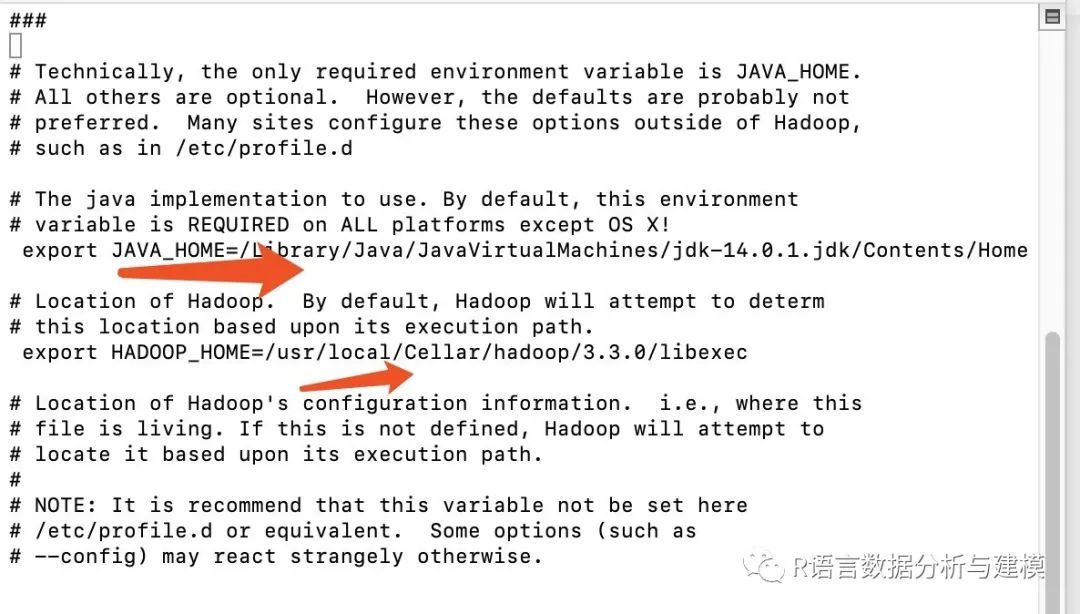

1.修改hadoop-env.sh文件

vim /usr/local/Cellar/hadoop/3.3.0/libexec/etc/hadoop/hadoop-env.sh

红线部分改成自己的路径哦

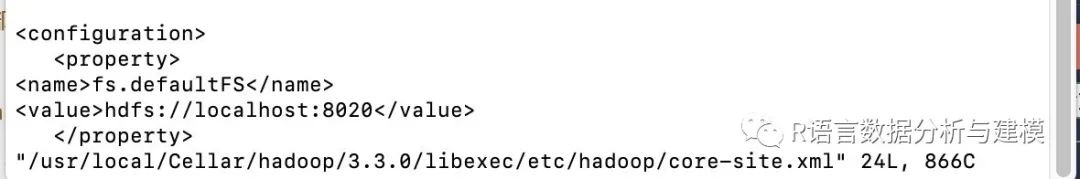

2.vim /usr/local/Cellar/hadoop/3.3.0/libexec/etc/hadoop/hadoop-core.xml

fs.defaultFS

hdfs://localhost:8020

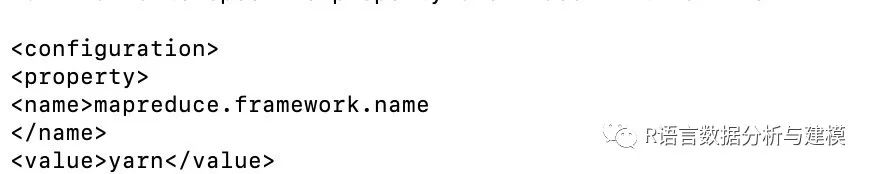

vim /usr/local/Cellar/hadoop/3.3.0/libexec/etc/hadoop/mapred-site.xml

mapreduce.framework.name

yarn

4.

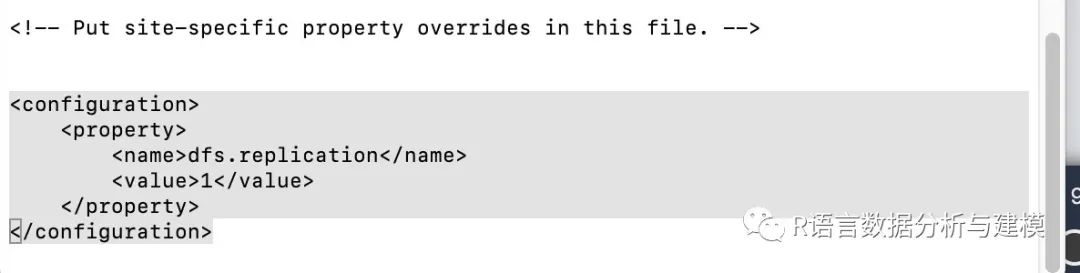

vim /usr/local/Cellar/hadoop/3.3.0/libexec/etc/hadoop/hdfs-site.xml

dfs.replication

1

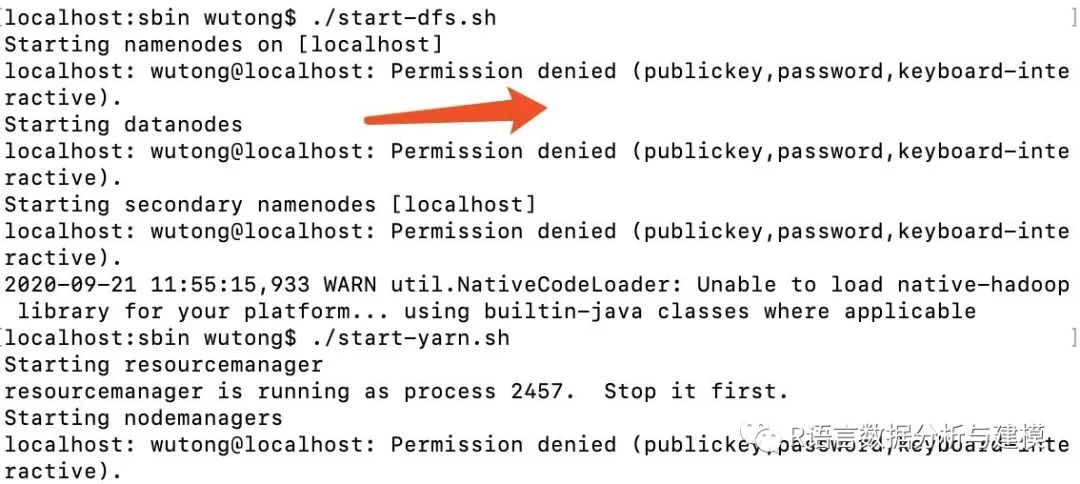

4.启动

把目录切换到/usr/local/Cellar/hadoop/3.3.0/

格式化文档:format -Hadoop或者 hdfs-format

启动 start-dsf.sh

NameNode 和 DataNode - http://localhost:9870

注意:Hadoop3.0中namenode的默认端口配置发生变化:从50070改为9870

启动ResourceManager 和 NodeManager:

start-yarn.sh

ResourceManager – http://localhost:8088NodeManager – http://localhost:8042

抱歉,只成功了ResourceManager – http://localhost:8088

应该还是我的免密登陆的问题

2636

2636

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?