Required Environment

- Scala 2.13.3

- Hadoop 3.2.1

Install Hadoop

- 解压缩

hadoop-3.2.1.tar.gz至/usr/local/

2. 配置运行环境参数,修改/hadoop-3.2.1文件夹下(后同)的/etc/hadoop/hadoop-env.sh

export JAVA_HOME=/Library/Java/JavaVirtualMachines/jdk-11.0.4.jdk/Contents/Home 3. 配置进程参数

- 修改

/etc/hadoop/core-site.xml,增加

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>- 修改

/etc/hadoop/hdfs-site.xml,增加

<configuration>

<property>

<name>dfs.namenode.name.dir</name>

<value>/usr/local/hadoop-3.2.1/tmp/dfs/name</value>

</property>

<!-- <property>

<name>dfs.hosts</name>

<value></value>

</property>

<property>

<name>dfs.blocksize</name>

<value></value>

</property>

<property>

<name>dfs.namenode.handler.count</name>

<value></value>

</property> -->

<property>

<name>dfs.datanode.data.dir</name>

<value>/usr/local/hadoop-3.2.1/tmp/dfs/data</value>

</property>

</configuration>3. 命令行进入/bin,运行hdfs namenode -format格式化存储

4. 命令行进入/sbin,运行./start-dfs.sh启动HDFS

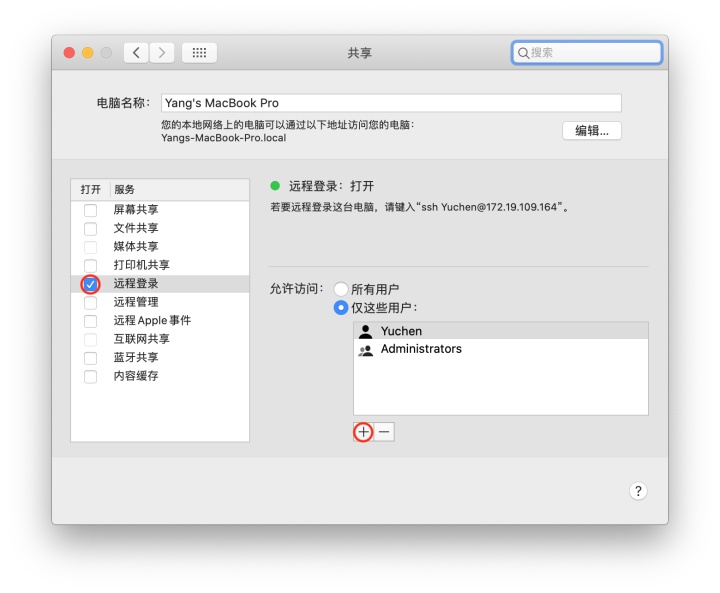

5. 报错connection refused,说实话本来不太想配置远程登录的但是绕不开

6. 报错permission denied,不想说话了,还得配置免密登录

ssh-keygen

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

chmod 600 ~/.ssh/authorized_keys首先生成一对公钥密钥,然后写入授权的公钥,最后修改一下权限比较安全

7. 输入ssh localhost进行验证,已经可以免密登录了

8. 重新启动HDFS,并运行jps命令查看是否成功启动

9. 在Hadoop 3.x后,通过浏览器访问的端口改为localhost:9870

Install Spark

- 解压缩

spark-3.0.1-bin-hadoop3.2至/usr/local/ - 命令行进入

/sbin,运行./start-master.sh启动master - 通过浏览器访问

localhost:8080,查看worker 信息 - 测试示例,运行

./bin/spark-submit --class org.apache.spark.examples.JavaSparkPi --master spark://Yangs-MacBook-Pro.local:7077 examples/jars/spark-examples_2.12-3.0.1.jar

1376

1376

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?