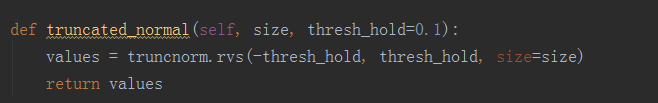

问题:最近需要初始化一个模型的参数,但在pytorch中没有类似可直接使用的类似tf.truncnormal()函数,一开始是直接尝试用torch.nn.init.normal_() 来代替tf.truncnormal()。效果相差较远,简单的正态分布并不能代替截断正态分布的作用。故考虑自己实现,借鉴了 https://discuss.pytorch.org/t/implementing-truncated-normal-initializer/4778/15的一个实现, 实现代码如下:

实现中借用了scipy.stats下的truncnorm函数来产生截断的正态分布值,再自行包装成torch可用的tensor。而这样的实现是有问题的,原因在于truncnorm.rvs()是基于标准正态分布产生截断的正态分布,而在原模型中是使用standard deviation为0.1的正态分布来产生的,初次实现时自己忽略了这样的细节(且rvs函数没有发现可以调整正态分布方差的参数,故不可以继续使用rvs函数来生成)。画出了一开始生成的错误的截断正态分布:

问题解决:

参考了上面链接中另一个实现的截断正态分布生成函数代码如下:

def 对应的画出了新的截断正态分布生成函数和原tf中的函数的结果如下:

基本可以达到tensorflow中truncnormal相同的效果。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?