一、TensorFlow简介

TensorFlow是由谷歌开发的一套机器学习的工具,使用方法很简单,只需要输入训练数据位置,设定参数和优化方法等,TensorFlow就可以将优化结果显示出来,节省了很大量的编程时间,TensorFlow的功能很多很强大,这边挑选了一个比较简单实现的方法,就是利用TensorFlow的逻辑回归算法对数据库中的手写数字做识别,让机器找出规律,然后再导入新的数字让机器识别。

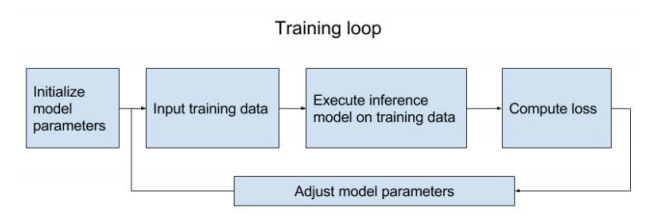

二、流程介绍

上图是TensorFlow的流程,可以看到一开始要先将参数初始化,然后导入训练数据,计算偏差,然后修正参数,再导入新的训练数据,不断重复,当数据量越大,理论上参数就会越准确,不过也要注意不可训练过度。

三、导入数据

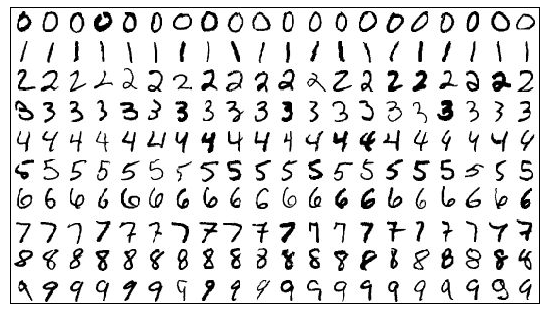

数据可进入MNIST数据库 (Mixed National Institute of Standards and Technology database),这是一个开放的数据库,里面有许多免费的训练数据可以提供下载,这次我们要下载的是手写的阿拉伯数字,为什么要阿拉伯数字呢?1、因为结果少,只有十个,比较好训练 2、图片的容量小,不占空间,下面是部分的训练数据案例

TensorFlow可以直接下载MNIST上的训练数据,并将它导入使用,下面为导入数据的代码

from tensorflow.examples.tutorials.mnist importinput_data

MNIST= input_data.read_data_sets("/data/mnist", one_hot=True)

四、设定参数

接下来就是在TensorFlow里设定逻辑回归的参数,我们知道回归的公式为Y=w*X+b,X为输入,Y为计算结果,w为权重参数,b为修正参数,其中w和b就是我们要训练修正的参数,但训练里要怎么判断计算结果好坏呢?就是要判断计算出来的Y和实际的Y损失值(loss)是多少,并尽量减少loss,这边我们使用softmax函数来计算,softmax函数在计算多类别分类上的表现比较好,有兴趣可以百度一下,这边就不展开说明了,下面为参数设定

X = tf.placeholder(tf.float32, [batch_size, 784], name="image")

Y= tf.placeholder(tf.float32, [batch_size, 10], name="label")

X为输入的图片,图片大小为784K,Y为实际结果,总共有十个结果(数字0-9)

w = tf.Variable(tf.random_normal(shape=[784, 10], stddev=0.01), name="weights")

b= tf.Variable(tf.zeros([1, 10]), name="bias")

w初始值为一个随机的变数,标准差为0.01,b初始值为0。

logits = tf.matmul(X, w) +b

entropy=tf.nn.softmax_cross_entropy_with_logits(logits=logits, labels=Y)

loss= tf.reduce_sum(entropy)

TensorFlow里面已经有softmax的函数,只要把他叫出来就可以使用。

optimizer =tf.train.GradientDescentOptimizer(learning_rate=learning_rate).minimize(loss)

init=tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init)

n_batches= int(MNIST.train.num_examples/batch_size)for i in range(n_epochs): #train the model n_epochs times

for _ inrange(n_batches):

X_batch, Y_batch=MNIST.train.next_batch(batch_size)

sess.run([optimizer, loss], feed_dict={X: X_batch, Y:Y_batch})

接着就是设定优化方式,这边是使用梯度降下发,然后将参数初始化,接着就运行了,这边要提一下,我们的训练方式是每次从训练数据里面抓取一个batch的数据,然后进行计算,这样可以预防过度训练,也比较可以进行事后的验证,运行完后再用下面的代码进行验证

n_batches = int(MNIST.test.num_examples/batch_size)

total_correct_preds=0for i inrange(n_batches):

X_batch, Y_batch=MNIST.test.next_batch(batch_size)

_, loss_batch, logits_batch=sess.run([optimizer, loss, logits],

feed_dict={X: X_batch, Y:Y_batch})

preds=tf.nn.softmax(logits_batch)

correct_preds= tf.equal(tf.argmax(preds, 1), tf.argmax(Y_batch, 1))

accuracy=tf.reduce_sum(tf.cast(correct_preds, tf.float32))

total_correct_preds+=sess.run(accuracy)print ("Accuracy {0}".format(total_correct_preds/MNIST.test.num_examples))

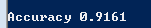

最后shell跑出来的结果是0.916,虽然看上去还算是不错的结果,但其实准确率是很低的,因为他验证的方式是判断一个图片是否为某个数字(单输出),所以假如机器随便猜也会有0.82左右的命中几率(0.9*0.9+0.1*0.1),想要更准确的话目前想到有两个方向,一个是提高训练量和增加神经网络的层数。

1258

1258

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?