来源 | 极链AI云(性价比最高的共享GPU算力平台,双十一活动新人注册可领取268元大礼包,价值150+小时的GPU免费使用时长,领取地址:https://cloud.videojj.com/)

一、yolov2对比yolov1的主要改进点

1.Batch Normalization(批标准化)

(ps:归一化(normalization)将一批不太标准的数据统一到指定的格式。我们在数据处理时常用的是将一组范围差距较大或者单位不同的数据依据一定规则变化到指定的范围之内。)

设计新网络darknet-19,加入了bn(batch normalization)层,收敛更快,相当于加了新的正则,可以去掉之前网络里的dropout层,提高2%map。

2.High Resolution Classifier

原来yolo网络在预训练输入尺寸为224 * 224,detection的时分辨率变为448 * 448的输入,分类模型切换到检测模型的时候,模型还要适应图像分辨率的改变。

yolov2则将预训练分为两步:224 * 224的输入从头开始训练网络,然后在将输入调整到448 * 448.最后再在检测的数据集上fine-tuning。最终提高大约4%map。

3. Convolutional with anchor boxes

借鉴Faster R-CNN的思想使用聚类算法产生anchors。map有所下降但是recall(召回率)提高了。

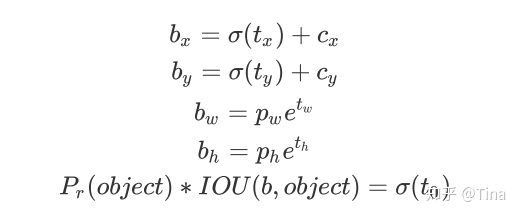

4. direct location prediction

坐标回归方式改变

5.class loss function

类别损失使用softmax来获得。

二、 yolov3的改进部分

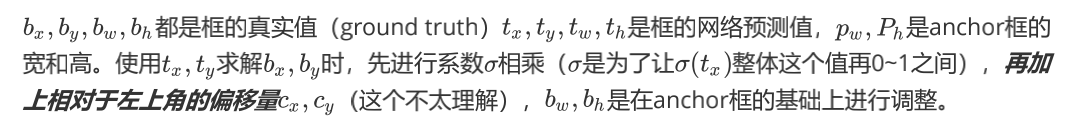

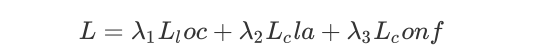

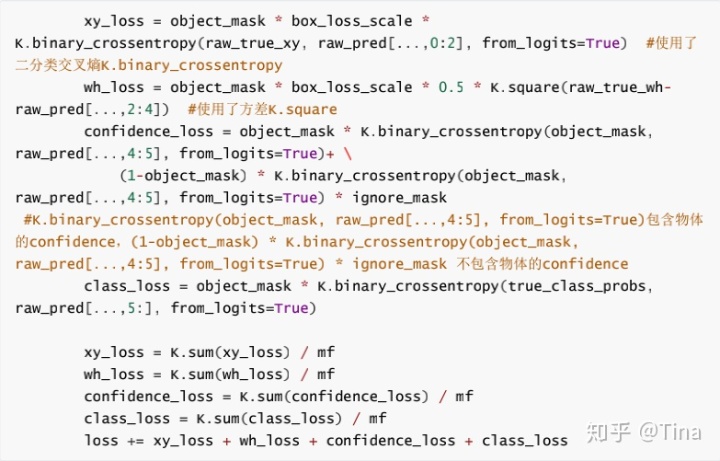

loss的改进

分别是位置损失,类别损失,置信度损失

yolov3具体的损失函数

三、yolov3网络

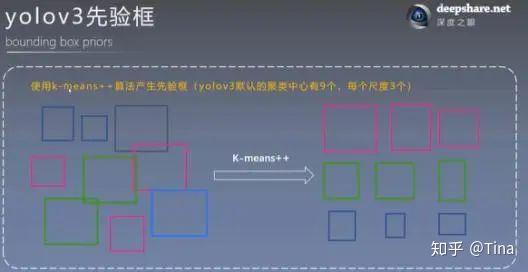

1.yolov3先验框

初始值k的选择:先随机在label boxes(ground truth)中选取k个框距离度量:d=1-iou(iou在0-1之间)

目标:通过不断更新中心值使得d的值最小

按照框的大小分为3组,每组三个框

52 * 52的框能预测小物体除了对应原图区域小以外,还融合了浅层的特征(浅层特征包含小物体特征比较丰富)

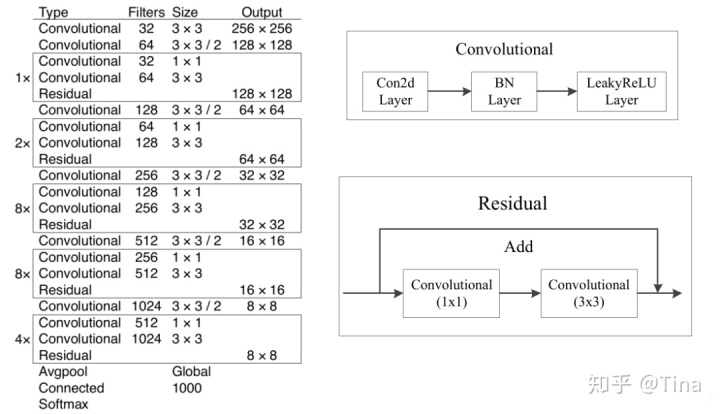

2.darknet-53的模型结构

这个网络主要是由一系列的1x1和3x3的卷积层组成(每个卷积层后都会跟一个BN层和一个LeakyReLU) 层,作者说因为网络中有53个convolutional layers,所以叫做Darknet-53(2 + 1*2 + 1 + 2*2 + 1 + 8*2 +1 + 8*2 + 1 + 4*2 + 1 = 53 按照顺序数,不包括Residual中的卷积层,最后的Connected是全连接层也算卷积层,一共53个)。下图就是Darknet-53的结构图,在右侧标注了一些信息方便理解。(卷积的strides默认为(1,1),padding默认为same,当strides为(2,2)时padding为valid)

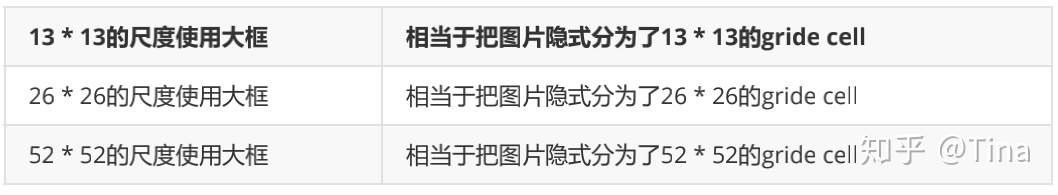

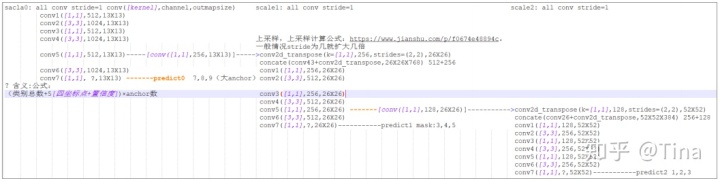

3.多尺度预测

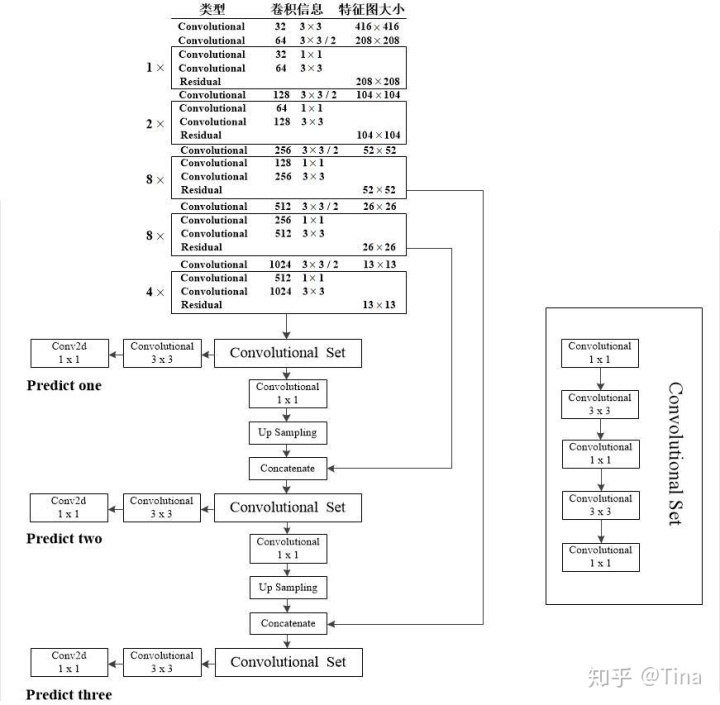

原Darknet53中的尺寸是在图片分类训练集上训练的,所以输入的图像尺寸是256x256,下图是以YOLO v3 416模型进行绘制的,所以输入的尺寸是416x416,预测的三个特征层大小分别是52,26, 13。

在上图中我们能够很清晰的看到三个预测层分别来自的什么地方,以及Concatenate层与哪个层进行拼接。

注意Convolutional是指Conv2d+BN+LeakyReLU,和Darknet53图中的一样,而生成预测结果的最后三层都只是Conv2d。

在darknet-53后面使用了7个卷积层做预测。最后一层的是自己设定的适用自己的数据集合对于voc数据集共20类(batchsize忽略)

13 * 13尺度预测输出:13 * 13 * 75

26 * 26尺度预测输出:26 * 26 * 75

52 * 52尺度预测输出:52 * 52 * 75

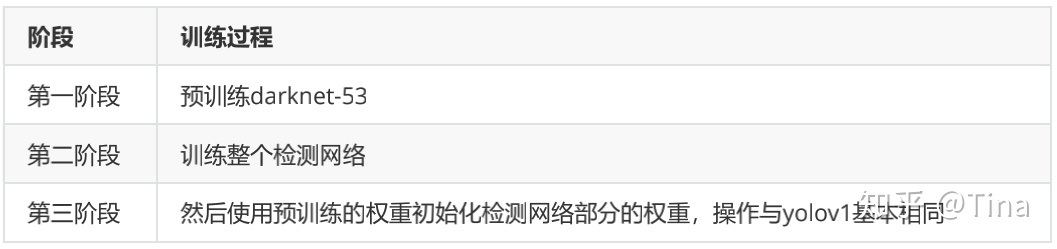

四、yolov3网络训练

在实际工程中可使用两种方法:

1. 预训练分类网络,然后在训练检测网络

2. 直接训练检测网络(需要大量数据),效果一般是经过预训练的方法更好

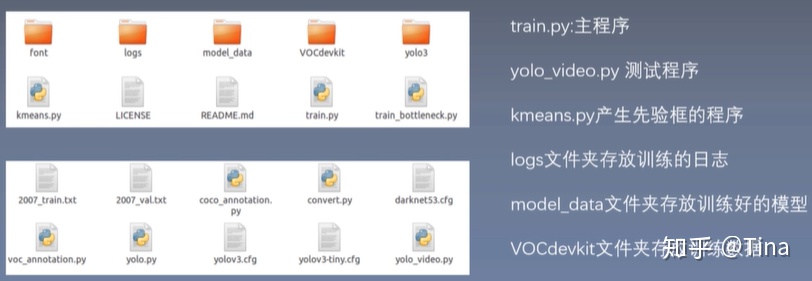

五、yolov3代码分析

第一步:下载作者使用的darknet训练的yolov3的权重

第二步:使用conver.py将权重转换为.h5格式

第三步:运行yolo_video.py测试程序

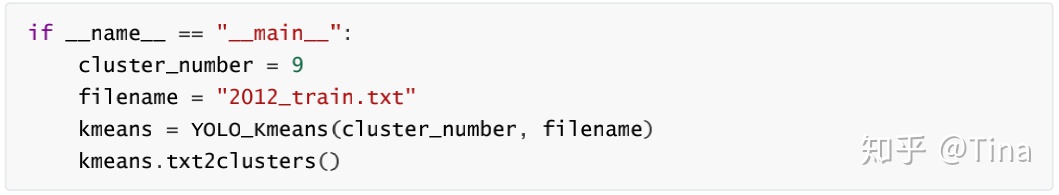

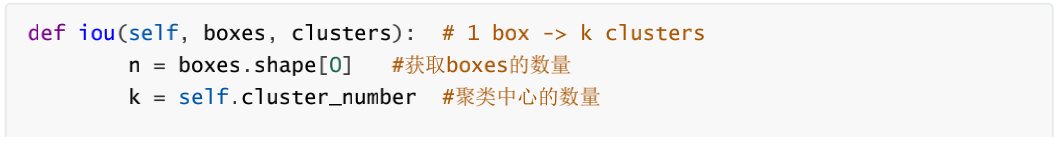

1. kmeans.py

主函数

cluster_number = 9 聚类中心的个数为9

filename = "2012_train.txt" 训练数据存放的txt文件

kmeans = YOLO_Kmeans(cluster_number,

filename) 使用YOLO_Kmeans(cluster_number, filename)类实例化一个kmeans对象

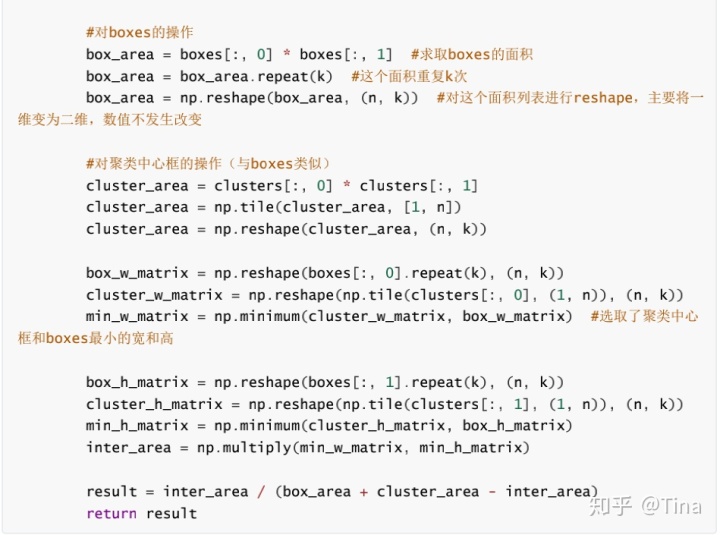

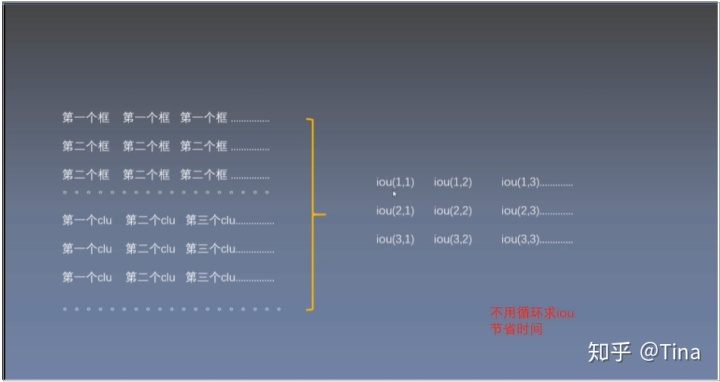

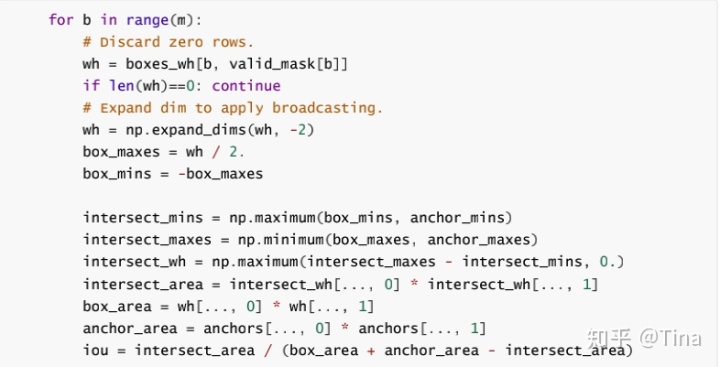

kmeans.txt2clusters() 最后调用kmeans里包含kmeans.txt2clusters()这个对象的方法(不太确定) 最核心部分为 def iou()这个函数

iou(1,1)即第一个boxes与第一个聚类中心框的iou(交并比)

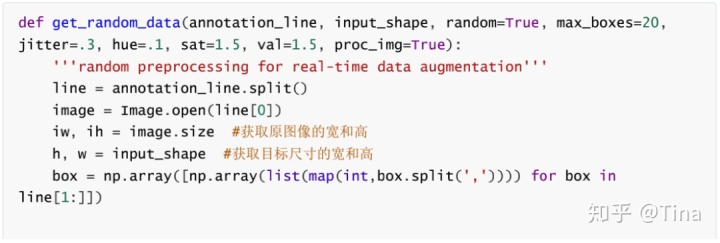

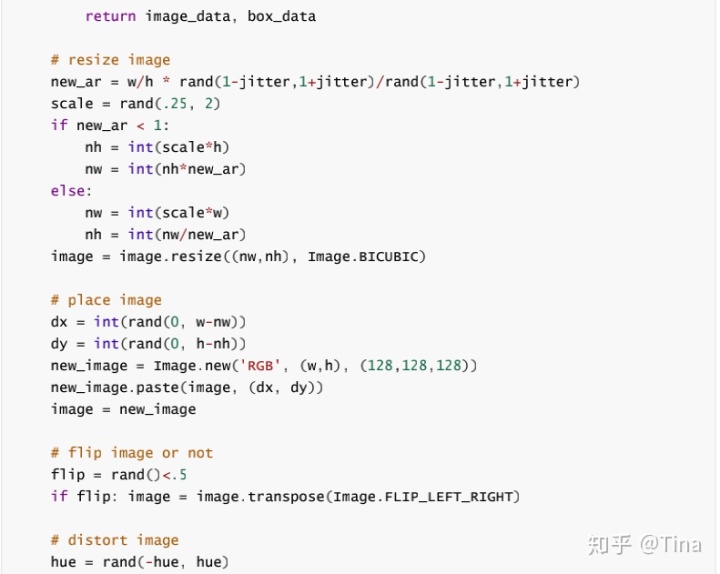

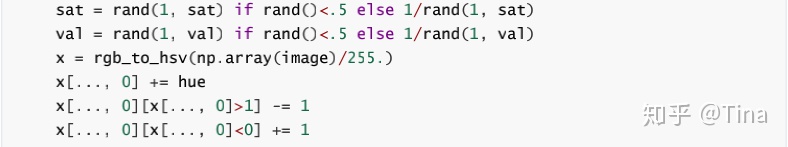

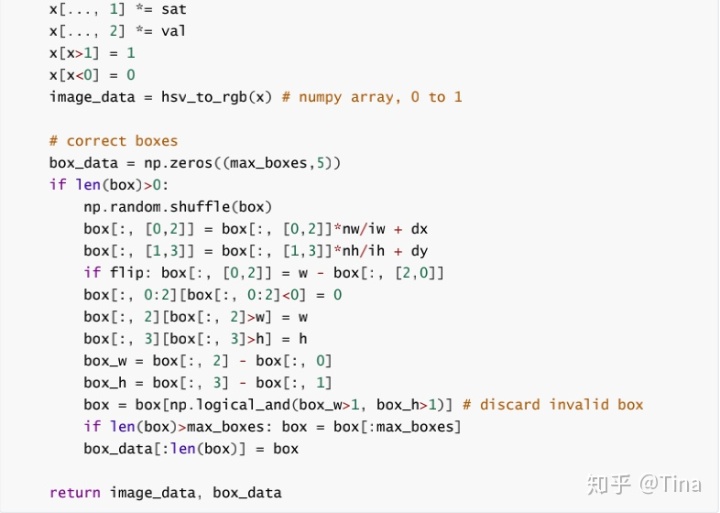

2. utils.py(数据处理的代码)

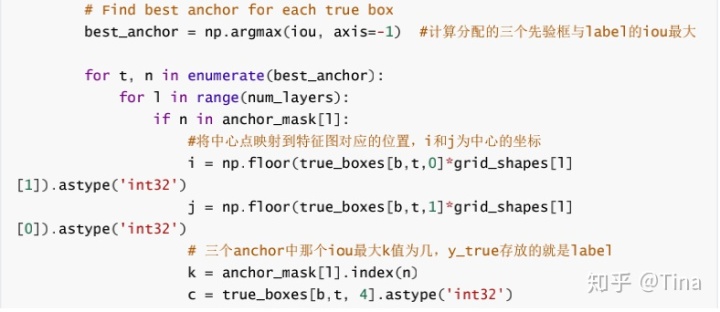

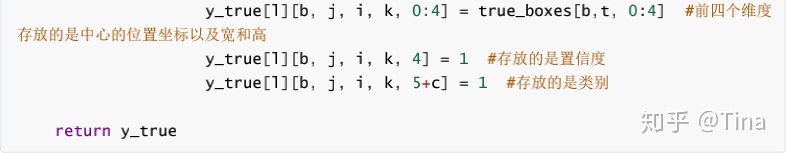

3. model.py

定义网络结构

损失函数

文末小结~

这篇真的是纯纯纯···干货了,是大佬自己学习整理出来的,拿出来给大家学习分享。在这里表示灰常感谢啦~

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?