线性判别函数是一类特殊的分类器,该分类器是样本观测值的线性函数。如何根据样本确定线性判别函数是线性判别分析要研究的问题。线性判别分析从形式上来看类似于数理统计中的线性统计模型,但两者又有很大的不同。这里的不同主要表现为因变量

![]()

的取值方式不一样。在线性统计模型中,因变量

![]()

是定义在

![]()

上的实值函数,而在线性判别分析中

![]()

的取值具有一定的随意性,仅代表离散的类别标签。鉴于此,有必要对线性判别分析进行专门的研究。

- 基本概念

线性判别函数定义为样本观测值的线性函数。假设样本观测值为

![]()

,线性判别函数

![]()

,

其中

![]()

为权重向量,

![]()

为偏置。根据判别函数

![]()

的取值并结合某种规则,我们可以将样本划入某一类。以后若不做特殊说明,均只考虑二分类问题。

线性判别分析要解决的问题就是根据训练样本确定权重向量

![]()

及偏置

![]()

,使得判别函数

![]()

具有尽可能低的分类误差。由训练样本确定

![]()

和

![]()

的关键在于设计一个合理的损失函数

![]()

,当

![]()

能够较好地对样本进行分类时,

![]()

取到最小值(不失一般性,设偏置

![]()

,仅考虑权重向量

![]()

)。

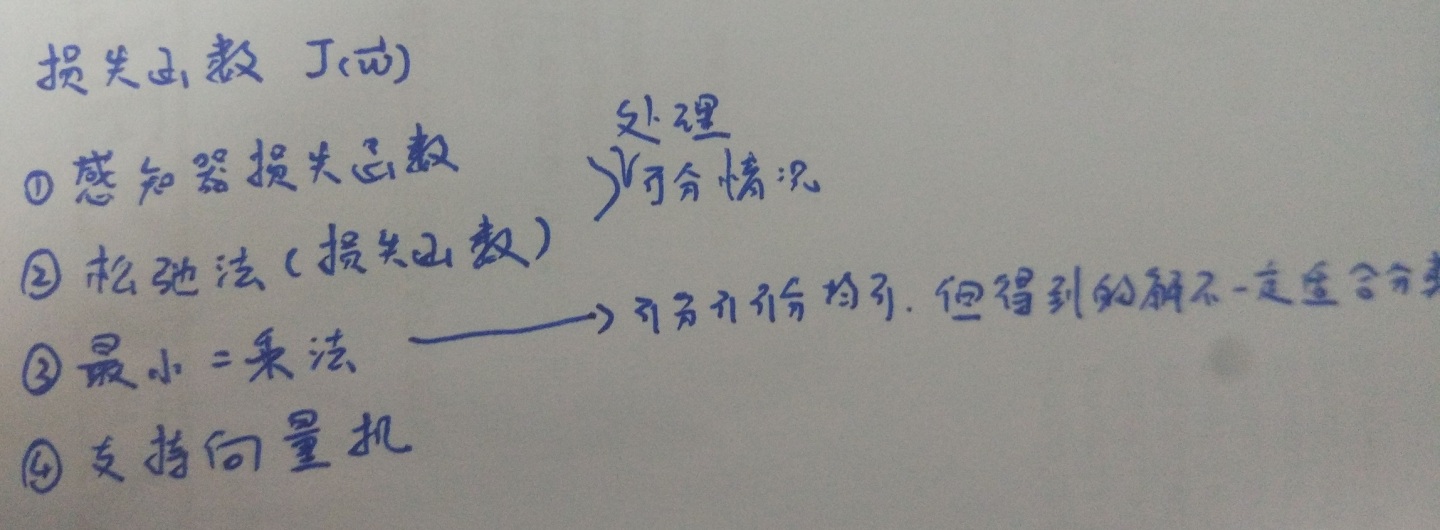

根据损失函数

![]()

设计的不同,产生了多种估计权向量

![]()

的方法,下面就几种典型的方法进行简单介绍。

2. 感知器算法

感知器算法规定,若

![]()

,则

![]()

属于类1;若

![]()

,则

![]()

属于类2。令

![]()

,

![]()

,如果

![]()

能够将训练样本正确分类,则有

![]()

,

![]()

类1;

![]()

,

![]()

类2。

称

![]()

为按照类别标签归一化后的样本。以下内容均假定样本已归一化。对所有被正确分类的样本,均有

![]()

。

感知器准则函数定义为所有被错分样本与权重向量的内积的负数,即

其中,

![]()

是被

![]()

错分的样本集。如果没有样本被错分,

![]()

就是空的,此时定义

![]()

。从几何上可知,

![]()

与错分样本到判决边界距离之和成正比。

对准则函数进行求导,得到

梯度下降的迭代公式为

即权向量的每次更新仅与上一次被错分的样本的观测值的和有关。

(感知器算法的收敛性证明 缺)

3. 松弛法(损失函数)

松弛法规定,若

![]()

,则

![]()

属于类1;若

![]()

,则

![]()

属于类2。令

![]()

,

![]()

,如果

![]()

能够将训练样本正确分类,那么

![]()

,

![]()

类1;

![]()

,

![]()

类2。

称

![]()

为按照类别标签归一化后的样本。以下内容均假定样本已归一化。对所有被正确分类的样本,均有

![]()

。

松弛算法的损失函数定义为

![]()

,

其中,

![]()

代表被

![]()

错分的训练样本的集合。若

![]()

为空,则定义

![]()

。

对准则函数进行求导,得到

![]()

,

梯度下降的迭代公式为

即每次更新量为错分样本的观测值的加权和。

(松弛算法的收敛性证明 缺)

4. 最小二乘法

同样考虑二分类问题。假设赋予类别1以类别标签

![]()

,赋予类别2以类别标签

![]()

,最小二乘分类法的目标是寻找一个合适的权重向量

![]()

,使得

![]()

与类别标签的值尽可能接近。

最小二乘分类算法最小化如下损失函数

其中

![]()

为每一个样本的类别标签,

![]()

为所有样本组成的系数矩阵。一般来说,

![]()

是列满秩的,

![]()

存在闭式解,

![]()

。

注意,分类问题不同于线性统计模型中的参数估计,其类别标签

![]()

、

![]()

的选取具有一定的任意性。

(1) 若取

![]()

,

![]()

,其中

![]()

为类别1的样本数,

![]()

为类别2的样本数,

![]()

,则上述最小二乘解与Fisher判别函数的解一致。证明如下:

其中

![]()

,

![]()

分别为类别1和类别2的样本均值;

![]()

,

![]()

分别为类别1和类别2的样本方差,

![]()

。

前面提到,假设偏置

![]()

,这意味着

![]()

,故

所以有

因为对于任意

![]()

均有

![]()

,所以

证毕!

(2) 若取

![]()

,

![]()

,当样本数目趋向无穷多时,最小二乘解是均方误差意义下最接近贝叶斯判别函数的线性分类器。

证明:

令贝叶斯判别函数为

![]()

,

假设样本为独立重复抽样得到,且符合如下分布函数

![]()

,

最小二乘算法最小化如下目标函数

![]()

,

根据大数定律,当

![]()

时,样本均值依概率收敛于期望,

![]()

,

其中,

![]()

,

![]()

,

那么,

![]()

,

最小化

![]()

会使上式中的第一项最小化。故当样本趋近于无穷时最小二乘解是最接近贝叶斯判别函数的线性分类器。

证毕!

6. 支持向量机

支持向量机算法最小化如下目标函数

![]()

,

![]()

,

其中

![]()

或

![]()

为类别标签。

求解方法,略。

919

919

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?