提起李宏毅老师,熟悉机器学习的读者朋友一定不会陌生。很多人选择的机器学习入门学习材料都是李宏毅老师的台大公开课视频。现在,机器学习爱好者有更完善的学习资料了。来自 Datawhale 的朋友整理、总结了李宏毅老师的机器学习视频教程,添加了课程笔记,实现了课程内容的完整复现。目前项目已完全开源,包括课程内容和复现代码,供大家使用。

目录

1.李宏毅机器学习简介

2.《LeeML-Notes》李宏毅机器学习笔记

3.《LeeML-Notes》学习笔记框架

4.笔记内容细节展示

a. 对梯度下降概念的解析

b. 为什么需要做特征缩放

c. 隐形马尔科夫链的应用

5.代码呈现

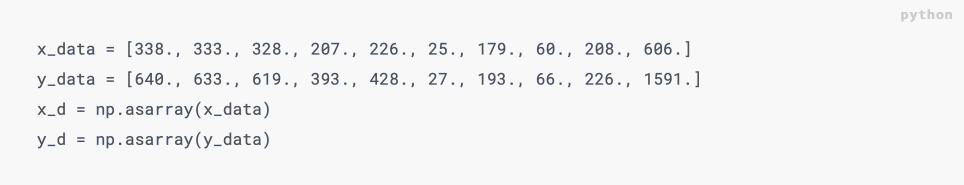

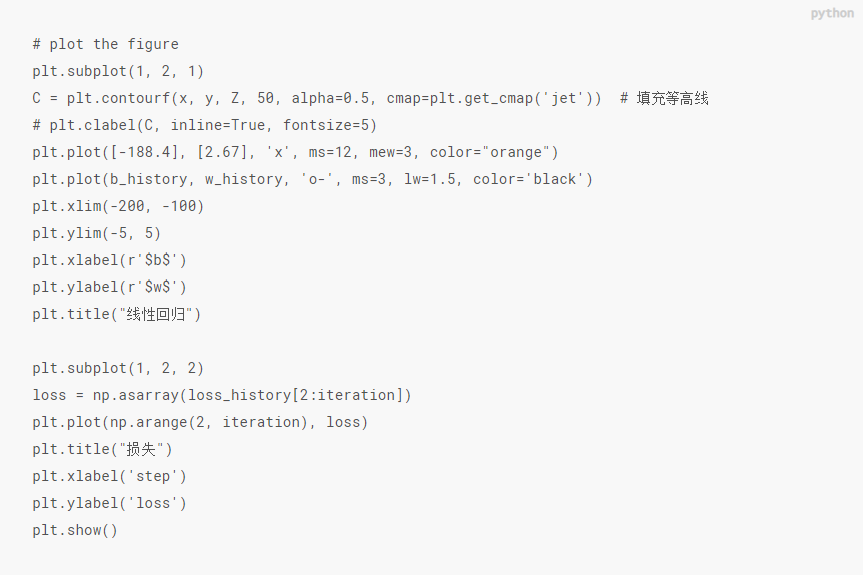

a. 回归分析

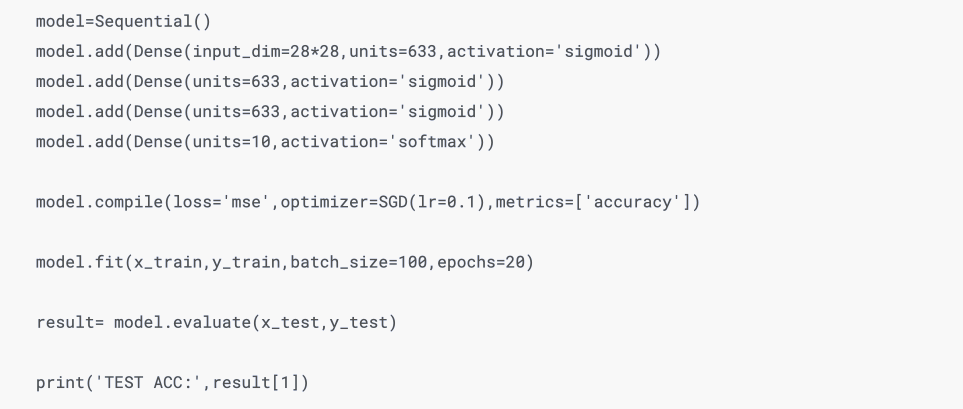

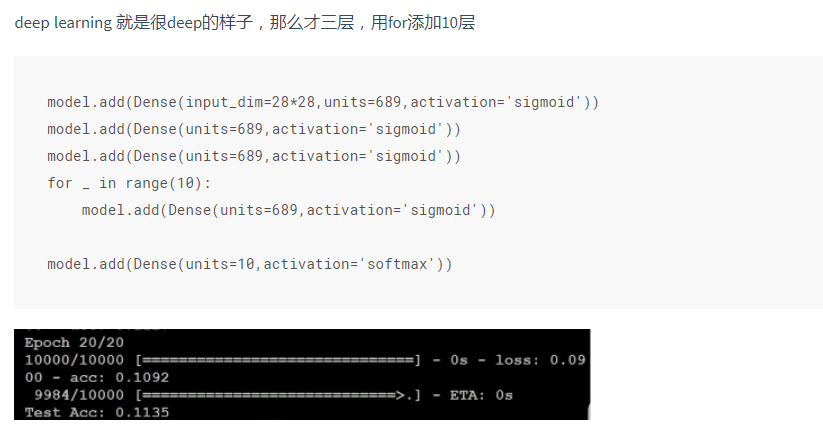

b. 深度学习

6.作业展示

7.交流互动

8.开源地址

9.配套视频

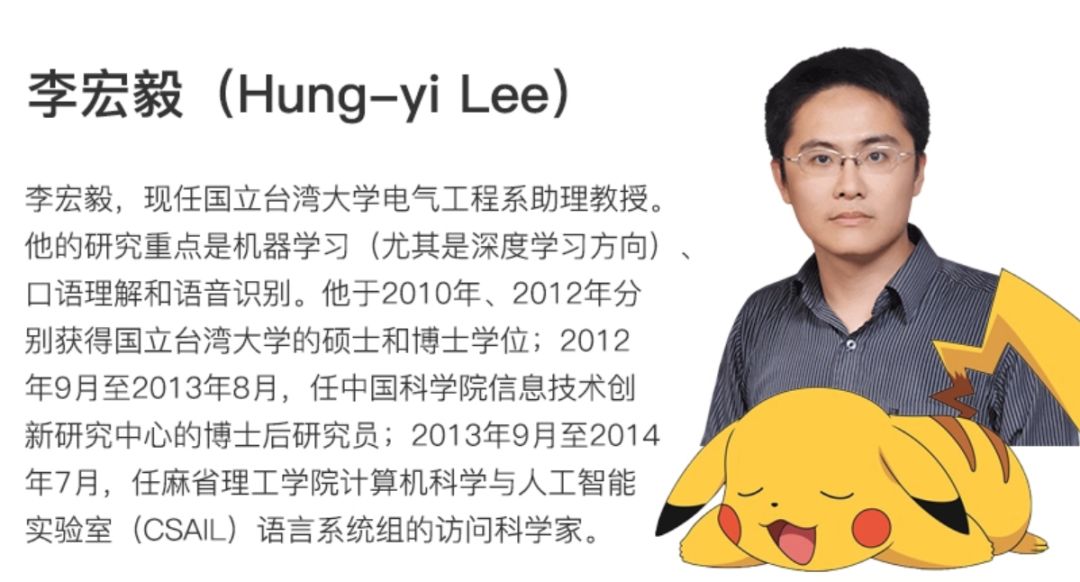

1. 李宏毅机器学习简介

李宏毅老师现任台湾大学电气工程助理教授,研究重点是机器学习,特别是深度学习领域。他有一系列公开的机器学习课程视频,在机器学习领域是很多人入门的教材,人气不输吴恩达的 Coursera 机器学习课程。

李宏毅老师的课程视频包括多种监督学习、无监督学习、半监督学习等领域,算法包括简单的线性回归、logistic 回归、支持向量机,乃至深度学习中的各类神经网络模型。

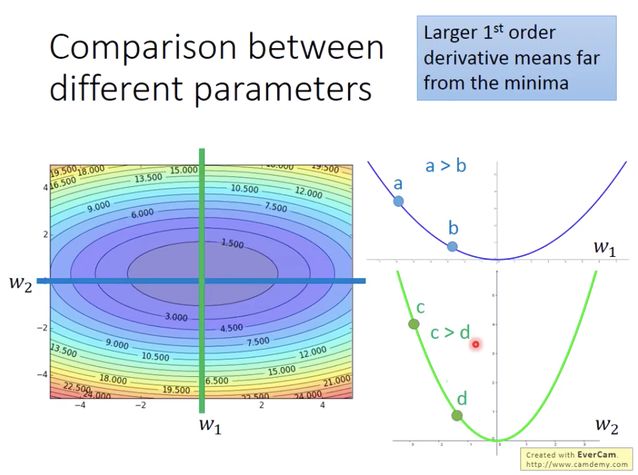

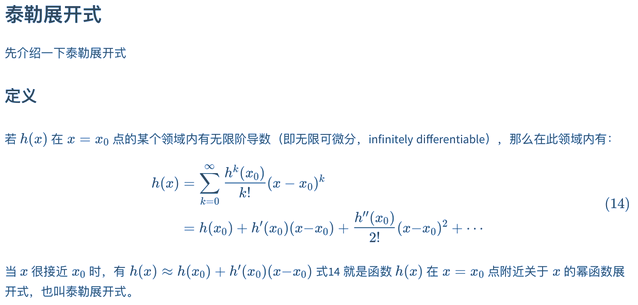

「梯度下降」课程中的 PPT 。对比了不同梯度下曲线的形状。

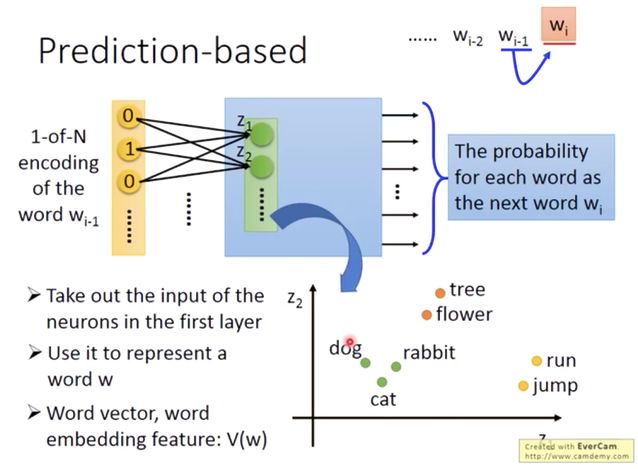

「词嵌入」课程中的PPT。展示了语义相似词语在词嵌入后呈现出的聚集关系。

因为课程中干货满满,李宏毅老师的课程视频也被称为中文世界中最好的机器学习视频。李老师以幽默风趣的上课风格让很多晦涩难懂的机器学习理论变得轻松易懂,他将理论知识与有趣的例子结合在课堂上展现,并且对深奥的理论知识逐步推导,保证学习者能够学习到问题的精髓所在。比如老师会经常用宝可梦来结合很多机器学习算法。对于想入门机器学习又想看中文讲解的人来说绝对是非常推荐的。

但是,考虑到很多机器学习爱好者对于课程笔记的需求,我们不仅仅需要的是教学视频。我们需要一份课程笔记,能够引领学习者的思路,帮助引导他们进入这个领域。因此,就诞生了这款《LeeML-Notes》李宏毅机器学习笔记。

2.《LeeML-Notes》李宏毅机器学习笔记

LeeML-Notes 是 Datawhale 开源组织自《机器学习南瓜书》后的又一开源学习项目,由团队成员王佳旭、金一鸣牵头,8 名成员历时半年精心打磨而成,实现了李宏毅老师机器学习课程内容的 100% 复现,并且在此基础上补充了有助于学习理解的相关资料和内容,对重难点公式进行了补充推导。期间,Datawhale 开源组织打造了《李宏毅老师机器学习》的组队学习,在众多学习者共同的努力下,对该内容进行了迭代和补充。下面,让我们来详细了解下工作详情吧。

具体准备工作:

2019 年 2 月--2019 年 4 月:笔记整理初级阶段,视频 100% 复现

2019 年 4 月--2019 年 6 月:网站搭建,对笔记内容及排版迭代优化

2019 年 5 月--2019 年 6 月:组队学习《李宏毅机器学习》并对内容进行迭代完善

2019 年 7 月:最后内容修正,正式推广。

下图为修订记录表:

3.《LeeML-Notes》学习笔记框架

3.a 亮点

这份学习笔记具有以下优点:

- 完全将李宏毅老师的讲课内容转为文字,方便学习者查阅参考。

- 不仅保留了 PPT 的内容,还根据课程内容补充了一些知识点。

- 具有完整的代码复现资料。

3.b 笔记框架

内容在整体框架上与李宏毅老师的机器学习课程保持一致,主要由监督学习、半监督学习、迁移学习、无监督学习、监督学习中的结构化学习以及强化学习构成。建议学习过程中将李宏毅老师的视频和这份资料搭配使用,效果极佳。笔记也和课程视频完全同步。

- P1 机器学习介绍

- P2 为什么要学习机器学习

- P3 回归

- P4 回归-演示

- P5 误差从哪来?

- P6 梯度下降

- P7 梯度下降(用 AOE 演示)

- P8 梯度下降(用 Minecraft 演示)

- P9 作业 1-PM2.5 预测

- P10 概率分类模型

- P11 logistic 回归

- P12 作业 2-赢家还是输家

- P13 深度学习简介

- P14 反向传播

- P15 深度学习初试

- P16 Keras2.0

- P17 Keras 演示

- P18 深度学习技巧

- P19 Keras 演示 2

- P20 Tensorflow 实现 Fizz Buzz

- P21 卷积神经网络

- P22 为什么要「深度」学习?

- P23 半监督学习

- P24 无监督学习-线性降维

- P25 无监督学习-词嵌入

- P26 无监督学习-领域嵌入

- P27 无监督学习-深度自编码器

- P28 无监督学习-深度生成模型 I

- P29 无监督学习-深度生成模型 II

- P30 迁移学习

- P31 支持向量机

- P32 结构化学习-介绍

- P33 结构化学习-线性模型

- P34 结构化学习-结构化支持向量机

- P35 结构化学习-序列标签

- P36 循环神经网络 I

- P37 循环神经网络 II

- P38 集成学习

- P39 深度强化学习浅析

- P40 机器学习的下一步

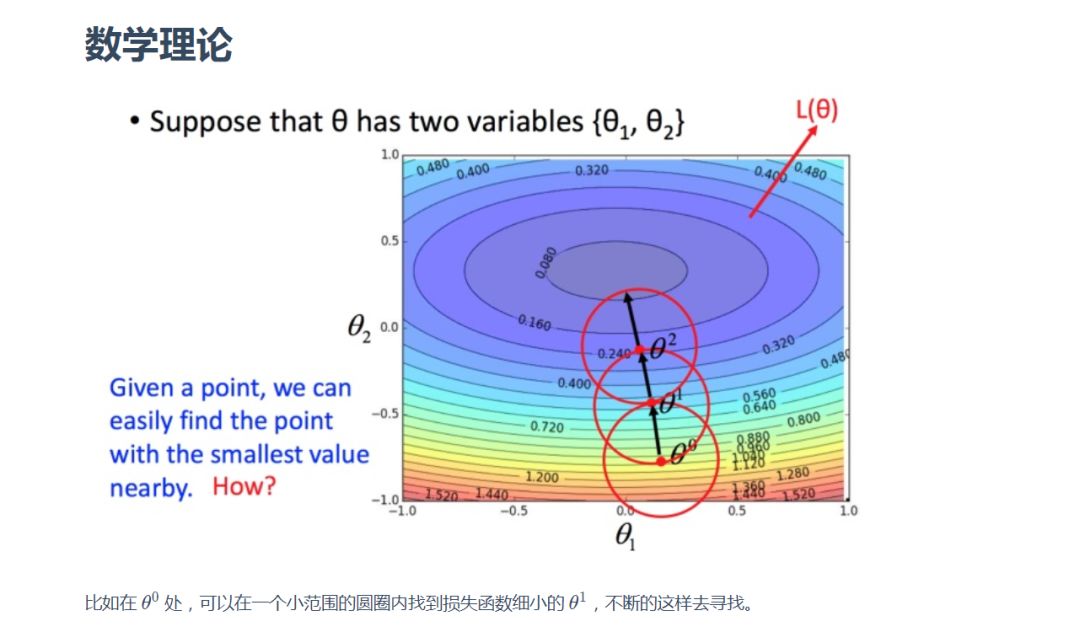

在笔记中重新整理PPT内容,并增加了一些注释。

在笔记中重新整理PPT内容,并增加了一些注释。

不对视频语音直接转文字,而是根据内容整理成知识点,方便读者理解阅读。

不对视频语音直接转文字,而是根据内容整理成知识点,方便读者理解阅读。

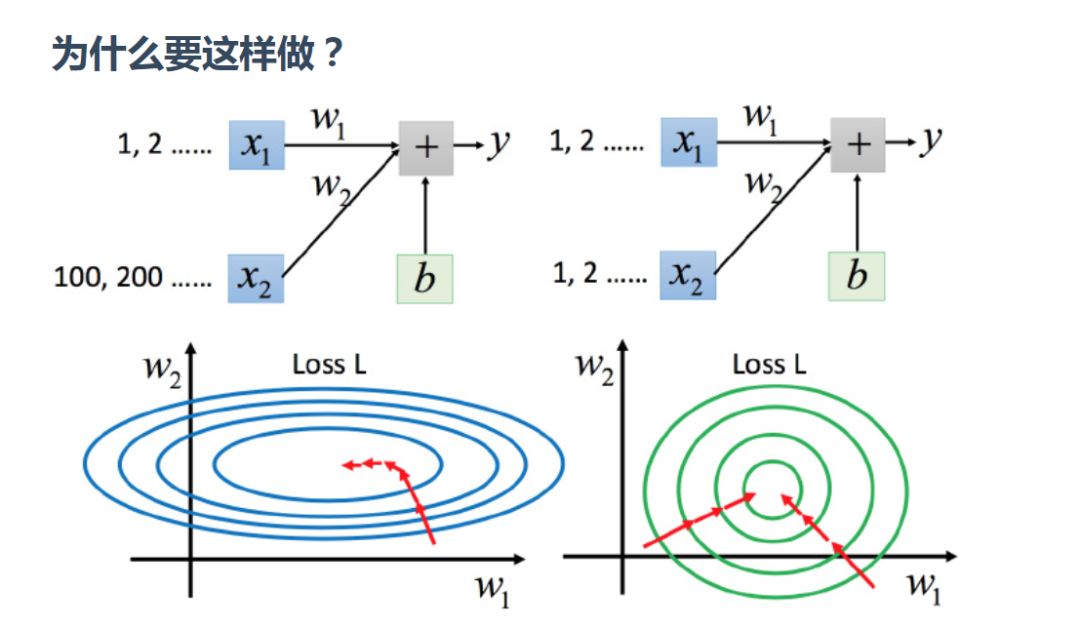

对特征缩放的PPT进行整理记录。

对特征缩放的PPT进行整理记录。

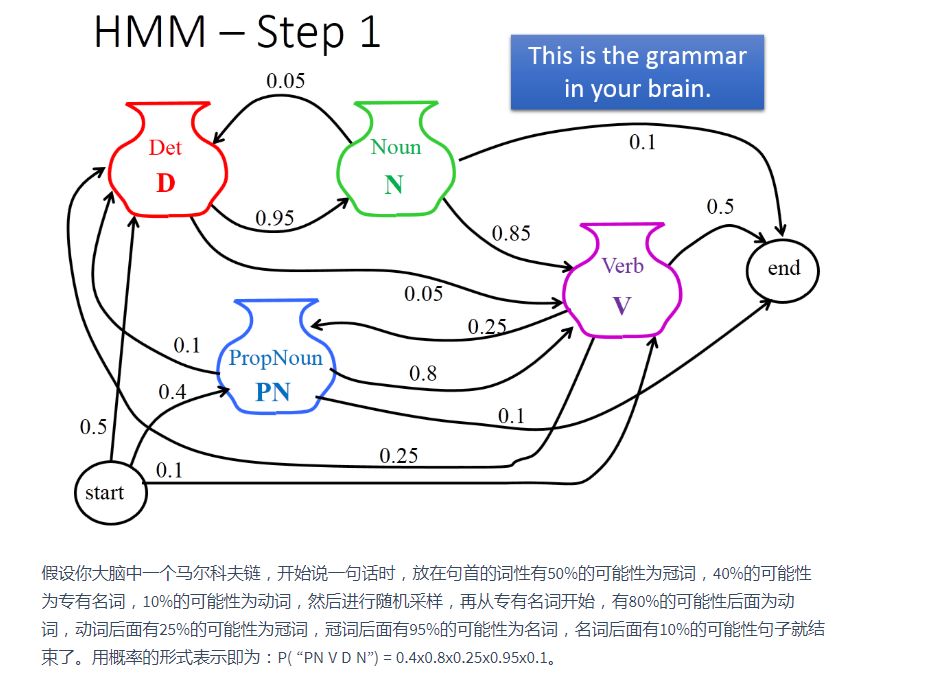

隐形马尔科夫链在语言模型中的应用。

隐形马尔科夫链在语言模型中的应用。

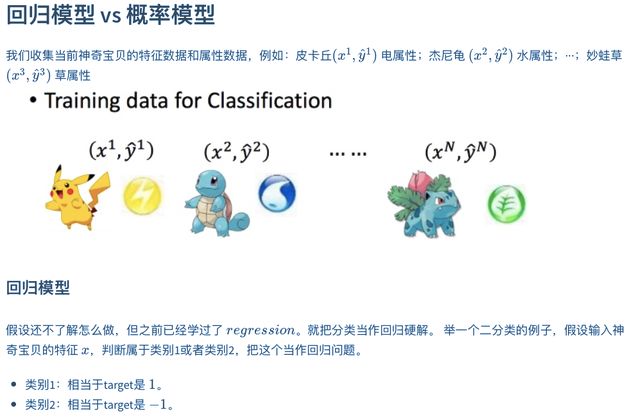

用算法对精灵宝可梦(神奇宝贝)进行分类。

用算法对精灵宝可梦(神奇宝贝)进行分类。

5. 代码呈现

Keras 的基础模型构建代码。

Keras 的基础模型构建代码。

用Keras构建深层模型

。

用Keras构建深层模型

。

问题描述。

问题描述。

笔记中提供了课程作业的参考答案。

笔记中提供了课程作业的参考答案。

- 8.开源地址:https://github.com/datawhalechina/leeml-notes

- 9. 配套视频:https://www.bilibili.com/video/av59538266

- 负责人:王佳旭、金一鸣

- 成员:黑桃、李威、 排骨、追风者、Summer、杨冰楠

899

899

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?