PyTorch是一个流行的深度学习框架,一般情况下使用单个GPU进行计算时是十分方便的。但是当涉及到处理大规模数据和并行处理时,需要利用多个GPU。这时PyTorch就显得不那么方便,所以这篇文章我们将介绍如何利用torch.multiprocessing模块,在PyTorch中实现高效的多进程处理。

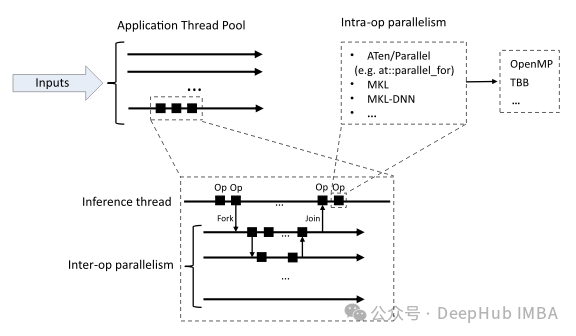

多进程是一种允许多个进程并发运行的方法,利用多个CPU内核和GPU进行并行计算。这可以大大提高数据加载、模型训练和推理等任务的性能。PyTorch提供了torch.multiprocessing模块来解决这个问题。

导入库

对于多进程的问题,我们主要要解决2方面的问题:1、数据的加载;2分布式的训练

数据加载

加载和预处理大型数据集可能是一个瓶颈。使用torch.utils.data.DataLoader和多个worker可以缓解这个问题。

num_workers=4意味着四个子进程将并行加载数据。这个方法可以在单个GPU时使用,通过增加数据读取进程可以加快数据读取的速度,提高训练效率。

分布式训练

分布式训练包括将训练过程分散到多个设备上。torch.multiprocessing可以用来实现这一点。

我们一般的训练流程是这样的

要修改这个流程,我们首先需要初始和共享模型

上面的例子中四个进程同时运行训练函数,共享模型参数。

多GPU的话则可以使用分布式数据并行(DDP)训练

对于大规模的分布式训练,PyTorch的torch.nn.parallel.DistributedDataParallel(DDP)是非常高效的。DDP可以封装模块并将其分布在多个进程和gpu上,为训练大型模型提供近线性缩放。

修改train函数初始化流程组并使用DDP包装模型。

修改main函数增加world_size参数并调整进程初始化以传递world_size。

这样,就可以在多个GPU上进行训练了

常见问题及解决

1、避免死锁

在脚本的开头使用mp.set_start_method(‘spawn’)来避免死锁。

因为多线程需要自己管理资源,所以请确保清理资源,防止内存泄漏。

2、异步执行

异步执行允许进程独立并发地运行,通常用于非阻塞操作。

3、共享内存管理

使用共享内存允许不同的进程在不复制数据的情况下处理相同的数据,从而减少内存开销并提高性能。

共享张量shared_tensor可以被多个进程修改

总结

PyTorch中的多线程处理可以显著提高性能,特别是在数据加载和分布式训练时使用torch.multiprocessing模块,可以有效地利用多个cpu,从而实现更快、更高效的计算。无论您是在处理大型数据集还是训练复杂模型,理解和利用多处理技术对于优化PyTorch中的性能都是必不可少的。使用分布式数据并行(DDP)进一步增强了跨多个gpu扩展训练的能力,使其成为大规模深度学习任务的强大工具。

作者:Ali ABUSALEH

2397

2397

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?