Hadoop之ReduceTask工作机制

目录

- 设置ReduceTask并行度(个数)

- 注意

- 实验:测试reducetask多少合适

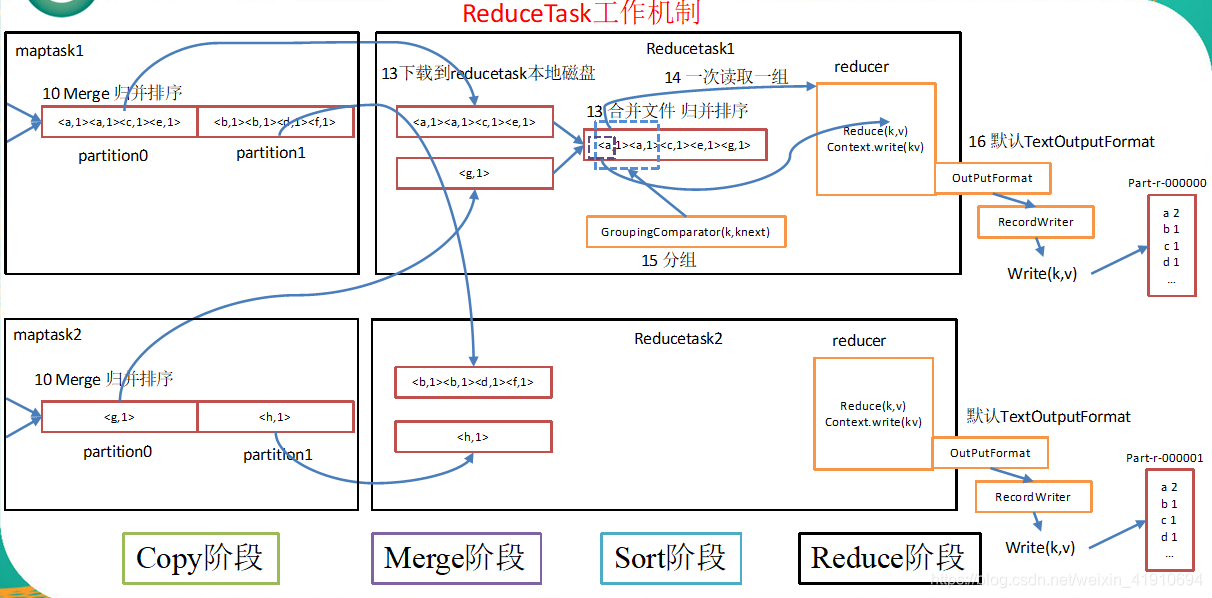

- ReduceTask工作机制

1. 设置ReduceTask并行度(个数)

reducetask的并行度同样影响整个job的执行并发度和执行效率,但与maptask的并发数由切片数决定不同,Reducetask数量的决定是可以直接手动设置:

//默认值是1,手动设置为4

job.setNumReduceTasks(4);

2. 注意

- reducetask=0 ,表示没有reduce阶段,输出文件个数和map个数一致。

- reducetask默认值就是1,所以输出文件个数为一个。

- 如果数据分布不均匀,就有可能在reduce阶段产生数据倾斜

- reducetask数量并不是任意设置,还要考虑业务逻辑需求,有些情况下,需要计算全局汇总结果,就只能有1个reducetask。

- 具体多少个reducetask,需要根据集群性能而定。

- 如果分区数不是1,但是reducetask为1,是否执行分区过程。答案是:不执行分区过程。因为在maptask的源码中,执行分区的前提是先判断reduceNum个数是否大于1。不大于1肯定不执行。

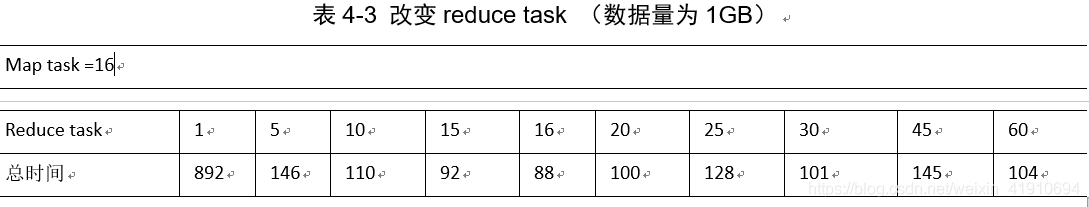

3. 实验:测试reducetask多少合适

- 实验环境:1个master节点,16个slave节点:CPU:8GHZ,内存: 2G

- 实验结论:

4. ReduceTask工作机制

3845

3845

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?