#DetToolChain

提升GPT-4V、Gemini检测任务性能,你需要这种提示范式

本文作者来自浙江大学、上海人工智能实验室、香港中文大学、悉尼大学和牛津大学。作者列表:吴逸璇,王逸舟,唐诗翔,吴文灏,贺通,Wanli Ouyang,Philip Torr,Jian Wu。其中,共同第一作者吴逸璇是浙江大学博士生,王逸舟是上海人工智能实验室科研助理。通讯作者唐诗翔是香港中文大学博士后研究员。

多模态大模型(Multimodal Large Language Models,MLLMs)在不同的任务中表现出了令人印象深刻的能力,尽管如此,这些模型在检测任务中的潜力仍被低估。在复杂的目标检测任务中需要精确坐标时,MLLMs 带有的幻觉又让它常常错过目标物体或给出不准确的边界框。为了让 MLLMs 赋能检测,现有的工作不仅需要收集大量高质量的指令数据集,还需要对开源模型进行微调。费时费力的同时,也无法利用闭源模型更强大的视觉理解能力。为此,浙江大学联合上海人工智能实验室和牛津大学提出了 DetToolChain,一种释放多模态大语言模型检测能力的新提示范式。不需要训练就能让多模态大模型学会精确检测。相关研究已经被 ECCV 2024 收录。

为了解决 MLLM 在检测任务上的问题,DetToolChain 从三个点出发:(1)针对检测设计视觉提示(visual prompts),比传统的文字提示(textual prompts)更直接有效的让 MLLM 理解位置信息,(2)把精细的检测任务拆解成小而简单的任务,(3)利用 chain-of-thought 逐步优化检测结果,也尽可能的避免多模态大模型的幻觉。

与上述的 insights 对应,DetToolChain 包含两个关键设计:(1)一套全面的视觉处理提示(visual processing prompts),直接在图像中绘制,可以显著缩小视觉信息和文本信息之间的差距。(2)一套全面的检测推理提示 (detection reasoning prompts),增强对检测目标的空间理解,并通过样本自适应的检测工具链逐步确定最终的目标精确位置。

通过将 DetToolChain 与 MLLM 结合,如 GPT-4V 和 Gemini,可以在无需指令调优的情况下支持各种检测任务,包括开放词汇检测、描述目标检测、指称表达理解和定向目标检测。

- 论文标题:DetToolChain: A New Prompting Paradigm to Unleash Detection Ability of MLLM

- 论文链接:https://arxiv.org/abs/2403.12488

什么是 DetToolChain?

图 1 DetToolChain 的整体框架

如图 1 所示,对于给定的查询图像,MLLM 被指示进行以下步骤:

I. Formatting:将任务的原始输入格式转化为适当的指令模板,作为 MLLM 的输入;

II. Think:将特定的复杂检测任务分解为更简单的子任务,并从检测提示工具包中选择有效的提示(prompts);

III. Execute:按顺序迭代执行特定的提示(prompts);

IV. Respond:运用 MLLM 其自身的推理能力来监督整个检测过程并返回最终响应(final answer)。

检测提示工具包:Visual Processing Prompts

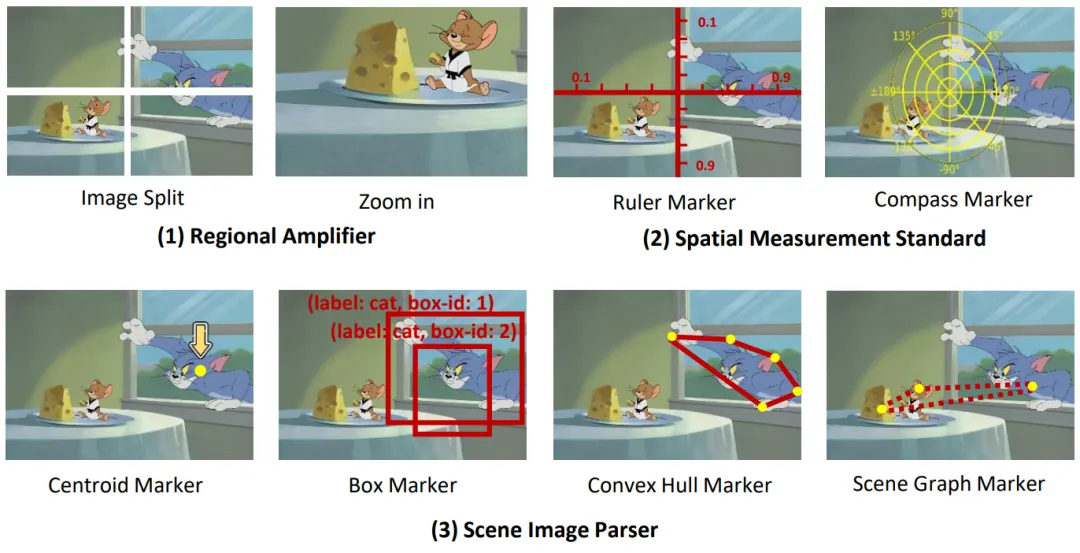

图 2:visual processing prompts 的示意图。我们设计了 (1) Regional Amplifier, (2) Spatial Measurement Standard, (3) Scene Image Parser,从不同的角度来提升 MLLMs 的检测能力。

如图 2 所示,(1) Regional Amplifier 旨在增强 MLLMs 对感兴趣区域(ROI)的可见性,包括将原始图像裁剪成不同部分子区域,重点关注目标物体所在子区域;此外,放大功能则使得可以对图像中特定子区域进行细粒度观察。

(2) Spatial Measurement Standard 通过在原始图像上叠加带有线性刻度的尺子和指南针,为目标检测提供更明确的参考,如图 2 (2) 所示。辅助尺子和指南针使 MLLMs 能够利用叠加在图像上的平移和旋转参考输出准确的坐标和角度。本质上,这一辅助线简化了检测任务,使 MLLMs 能够读取物体的坐标,而不是直接预测它们。

(3) Scene Image Parser 标记预测的物体位置或关系,利用空间和上下文信息实现对图像的空间关系理解。Scene Image Parser 可以分为两类:首先,针对单个目标物体,我们用质心、凸包和带标签名称及框索引的边界框标记预测的物体。这些标记以不同格式表示物体位置信息,使 MLLM 能够检测不同形状和背景的多样物体,特别是形状不规则或被大量遮挡的物体。例如,凸包标记器标记物体的边界点并将其连接为凸包,以增强对形状非常不规则的物体的检测性能。其次,针对多目标,我们通过场景图标记器(scene graph marker)连接不同物体的中心,以突出图像中物体之间的关系。基于场景图,MLLM 可以利用其上下文推理能力来优化预测的边界框并避免幻觉。例如,如图 2 (3) 所示,Jerry 要吃奶酪,因此它们的 bounding box 应该非常接近。

检测提示工具包:Detection Reasoning Prompts

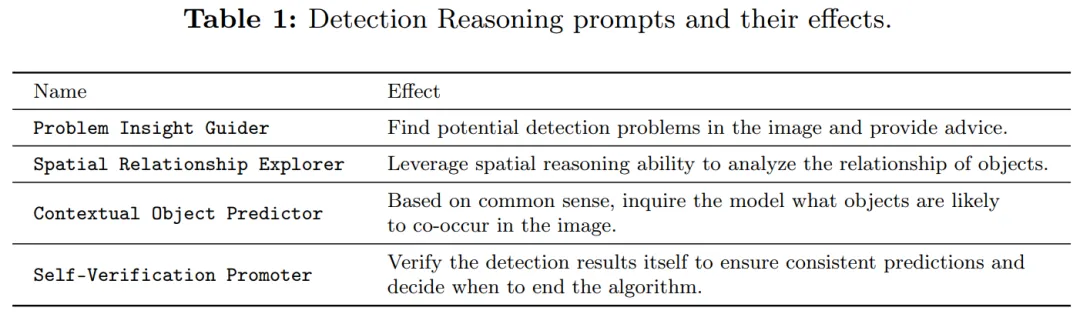

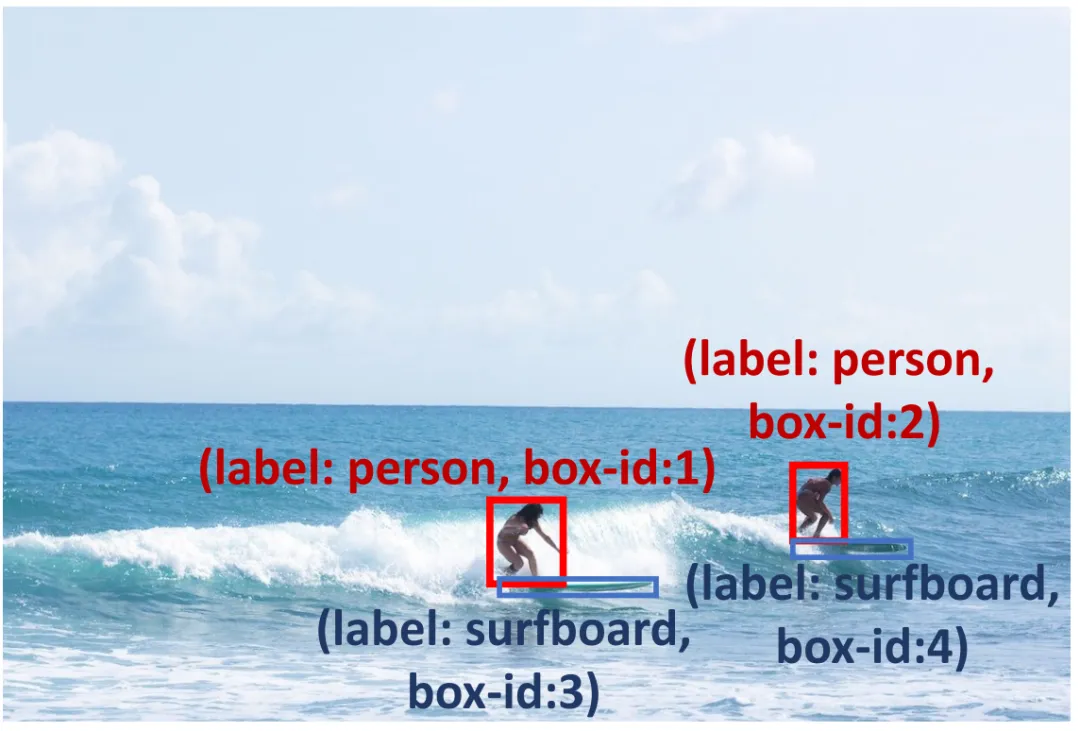

为了提高预测框的可靠性,我们进行了检测推理提示(如表 1 所示),以检查预测结果并诊断可能存在的潜在问题。首先,我们提出了 Problem Insight Guider,突出困难问题并为查询图像提供有效的检测建议和相似例子。例如,针对图 3,Problem Insight Guider 将该查询定义为小物体检测的问题,并建议通过放大冲浪板区域来解决它。其次,为了利用 MLLMs 固有的空间和上下文能力,我们设计了 Spatial Relationship Explorer 和 Contextual Object Predictor,以确保检测结果符合常识。如图 3 所示,冲浪板可能与海洋共现(上下文知识),而冲浪者的脚附近应该有一个冲浪板(空间知识)。此外,我们应用 Self-Verification Promoter 来增强多轮响应的一致性。为了进一步提升 MLLMs 的推理能力,我们采用了广泛应用的 prompting 方法,例如 debating 和 self-debugging 等。详细描述请见原文。

图 3 检测推理提示可以帮助 MLLMs 解决小物体检测问题,例如,利用常识定位人脚下的冲浪板,并鼓励模型在海洋中检测冲浪板。

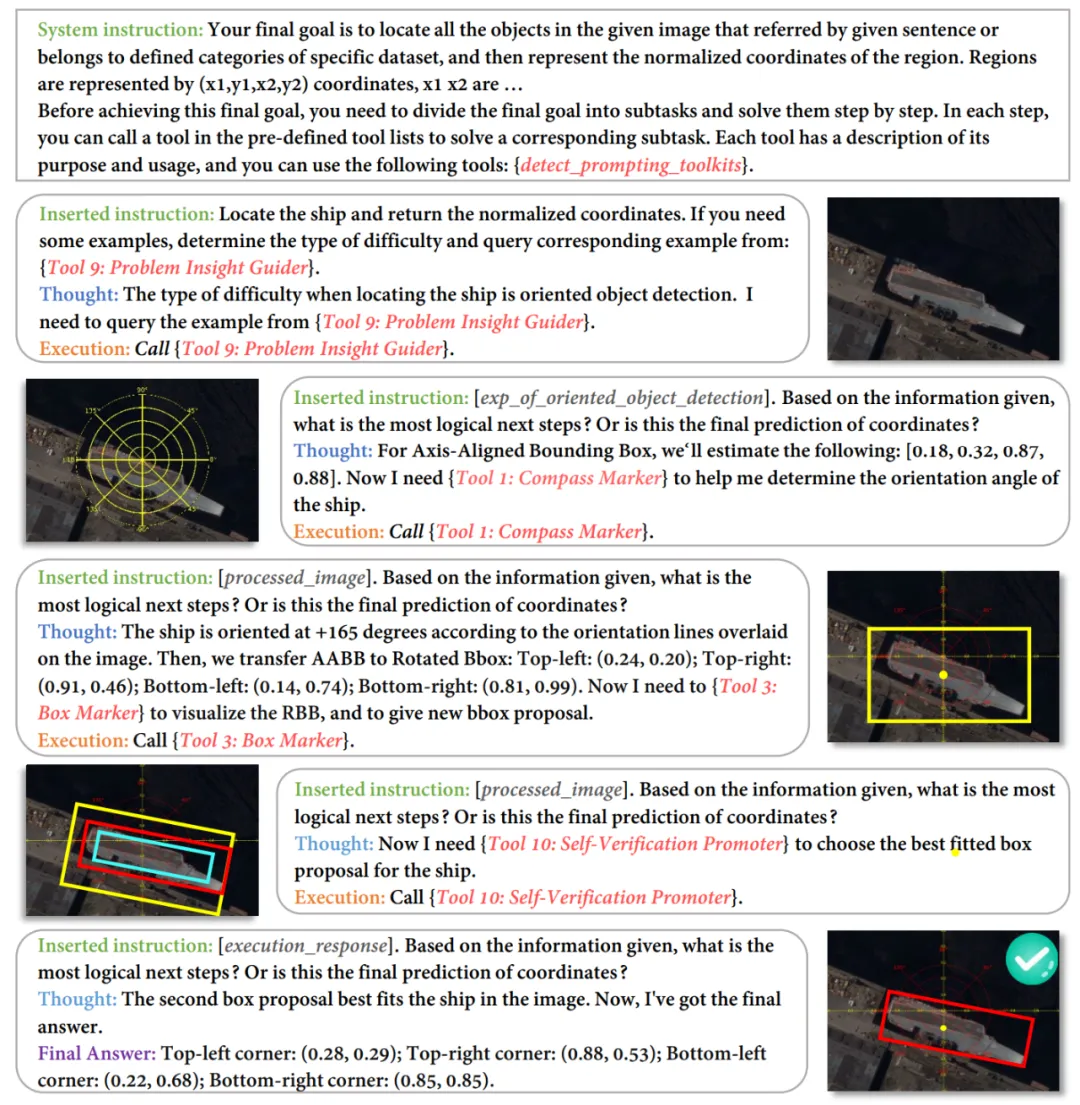

图 4 一个 DetToolChain 应用于旋转目标检测的例子(HRSC2016 数据集)

实验:免训练也能超越微调方法

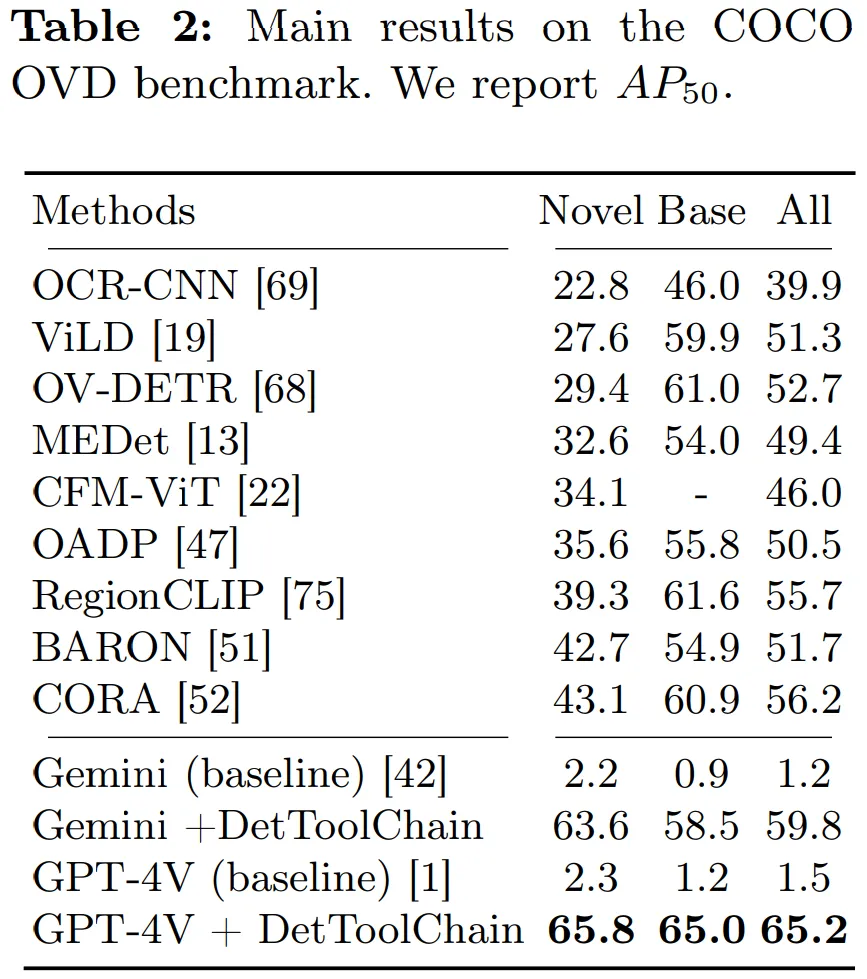

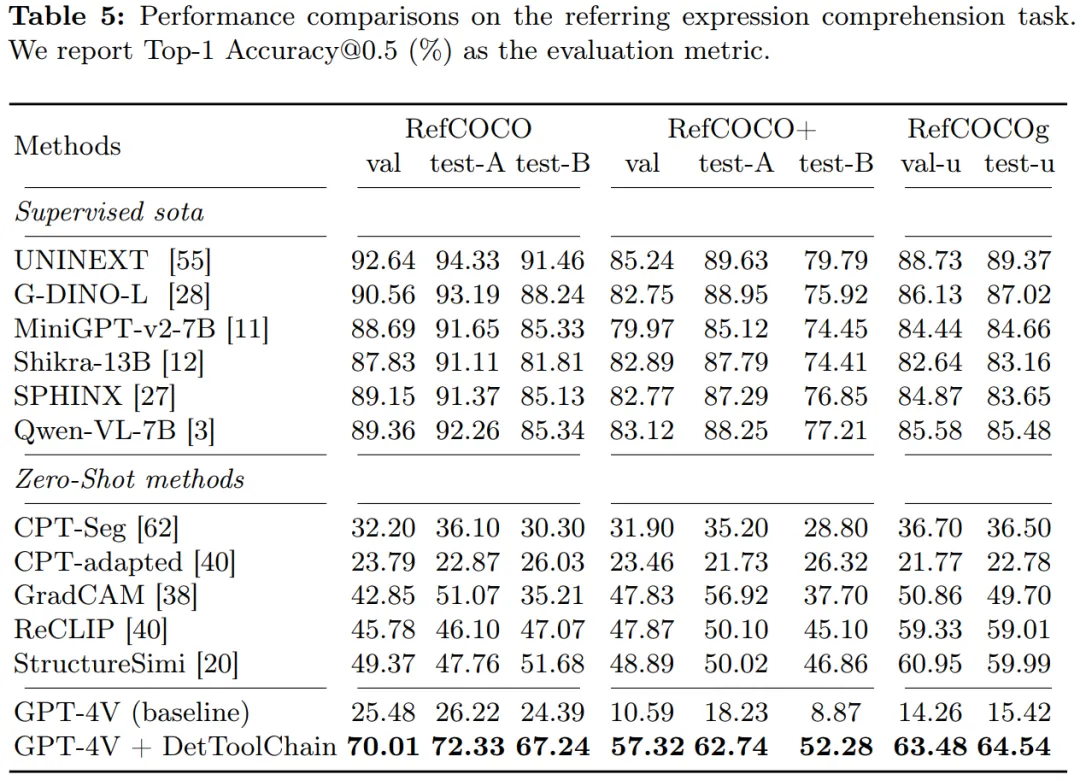

如表 2 所示,我们在 open vocabulary detection(OVD)上评估了我们的方法,测试了在 COCO OVD benchmark 中 17 个新类、48 个基础类和所有类的 AP50 结果。结果显示,使用我们的 DetToolChain,GPT-4V 和 Gemini 的性能均显著提升。

为了展示我们的方法在指称表达理解上的有效性,我们将我们的方法与其他零样本方法在 RefCOCO、RefCOCO + 和 RefCOCOg 数据集上进行了比较(表 5)。在 RefCOCO 上,DetToolChain 使得 GPT-4V 基线在 val、test-A 和 test-B 上的性能分别提升了 44.53%、46.11% 和 24.85%,展示了 DetToolChain 在 zero-shot 条件下优越的指称表达理解和定位性能。

#Entropy Law

中科大联合华为诺亚提出Entropy Law,揭秘大模型性能、数据压缩率以及训练损失关系

本工作由中科大认知智能全国重点实验室 IEEE Fellow 陈恩红团队与华为诺亚方舟实验室完成。陈恩红教授团队深耕数据挖掘、机器学习领域,在顶级期刊与会议上发表多篇论文,谷歌学术论文引用超两万次。诺亚方舟实验室是华为公司从事人工智能基础研究的实验室,秉持理论研究与应用创新并重的理念,致力于推动人工智能领域的技术创新和发展。

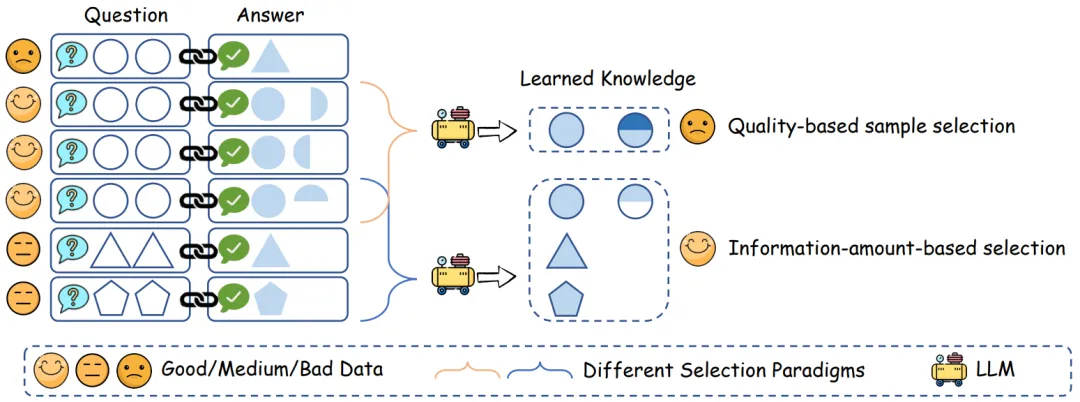

数据是大语言模型(LLMs)成功的基石,但并非所有数据都有益于模型学习。直觉上,高质量的样本在教授 LLM 上预期会有更好的效率。因此,现有方法通常专注于基于质量的数据选择。然而,这些方法中的大多数独立地评估不同的数据样本,忽略了样本之间复杂的组合效应。如图 1 所示,即使每个样本质量完美,由于它们的互信息冗余或不一致性,它们的组合可能仍然次优。尽管基于质量的子集由所有三个优质样本组成,但它们编码的知识实际上是冗余和冲突的。相比之下,另一个由几个相对较低质量但多样化的样本组成的数据子集在教授 LLM 方面可能传达更多信息。因此,基于质量的数据选择并未完全符合最大化 LLM 知识掌握的目标。

而本文旨在揭示 LLM 性能与数据选择之间的内在关系。受 LLM 信息压缩本质的启发,我们发现了一条 entropy law,它将 LLM 性能与数据压缩率和前几步模型训练的损失加以联系,分别反映了数据集的信息冗余程度和 LLM 对数据集中固有知识的掌握程度。通过理论推导和实证评估,我们发现模型性能与训练数据的压缩率呈负相关,而这通常会产生较低的训练损失。基于 entropy law 的发现,我们提出了一种非常高效且通用的数据选择方法用于训练 LLM,名为 ZIP,其旨在优先选择低压缩率的数据子集。ZIP 分多阶段、贪心地选择多样化的数据,最终获得一个具有良好多样性的数据子集。

- 团队:中科大认知智能全国重点实验室陈恩红团队,华为诺亚方舟实验室

- 论文链接: https://arxiv.org/pdf/2407.06645

- 代码链接: https://github.com/USTC-StarTeam/ZIP

图 1

Entropy law

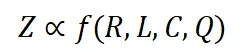

我们对数据压缩与 LLM 性能之间的关系进行理论分析。直觉上,训练数据的正确性和多样性会影响最终模型的性能。同时,如果数据存在严重的内在冲突或模型对数据编码的信息掌握不佳,LLM 的性能可能会次优。基于这些假设,我们将 LLM 的性能表示为 Z ,其预期会受到以下因素的影响:

- 数据压缩率 R:直觉上,压缩率越低的数据集表明信息密度越高。

- 训练损失 L:表示数据对模型来说是否难以记忆。在相同的基础模型下,高训练损失通常是由于数据集中存在噪声或不一致的信息。

- 数据一致性 C:数据的一致性通过给定前文情况下下一个 token 的概率的熵来反映。更高的数据一致性通常会带来更低的训练损失。

- 平均数据质量 Q:反映了数据的平均样本级质量,可以通过各种客观和主观方面来衡量。

给定一定量的训练数据,模型性能可以通过上述因素来估计:

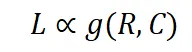

其中 f 是一个隐函数。给定一个特定的基础模型,L 的规模通常取决于 R 和 C,可以表示为:

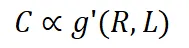

由于具有更高同质性或更好数据一致性的数据集更容易被模型学习,L 预计在 R 和 C 上是单调的。因此,我们可以将上述公式重写为:

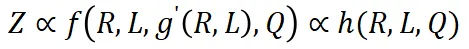

其中 g' 是一个反函数。通过结合上述三个方程,我们得到:

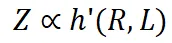

其中 h 是另一个隐函数。如果数据选择方法不会显著改变平均数据质量 Q,我们可以近似地将变量 Q 视为常数。因此,最终性能可以粗略地表示为:

这意味着模型性能与数据压缩率和训练损失相关。我们将这种关系称为 Entropy law。

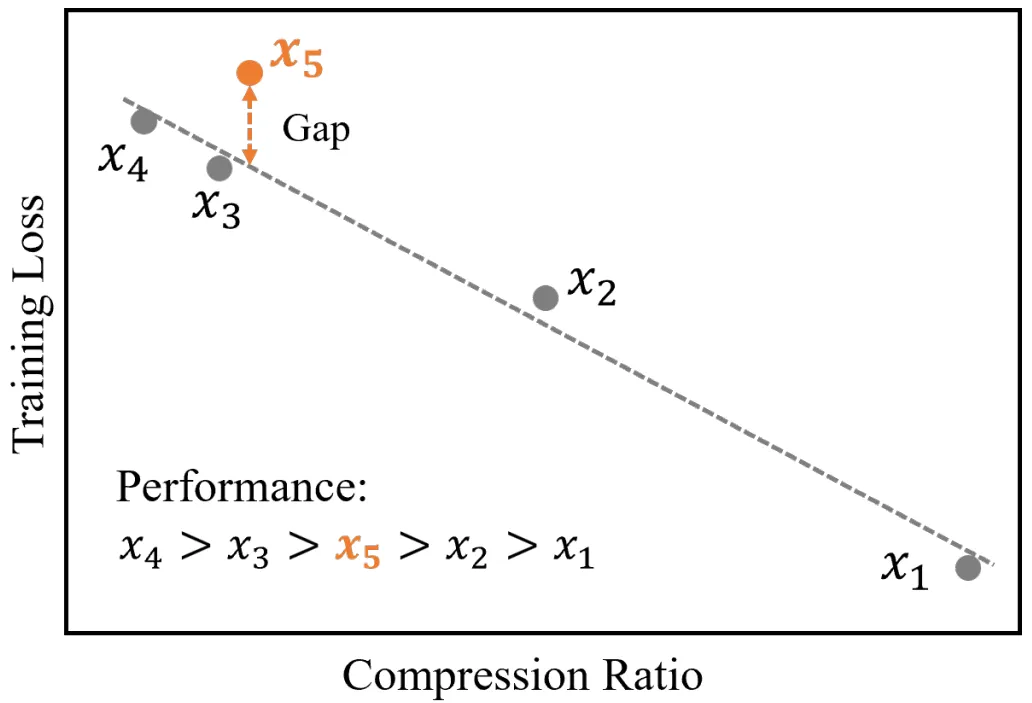

基于 Entropy law,我们提出两个推论:

- 如果将 C 视为常数,训练损失直接受压缩率影响。因此,模型性能由压缩率控制:如果数据压缩率 R 较高,那么 Z 通常较差,这将在我们的实验中得到验证。

- 在相同的压缩率下,较高训练损失意味着较低的数据一致性。因此,模型学到的有效知识可能更有限。这可以用来预测 LLM 在具有相似压缩率和样本质量的不同数据上的性能。我们将在后续展示这一推论在实践中的应用。

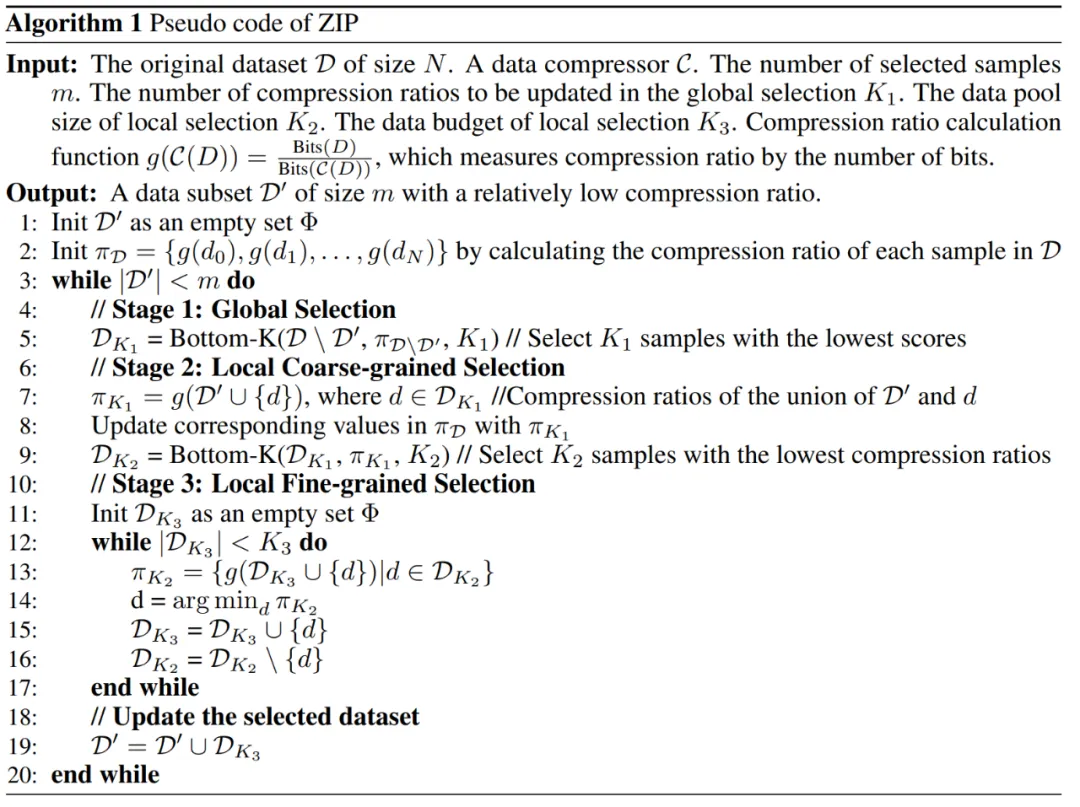

ZIP:高度轻量化的数据选择算法

在 entropy law 的指导下,我们提出了 ZIP 这一数据选择方法,通过数据压缩率来选择数据样本,旨在在有限的训练数据预算下最大化有效信息量。出于效率考量,我们采用了一种迭代多阶段贪心范式,以高效地获得具有相对低压缩率的近似解。在每轮迭代中,我们首先使用全局选择阶段来选择一组具有低压缩率的候选样本池,找到信息密度高的样本。然后,我们采用粗粒度的局部选择阶段,选择一组与已选样本冗余度最低的较小样本集。最后,我们使用细粒度的局部选择阶段,最小化要添加样本之间的相似性。上述过程持续进行直到获得足够的数据,具体算法如下:

实验结果

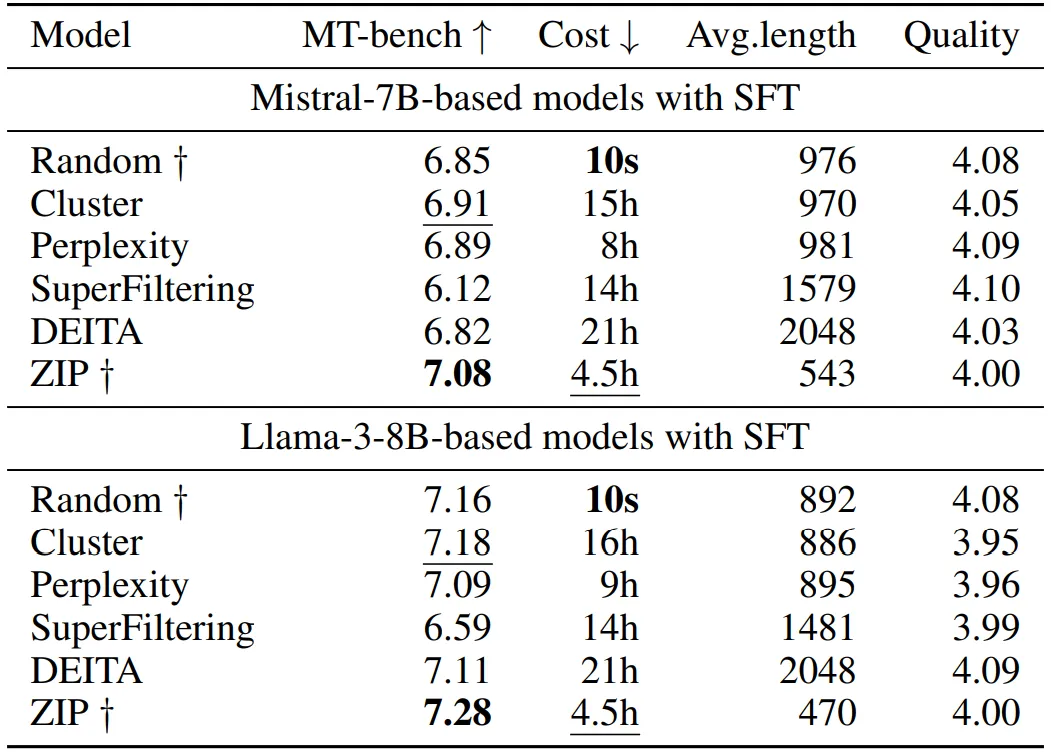

1.ZIP 选择算法对于不同 LLM、在不同 LLM 对齐阶段的有效性

对比不同的 SFT 数据选择算法,基于 ZIP 选择数据所训练得到的模型性能上展现出优势,并且在效率上也占优。具体结果见下表:

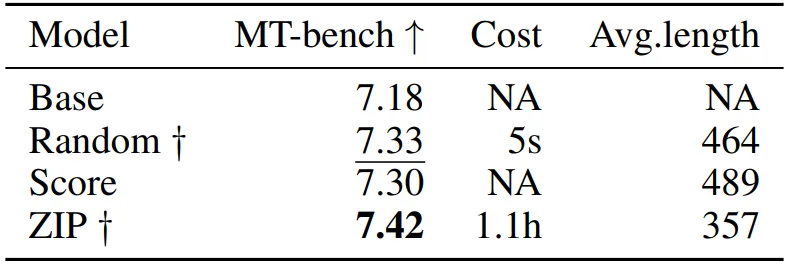

得益于 ZIP 的模型无关、内容无感知的特性,其同样也可应用于偏好对齐阶段的数据选择。而 ZIP 所选择的数据同样展现出了较大的优势。具体结果见下表:

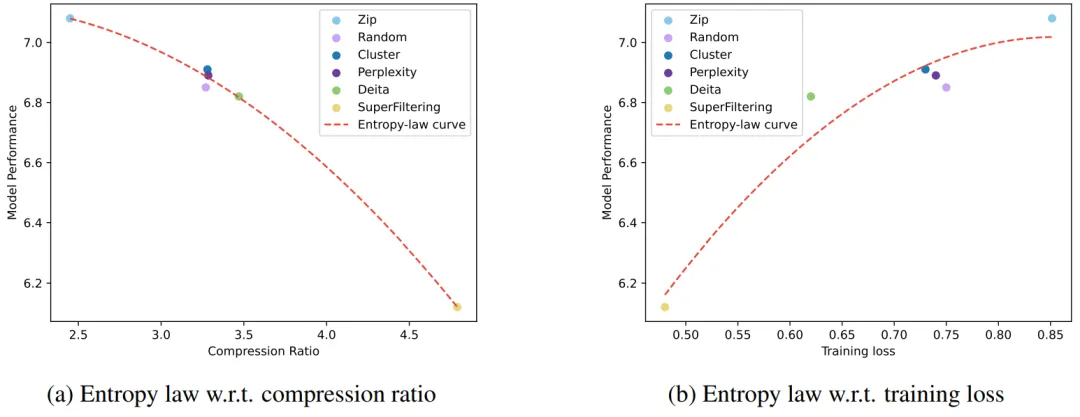

2.Entropy law 的实验验证

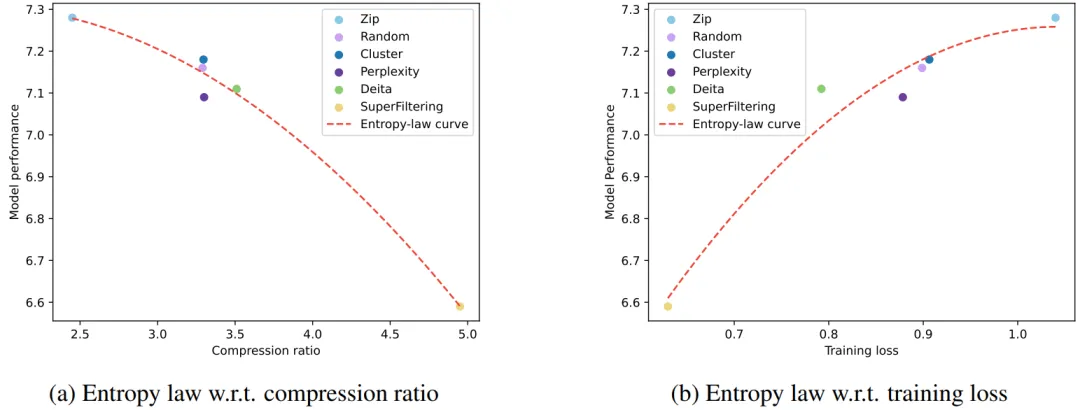

基于 SFT 数据选择实验,我们基于模型效果、数据压缩率以及模型在前几步训练的损失,分别拟合了多条关系曲线。结果见图 2 以及图 3,我们从图中可以观察到三个因素之间的紧密关联。首先,低压缩率数据通常会带来更好的模型效果,这是因为 LLMs 的学习过程与信息压缩高度相关,我们可以将 LLM 视为数据压缩器,那么压缩率较低的数据意味着更多的知识量,从而对压缩器更有价值。同时,可以观察到较低的压缩率通常伴随着更高的训练损失,这是因为难以压缩的数据携带了更多的知识,对 LLM 吸收其中蕴含的知识提出了更大的挑战。

图 2 Mistral-7B

图 3 Llama-3-8B

3.Entropy law 的实际应用

我们提供了一个 entropy law 在真实场景中指导 LLM 训练数据增量更新的应用。在该任务场景中,训练数据量保持相对稳定,只有一小部分数据会被修改。结果见图 4,其中

到

是逐渐增量更新的 5 个数据版本,出于保密要求,仅提供不同压缩率下模型效果的相对关系。根据 entropy law 预测,假设每次增量更新后数据质量没有显著下降,可以预期随着数据压缩率的降低,模型性能会有所提升。这一预测与图中数据版本

到

的结果一致。然而,数据版本

显示出损失和数据压缩率的异常增加,这预示了由于训练数据一致性下降导致的模型性能下降的潜在可能。这一预测通过随后的模型性能评估进一步得到证实。因此,entropy law 可以作为 LLM 训练的指导原则,无需在完整数据集上训练模型直到收敛,便可预测 LLM 训练失败的潜在风险。鉴于训练 LLM 的高昂成本,这一点尤其重要。

图 4

#深入理解深度学习

这可能是当今最全面、最新的深度学习概述之一。

爆火的深度学习领域,最近又有了热门学习资料。

近日,麻省理工出版社的新书《Understanding Deep Learning》(深入理解深度学习)迎来了中文版。

这本书一共分为 21 个章节,涵盖了深度学习领域的许多关键概念,包括基本构建、Transformer 架构、图神经网络 GNN、强化学习 RL、扩散模型等等。对于不论是初学者,还是已有工作经验的开发者来说都有极高的价值。

- GitHub 链接:https://github.com/careywyr/UnderstandingDeepLearning-ZH-CN

- 书籍原链接:https://udlbook.github.io/udlbook/

目前,该书的英文电子版下载量已达到 34.4 万。

该书的实体版本在去年 12 月正式发布,全书共 541 页,不过它的电子版一直在继续更新。目前在网站上,作者还提供了 68 个 Python 笔记本练习,可以帮助读者通过编程实践加深理解。

本书希望以准确易懂的方式,向人们介绍深度学习的基础思想,旨在帮助刚入门的读者理解深度学习背后的原理。对于想要深入理解本书内容的读者来说,只需要本科水平的数学知识就能读懂。

具体来说,该书在前面的部分介绍了深度学习模型,并讨论了如何训练、评估这些模型,如何提高它们的性能的方法。在接下来的部分,作者会带领我们考察专门用于图像、文本和图数据的架构。后续的章节探讨了生成模型和强化学习。倒数第二章探讨了这些以及其他尚未完全理解的方面。最后一章讨论了 AI 伦理。

目录

第一章 - Introduction 介绍

第二章 - Supervised learning 监督学习

第三章 - Shallow neural networks 浅层神经网络

第四章 - Deep neural networks 深度神经网络

第五章 - Loss functions 损失函数

第六章 - Fitting models 训练模型

第七章 - Gradients and initialization 梯度和初始化

第八章 - Measuring performance 性能评估

第九章 - Regularization 正则化

第十章 - Convolutional networks 卷积网络

第十一章 - Residual networks 残差网络

第十二章 - Transformers

第十三章 - Graph neural networks 图神经网络

第十四章 - Unsupervised learning 无监督学习

第十五章 - Generative adversarial networks 生成对抗网络

第十六章 - Normalizing flows 标准化流

第十七章 - Variational autoencoders 变分自编码器

第十八章 - Diffusion models 扩散模型

第十九章 - Deep reinforcement learning 深度强化学习

第二十章 - Why does deep learning work? 为什么深度学习有效?

第二十一章 - Deep learning and ethics 深度学习与伦理

参考链接:

https://x.com/tuturetom/status/1814689613304508777

#LLM范式的转变

盛名一时的BERT哪去了?这个问题的答案昭示了LLM范式的转变编码器模型哪去了?如果 BERT 效果好,那为什么不扩展它?编码器 - 解码器或仅编码器模型怎么样了?

在大型语言模型(LLM)领域,现在是仅解码器模型(如 GPT 系列模型)独领风骚的时代。那编码器 - 解码器或仅编码器模型发展如何呢?为什么曾经盛名一时的 BERT 却渐渐少有人关注了?

近日,AI 创业公司 Reka 的首席科学家和联合创始人 Yi Tay 发布了一篇博客文章,分享了他的看法。Yi Tay 在参与创立 Reka 之前曾在 Google Research 和谷歌大脑工作过三年多时间,参与过 PaLM、UL2、Flan-2、Bard 等著名 LLM 以及 PaLI-X 和 ViT-22B 等多模态模型的研发工作。以下为他的博客文章内容。

基础简介

总体上看,过去这些年的 LLM 模型架构主要分为三大范式:仅编码器模型(如 BERT)、编码器 - 解码器模型(如 T5)、仅解码器模型(如 GPT 系列模型)。人们常常搞不清楚这些,并且对这些分类方法和架构有所误解。

首先要理解的一点是:编码器 - 解码器模型实际上也是自回归模型。在编码器 - 解码器模型中,解码器本质上依然是因果解码器。其无需预填充解码器模型,而是会将某些文本卸载到编码器,然后再通过交叉注意力发送给解码器。是的,T5 模型也是语言模型!

这类模型的一种变体是前缀语言模型(Prefix Language Model),简称 PrefixLM,其工作方式几乎一样,只是没有交叉注意力(以及其它一些小细节,比如编码器 / 解码器之间共享权重以及没有编码器瓶颈)。PrefixLM 有时也被称为非因果解码器。简单来说,编码器 - 解码器、仅解码器模型和 PrefixLM 整体上差别不大!

在 Hyung Won 近期的精彩讲座中,他娴熟地解释了这些模型之间的关系。

同时,BERT 这样的仅编码器模型的去噪方式不一样(即 in-place);并且从某种程度上讲,仅编码器模型要在预训练之后真正发挥作用,需要依靠分类「任务」头。后来,T5 等模型采用了一种「修改版」的去噪目标,其使用了一种序列到序列的格式。

为此,需要指出:T5 中的去噪并非一种新的目标函数(在机器学习意义上),而是一种跨输入的数据变换,即你也可以使用一个因果解码器训练跨度损坏目标(span corruption objective )。

人们总是假设编码器 - 解码器模型必定是去噪模型,部分原因是 T5 实在过于具有代表性。但事实并不总是如此。你可以使用常规的语言建模任务(比如因果语言建模)训练编码器 - 解码器。反过来,也可以使用跨度损坏任务训练因果解码器。正如我前面说的那样,这基本上就是一种数据变换。

还有一点值得注意:一般来说,有 2N 个参数的编码器 - 解码器的计算成本与有 N 个参数的仅解码器模型一样,这样一来,它们的 FLOP 和参数量之比就不一样了。这就像是在输入和目标之间分配「模型稀疏性」。

这不是什么新东西,也不是我自己想出来的。2019 年的 T5 论文中就有,并且 UL2 论文也再次强调了这一点。

目前来说,很高兴能把这一点说清楚。现在来说目标。

关于去噪目标(它没起作用吗?无法扩展吗?还是太容易了?)

这里的去噪目标是指「跨度损坏」任务的任意变体。这有时候被称为「填充」或「填空」。表达它的方式有很多,比如跨度长度、随机性、sentinel token 等。想必你已明白其中关键。

尽管 BERT 式模型的去噪目标基本是就地的(in-place,比如分类头位于掩码 token 上),但「T5 风格」要更现代一点,即通过编码器 - 解码器或仅解码器模型来处理数据变换。在这样的数据变换中,被掩蔽的 token 只是会被「移回去」以便模型给出预测。

预训练的主要目标是以尽可能最高效和有效的方式构建与下游任务对齐的内部表征。这种内部表征越好,就更容易将这些学习到的表征用于后续任务。我们都知道,简单的下一词预测「因果语言建模」目标表现出色,并且已成为 LLM 革命的核心。现在的问题是去噪目标是否同样出色。

根据公开信息,我们知道 T5-11B 的效果相当好,即使在对齐和经过监督式微调之后(Flan-T5 XXL 的 MMLU 分数是 55+,在当时来说,这个规模的模型已经相当好了)。因此,我们可以得出这样的结论:去噪目标的迁移过程(预训练→对齐)在这个规模上相对来说效果不错。

我的看法是,去噪目标的效果很好,但还不足以单独作为目标。一个巨大的缺点源自所谓的更少的「损失暴露(loss exposure)」。在去噪目标中,仅有少量 token 会被掩蔽和得到学习(即被考虑到损失中)。反过来,在常规的语言建模中,这接近于 100%。这使得每个 FLOP 的样本效率非常低,这使得在 flop 基础上的比较中,去噪目标的劣势很大。

去噪目标的另一个缺点是其比常规语言建模更不自然,因为它会以一种奇怪的方式重新设定输入 / 输出的格式,这使得它们不太适合少样本学习。(但在少样本任务上,仍可能通过调整这些模型让其表现得相当优良。)因此,我认为去噪目标应该只能用作常规语言建模的补充目标。

统一的早期以及 BERT 类模型消失的原因

类似 BERT 的模型逐渐消失,现在已经没多少人再谈它们了。这也能解释为什么我们现在看不到超大规模的 BERT 模型了。原因是什么?这很大程度上是因为任务 / 建模范式的统一和转变。BERT 式模型很繁琐,但 BERT 模型被弃用的真正原因是:人们希望一次性完成所有任务,因此采用了一种更好的去噪方法 —— 使用自回归模型。

在 2018-2021 年期间,出现了一种隐含的范式转变:从单任务微调转变成大规模多任务模型。这慢慢地将我们导向了统一的 SFT 模型,这就是我们如今看到的通用模型。使用 BERT 却很难做到这一点。我认为这与「去噪」关系不大。对于还想使用这样的模型(即 T5)的人,他们找到了一种重新表达去噪预训练任务的方法,这使得如今 BERT 式模型已经基本上被弃用了,因为我们已有更好的替代方案。

更确切地说,编码器 - 解码器和仅解码器模型无需特定于任务的分类头就能用于多种任务。对于编码器 - 解码器,研究者和工程师开始发现放弃编码器的效果就和 BERT 编码器差不多。此外,这还能保留双向注意力的优势 —— 该优势让 BERT 在小规模(往往是生产规模)上可与 GPT 竞争。

去噪目标的价值

去噪预训练目标也能以一种类似常规语言建模的方式学习预测下一个词。但是,不同于常规因果语言建模,这需要对序列使用一种数据变换,使得模型可以学习「填空」,而不是简单地预测从左到右的自然文本。

值得注意的是,去噪目标有时也称为「填充任务」,有时会与常规语言建模任务一起在预训练过程中混合使用。

虽然确切的配置和实现细节可能有所不同,但当今的现代 LLM 可能在某种程度上组合使用语言建模和填充。有趣的是,这种「语言模型 + 填充」的混合实际上也大概在同一时期四处传播(如 UL2、FIM、GLM、CM3),许多团队都带来了自己独具特色的混合方案。顺带一提,目前已知的以这种方式训练的最大模型很可能是 PaLM-2。

还需要说明一点,预训练任务混合也可以按顺序堆叠,不一定必须同时混合,比如 Flan-T5 起初是在 1T 跨度损坏 token 上训练的,然后换到前馈语言建模目标的 100B token,之后再进行 flan 指令微调。某种程度上讲,这适合混合去噪 / LM 目标模型。需要明确的是,前缀语言建模目标(不要与架构混淆)单纯只是因果语言建模,其有一个随机确定和发送到输入端的分割点(没有损失和非因果掩码)。

顺便一提,填充可能起源于代码 LLM 领域,其中「填空」更像是写代码所需的一个功能。同时,UL2 的动机更多是将去噪目标和双向 LLM 擅长的任务类别与固有的生成任务(例如总结或开放式生成)统一起来。这种自回归式的解码「向后移」的优点是:其不仅能让模型学习更长程的依赖关系,还能让其隐式地受益于非显式的双向注意力(因为为了填空,你已经看过了未来)。

有一个传说中的经验:去噪目标学习的表征在特定任务类别上表现更好,有时候还会有更高的样本效率。在 U-PaLM 论文中,我们展示了少量的跨度损坏 up-training 如何改变在一组 BIG-Bench 任务上的行为和涌现现象。在此基础上,对使用这一目标训练的模型进行微调通常可以得到更好的监督式微调模型,尤其是当规模较小时。

在单任务微调方面,可以看到 PaLM-1 62B 模型被小得多的 T5 模型击败。在相对较小的规模上,「双向注意力 + 去噪目标」是一记漂亮的组合拳!我相信很多实践者也注意到了这种情况,尤其是在生产应用中。

双向注意力如何呢?

对语言模型来说,双向注意力是一种有趣的「归纳偏置」—— 人们常常将其与目标和模型骨干混淆。在不同的计算领域,归纳偏置的用途也各不相同,并且也可能对扩展曲线造成不同的影响。话虽如此,相比于较小规模,双向注意力在规模较大时可能就没那么重要了,或者可能对不同的任务或模态有不同的影响。举个例子,PaliGemma 使用了 PrefixLM 架构。

Hyung Won 也在他的演讲中指出:PrefixLM 模型(使用双向注意力的仅解码器模型)也存在缓存问题,这是这类架构的一个固有缺陷。但是,我认为有很多方法可以解决这个缺陷,但这超出了本文的范围。

编码器 - 解码器架构的优缺点

相比于仅解码器模型,编码器 - 解码器架构有优势也有劣势。第一种情况是编码器端不受因果掩码的限制。在某种程度上,你可以在注意力层上放开手脚,激进地执行池化或任何形式的线性注意力,而不必担心自回归的设计限制。这是一种将不太重要的「上下文」卸载到编码器的好方法。你也能把编码器做小点,这也是个优势。

必需编码器 - 解码器架构的一个例子是 Charformer,其中大胆使用了编码器并缓解了字节层面的模型的速度劣势。在编码器方面进行创新可以快速获益,同时无需担心因果掩码的重大缺陷。

同时,相比于 PrefixLM,编码器 - 解码器的一个缺点是输入和目标必须分配固定的预算。举个例子,如果输入预算是 1024 token,那么编码器端就必须填充到这个值,而这可能会浪费大量计算。相反,在 PrefixLM 中,输入和目标可以直接连接起来,从而可以缓解这个问题。

与当今模型的相关性和关键要点

当今时代,要成为一位合格的 LLM 研究者和实践者,一项关键能力是能同时从架构方面和预训练方面推断归纳偏置。理解其中微妙的差异可帮助人们进行外推和持续创新。

以下是我的关键要点:

- 编码器 - 解码器和仅解码器模型都是自回归模型,它们在实现层面上有差异,也有各自的优缺点。它们是略有不同的归纳偏置。至于选用哪一种,这取决于下游用例和应用限制。与此同时,对于大多数 LLM 用例和利基用例而言,可以认为 BERT 式的编码器模型已经过时。

- 去噪目标主要能作为因果语言模型的补充。它们已经被成功用作训练阶段的「支持目标」。使用去噪目标训练因果语言模型通常能带来某种程度的帮助。尽管这在代码模型领域非常常见(即代码填充),但对于如今的通用模型,使用因果语言模型加某个去噪目标来进行预训练的做法也挺常见。

- 双向注意力能给较小规模模型带来很大助益,但对较大模型来说可有可无。这大都是传言。我认为双向注意力具有一种归纳偏置,就类似于对 Transformer 模型做的许多其它类型的修改。

最后,总结一下。目前已经没有大规模版本的 BERT 模型在运营了:BERT 模型已被弃用,取而代之的是更灵活的去噪(自回归)T5 模型。这主要是由于范式统一,即人们更喜欢使用一个通用模型去执行各种任务(而不是使用特定于某任务的模型)。与此同时,自回归去噪有时可作为因果语言模型的副目标。

原文链接:https://www.yitay.net/blog/model-architecture-blogpost-encoders-prefixlm-denoising

whaosoft aiot http://143ai.com

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?