运用dropout防止过拟合,还是之前的数据,用tensorboard进行可视化, 如果没用dropout的话, test的loss要比train的loss大,这就是过拟合了,即训练的很好,但是测试的时候效果远比训练的时候差

from __future__ import print_function

import tensorflow as tf

from sklearn.datasets import load_digits

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import LabelBinarizer

digits = load_digits()

X = digits.data

y = digits.target

y = LabelBinarizer().fit_transform(y)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=.3) #skleran的划分数据集

def add_layer(inputs, in_size, out_size, layer_name, activation_function=None, ):

w = tf.Variable(tf.random_normal([in_size, out_size]))

b = tf.Variable(tf.zeros([1, out_size]) + 0.1)

Wx_plus_b = tf.matmul(inputs, w) + b;

Wx_plus_b = tf.nn.dropout(Wx_plus_b, keep_prob) #加入dropout,相当于去掉一半的数据,防止过拟合

if activation_function is None:

outputs = Wx_plus_b

else:

outputs = activation_function(Wx_plus_b, )

tf.summary.histogram(layer_name + '/outputs', outputs)

return outputs

keep_prob = tf.placeholder(tf.float32) #保持率

xs = tf.placeholder(tf.float32, [None, 64])

ys = tf.placeholder(tf.float32, [None, 10])

l1 = add_layer(xs, 64, 50, 'l1', activation_function=tf.nn.tanh) #第一层

prediction = add_layer(l1, 50, 10, 'l2', activation_function=tf.nn.softmax) #第二层

cross_entropy = tf.reduce_mean(-tf.reduce_sum(ys*tf.log(prediction), reduction_indices=[1])) #loss函数

tf.summary.scalar('loss', cross_entropy)

train_step = tf.train.GradientDescentOptimizer(0.5).minimize(cross_entropy) #训练,梯度下降

sess = tf.Session()

merged = tf.summary.merge_all() #将所有summary保存在磁盘,以便tensorboard显示

train_writer = tf.summary.FileWriter("logs/train", sess.graph) #事件文件所在目录,第二个参数是事件文件要记录的图

test_writer = tf.summary.FileWriter("logs/test", sess.graph)

sess.run(tf.initialize_all_variables())

for i in range(500):

sess.run(train_step, feed_dict={xs: X_train, ys: y_train, keep_prob: 0.5}) #把保留率设为0.5,即只留一半

if i % 50 == 0 :

train_result = sess.run(merged, feed_dict={xs: X_train, ys: y_train, keep_prob: 1}) #把训练结果保存,以便tensorboard显示

test_result = sess.run(merged, feed_dict={xs: X_test, ys: y_test, keep_prob: 1}) #把测试结果保存,以便tensorboard显示

train_writer.add_summary(train_result, i) #每50次记一下

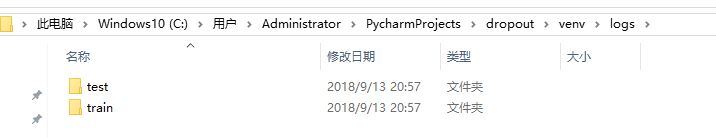

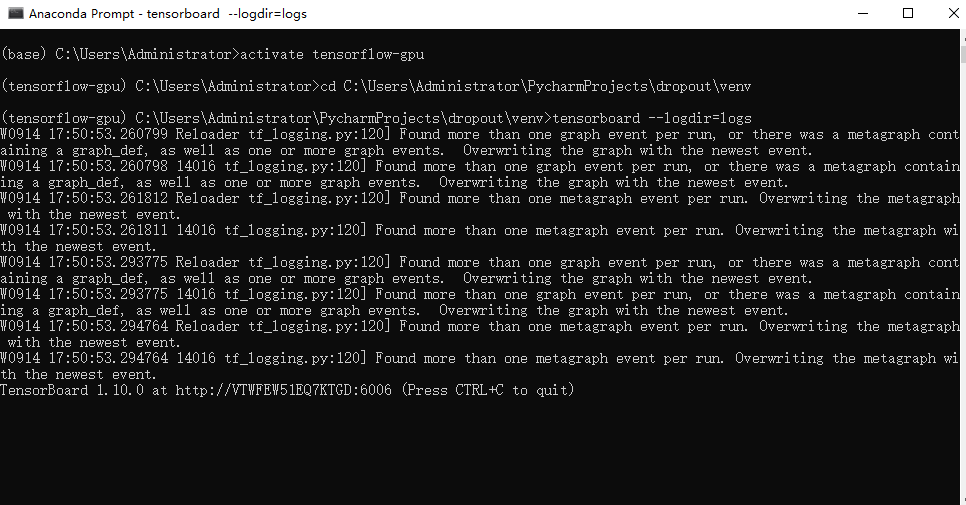

test_writer.add_summary(test_result, i)这样在logs文件夹下面生成了train和test文件夹,里面分别有一个文件,启动命令行,切换的..\venv\环境下,输入

tensorboard --logdir=logs复制最后的URL,放在浏览器上,就能显示函数图像了。

3585

3585

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?