一.K-近邻算法

k-近邻算法优点:精度高,对异常值不敏感,无数据输入假定。

缺点:计算复杂度高,空间复杂度高

适用数据范围:数值型和标称型

1.k-近邻算法的工作原理:存在一个样本数据集合,也称作训练样本集合,并且样本集中每个数据都存在标签,即我们知道样本集中每一数据与所属分类的对应关系。输入没标签的新数据后,将新数据的每个特征与样本集中数据对应的特征进行比较,然后算法提取样本集中特征最相似的数据的分类标签。一般来说我们只选择样本数据集中前k个最相似的数据,通常k是不大于20的整数。最后选择k个最相似的数据中出现次数最多的分类,作为新数据的分类。

k-近邻算法的一般流程(1)收集数据:可以使用任何方法

(2)准备数据:距离计算所需要的数值,最好是结构化的数据格式

(3)分析数据:可以使用任何方法

(4)测试算法:计算错误率

2.k-近邻算法的代码

总结代码之前,想先总结一下此次算法中出现的相关函数和关键字

(1)储备知识:

<1>shape函数:shape函数是numpy.core.fromnumeric中的函数,它的功能是读取矩阵的长度,比如shape[0]就是读取矩阵第一维度的长度。

详细见shape用法

<2>tile函数:基本格式tile(a,reps).详细内容建议参考以下两个网址:

tile讲解一

tile讲解二

<3>axis关键字:起作用的话就是合并同一维度的数据成一个,换种说法就是同一维度对应元素加和。详细内容请参考:axis讲解

<4>argsor()函数:排序函数,默认值时为从小到大排序,argsort函数返回的是数组值从小到大的索引值

<5>iteritems()函数:iteritems()返回一个迭代器(迭代器是可以返回相同类型值的有序序列的一段代码)

<6>itemgetter():itemgetter(a),对元组或者列表按照某一属性大小关系进行排序。参考网站1,参考网站2

(2)正式代码:

def classify0(intX, dataSet, labels, k):

# intX是测试的用例,dataset训练集,labels是训练集对应的标签,k是用于选择最近邻的数目

dataSetSize = dataSet.shape[0]

# 用欧式距离公式进行距离计算

diffMat = tile(intX, (dataSetSize,1)) - dataSet # numpy.tile进行数组的重复生成

sqdiffMat = diffMat**2

sqDistances = sqdiffMat.sum(axis=1)

distances = sqDistances**0.5

sortedDistIndicies = distances.argsort() # 返回的是数组值从小到大的索引值

classCount = {}

for i in range(k):

voteIlabel = labels[sortedDistIndicies[i]]

classCount[voteIlabel] = classCount.get(voteIlabel, 0) + 1

sortedClassCount = sorted(classCount.items(), key=op.itemgetter(1), reverse=True)

# python3中函数为:items(),python2中函数为:iteritems()

return sortedClassCount[0][0]

二.决策树

决策树 优点:计算复杂度不高,输出结果易于理解,对中间值的缺失不敏感,可以处理不相关的特征数据 缺点:可能会产生过度匹配问题 适用数据类型:数值型和标称型

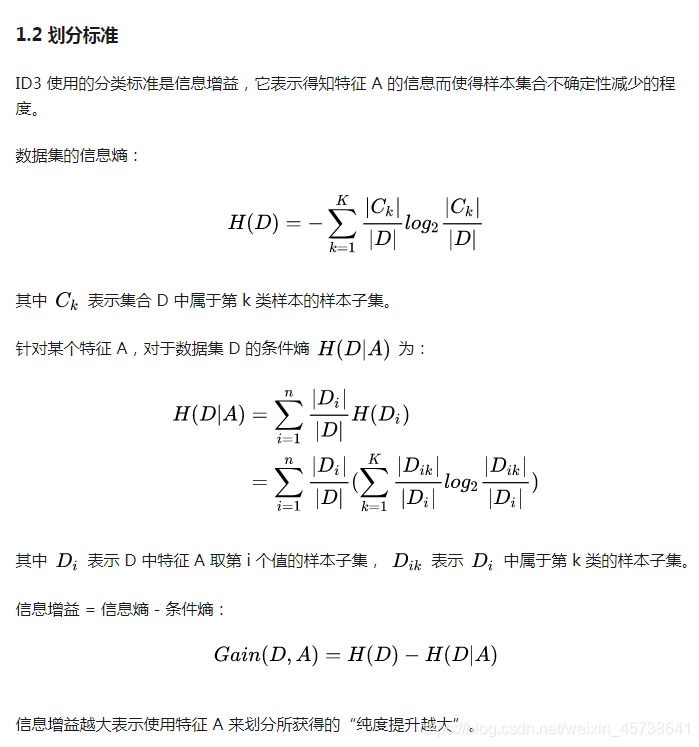

1.信息增益的计算:

计算给定数据的香农熵:

from math import log

def calcShannonEnt(dataSet):

numEntries=len(dataSet)

labelCounts={}

for featVec in dataSet:

currentLabel=featVec[-1]

if currentLabel not in labelCounts.keys() :

labelCounts[currentLabel]=0

labelCounts[currentLabel]+=1

shannonEnt=0.0

for key in labelCounts:

prob=float((labelCounts[key]))/numeEntries

shannonEnt-=prob*log(prob,2)

return shannonEnt

按照给定特征划分数据集:

def splitDataSet(dataSet,axis,value): # 按某个特征分类后的数据

retDataSet=[]

for featVec in dataSet:

if featVec[axis]==value:

reducedFeatVec =featVec[:axis]

reducedFeatVec.extend(featVec[axis+1:])

retDataSet.append(reducedFeatVec)

return retDataSet

选择最好的数据集合划分方式:

def chooseBestFeatureToSplit(dataSet): # 选择最优的分类特征

numFeatures = len(dataSet[0])-1

baseEntropy = calcShannonEnt(dataSet) # 原始的熵

bestInfoGain = 0

bestFeature = -1

for i in range(numFeatures):

featList = [example[i] for example in dataSet]

uniqueVals = set(featList)

newEntropy = 0

for value in uniqueVals:

subDataSet = splitDataSet(dataSet,i,value)

prob =len(subDataSet)/float(len(dataSet))

newEntropy +=prob*calcShannonEnt(subDataSet) # 按特征分类后的熵

infoGain = baseEntropy - newEntropy # 原始熵与按特征分类后的熵的差值

if (infoGain>bestInfoGain): # 若按某特征划分后,熵值减少的最大,则次特征为最优分类特征

bestInfoGain=infoGain

bestFeature = i

return bestFeature

按分类后类别数量排序:

def majorityCnt(classList):

classCount={}

for vote in classList:

if vote not in classCount.keys():

classCount[vote]=0

classCount[vote]+=1

sortedClassCount = sorted(classCount.items(),key=operator.itemgetter(1),reverse=True)

return sortedClassCount[0][0]

创建树的函数代码:

def createTree(dataSet,labels):

classList=[example[-1] for example in dataSet] # 类别:男或女

if classList.count(classList[0])==len(classList):

return classList[0]

if len(dataSet[0])==1:

return majorityCnt(classList)

bestFeat=chooseBestFeatureToSplit(dataSet) #选择最优特征

bestFeatLabel=labels[bestFeat]

myTree={bestFeatLabel:{}} #分类结果以字典形式保存

del(labels[bestFeat])

featValues=[example[bestFeat] for example in dataSet]

uniqueVals=set(featValues)

for value in uniqueVals:

subLabels=labels[:]

myTree[bestFeatLabel][value]=createTree(splitDataSet\

(dataSet,bestFeat,value),subLabels)

return myTree

本文深入解析了K-近邻算法与决策树算法的原理与应用,包括算法的优点、缺点、适用范围及具体实现代码。K-近邻算法通过计算距离来分类新数据,而决策树则通过信息增益选择最佳特征进行数据划分。

本文深入解析了K-近邻算法与决策树算法的原理与应用,包括算法的优点、缺点、适用范围及具体实现代码。K-近邻算法通过计算距离来分类新数据,而决策树则通过信息增益选择最佳特征进行数据划分。

20

20

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?