一 缓存

Redis数据类型

与Memcached仅支持简单的key-value结构的数据记录不同,Redis支持的数据类型要丰富得多,常用的数据类型主要有五种:String、List、Hash、Set和Sorted Set。

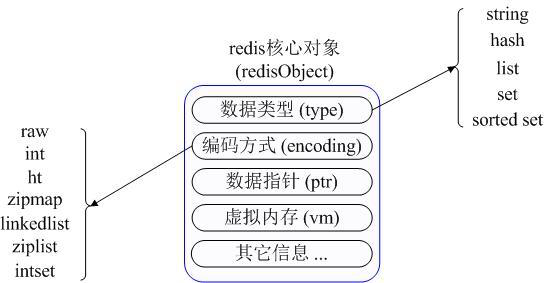

Redis数据类型内存结构分析

Redis内部使用一个redisObject对象来表示所有的key和value。redisObject主要的信息包括数据类型(type)、编码方式(encoding)、数据指针(ptr)、虚拟内存(vm)等。type代表一个value对象具体是何种数据类型,encoding是不同数据类型在redis内部式。

redisObject 对象示意图

下面分别介绍5种数据类型的用法。

String类型

字符串是Redis值的最基础的类型。Redis中使用的字符串是通过包装的,基于c语言字符数组实现的简单动态字符串(simple dynamic string, SDS)一个抽象数据结构。其源码定义如下:

struct sdshdr { int len; //len表示buf中存储的字符串的长度。 int free; //free表示buf中空闲空间的长度。 char buf[]; //buf用于存储字符串内容。 };

C语言字符串内存结构示意图1

假设上图是”hello”字符串的内存结构,这个时候len=5,free=2那么redis包装后(sds)其长度为:

sizeof(struct sdshdr) + len + free + 1

其中buf的大小为:

len + free + 1

1表示1个字节是用来存储结束符’\0’的。Redis字符串是二进制安全的,因为二进制数据通常会有中间某个字节存储’\0’的这种情况,这意味着一个Redis字符串可以包含任何种类的数据,例如一个JPEG图像或者一个序列化的Ruby对象。二进制是否安全,简单的理解就是能不能在字符串中间有‘\0’,如下图:

C语言字符串内存结构示意图2

对于上图,sds认为这个字符串是“hello world”,而C语言的字符处理函数认为这个字符串是“hello”。

应用场景

String是最常用的一种数据类型,普通的key/value存储都可以归为此类。

常用命令

(1)set——设置key对应的值为String类型的value

(2)get——获取key对应的值

192.168.2.129:6379> setnx name lisi

(integer) 0

192.168.2.129:6379> setnx name1 wangwu

(integer) 1

192.168.2.129:6379> get name

"zhangsan"

192.168.2.129:6379> get name1

"wangwu"

192.168.2.129:6379>(3)mget——批量获取多个key的值,如果可以不存在则返回nil

192.168.2.129:6379> mget name name1

1) "zhangsan"

2) "wangwu"

192.168.2.129:6379> mget name name1 name2

1) "zhangsan"

2) "wangwu"

3) (nil)

192.168.2.129:6379>(4)incr && incrby——incr对key对应的值进行加加操作,并返回新的值;incrby加指定值

192.168.2.129:6379> get age

"20"

192.168.2.129:6379> incr age

(integer) 21

192.168.2.129:6379> set age1 "20"

OK

192.168.2.129:6379> get age1

"20"

192.168.2.129:6379> incr age1

(integer) 21

192.168.2.129:6379> incrby age 3

(integer) 24从上面的结果可以看出,我们对int型的age和string型的age1都能进行incr操作时,

实际上type=string代表value存储的是一个普通字符串,那么对应的encoding可以是raw或者是int,如果是int则代表实际redis内部是按数值型类存储和表示这个字符串的,当然前提是这个字符串本身可以用数值表示,比如"20"这样的字符串,当遇到incr、decr等操作时会转成数值型进行计算,此时redisObject的encoding字段为int。如果你试图对name进行incr操作则报错。

192.168.2.129:6379> incr name

(error) ERR value is not an integer or out of range(5)decr && decrby——decr对key对应的值进行减减操作,并返回新的值;decrby减指定值

192.168.2.129:6379> decr age

(integer) 23

192.168.2.129:6379> decrby age 3

(integer) 20

192.168.2.129:6379>(6)其他命令

| 命令 | 说明 |

| setnx | 设置key对应的值为String类型的value,如果key已经存在则返回0 |

| setex | 设置key对应的值为String类型的value,并设定有效期 |

| setrange | 设置key对应value的子字符串 |

| getrange | 获取key对应value的子字符串 |

| mset | 批量设置多个key的值,如果成功表示所有值都被设置,否则返回0表示没有任何值被设置 |

| msetnx | 同mset,不存在就设置,不会覆盖已有的key |

| getset | 设置key的值,并返回key旧的值 |

| append | 给指定key的value追加字符串,并返回新字符串的长度 |

| strlen | 取指定key的value的长度 |

Hash类型

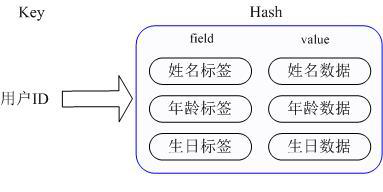

Hash是一个String类型的field和value之间的映射表,即redis的Hash数据类型的key(hash表名称)对应的value实际的内部存储结构为一个HashMap,因此Hash特别适合存储对象。相对于把一个对象的每个属性存储为String类型,将整个对象存储在Hash类型中会占用更少内存。

Hash 数据类型内部结构示意图

当前HashMap的实现有两种方式:当HashMap的成员比较少时Redis为了节省内存会采用类似一维数组的方式来紧凑存储,而不会采用真正的HashMap结构,这时对应的value的redisObject的encoding为zipmap,当成员数量增大时会自动转成真正的HashMap,此时encoding为ht。

应用场景

用一个对象来存储用户信息,商品信息,订单信息等等。

常用命令

(1)hset——设置key对应的HashMap中的field的value

(2)hget——获取key对应的HashMap中的field的value

192.168.2.129:6379> hset myhash name zhangsan

(integer) 1

192.168.2.129:6379> hset myhash age 20

(integer) 1

192.168.2.129:6379> hget myhash name

"zhangsan"

192.168.2.129:6379> hget myhash age

"20"

192.168.2.129:6379>(3)hgetall——获取key对应的HashMap中的所有field的value

192.168.2.129:6379> hgetall myhash

1) "name"

2) "zhangsan"

3) "age"

4) "20"

192.168.2.129:6379>(4)其它命令

| 命令 | 说明 |

| hsetnx | 设置key对应的HashMap中的field的value,如果不存在则先创建 |

| hmset | 批量设置key对应的HashMap中的field的value |

| hmget | 批量获取key对应的HashMap中的field的value |

| hincrby | 给key对应的HashMap中的field的value加指定的值 |

| hexits | 测试key对应的HashMap中的field是否存在 |

| hlen | 返回key对应的HashMap中的field的数量 |

| hdel | 删除key对应的HashMap中的field |

| hkeys | 返回key对应的HashMap中所有的field |

| hvals | 返回key对应的HashMap中所有的field的value |

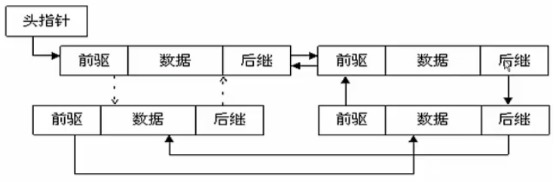

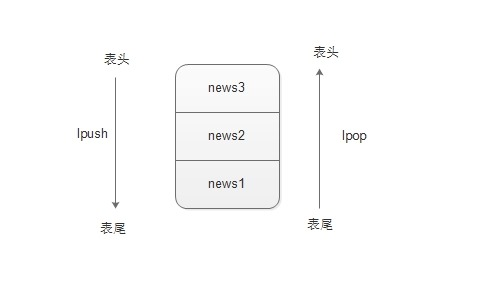

List类型

Redis的List类型其实就是每一个元素都是String类型的双向链表。我们可以从链表的头部和尾部添加或者删除元素。这样的List既可以作为栈,也可以作为队列使用。

应用场景

如好友列表,粉丝列表,消息队列,最新消息排行等。

常用命令

(1)lpush——在key对应的list的头部添加一个元素。

(2)lrange——获取key对应的list的指定下标范围的元素,-1表示获取所有元素。

(3)lpop——从key对应的list的尾部删除一个元素,并返回该元素。

192.168.2.129:6379> lpush newlist news1 news2 news3

(integer) 3

192.168.2.129:6379> lrange newlist 0 -1

1) "news3"

2) "news2"

3) "news1"

192.168.2.129:6379> lpop newlist

"news3"

192.168.2.129:6379> lrange newlist 0 -1

1) "news2"

2) "news1"

192.168.2.129:6379>从上面的操作可以看出,lpush、lpop从表头操作。

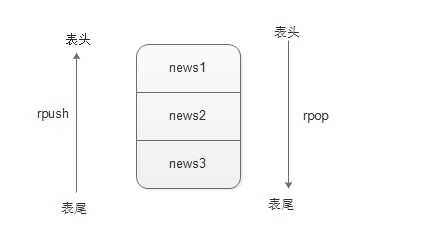

(4)rpush——在key对应的list的尾部添加一个元素。

(5)rpop——从key对应的list的尾部删除一个元素,并返回该元素。

192.168.2.129:6379> rpush newlist2 news1 news2 news3

(integer) 3

192.168.2.129:6379> lrange newlist2 0 -1

1) "news1"

2) "news2"

3) "news3"

192.168.2.129:6379> rpop newlist2

"news3"

192.168.2.129:6379>从上面的操作可以看出,rpush、rpop从表尾操作。

(6)其他命令

| 命令 | 说明 |

| linsert | 在key对应的list的特定元素的前或后插入元素 |

| lset | 设置key对应的list中指定下标元素的值 |

| lrem | 从key对应的list中删除n个和value相同的元素 |

| ltrim | 保留key对应的list中指定范围的元素 |

| rpoplpush | 从第一个list的尾部移除一个元素并添加到第二个list的头部 |

| llen | 返回key对应的list的长度 |

| lindex | 返回key对应的list中index的元素 |

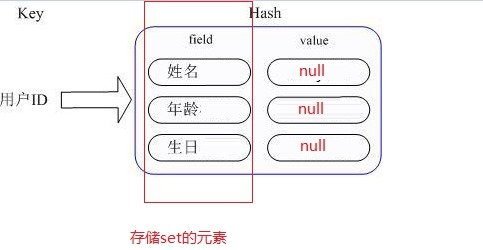

Set类型

Redis 集合(Set类型)是一个无序的String类型数据的集合,类似List的一个列表,与List不同的是Set不能有重复的数据。实际上,Set的内部是用HashMap实现的,Set只用了HashMap的key列来存储对象。我们来看看java中HashSet的源码:

public class HashSet<E>

extends AbstractSet<E>

implements Set<E>, Cloneable, java.io.Serializable

{

static final long serialVersionUID = -5024744406713321676L;

private transient HashMap<E,Object> map;

// Dummy value to associate with an Object in the backing Map

private static final Object PRESENT = new Object();

/**

* Constructs a new, empty set; the backing <tt>HashMap</tt> instance has

* default initial capacity (16) and load factor (0.75).

*/

public HashSet() {

map = new HashMap<>();

}

......

/**

* Returns an iterator over the elements in this set. The elements

* are returned in no particular order.

*

* @return an Iterator over the elements in this set

* @see ConcurrentModificationException

*/

public Iterator<E> iterator() {

return map.keySet().iterator();

}

可见创建一个HashSet的时候实际上创建了一个HashMap;Set中的元素,只是存放在了底层HashMap的key上,底层HashMap的value列为空,遍历HashSet的时候从HashMap中取出keySet来遍历。

Set底层结构示意图

应用场景

集合有取交集、并集、差集等操作,因此可以求共同好友、共同兴趣、分类标签等。

常用命令

(1)sadd——在key对应的set中添加一个元素。

(2)smembers——获取key对应的set的所有元素。

(3)spop——随机返回并删除key对应的set中的一个元素。

192.168.2.129:6379> sadd myset news1 news2 news3

(integer) 3

192.168.2.129:6379> smembers myset

1) "news3"

2) "news2"

3) "news1"

192.168.2.129:6379> spop myset

"news3"

192.168.2.129:6379>(4)sdiff——求给定key对应的set与第一个key对应的set的差集

192.168.2.129:6379> smembers myset

1) "news3"

2) "news2"

3) "news1"

192.168.2.129:6379> sadd myset2 news3 news4 news5

(integer) 3

192.168.2.129:6379> smembers myset2

1) "news4"

2) "news3"

3) "news5"

192.168.2.129:6379> sdiff myset myset2

1) "news1"

2) "news2"

192.168.2.129:6379>(5)suion——求给定key对应的set并集

192.168.2.129:6379> sunion myset myset2

1) "news3"

2) "news1"

3) "news2"

4) "news4"

5) "news5"

192.168.2.129:6379>(6)sinter——求给定key对应的set交集

192.168.2.129:6379> sinter myset myset2

1) "news3"

192.168.2.129:6379>(7)其他命令

| 命令 | 说明 |

| srem | 删除key对应的set中的一个元素 |

| sdiffstore | 求给定key对应的set与第一个key对应的set的差集,并存储到另一个key对应的set中 |

| sinterstore | 求给定key对应的set交集,并存储到另一个key对应的set中 |

| suionstore | 求给定key对应的set并集,并存储到另一个key对应的set中 |

| somve | 从第一个key对应的set中删除指定元素并添加到第二个key对应的set中 |

| scard | 返回key对应的set的元素个数 |

| sismember | 测试某个元素是否为key对应的set中的元素个数 |

| srandmember | 随机返回key对应的set中的一个元素,但不删除元素 |

SortSet

SortSet顾名思义,是一个排好序的Set,它在Set的基础上增加了一个顺序属性score,这个属性在添加修改元素时可以指定,每次指定后,SortSet会自动重新按新的值排序。

sorted set的内部使用HashMap和跳跃表(SkipList)来保证数据的存储和有序,HashMap里放的是成员到score的映射,而跳跃表里存放的是所有的成员,排序依据是HashMap里存的score。

应用场景

如按时间排序的时间轴。

常用命令

(1)zadd ——在key对应的zset中添加一个元素

(2)zrange——获取key对应的zset中指定范围的元素,-1表示获取所有元素

192.168.2.129:6379> zadd myzset 1 "one" 2 "two" 3 "three"

(integer) 3

192.168.2.129:6379> zrange myzset 0 -1

1) "one"

2) "two"

3) "three"

192.168.2.129:6379> zrange myzset 0 -1 withscores

1) "one"

2) "1"

3) "two"

4) "2"

5) "three"

6) "3"

192.168.2.129:6379>(3)zrem——删除key对应的zset中的一个元素

192.168.2.129:6379> zrem myzset one

(integer) 1

192.168.2.129:6379> zrange myzset 0 -1 withscores

1) "two"

2) "2"

3) "three"

4) "3"

192.168.2.129:6379>(4)其它命令

| 命令 | 说明 |

| zincrby | 如果key对应的zset中已经存在元素member,则对member的score属性加指定的值 |

| zrank | 返回key对应的zset中指定member的排名。其中member按score值递增(从小到大);排名以0为底,也就是说,score值最小的成员排名为0 |

| zrevrank | 获得成员按score值递减(从大到小)排列的排名 |

| zrevrange | 返回有序集key中,指定区间内的成员。其中成员的位置按score值递减(从大到小)来排列 |

| zrangebyscore | 返回有序集key中,指定分数范围的元素列表 |

| zcount | 返回有序集key中,score值在min和max之间(默认包括score值等于min或max)的成员 |

| zcard | 返回key的有序集元素个数 |

Redis常用命令

键值常用命令

keys/exits/del/expire/ttl/move/persist/randomkey/rename/type

服务器常用命令

ping/echo/select/quit/dbsize/info/config get/flushdb/flushall

这些命令都很容易使用,就不举例说明了。到此,redis的数据类型以及常用命令已经介绍完毕,下一篇我们将学习redis的一些高级特性。

缓存三兄弟

缓存穿透

key 对应的数据在redis中并不存在,每次针对此 key的请求从缓存获取不到,请求转发到数据库,访问量大了可能压垮数据库。比如用一个不存在的用户 id 获取用户信息,redis缓存和数据库中都没有,若黑客利用此漏洞进行攻击可能压垮数据库(黑客访问肯定不存在的数据,造成服务器压力大)

一个一定不存在的数据,由于缓存是不命中时被动写的,并且出于容错考虑,如果从存储层查不到数据则不写入缓存,这将导致这个不存在的数据每次请求都要到存储层去查询,失去了缓存的意义

解决方案:

对空值缓存: 如果一个查询返回的数据为空(不管是数据是否不存在),我们仍然把这个空结果(null)进行缓存,这样可以缓解数据库的访问压力,然后设置空结果的过期时间会很短,最长不超过五分钟。(只能作为简单的应急方案)

设置可访问的名单(白名单): 使用 bitmaps 类型定义一个可以访问的名单,名单 id 作为 bitmaps 的偏移量,每次访问和 bitmap 里面的 id 进行比较,如果访问 id 不在 bitmaps 里面,进行拦截,不允许访问。

布隆过滤器: 将所有可能存在的数据哈希到一个足够大的 bitmaps 中,一个一定不存在的数据会被这个bitmaps 拦截掉,从而避免了对底层存储系统的查询压力

进行实时监控: 当发现 Redis 的命中率开始急速降低,需要排查访问对象和访问的数据,和运维人员配合,可以设置黑名单限制服务

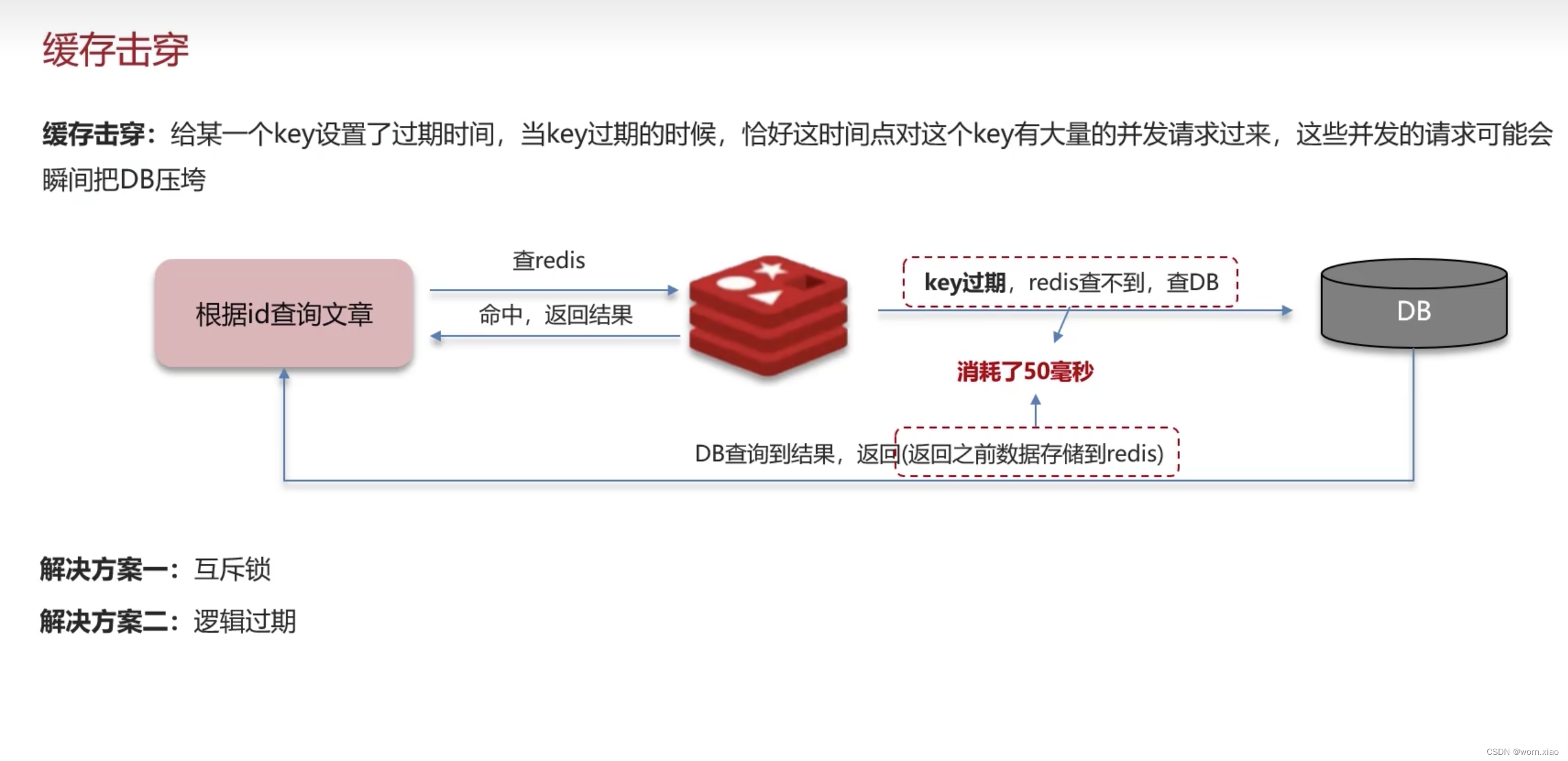

缓存击穿

key 对应的数据存在,但在 redis 中过期,此时若有大量并发请求过来,这些请求发现缓存过期一般都会从后端 DB 加载数据并回设到缓存,这个时候大量并发的请求可能会瞬间把后端 DB 压垮(redis某个热门数据过期,大量的合理数据请求到达数据库)

数据库的访问压力瞬间激增

redis正常运行

redis没有出现大量的过期现象(过期后无法访问,若未命中,则需要访问数据库)

产生原因: redis中的某个热门的key过期了,而此时客户端对这个key的访问量激增,redis无法命中,这些访问就会转发到数据库,造成数据库瞬间压力过大

key 可能会在某些时间点被超高并发地访问,是一种非常“热点”的数据。这个时候,需要考虑一个问题:缓存被“击穿”的问题。

预先设置热门数据:

在 redis 高峰访问之前,把一些热门数据提前存入到redis 里面,加大这些热门数据 key 的时长

实时调整:

现场监控哪些数据热门,实时调整 key 的过期时长使用锁:

(1)就是在缓存失效的时候(判断拿出来的值为空),不是立即去 load DB;

(2) 先使用缓存工具的某些带成功操作返回值的操作(比如 Redis 的 SETNX)去 set 一个 mutex key;

(3) 当操作返回成功时,再进行 load db 的操作,并回设缓存,最后删除 mutex key;

(4) 当操作返回失败,证明有线程在 load db,当前线程睡眠一段时间再重试整个 get 缓存的方法

缓存雪崩

key 对应的数据存在,但在 redis 中过期,此时若有大量并发请求过来,这些请求发现缓存过期一般都会从后端 DB 加载数据并回设到缓存,这个时候大量并发的请求可能会瞬间把后端 DB 压垮

缓存雪崩针对很多 key 失效导致redis无法命中,数据库压力激增;缓存击穿则是某一个热门 key 失效导致redis无法命中,数据库压力激增.

缓存雪崩现象: 数据库压力变大,服务器崩溃

雪崩出现原因: 极小时间段内,redis中大量的key过期,导致命中率极低,数据库压力激增

解决方案

缓存失效时的雪崩效应对底层系统的冲击非常可怕!

构建多级缓存架构: nginx 缓存 + redis 缓存 +其他缓存(ehcache 等),程序设计较为复杂

使用锁或队列: 用加锁或者队列的方式来保证不会有大量的线程对数据库一次性进行读写,从而避免失效时大量的并发请求落到底层存储系统上。效率低,不适用高并发情况

设置过期标志更新缓存: 记录缓存数据是否过期(设置提前量),如果过期会触发通知另外的线程在后台去更新实际 key 的缓存

将缓存失效时间分散开: 比如我们可以在原有的失效时间基础上增加一个随机值,比如 1-5 分钟随机,这样每一个缓存的过期时间的重复率就会降低,就很难引发集体失效的事件

redis过期删

除策略

定期删除

每隔一段时间就扫描一定数据的设置了过期时间的key,并清除其中已过期的keys。如果有多于25%的key过期,重复上述步骤。

惰性删除

访问key时判断是否过期,过期才删除。也就是说如果这个key过期后一直没有访问它,那么它就一直在不会被删除。

内存满淘汰策略

- 1.noeviction(默认策略): 不会删除任何数据,拒绝所有写入操作并返回客户端错误消息(error)OOM command not allowed when used memory,此时 Redis 只响应删和读操作;

- 2.allkeys-lru: 从所有 key 中使用 LRU 算法进行淘汰(LRU 算法:最近最少使用算法);

- 3.allkeys-lfu: 从所有 key 中使用 LFU 算法进行淘汰(LFU 算法:最不常用算法,根据使用频率计算,4.0 版本新增);

- 4.volatile-lru: 从设置了过期时间的 key 中使用 LRU 算法进行淘汰;

- 5.volatile-lfu: 从设置了过期时间的 key 中使用 LFU 算法进行淘汰;

- 6.allkeys-random: 从所有 key 中随机淘汰数据;

- 7.volatile-random: 从设置了过期时间的 key 中随机淘汰数据;

- 8.volatile-ttl: 在设置了过期时间的key中,淘汰过期时间剩余最短的。

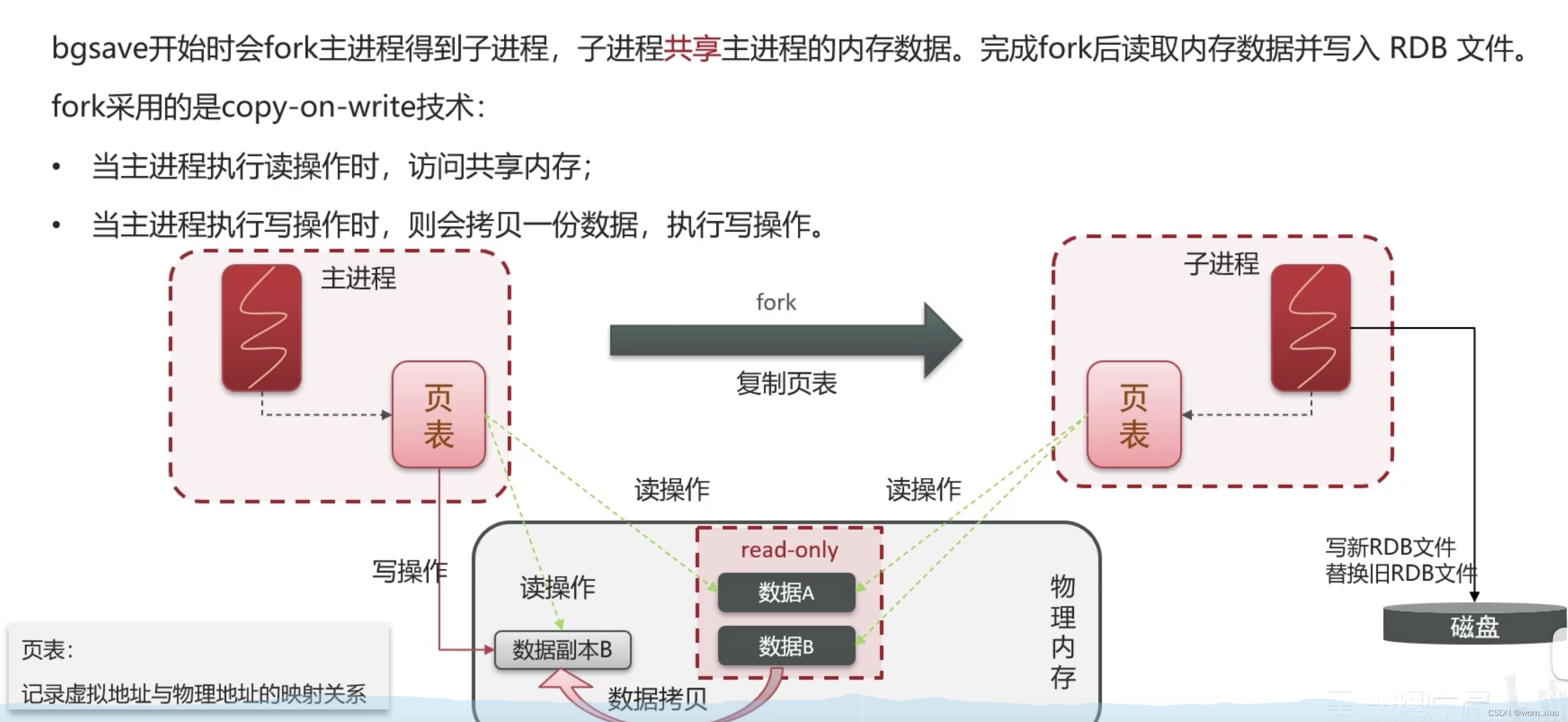

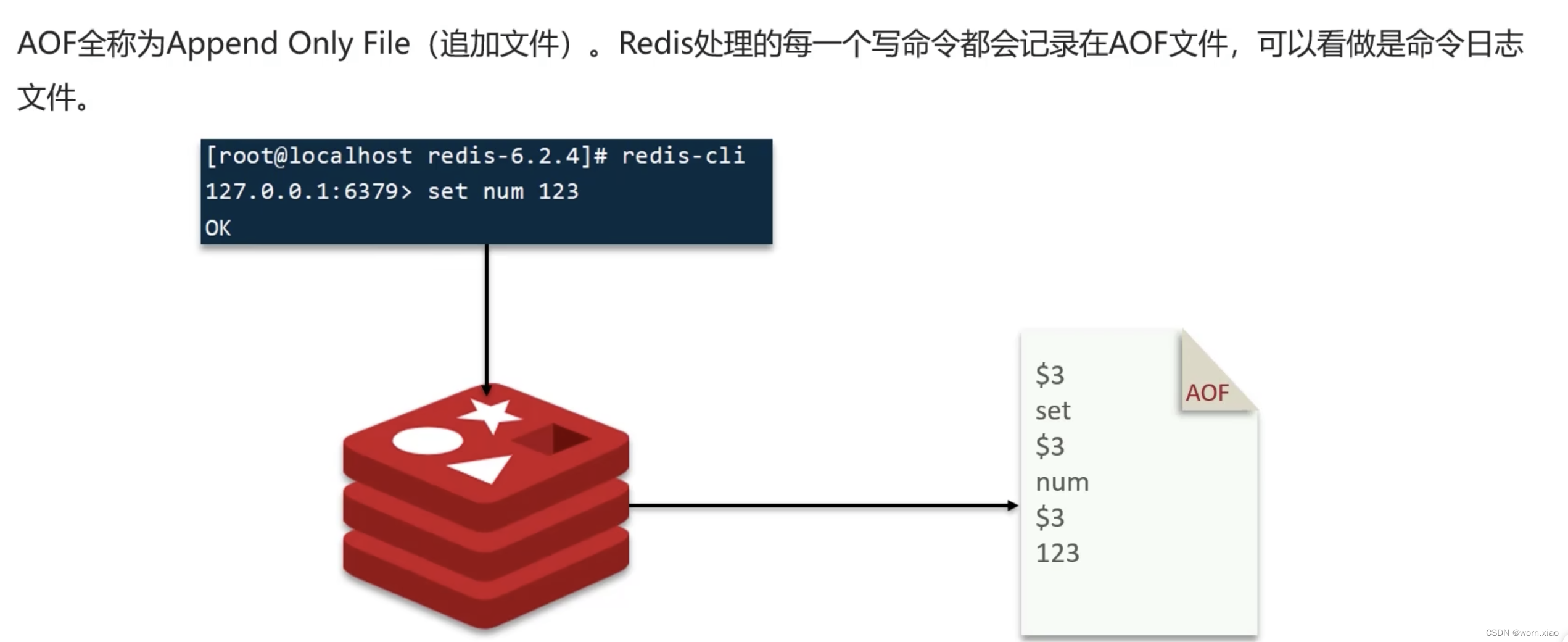

持久化存储

RDB

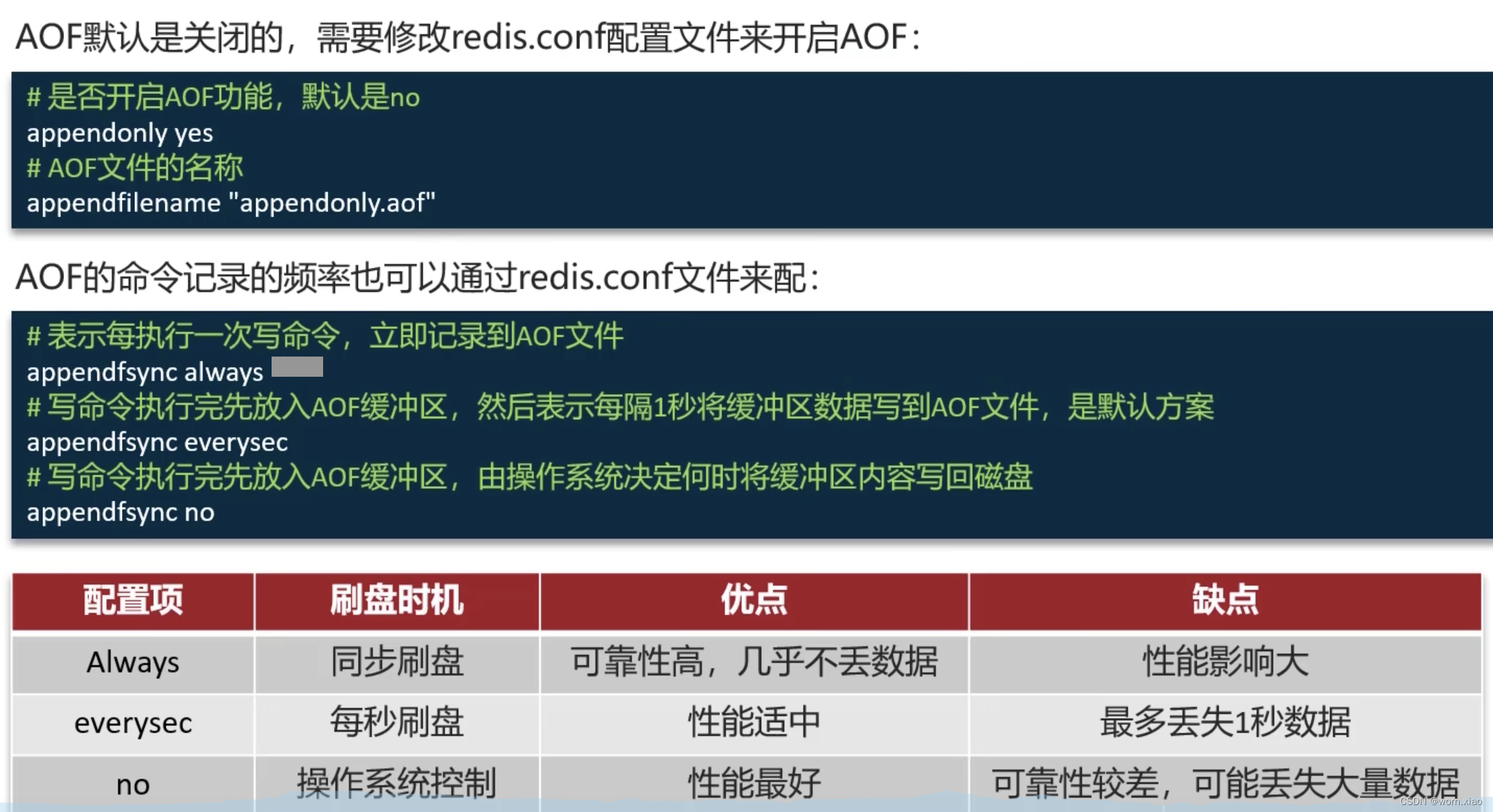

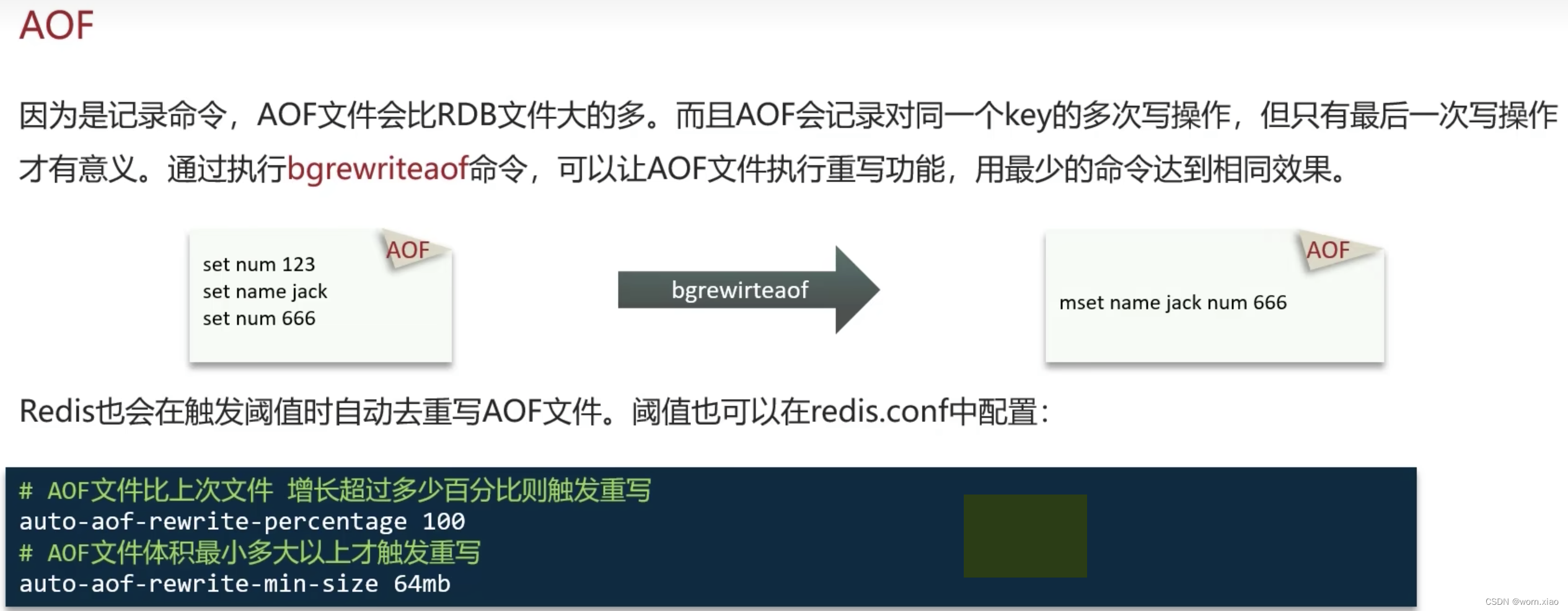

AOF

RDB & AOF 的对比

二 分布式锁

分布式锁使用场景:

分布式定时任务执行控制,缓存双写一致性问题,抢劵抢单,库存超买超卖等。可以使用redisson实现分布式锁,底层使用的是redis的setnx和lua脚本保持原子性。

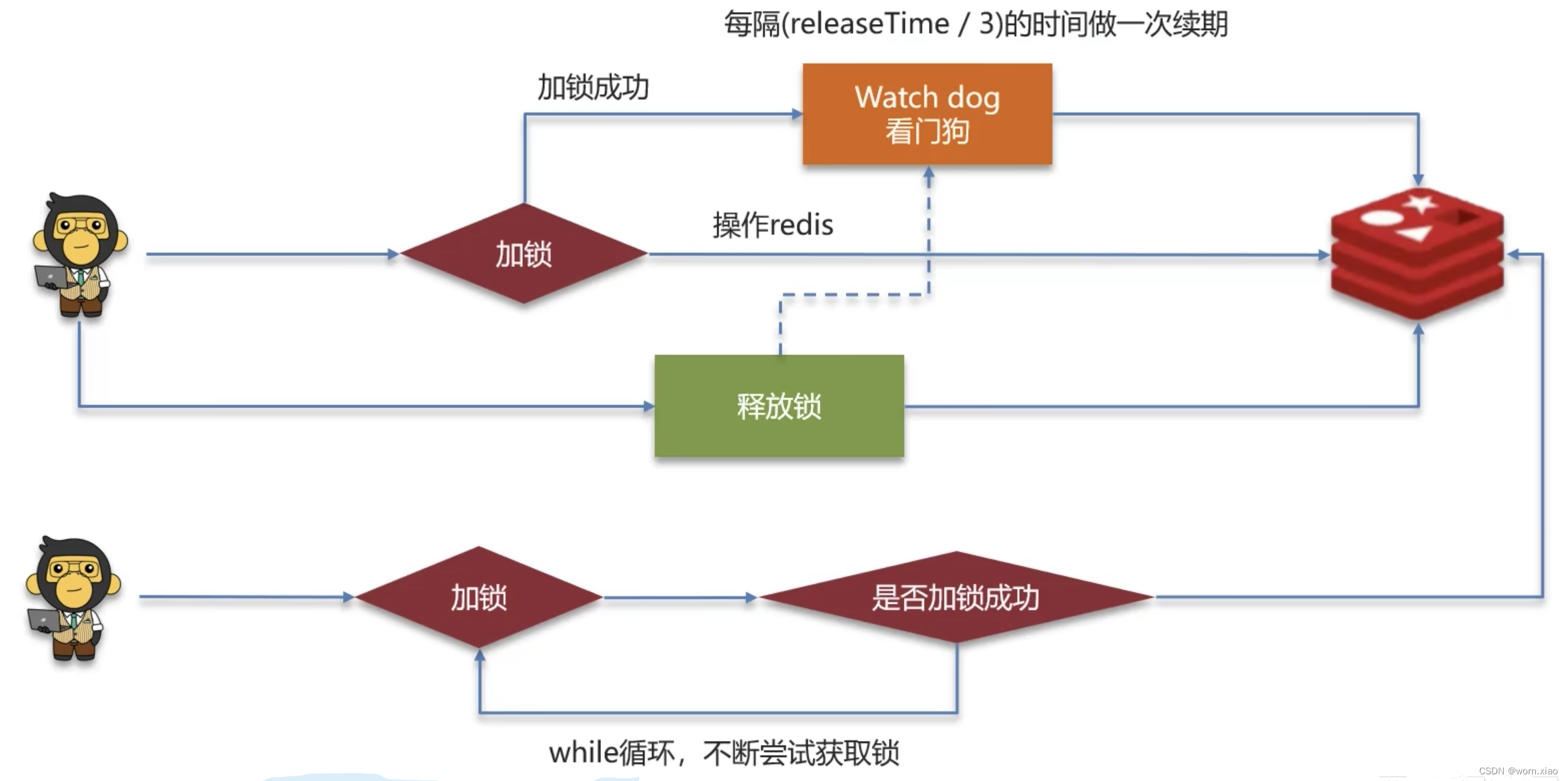

在redisson的分布式锁中,提供了一个watchdog(看门狗),一个线程获取锁成功以后会同时启动一个同生命周期的共同体线程,每10秒对锁进行一次续期

Redisson可以重入,多个锁重入需要判断是否是当前线程,在redis中进行存储的时候使用的hash结构,来存储线程信息和重入次数

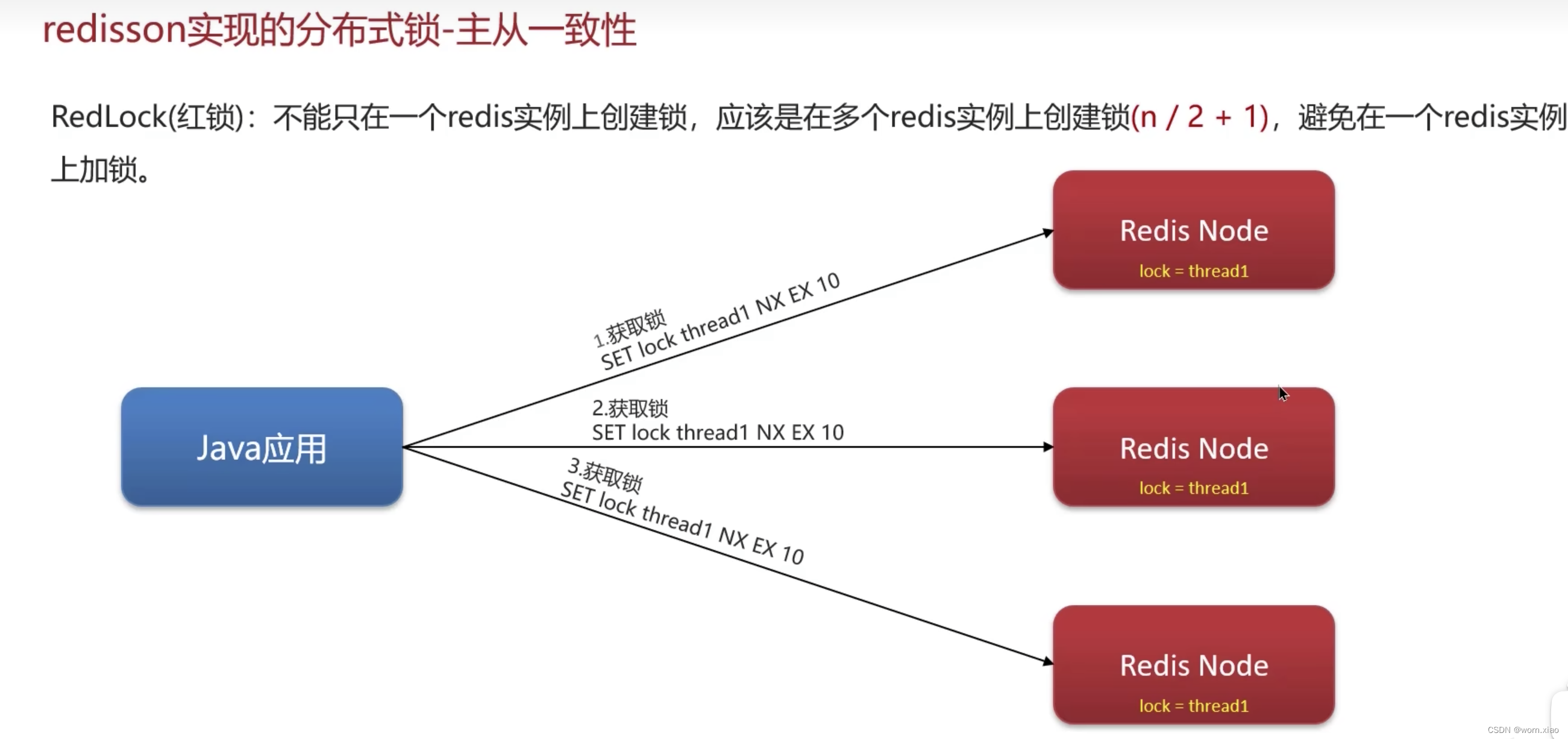

红锁本质上就是使用多个Redis做锁。例如有5个Redis,一次锁的获取,会对每个请求都获取一遍,如果获取锁成功的数量超过一半(2.5),则获取锁成功,反之失败;释放锁也需要对每个Redis释放。

三 redis集群

主从复制

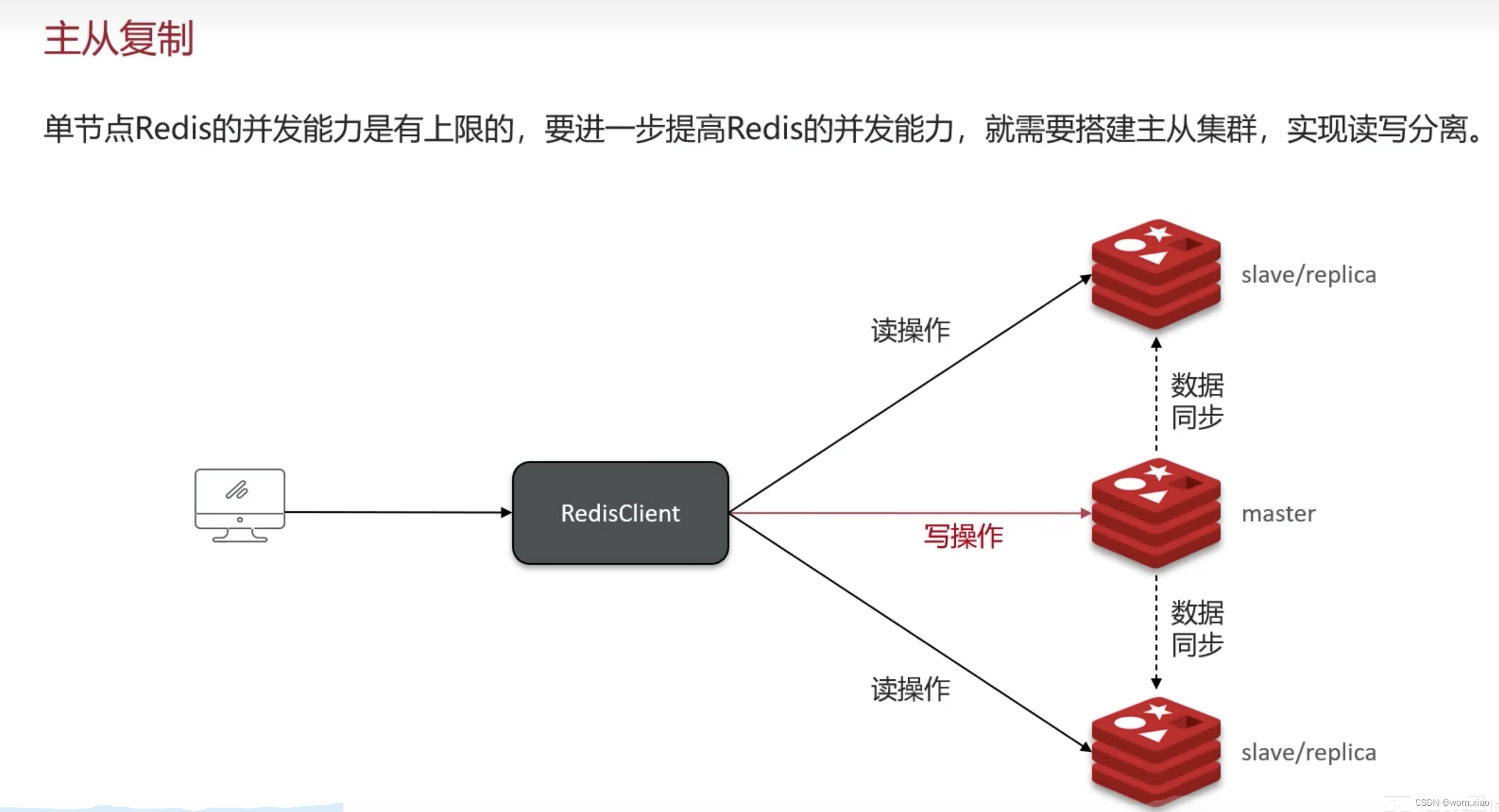

单节点redis的并发能力是有上限的,要进一步提高redis的并发执行能力,就需要搭建主从集群,实现读写分离,一般都是一主多从,主节点负责写数据,从节点负责读数据。

- 从主节点请求主节点同步数据(replication id, offset)

- 主节点判断是否是第一次请求,是第一次就与从节点同步版本信息(replicaiion id和offset)

- 主节点执行bgsave,生成rdb文件后,发送给从节点去执行

- 在rdb生成执行期间,主节点会以命令的方式记录到缓冲区

- 把生成之后的命令日志文件发送给从节点进行同步

- 从节点请求主节点同步数据,主节点判断不是第一次请求,不是第一次请求就获取从节点的offset值。

- 主节点从命令日志中获取offset值之后的数据,发送给从节点进行数据同步

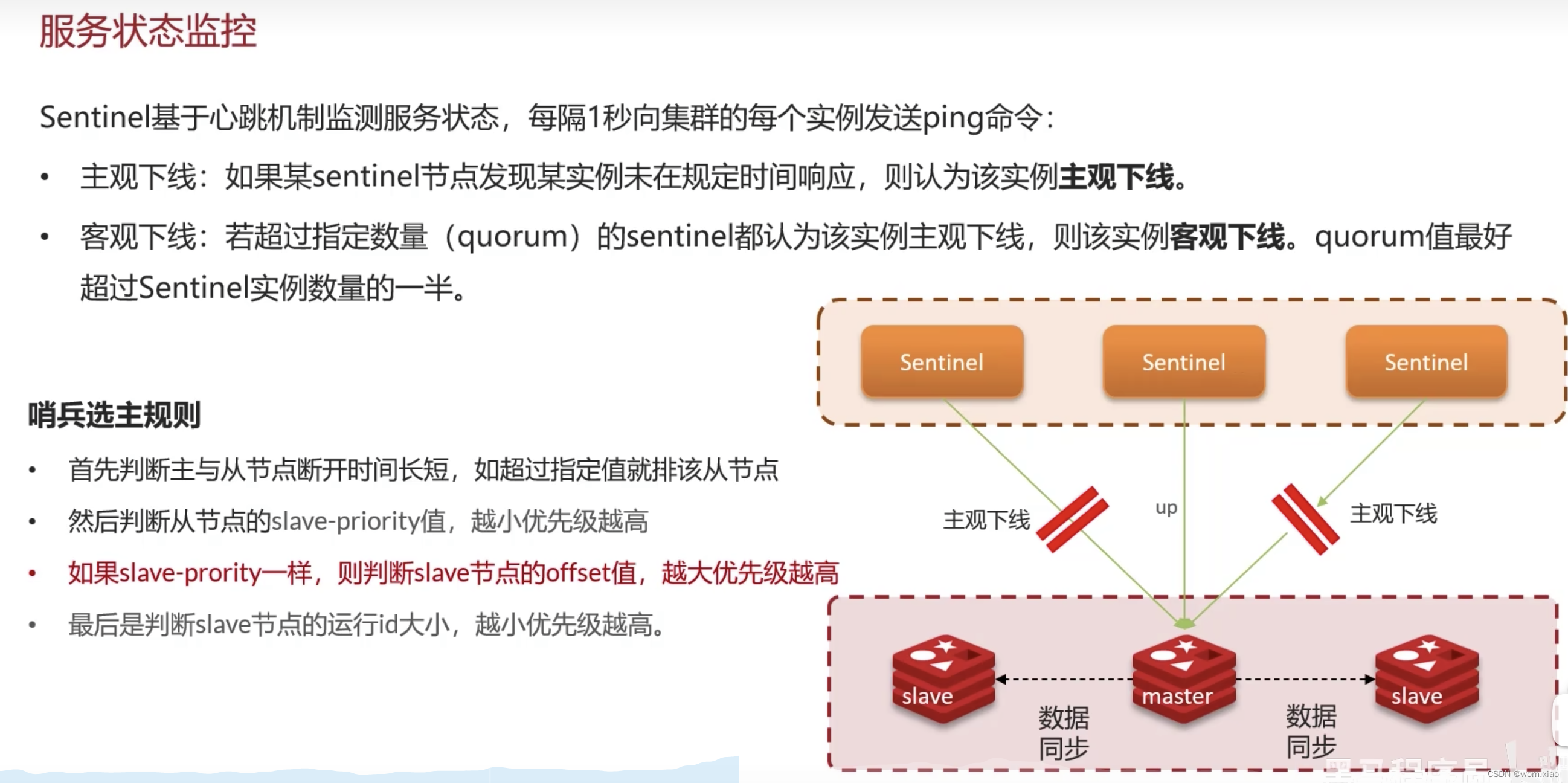

哨兵机制

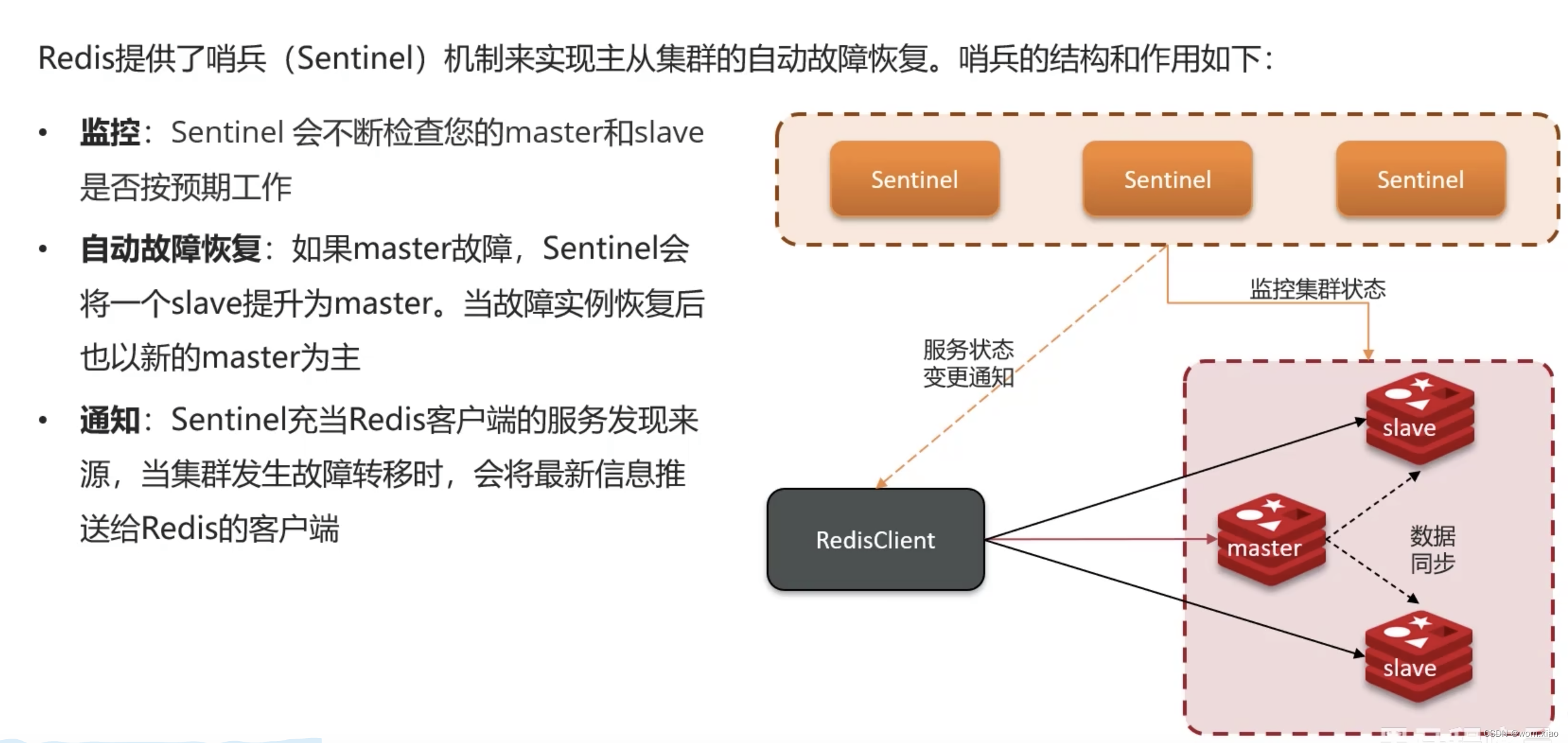

哨兵模式是一种自动选择老大的模式,即在老大宕机之后,哨兵模式会根据哨兵们的内部投票,自动的重新选出一个新的老大。哨兵模式是一种特殊的模式,首先Redis提供了哨兵的命令,哨兵是一个独立的进程,作为进程,它会独立运行。其原理是哨兵通过发送命令,等待Redis服务器响应,如果Redis服务器一直没有响应,说明这个Redis服务器可能已经宕机了,从而监控运行的多个Redis实例。

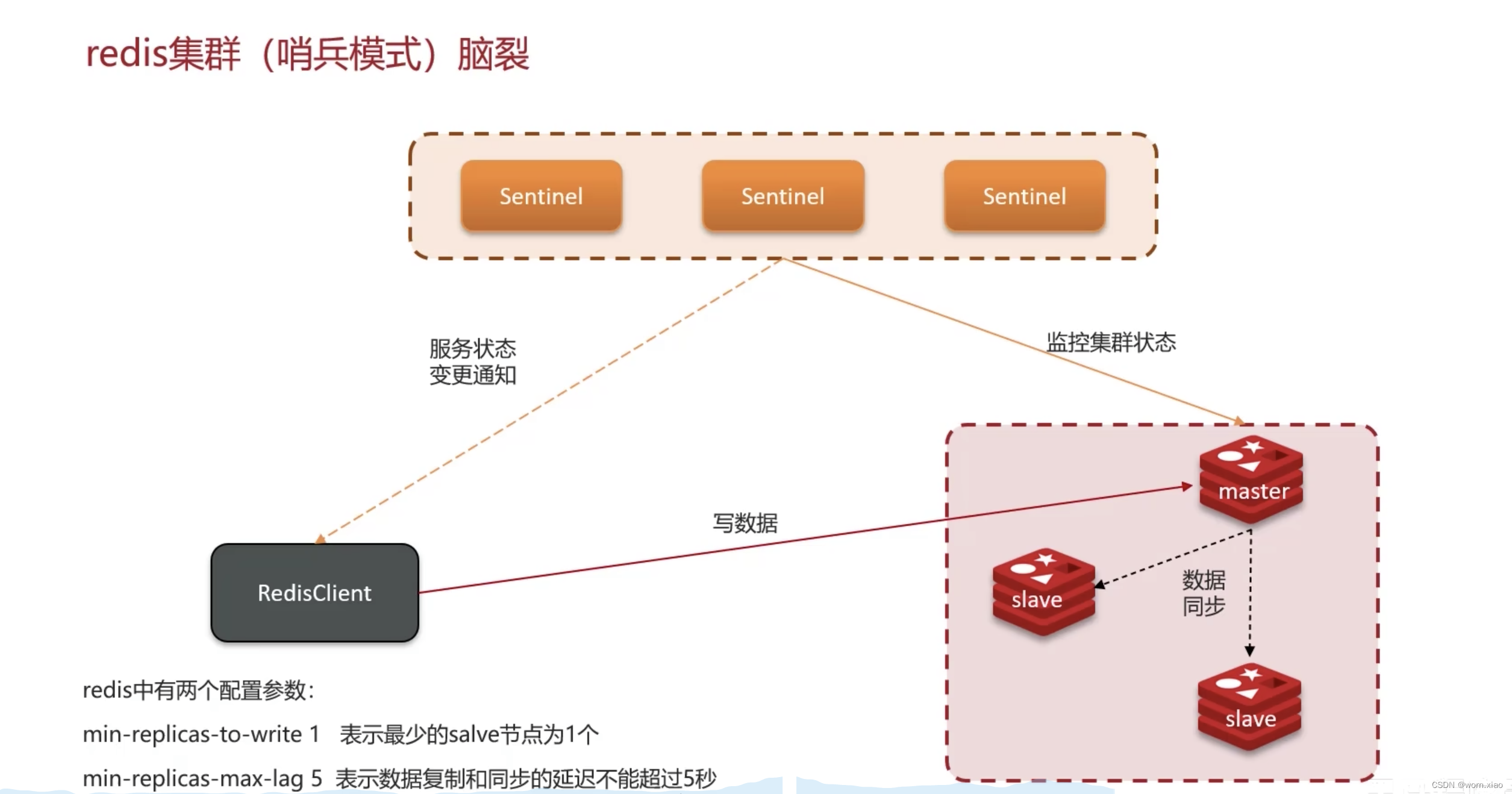

如果此时master服务器所在区域网络通信出现异常,导致和两台slave机器无法正常通信,但是和客户端的连接是正常的。那么sentinel就会从两台slave机器中选举其中一个作为新的master来处理客户端请求。这个时候,已经存在两台master服务器,client发送的数据会持续保存在旧的master服务器中,而新的master和slave中没有新的数据。如果一分钟以后,网络恢复正常,服务之间能够正常通信。此时,sentinel会把旧的master会变成新的master的slave节点。

解决办法

在配置文件中添加如下配置

min-slaves-to-write 1

min-slaves-max-lag 10这两个配置什么意思呢?

min-slaves-to-write 1,要求至少有一个slave。

min-slaves-max-lag 10,主从数据同步超时时间,10秒。以上两个配置,都不满足就会导致master拒绝接受客户端请求。根据以上配置可以将master通信异常期间的数据丢失控制在10秒以内

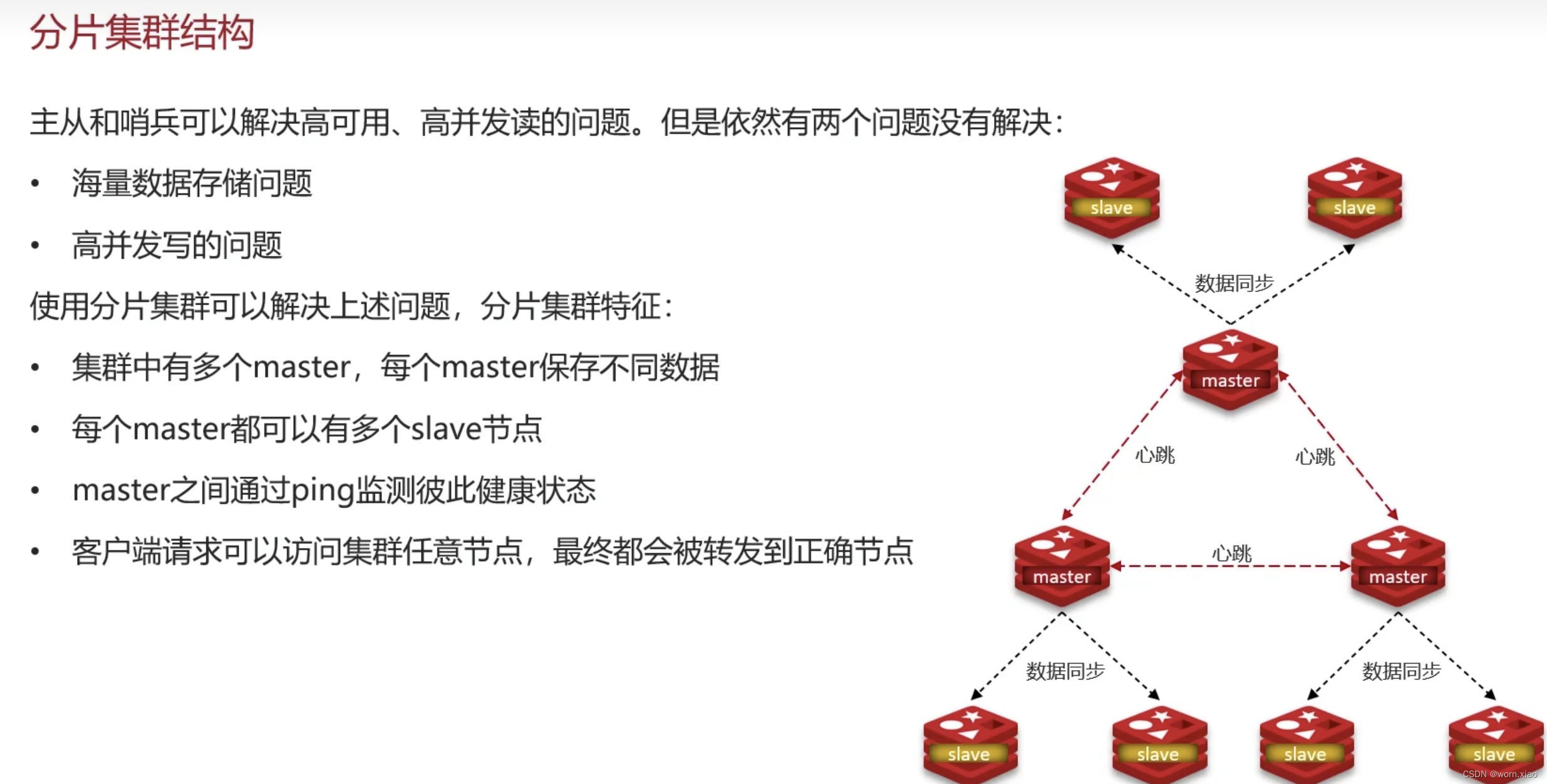

redis分片

804

804

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?