Hadoop 历史

雏形开始于2002年的Apache的Nutch,Nutch是一个开源java实现的搜索引擎。它提供我们运行自己的搜索引擎所需的全部工具。包括全文搜索和Web爬虫。 随后在2003年Google发表了一篇技术学术论文谷歌系统(GFS)。(GFS)也就是google File System, google 公司为了让存储海量搜索数据而设计的专门文件系统。 2004年Nutch创始人Doug Cutting 基于Google 的GFS论文实现了分布式文件存储系统名为DNFS。 2004年Google又发表一篇技术科学论文MapReduce。MapReduce是一种编程模型,用于大规模数据集(大于1tb)的并行分析运算。 2005年Doug Cutting又基于MapReduce,在Nutch搜索引擎实现了该功能。 2006年,Yahoo雇佣了Doug Cutting, Doug Cutting 将NDFS 和 MapReduce 升级命名为Hadoop, yahoo 开建了一个独立的团队给Doug Cutting专门研究发展Hadoop。 不得不说Google和Yahoo对Hadoop的贡献功不可没。Hadoop 核心

Hadoop的核心就是HDFS和MapReduce,而两者只是理论基础,不是具体可使用的高级应用,Hadoop旗下有很多经典子项目,比如HBase、Hive等,这些都是基于HDFS和MapReduce发展而来的。想要了解Hadoop是什么,就必须知道HDFS和MapReduce是什么。HDFS

HDFS(Hadoop Distributed File System, Hadoop分布式文件系统),它是一个高度容错性的系统,适合部署在廉价的机器上。HDFS能提供高吞吐量的数据访问,适合那些有着超大数据集(large data set) 的应用程序。 HDFS的设计特点是: 1、大数据文件,非常适合上T级别的大文件或者一大堆大数据文件的存储,如果文件只有几个G或者更小那就没撒意义了。 2、文件文块存储,HDFS会将一个完整的大文件平均分块存储到不同计算器上,它的意思在于读取文件时可以同时从多个主机取不同区块的文件,多主机读取比单主机读取效率要高的多得多。 3、流式数据访问,一次写入多次读写,这种模式跟传统文件不同,他不支持动态改变文件内容,而是要求文件一次写入就不做变化,要变化智能在文件末尾添加内容。 4、廉价硬件,HDFS可以应用在普通PC机上,这种机制能够让一些公司用几十台廉价计算机就可以撑起一个大数据集群。 5、硬件故障,HDFS认为所有计算机都可能出问题,为了防止某个主机失效读取不到该主机的块文件,它将同一个文件块副本分配到其他某几个主机上,如果其中一台主机失效可以迅速找到另一块副本读取文件。HDFS的关键元素:

Block:将一个文件文块,通常是64M.

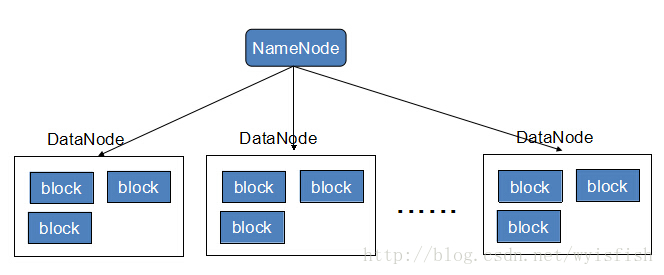

NameNode:保存整个文件系统的目录信息、文件信息及分块信息,这是由唯一一台主机专门保存,当然这台主机如果出错,NameNode就失效了。在Hadoop2.*开始支持activity-standy模式---r如果主NameNode失效,启动备用主机运行NameNode.

DataNode: 分布在廉价计算机上,用于存储Block块文件。

Hadoop初识之

最新推荐文章于 2022-12-07 20:06:36 发布

159

159

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?