现象级翻车:一个简单提问暴露Siri的“技术债务”

近日,苹果语音助手Siri因无法正确处理“现在几月份”(What month is it?)这一基础问题,在开发者社区引发热议。经技术测试,搭载iOS 18.4 Beta 4的iPhone 16 Pro中,Siri对该问题的响应仅返回年份(如“2025年”),而同类问题“今天星期几”的失败率更是高达100%。看似简单的日期解析,实则是自然语言处理(NLP)技术栈的全面溃败。

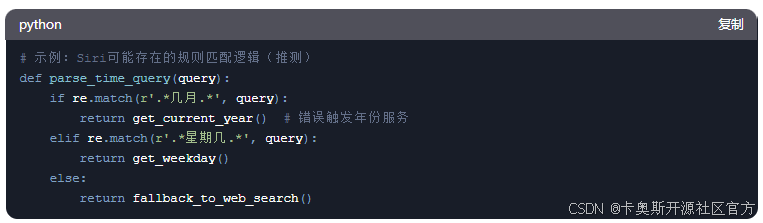

开发者通过逆向工程发现:Siri的日期解析模块仍依赖正则表达式匹配与硬编码规则。当用户提问未严格匹配预设模板(如“当前月份”)时,系统直接触发默认的年份查询服务。这种“if-else式”的规则引擎,与当下基于Transformer的大语言模型(LLM)相比,堪称技术代差。

架构溯源:Siri的技术栈为何落后一个时代?

1. 知识库更新机制的致命缺陷

Siri的知识服务仍基于静态数据库+预定义API的混合架构:

-

本地数据库:固化在系统镜像中的基础事实数据(如节假日),更新依赖系统升级

-

Wolfram Alpha API:用于数学计算和结构化查询,但响应延迟高且无法处理模糊语义

-

Web Search Fallback:当本地无匹配时调用Bing搜索,但结果解析缺乏AI增强

相比之下,ChatGPT等工具采用动态知识融合技术:

-

实时检索增强生成(RAG):将网络检索结果注入生成流程

-

多源置信度校验:通过多个API结果交叉验证准确性

2. 对话管理系统的设计僵化

Siri的对话管理器仍基于有限状态机(FSM),导致多轮对话能力薄弱。开发者日志显示,其上下文窗口长度被硬编码为3轮对话,且缺乏长期记忆存储。这种设计在面对复杂查询时极易丢失意图:

开发者生态的连锁反应:被阉割的SiriKit API

苹果对Siri能力的限制已直接影响开发者生态:

-

意图(Intent)定义僵化:仅支持苹果预定义的24类意图(如发送消息、播放音乐),无法扩展自定义语义场景

-

上下文传递受阻:App与Siri间的数据交换被严格沙箱隔离,导致跨应用任务流中断

-

个性化学习缺失:未开放用户习惯数据接口,开发者无法构建自适应对话模型

某智能家居开发者吐槽:“我们曾尝试让Siri根据用户说‘太冷了’自动调节空调,但系统只能识别预置的‘调整温度’指令,最终被迫接入阿里AI语音接口。”

技术突围:从规则引擎到LLM的迁移挑战

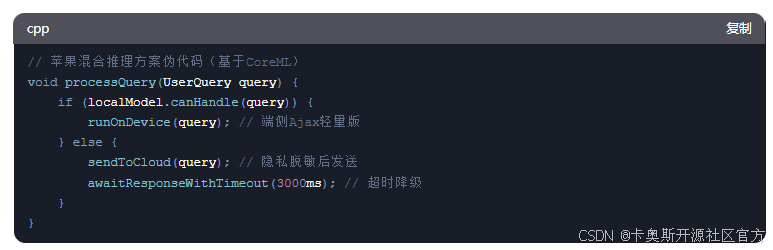

尽管苹果在WWDC 2025宣布将基于自研Ajax大模型重构Siri,但内部代码显示其面临多重技术债:

-

传统架构的惯性:现有数亿行Objective-C代码难以与PyTorch生态兼容

-

设备端推理性能:Ajax模型(175B参数)在iPhone端的推理延迟高达7秒,被迫采用“云+端”混合方案

-

隐私合规风险:端侧模型无法处理敏感查询时,云端传输面临GDPR合规审查

开源启示录:从LLM微调看智能助手的未来

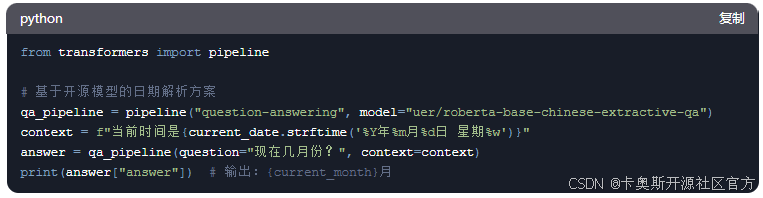

Siri的困境反衬出开源社区的灵活性。开发者可通过HuggingFace快速构建替代方案:

技术建议:

-

采用动态上下文注入:将设备状态、用户画像等实时数据融入prompt

-

实现渐进式更新:通过Diff算法增量更新本地知识库

-

构建反馈学习环路:将用户纠错数据用于模型微调

Siri危机背后的技术哲学之争

当苹果仍在纠结“完全端侧智能”与“云端协同”的路线之争时,开源社区已用LLaMA、StableLM等模型证明:模块化、可插拔的AI架构才是未来。Siri的案例警示开发者:技术债务不会消失,只会以用户体验崩坏的形式爆发。或许正如Linus定律所言:“足够多的眼睛,方可让所有BUG现形”——在AI时代,这句话应该改写为:“足够开放的技术生态,才能治愈智能体的‘人工智障’顽疾。”

如果你是Siri架构师,会如何设计下一代对话系统?欢迎在评论区分享你的技术方案!

409

409

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?