参考来源

高性能深度学习支持引擎实战——TensorRT

本文源于对云栖社区该博文的理解,算是总结下TensorRT是什么。

TensorRT解释

从TensorRT这个名字上开始解释,一般一维数组叫做Vector(即向量),二维数组叫做Matrix,再高纬度的就叫Tensor,Matrix其实是二维的Tensor。在TensorRT中,所有的数据都被组成最高四维的数组,如果对应到CNN中其实就是{N, C, H, W}。RT表示的是Runtime,即TensorRT是专门针对部署端进行优化的。

深度学习模型一般包含训练(Training)和推断(Inference),两者的差异主要在于:

- 推断(Inference)的网络权值已经固定下来,无后向传播过程。 这是因为1) 模型固定,可以对计算图进行优化;输入输出大小固定,可以做memory优化,也因此TensorRT没有fine-tuning;

- 推断(Inference)的batch size要小很多, 吞吐降低,没有办法很好地利用GPU;

- 推断(Inference)可以使用低精度的技术, 一方面可以减少计算量,另一方面是模型需要的空间减少,不管是权值的存储还是中间值的存储;

- 推断(Inference)不能用各种框架, 训练(Training)过程中可以使用不同的框架,灵活性和性能是一种trade-off的关系。

TensorRT整个过程可以分三个步骤,即模型的解析(Parser),Engine优化和执行(Execution),Parser目前有自定义层管理、C++/Python接口、caffe Parser/uff/onnx三个类型。

TensorRT优化过程

TensorRT所做的优化可以总结为:

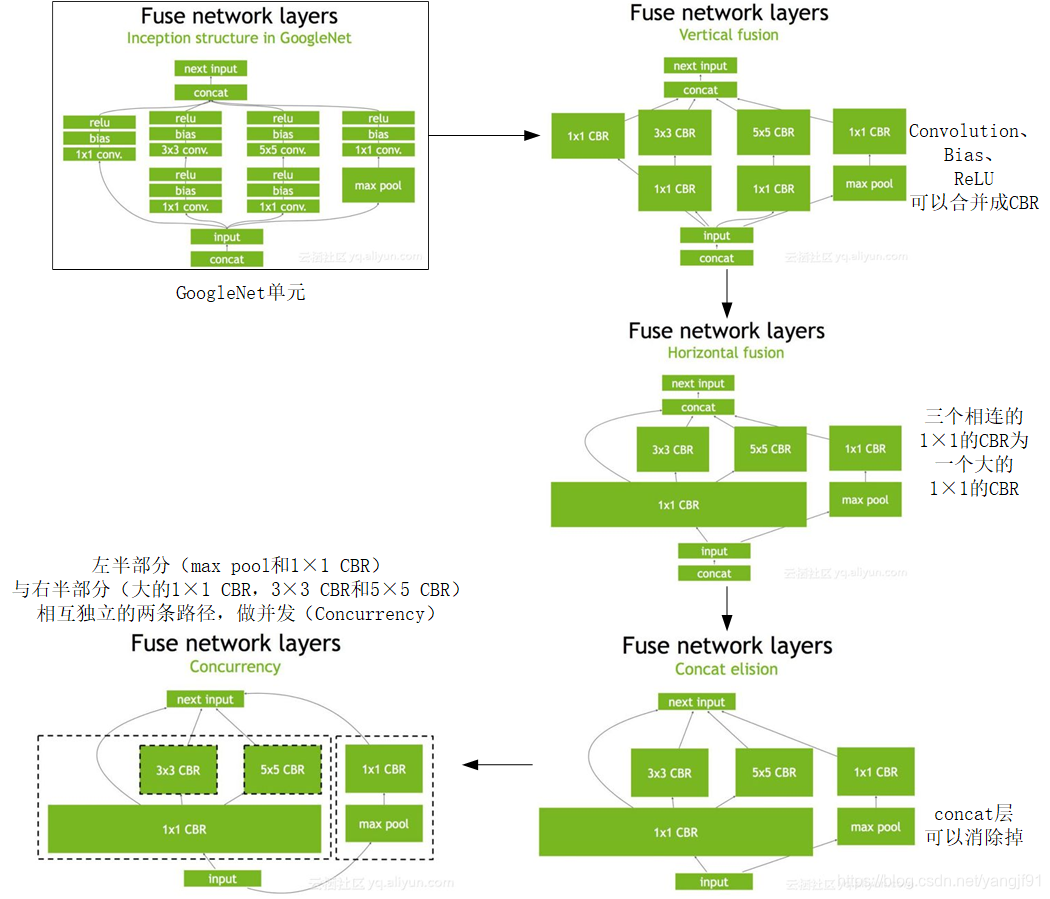

1. 把一些网络层进行了合并,如常见的层结构一次完成,相同大小的卷积合并做;

2. 取消如concat层,TensorRT可以直接实现不用专门做;

3. Kernel根据batchsize及计算复杂度自动选择合适的实现算法;

4. 不同的batch size会做tuning;

5. 针对硬件优化的engine。

如图为GoogleNet优化过程,首先对网络的常见结构层进行合并(conv + bias + relu = CBR),然后将相同大小网络结构合并到一起计算(CBR + CBR + CBR = big CBR ? ),取消concat层,划分并发实现的方法。本例只是一个示例,TensorRT的优化不止于此,比如还有针对实现算法优化和针对硬件平台的优化。

TensorRT的低精度优化

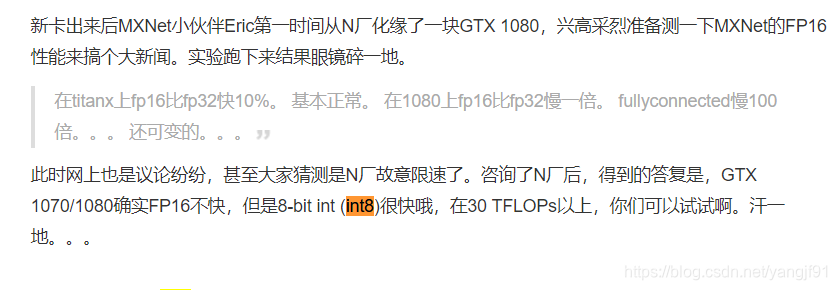

TensorRT支持FP16和INT8优化,可以安装TensorRT后查看自带的例子工程,需要注意的是优化效果和使用硬件平台相关,比如P100和V100主要支持FP16、P4和P40主要支持INT8。以18年使用最常见的1080为例,其主要支持INT8优化,在FP16下并不一定能取得想象中的优化效果。

gtx1080比gtx1070强多少

关于两种精度格式, FP16推断不需要额外的输入。INT8 推断需要生成一个校准表来量化模型,其过程主要为:

- a. 如何生成校准表 输入有代表性的数据集(500~1000,全类别)

- b. 如何使用校准表 writeCalibrationCache和readCalibrationCache加载文档,具体参见simpleINT8示例。

总结一下

训练时候,研发人员希望使用更灵活的框架搭建一个从无到有的模型,为了充分利用资源选用大batchsize进行训练(当然实践证明这样对训练效果也有提升)。

但到了部署的时候,工程人员面对的首要问题是实时性,不能使用大batchsize,但相对于训练时模型固定且不需要反向传输梯度。

因此,TensorRT通过解析模型合并计算的方式在小batchsize情况下提高硬件利用,并通过降低精度的方式在尽可能小的损失情况下大幅减少计算复杂度以提高推断的速度,最终实现部署时的模型加速。

1118

1118

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?