mscoco 数据集的bottom-up attention的特征(目标检测的框对应的特征)

trainval_resnet101_faster_rcnn_genome_36.tsv 或者 trainval_resnet101_faster_rcnn_genmoe.tsv

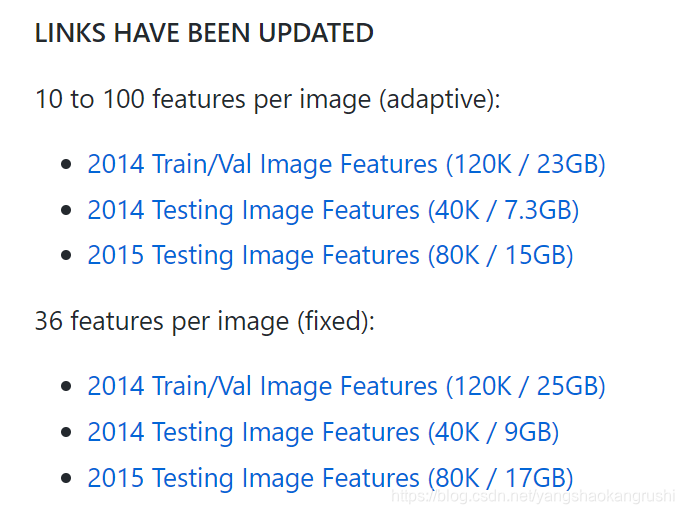

下载地址为 https://github.com/peteanderson80/bottom-up-attention#demo

.tsv文件中数据格式如下

FIELDNAMES = ['image_id', 'image_w','image_h','num_boxes', 'boxes', 'features']

其中item['boxes']为对应检测框的位置信息 x,y,w,h

item[''boxes'].shape=(num_boxes,4)

item['features']为对应检测框 在pool5_flat 层的特征

item['features'].shape=(num_boxes, feature_dim)

item['num_boxes'] 为该张图片对应的检测框数目

注意到源码中写到

return {

'image_id': image_id,

'image_h': np.size(im, 0),

'image_w': np.size(im, 1),

'num_boxes' : len(keep_boxes),

'boxes': base64.b64encode(cls_boxes[keep_boxes]),

'features': base64.b64encode(pool5[keep_boxes])

}

所以在读取 .tsv文件是,需要用到base64.decodestring()解码

可以参考 https://github.com/peteanderson80/bottom-up-attention/blob/master/tools/generate_tsv.py获取这些信息的详细由来过程

感谢苏璐岩小姐姐

1624

1624

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?