win7+python2.7下安装spark

最近在学习spark,由于我的python是在windows下安装的,好多库也已经配置好,所以需要将spark安装在windows环境下,下面是安装过程:

下载spark和对应版本的hadoop编译包

可以从http://spark.apache.org/downloads.html上下载对应的版本,我用的版本是spark-1.2.0-bin-hadoop2.4.tgz和hadoop-2.4.0.tar.gz

下载完两个压缩文件后,分别解压。我分别解压到D:\spark-1.2.0-bin-hadoop2.4和D:\hadoop-2.4.0

同时还要下载安装java虚拟机

配置环境

spark环境变量配置

将D:\spark1.2.0binhadoop2.4\bin添加到系统Path变量,同时新建SPARK_HOME变量,变量值为:D:\spark1.2.0binhadoop2.4

hadoop环境变量配置

将D:\hadoop2.4.0\bin添加到系统Path变量;同时新建HADOOP_HOME变量,变量值为:D:\hadoop2.4.0

python配置

将spark目录下的pyspark文件夹(D:\spark1.2.0binhadoop2.4\python\pyspark)复制到python安装目录C:\Python27\Lib\sitepackages里

在cmd命令行下运行cd C:\Python27\Scripts(我的python安装在C盘,这里是切换到pip的安装目录下,然后才能执行pip,没有装pip的需要预先安装),然后运行pip install py4j安装相关库。

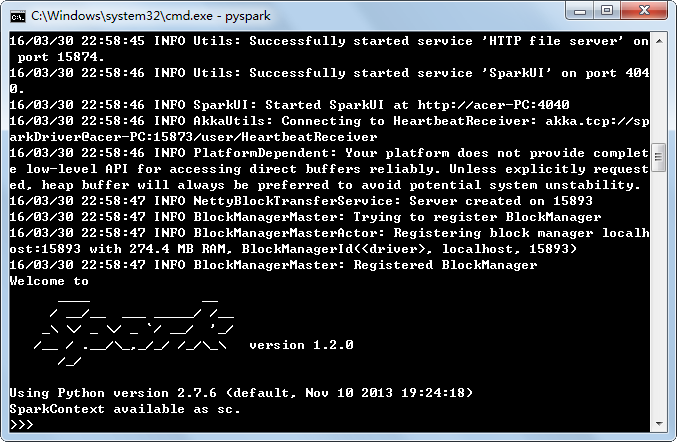

最后,在命令行窗口执行pyspark看看效果:

好了,然后就可以使用spark了。

965

965

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?