作者用的是adam onecycle,使用了下面的配置。由于我不想只训练200个epoch rpn阶段,想多训练一些周期,于是自己调整了训练周期,但是这样做训练一段时间之后,学习率还是在上升的,这样肯定是不行的,因为一般训练结束的时候学习率是很小的。

分析学习率变化有两种方法,一种是理论分析,一种看代码分析,一种是试验分析。我采用最后者。但是如果真训练的话又会用太长时间。于是我就把训练的样本从几千个变成了1,这样1S左右一个epoch。

接下来我更改总的学习周期,更改DECAY_STEP_LIST等,看看学习率变化曲线是怎样的。

LR: 0.002 LR_CLIP: 0.00001 LR_DECAY: 0.5 DECAY_STEP_LIST: [100, 150, 180, 200] LR_WARMUP: True WARMUP_MIN: 0.0002 WARMUP_EPOCH: 1

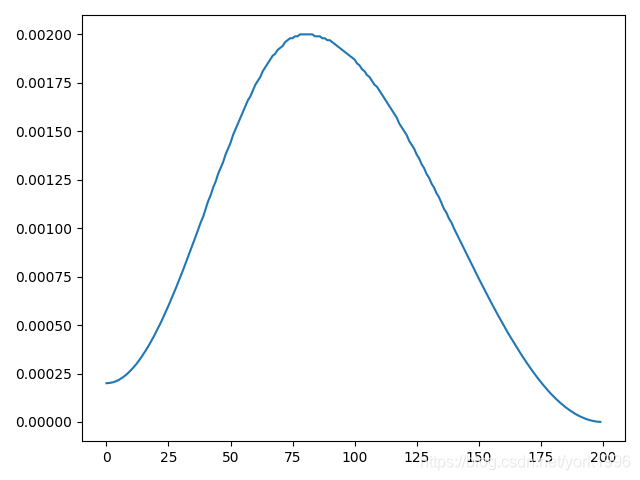

下面是DECAY_STEP_LIST: [100, 150, 180, 200],epoches=200

下面是DECAY_STEP_LIST: [100, 150, 180, 200],epoches=200

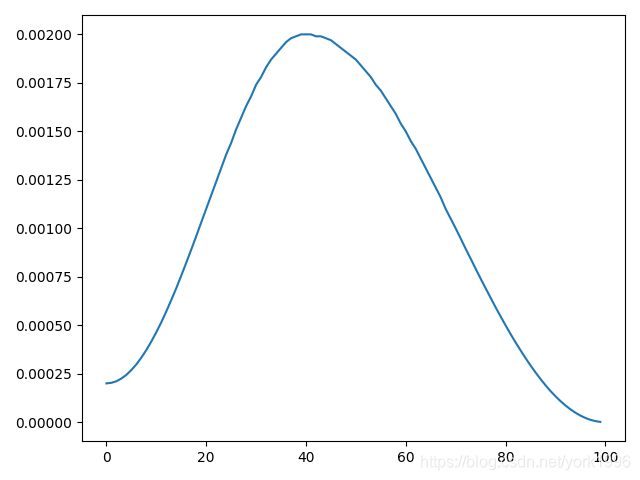

可以看到好像和设置的 : [100, 150, 180, 200]没有关系,和设置的总训练周期有关系,先上升后下降。

现在改改[100, 150, 180, 200]中的数字个数试试。并没有什么卵用,不太清楚这里的作用。

猜想是训练方法的原因,如果不是adam_onecycle,可能这个列表就有用了。下面试试:

果然。。

DECAY_STEP_LIST: [10, 15, 18, 40] & epoches=100

LR_CLIP: 0.00001 LR_DECAY: 0.5 DECAY_STEP_LIST: [10, 15, 18, 20,25,27,28,29,30] LR_WARMUP: True WARMUP_MIN: 0.0002 WARMUP_EPOCH: 1 设置文件里面的这些参数应该都是为adam用的。

(一)、什么是Warmup?

Warmup是在ResNet论文中提到的一种学习率预热的方法,它在训练开始的时候先选择使用一个较小的学习率,训练了一些epoches或者steps(比如4个epoches,10000steps),再修改为预先设置的学习来进行训练。引用自学习率预热

LR: 0.002 代表最大的学习率。adam和adam_onecycle共用这个参数。

814

814

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?