今天测试爬虫scrapy爬取站点图片,保存的.csv文件数据有530000+行,使用excel打开非常缓慢,所以想着给他切割成多个文件,这样打开查看就很方便了。

# code=utf-8

import pandas as pd

# 打开文件

data = pd.read_csv(r'C:\Users\Admin\Desktop\爬虫爬取的文件\xxx.csv')

# 每个excel保存3万行,那么530000+数据需要18个.csv文档保存

for i in range(0, 18):

save_data = data.iloc[i*30000 + 1 : (i+1)*30000+1]

file_name = r'C:\Users\Admin\Desktop\爬虫爬取的文件\xxx' + str(i) + '.csv' # 保存文件路径以及文件名称

save_data.to_csv(file_name, index=False) # 保存格式为.csv,如果是xlsx则修改为save_data.to_excel

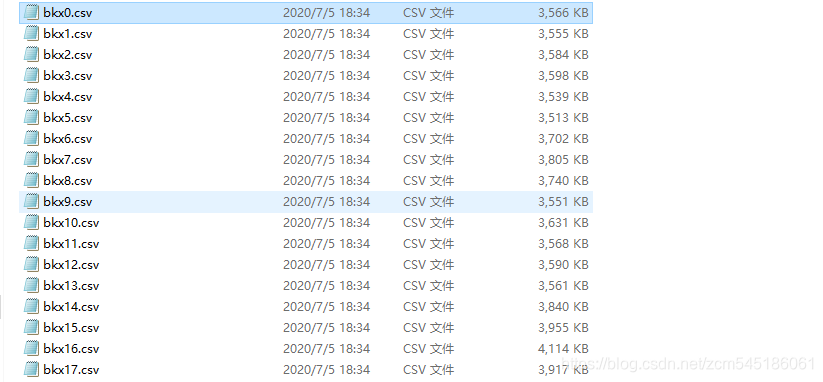

查看结果,发现被分割成了18个.csv文件

2419

2419

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?