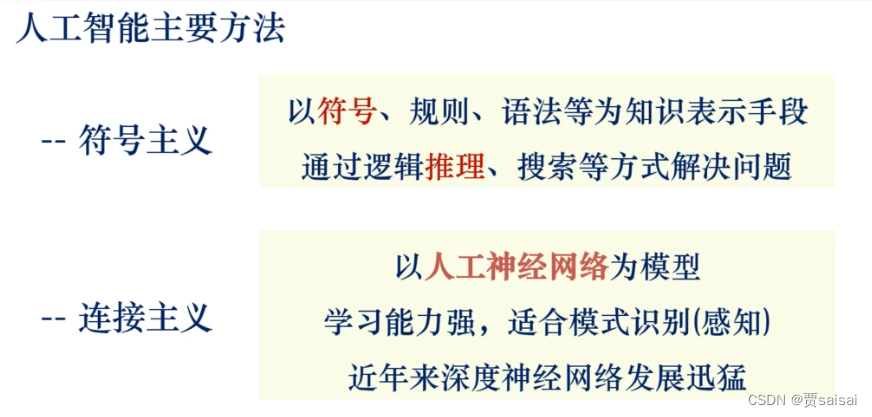

简单概念

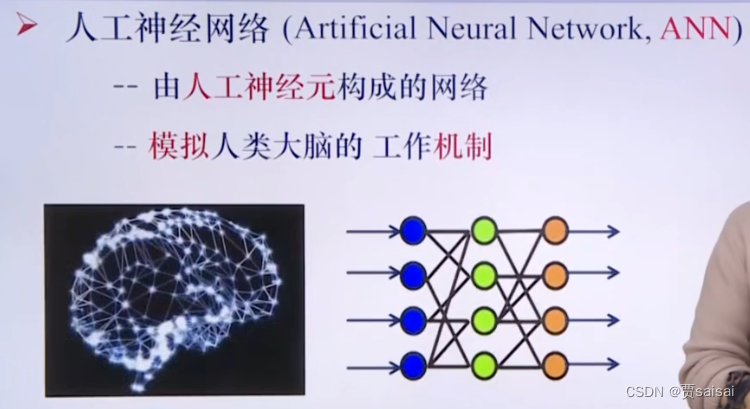

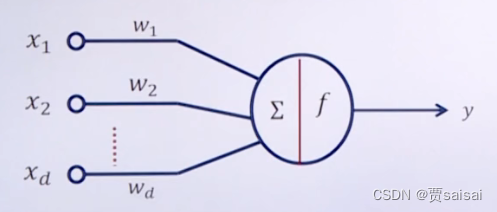

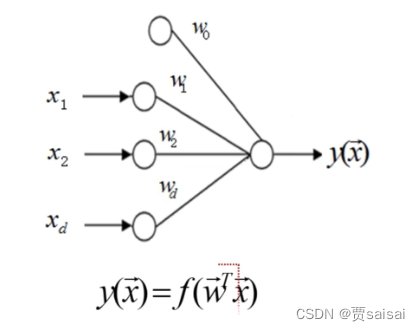

基本模型:

输入乘以权重之后累加,大于一定的阈值(f为阈值函数)才会有输出,阈值函数有多种选择。

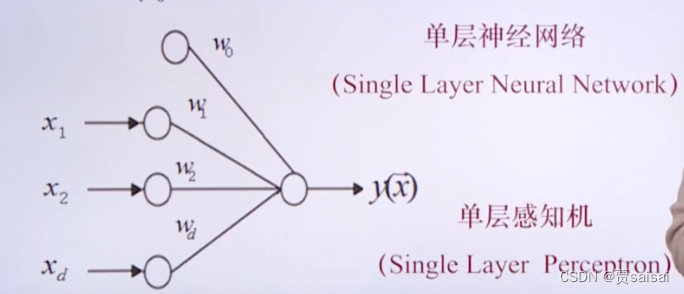

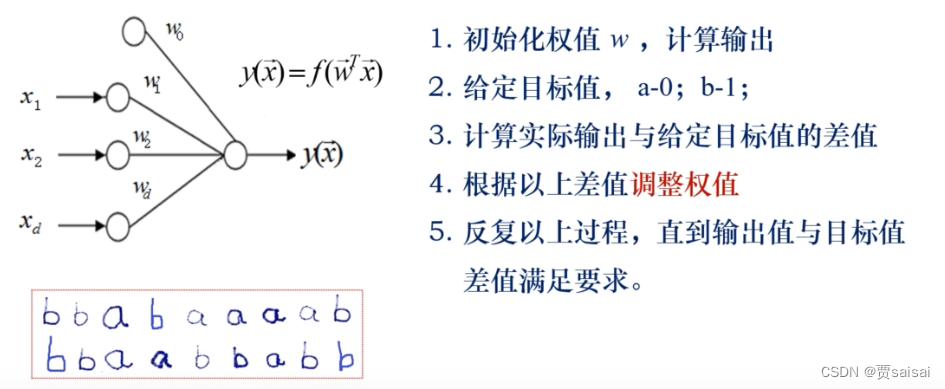

单层神经网络(单层感知机)

WT是权重矩阵。

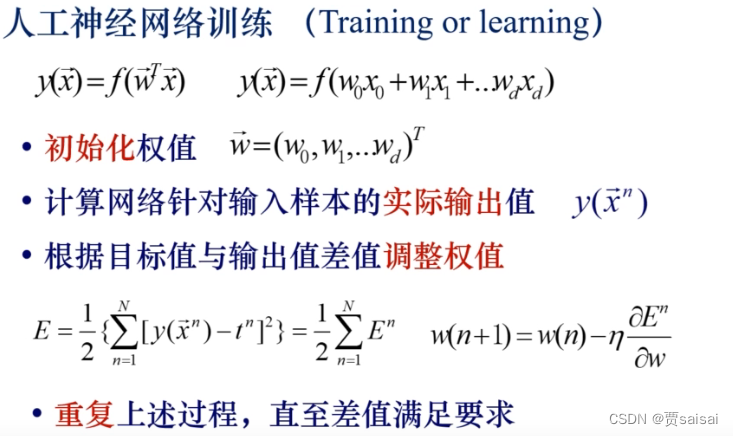

整个过程大致是收集标注样本、训练神经网络、测试神经网络。

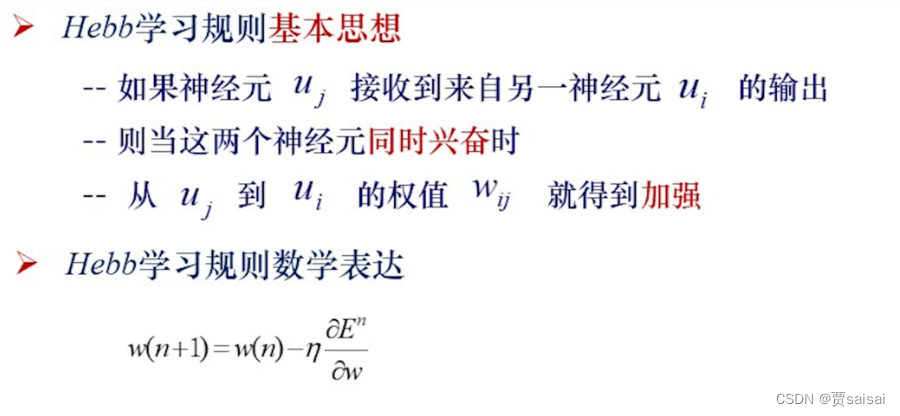

Hebb学习规则只根据神经元连接间的激活水平改变权值,因此这种方法又称为相关学习或并联学习。

在ANN中Hebb算法最简单可以描述为:如果一个处理单元从另一处理单元接收输入激励信号,而且如果两者都处于高激励电平,那么处理单元之间的加权就应当增强。

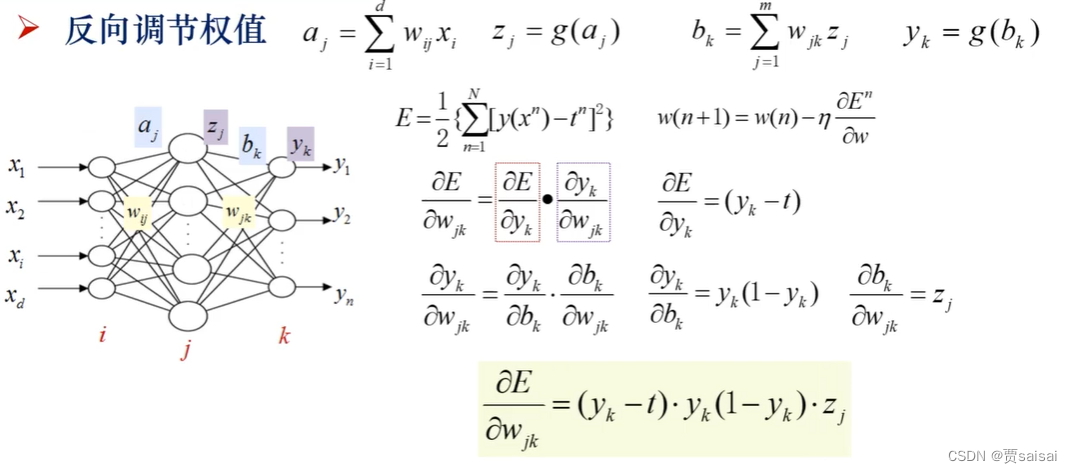

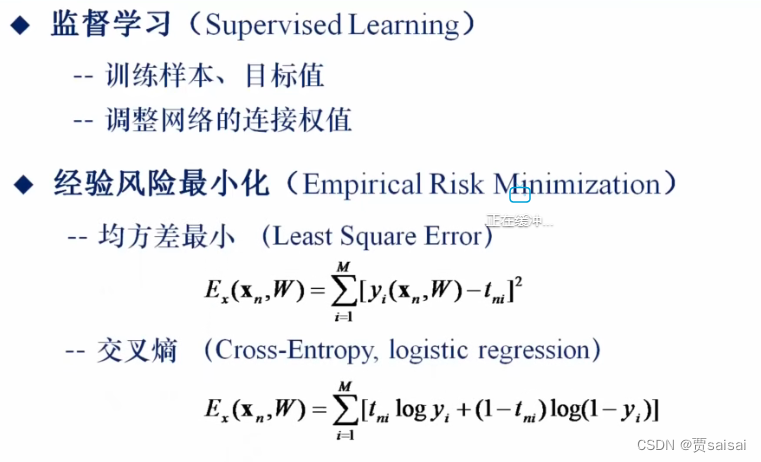

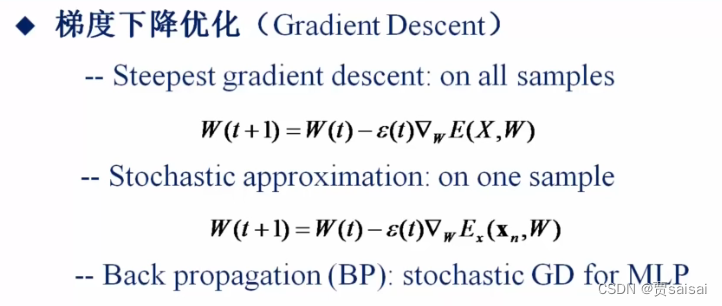

公式中E是目标值和输出值的差,求对权重偏导。

如果一个神经元出现会激发附近的另一个神经元,那么这两个神经元间的联系就会强化,从而记住这两个事物之间存在着联系。相反,如果两个神经元总是不能同步激发,那么它们间的联系将会越来越弱。

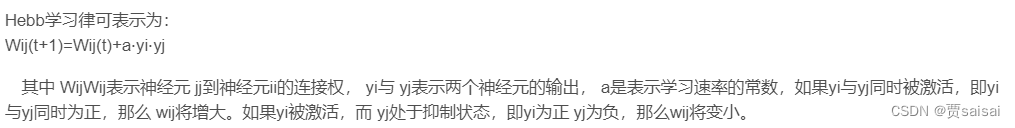

下面是截取其他博主的解释:

不过这里感觉应该是yj-yi

单层神经网络训练得到的精度会比较差。

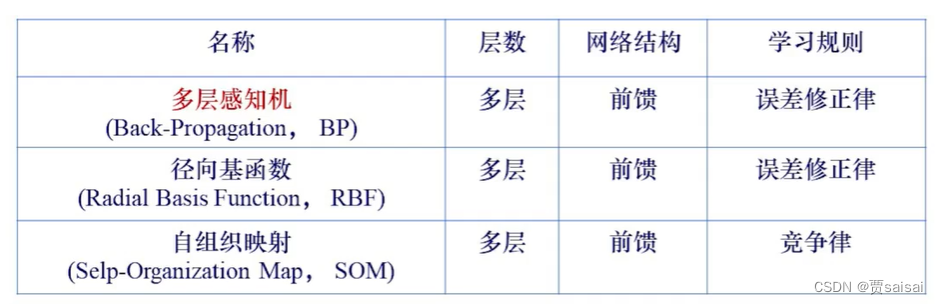

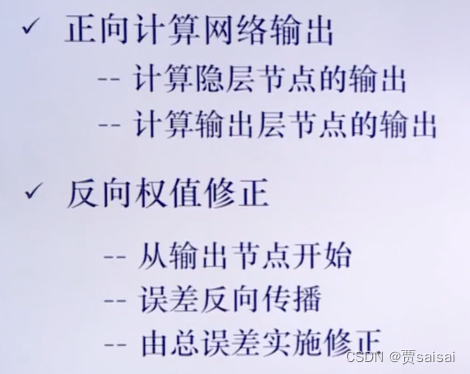

多层神经网络(多层感知机)

反向传播的例子及通俗理解: 第四章反向传播法

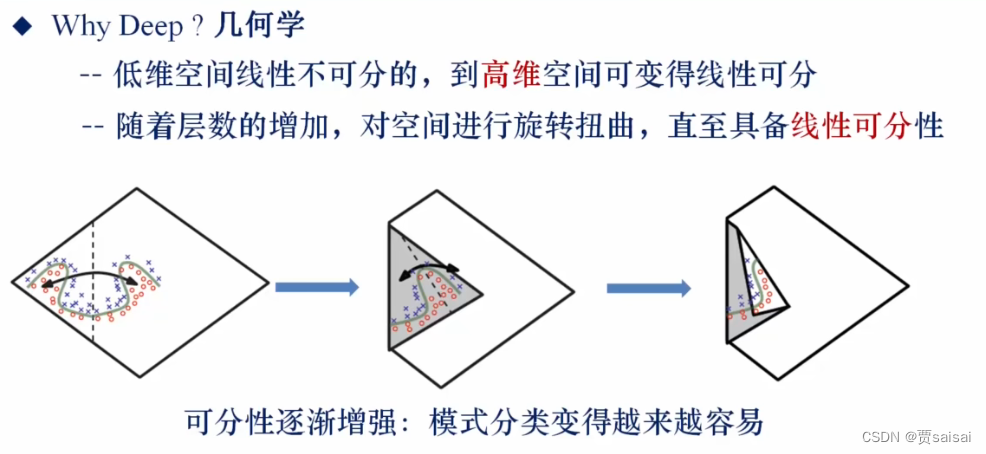

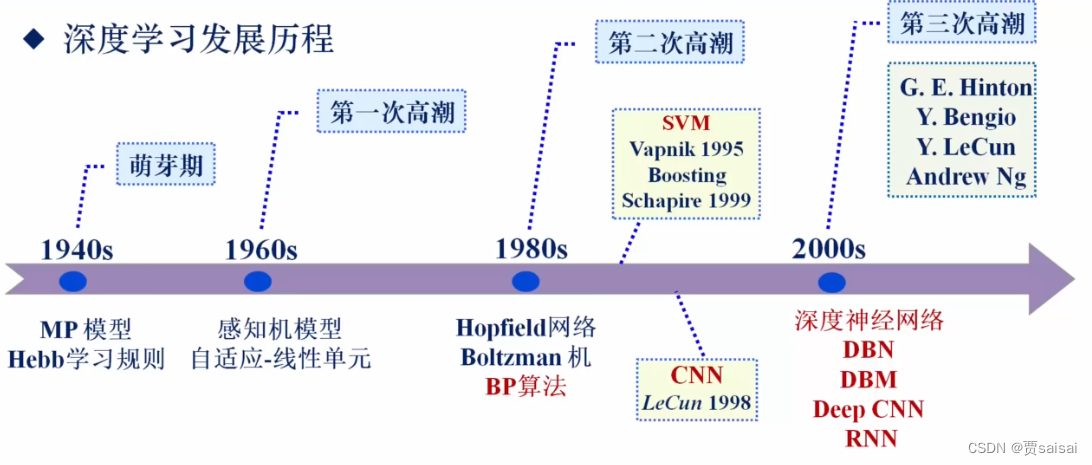

深度学习

以前由于计算机性能等的影响没有深度学习

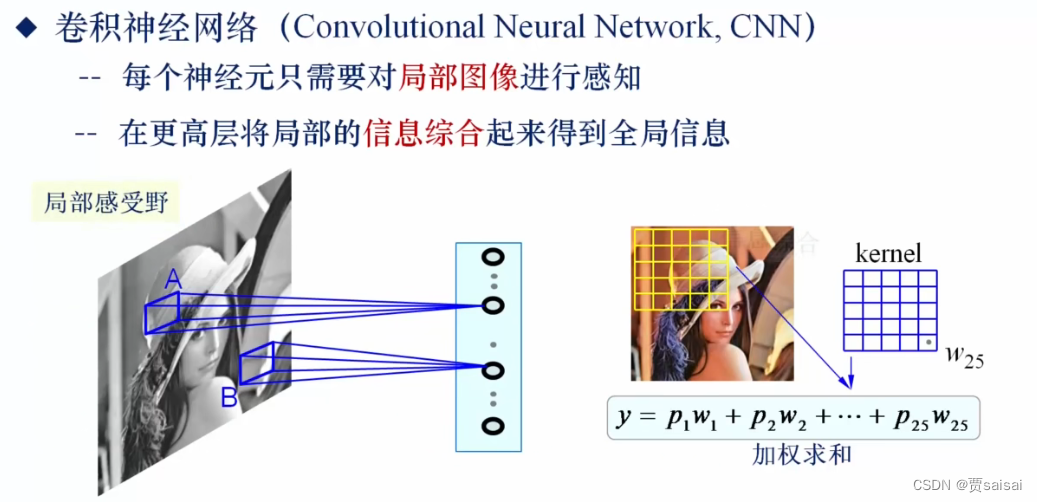

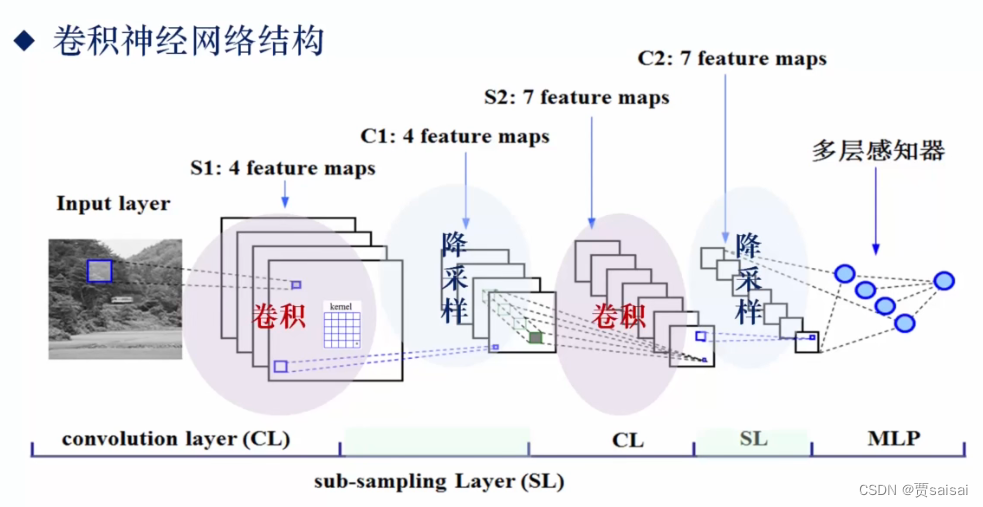

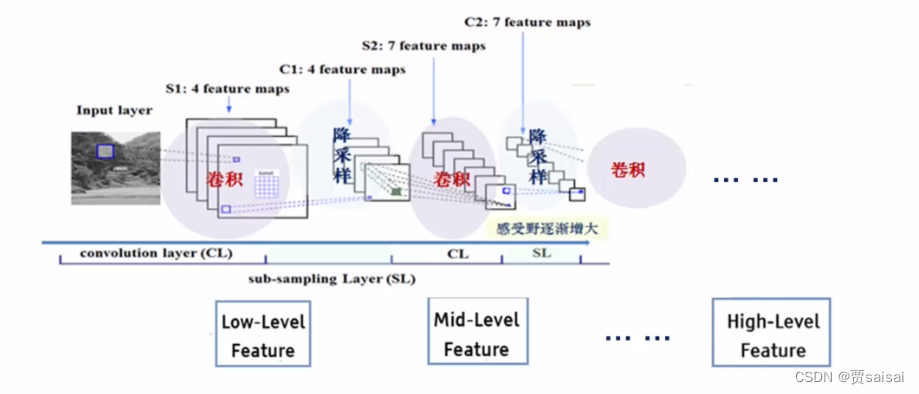

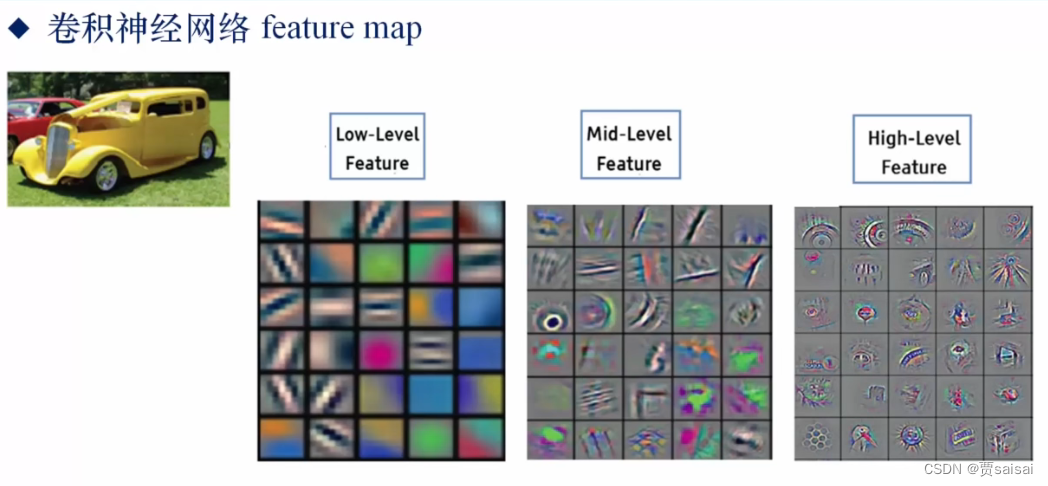

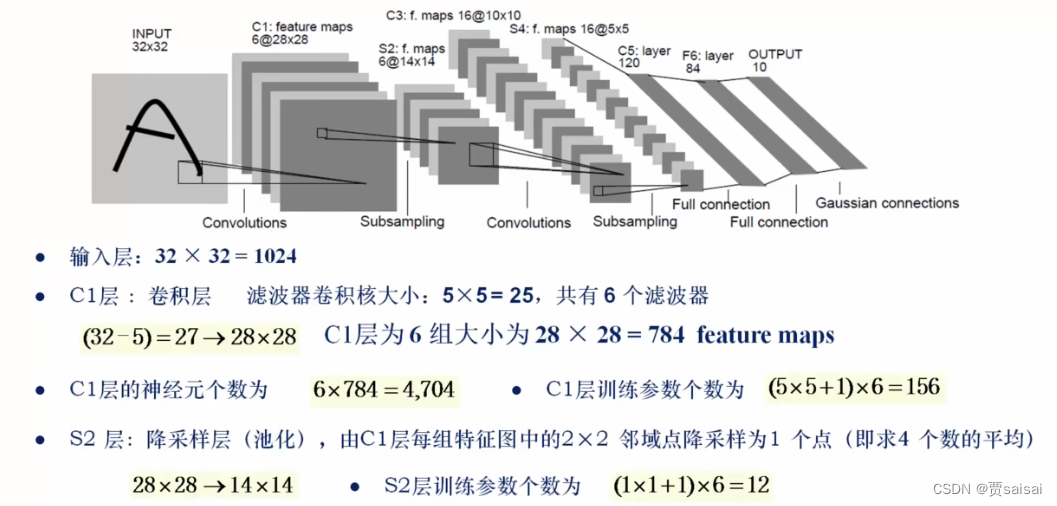

卷积神经网络

深度学习网络

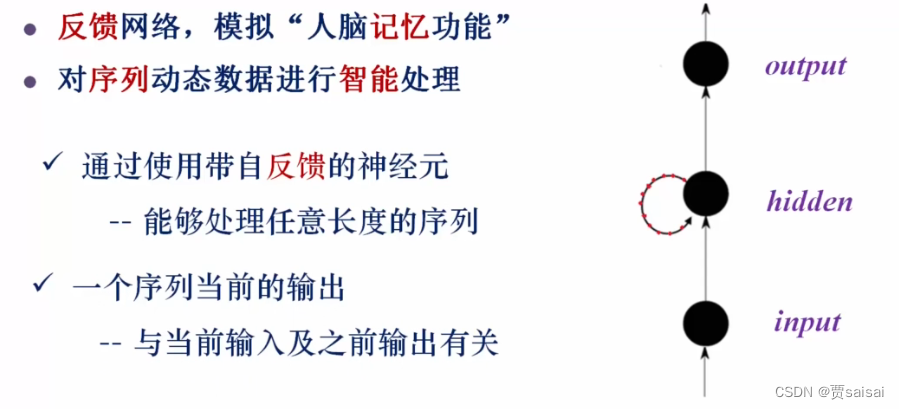

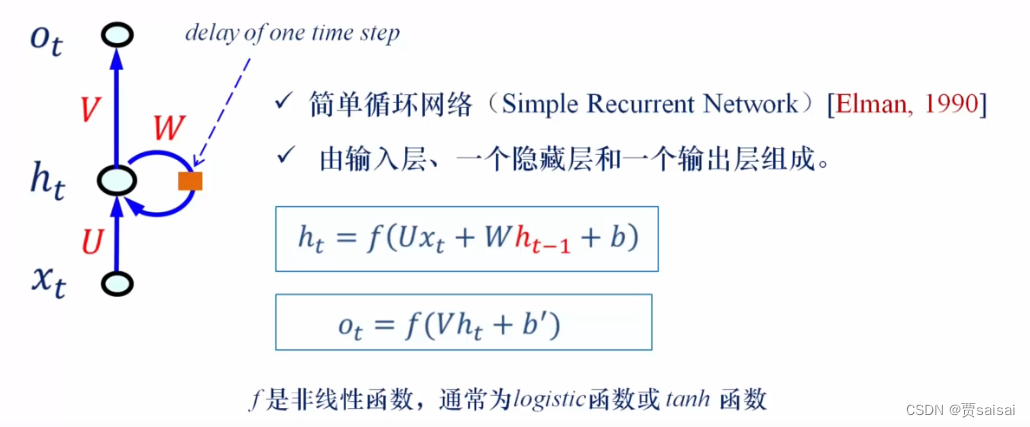

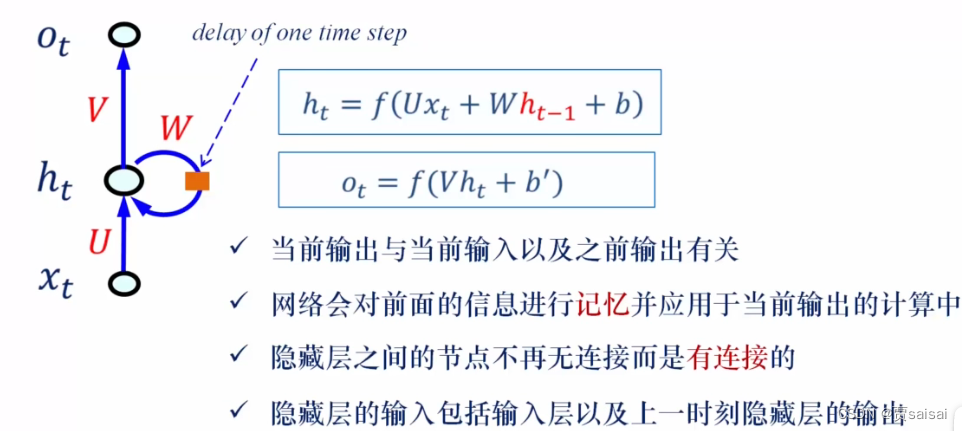

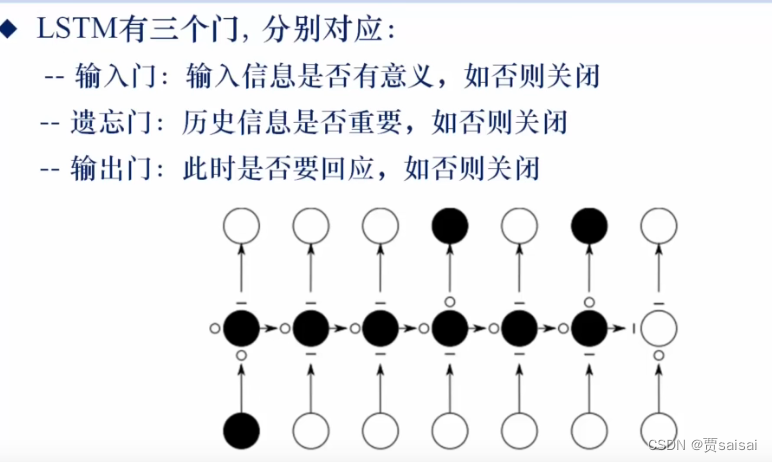

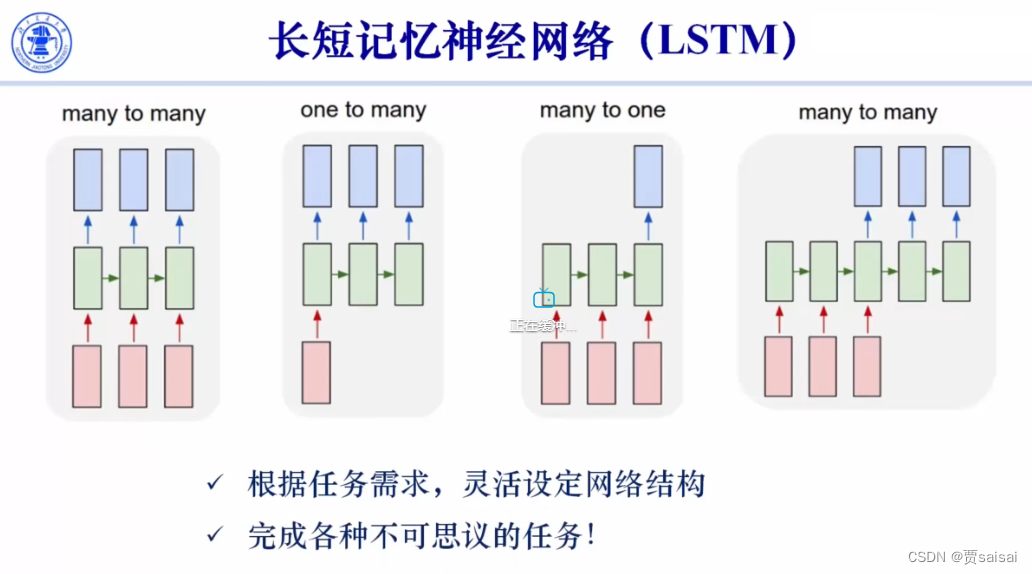

循环神经网络

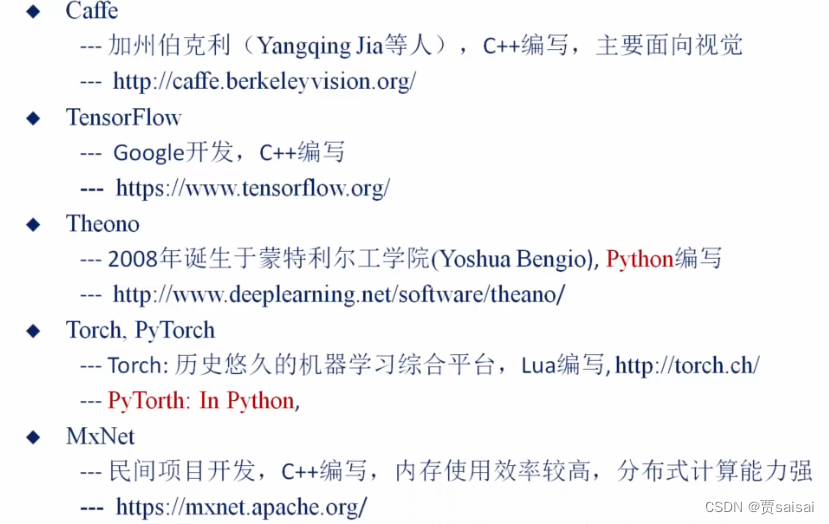

学习工具:

7014

7014

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?