这一讲介绍学习理论,之前我们已经学习了不少机器学习算法,那么在使用中如何评估这些算法的运行情况,需要进行哪些调整?学习理论就是用来debug算法,通过学习理论能够针对实际问题更好的选择算法,修改算法。这一讲首先介绍underfitting/overfitting,Bias/variance, 经验风险最小化(EmpiricalRisk Minization ERM),联合界(Union bound)、一致收敛(Uniform Convergence)。

Bias/variance

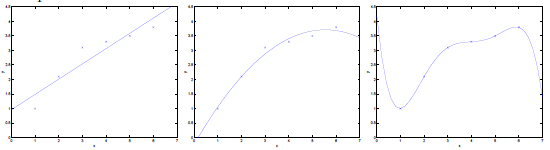

HighBias描述的是模型过于简单,对训练集中数据的结构没有表现出来,造成较大误差,也就是此时存在underfitting。 High variance描述的是模型过于复杂,可以理解为捕捉到的只是训练集数据特有的结构,失去了一般性,对新样本造成较大误差,也就是此时存在overfitting。

接下来会更为正式的学习Bias/variance的概念,探索何时会出现High Bias和High variance。首先介绍一些辅助定理。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?