1、开发前准备:假定您已经搭建好了Spark集群。

2、开发环境采用eclipse maven工程,需要添加Spark Streaming依赖。

3、Spark streaming基于Spark Core进行计算,需要注意事项:

设置本地master,如果指定local的话,必须配置至少二条线程,也可通过sparkconf来设置,因为Spark Streaming应用程序在运行的时候,至少有一条线程用于不断的循环接收数据,并且至少有一条线程用于处理接收的数据(否则的话无法有线程用于处理数据),随着时间的推移,内存和磁盘都会不堪重负)。

温馨提示:

对于集群而言,每隔Executor一般肯定不只一个Thread,那对于处理Spark Streaming应用程序而言,每个Executor一般分配多少core比较合适?根据我们过去的经验,5个左右的core是最佳的(段子:分配为奇数个core的表现最佳,例如:分配3个、5个、7个core等)。

接下来,让我们开始动手写Java代码吧!

一、Java方式开发

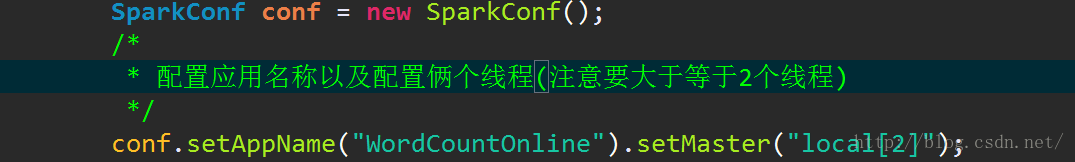

第一步,配置SparkConf:

/*

*第一步:配置SparkConf:

* 1,至少2条线程:因为Spark Streaming应用程序在运行的时候,至少有一条

*线程用于不断的循环接收数据,并且至少有一条线程用于处理接受的数据(否则的话无法

*有线程用于处理数据,随着时间的推移,内存和磁盘都会不堪重负);

* 2,对于集群而言,每个Executor一般肯定不止一个Thread,那对于处理Spark Streaming的

*应用程序而言,每个Executor一般分配多少Core比较合适?根据我们过去的经验,5个左右的

* Core是最佳的(一个段子分配为奇数个Core表现最佳,例如3个、5个、7个Core等);

*/

/*SparkConf conf = newSparkConf().setMaster("local[2]").

setAppName("WordCountOnline");*/

SparkConf conf = newSparkConf().setMaster("spark://Master:7077").

setAppName("WordCountOnline");

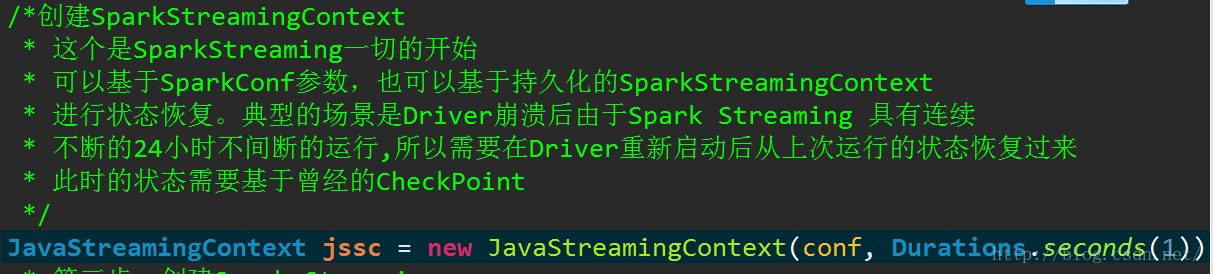

第二步,创建SparkStreamingContext:

我们采用基于配置文件的方式创建SparkStreamingContext对象。

/*

*第二步:创建SparkStreamingContext:

* 1,这个是SparkStreaming应用程序所有功能的起始点和程序调度的核心

* SparkStreamingContext的构建可以基于SparkConf参数,也可基于持久化的SparkStreamingContext的

*内容来恢复过来(典型的场景是Driver崩溃后重新启动,由于Spark Streaming具有连续7*24小时不,

*间断运行的特征所有需要在Driver重新启动后继续上衣系的状态,此时的状态恢复需要基于曾经的

* Checkpoint);

* 2,在一个SparkStreaming应用程序中可以创建若干个SparkStreamingContext对象,使用下一个

* SparkStreamingContext之前需要把前面正在运行的SparkStreamingContext对象关闭掉,由此,

*我们获得一个重大的启发,SparkStreaming框架也只是Spark Core上的一个应用程序而已,

*只不过SparkStreaming框架箱运行的话需要Spark工程师写业务逻辑处理代码;

*/

JavaStreamingContext jsc= new JavaStreamingContext(conf, Durations.seconds(5));

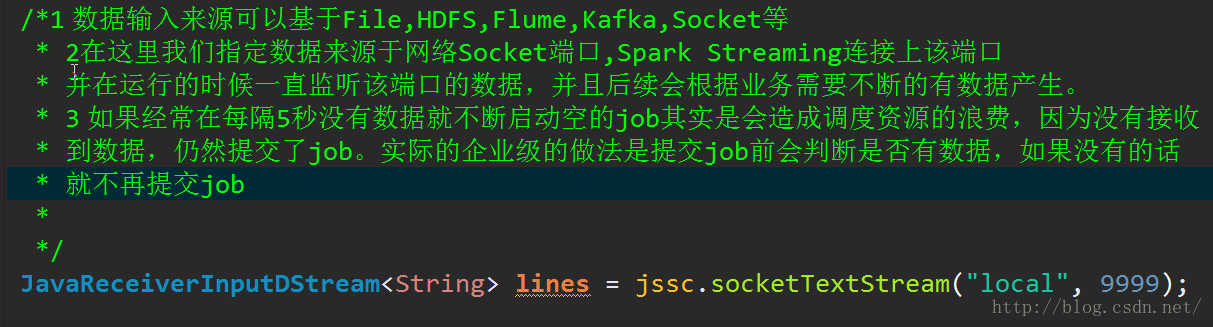

第三步,创建Spark Streaming输入数据来源:

我们将数据来源配置为本地端口9999(注意,端口要求没有被占用):

/*

*第三步:创建SparkStreaming输入数据来源input Stream:

* 1,数据输入来源可以基于File、HDFS、Flume、Kafka、Socket等

* 2,在这里我们指定数据来源于网络Socket端口,Spark Streaming连接上该端口并在运行的时候一直监听

*该端口的数据(当然该端口服务首先必须存在),并且在后续会根据业务需要不断的有数据产生(当然对于

* Spark Streaming应用程序的运行而言,有无数据其处理流程都是一样的);

* 3,如果经常在每间隔5秒钟没有数据的话不断的启动空的Job其实是会造成调度资源的浪费,

* 因为并没有数据需要发生计算,所以

*实例的企业级生成环境的代码在具体提交Job前会判断是否有数据,如果没有的话就不再提交Job;

*/

JavaReceiverInputDStreamlines = jsc.socketTextStream("Master", 9999);

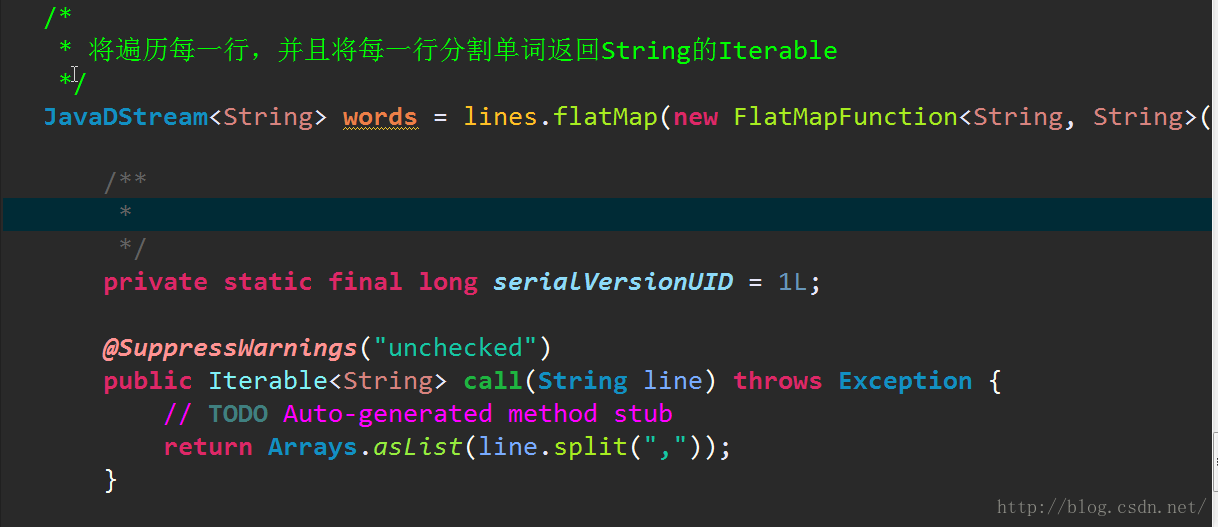

第四步:我们就像对RDD编程一样,基于DStream进行编程,原因是DStream是RDD产生的模板,在SparkStreaming发生计算前,其实质是把每个Batch的DStream的操作翻译成为了RDD操作。

1、flatMap操作:

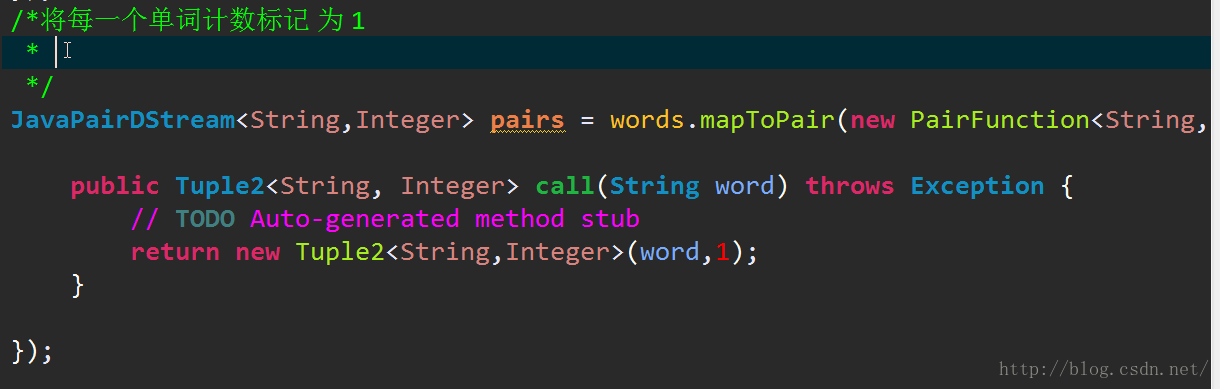

2、mapToPair操作:

3、reduceByKey操作:

4、print等操作:

/*

*第四步:接下来就像对于RDD编程一样基于DStream进行编程!!!原因是DStream是RDD产生的模

*板(或者说类),在SparkStreaming具体发生计算前,其实质是把每个Batch的DStream的操作翻译成

*为对RDD的操作!!!

*对初始的DStream进行Transformation级别的处理,例如map、filter等高阶函数等的编程,来进行具体

*的数据计算

*第4.1步:讲每一行的字符串拆分成单个的单词

*/

JavaDStream<String>words = lines.flatMap(new FlatMapFunction<String, String>() { //如果是Scala,由于SAM转换,所以可以写成valwords = lines.flatMap { line => line.split(" ")}

@Override

public Iterable<String> call(String line) throws Exception {

return Arrays.asList(line.split(" "));

}

});

/*

* 第四步:对初始的DStream进行Transformation级别的处理,例如map、filter等高阶函数等的编程,来进行具体的数据计算

* 第4.2步:在单词拆分的基础上对每个单词实例计数为1,也就是word => (word, 1)

*/

JavaPairDStream<String,Integer> pairs = words.mapToPair(new PairFunction<String, String,Integer>() {

@Override

public Tuple2<String, Integer> call(String word) throwsException {

return new Tuple2<String, Integer>(word, 1);

}

});

/*

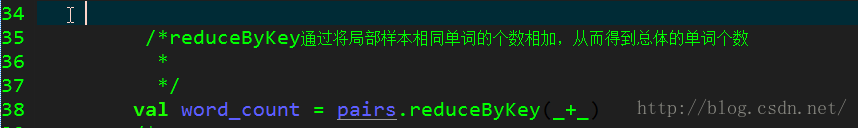

* 第四步:对初始的DStream进行Transformation级别的处理,例如map、filter等高阶函数等的编程,来进行具体的数据计算

* 第4.3步:在每个单词实例计数为1基础之上统计每个单词在文件中出现的总次数

*/

JavaPairDStream<String,Integer> wordsCount = pairs.reduceByKey(new Function2<Integer, Integer,Integer>() { //对相同的Key,进行Value的累计(包括Local和Reducer级别同时Reduce)

@Override

public Integer call(Integer v1, Integer v2) throws Exception {

return v1 + v2;

}

});

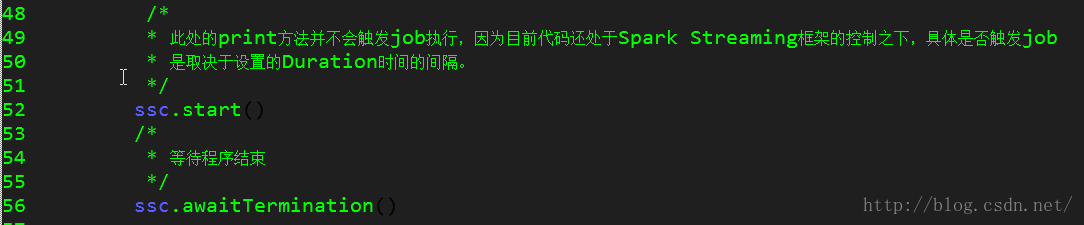

/*

*此处的print并不会直接出发Job的执行,因为现在的一切都是在Spark Streaming框架的控制之下的,对于Spark Streaming

*而言具体是否触发真正的Job运行是基于设置的Duration时间间隔的

*

*诸位一定要注意的是SparkStreaming应用程序要想执行具体的Job,对Dtream就必须有outputStream操作,

* output Stream有很多类型的函数触发,类print、saveAsTextFile、saveAsHadoopFiles等,最为重要的一个

*方法是foraeachRDD,因为Spark Streaming处理的结果一般都会放在Redis、DB、DashBoard等上面,foreachRDD

*主要就是用用来完成这些功能的,而且可以随意的自定义具体数据到底放在哪里!!!

*/

wordsCount.print();

/*

* Spark Streaming执行引擎也就是Driver开始运行,Driver启动的时候是位于一条新的线程中的,当然其内部有消息循环体,用于

*接受应用程序本身或者Executor中的消息;

*/

jsc.start();

jsc.awaitTermination();

jsc.close();

温馨提示:

除了 print() 方法将处理后的数据输出之外,还有其他的方法也非常重要,在开发中需要重点掌握,比如 SaveAsTextFile , SaveAsHadoopFile 等。最为重要的是 foreachRDD 方法,这个方法可以将数据写入 Redis , DB , DashBoard 等,甚至可以随意的定义数据放在哪里,功能非常强大。

二、Scala方式开发

接下来我们看看如何用非常简洁的Scala代码实现上面Java代码同样的功能。

第一步,接收数据源:

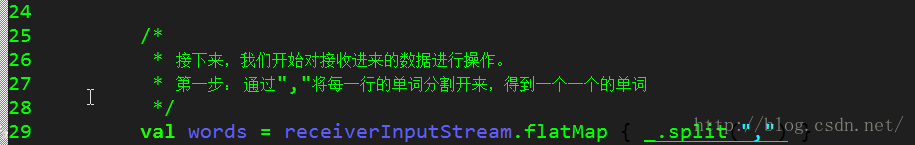

第二步,flatMap操作:

第三步,map操作:

第四步,reduceByKey操作:

第五步,print操作:

第六步,start和awaitTermination等操作:

课程笔记来源:

DT大数据梦工厂IMF传奇行动课程学员姜伟整理。YY直播永久课堂频道68917580每晚8点准时开课。

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?