序

Beautiful Soup 是一个可以从HTML或XML文件中提取数据的Python库.它能够通过你喜欢的转换器实现惯用的文档导航,查找,修改文档的方式.Beautiful Soup会帮你节省数小时甚至数天的工作时间。

Beautiful Soup支持Python标准库中的HTML解析器,还支持一些第三方的解析器,其中一个是 lxml 。

另一个可供选择的解析器是纯Python实现的 html5lib , html5lib的解析方式与浏览器相同。

Windows平台 + Python3.5

安装BeautifulSoup4

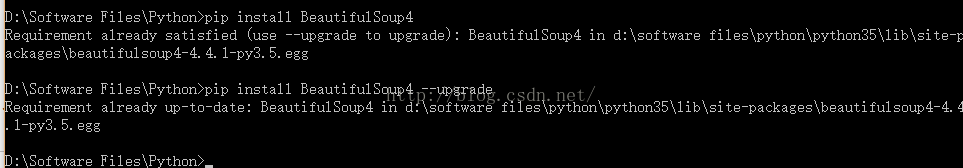

方法一:打开cmd,运行pip install BeautifulSoup4

如上图所示,由于我已经安装过了。可以使用 --upgrade来升级为最新版本。

方法二:去官网

BeautifulSoup4源码下载 -- 戳我吧!下载源码,编译运行。

这篇博客主要介绍了如何在Windows平台下,使用Python3.5进行BeautifulSoup4、html5lib和lxml的安装步骤,包括通过pip和easy_install命令进行安装。

这篇博客主要介绍了如何在Windows平台下,使用Python3.5进行BeautifulSoup4、html5lib和lxml的安装步骤,包括通过pip和easy_install命令进行安装。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

448

448

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?