一、安装pycharm

二、安装Python

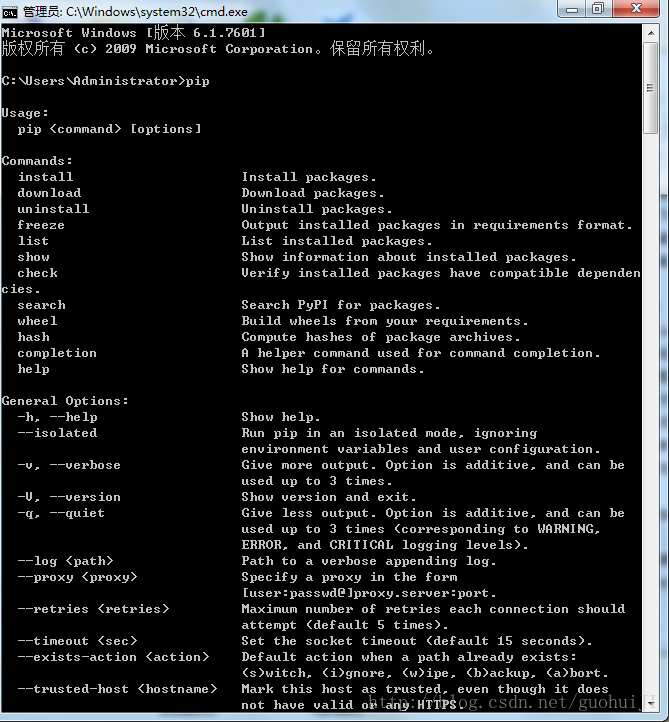

三、在Python下安装pip,如下图所示,pip安装成功

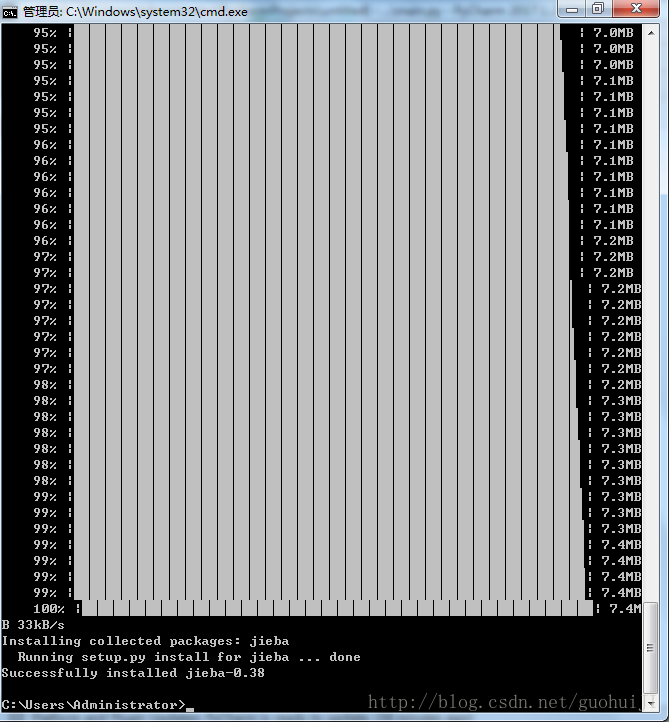

四、在python下安装jieba:

如下图所示,jieba安装成功:

五、在pycharm中新建Python项目,对test.txt文件中的中文进行分词,并写入testResult.txt文件中,具体代码如下:

#!/usr/bin/env Python

# coding=utf-8

import jieba.analyse

import jieba

import jieba.posseg as pseg

import sys

reload(sys)

sys.setdefaultencoding( "utf

本文档详细介绍了如何利用Python的jieba库进行中文分词,然后结合weka工具进行文本分类。首先,安装了pycharm、Python和pip,接着安装jieba并进行自定义词典与停词表的设置。通过代码实现将分词结果写入文件,再转换为weka可读的.arff格式。最后,在weka环境中,应用StringToWordVector过滤器并使用J48或随机森林算法进行分类。

本文档详细介绍了如何利用Python的jieba库进行中文分词,然后结合weka工具进行文本分类。首先,安装了pycharm、Python和pip,接着安装jieba并进行自定义词典与停词表的设置。通过代码实现将分词结果写入文件,再转换为weka可读的.arff格式。最后,在weka环境中,应用StringToWordVector过滤器并使用J48或随机森林算法进行分类。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9331

9331

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?