一、概述

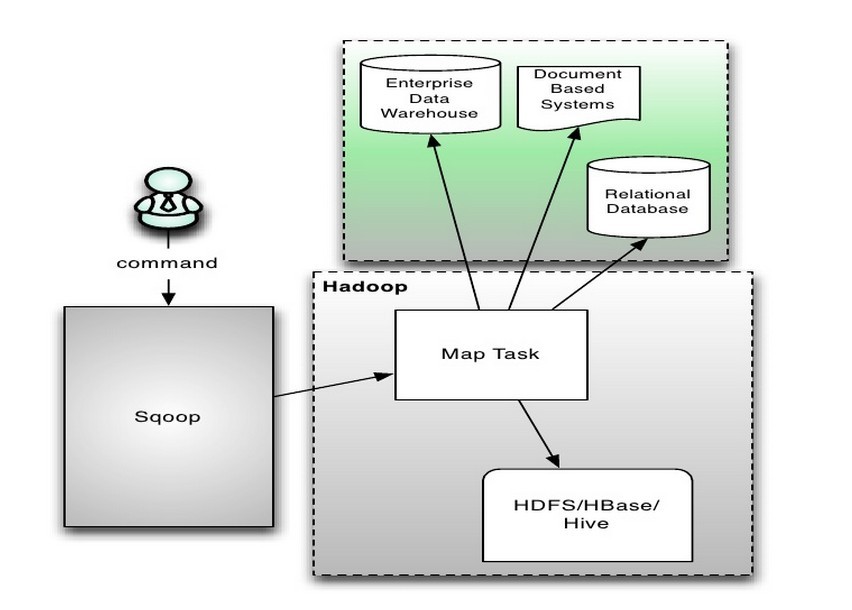

sqoop是Apache顶级项目,主要用来在Hadoop和关系数据库中传递数据。通过sqoop,我们可以方便的将数据从关系数据库导入到HDFS,或者将数据从HDFS导出到关系数据库。sqoop架构:

sqoop架构非常简单,其整合了Hive、Hbase和Oozie,通过map-reduce任务来传输数据,从而提供并发特性和容错。

sqoop主要通过JDBC和关系数据库进行交互。理论上支持JDBC的database都可以使用sqoop和hdfs进行数据交互。

但是,只有一小部分经过sqoop官方测试,如下:

| Database | version | -direct support | connect string matches |

| HSQLDB | 1.8.0+ | NO | jdbc:hsqldb:*// |

| MySQL | 5.0+ | YES | jdbc:mysql:// |

| Oracle | 10.2.0+ | NO | jdbc:oracle:*// |

| PostgreSQL | 8.3+ | YES | (import only)jdbc:postgresql:// |

二、安装配置

1、环境

操作系统:CentOS-6.3

Hadoop版本:1.2.1

Sqoop:sqoop-1.4.5.bin__hadoop-1.0.0

2、解压sqoop,配置环境变量

在/etc/profile中添加:

export $ZOOKEEPER_HOME=/usr/local/app/hadoop/zookeeper-3.4.6

<pre name="code" class="plain">export $SQOOP_HOME=/usr/local/app/hadoop/sqoop-1.4.5.bin__hadoop-1.0.0

三、工具命令

1、sqoop help可以查看相关帮助

$ sqoop help

usage: sqoop COMMAND [ARGS]

Available commands:

codegen Generate code to interact with database records

create-hive-table Import a table definition into Hive

eval Evaluate a SQL statement and display the results

export Export an HDFS directory to a database table

help List available commands

import Import a table from a database to HDFS

import-all-tables Import tables from a database to HDFS

job Work with saved jobs

list-databases List available databases on a server

list-tables List available tables in a database

merge Merge results of incremental imports

metastore Run a standalone Sqoop metastore

version Display version information

See 'sqoop help COMMAND' for information on a specific command.2、list-tables查看表

$ sqoop list-tables --connect jdbc:mysql://127.0.0.1/test --username root --password 123456

a

t13、import

sqoop 数据导入具有以下特点:

1)支持文本文件(--as-textfile)、avro(--as-avrodatafile)、SequenceFiles(--as-sequencefile)。 RCFILE暂未支持,默认为文本

2)支持数据追加,通过--apend指定

3)支持table列选取(--column),支持数据选取(--where),和--table一起使用

4)支持数据选取,例如读入多表join后的数据'SELECT a.*, b.* FROM a JOIN b on (a.id == b.id) ‘,不可以和--table同时使用

5)支持map数定制(-m)

6)支持压缩(--compress)

7)支持将关系数据库中的数据导入到Hive(--hive-import)、HBase(--hbase-table)

示例:

1)MySQL数据库内容:

mysql> select * from a;

+------+--------+

| key1 | value1 |

+------+--------+

| 1 | a1 |

| 2 | a2 |

| 3 | a3 |

| 4 | a4 |

| 5 | a5 |

| 6 | a6 |

| 7 | a7 |

| 8 | a8 |

| 9 | a9 |

+------+--------+$ sqoop --options-file a.conf import

--append

-m 3

--connect jdbc:mysql://127.0.0.1/test

--username root

--password 123456

--table a

--target-dir /tmp/a

--columns key1

--where 'key1>3'$ hadoop fs -ls /tmp/a/

Found 3 items

-rw-r--r-- 1 work supergroup 4 2013-03-21 23:08 /tmp/a/part-m-00000

-rw-r--r-- 1 work supergroup 4 2013-03-21 23:08 /tmp/a/part-m-00001

-rw-r--r-- 1 work supergroup 4 2013-03-21 23:08 /tmp/a/part-m-00002 $ hadoop fs -cat /tmp/a/*

4

5

6

7

8

9

4、Export

sqoop export 能将HDFS上的文件导出到关系数据库。其工作原理是根据用户指定的分隔符(字段分隔符:--fields-terminated-by)读入并解析数据,然后转换成insert/update语句导入数据到关系数据库。

1)支持将数据导出到表(--table)或者调用存储过程(--call)

3)支持并发控制(-m)

示例:

1)查看HDFS上的数据

$ hadoop fs -cat /tmp/b/*

1,a

2,b

3,c$ sqoop export --connect jdbc:mysql://127.0.0.1/test --table b -username root -password 123456 --export-dir /tmp/bmysql> select * from b;

+------+--------+

| key1 | value1 |

+------+--------+

| 1 | a |

| 2 | b |

| 3 | c |

+------+--------+四、其它

1. 通过使用map-reduce,sqoop提供了良好的并发性和容错,可以作为 异构数据库同步工具。2. Sqoop虽然支持Hive、HBase,但并不完整,某些场景下数据传输后的加工不可避免

3. 大数据传输,也许可以使用--direct

转自:http://blog.csdn.net/yfkiss/article/details/8700480

参考:

sqoop是一款由Apache顶级项目支持的工具,专为在Hadoop和关系数据库间传输数据而设计。本文详细介绍了sqoop的架构、安装配置、工具命令以及使用示例,包括数据导入和导出的功能特性。

sqoop是一款由Apache顶级项目支持的工具,专为在Hadoop和关系数据库间传输数据而设计。本文详细介绍了sqoop的架构、安装配置、工具命令以及使用示例,包括数据导入和导出的功能特性。

1459

1459

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?