使用IntelliJ IDEA编写Scala在Spark中运行

环境说明:hadoop-2.2.0+spark-1.1.0

hadoop是完全分布式,spark是standalone。在master节点master1上安装了IntelliJ IDEA。

1、开启spark

进入到spark的sbin目录,./start-all.sh命令开启spark。

注意:因为演示的是SparkPi demo,无需从hdfs读取数据,所以没有启动hadoop。可以根据需要启动hadoop。

2、在IntelliJ IDEA中新建SparkTest工程

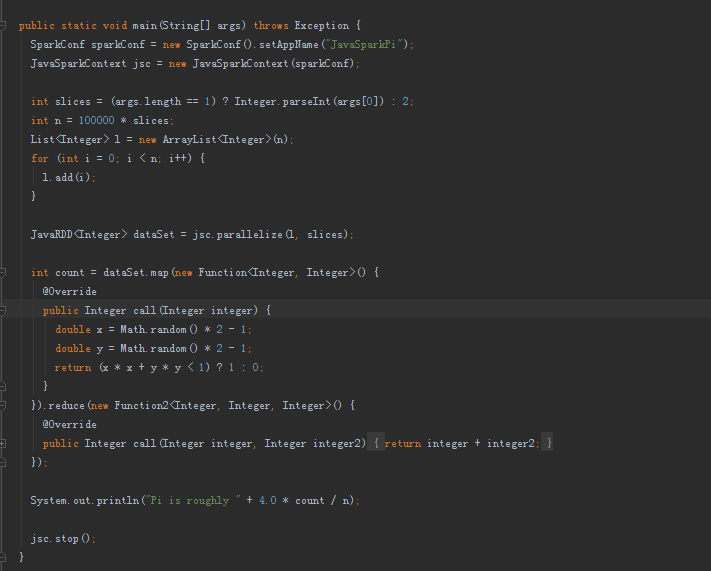

将spark提供的SparkPi.scala文件中的内容拷贝到工程中(package语句除外)如下图所示。

2.1、在工程中引入spark-assembly-1.1.0-hadoop2.2.0.jar

“File”->”Project Structure”->”Libraries”->绿色加号->”java”,在弹出页面中到spark/lib目录下找到spark-assembly-1.1.0-hadoop2.2.0.jar,”OK”。如下图所示

本文详细介绍了如何在IntelliJ IDEA中创建一个SparkTest工程,使用Scala编写SparkPi程序,并连接到Spark standalone集群进行运行。通过开启Spark,引入依赖,修改代码,打包JAR以及配置运行参数,最终成功运行程序并获取结果。

本文详细介绍了如何在IntelliJ IDEA中创建一个SparkTest工程,使用Scala编写SparkPi程序,并连接到Spark standalone集群进行运行。通过开启Spark,引入依赖,修改代码,打包JAR以及配置运行参数,最终成功运行程序并获取结果。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5458

5458

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?