转载:点击打开链接

1、 概念说明

首先需要理解几个概念:

(1)用户空间、内核空间

(2)进程切换

(3)进程的阻塞

(4)文件描述符fd

(5)缓存 I/O

1.1 用户空间与内核空间

现在操作系统都是采用虚拟存储器,那么对32位操作系统而言,它的寻址空间(虚拟存储空间)为4G(2的32次方)。操作系统的核心是内核,独立于普通的应用程序,可以访问受保护的内存空间,也有访问底层硬件设备的所有权限。为了保证用户进程不能直接操作内核(kernel),保证内核的安全,

操作系统将虚拟空间划分为两部分,一部分为内核空间,一部分为用户空间

。针对linux操作系统而言,将最高的1G字节(从虚拟地址0xC0000000到0xFFFFFFFF),供内核使用,称为内核空间,而将较低的3G字节(从虚拟地址0x00000000到0xBFFFFFFF),供各个进程使用,称为用户空间。

1.2 进程切换

为了控制进程的执行,内核必须有能力挂起正在CPU上运行的进程,并恢复以前挂起的某个进程的执行。这种行为被称为

进程切换

。因此可以说,任何进程都是在操作系统内核的支持下运行的,是与内核紧密相关的。

从一个进程的运行转到另一个进程上运行,这个过程中经过下面这些变化:

(1)保存处理机上下文,包括程序计数器和其他寄存器。

(2)更新PCB信息。

(3)把进程的PCB移入相应的队列,如就绪、在某事件阻塞等队列。

(4)选择另一个进程执行,并更新其PCB。

(5)更新内存管理的数据结构。

(6)恢复处理机上下文。

1.3 进程的阻塞

正在执行的进程,由于期待的某些事件未发生,

如请求系统资源失败、等待某种操作的完成、新数据尚未到达或无新工作做等

,则由系统自动执行阻塞原语(Block),使自己由运行状态变为阻塞状态。可见,进程的阻塞是进程自身的一种主动行为,也因此只有处于运行态的进程(获得CPU),才可能将其转为阻塞状态。当进程进入阻塞状态,是不占用CPU资源的。

1.4 文件描述符fd

文件描述符(File descriptor)是一个用于表述

指向的文件的引用

的抽象化概念。

文件描述符在形式上是一个

非负整数

。实际上,它是一个索引值,指向内核为每一个进程所维护的该进程打开文件的记录表。

当程序打开一个现有文件或者创建一个新文件时,内核向进程返回一个文件描述符。

1.5 缓存 I/O

缓存 I/O 又被称作标准 I/O,

大多数文件系统的默认 I/O 操作都是缓存 I/O

。在 Linux 的缓存 I/O 机制中,操作系统会将 I/O 的数据缓存在文件系统的

页缓存

( page cache )中,也就是说,

数据会先被拷贝到操作系统内核的缓冲区中,然后才会从操作系统内核的缓冲区拷贝到应用程序的地址空间。

缓存 I/O 的缺点:

数据在传输过程中需要在应用程序地址空间和内核进行多次数据拷贝操作,这些数据拷贝操作所带来的 CPU 以及内存开销是非常大的。

2、I/O模式

2.1 同步(Sync)/异步(Async)、阻塞(Block)/非阻塞(NonBlock)

在进行网络编程时,我们常常见到四中调用方式:

(1)同步(Sync)

(2)异步(Async)

(3)阻塞(Block)

(4)非阻塞(NonBlock)

同步:

在发出一个功能调用时,在没有得到结果之前,该调用就不返回。

也就是说必须一件事一件事的做,等前一件事做完了才能做下一件事。

例如普通B/S模式(同步):提交请求

->

等待服务器处理

->

处理完毕返回

(这个期间客户端浏览器不能干任何事)

异步:

异步的概念和同步相对。

当一个异步过程调用发出后,调用者不能立刻得到结果。实际处理这个调用的部件在完成后,通过状态、通知和回调来通知调用者。

例如 ajax请求(异步): 请求通过事件触发

->

服务器处理(这个时候浏览器仍然可以干其他事情)

->

处理完毕

阻塞:

阻塞调用是指调用结果返回之前,当前线程会被挂起

(线程进入非可执行状态,在这个状态下,cpu不会给线程分配时间片,即线程暂停运行)。函数只有在得到结果之后才会将阻塞的线程激活。

非阻塞:

非阻塞和阻塞的概念相对应。

指在不能立刻得到结果之前,该函数不会阻塞当前线程,而会立刻返回。

总结:

同步和异步针对的是

功能函数调用

(数据拷贝过程)。

(1)同步,就是我调用一个功能,该功能没有结束前,我死等结果。

(2)异步,就是我调用一个功能,不需要立即知道该功能的结果,该功能有结果后通知我(回调通知)。

阻塞和非阻塞针对的是

进程或者线程

(I/O请求)。

(1)阻塞,线程调用一个函数,在还没有得到结果之前,线程会被挂起。

(2)非阻塞,线程调用一个函数,不会挂起线程,立即返回,之后通过select通知调用者。

2.2 I/O模型

对于一次IO访问(以read举例),数据会先被拷贝到操作系统内核的缓冲区中,然后才会从操作系统内核的缓冲区拷贝到应用程序的地址空间。

所以说,当一个read操作发生时,它会经历

两个阶段

:

(1)等待数据准备 (Waiting for the data to be ready)

(2) 将数据从内核拷贝到进程中 (Copying the data from the kernel to the process)

正式因为这两个阶段,linux系统产生了下面

五种网络模式

:

(1)阻塞 I/O(blocking IO)

(2)非阻塞 I/O(nonblocking IO)

(3)I/O 多路复用( IO multiplexing)

(4)信号驱动 I/O( signal driven IO)

(5)异步 I/O(asynchronous IO)

注:由于signal driven IO在实际中并不常用,所以这里只提及剩下的四种 IO 模型。

前四种都是同步I/O,只有最后一种才是异步I/O

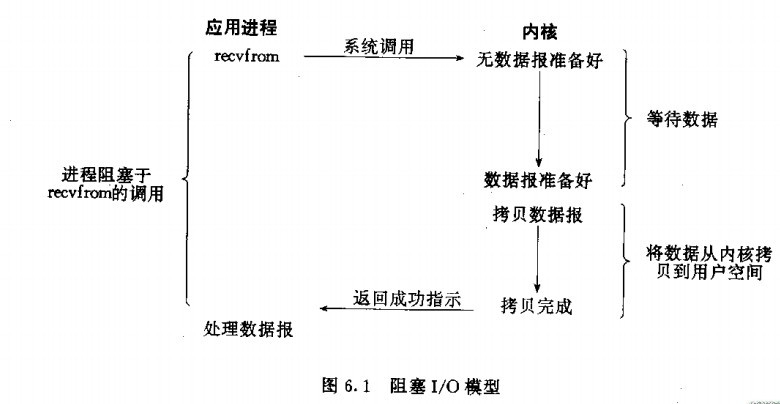

2.2.1 阻塞 I/O

当用户进程调用了recvfrom这个系统调用,kernel(内核)就开始了IO的第一个阶段:准备数据(对于网络IO来说,很多时候数据在一开始还没有到达。比如,还没有收到一个完整的UDP包。这个时候kernel就要等待足够的数据到来)。这个过程需要等待,也就是说数据被拷贝到操作系统内核的缓冲区中是需要一个过程的。而在用户进程这边,

整个进程会被阻塞

(当然,是进程自己选择的阻塞)。当kernel直到到数据准备好了,它就会将数据从kernel中拷贝到用户内存,然后kernel返回结果,用户进程才解除阻塞的状态,重新运行起来。

所以,阻塞 IO 的特点就是在IO执行的两个阶段 进程一直被阻塞。

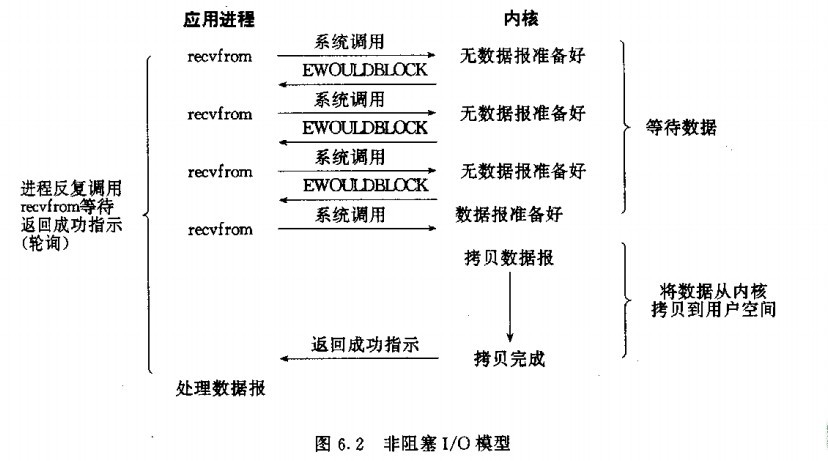

2.2.2 非阻塞 I/O

当用户进程发出read操作时,如果kernel中的数据还没有准备好,那么它并不会block用户进程,而是立刻返回一个error。从用户进程角度讲,它发起一个read操作后,并不需要等待,而是马上就得到了一个结果,只是这个结果并不一定是期望的结果。用户进程判断结果是一个error时,它就知道数据还没有准备好,于是它可以再次发送read操作。一旦kernel中的数据准备好了(第一个阶段已经完成),并且又再次收到了用户进程的system call(系统调用),那么它马上就将数据拷贝到了用户内存,然后返回。

所以,非阻塞 IO 的特点是用户进程需要不断的主动询问kernel数据好了没有。

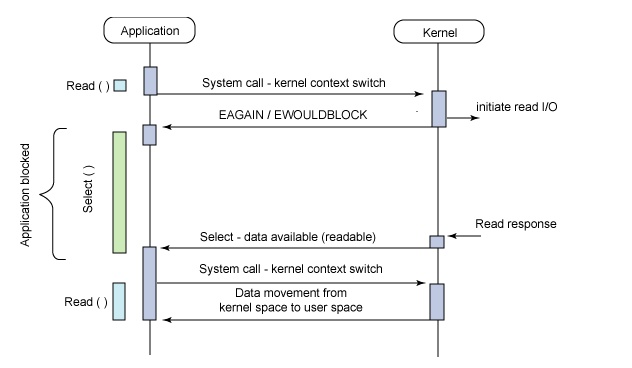

2.2.3 I/O 多路复用 ( IO multiplexing)

IO多路复用(IO multiplexing)就是我们说的select,poll,epoll,有些地方也称这种IO方式为 事件驱动IO(event driven IO)。

select/epoll的好处就在于单个进程就可以同时处理多个网络连接的IO。它的基本原理就是select,poll,epoll这个function会不断的

轮询

所负责的所有socket,当某个socket的数据准备好了可以读取了,就通知用户进程来取数据。

当用户进程调用了select,那么整个进程会被

阻塞

,而同时,kernel会“监视”所有select负责的socket,当任何一个socket中的数据准备好了,select就会返回。这个时候用户进程再调用read操作,将数据从kernel拷贝到用户进程。

所以,I/O 多路复用的特点是通过一种机制让一个进程能同时等待多个文件描述符,而这些文件描述符(套接字描述符)其中的任意一个进入读就绪状态,select()函数就可以返回。

这个图和blocking IO的图其实并没有太大的不同,事实上,还更差一些。因为这里需要使用两个system call (select 和 recvfrom),而blocking IO只调用了一个system call (recvfrom)。

但是,用select的优势在于它可以同时处理多个connection。

(所以,如果处理的连接数不是很高的话,使用select/epoll的web server不一定比使用多线程 + 阻塞IO 的web server性能更好,可能延迟还更大。select/epoll的优势并不是对于单个连接能处理得更快,而是在于能处理更多的连接。)

在IO multiplexing Model中,实际中,对于每一个socket,一般都设置成为non-blocking,但是,如上图所示,整个用户的进程其实是一直被block的。只不过进程是被select这个函数block,而不是被socket IO给block。

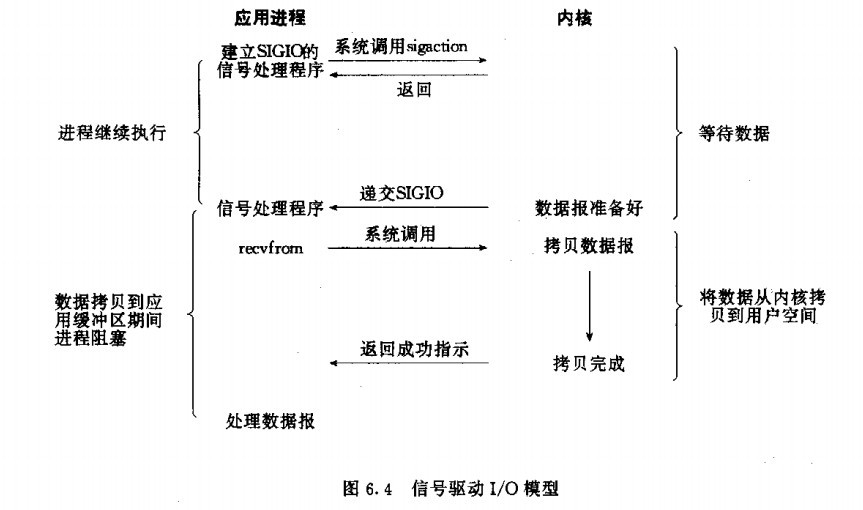

2.2.4 信号驱动 I/O

我们也可以用信号,让内核在描述符就绪时发送SIGIO信号给我们。这种模型称为

信号驱动式I/O

(signal-driven I/O)。

我们首先开启套接字的信号驱动式I/O功能,并通过sigaction系统调用安装一个信号处理函数。该系统调用将立即返回,我们的进程继续工作, 也就是说它没有被阻塞。当数据报准备好读写时,内核就为该进程产生一个SIGIO信号。我们随后既可以在信号处理函数中调用recvfrom读取数据报,并通知主循环数据已准备好待处理,也可以立即通知主循环,让它读取数据报。

无论如何处理SIGIO信号,

这种模型的优势在于等待数据报到达期间进程不被阻塞。

主循环可以继续执行,只要等待来自信号处理函数的通知:既可以是数据已准备好被处理,也可以是数据报已准备好被读取。

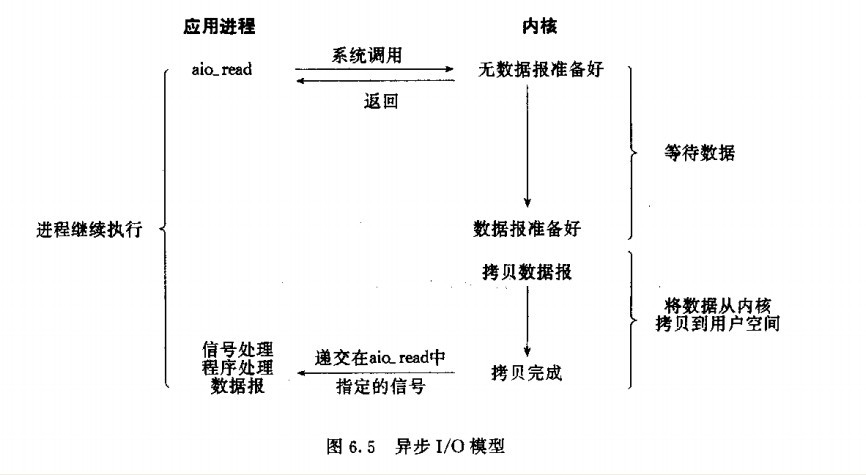

2.2.5 异步 I/O

异步I/O(asynchronous I/O)由POSIX规范定义。一般来说,用于实现异步I/O的函数的工作机制是:告知内核启动某个操作,并让内核在整个操作(包括两个阶段的任务)

完成后

通知我们。这种模型与前面介绍的信号驱动模型的主要区别在于:信号驱动式I/O是由内核通知我们何时可以启动一个I/O操作,而异步I/O模型是由内核通知我们I/O操作何时完成。

总结:

通过上面的图片,可以发现

非阻塞 IO

和

异步 IO

的区别还是很明显的。

在non-blocking IO中,虽然进程大部分时间都不会被block,但是它仍然要求进程去主动的check,并且当数据准备完成以后,也需要进程主动的再次调用recvfrom来将数据拷贝到用户内存。

而asynchronous IO则完全不同。它就像是用户进程将整个IO操作(两个阶段的事情)交给了他人(kernel)完成,然后他人做完后发信号通知。在此期间,用户进程不需要去检查IO操作的状态,也不需要主动的去拷贝数据。

3、I/O 多路复用之select、poll、epoll详解

select,poll,epoll都是IO多路复用的机制

。

I/O多路复用就是通过一种机制,一个进程可以监视多个描述符,一旦某个描述符就绪(一般是读就绪或者写就绪),能够通知程序进行相应的读写操作。

但select,poll,epoll本质上都是同步I/O,因为他们都需要在读写事件就绪后自己负责进行读写,也就是说这个读写过程是阻塞的,而异步I/O则无需自己负责进行读写,异步I/O的实现会负责把数据从内核拷贝到用户空间。

3.1 select

int select (int n, fd_set *readfds, fd_set *writefds, fd_set *exceptfds, struct timeval *timeout);

select调用过程图:

select 函数监视的文件描述符分

3类

,分别是writefds、readfds、和exceptfds。调用后select函数会

阻塞

,直到有描述符就绪(有数据 可读、可写、或者有except),或者超时(timeout指定等待时间,如果立即返回设为null即可),函数返回。当select函数返回后,可以通过遍历fdset,来找到就绪的描述符。

select目前几乎在所有的平台上得到了支持,其良好跨平台支持也是它的一个优点。 select的几大

缺点

:

(1)每次调用select,都需要把fd集合从用户态拷贝到内核态,这个开销在fd很多时会很大。

(2)同时每次调用select都需要在内核遍历传递进来的

所有fd

,这个开销在fd很多时也很大。

(3)select支持的文件描述符数量太小了,默认是1024。

3.2 poll

int poll (struct pollfd *fds, unsigned int nfds,int timeout);

poll的实现和select非常相似,只是描述fd集合的方式不同,poll使用pollfd结构而不是select的fd_set结构,其他的都差不多。

struct pollfd {

int fd; /* file descriptor */

short events; /* requested events to watch */

short revents; /* returned events witnessed */

};

pollfd结构包含了要监视的event和发生的event,不再使用select“参数-值”传递的方式。同时,pollfd并没有最大数量限制(但是数量过大后性能也是会下降)。 和select函数一样,poll返回后,需要

轮询

pollfd来获取就绪的描述符。

从上面看,select和poll都需要在返回后,

通过遍历文件描述符来获取已经就绪的socket

。事实上,同时连接的大量客户端在一时刻可能只有很少的处于就绪状态,因此随着监视的描述符数量的增长,其效率也会线性下降。

3.3 epoll

epoll是在2.6内核中提出的,是之前的select和poll的增强版本。

相对于select和poll来说,epoll更加灵活,没有描述符限制。

epoll使用一个文件描述符管理多个描述符,将用户关系的文件描述符的事件存放到内核的一个事件表中,这样在用户空间和内核空间的copy只需一次。

3.3.1 epoll操作过程

epoll操作过程需要三个接口,分别如下:

int epoll_create(int size);

int epoll_ctl(int epfd, int op, int fd, struct epoll_event *event);

int epoll_wait(int epfd, struct epoll_event * events, int maxevents, int timeout);

1. int epoll_create(int size);

创建一个epoll的句柄,size用来告诉内核这个监听的数目一共有多大

,这个参数不同于select()中的第一个参数,给出最大监听的fd+1的值,参数size并不是限制了epoll所能监听的描述符最大个数,只是对内核初始分配内部数据结构的一个建议。

当创建好epoll句柄后,它就会占用一个fd值,在linux下如果查看/proc/进程id/fd/,是能够看到这个fd的,所以在使用完epoll后,必须调用close()关闭,否则可能导致fd被耗尽。

2. int epoll_ctl(int epfd, int op, int fd, struct epoll_event *event);

这个函数是对指定描述符fd执行op操作。

epfd:

是epoll_create()的返回值。

op:

表示op操作,用三个宏来表示:

(1)添加 EPOLL_CTL_ADD;

(2)删除

EPOLL_CTL_DEL;

(3)修改 EPOLL_CTL_MOD。

分别添加、删除和修改对fd的监

听事件。

fd:

是需要监听的fd(文件描述符)

epoll_event:

是告诉内核需要监听什么事,struct epoll_event 结构如下:

struct epoll_event {

__uint32_t events; /* Epoll events */

epoll_data_t data; /* User data variable */

};

//events可以是以下几个宏的集合:

EPOLLIN :表示对应的文件描述符可以读(包括对端SOCKET正常关闭);

EPOLLOUT:表示对应的文件描述符可以写;

EPOLLPRI:表示对应的文件描述符有紧急的数据可读(这里应该表示有带外数据到来);

EPOLLERR:表示对应的文件描述符发生错误;

EPOLLHUP:表示对应的文件描述符被挂断;

EPOLLET: 将EPOLL设为边缘触发(Edge Triggered)模式,这是相对于水平触发(Level Triggered)来说的。

EPOLLONESHOT:只监听一次事件,当监听完这次事件之后,如果还需要继续监听这个socket的话,

需要再次把这个socket加入到EPOLL队列里

3. int epoll_wait(int epfd, struct epoll_event * events, int maxevents, int timeout);

等待epfd上的io事件,最多返回maxevents个事件。

参数events用来从内核得到事件的集合,maxevents告之内核这个events有多大,这个maxevents的值不能大于创建epoll_create()时的size,参数timeout是超时时间(毫秒,0会立即返回,-1将不确定,也有说法说是永久阻塞)。该函数返回需要处理的事件数目,如返回0表示已超时。

3.3.2 epoll工作模式

epoll对文件描述符的操作有两种模式:LT(level trigger)和ET(edge trigger)。LT模式是默认模式,LT模式与ET模式的区别如下:

LT模式:当epoll_wait检测到描述符事件发生并将此事件通知应用程序,应用程序可以不立即处理该事件。下次调用epoll_wait时,会再次响应应用程序并通知此事件。

ET模式:当epoll_wait检测到描述符事件发生并将此事件通知应用程序,应用程序必须立即处理该事件。如果不处理,下次调用epoll_wait时,不会再次响应应用程序并通知此事件。

(1)LT模式

LT(level triggered)是缺省的工作方式,并且同时支持block和no-block socket。在这种做法中,内核告诉你一个文件描述符是否就绪了,然后你可以对这个就绪的fd进行IO操作。如果你不作任何操作,内核还是会继续通知你。

(2)ET模式

ET(edge-triggered)是高速工作方式,只支持no-block socket。在这种模式下,当描述符从未就绪变为就绪时,内核通过epoll告诉你。然后它会假设你知道文件描述符已经就绪,并且不会再为那个文件描述符发送更多的就绪通知,直到你做了某些操作导致那个文件描述符不再为就绪状态了(比如,你在发送,接收或者接收请求,或者发送接收的数据少于一定量时导致了一个EWOULDBLOCK 错误)。但是请注意,如果一直不对这个fd作IO操作(从而导致它再次变成未就绪),内核不会发送更多的通知(only once)。

ET模式在很大程度上减少了epoll事件被重复触发的次数,因此效率要比LT模式高。epoll工作在ET模式的时候,必须使用非阻塞套接口,以避免由于一个文件句柄的阻塞读/阻塞写操作把处理多个文件描述符的任务饿死。

3.3.3 epoll用法的代码演示

下面是一段不完整的代码且格式不对,意在表述上面的过程,去掉了一些模板代码。

#define IPADDRESS "127.0.0.1"

#define PORT 8787

#define MAXSIZE 1024

#define LISTENQ 5

#define FDSIZE 1000

#define EPOLLEVENTS 100

listenfd = socket_bind(IPADDRESS,PORT);

struct epoll_event events[EPOLLEVENTS];

//创建一个描述符

epollfd = epoll_create(FDSIZE);

//添加监听描述符事件

add_event(epollfd,listenfd,EPOLLIN);

//循环等待

for ( ; ; ){

//该函数返回已经准备好的描述符事件数目

ret = epoll_wait(epollfd,events,EPOLLEVENTS,-1);

//处理接收到的连接

handle_events(epollfd,events,ret,listenfd,buf);

}

//事件处理函数

static void handle_events(int epollfd,struct epoll_event *events,int num,int listenfd,char *buf)

{

int i;

int fd;

//进行遍历;这里只要遍历已经准备好的io事件。num并不是当初epoll_create时的FDSIZE。

for (i = 0;i < num;i++)

{

fd = events[i].data.fd;

//根据描述符的类型和事件类型进行处理

if ((fd == listenfd) &&(events[i].events & EPOLLIN))

handle_accpet(epollfd,listenfd);

else if (events[i].events & EPOLLIN)

do_read(epollfd,fd,buf);

else if (events[i].events & EPOLLOUT)

do_write(epollfd,fd,buf);

}

}

//添加事件

static void add_event(int epollfd,int fd,int state){

struct epoll_event ev;

ev.events = state;

ev.data.fd = fd;

epoll_ctl(epollfd,EPOLL_CTL_ADD,fd,&ev);

}

//处理接收到的连接

static void handle_accpet(int epollfd,int listenfd){

int clifd;

struct sockaddr_in cliaddr;

socklen_t cliaddrlen;

clifd = accept(listenfd,(struct sockaddr*)&cliaddr,&cliaddrlen);

if (clifd == -1)

perror("accpet error:");

else {

printf("accept a new client: %s:%d\n",inet_ntoa(cliaddr.sin_addr),cliaddr.sin_port); //添加一个客户描述符和事件

add_event(epollfd,clifd,EPOLLIN);

}

}

//读处理

static void do_read(int epollfd,int fd,char *buf){

int nread;

nread = read(fd,buf,MAXSIZE);

if (nread == -1) {

perror("read error:");

close(fd); //记住close fd

delete_event(epollfd,fd,EPOLLIN); //删除监听

}

else if (nread == 0) {

fprintf(stderr,"client close.\n");

close(fd); //记住close fd

delete_event(epollfd,fd,EPOLLIN); //删除监听

}

else {

printf("read message is : %s",buf);

//修改描述符对应的事件,由读改为写

modify_event(epollfd,fd,EPOLLOUT);

}

}

//写处理

static void do_write(int epollfd,int fd,char *buf) {

int nwrite;

nwrite = write(fd,buf,strlen(buf));

if (nwrite == -1){

perror("write error:");

close(fd); //记住close fd

delete_event(epollfd,fd,EPOLLOUT); //删除监听

}else{

modify_event(epollfd,fd,EPOLLIN);

}

memset(buf,0,MAXSIZE);

}

//删除事件

static void delete_event(int epollfd,int fd,int state) {

struct epoll_event ev;

ev.events = state;

ev.data.fd = fd;

epoll_ctl(epollfd,EPOLL_CTL_DEL,fd,&ev);

}

//修改事件

static void modify_event(int epollfd,int fd,int state){

struct epoll_event ev;

ev.events = state;

ev.data.fd = fd;

epoll_ctl(epollfd,EPOLL_CTL_MOD,fd,&ev);

}

3.3.4 epoll总结

在 select/poll中,进程只有在调用一定的方法后,内核才对所有监视的文件描述符进行扫描,

而epoll事先通过epoll_ctl()来注册一 个文件描述符,一旦基于某个文件描述符就绪时,内核会采用类似callback的回调机制,迅速激活这个文件描述符,当进程调用epoll_wait() 时便得到通知。

(此处去掉了遍历文件描述符,而是通过监听回调的的机制。这正是epoll的魅力所在。)

epoll的优点主要是一下几个方面:

(1)监听的文件描述符数量不受限制,它所支持的FD上限是最大可以打开文件的数目,这个数字一般远大于2048。

举个例子,在1GB内存的机器上大约是10万左右,具体数目可以cat /proc/sys/fs/file-max察看,一般来说这个数目和系统内存关系很大。select的最大缺点就是进程打开的fd是有数量限制的。这对于连接数量比较大的服务器来说根本不能满足。虽然也可以选择多进程的解决方案( Apache就是这样实现的),不过虽然linux上面创建进程的代价比较小,但仍旧是不可忽视的,加上进程间数据同步远比不上线程间同步的高效,所以也不是一种完美的方案。

(2)IO的效率不会随着监视fd的数量的增长而下降。

epoll不同于select和poll轮询的方式,而是通过每个fd定义的

回调函数

来实现的。只有就绪的fd才会执行回调函数。

如果没有大量的idle -connection或者dead-connection,epoll的效率并不会比select/poll高很多,但是当遇到大量的idle- connection,就会发现epoll的效率大大高于select/poll。

295

295

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?