在看这里

https://www.bilibili.com/video/av6731067/index_9.html#page=10 时有一个疑问没有想明白,就是当说通过函数不能从一条直线“解压缩”出来一个平面时,对“函数”的要求是:它能将一个单独的向量变换为一整条线的向量。

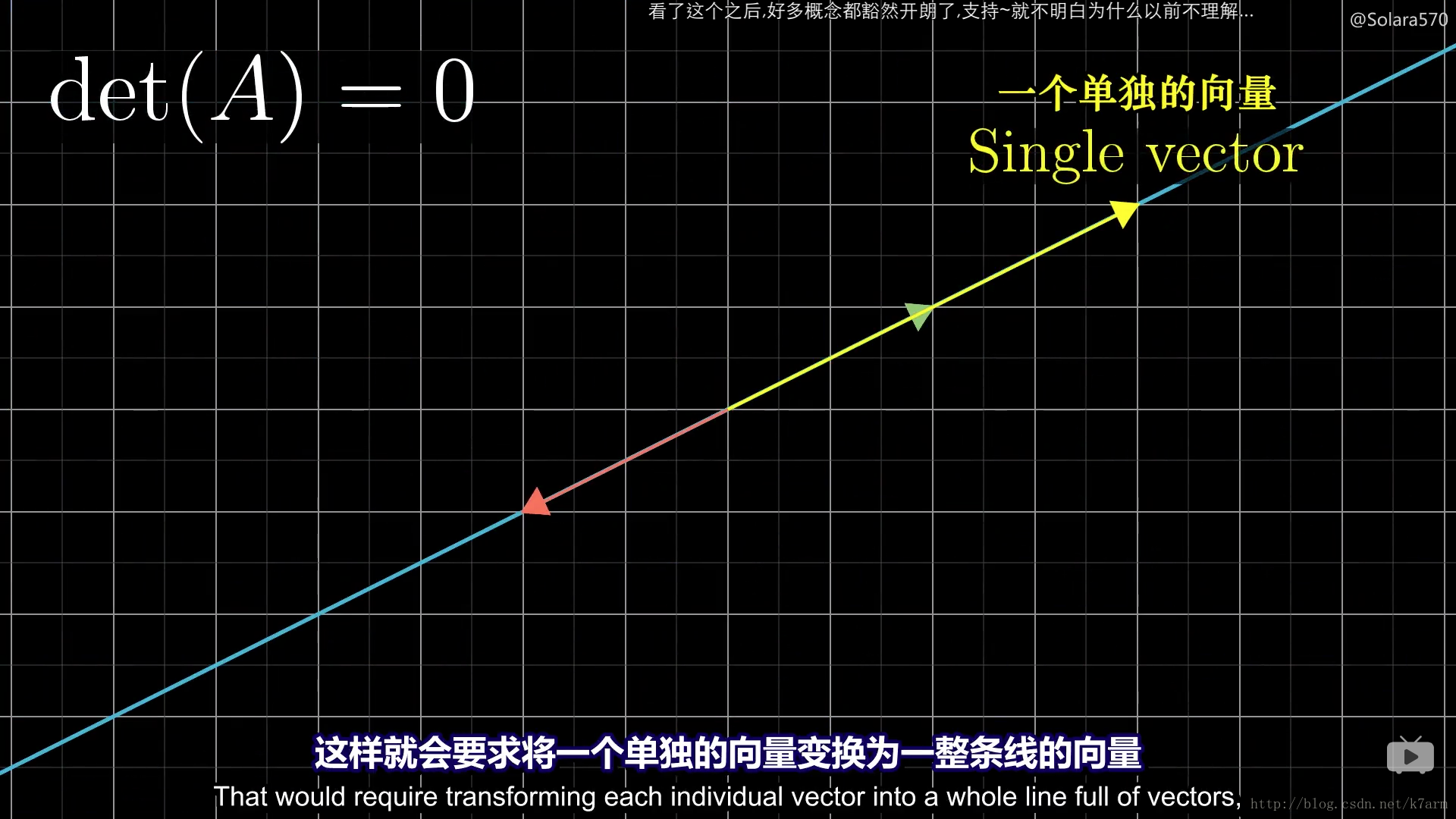

图1 变换为一条之后的情况

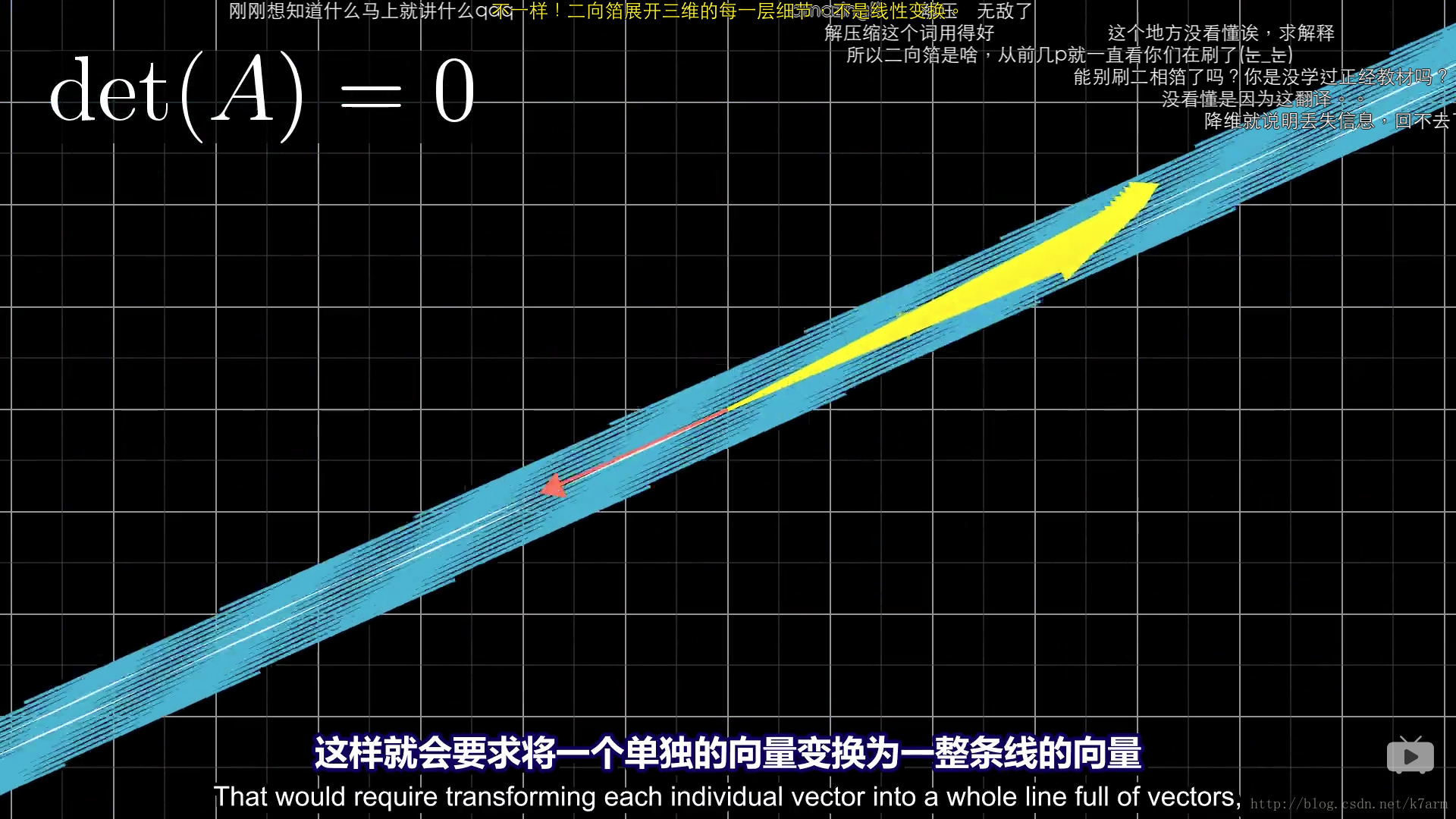

图2 企图从一条线“解压”出来一个平面

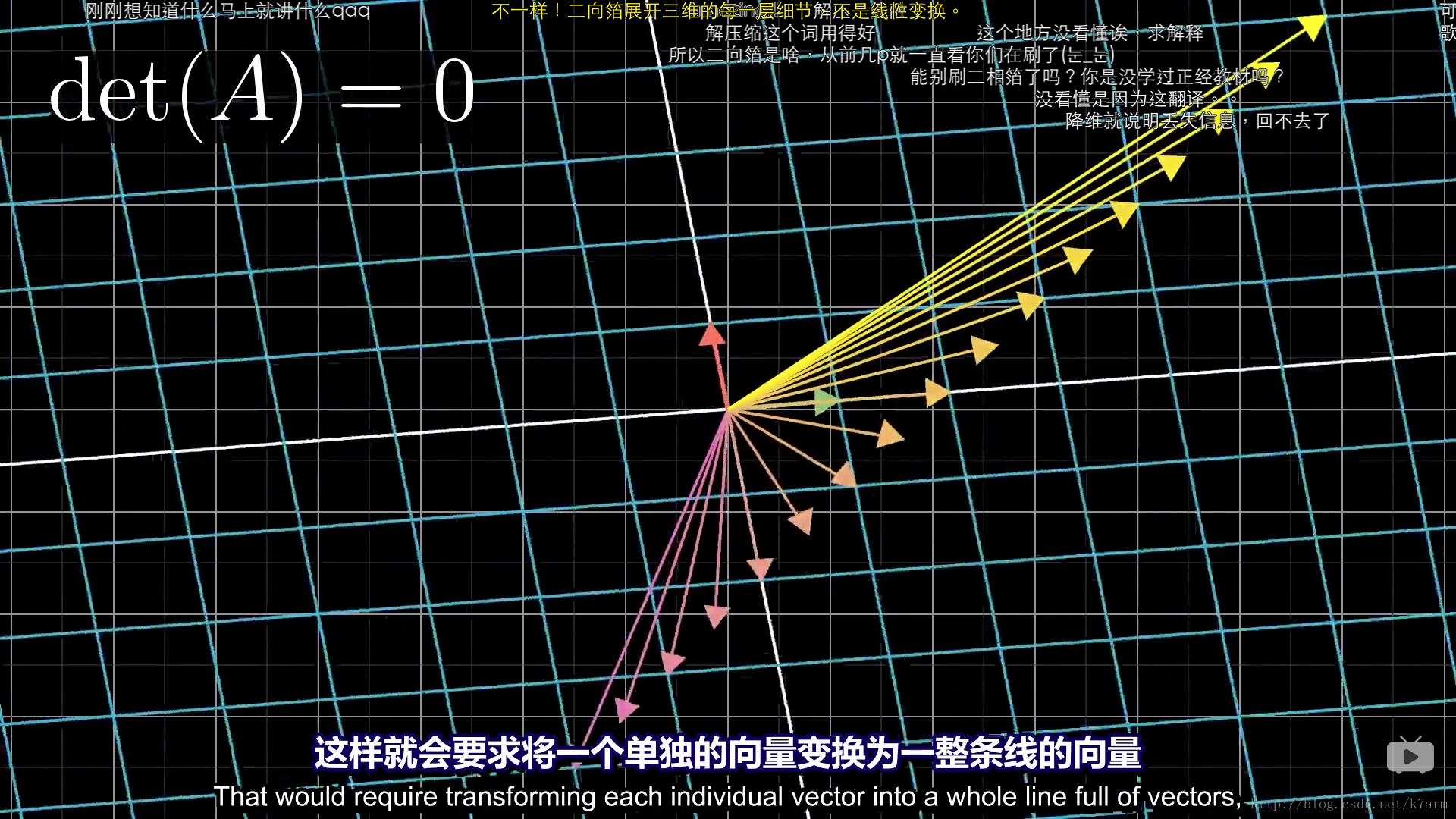

图3 继续企图变换成平面

首先明确一下,上面的3个图是为了解释假设能从一条线解压出来一个平面所经历的过程。

实际上是无法从第1个图变换到第3个图的。

这句翻译后的中文怎么看都是似懂非懂的,什么叫将一个单独的向量变换为一整条线的向量?一个单独的向量还勉强可以理解,就是一个向量嘛,说他单独不单独什么意思呢?就是单个的,跟其他向量没有关系的,最简单的示例就是在空间中只画一个向量v就完事了。关键是后面的那句一整条线的向量,啥叫一整条线的向量?连蒙带猜的理解是,有很多很多很多的向量,以至于它们都能组成一条线了,是这个意思吗?理解起来太费劲了。突然瞥了一眼下面的英文原句,卧槽,瞬间开朗了。首先,原句分明说的是:each individual vector,按我的理解,each individual这个强调的应该是”每一个”这层意思,而不是“一个单独”,这差别可就大了。再看后面的“一整条线的向量”的原句:a whole line full of vectors.这咋理解?由向量组成的线。

写到这里的时候,我觉得我明白了作者的意思,但是我也不能很好的表达出来它的意思。于是我想了一个例子。比如我去医院看完病拿药,医生给开了好几样的药,它们的外观看起来是一样的,但是每种药的包装上都有说明来描述药名和吃法,所以我能很好的区分它们。这里的药名,药片的数量和吃法就可以看做是每种药的向量,表示3个属性的信息,可以看做是3维的。然后我准备回家,这里还有一个问题,就是我没有带书包,这一大堆的药我怎么带回去呢?于是故作聪明的我想到了一个办法,就是把这些药片的包装都拆开扔掉,只拿药片就行了。于是就这么干了。到了家发现,由于它们长得都一样,我不知道该怎么区分它们,也不知道该怎么吃了。因为可以区分他们的外包装让我给扔了,怎么吃的方法也在外包装上,一块儿都给扔了。最后只剩下什么?只剩下一堆药片了。你能说,你看看这些药片就能告诉我每一片药叫什么,怎么吃吗?是的,你不能,你唯一能告诉我的就是这堆药片的数量,因为我没有把药片搞丢了,所以这是刚才那3个属性中的仅有的一个属性了,它没有发生变化。这整个的过程就是把信息从3维降到1维了,丢失了2维的信息。

原视频中的情况也类似,当将一个2维向量变换为1维后,那它肯定是丢失了信息了,如果没有丢失信息那不还是2维吗?很显然,针对视频中的例子来说,它在变换之后丢失大小和方向中的方向这个信息。所以在企图还原的到时候你也不知道它原来的方向该指向哪里了?你看图3中的那些向量的箭头,它们该指向哪里呢?彻底懵逼了。这不是难为人嘛。你说你蒙一个得了,卧槽,大哥,我们在讨论一个很严肃的问题,你搞笑呢?

我觉得我用叨逼叨的方式已经说得很清楚了。

1884

1884

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?