关于lda和其他的好多,大家也可以参考http://leftnoteasy.cnblogs.com

LDA: linear discriminant analysis,线性判别分析。是一种监督学习方法,其中用到的有fisher判别,也叫fisher 判别分析。窃以为可以先把它看成是分类的模型,求解分类超平面

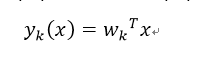

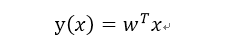

很明显的两类分问题。假设分类超平面为

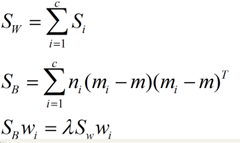

我们的目的是将红点和蓝点两类二维数据投影到一维的分类超平面上。那么我们就想要投影过后的两类点的类内距离足够小,而类间距离足够大。这样分类效果才最好。

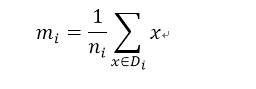

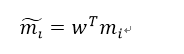

好吧,那么投影前的类中心为:

投影后的类中心:

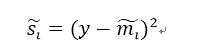

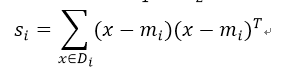

投影之后,每一类数据的分散程度可以用

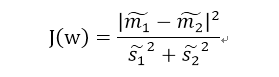

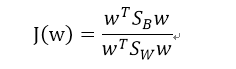

那么损失函数就是:

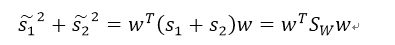

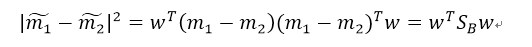

令

则

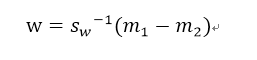

结果就是这样了,那怎么求这个值呢,接下来就可以用拉格朗日乘子法进行求解,这里直接写结果吧,过程以后再添,

对于两类问题:

对于多类问题:

这个式子到最后就是求特征值了,求出来最大的k个特征值对应的特征向量就是对应的w了。

线性判别分析(LDA)是一种监督学习方法,用于分类问题,寻找最佳分类超平面。目标是使类内距离最小,类间距离最大。通过最大化损失函数J(w)来确定权重向量w,最终通过求解特征值找到最优解。LDA适用于两类及多类问题。

线性判别分析(LDA)是一种监督学习方法,用于分类问题,寻找最佳分类超平面。目标是使类内距离最小,类间距离最大。通过最大化损失函数J(w)来确定权重向量w,最终通过求解特征值找到最优解。LDA适用于两类及多类问题。

229

229

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?