一、HBase集群规划

在HBase中分成两个角色,分别为HMaster和HRegionServer

HBase的数据最终存储在DataNode,故HRegionServer放在cloud05,cloud06,cloud07

HMaster负责高可用,需要ZooKeeper集群,故ZooKeeper放在

cloud05,cloud06,cloud07

HBase建立高可用,故HMaster需要在cloud01,cloud02上

二、HBase集群搭建步骤

1.上传HBase安装包

[hadoop@cloud01 ~]$ tar -zxvf hbase-0.96.2-hadoop2-bin.tar.gz -C app/

3.配置hbase集群,要修改3个文件(首先zk集群已经安装好了)

cloud06

scp -r /home/app/hbase-0.96.2-hadoop2/ cloud05:/home/app/

5.启动所有的hbase

分别启动zk

./zkServer.sh start

启动hdfs集群

start-dfs.sh

启动hbase,在主节点上运行:

start-hbase.sh

6.通过浏览器访问hbase管理页面

192.168.2.31:60010

7.为保证集群的可靠性,要启动多个HMaster

hbase-daemon.sh start master

3.配置hbase集群,要修改3个文件(首先zk集群已经安装好了)

注意:由于hbase最终数据存放到hdfs,故需要要把hadoop的hdfs-site.xml和core-site.xml 放到hbase/conf下

[hadoop@cloud01 conf]$ pwd

/home/hadoop/app/hbase-0.96.2-hadoop2/conf

/home/hadoop/app/hbase-0.96.2-hadoop2/conf

[hadoop@cloud01 conf]$ scp -r /home/hadoop/app/hadoop-2.4.1/etc/hadoop/hdfs-site.xml .

[hadoop@cloud01 conf]$ scp -r /home/hadoop/app/hadoop-2.4.1/etc/hadoop/core-site.xml .

[hadoop@cloud01 conf]$ scp -r /home/hadoop/app/hadoop-2.4.1/etc/hadoop/core-site.xml .

3.1在cloud01上修改hbase-env.sh

export JAVA_HOME=/usr/java/jdk1.7.0_55

//告诉hbase使用外部的zk

export HBASE_MANAGES_ZK=false

//告诉hbase使用外部的zk

export HBASE_MANAGES_ZK=false

3.2

在cloud01上

vim hbase-site.xml

<configuration>

<!-- 指定hbase在HDFS上存储的路径 -->

<property>

<name>hbase.rootdir</name>

<value>hdfs://ns1/hbase</value>

</property>

<!-- 指定hbase是分布式的 -->

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<!-- 指定zk的地址,多个用“,”分割 -->

<property>

<name>hbase.zookeeper.quorum</name>

<value>itcast05:2181,itcast06:2181,itcast07:2181</value>

</property>

</configuration>

<!-- 指定hbase在HDFS上存储的路径 -->

<property>

<name>hbase.rootdir</name>

<value>hdfs://ns1/hbase</value>

</property>

<!-- 指定hbase是分布式的 -->

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<!-- 指定zk的地址,多个用“,”分割 -->

<property>

<name>hbase.zookeeper.quorum</name>

<value>itcast05:2181,itcast06:2181,itcast07:2181</value>

</property>

</configuration>

3.3

在cloud01上

指定哪些机器为regionserver,不单独指定master。其中:在哪个机器上启动,哪台就是master,在

regionservers文件说明要启动的HRegionServer

vim regionservers

cloud05

cloud06

cloud07

3.4

在cloud01上

拷贝hbase到其他节点

scp -r /home/app/hbase-0.96.2-hadoop2/ cloud02:/home/app/scp -r /home/app/hbase-0.96.2-hadoop2/ cloud05:/home/app/

scp -r /home/app/hbase-0.96.2-hadoop2/ cloud06:/home/app/

scp -r /home/app/hbase-0.96.2-hadoop2/ cloud07:/home/app/

其中: cloud01,cloud02分别为Hmaster,cloud05,cloud06,cloud07 分别为HRegionServer

4.将配置好的HBase拷贝到每一个节点并同步时间。5.启动所有的hbase

分别启动zk

./zkServer.sh start

启动hdfs集群

start-dfs.sh

启动hbase,在主节点上运行:

start-hbase.sh

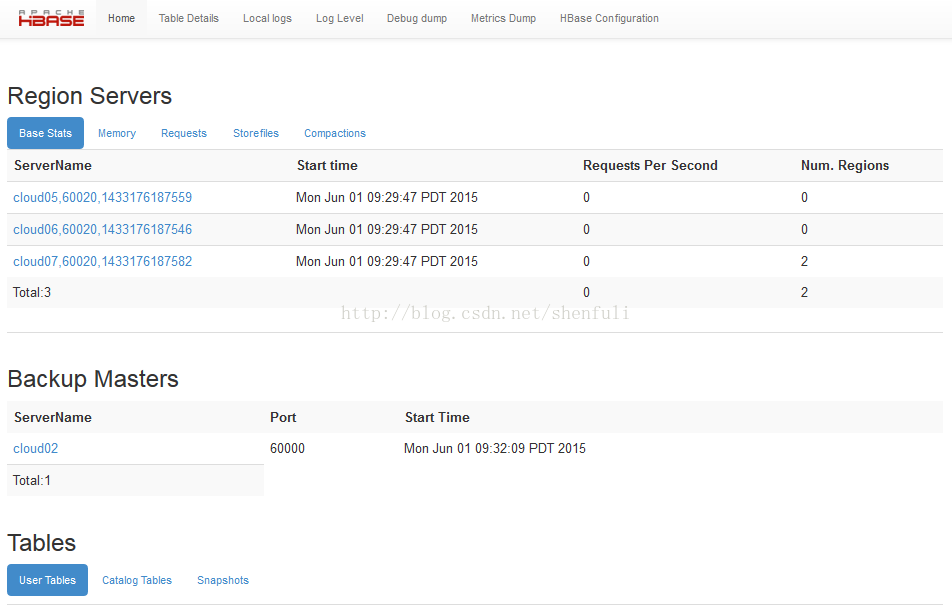

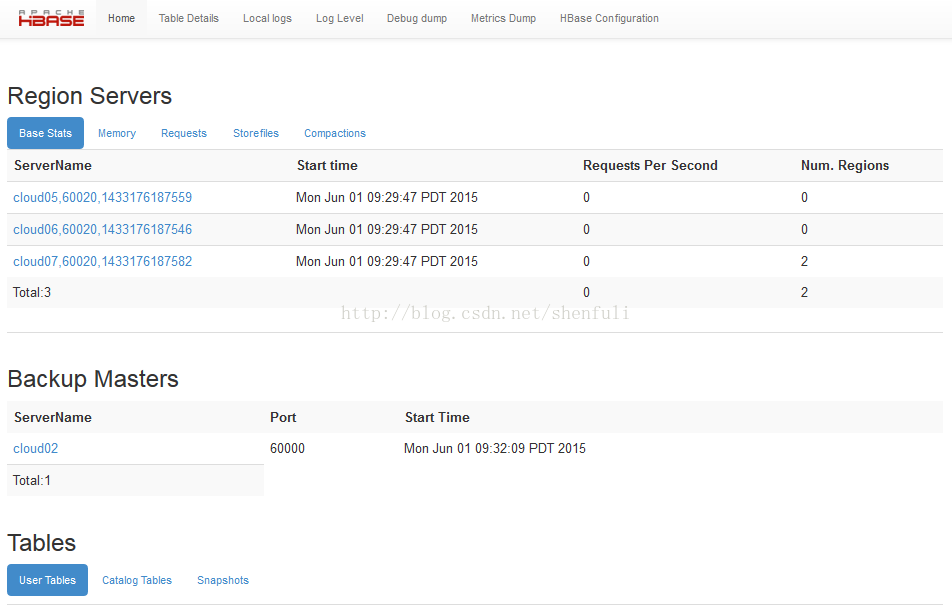

6.通过浏览器访问hbase管理页面

192.168.2.31:60010

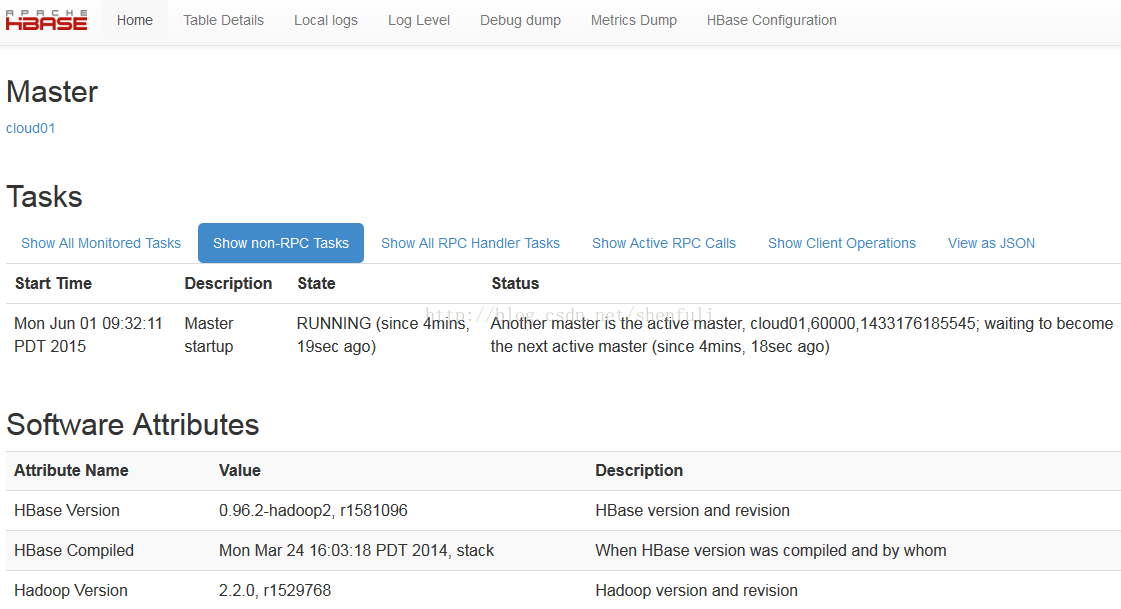

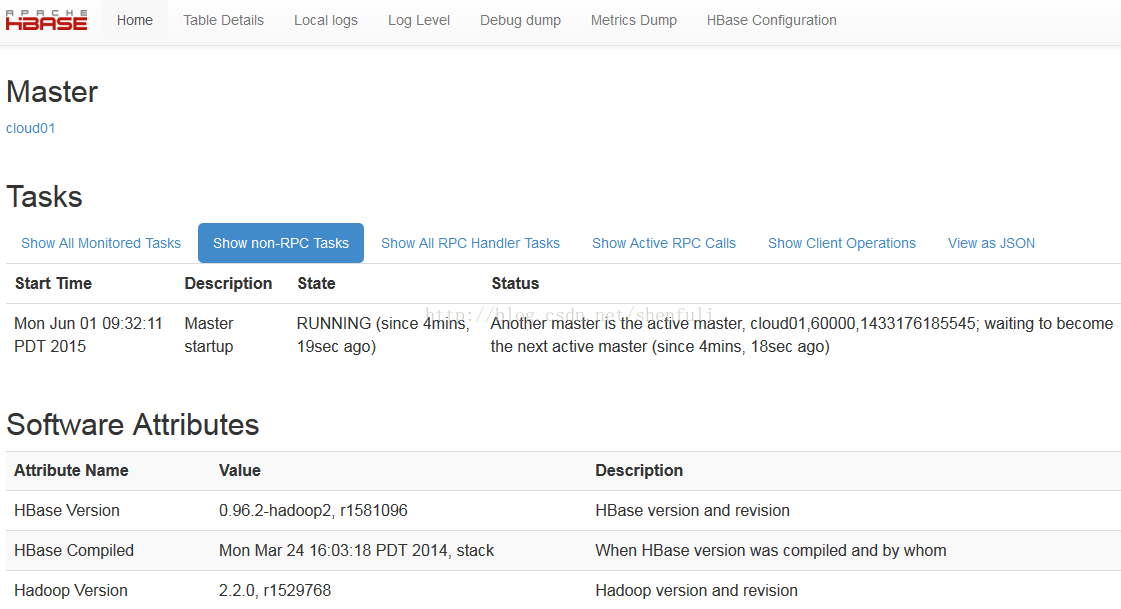

7.为保证集群的可靠性,要启动多个HMaster

hbase-daemon.sh start master

访问

192.168.2.31:60010

访问

192.168.2.32:60010

2989

2989

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?