最近因为整理文档,发现一些很久以前写的关于ceph基础介绍的ppt,为了防止资料丢失,打算把搬到这里留作备份。

现在线上环境是openstack+ceph的结构,ceph直接连接在openstack中块存储模块cinder的后端。

什么是Ceph

利用一个分布式集群来提供对象,块和文件存储的统一存储平台。是一个免费开源软件,

Ceph的是一种基于软件的解决方案,并在商品硬件上运行。该系统被设计成自动修复和智能管理,希望减低管理员和预算开销。

最初是SageWeil一项关于存储系统的PhD研究项目。主线Linux内核(从2.6.34版开始中找到Ceph的身影。

想达到的目标:没有单点故障的完全分布式存储系统,使数据能容错和无缝的复制,可扩展EB水平(EB,PB,TB,GB)

Ceph架构

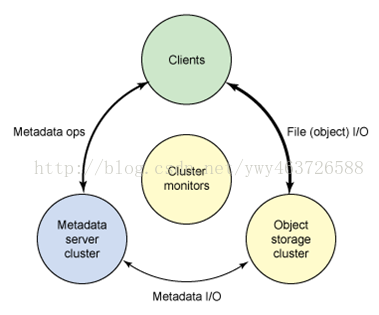

Ceph生态系统可以大致划分为四部分:

1.客户端(数据用户)

2.元数据服务器(缓存和同步分布式元数据)

3.对象存储集群(将数据和元数据作为对象存储,执行其他关键职能)

4.集群监视器(执行监视功能)。

Ceph设计

•在server端,提供一个存储集群Ceph Storage Cluster。–核心组件RADOS (Reliable, AutonomicDistributed Object Store)

•在client端,ceph提供三种存储方式:1.Ceph Filesystem 2.Ceph Block Device 3.Ceph Object Storage

RADOS

ceph存储集群的基础。所有服务都从其中读取和写入数据。

包括两类守护进程:1.对象存储守护进程(OSD)存储为对象 2

本文介绍了Ceph的基础概念,包括Ceph架构、RADOS、Ceph Filesystem、Block Device和Object Storage。重点讲解了RADOS的架构,如Cluster Map、数据存放的两层映射、Pool管理、PG ID计算以及错误检测和恢复机制。内容适合对Ceph感兴趣的读者和OpenStack+Ceph环境的管理员。

本文介绍了Ceph的基础概念,包括Ceph架构、RADOS、Ceph Filesystem、Block Device和Object Storage。重点讲解了RADOS的架构,如Cluster Map、数据存放的两层映射、Pool管理、PG ID计算以及错误检测和恢复机制。内容适合对Ceph感兴趣的读者和OpenStack+Ceph环境的管理员。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

962

962

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?