一、集群搭建

1.上传Kafka安装包到Linux并解压,构建软连接

tar -zvxf Kafka压缩包 -C 目标文件夹

构建软连接:ln -s kafka_2.13-2.8.0/ kafka

2.修改server.properties文件

cd /export/servers/kafka/config

vim server.properties

#指定broker的id

#指定Kafka数据的位置(根据自己需要选择位置)

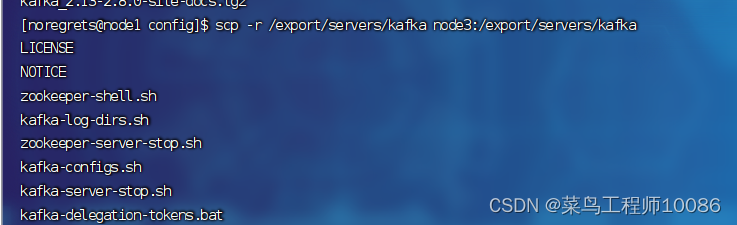

3.分发Kafka文件到其余节点(修改broker的id分别为1,2)

scp -r /export/servers/kafka node2:/export/servers/kafka

scp -r /export/servers/kafka node3:/export/servers/kafka

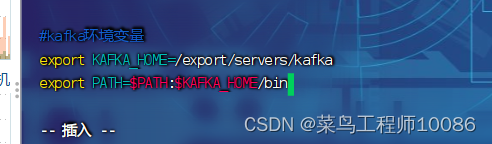

4.配置并生效环境变量(各节点)

#kafka环境变量

export KAFKA_HOME=/export/servers/kafka

export PATH=$PATH:$KAFKA_HOME/bin

生效环境变量:source /etc/profile

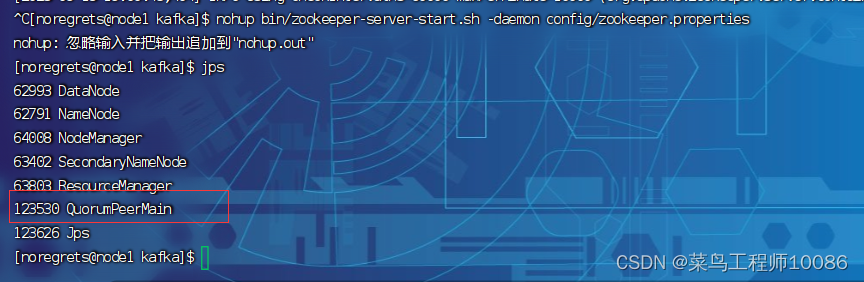

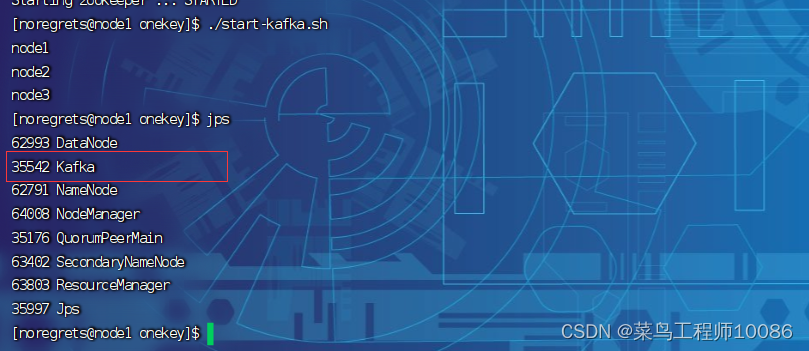

5.启动服务器

#启动Zookeeper

nohup bin/zookeeper-server-start.sh -daemon config/zookeeper.properties

#启动Kafka

nohup bin/kafka-servers-start.sh -daemon config/server.properties

验证kafka,使用命令查看卡夫卡主题列表

二、一键启动脚本撰写

1.Kafka启停脚本

在export文件夹新建onekey文件夹,新建文件slave

添加各节点名称

新建start-kafka.sh文件

cat /export/onekey/slave | while read line

do

{

echo $line

ssh $line "source /etc/profile;export JMX_PORT=9988;nohup ${KAFKA_HOME}/bin/kafka-server-start.sh ${KAFKA_HOME}/config/server.properties > /dev/nul* 2>&1 & " &

}&

wait

done

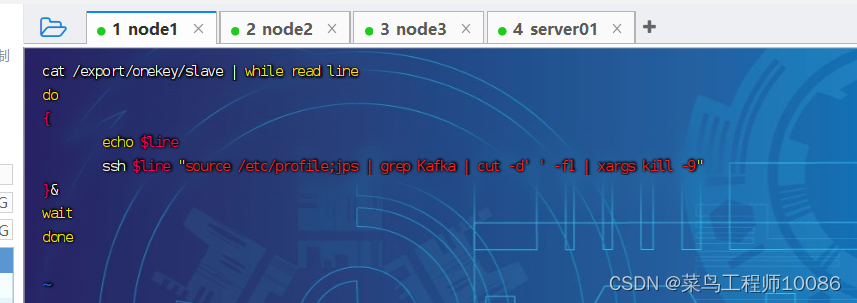

新建stop-kafka.sh

cat /export/onekey/slave | while read line

do

{

echo $line

ssh $line "source /etc/profile;jps | grep Kafka | cut -d' ' -f1 | xargs kill -9"

}&

wait

done

将两个文件改为可执行文件

chmod u+x start-kafka.sh

chmod u+x stop-kafka.sh

验证可执行文件

509

509

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?