安装hive

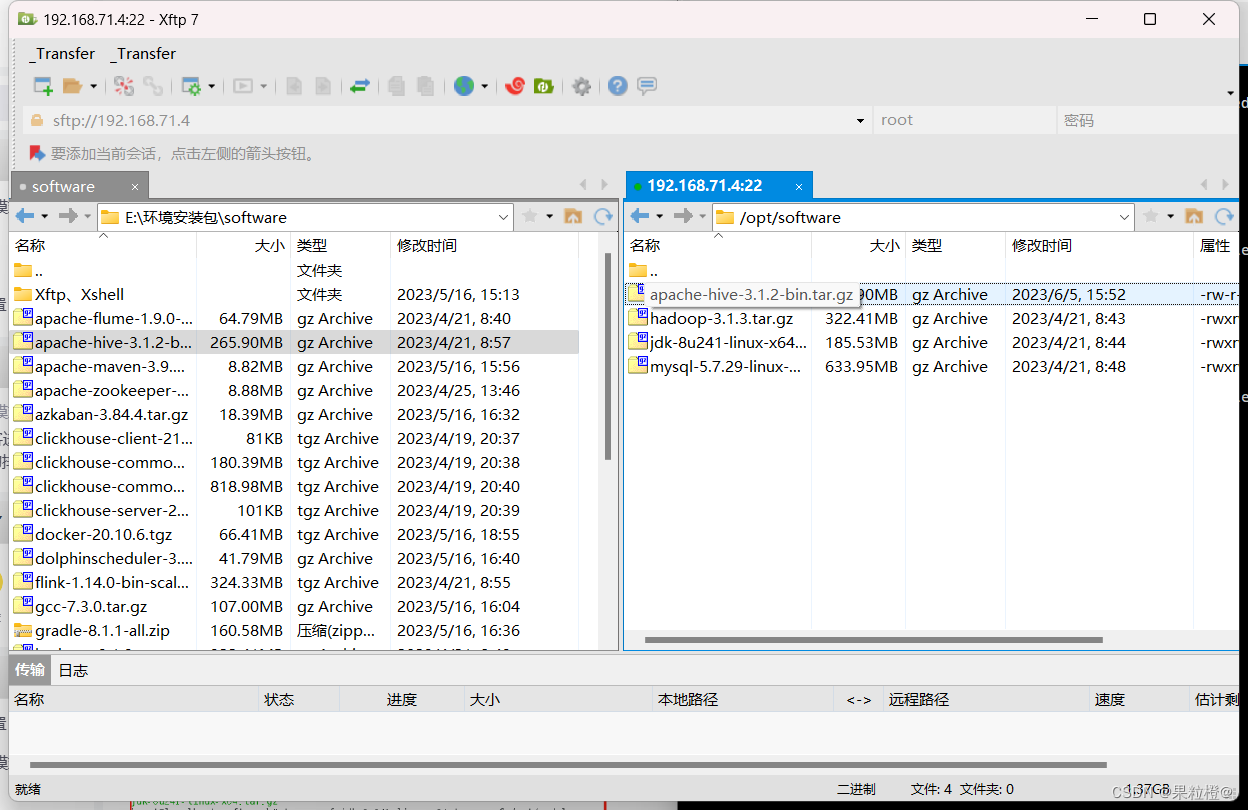

1. 使用Xshell工具上传apache-hive-3.1.2-bin.tar.gz到/opt/software目录下:

2.在/opt/software目录下使用tar命令解压apache-hive-3.1.2-bin.tar.gz到/opt/module目录下:

tar -zxvf apache-hive-3.1.2-bin.tar.gz -C /opt/module3.在/opt/module目录下修改文件夹名称:

mv apache-hive-3.1.2-bin/ hive4.打开环境变量:

vim /etc/profile在底部添加如下配置:

#hive

export HIVE_HOME=/opt/module/hive

export PATH=$PATH:$HIVE_HOME/bin

5.将profile文件重新运行:

source /etc/profile6. 编辑hive-site.xml配置文件:

vim /opt/module/hive/conf/hive-site.xml进行如下配置:

<?xml version="1.0" encoding="UTF-8" standalone="no"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<!--连接数据的用户名-->

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

</property>

<!--连接数据的密码-->

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>123456</value>

</property>

<!--mysql数据库的访问路径,没有路径则自动创建-->

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://bigdata01:3306/hive?createDatabaseIfNotExist=true&useSSL=false</value>

</property>

<!--连接数据库的驱动-->

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

</property>

<!--元数据是否校验-->

<property>

<name>hive.metastore.schema.verification</name>

<value>false</value>

</property>

<!--是否自动创建核心文件-->

<property>

<name>datanucleus.schema.autoCreateAll</name>

<value>true</value>

</property>

<!--thrift服务器绑定的主机-->

<property>

<name>hive.server2.thrift.bind.host</name>

<value>bigdata01</value>

</property>

<!--默认的存储地址-->

<property>

<name>hive.metastore.warehouse.dir</name>

<value>hdfs://bigdata01:9000/user/hive/warehouse</value>

<description>location of default database for the warehouse</description>

</property>

<!--设置显示表头字段名-->

<property>

<name>hive.cli.print.header</name>

<value>true</value>

</property>

<property>

<name>hive.cli.print.current.db</name>

<value>true</value>

</property>

</configuration>

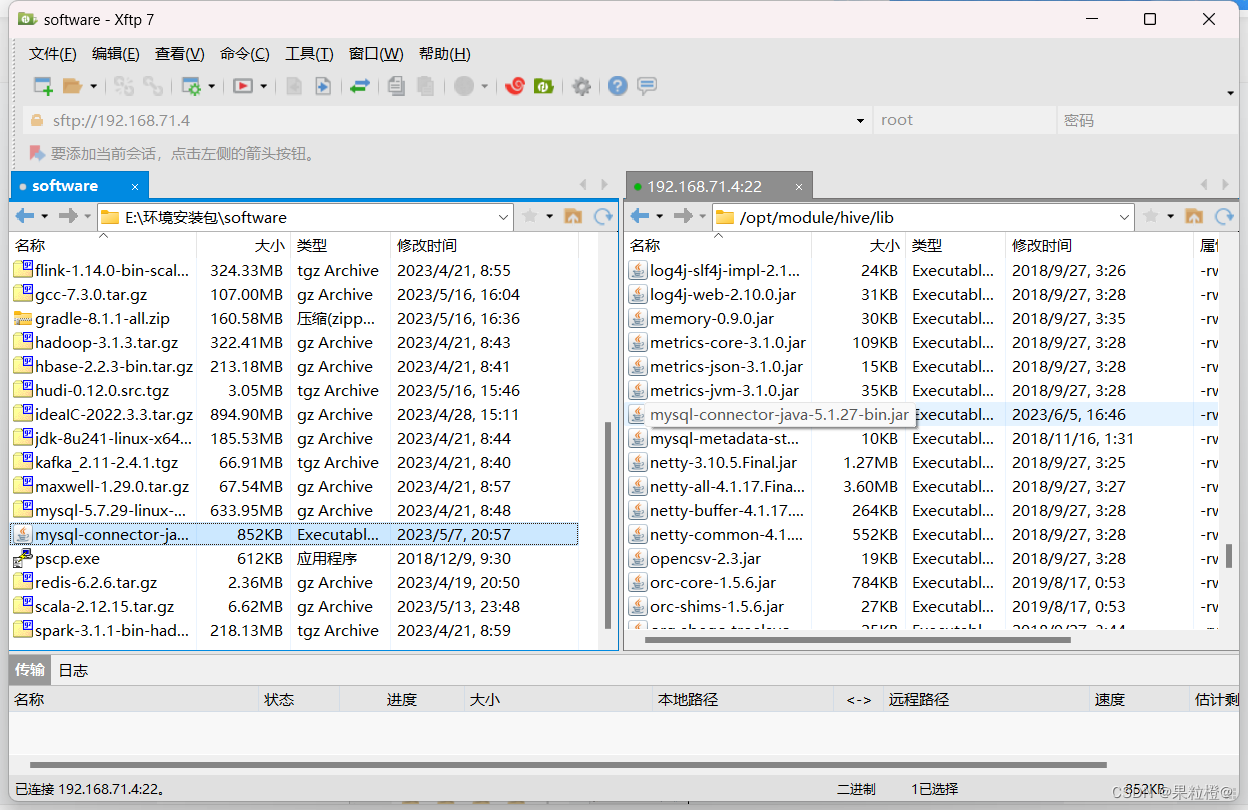

7.使用Xshell工具上传mysql-connector-java-5.1.27-bin.jar到/opt/module/hive/lib:

8.拷贝hive-env.sh.template另存为hive-env.sh:

cp hive-env.sh.template hive-env.sh9.编辑hive-env.sh配置文件:

vim hive-env.sh将hadoop安装路径添加至文件底部:

HADOOP_HOME=/opt/module/hadoop10. 删除hive里的guava.jar:

rm -rf /opt/module/hive/lib/guava-19.0.jar 11. 把hadoop里的guava.jar复制到hive里:

cp /opt/module/hadoop/share/hadoop/common/lib/guava-27.0-jre.jar /opt/module/hive/lib

12.重新加载环境变量:

source /etc/profile13.启动hadoop:

start-all.sh14.hive初始化:

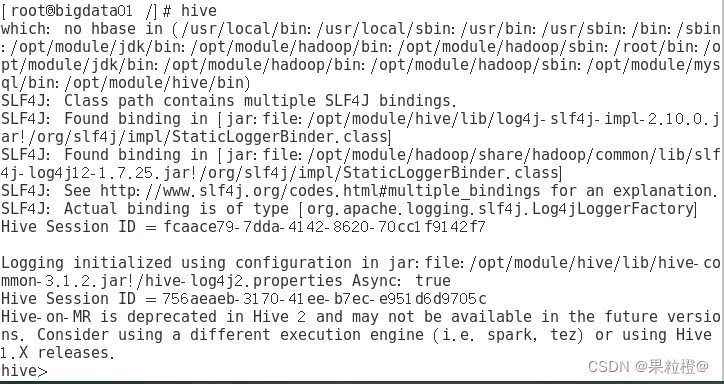

schematool -dbType mysql -initSchema15.进入hive:

hive执行结果如下:

hive安装配置成功!

5944

5944

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?