网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

<artifactId>fastjson</artifactId>

<version>1.2.62</version>

</dependency>

代码:

package com.cwl.database.flume.interceptor;

import com.alibaba.fastjson.JSONObject;

import org.apache.flume.Context;

import org.apache.flume.Event;

import org.apache.flume.interceptor.Interceptor;

import java.nio.charset.StandardCharsets;

import java.util.Iterator;

import java.util.List;

import java.util.Map;

public class TimestampInterceptor implements Interceptor {

@Override

public void initialize() {

}

@Override

public Event intercept(Event event) {

//1、获取header和body的数据

Map<String, String> headers = event.getHeaders();

String log = new String(event.getBody(), StandardCharsets.UTF_8);

try {

//2、将body的数据类型转成jsonObject类型(方便获取数据)

JSONObject jsonObject = JSONObject.parseObject(log);

//3、header中timestamp时间字段替换成日志生成的时间戳(解决数据漂移问题)

String ts = jsonObject.getString("ts");

headers.put("timestamp", ts);

return event;

} catch (Exception e) {

e.printStackTrace();

return null;

}

}

@Override

public List intercept(List list) {

Iterator iterator = list.iterator();

while (iterator.hasNext()) {

Event event = iterator.next();

if (intercept(event) == null) {

iterator.remove();

}

}

return list;

}

@Override

public void close() {

}

public static class Builder implements Interceptor.Builder {

@Override

public Interceptor build() {

return new TimestampInterceptor();

}

@Override

public void configure(Context context) {

}

}

}

代码打包上传到…/flume/lib下

### 优化

1)FileChannel优化

通过配置dataDirs指向多个路径,每个路径对应不同的硬盘,增大Flume吞吐量。

官方说明如下:

Comma separated list of directories for storing log files. Using multiple directories on separate disks can improve file channel peformance

checkpointDir和backupCheckpointDir也尽量配置在不同硬盘对应的目录中,保证checkpoint坏掉后,可以快速使用backupCheckpointDir恢复数据

2)HDFS Sink优化

(1)HDFS存入大量小文件,有什么影响?

元数据层面:每个小文件都有一份元数据,其中包括文件路径,文件名,所有者,所属组,权限,创建时间等,这些信息都保存在Namenode内存中。所以小文件过多,会占用Namenode服务器大量内存,影响Namenode性能和使用寿命

计算层面:默认情况下MR会对每个小文件启用一个Map任务计算,非常影响计算性能。同时也影响磁盘寻址时间。

(2)HDFS小文件处理

官方默认的这三个参数配置写入HDFS后会产生小文件,hdfs.rollInterval、hdfs.rollSize、hdfs.rollCount

基于以上hdfs.rollInterval=3600,hdfs.rollSize=134217728,hdfs.rollCount =0几个参数综合作用,效果如下:

文件在达到128M时会滚动生成新文件

文件创建超3600秒时会滚动生成新文件

### 小结

拿下!

flume

1.基本组成

1.1 source

TairDirSource:断点续传丶多目录多文件

断点续传offset文件:

[iNode+绝对路径,pos]

解决方案:

1)选择滚动日志不更名的框架

2)修改源码,使其只按照iNode值判断是否为同一个文件

KafkaSource:上游是kafka

1.2 channel

kafkachannel:节省了一个sink

按照Flume格式解析:FALSE

FileChannel:安全

1.3 sink

HDFS Sink

2.拦截器 (解决零点漂移问题)

时间戳拦截器(log)

时间戳+表名拦截器(db)

开发流程:

实现拦截器接口;

私有化构造器

重写4个方法:

初始化

单个事件

多个事件

关闭

静态内部类:创建拦截器

打包上传到Flume lib目录下

编写配置信息时,拦截器全类名$Builder

3.channel选择器

默认的:副本

多路复用:结合拦截器使用

4.sink处理器(sink组)

Default:只允许单个Sink

负载均衡:轮询、随机、自定义

故障转移:

5.监控器

Ganglia

尝试Put的事件数 成功Put的事件数

尝试Take的事件数 成功Take的事件数

Channel中现有的事件数

尝试Put的事件数 >> 成功Put的事件数:资源不足

尝试Take的事件数 >> 成功Take的事件数:资源不足

成功Put的事件数 = 成功Take的事件数 + Channel中现有的事件数(如果是>说明:丢数据)

6.优化

默认内存:20M 4-6G (在flume/bin/conf/flume.env ->JAVA_OPTS)

HDFS Sink:滚动文件参数

防止产生小文件 30min 128m 0个事件(该参数关闭)

TairDirSource:

替换不更名日志框架

修改源码

都是为了不产生重复数据

拦截器:

时间戳:防止零点漂移问题

丢数据?:

没有丢数据!

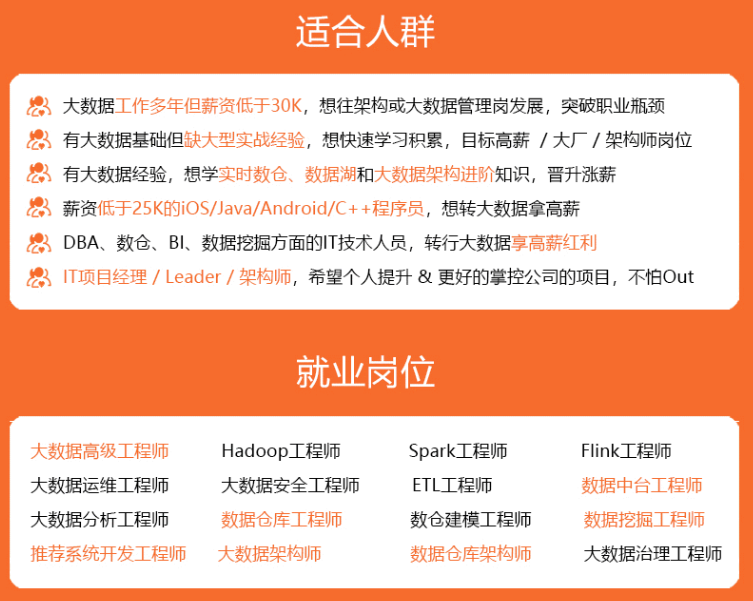

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

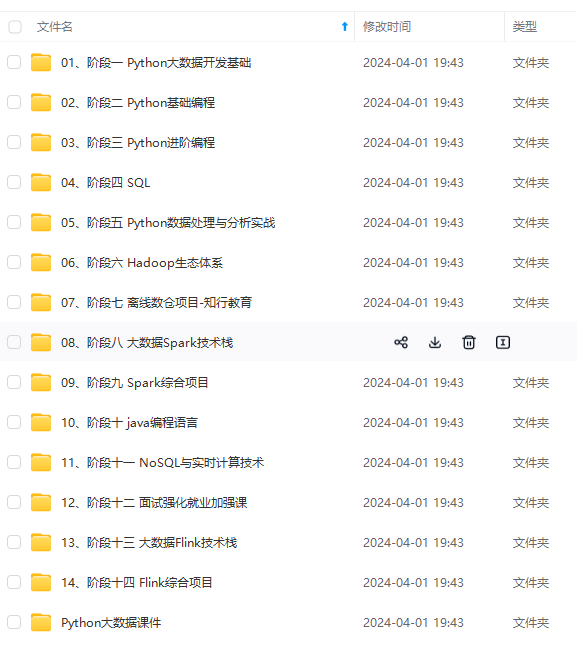

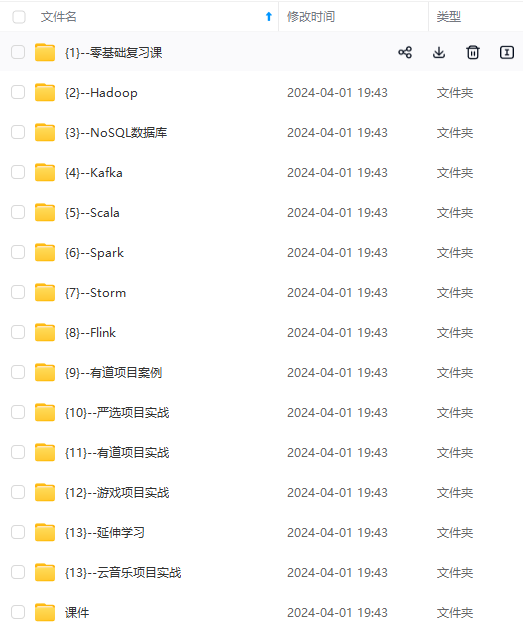

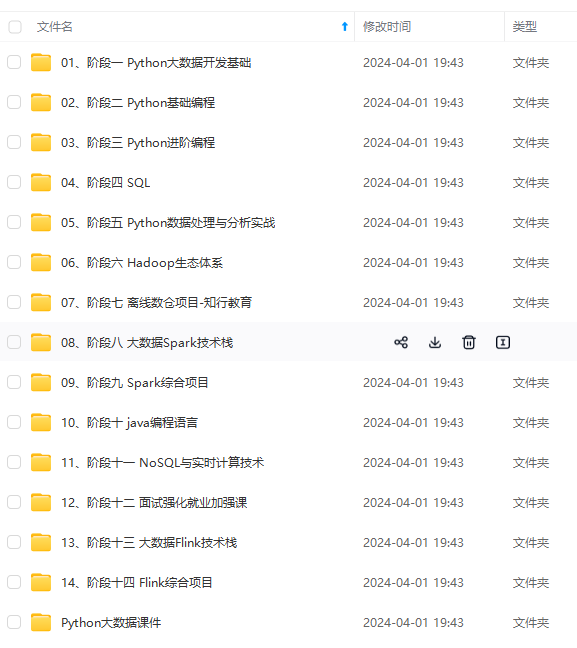

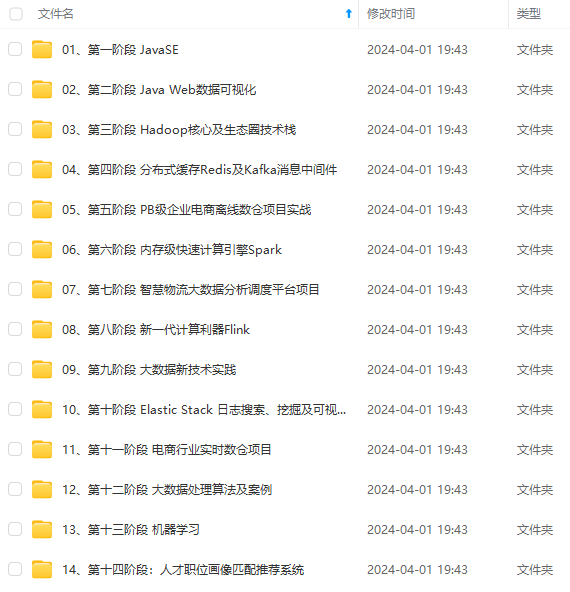

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

2764

2764

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?