文章目录

MHA高可用配置及故障切换

一、关于MHA介绍

1、MHA概述

- MHA(Master High Availability)是一套优秀的MySQL高可用环境下故障切换和主从复制的软件。

- MHA的出现就是解决MySQL单点的问题。

- MySQL故障切换过程中,MHA能做到0-30秒内自动完成故障切换。

- MHA能在最大程度上保证数据的一致性,以达到真正意义上的高可用。

数据同步方式

- 异步复制

- 只要master接收到客户端提交的事务,就会立刻返回给客户端信息,并不关心从服务器是否同步到数据

- 同步复制

- master接收到客户端提交的事务,master要等待所有的从服务器同步完数据,才会返回给客户端信息

- 半同步复制

- master接收到客户端提交的事务,从服务器中只要有一台设备同步完数据,就会返回给客户端信息(一般使用半同步复制)

2、MHA的组成

2.1 MHA Manager(管理节点)

- MHA Manager可以单独部署在一台独立的机器上,管理多个master-slave集群;也可以部署在一台slave节点上。

- MHA Manager会定时探测集群中的master节点。当master出现故障时,它可以自动将最新数据的slave提升为新的master,然后将所有的slave重新指向新的master,整个故障转移过程对应用程序完全透明。

2.2 MHA Node(数据节点)

- MHA Node运行在每台MySQL服务器上。

3、MHA特点

- 自动故障切换过程中,MHA试图从宕机的主服务器上保存二进制日志,最大程度的保证数据不丢失。

- 使用半同步复制,可以大大降低数据丢失的风险,如果只有一个slave已经收到了最新的二进制日志,MHA可以将最新的二进制日志应用于其他所有的slave服务器上,因此可以保证所有节点的数据一致性。

- 目前MHA支持一主多从的架构,最少三台服务,即一主两从

4、MHA切换过程

- 从宕机崩溃的master保存二进制日志事件(binlog events);

- 识别含有最新更新的slave;

- 应用差异的中继日志(relay log)到其他 slave;

- 应用从master保存的二进制日志事件(binlog events);

- 提升含有最新更新的slave成为新master;

- 使其他的slave连接新的master进行复制。

二、搭建MHA高可用配置

1、MHA架构

- 数据库安装

- 一主两从

- MHA搭建

2、故障模拟

- 主库失效

- 备选主库成为主库

- 原故障主库恢复重新加入到MHA成为从库

3、搭建MHA

- 服务器、主机名、系统、IP以及软件版本配置

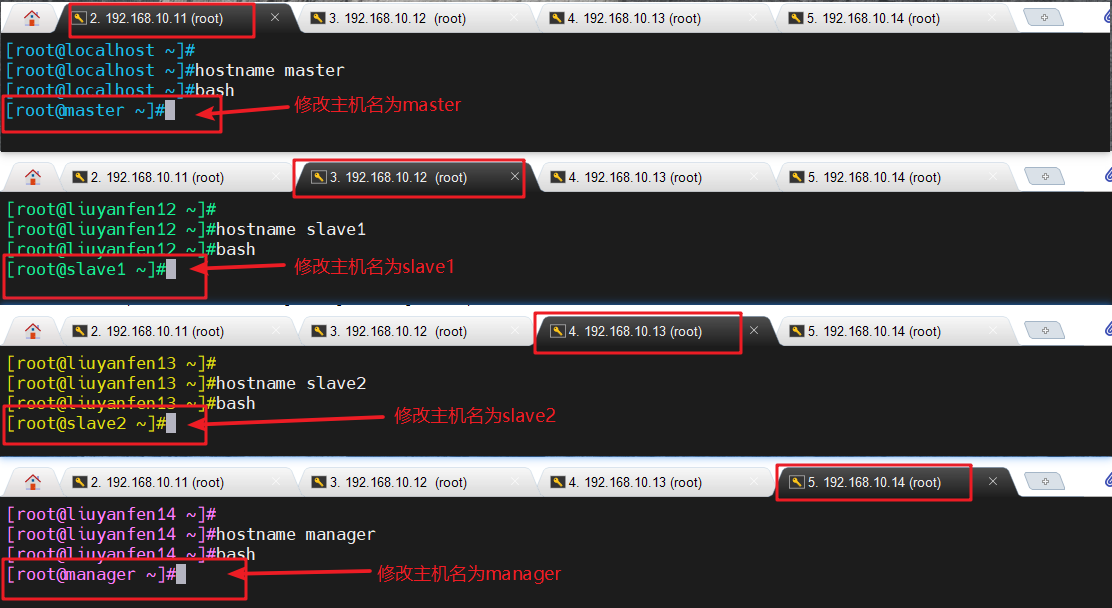

| 服务器 | 主机名 | 系统 | IP | 软件及版本 | |

|---|---|---|---|---|---|

| Master节点服务器 | mysql1 | CentOS7.4(64位) | 192.168.10.11 | 安装mysql5.7、MHA node组件 | |

| Slave1节点服务器 | slave1 | CentOS7.4(64位) | 192.168.10.12 | 安装mysql5.7、MHA node组件 | |

| Slave2节点服务器 | slave2 | CentOS7.4(64位) | 192.168.10.13 | 安装mysql5.7、MHA node组件 | |

| MHA manager节点服务器 | manager | CentOS7.4(64位) | 192.168.10.14 | 安装MHA node和manager组件 |

hostname 主机名

#临时修改主机名,便于区分

3.1 MySQL服务器配置主从同步

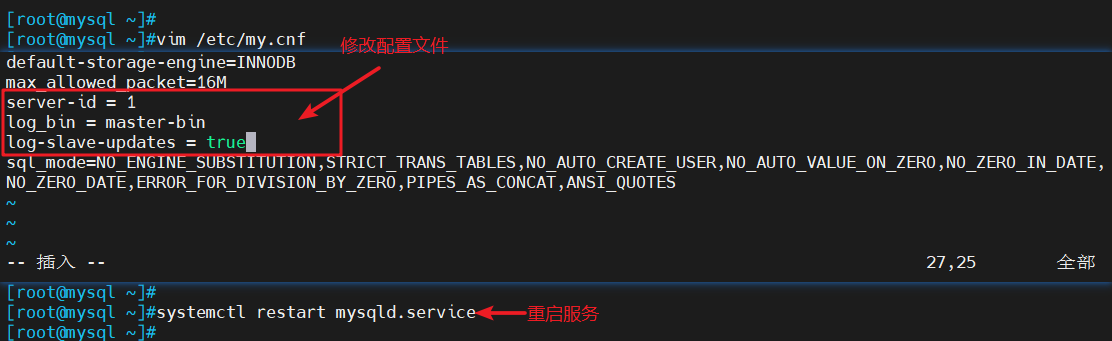

3.1.1 修改Master、Slave1、Slave2节点的MySQL主配置文件

- master(192.168.10.11)

#修改配置文件

vim /etc/my.cnf

[mysqld]

server-id = 1

log_bin = master-bin

log-slave-updates = true

#添加上面配置内容

systemctl restart mysqld.service

#重启服务

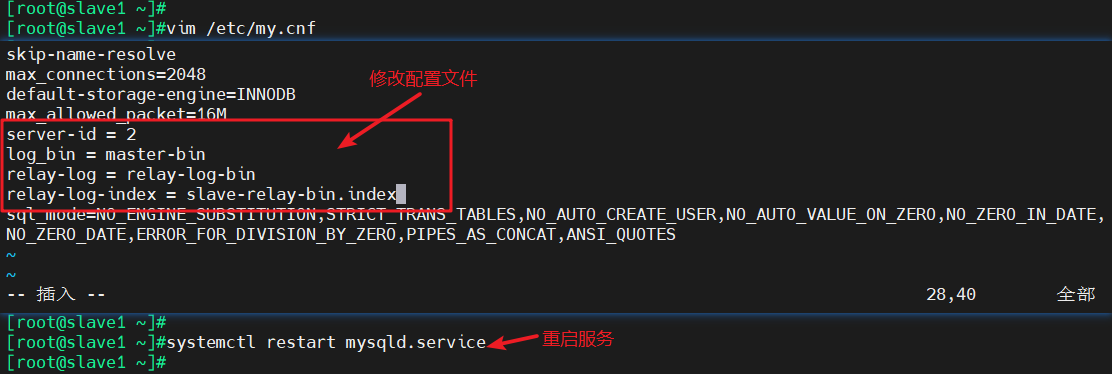

- slave1(192.168.10.12)

#修改配置文件

vim /etc/my.cnf

[mysqld]

server-id = 2

log_bin = master-bin

relay-log = relay-log-bin

relay-log-index = slave-relay-bin.index

#添加上面配置内容

systemctl restart mysqld.service

#重启服务

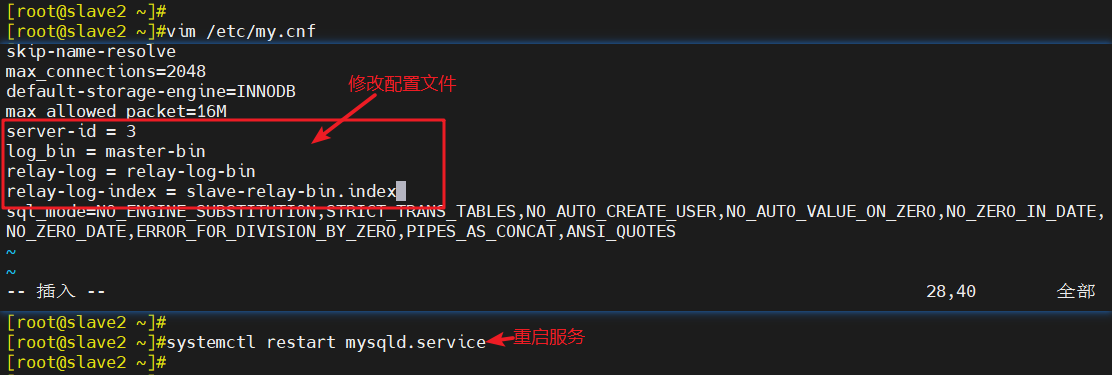

- slave2(192.168.10.13)

#修改配置文件

vim /etc/my.cnf

[mysqld]

server-id = 3

log_bin = master-bin

relay-log = relay-log-bin

relay-log-index = slave-relay-bin.index

#添加上面配置内容

systemctl restart mysqld.service

#重启服务

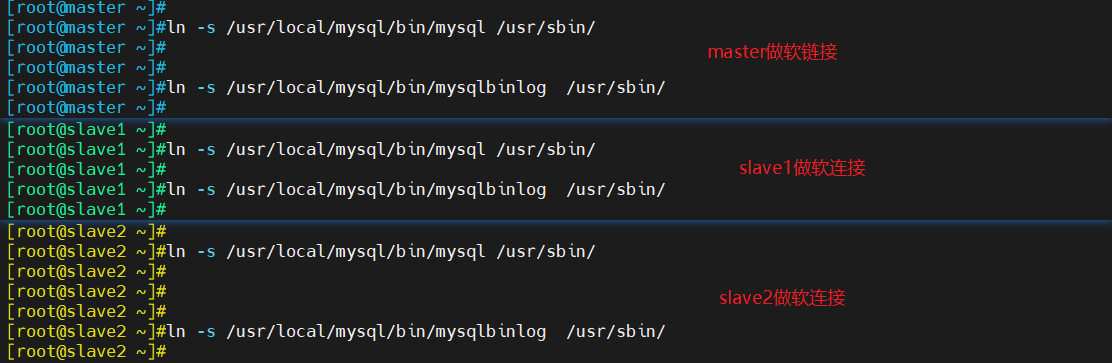

3.1.2 在Master、Slave1、Slave2节点上都创建两个软链接

- master(192.168.10.11)、slave1(192.168.10.12)、slave2(192.168.10.13)

ln -s /usr/local/mysql/bin/mysql /usr/sbin/

ln -s /usr/local/mysql/bin/mysqlbinlog /usr/sbin/

#做软连接

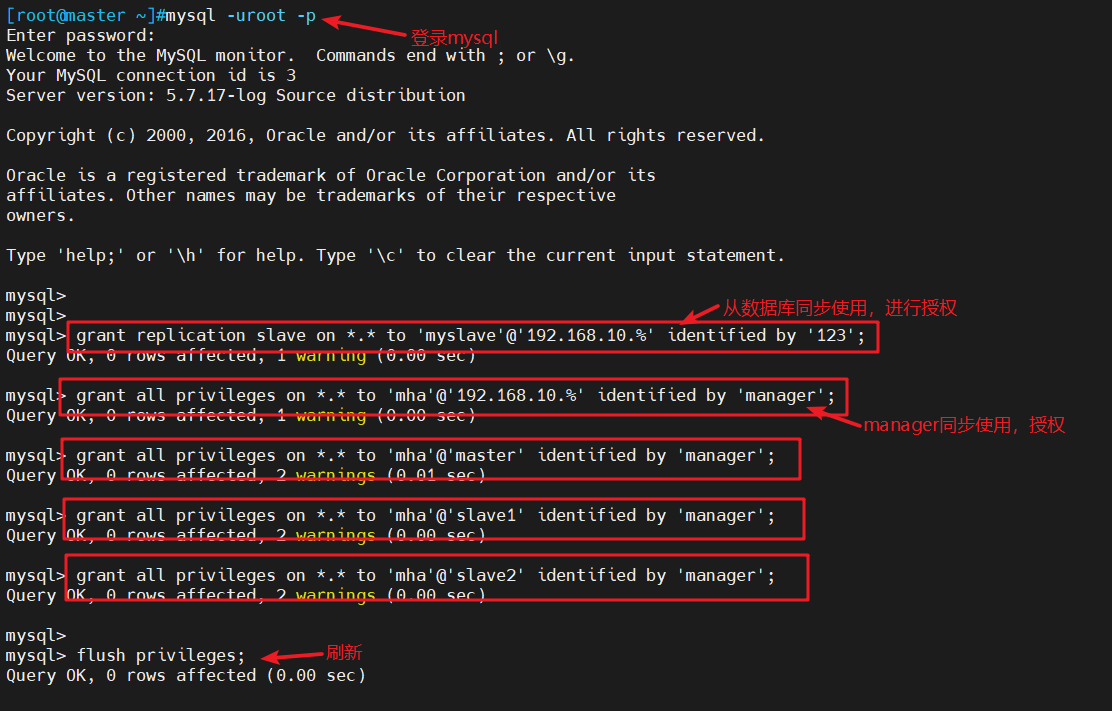

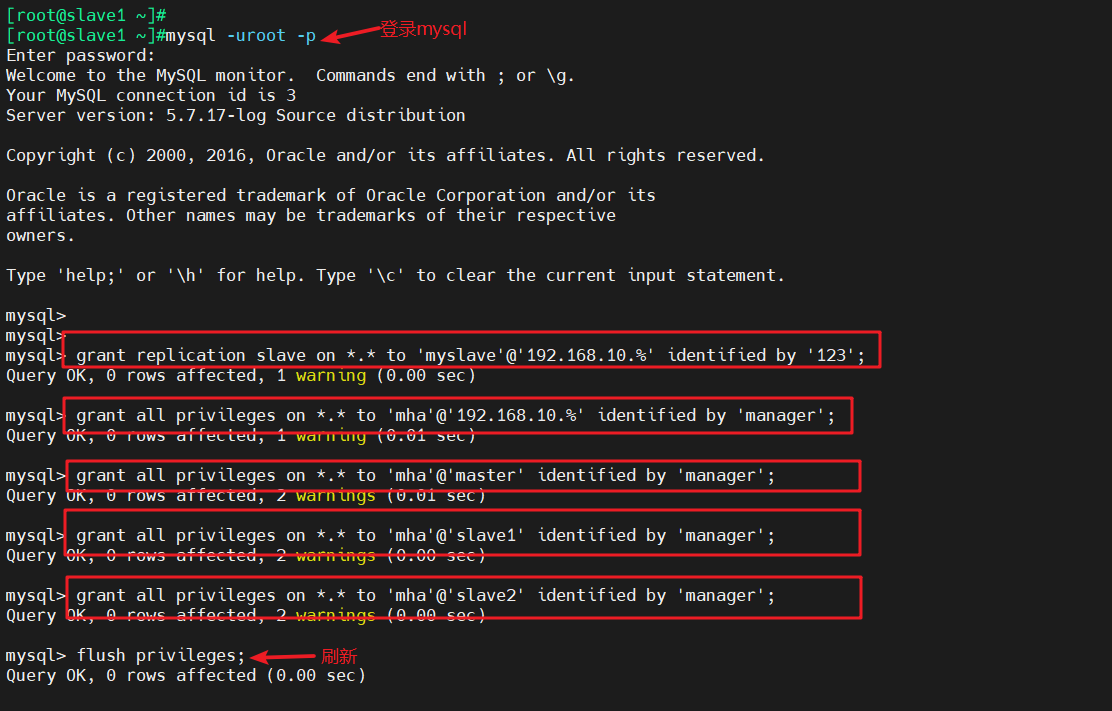

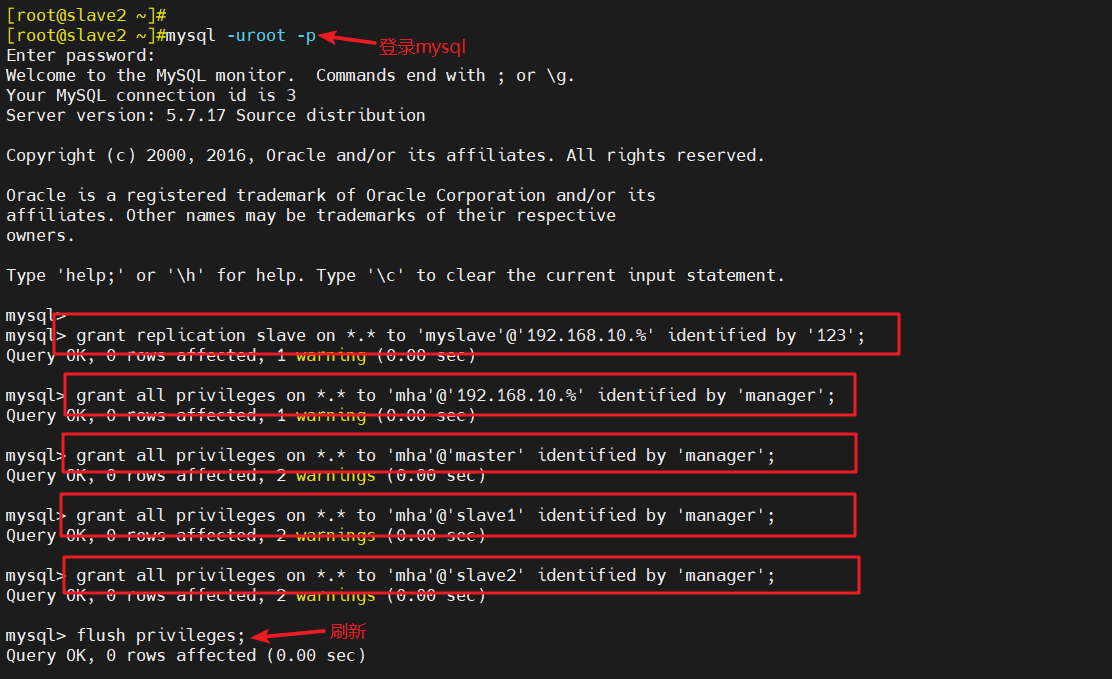

3.1.3 配置mysql一主两从,对所有数据库节点进行授权

- master(192.168.10.11)、slave1(192.168.10.12)、slave2(192.168.10.13)

mysql -uroot -p

#登录mysql

grant replication slave on *.* to 'myslave'@'192.168.10.%' identified by '123';

#从数据库同步使用

grant all privileges on *.* to 'mha'@'192.168.10.%' identified by 'manager';

#manager同步使用

grant all privileges on *.* to 'mha'@'master' identified by 'manager';

#防止从库通过主机名连接不上主库

grant all privileges on *.* to 'mha'@'slave1' identified by 'manager';

grant all privileges on *.* to 'mha'@'slave2' identified by 'manager';

flush privileges;

- master(192.168.10.11)

- slave1(192.168.10.12)

- slave2(192.168.10.13)

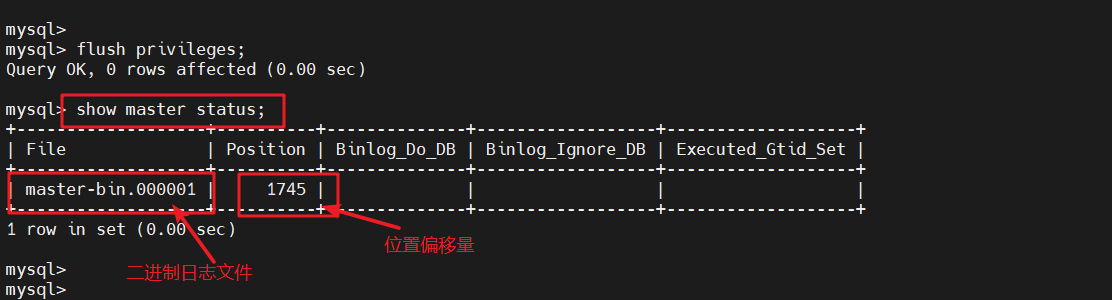

①、在Master节点查看二进制文件和同步点

- master(192.168.10.11)

show master status;

#查看master状态(二进制日志文件和位置偏移量)

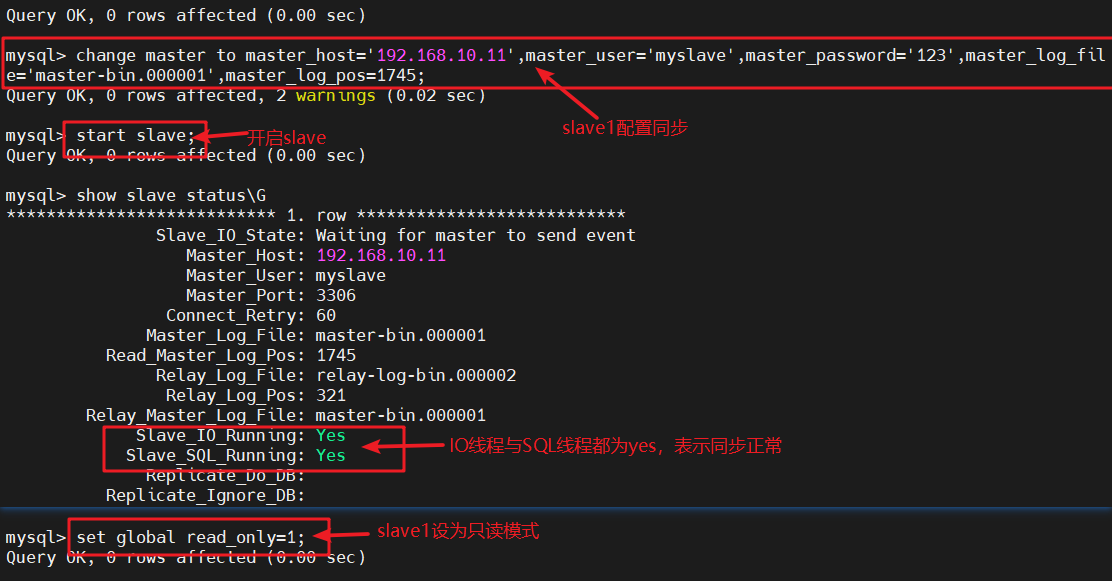

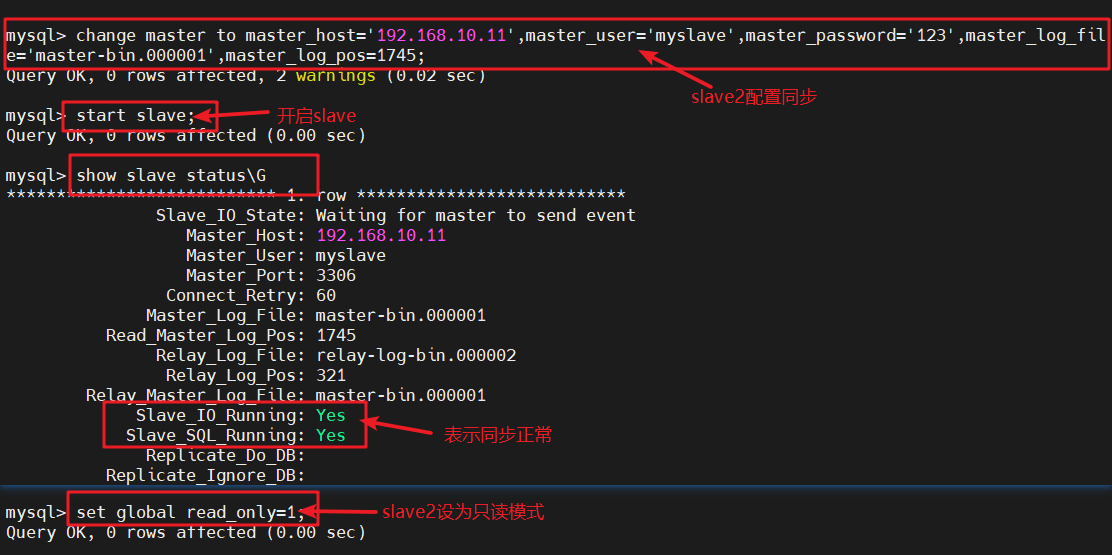

②、在Slave1、Slave2节点执行同步操作

change master to master_host='192.168.10.11',master_user='myslave',master_password='123',master_log_file='master-bin.000001',master_log_pos=1745;

#从服务器配置同步

##说明

master_host='192.168.10.11':设置主服务器的IP地址为192.168.10.11

master_user='myslave':设置用于复制的用户为'myslave',这个用户在主服务器上必须拥有REPLICATION SLAVE权限

master_password='123':设置复制用户的密码为'123'。在实际生产环境中,务必使用强密码

master_log_file='master-bin.000001':指定从哪个二进制日志文件开始复制,这里是从'master-bin.000001'文件开始

master_log_pos=1745:指定在上述二进制日志文件中的起始位置为1745

start slave;

#开启slave

show slave status\G

#查看slave状态

#IO和SQL线程都是Yes,代表同步正常

set global read_only=1;

#设为只读模式

- slave1(192.168.10.12)

- slave2(192.168.10.13)

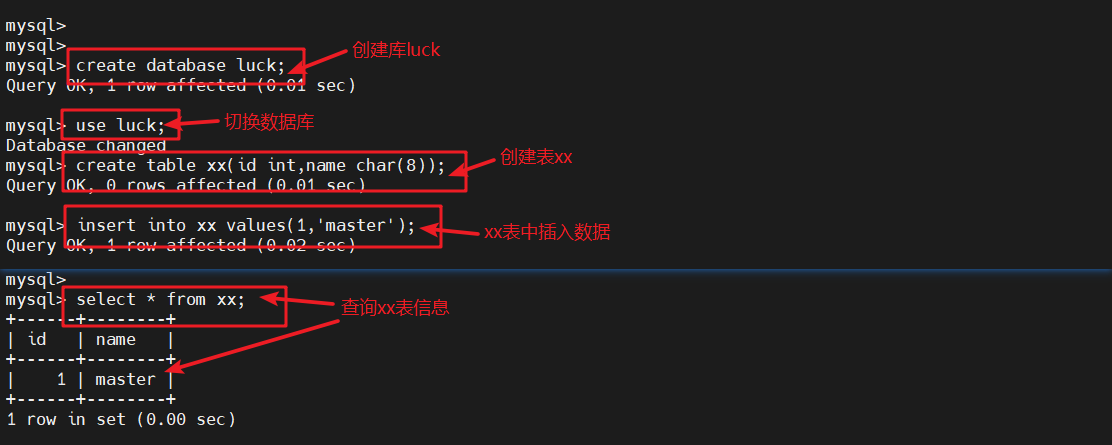

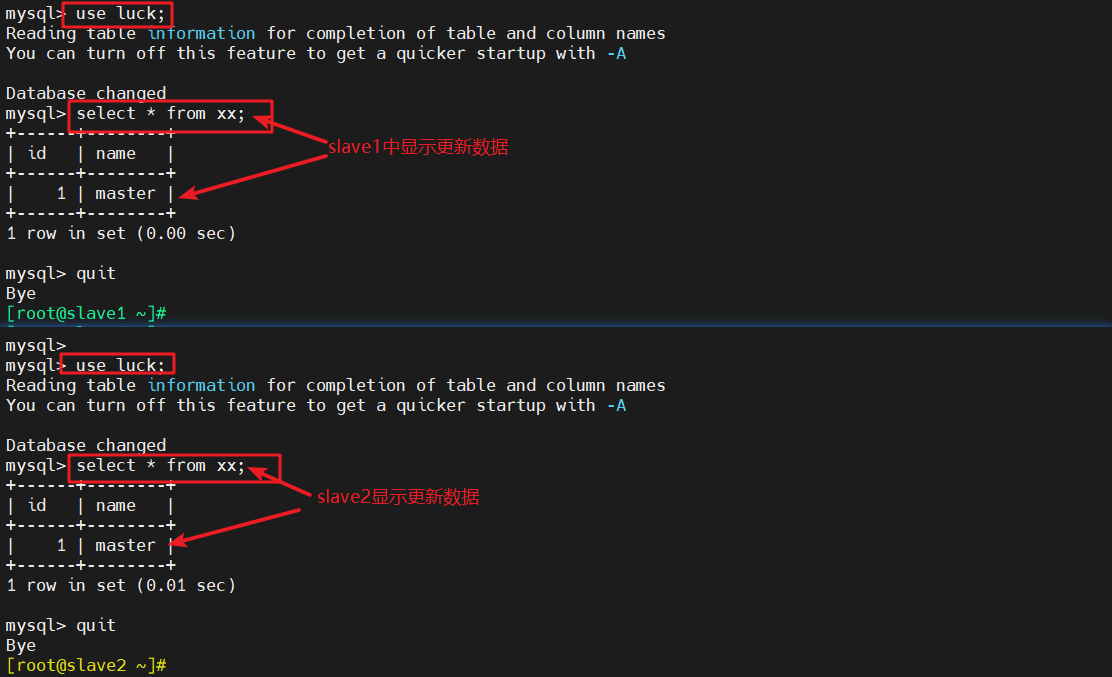

3.1.4 检测mysql主从同步配置

- master(192.168.10.11)

- master数据库更新数据

create database luck;

#创建库

use luck;

#切换数据库

create table xx(id int,name char(8));

#创建xx表

insert into xx values(1,'master');

#xx表中插入数据

select * from xx;

#查询xx表的信息

-

查看从数据库信息

-

slave1(192.168.10.12)、slave2(192.168.10.13)

use luck;

#切换数据库

select * from xx;

#查看xx表的信息

总结:master服务器中更新数据,slave服务器同样可以查询到数据,主从复制设置完成

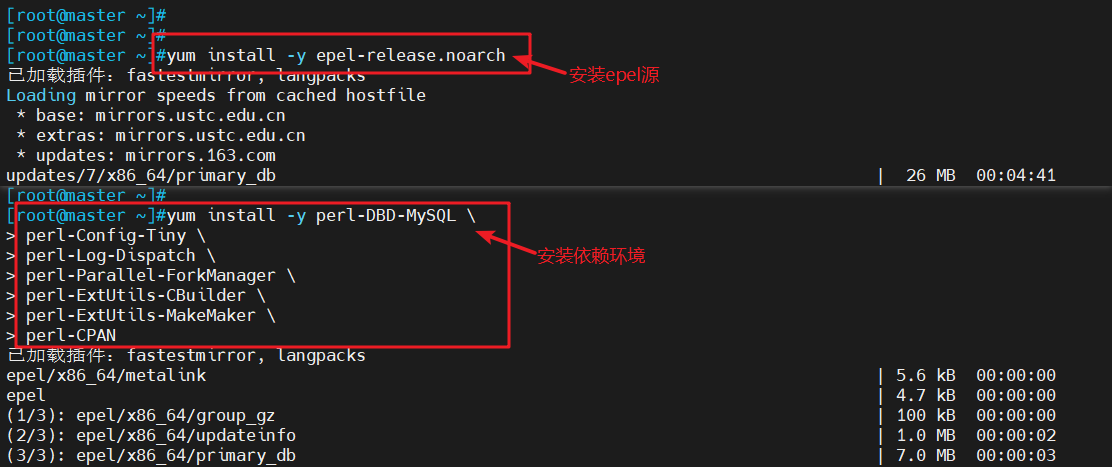

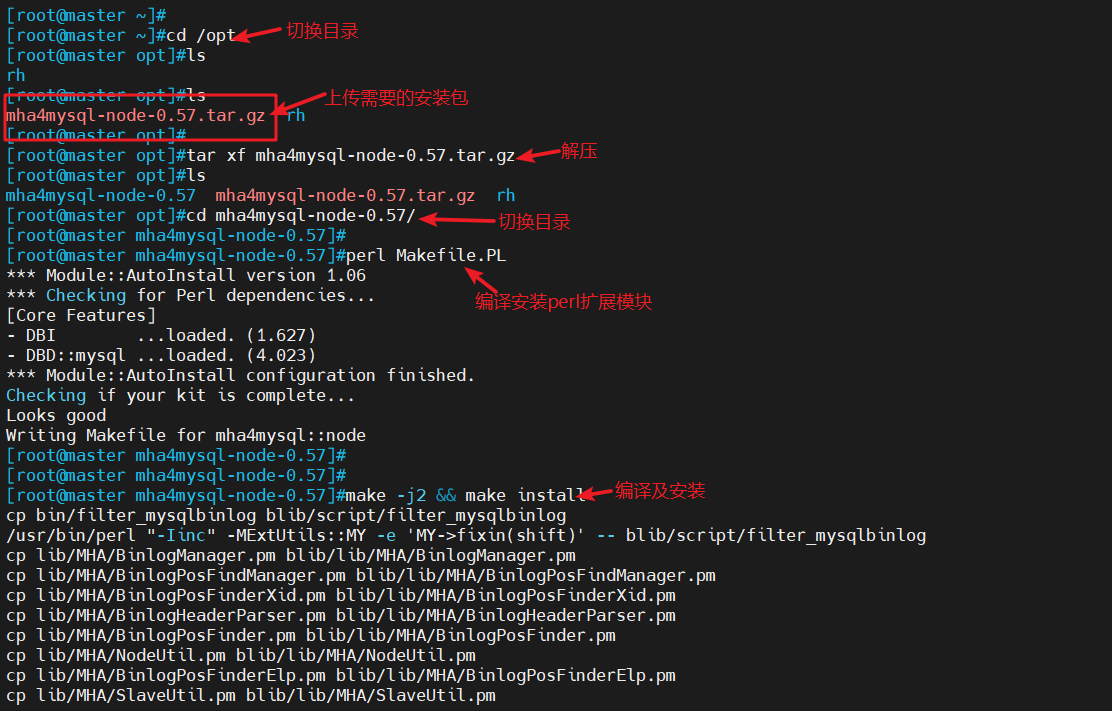

3.2 安装MHA服务

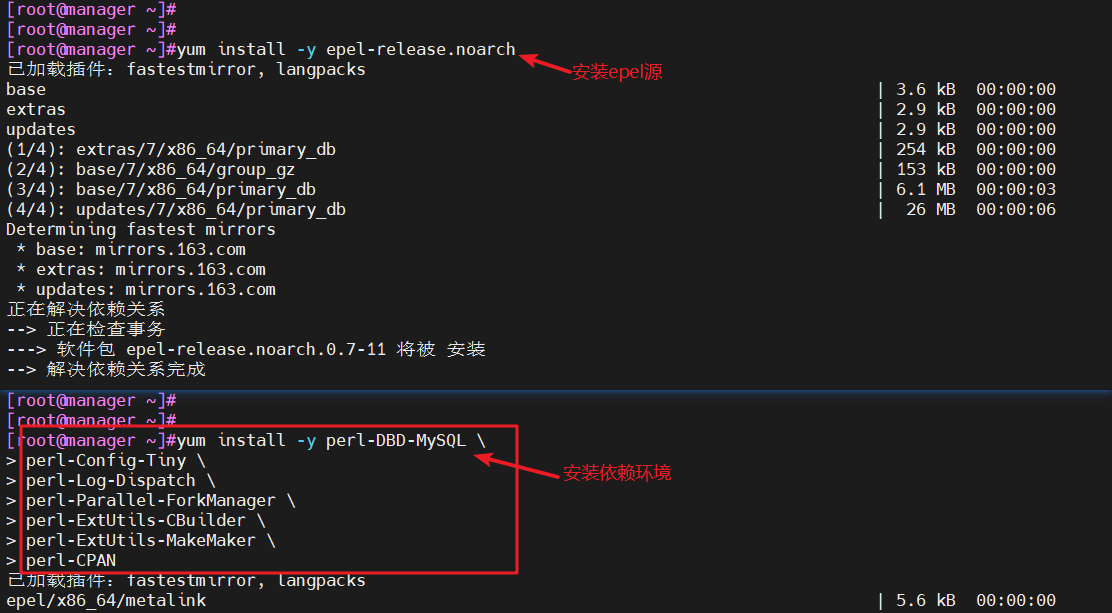

3.2.1 所有服务器上安装MHA依赖环境,首先安装epel源

- master(192.168.10.11)、slave(192.168.10.12;192.168.10.13)、MHA manager(192.168.10.14)

yum install -y epel-release.noarch

#安装epel源

yum install -y perl-DBD-MySQL \

perl-Config-Tiny \

perl-Log-Dispatch \

perl-Parallel-ForkManager \

perl-ExtUtils-CBuilder \

perl-ExtUtils-MakeMaker \

perl-CPAN

#安装依赖环境

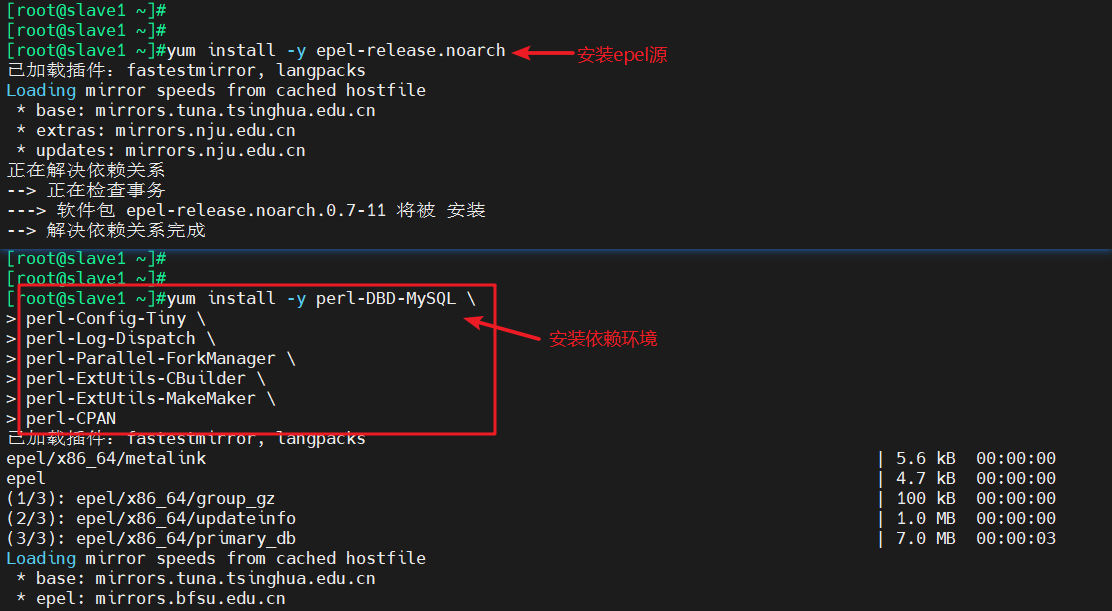

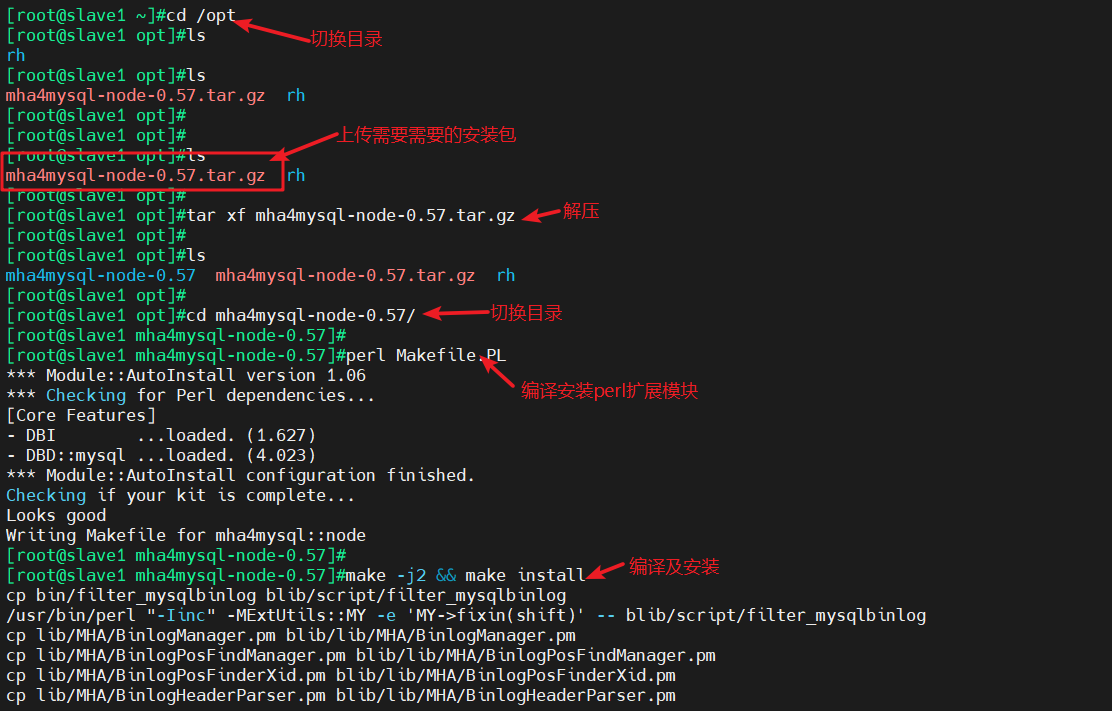

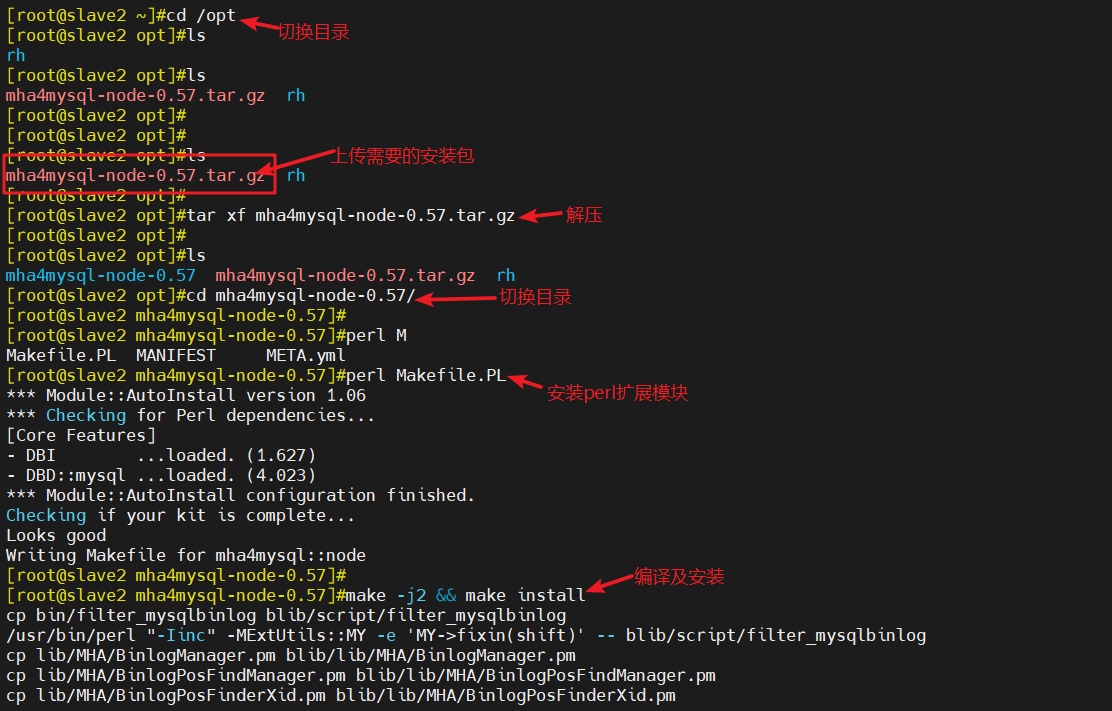

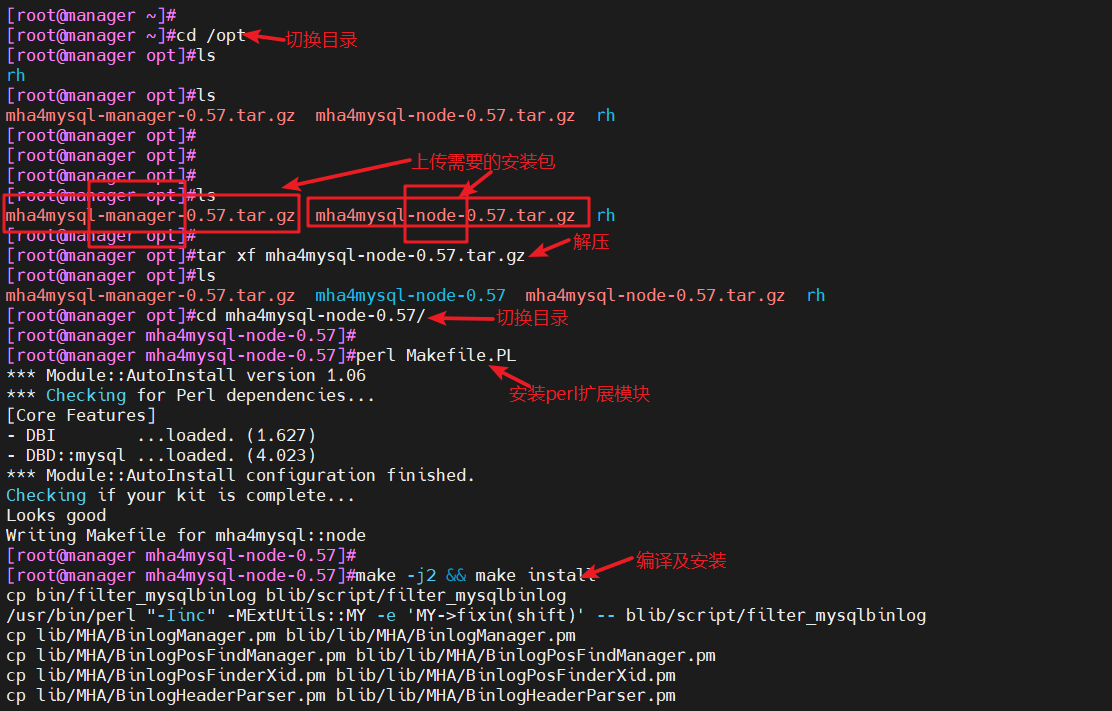

cd /opt

#切换目录,在该目录下上传需要的安装包

tar xf mha4mysql-node-0.57.tar.gz

#解压

cd mha4mysql-node-0.57/

#切换目录

perl Makefile.PL

#编译安装perl扩展模块

make -j2 && make install

#编译及安装

- master(192.168.10.11)

- slave(192.168.10.12)

- slave(192.168.10.13)

- MHA manager(192.168.10.14)

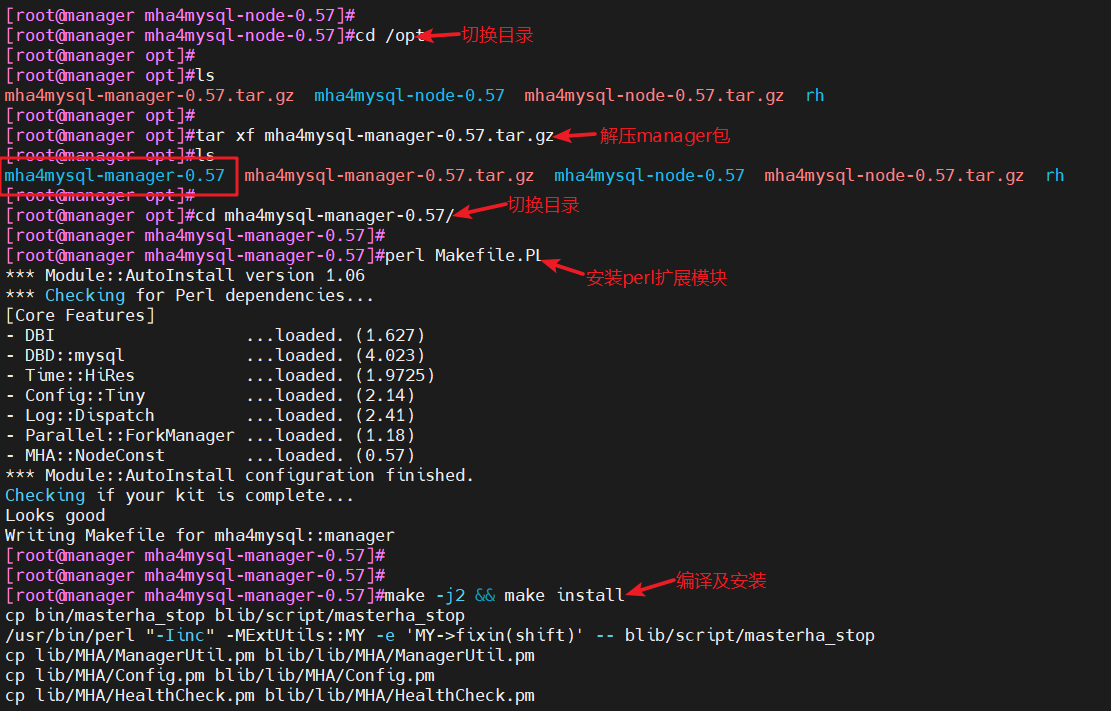

3.2.2 MHA manager节点上安装manager组件

- MHA manager(192.168.10.14)

cd /opt

#切换目录

tar xf mha4mysql-manager-0.57.tar.gz

#解压

cd mha4mysql-manager-0.57/

#切换目录

perl Makefile.PL

#编译安装perl扩展模块

make && make install

#编译及安装

3.2.3 配置到数据库节点的无密码认证

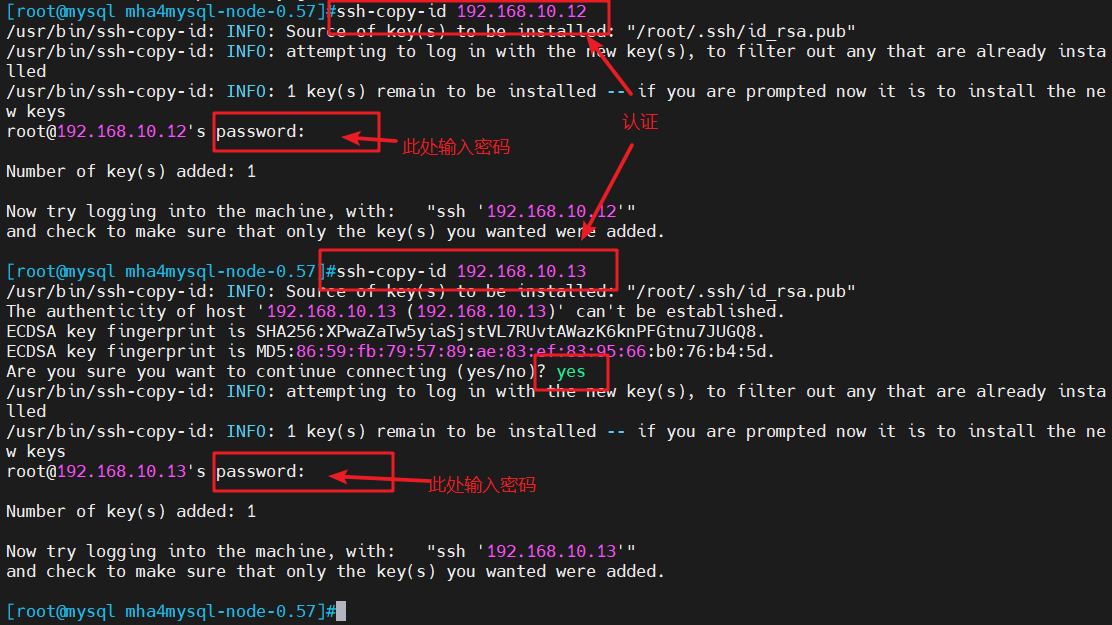

- master(192.168.10.11)

ssh-keygen -t rsa

#一直按回车键

ssh-copy-id 192.168.10.12

#输入密码(12地址的登录密码,非第一次连接时,不再需要输入yes)

ssh-copy-id 192.168.10.13

#输入yes,输入密码(13地址的登录密码)

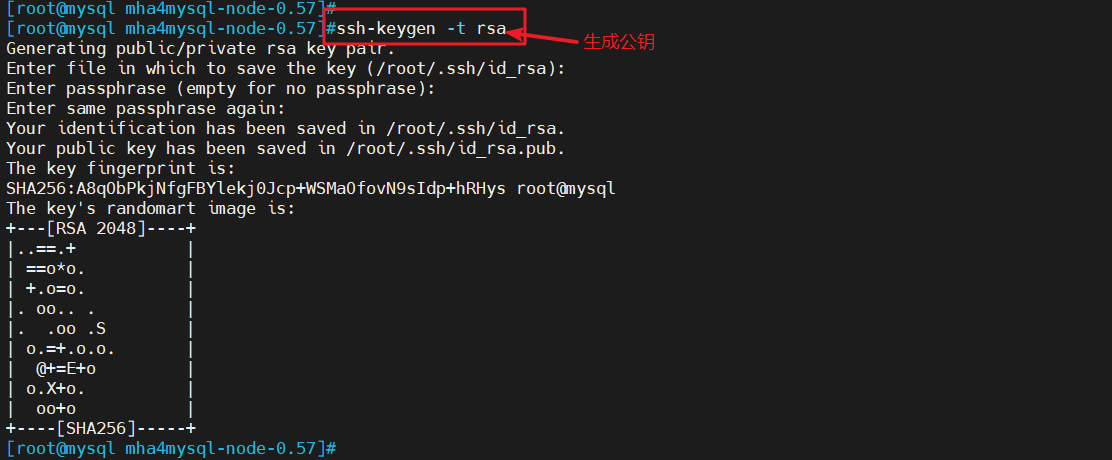

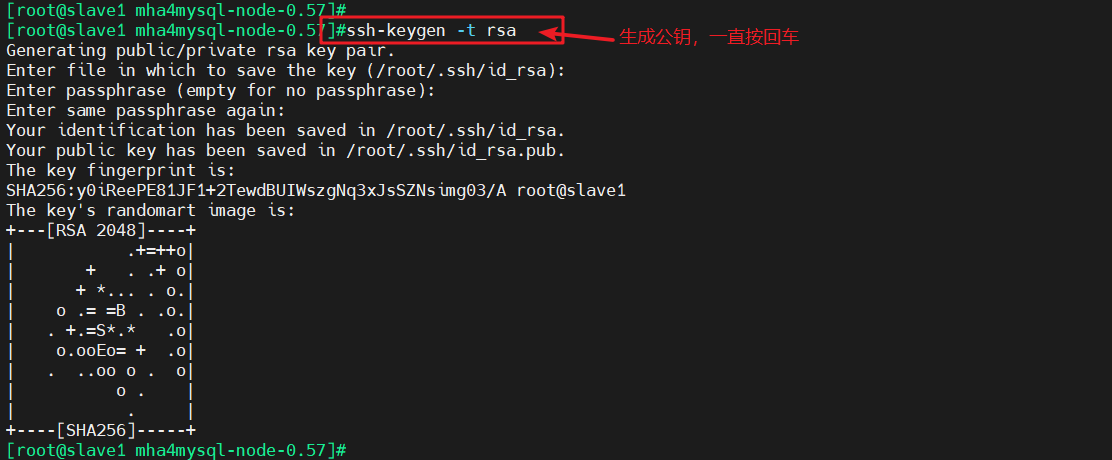

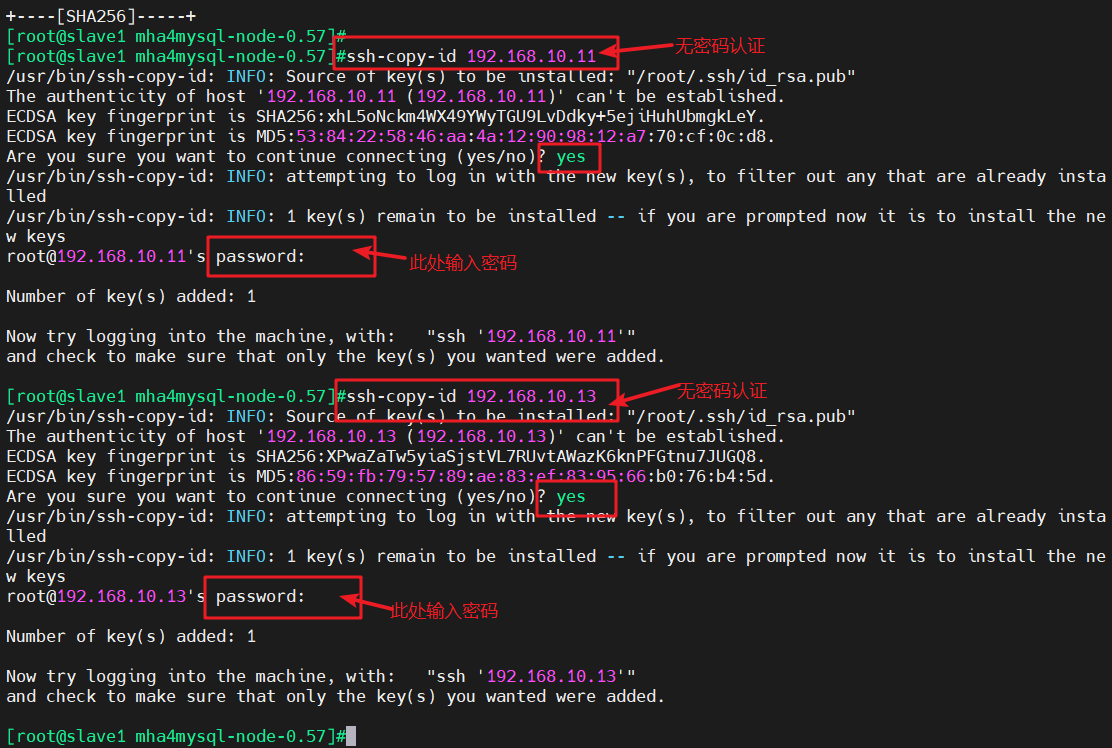

- slave1(192.168.10.12)

ssh-keygen -t rsa

#一直按回车键

ssh-copy-id 192.168.10.11

#输入yes,输入密码

ssh-copy-id 192.168.10.13

#输入yes,输入密码

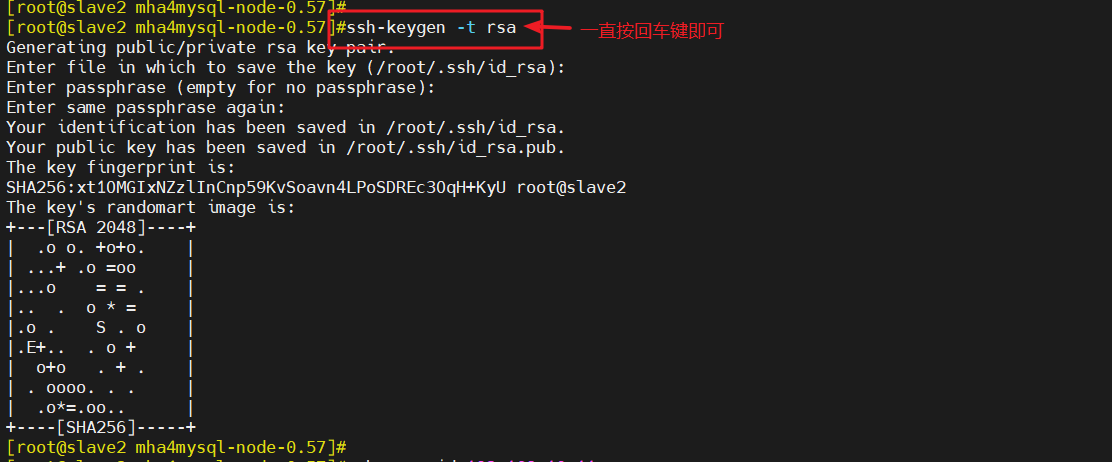

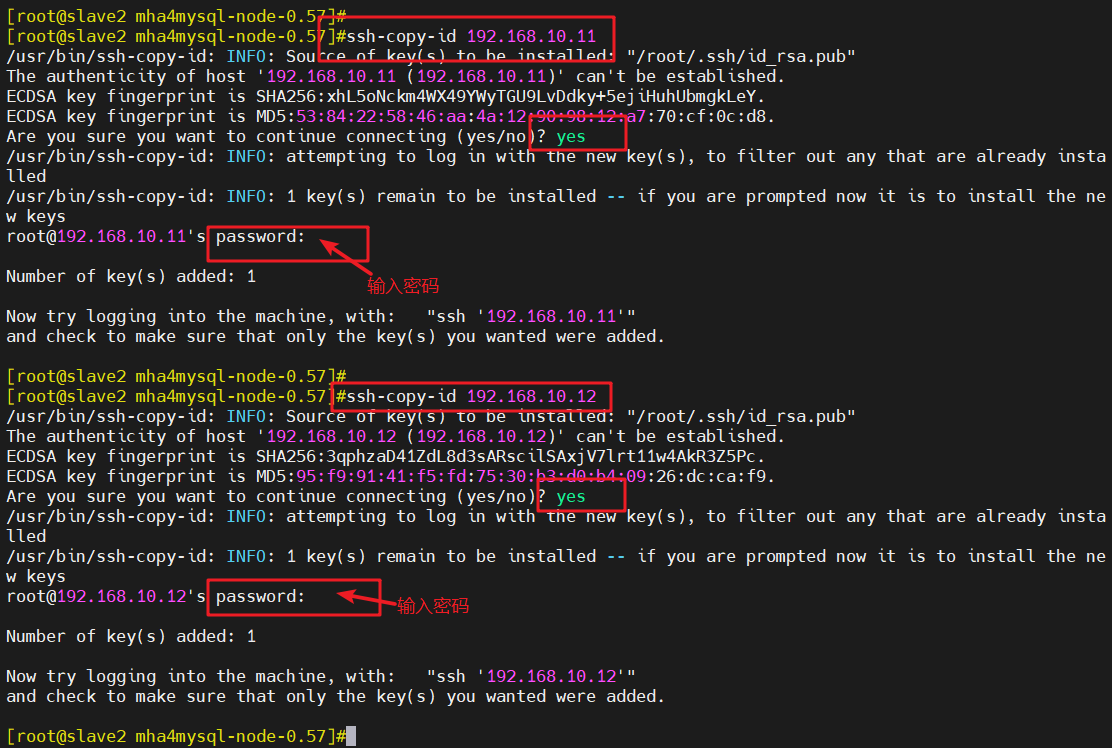

- slave2(192.168.10.13)

ssh-keygen -t rsa

#一直按回车键

ssh-copy-id 192.168.10.11

#输入yes,输入密码

ssh-copy-id 192.168.10.12

#输入yes,输入密码

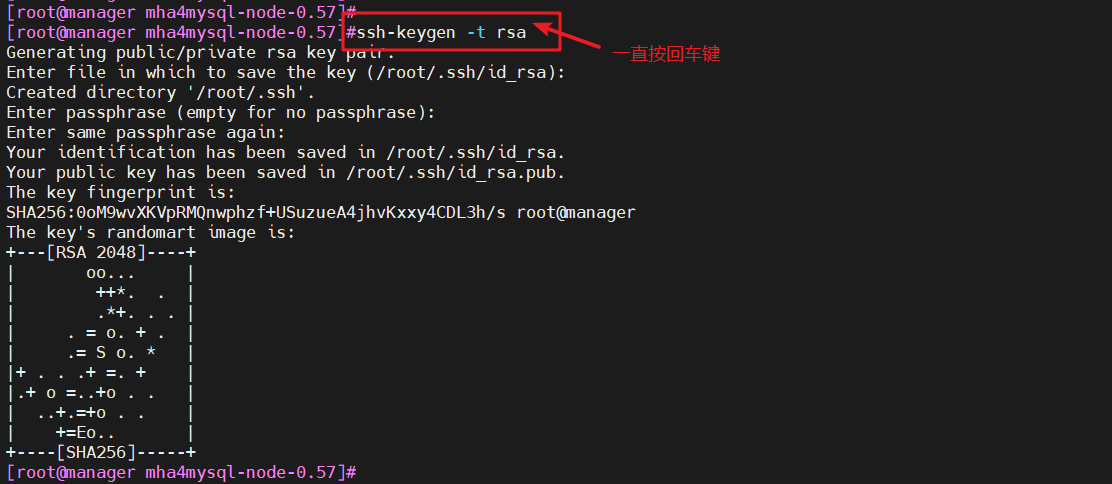

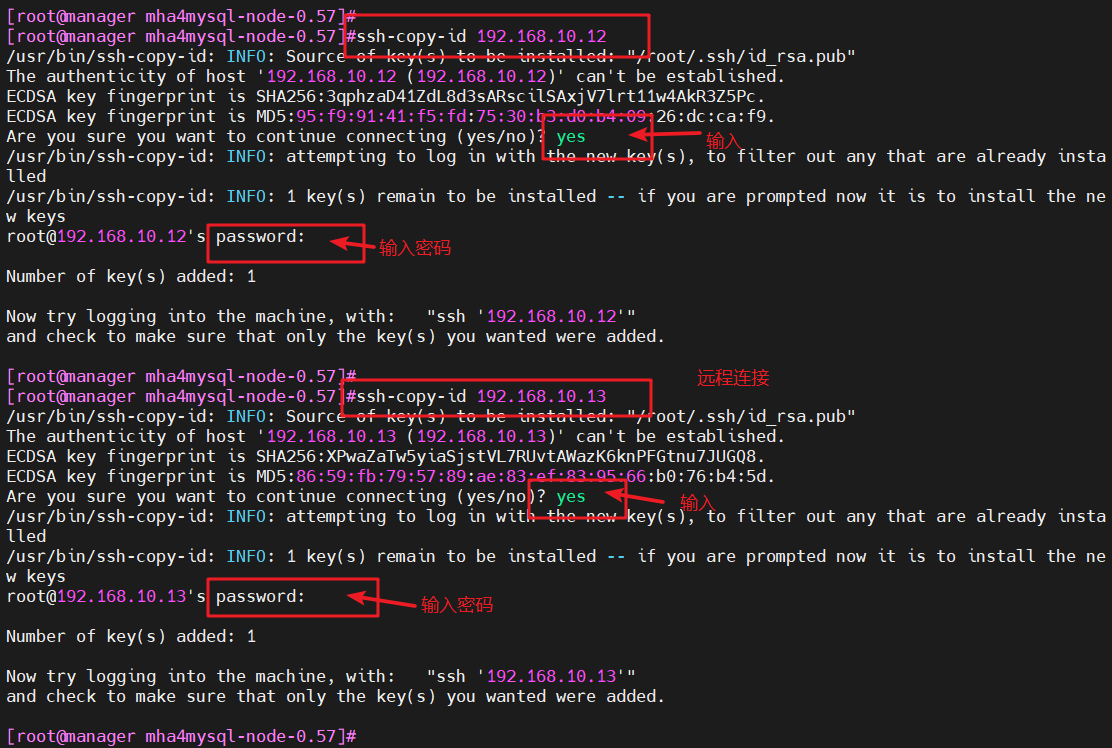

- MHA manager

ssh-keygen -t rsa

#一直按回车键

ssh-copy-id 192.168.10.11

#输入yes,输入密码

ssh-copy-id 192.168.10.12

#输入yes,输入密码

ssh-copy-id 192.168.10.13

#输入yes,输入密码

3.2.4 在manage节点配置MHA

- MHA manager(192.168.10.14)

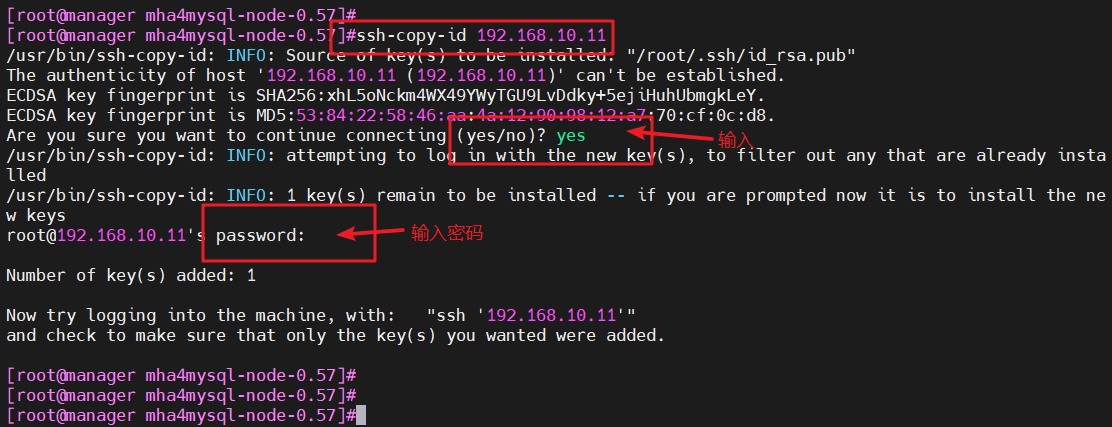

cp -a /opt/mha4mysql-manager-0.57/samples/scripts/ /usr/local/bin/

#复制相关脚本文件到/usr/local/bin目录

ls /usr/local/bin/scripts/

master_ip_failover

#自动切换时VIP的管理脚本

master_ip_online_change

#在线切换时VIP的管理脚本

power_manager

#故障发生后关闭主机的脚本

send_report

#因故障切换后发送报警的脚本

cp /usr/local/bin/scripts/master_ip_failover /usr/local/bin

#复制文件到/usr/local/bin目录

#master_ip_failover脚本来管理VIP和故障切换

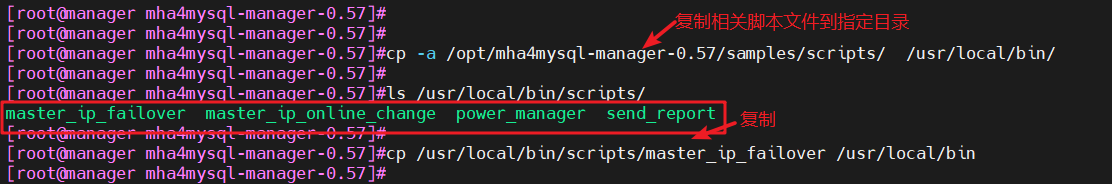

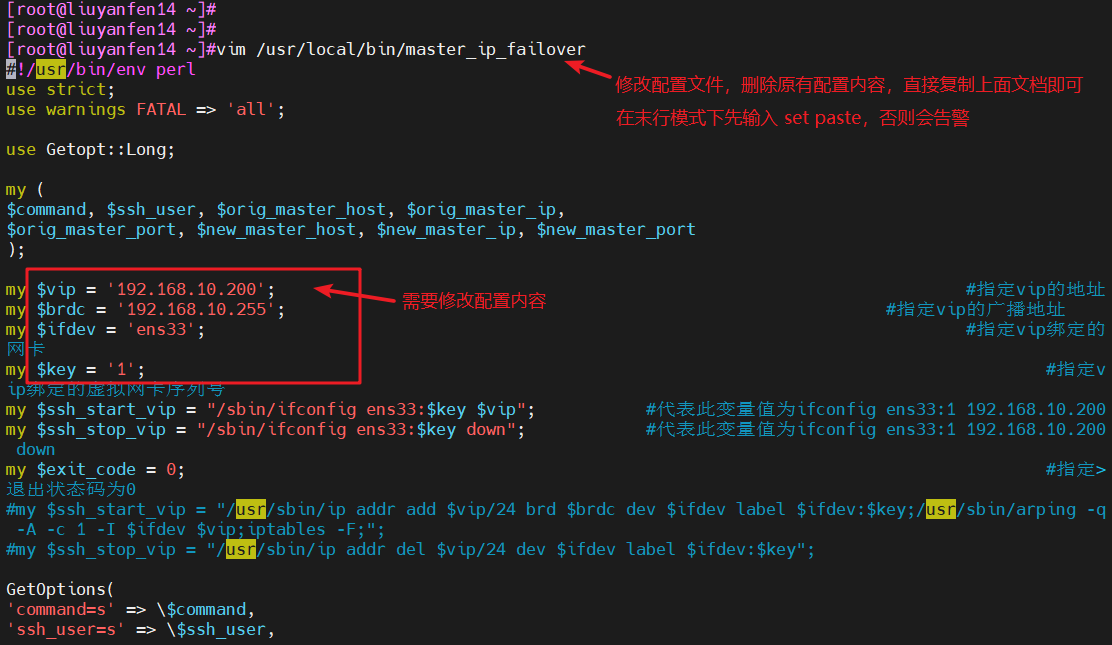

#修改配置文件,删除原有内容,直接复制,需要修改vip地址相关参数

#复制粘贴之前,在末行模式下先输入 set paste 否则会告警

vim /usr/local/bin/master_ip_failover

#!/usr/bin/env perl

use strict;

use warnings FATAL => 'all';

use Getopt::Long;

my (

$command, $ssh_user, $orig_master_host, $orig_master_ip,

$orig_master_port, $new_master_host, $new_master_ip, $new_master_port

);

my $vip = '192.168.10.200'; #指定vip的地址

my $brdc = '192.168.10.255'; #指定vip的广播地址

my $ifdev = 'ens33'; #指定vip绑定的网卡

my $key = '1'; #指定vip绑定的虚拟网卡序列号

my $ssh_start_vip = "/sbin/ifconfig ens33:$key $vip"; #代表此变量值为ifconfig ens33:1 192.168.10.200

my $ssh_stop_vip = "/sbin/ifconfig ens33:$key down"; #代表此变量值为ifconfig ens33:1 192.168.10.200 down

my $exit_code = 0; #指定>退出状态码为0

#my $ssh_start_vip = "/usr/sbin/ip addr add $vip/24 brd $brdc dev $ifdev label $ifdev:$key;/usr/sbin/arping -q -A -c 1 -I $ifdev $vip;iptables -F;";

#my $ssh_stop_vip = "/usr/sbin/ip addr del $vip/24 dev $ifdev label $ifdev:$key";

GetOptions(

'command=s' => \$command,

'ssh_user=s' => \$ssh_user,

'orig_master_host=s' => \$orig_master_host,

'orig_master_ip=s' => \$orig_master_ip,

'orig_master_port=i' => \$orig_master_port,

'new_master_host=s' => \$new_master_host,

'new_master_ip=s' => \$new_master_ip,

'new_master_port=i' => \$new_master_port,

);

exit &main();

sub main {

print "\n\nIN SCRIPT TEST====$ssh_stop_vip==$ssh_start_vip===\n\n";

if ( $command eq "stop" || $command eq "stopssh" ) {

my $exit_code = 1;

eval {

print "Disabling the VIP on old master: $orig_master_host \n";

&stop_vip();

$exit_code = 0;

};

if ($@) {

warn "Got Error: $@\n";

exit $exit_code;

}

exit $exit_code;

}

elsif ( $command eq "start" ) {

my $exit_code = 10;

eval {

print "Enabling the VIP - $vip on the new master - $new_master_host \n";

&start_vip();

$exit_code = 0;

};

if ($@) {

warn $@;

exit $exit_code;

}

exit $exit_code;

}

elsif ( $command eq "status" ) {

print "Checking the Status of the script.. OK \n";

exit 0;

}

else {

&usage();

exit 1;

}

}

sub start_vip() {

`ssh $ssh_user\@$new_master_host \" $ssh_start_vip \"`;

}

## A simple system call that disable the VIP on the old_master

sub stop_vip() {

`ssh $ssh_user\@$orig_master_host \" $ssh_stop_vip \"`;

}

sub usage {

print

"Usage: master_ip_failover --command=start|stop|stopssh|status --orig_master_host=host --orig_master_ip=ip --orig_master_port=port --new_master_host=host --new_master_ip=ip --new_master_port=port\n";

}

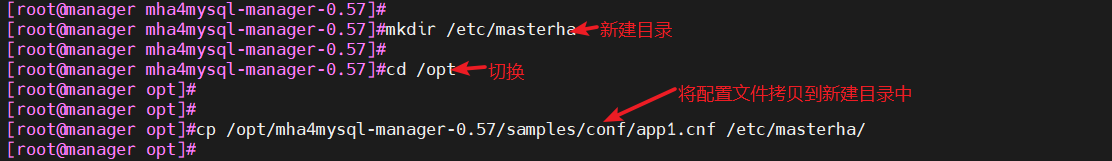

mkdir /etc/masterha

#新建目录

cp /opt/mha4mysql-manager-0.57/samples/conf/app1.cnf /etc/masterha

#将配置文件拷贝到新建的目录中

#修改配置文件,删除原有内容,直接复制,修改节点服务器的ip

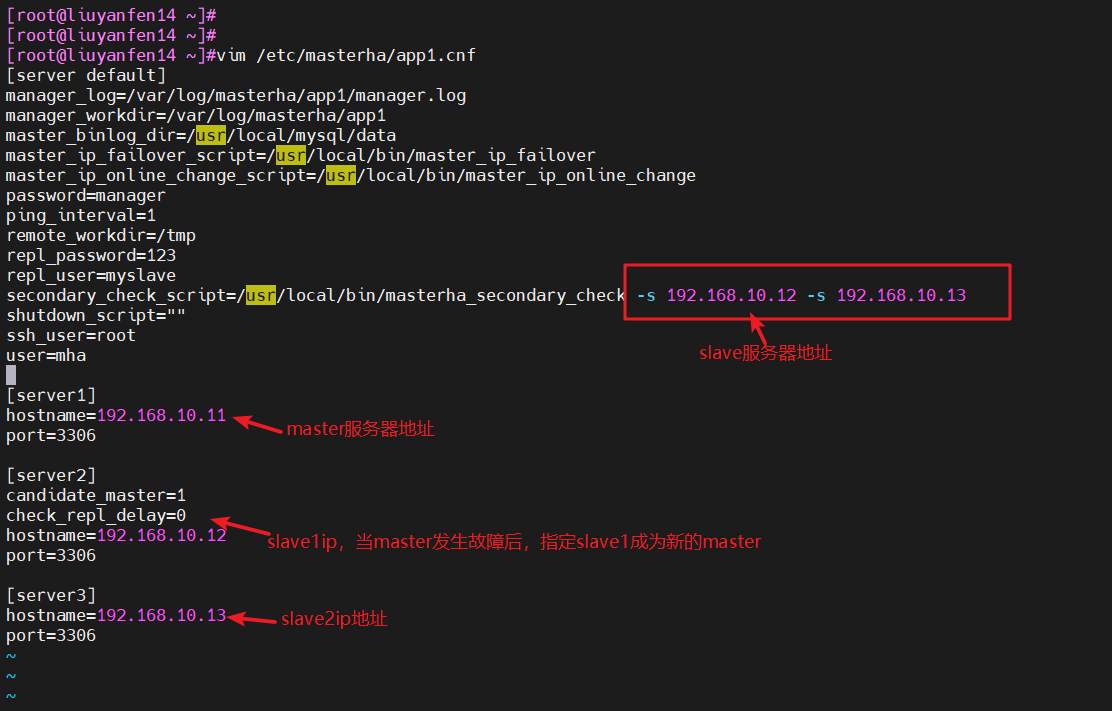

vim /etc/masterha/app1.cnf

[server default]

manager_log=/var/log/masterha/app1/manager.log

manager_workdir=/var/log/masterha/app1

master_binlog_dir=/usr/local/mysql/data

master_ip_failover_script=/usr/local/bin/master_ip_failover

master_ip_online_change_script=/usr/local/bin/master_ip_online_change

password=manager

ping_interval=1

remote_workdir=/tmp

repl_password=123

repl_user=myslave

secondary_check_script=/usr/local/bin/masterha_secondary_check -s 192.168.10.12 -s 192.168.10.13

shutdown_script=""

ssh_user=root

user=mha

[server1]

hostname=192.168.10.11

port=3306

[server2]

candidate_master=1

check_repl_delay=0

hostname=192.168.10.12

port=3306

[server3]

hostname=192.168.10.13

port=3306

##说明

[server default]

manager_log=/var/log/masterha/app1/manager.log

#manager日志

manager_workdir=/var/log/masterha/app1

#manager工作目录

master_binlog_dir=/usr/local/mysql/data

#master保存binlog的位置,这里的路径要与master里配置的binlog的路径一致,以便MHA能找到

master_ip_failover_script=/usr/local/bin/master_ip_failover

#设置自动failover时候的切换脚本,也就是上面的那个脚本

master_ip_online_change_script=/usr/local/bin/master_ip_online_change

#设置手动切换时候的切换脚本

password=manager

#设置mysql中root用户的密码,这个密码是前文中创建监控用户的那个密码

ping_interval=1

#设置监控主库,发送ping包的时间间隔,默认是3秒,尝试三次没有回应的时候自动进行failover

remote_workdir=/tmp

#设置远端mysql在发生切换时binlog的保存位置

repl_password=123

#设置复制用户的密码

repl_user=myslave

#设置复制用户的用户

secondary_check_script=/usr/local/bin/masterha_secondary_check -s 192.168.10.12 -s 192.168.10.13

#指定检查的从服务器IP地址

shutdown_script=""

#设置故障发生后关闭故障主机脚本(该脚本的主要作用是关闭主机防止发生脑裂,这里没有使用)

ssh_user=root

#设置ssh的登录用户名

user=mha

#设置监控用户root

[server1]

hostname=192.168.10.11

port=3306

[server2]

candidate_master=1

#设置为候选master,设置该参数以后,发生主从切换以后将会将此从库提升为主库,即使这个从库不是集群中最新的slave

check_repl_delay=0

#默认情况下如果一个slave落后master 超过100M的relay logs的话,MHA将不会选择该slave作为一个新的master, 因为对于这个slave的恢复需要花费很长时间;通过设置check_repl_delay=0,MHA触发切换在选择一个新的master的时候将会忽略复制延时,这个参数对于设置了candidate_master=1的主机非常有用,因为这个候选主在切换的过程中一定是新的master

hostname=192.168.10.12

port=3306

[server3]

hostname=192.168.10.13

port=3306

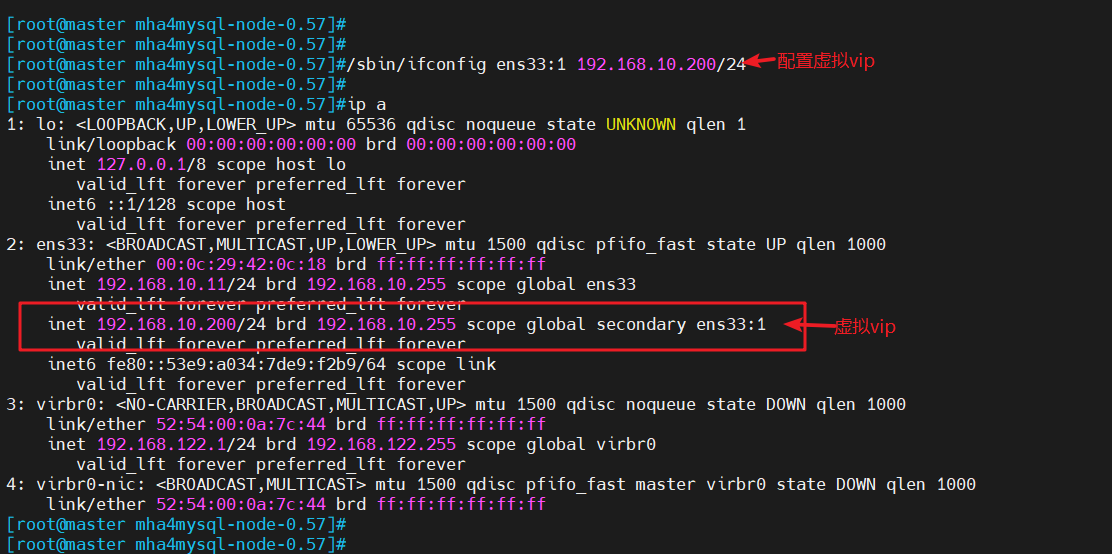

3.2.5 第一次配置需要在 Master 节点上手动开启虚拟IP

/sbin/ifconfig ens33:1 192.168.10.200/24

#配置虚拟vip

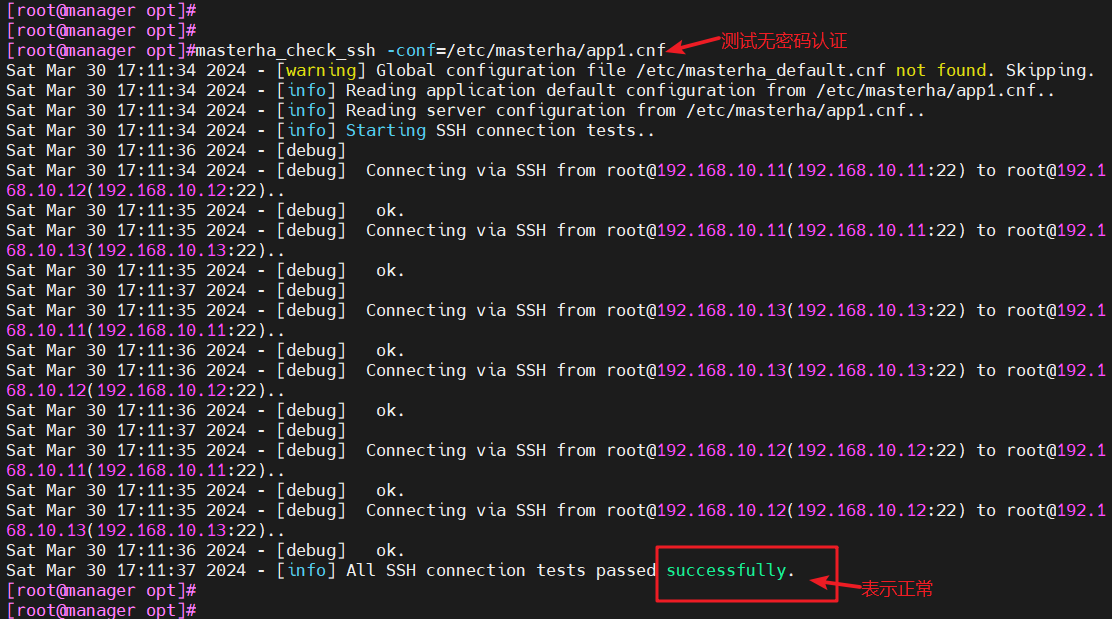

3.2.6 在manager节点上测试ssh无密码认证

- MHA manager(192.168.10.14)

masterha_check_ssh -conf=/etc/masterha/app1.cnf

#测试ssh无密码认证

#如果配置正常,最后会输出successfully

3.2.7 在manager节点上测试mysql主从连接情况

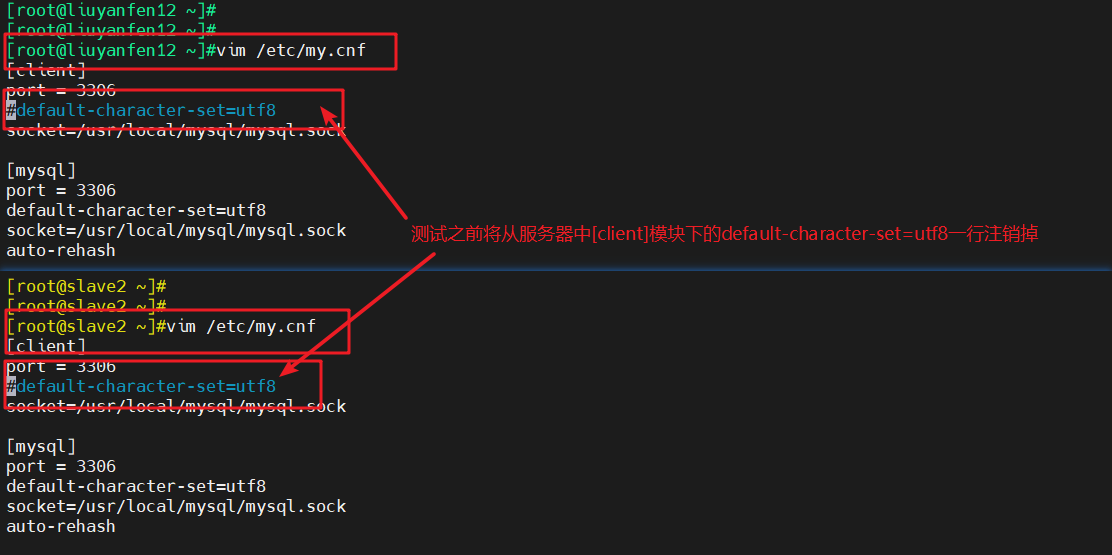

- slave1(192.168.10.12)、slave(192.168.10.13)

#修改从服务器的配置文件

vim /etc/my.cnf

[client]

port = 3306

#default-character-set=utf8

#注销掉此行

socket=/usr/local/mysql/mysql.sock

systemctl restart mysqld.service

#重启服务

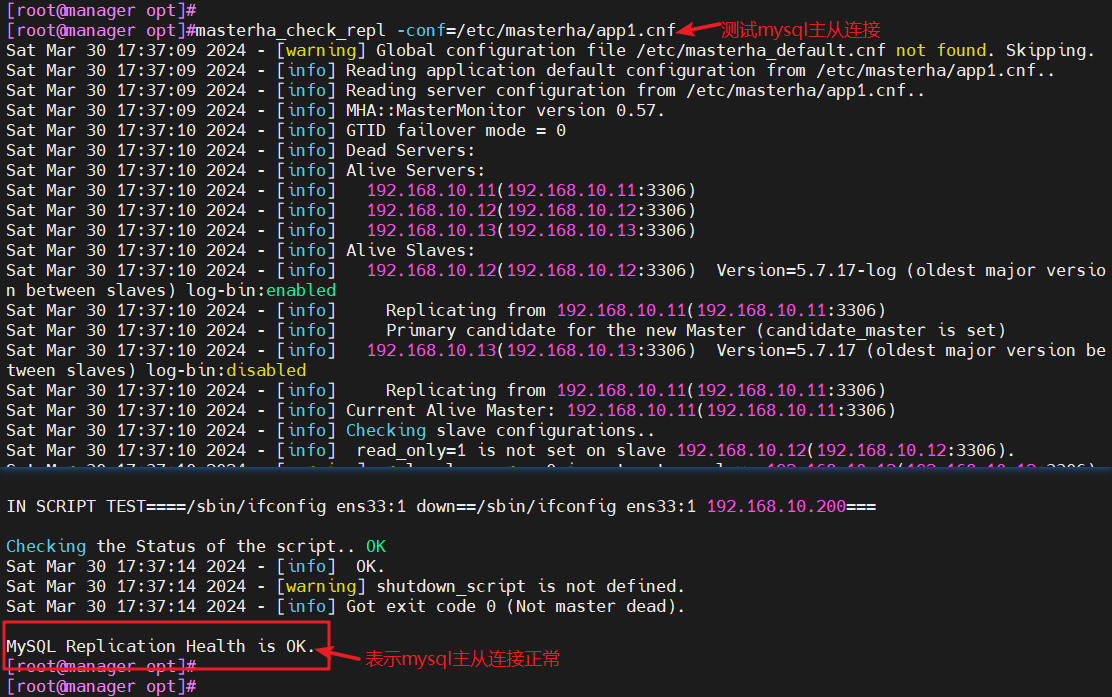

- MHA manager(192.168.10.14)

masterha_check_repl -conf=/etc/masterha/app1.cnf

#测试mysql主从连接情况

#MySQL Replication Health is OK.表示连接情况正常

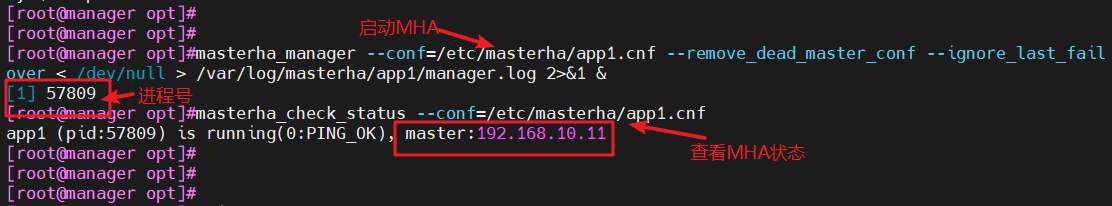

3.2.8 在manager节点上启动MHA

- MHA manager(192.168.10.14)

masterha_manager --conf=/etc/masterha/app1.cnf --remove_dead_master_conf --ignore_last_failover < /dev/null > /var/log/masterha/app1/manager.log 2>&1 &

#启动MHA服务

[1] 57809

#显示MHA进程号

##说明

--remove_dead_master_conf:该参数代表当发生主从切换后,老的主库的 ip 将会从配置文件中移除。

--ignore_last_failover:在缺省情况下,如果 MHA 检测到连续发生宕机,且两次宕机间隔不足 8 小时的话,则不会进行 Failover, 之所以这样限制是为了避免 ping-pong 效应。该参数代表忽略上次 MHA 触发切换产生的文件,默认情况下,MHA 发生切换后会在日志记目录,也就是上面设置的日志app1.failover.complete文件,下次再次切换的时候如果发现该目录下存在该文件将不允许触发切换,除非在第一次切换后收到删除该文件,为了方便,这里设置为--ignore_last_failover。

masterha_check_status --conf=/etc/masterha/app1.cnf

#查看MHA状态,此时master是192.168.10.11

总结:此处截止,实现MHA高可用配置,若是master数据库出现故障,会将slave1当做新的master继续运行,不会影响数据库正常工作

总结:此处截止,实现MHA高可用配置,若是master数据库出现故障,会将slave1当做新的master继续运行,不会影响数据库正常工作

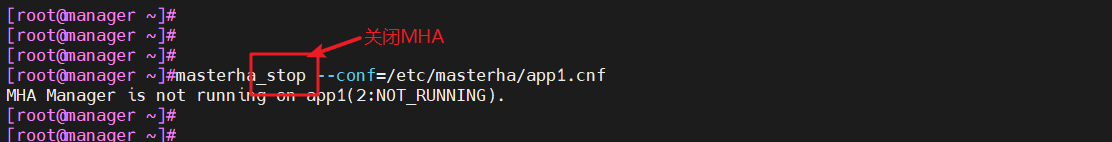

- manager(192.168.10.14)

masterha_stop --conf=/etc/masterha/app1.cnf

#关闭NHA服务

4、故障模拟与修复

4.1 模拟故障

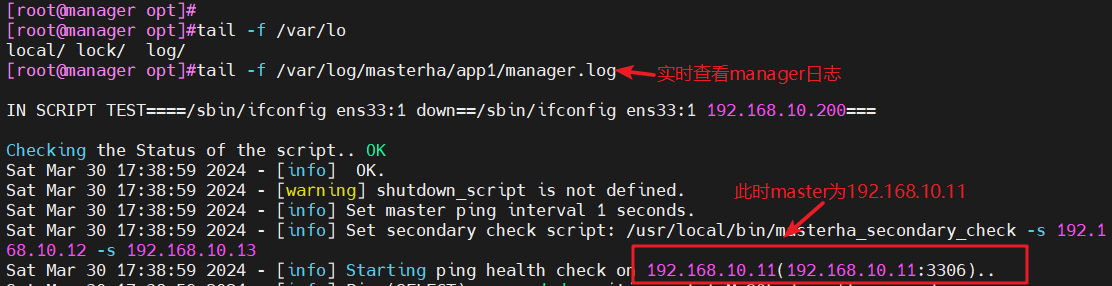

4.1.1 manager节点上监控观察日志记录

- MHA manager(192.168.10.14)

tail -f /var/log/masterha/app1/manager.log

#实时查看日志

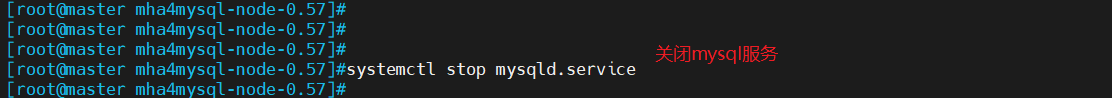

4.1.2 停止master服务器的mysql服务

- master(192.168.10.11)

systemctl stop mysqld.service

#关闭mysql

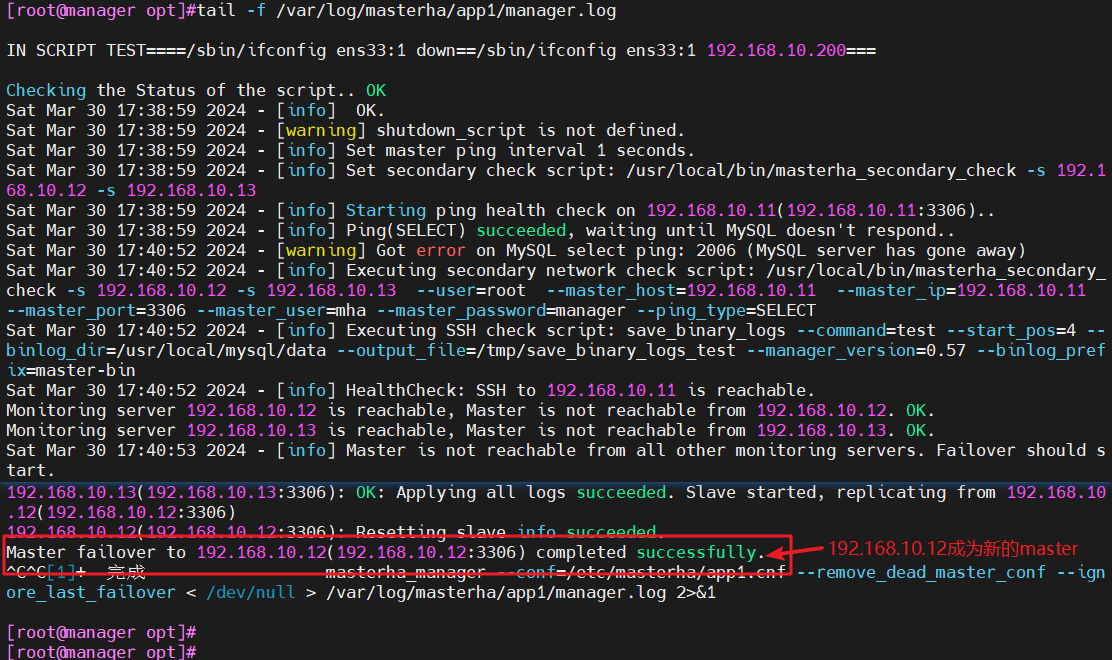

- MHA manager(192.168.10.14)

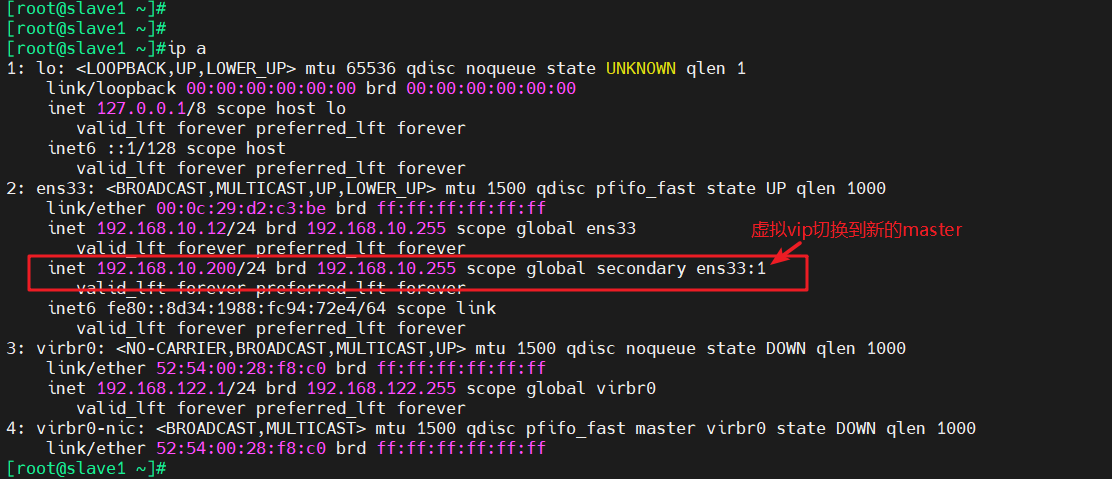

- slave1(192.168.10.12),成为新的master

- MHA manager(192.168.10.14)

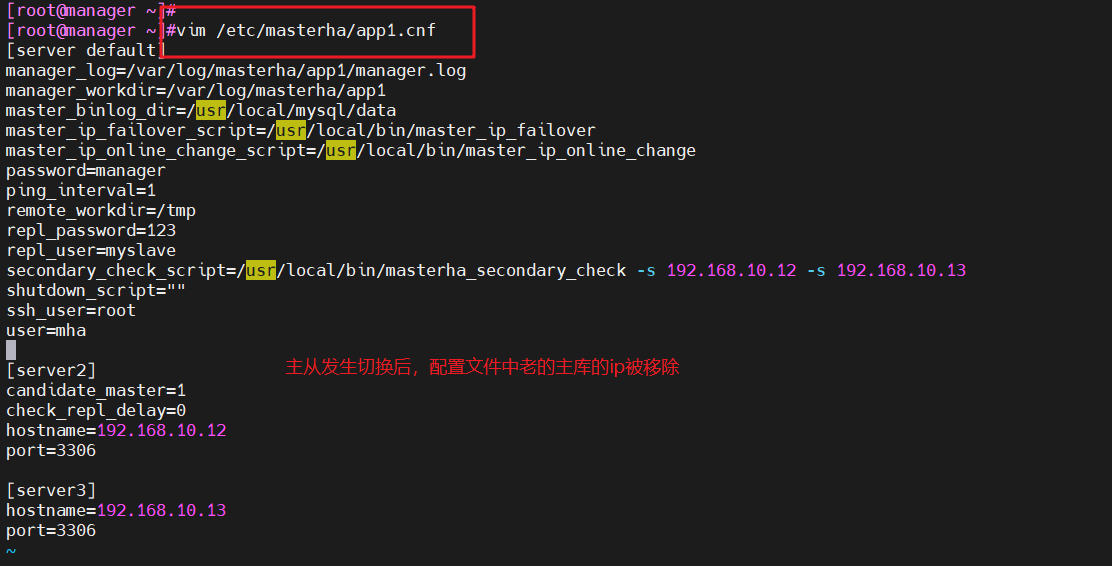

vim /etc/masterha/app1.cnf

#查看配置文件内容

#正常自动切换一次后,MHA进程会退出。HMA会自动修改app1.cnf文件内容,将宕机的mysql节点删除

故障切换备选主库的算法

- 一般判断从库的是从(position/GTID)判断优劣,数据有差异,最接近于master的slave,成为备选主。

- 数据一致的情况下,按照配置文件顺序,选择备选主库。

- 设定有权重(candidate_master=1),按照权重强制指定备选主。

- 默认情况下如果一个slave落后master 100M的relay logs的话,即使有权重,也会失效。

- 如果check_repl_delay=0的话,即使落后很多日志,也强制选择其为备选主。

4.2 修复故障

4.2.1 修复mysql主从

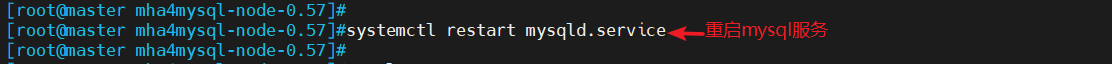

- master(192.168.10.11)

systemctl restart mysqld.service

#重启mysql服务

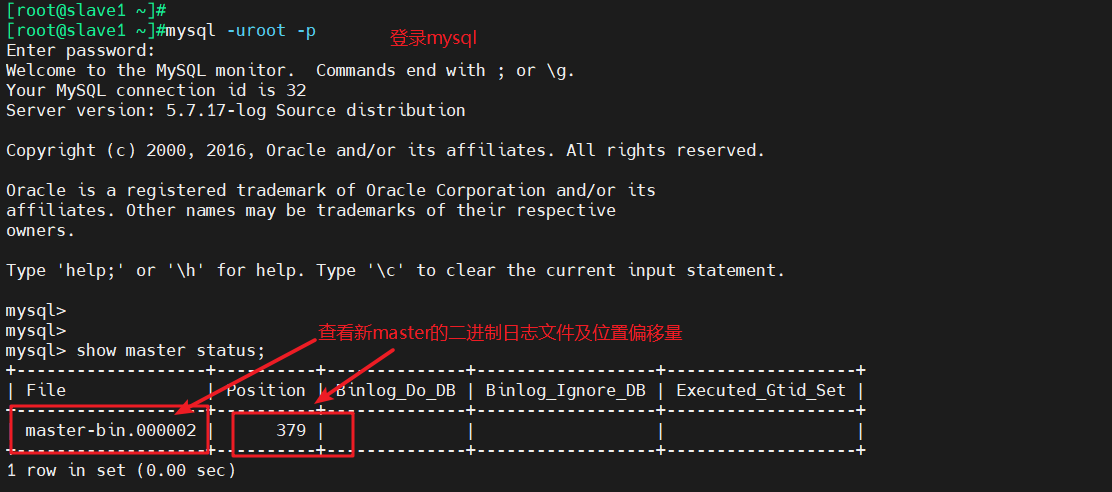

- slave1(192.168.10.12)、新master

mysql -uroot -p

#登录mysql

show master status;

#查看二进制日志文件及位置偏移量

- master(192.168.10.11)

mysql -uroot -p

#登录mysql

change master to master_host='192.168.10.12',master_user='myslave',master_password='123',master_log_file='master-bin.000002',master_log_pos=379;

#配置与新master同步

start slave;

#开启slave

show slave status\G

#查看slave状态

#IO和SQL线程都是Yes,代表同步正常

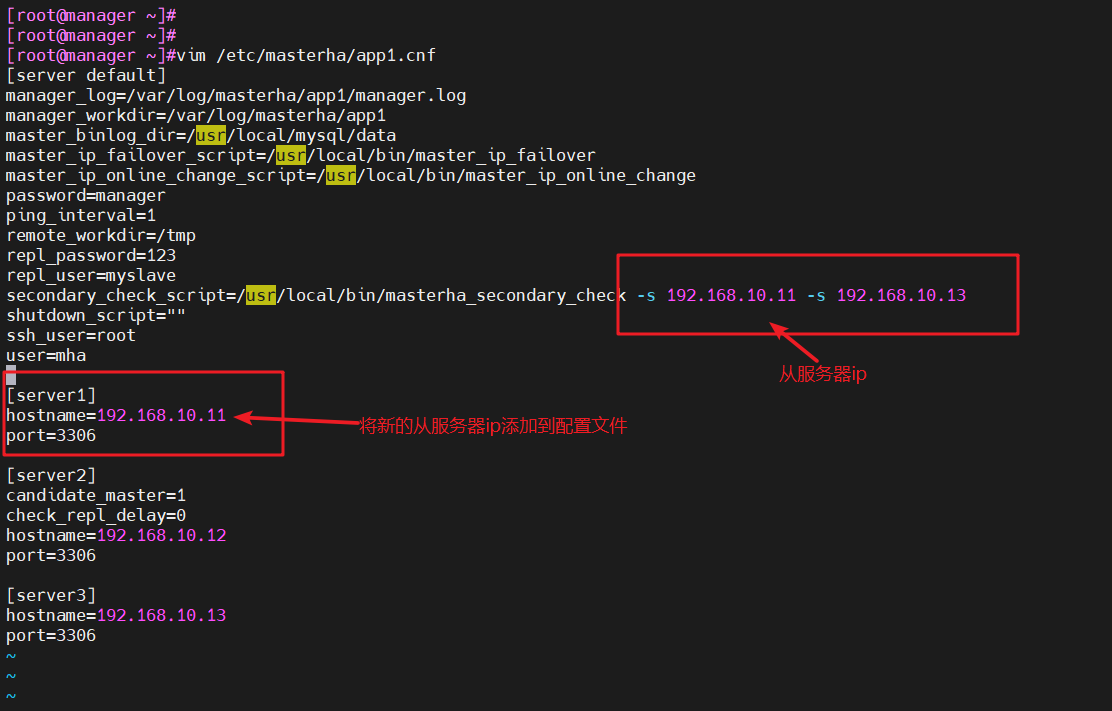

4.2.2 在manager节点上修改配置文件app1.cnf

- MHA manager(192.168.10.14)

#修改配置文件

vim /etc/masterha/app1.cnf

secondary_check_script=/usr/local/bin/masterha_secondary_check -s 192.168.10.11 -s 192.168.10.13

#修改192.168.10.11为从服务器地址

[server1]

hostname=192.168.10.11

port=3306

#将新的slave(原先master)ip添加到配置文件

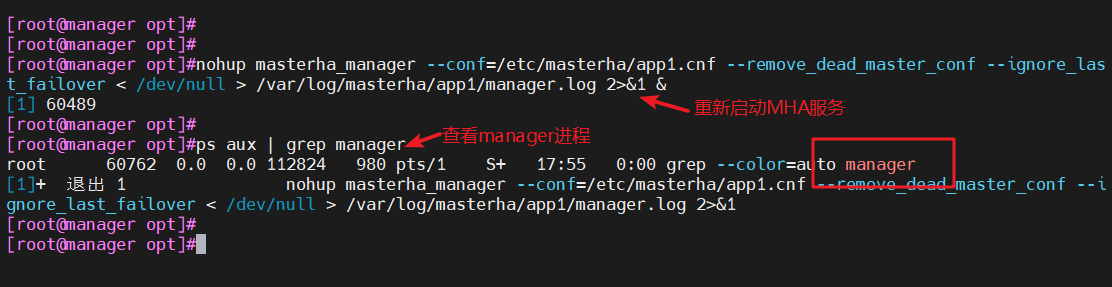

nohup masterha_manager --conf=/etc/masterha/app1.cnf --remove_dead_master_conf --ignore_last_failover < /dev/null > /var/log/masterha/app1/manager.log 2>&1 &

#重新启动MHA 服务

ps aux | grep manager

#查看manager进程

4.2.3 检测mysql主从同步

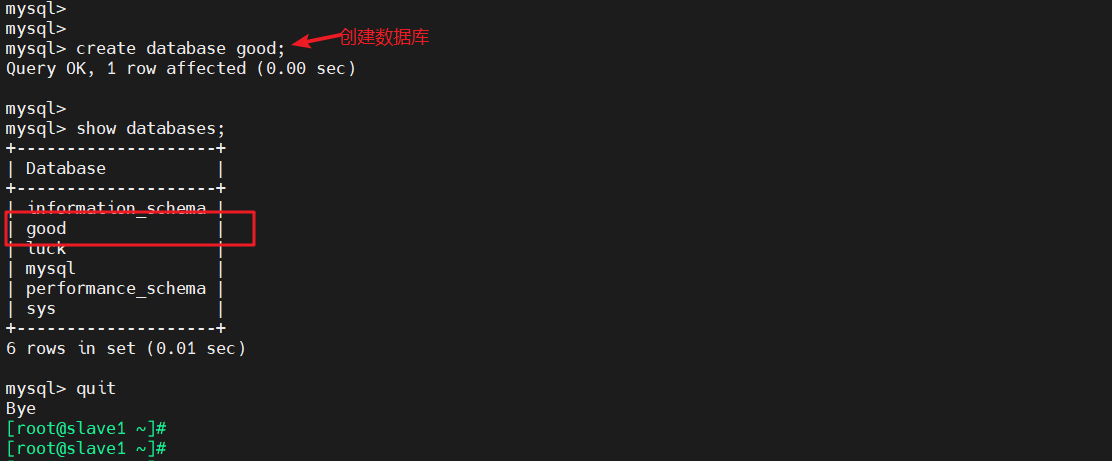

- slave1(192.168.10.12),新master

create database good;

#创建库good

show databases;

#查看数据库信息

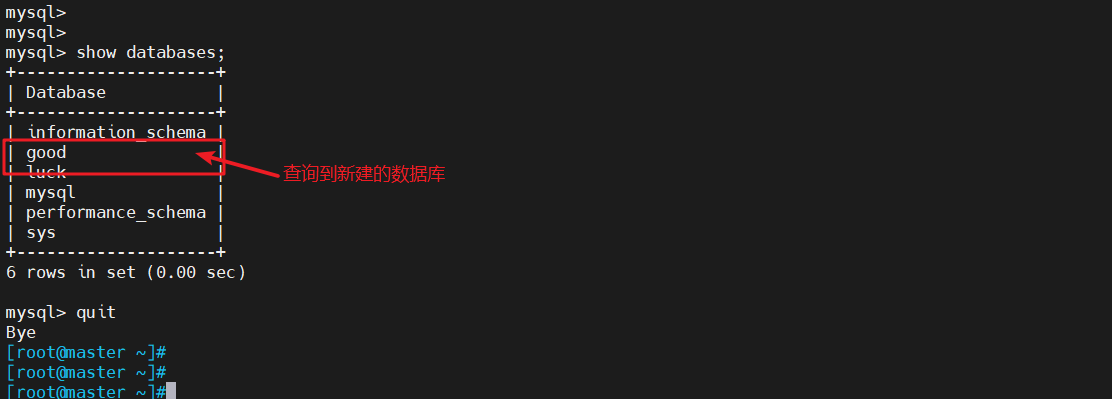

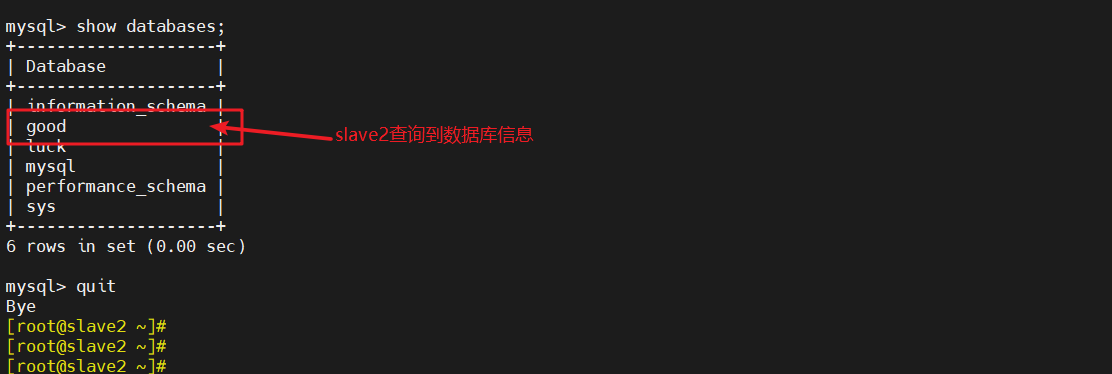

- master(192.168.10.11),新slave

- slave2(192.168.10.13)

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?