文章目录

kubeadm/flannel/dashboard/harbor部署以及服务发布

一、部署kubeadm

1、服务器配置

| 服务器(主机名) | 配置 | ip | 主要软件 |

|---|---|---|---|

| master | 2C/4G,cpu要求大于2 | 192.168.10.11 | docker/kubeadm/kubelet/kubectl/flannel |

| node01 | 2C/4G | 192.168.10.12 | docker/kubeadm/kubelet/kubectl/flannel |

| node02 | 2C/4G | 192.168.10.13 | docker/kubeadm/kubelet/kubectl/flannel |

| harbor | 2C/4G | 192.168.10.14 | compose/harbor-office-v1.2.2 |

2、部署思路

- 在所有节点上安装Docker和kubeadm

- 部署Kubernetes Master

- 部署容器网络插件

- 部署Kubernetes Node,将节点加入Kubernetes集群中

- 部署Dashboard Web页面,可视化查看Kubernetes资源

- 部署Harbor私有仓库,存放镜像资源

3、环境准备

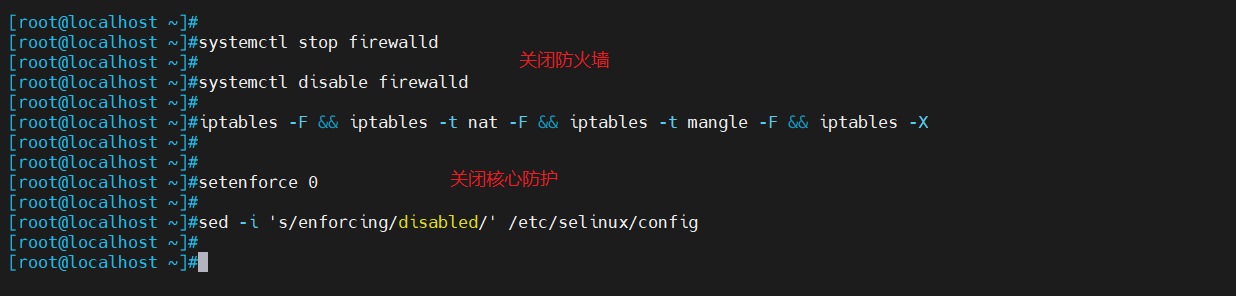

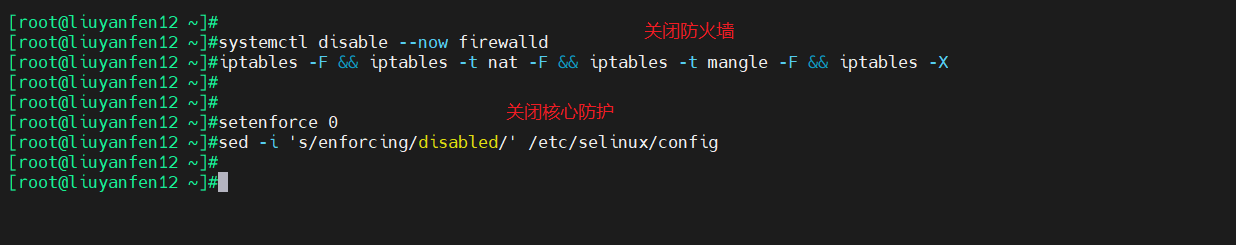

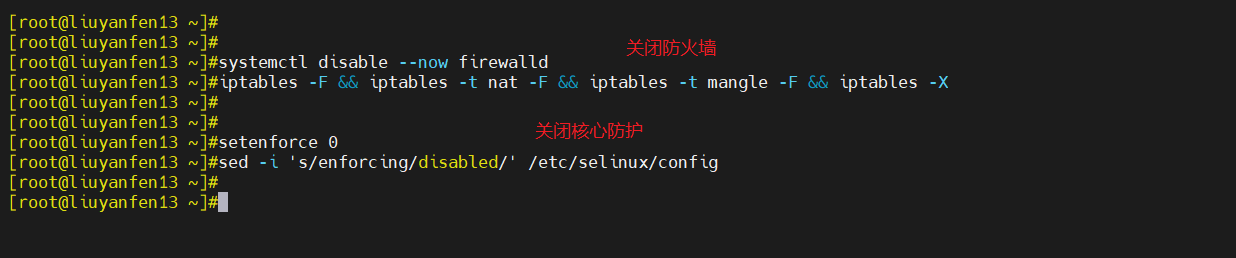

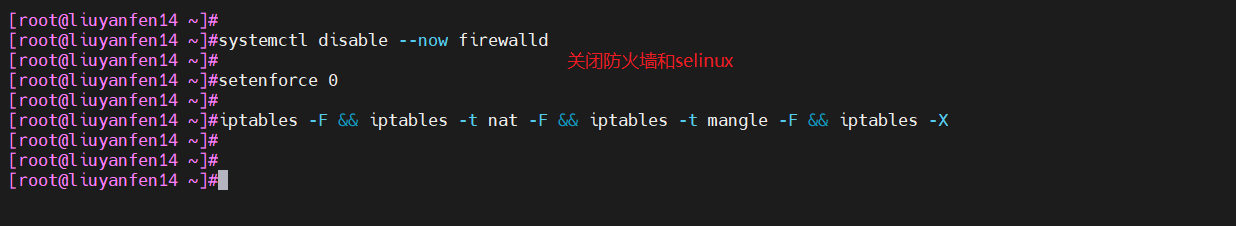

3.1 关闭防火墙规则,关闭selinux

systemctl disable --now firewalld

setenforce 0

iptables -F && iptables -t nat -F && iptables -t mangle -F && iptables -X

#关闭防火墙,关闭selinux

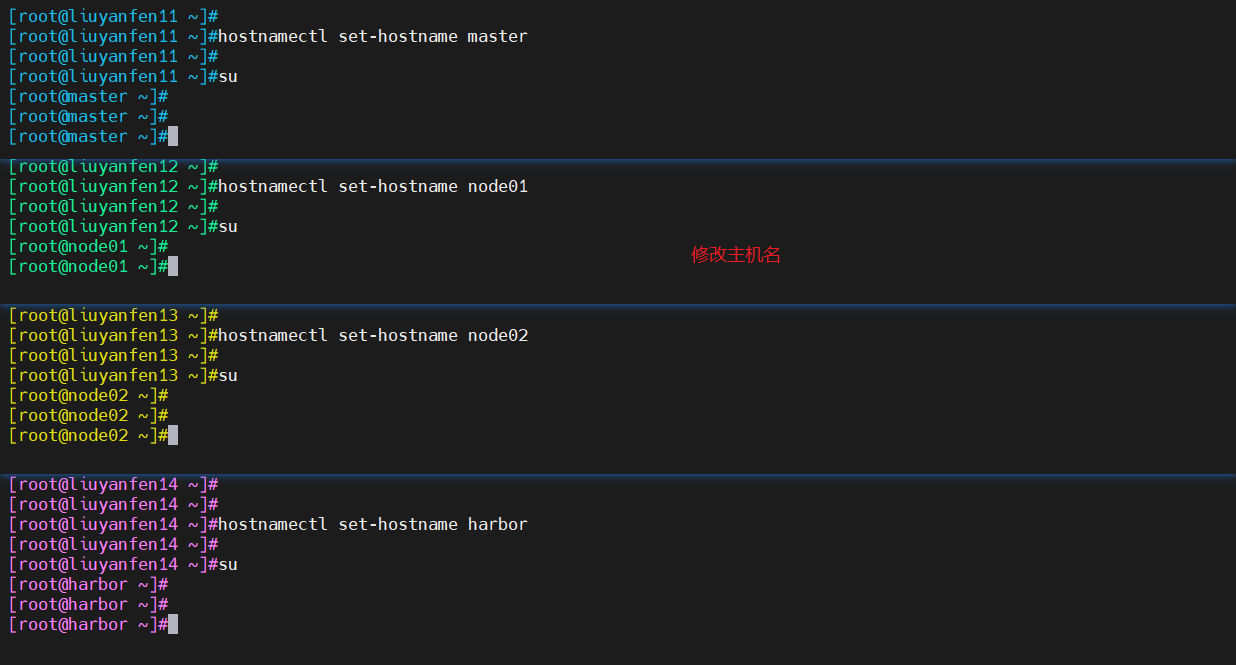

3.2 修改主机名

hostnamectl set-hostname master

hostnamectl set-hostname node01

hostnamectl set-hostname node02

hostnamectl set-hostname harbor

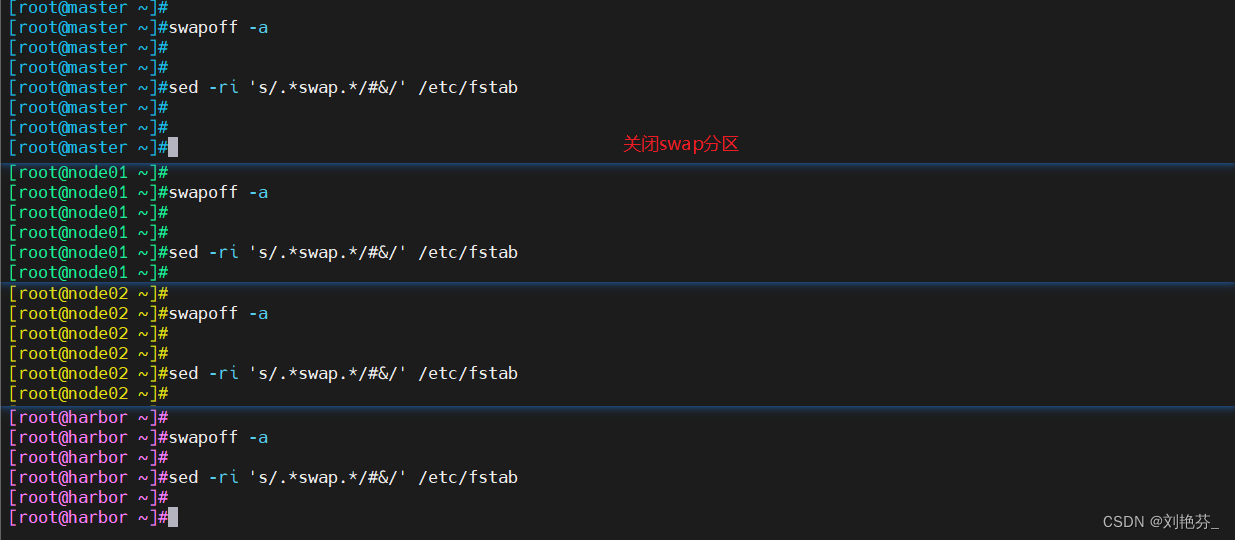

3.3 关闭swap

swapoff -a

#交换分区必须要关闭

sed -ri 's/.*swap.*/#&/' /etc/fstab

#永久关闭swap分区,&符号在sed命令中代表上次匹配的结果

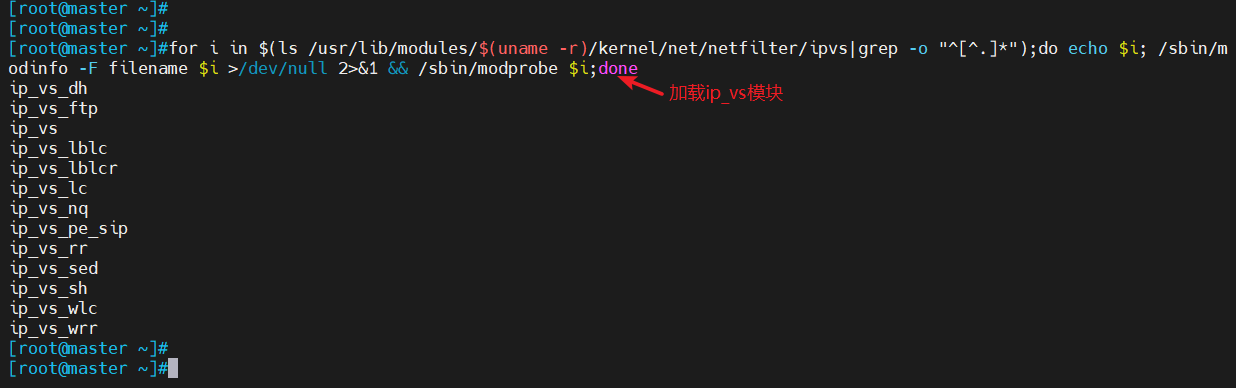

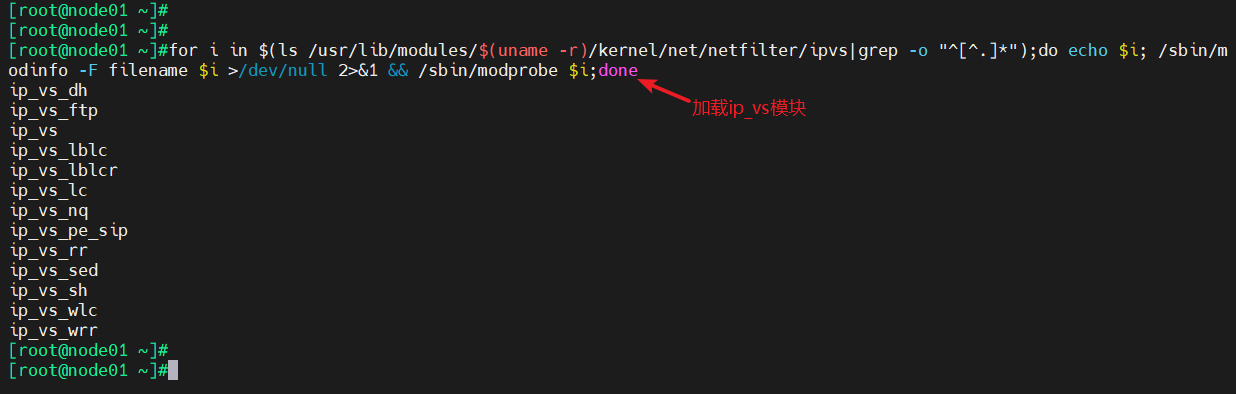

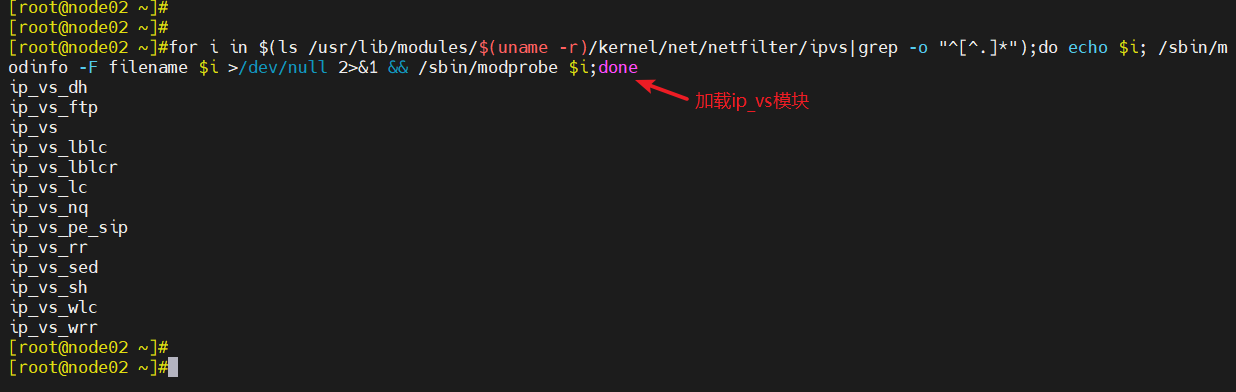

3.4 加载ip_vs模块

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

#加载ip_vs模块

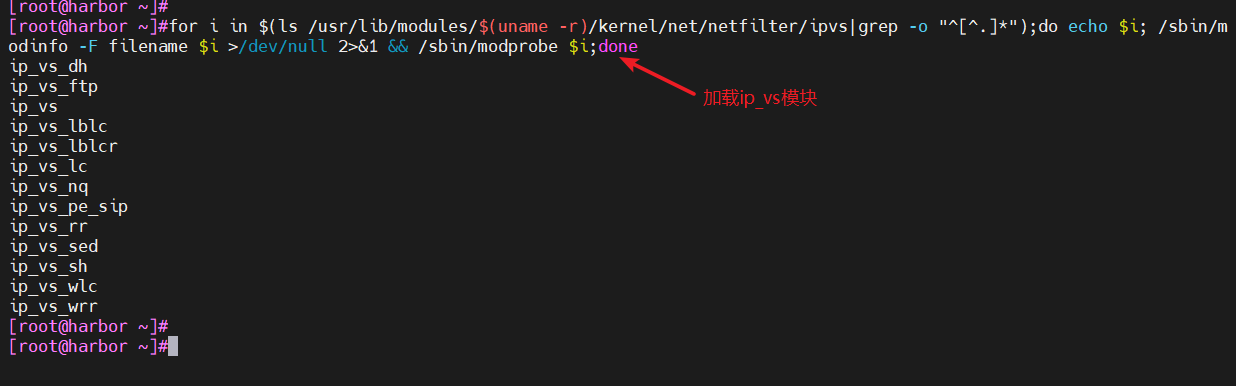

3.5 所有节点修改hosts文件

cat >> /etc/hosts << EOF

192.168.10.11 master

192.168.10.12 node01

192.168.10.13 node02

EOF

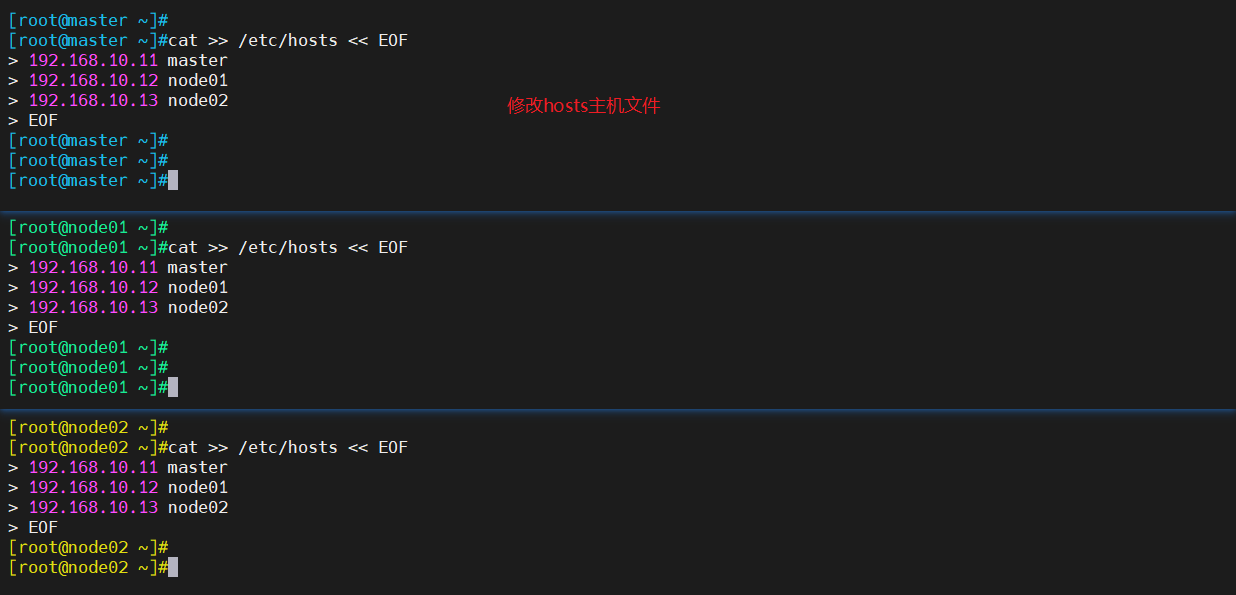

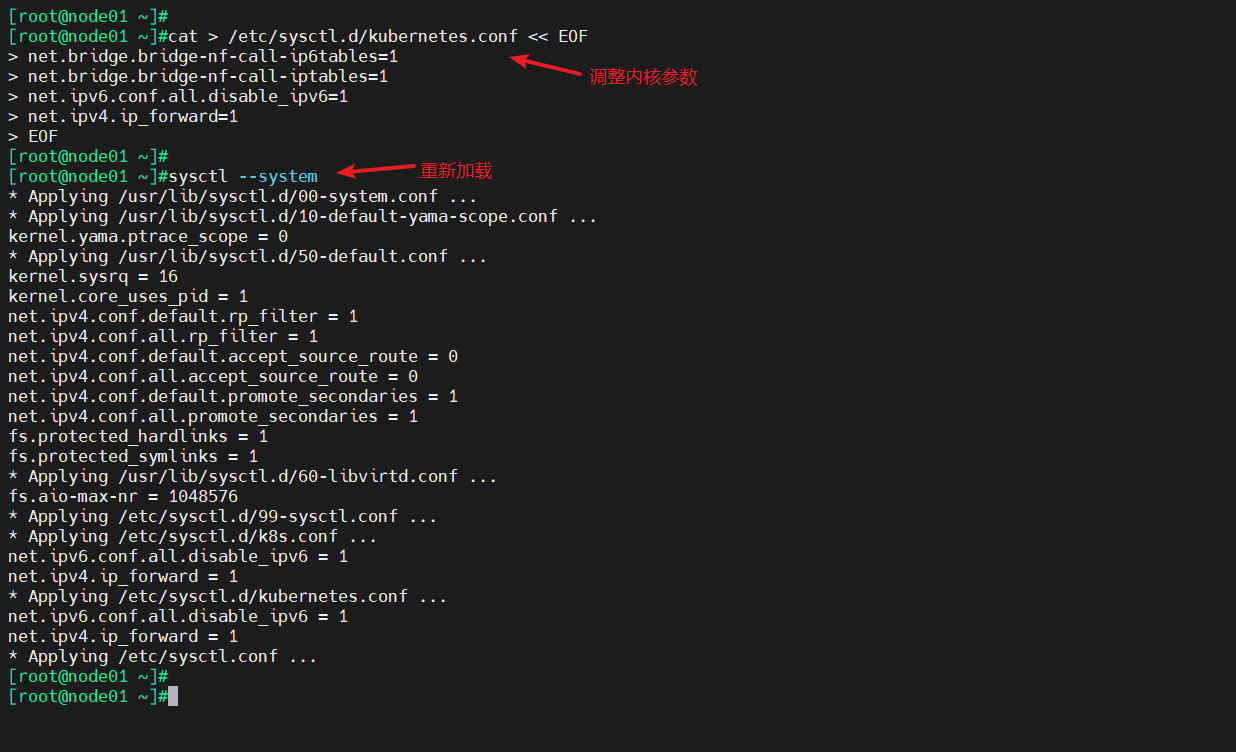

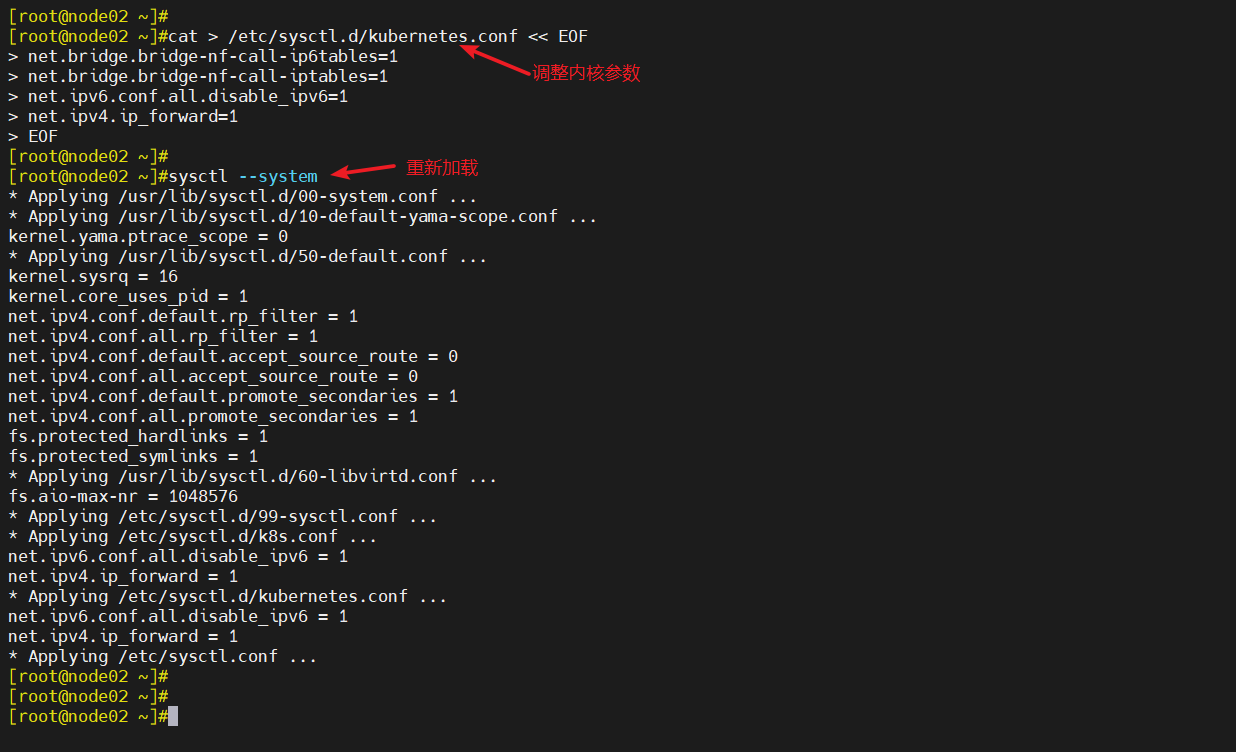

3.6 调整内核参数

#调整内核参数

cat > /etc/sysctl.d/kubernetes.conf << EOF

net.bridge.bridge-nf-call-ip6tables=1

net.bridge.bridge-nf-call-iptables=1

net.ipv6.conf.all.disable_ipv6=1

net.ipv4.ip_forward=1

EOF

sysctl --system

#重新加载

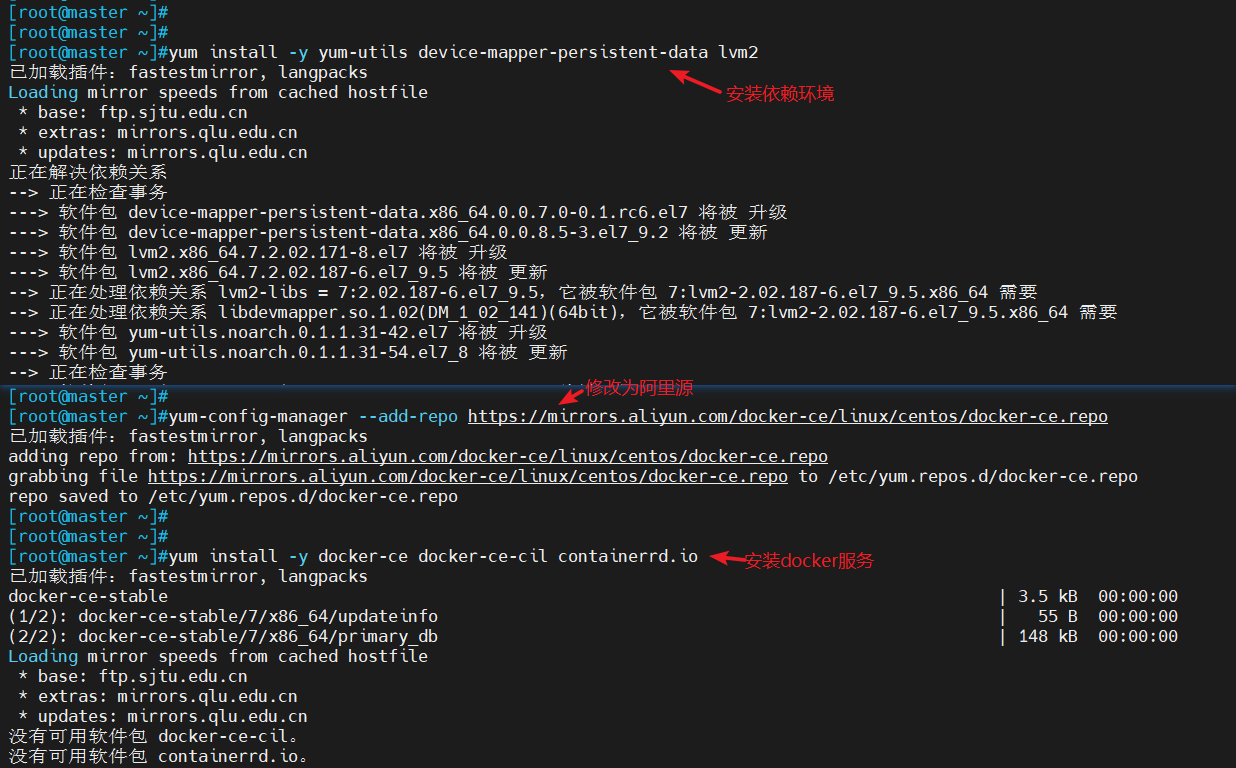

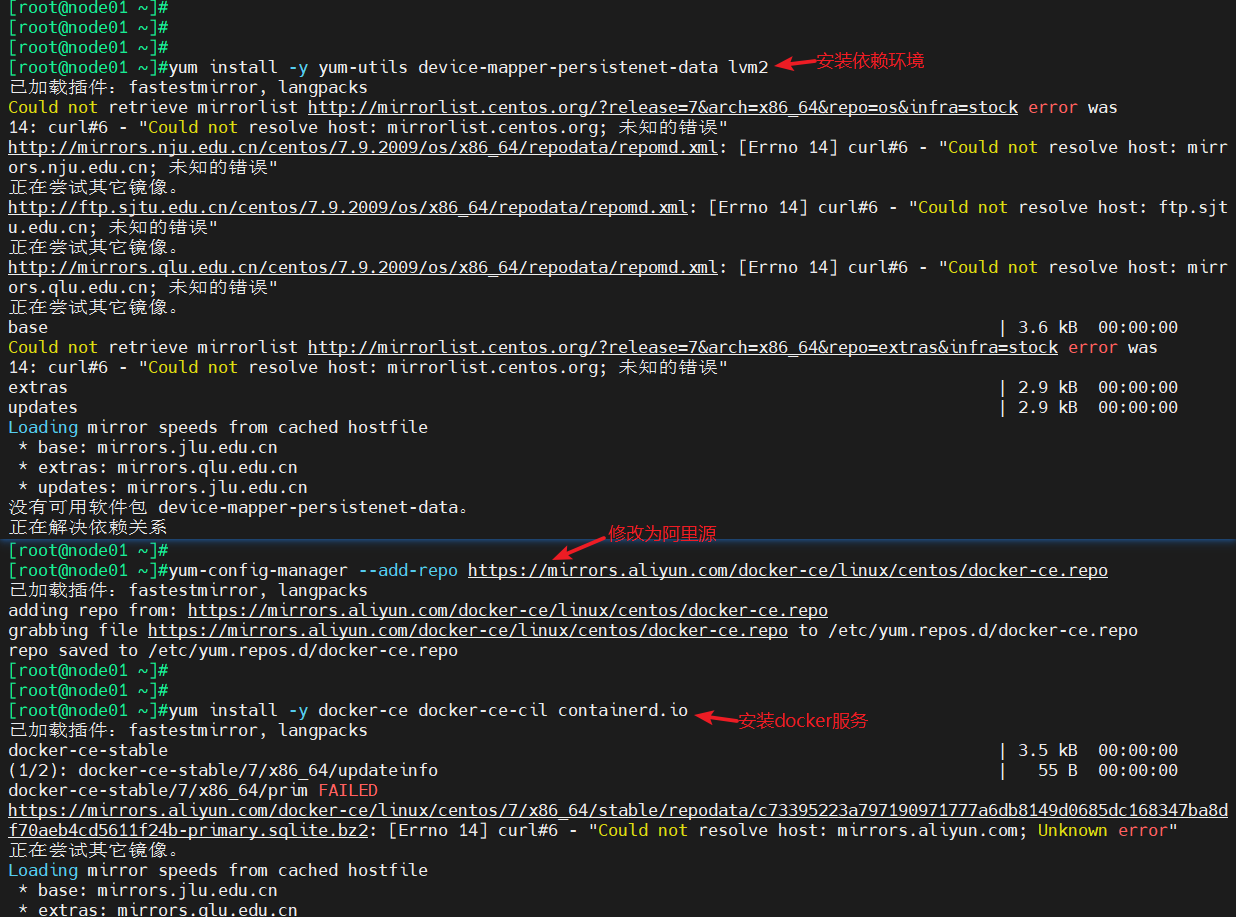

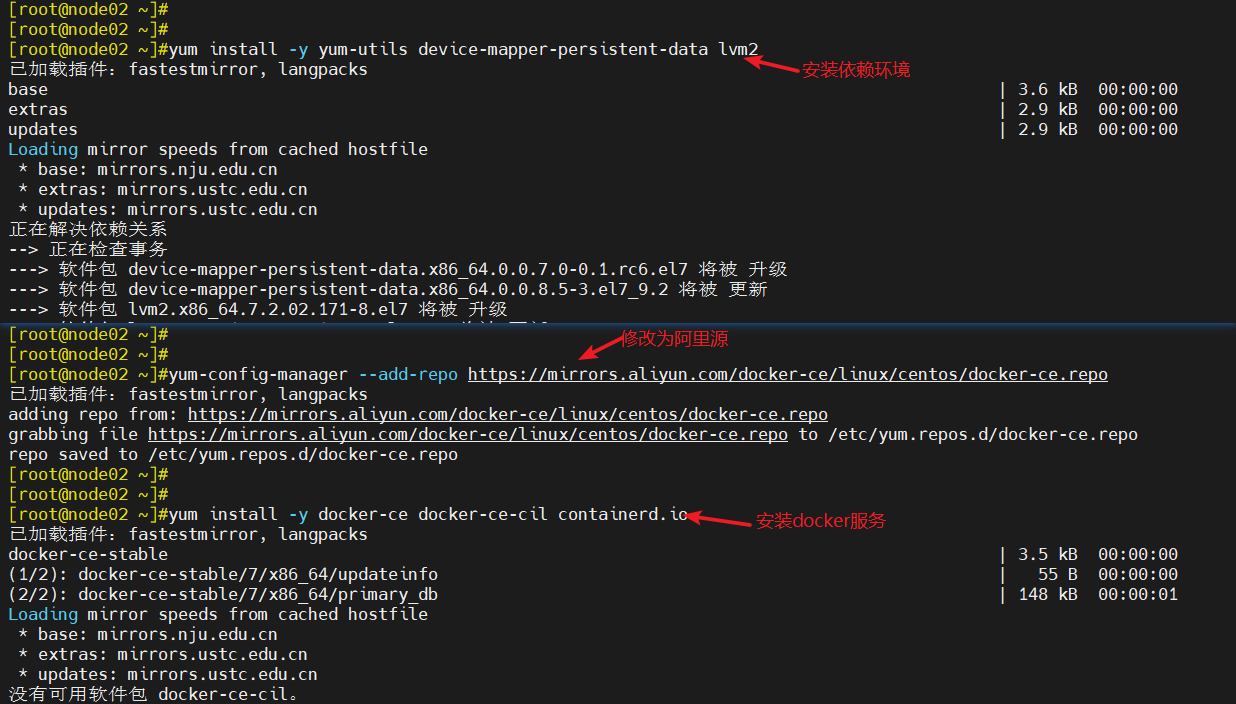

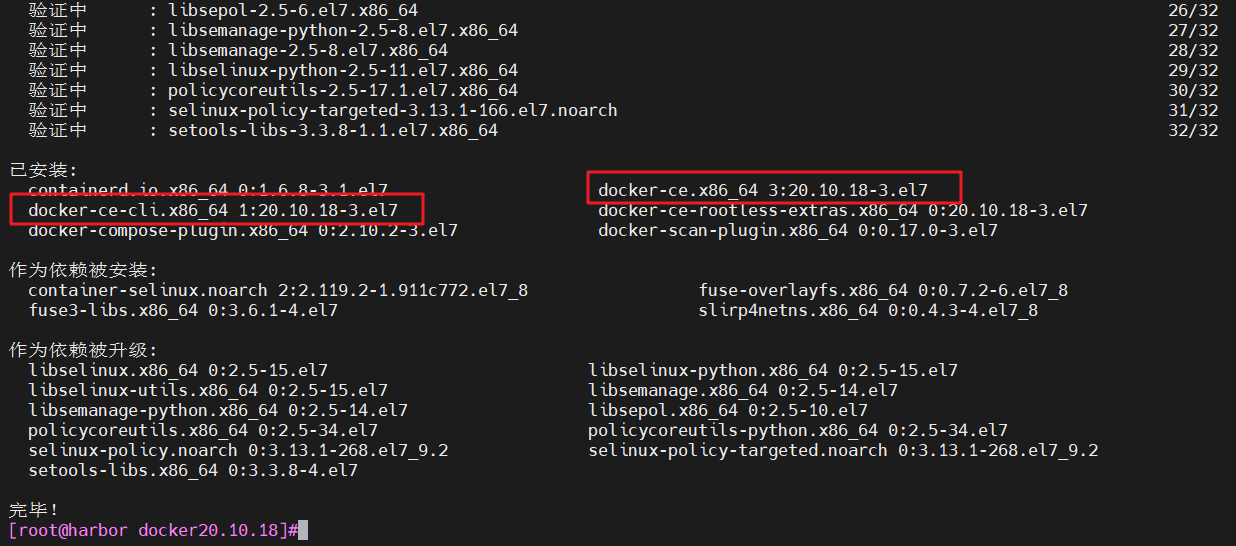

4、所有节点安装docker

4.1 安装docker

yum install -y yum-utils device-mapper-persistent-data lvm2

#安装依赖环境

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

#修改为阿里源

yum install -y docker-ce docker-ce-cli containerd.io

#安装docker-ce版本

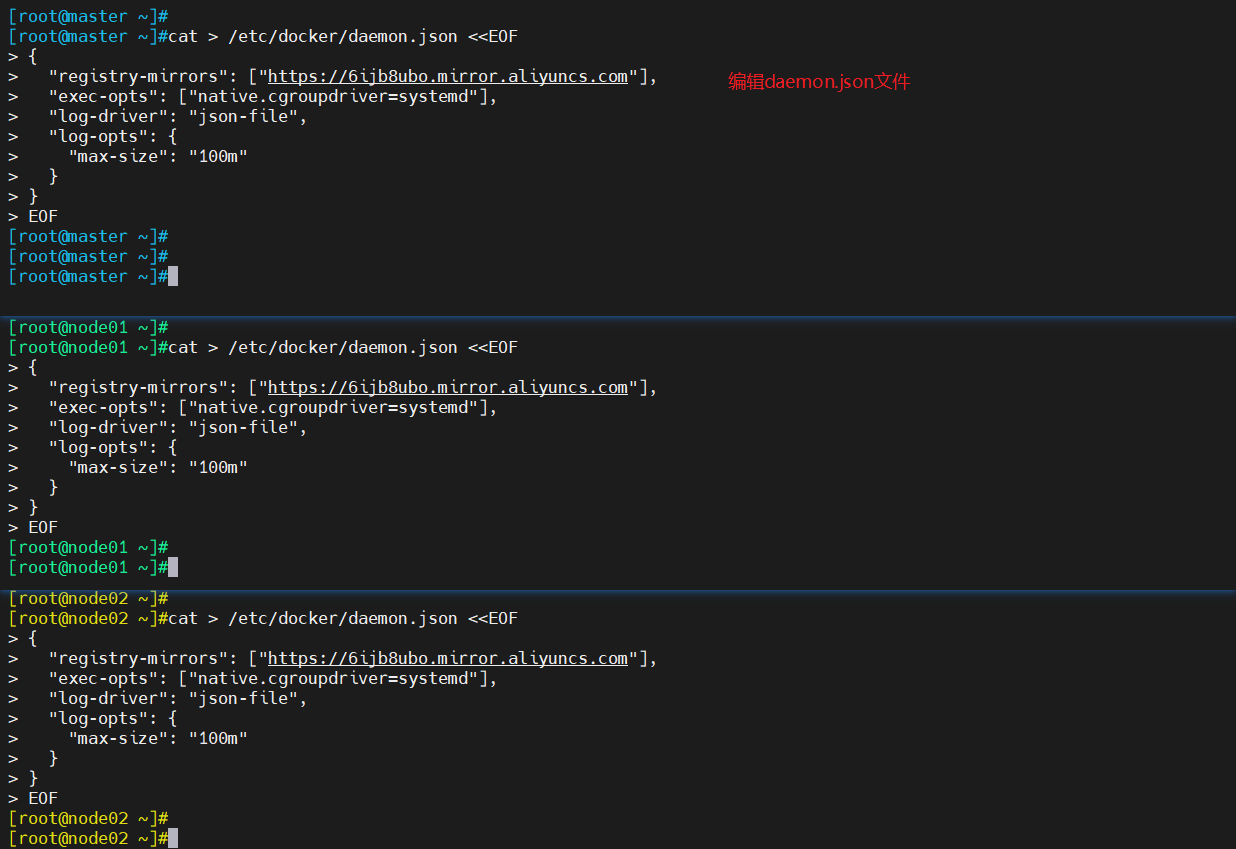

4.2 编写daemon.json

#编辑daemon.json

cat > /etc/docker/daemon.json <<EOF

{

"registry-mirrors": ["https://6ijb8ubo.mirror.aliyuncs.com"],

"exec-opts": ["native.cgroupdriver=systemd"],

#使用systemd管理k8s集群中的资源限制

"log-driver": "json-file",

"log-opts": {

"max-size": "100m"

}

}

EOF

#使systemd管理Cgroup来进行资源控制与管理,因为相对cgoupfs而言,systemd限制CPU、内存等资源更加简单和成熟稳定。

#日志使用json-file格式类型存储,大小为100M,保存在/var/log/containers目录下,方便ELK等日志系统收集和管理日志。

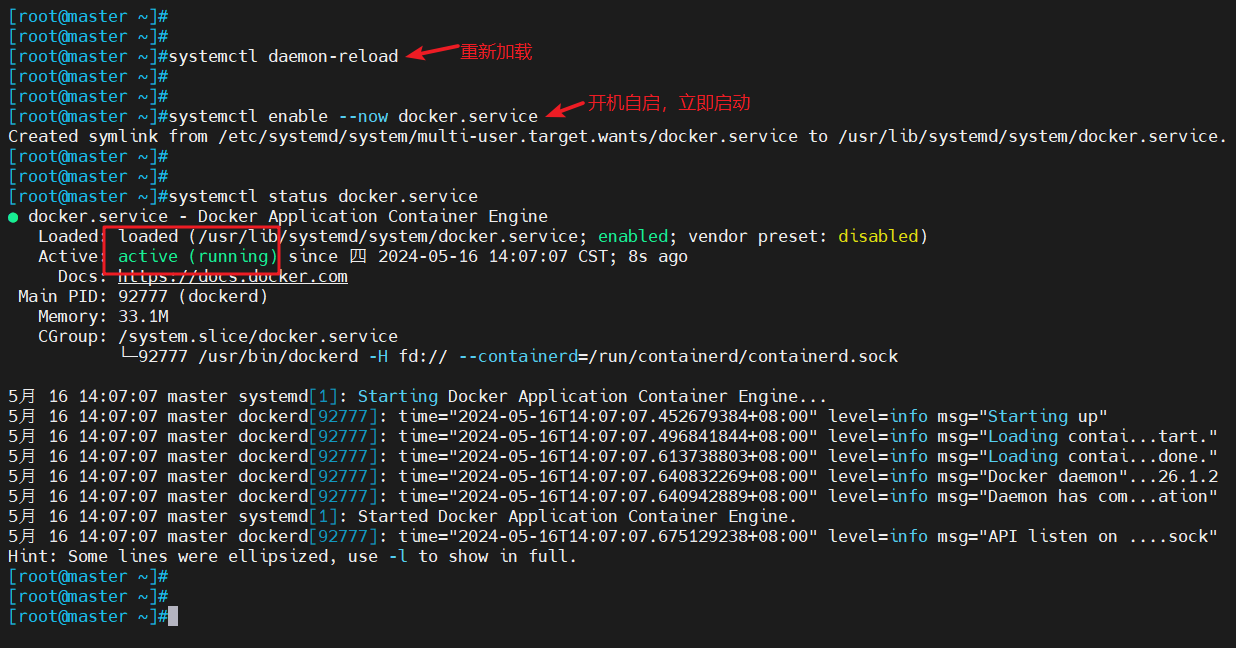

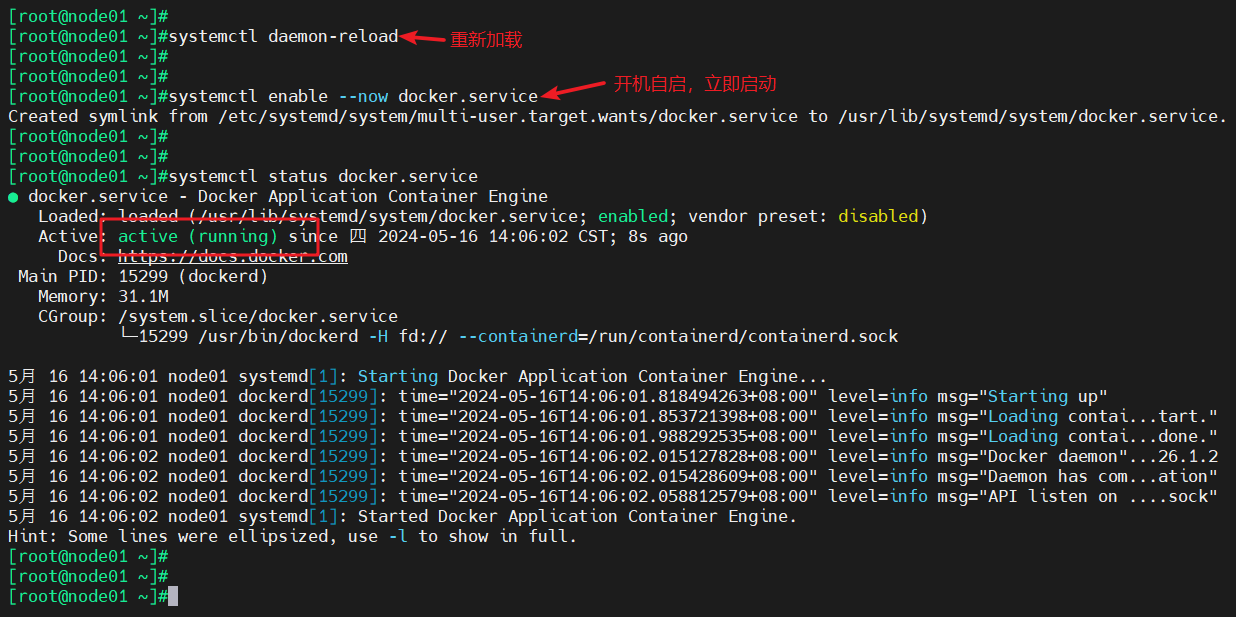

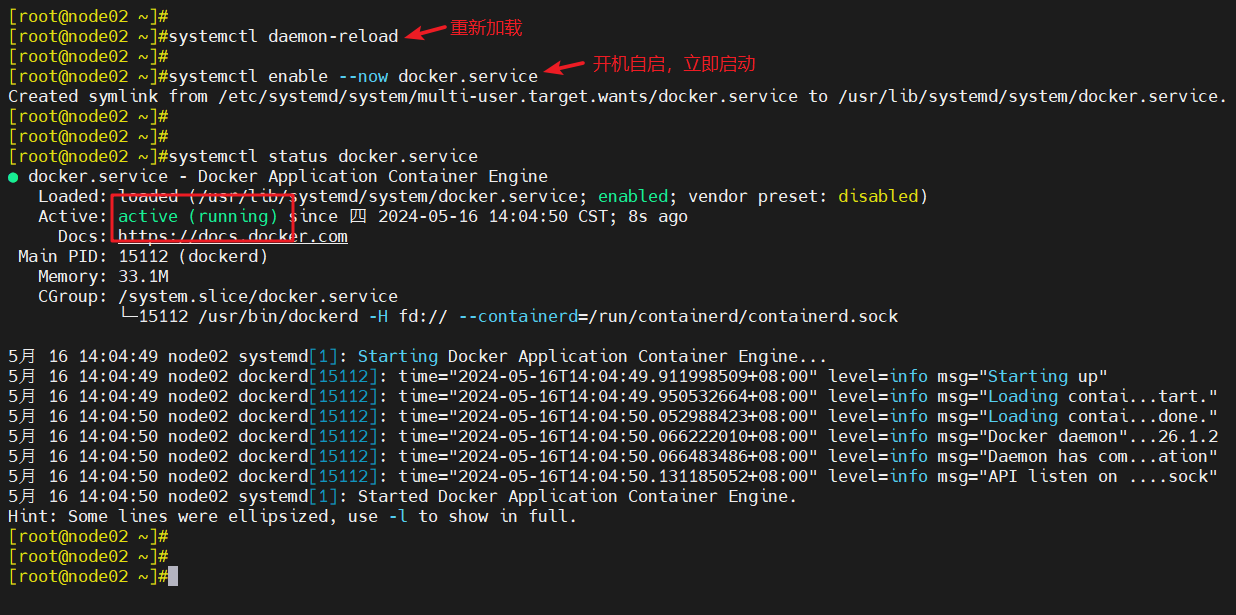

4.3 启动docker

systemctl daemon-reload

#重新加载

systemctl enable --now docker.service

#开机自启并立即启动

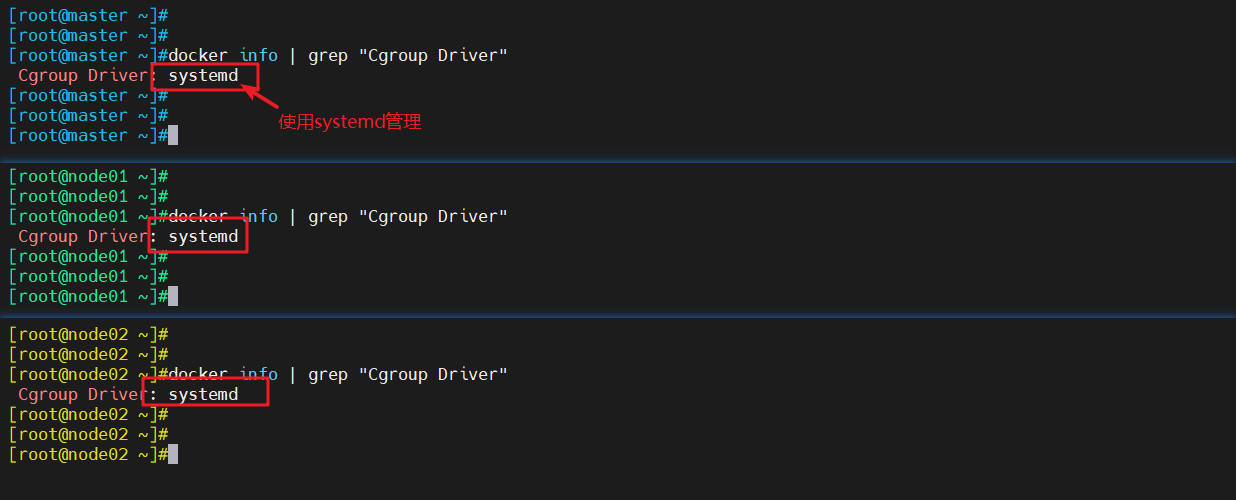

4.4 查看Cgroup Driver

docker info | grep "Cgroup Driver"

#查看信息,过滤Cgroup Driver,显示使用systemd管理

5、所有节点安装kubeadm,kubelet和kubectl

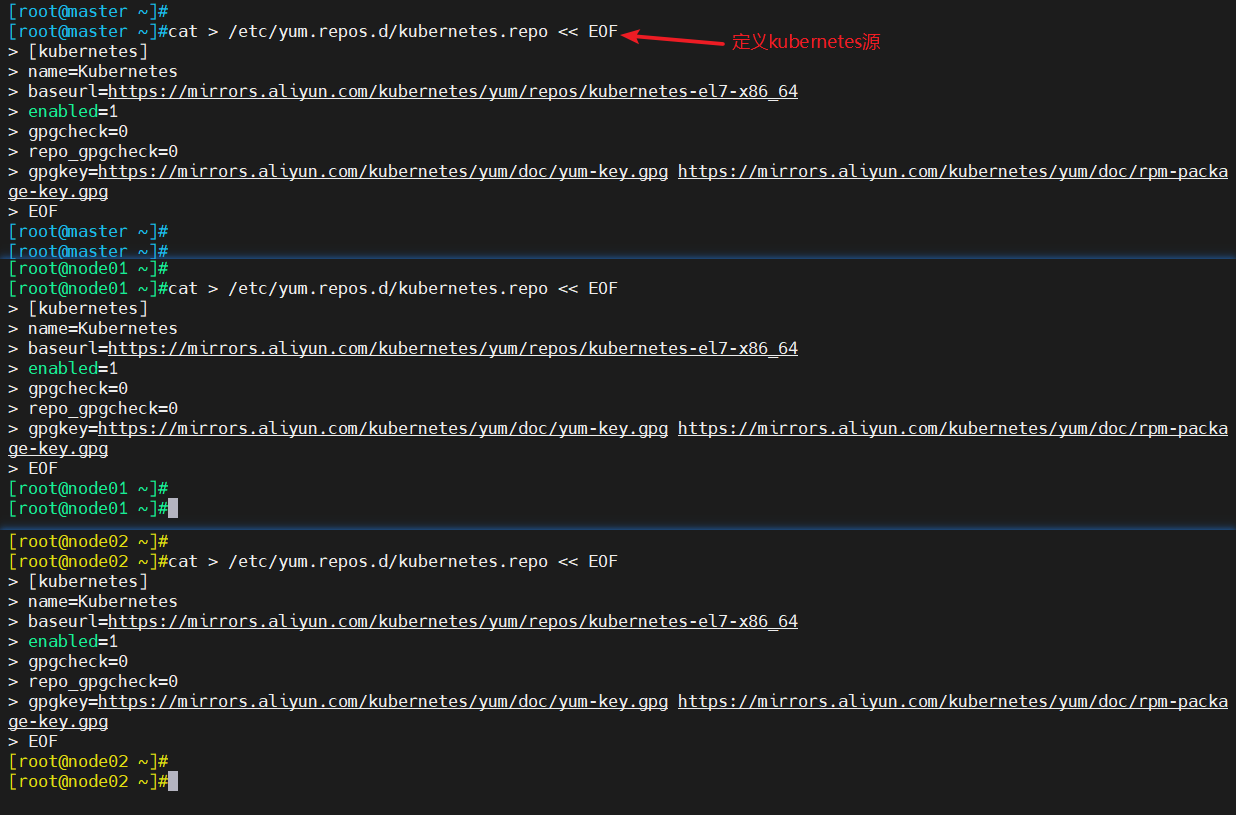

5.1 定义kubernetes源

#定义kubernetes源

cat > /etc/yum.repos.d/kubernetes.repo << EOF

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

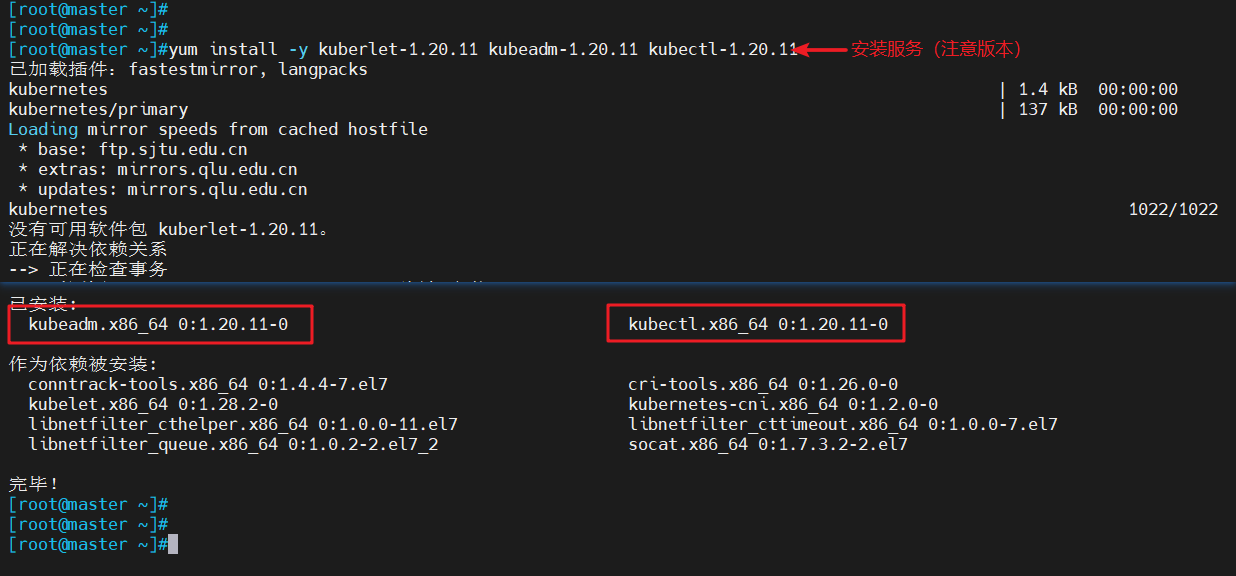

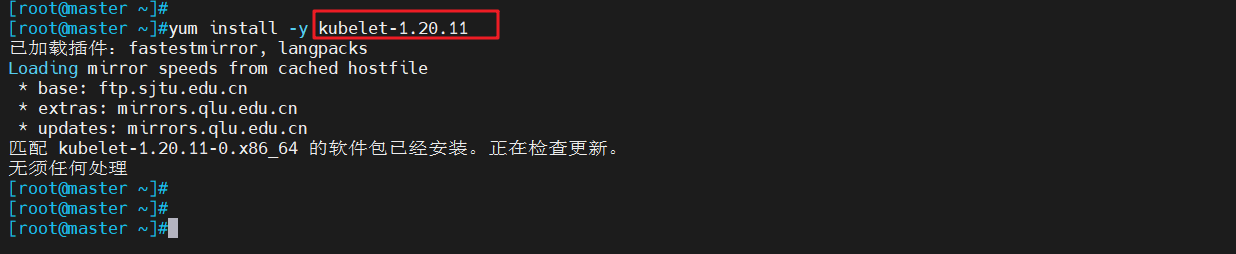

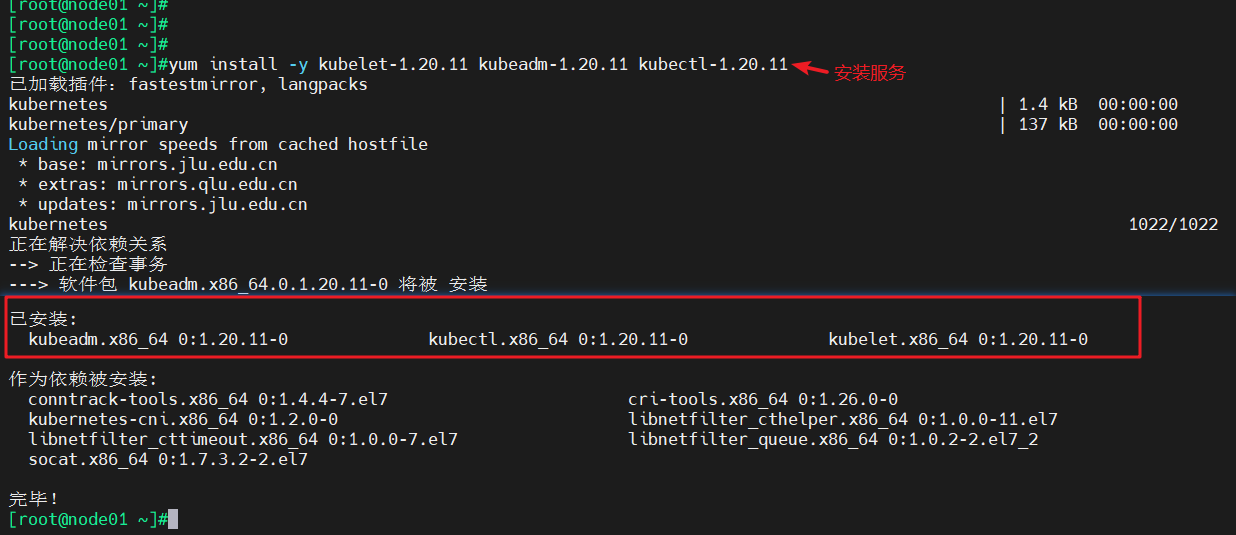

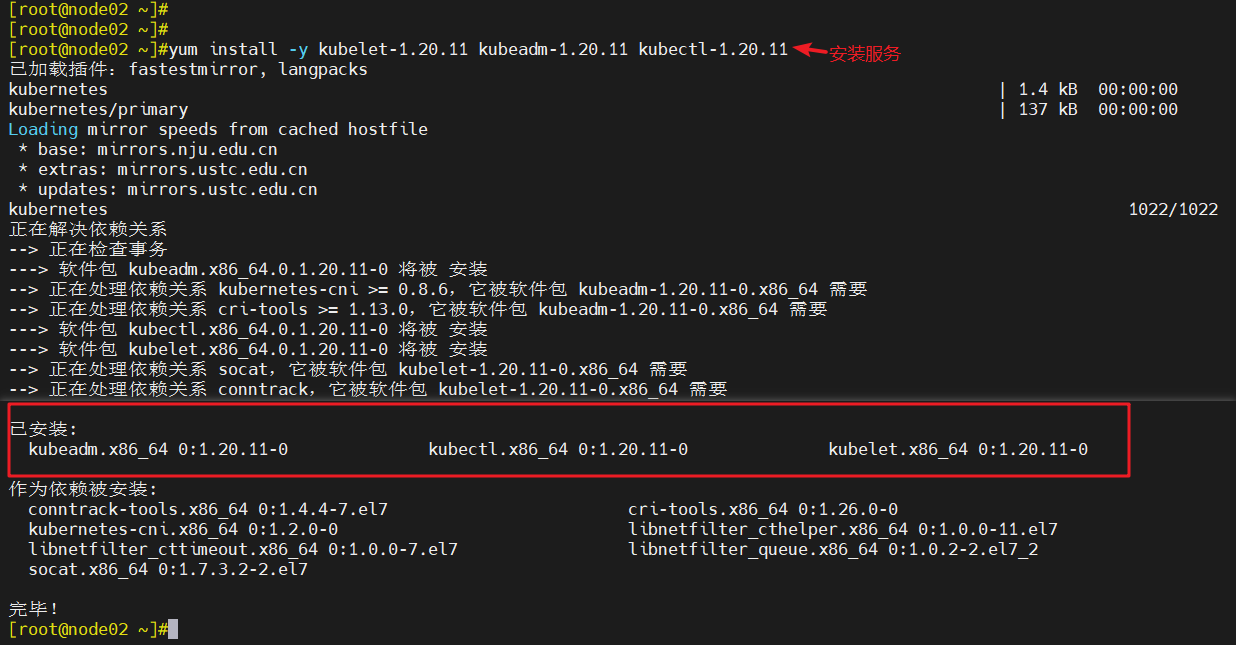

5.2 安装kubelet-1.20.11/kubeadm-1.20.11/kubectl-1.15.1

yum install -y kubelet-1.20.11 kubeadm-1.20.11 kubectl-1.20.11

#安装kubelet、kubeadm、kubectl(注意安装版本)

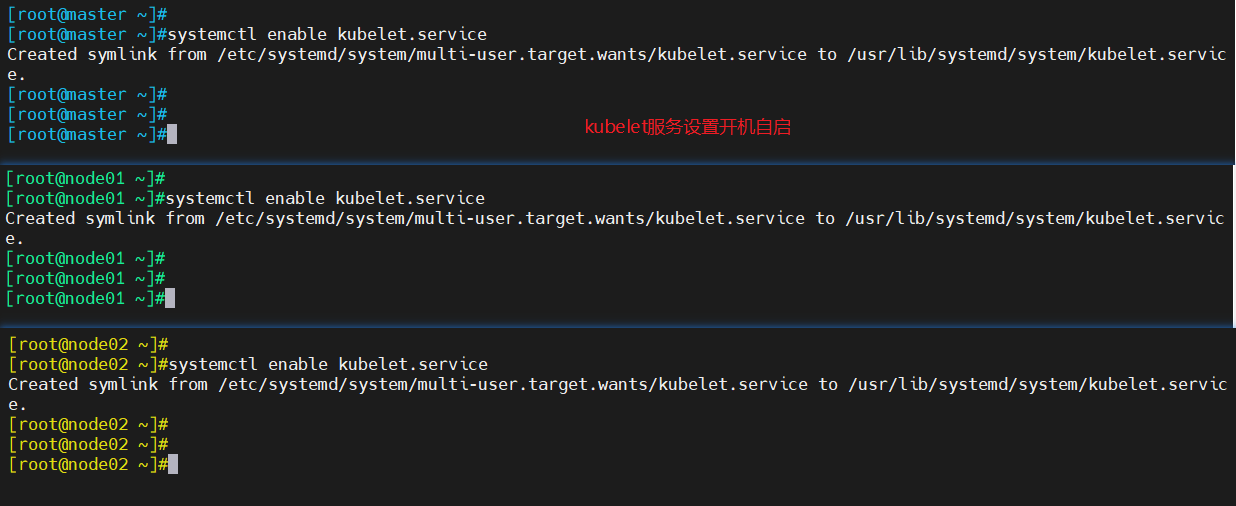

5.3 设置kubelet服务开机自启

systemctl enable kubelet.service

#开机自启

#k8s通过kubeadm安装出来以后都是以Pod方式存在,即底层是以容器方式运行,所以kubelet必须设置开机自启。

6、部署K8S集群

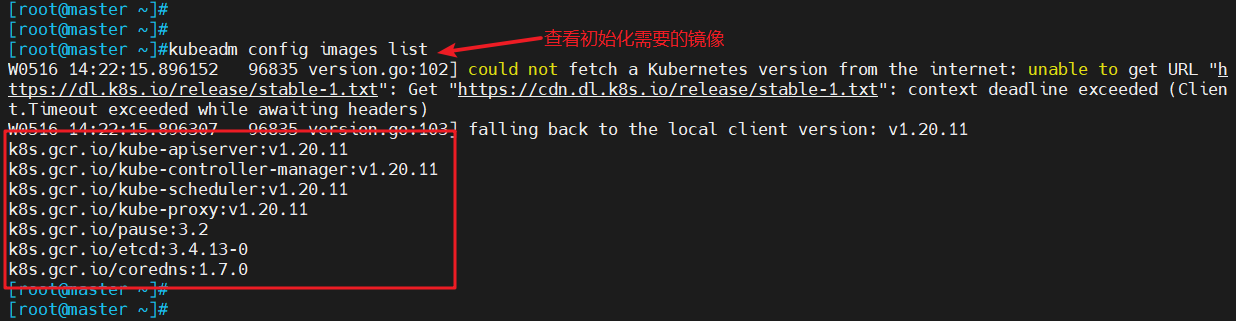

6.1 查看初始化需要的镜像

- master节点

kubeadm config images list

#查看初始化需要的镜像

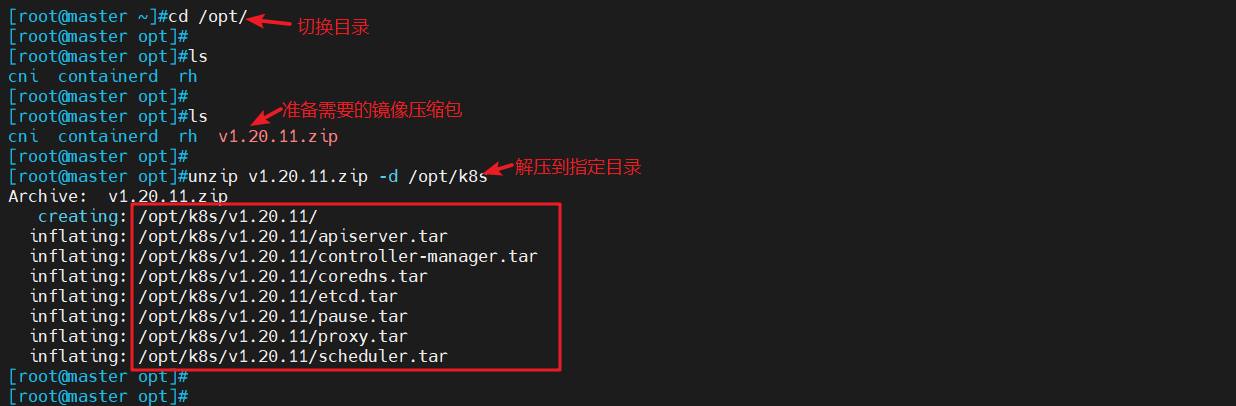

6.2 在master节点准备kubeadm基础镜像

- master节点

cd /opt

#切换目录

#上传v1.20.11.zip压缩包

unzip v1.20.11.zip -d /opt/k8s

#解压kubeadm基础镜像压缩包到指定目录

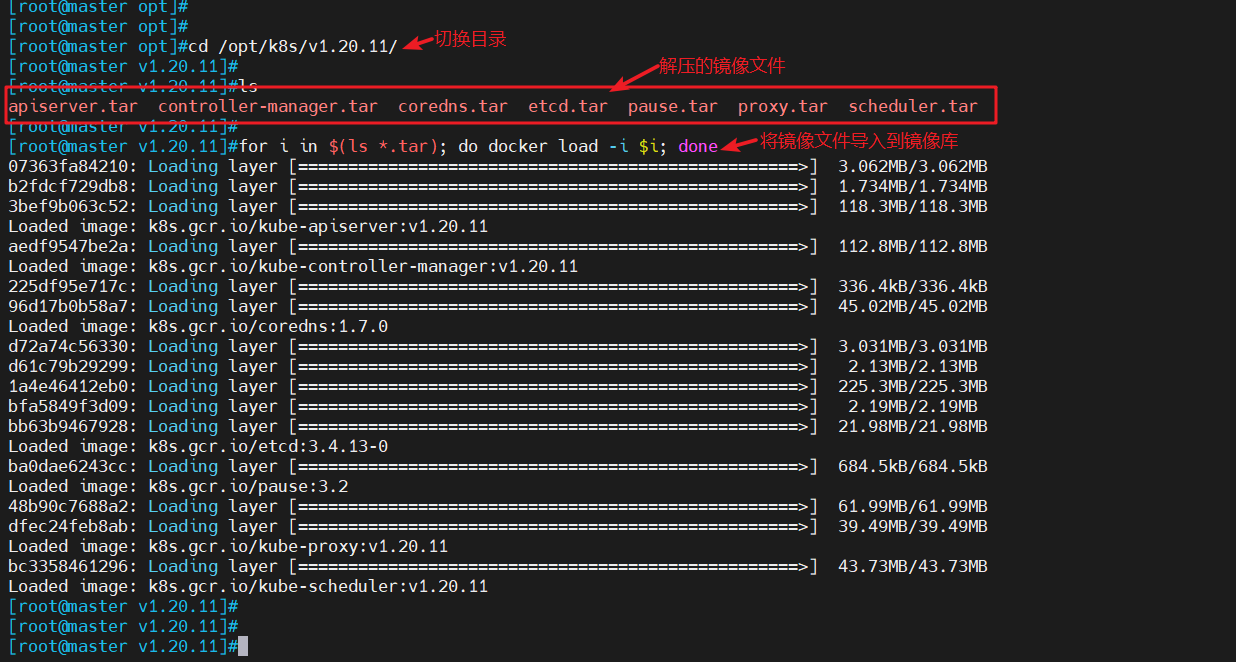

6.3 加载镜像至docker容器

- master节点

cd /opt/k8s/v1.20.11/

#切换目录

for i in $(ls *.tar); do docker load -i $i; done

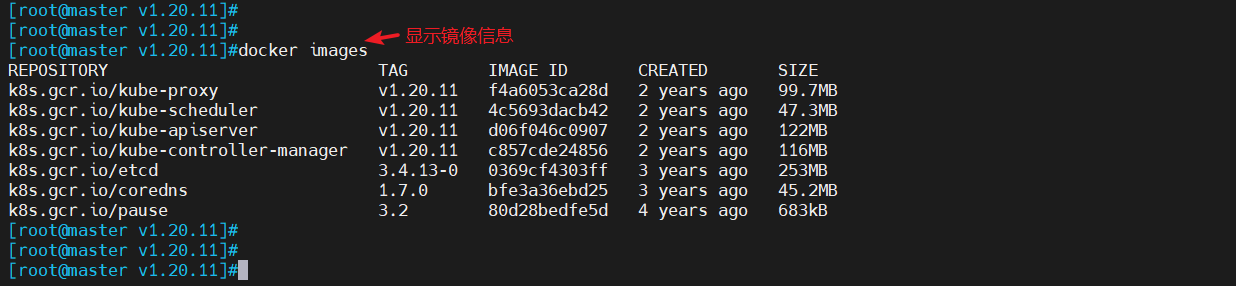

#加载镜像至docker容器

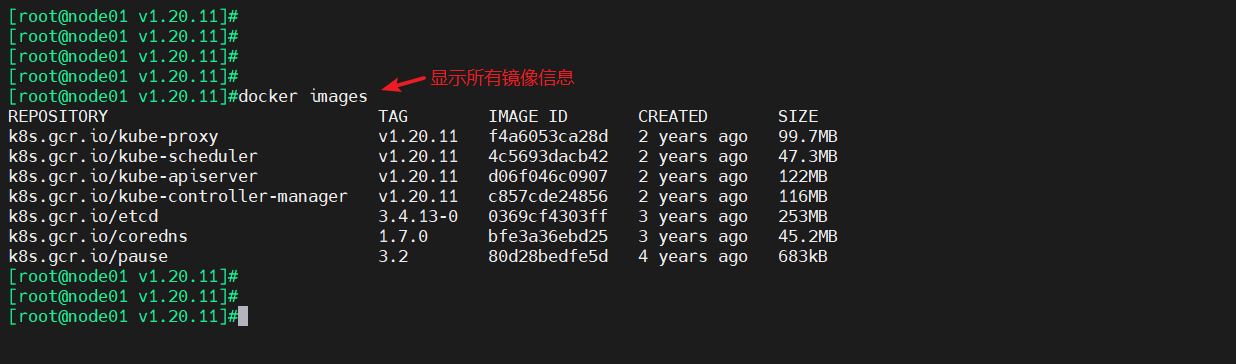

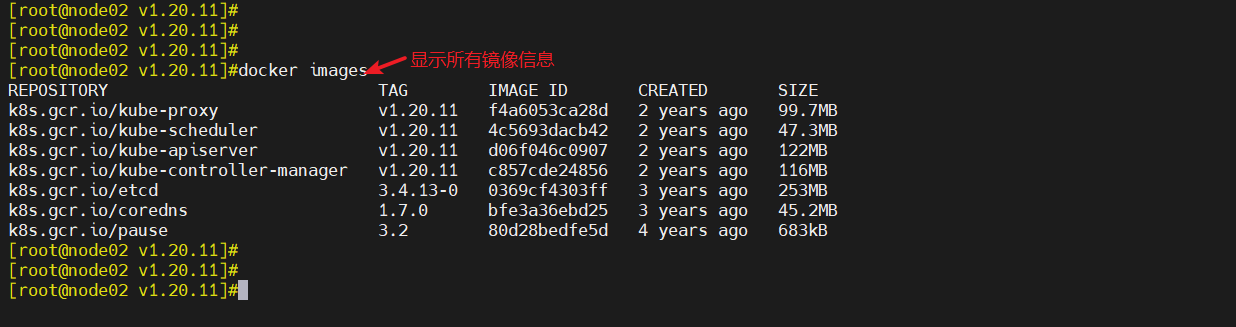

docker images

#显示所有镜像信息

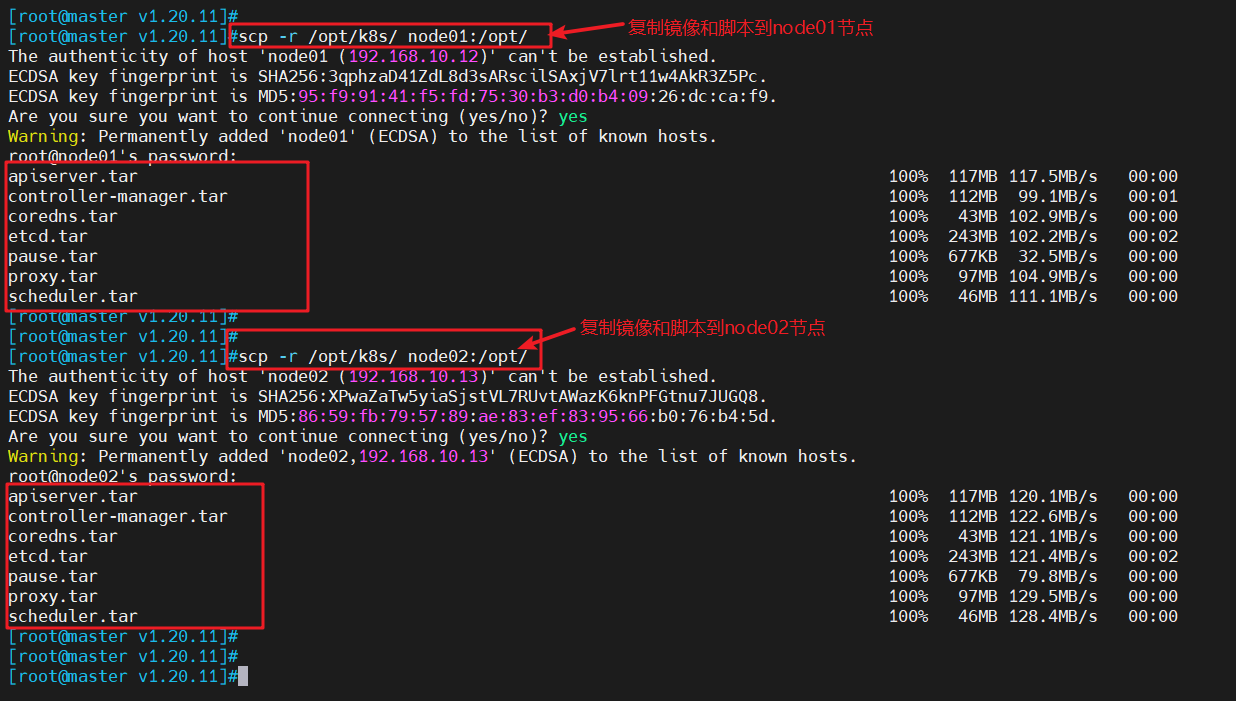

6.4 复制镜像和脚本到node节点

- master节点

scp -r /opt/k8s node01:/opt

scp -r /opt/k8s node02:/opt

#复制master镜像信息至所有node节点

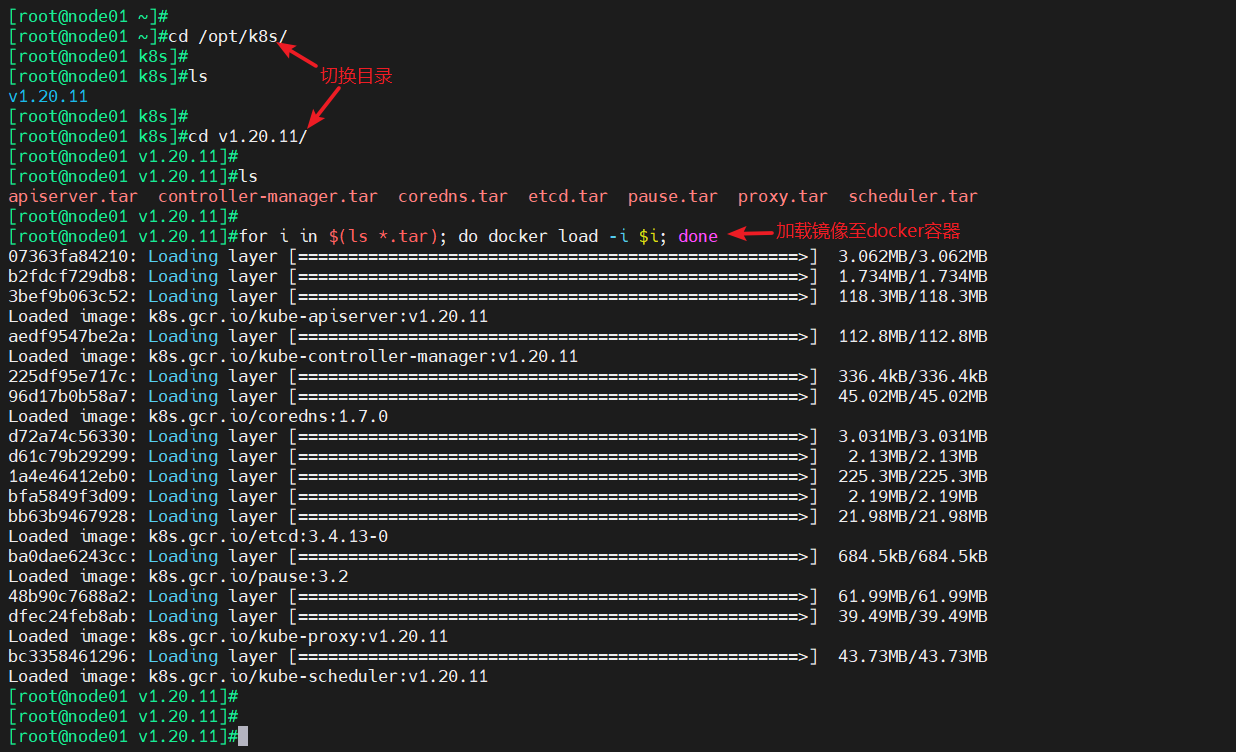

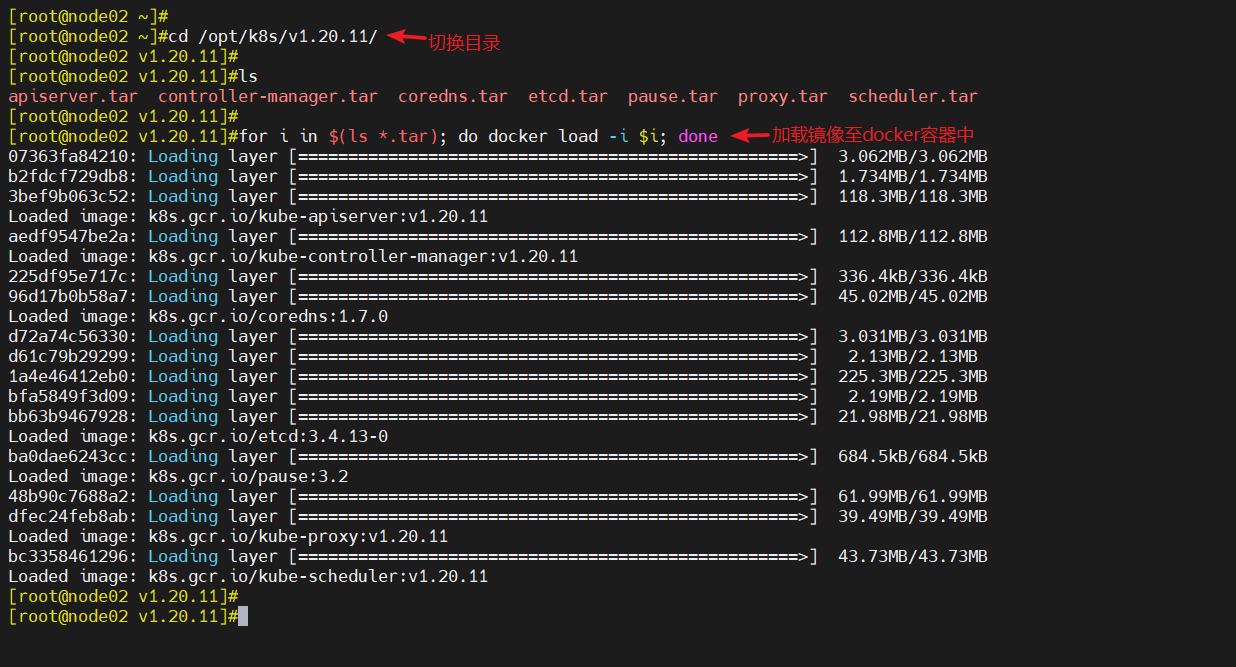

- node节点

cd /opt

#切换目录

for i in $(ls *.tar); do docker load -i $i; done

#将镜像文件导入到镜像库中

docker images

#显示所有镜像信息

- node01 节点

- node02节点

6.6 初始化kubeadm

6.6.1 方法一

- master节点

kubeadm config print init-defaults > /opt/kubeadm-config.yaml

#初始化配置文件

cd /opt/

#切换目录

-----------------------------------------------------------------------------------------------------

#修改yaml配置文件

vim kubeadm-config.yaml

12 advertiseAddress: 192.168.10.11

#修改12行,指定master节点的IP地址

34 kubernetesVersion: v1.20.11

#修改34行,指定kubernetes版本号

35 networking:

36 dnsDomain: cluster.local

37 podSubnet: "10.244.0.0/16"

#添加,指定pod网段,10.244.0.0/16用于匹配flannel默认网段

38 serviceSubnet: 10.96.0.0/16

#指定service网段

39 scheduler: {}

#末尾再添加以下内容

---

apiVersion: kubeproxy.config.k8s.io/v1alpha1

kind: KubeProxyConfiguration

mode: ipvs

#把默认的service调度方式改为ipvs模式

---------------------------------------------------------------------------------------------------

kubeadm init --config=kubeadm-config.yaml -upload-certs | tee kubeadm-init.log

#--experimental-upload-certs 参数可以在后续执行加入节点时自动分发证书文件,k8sV1.16版本开始替换为 --upload-certs

#tee kubeadm-init.log 用以输出日志

#注意记录,node节点使用该命令加入集群

less kubeadm-init.log

#查看kubeadm-init日志

ls /etc/kubernetes/

#kubernetes配置文件目录

ls /etc/kubernetes/pki/

#存放ca等证书和密码的目录

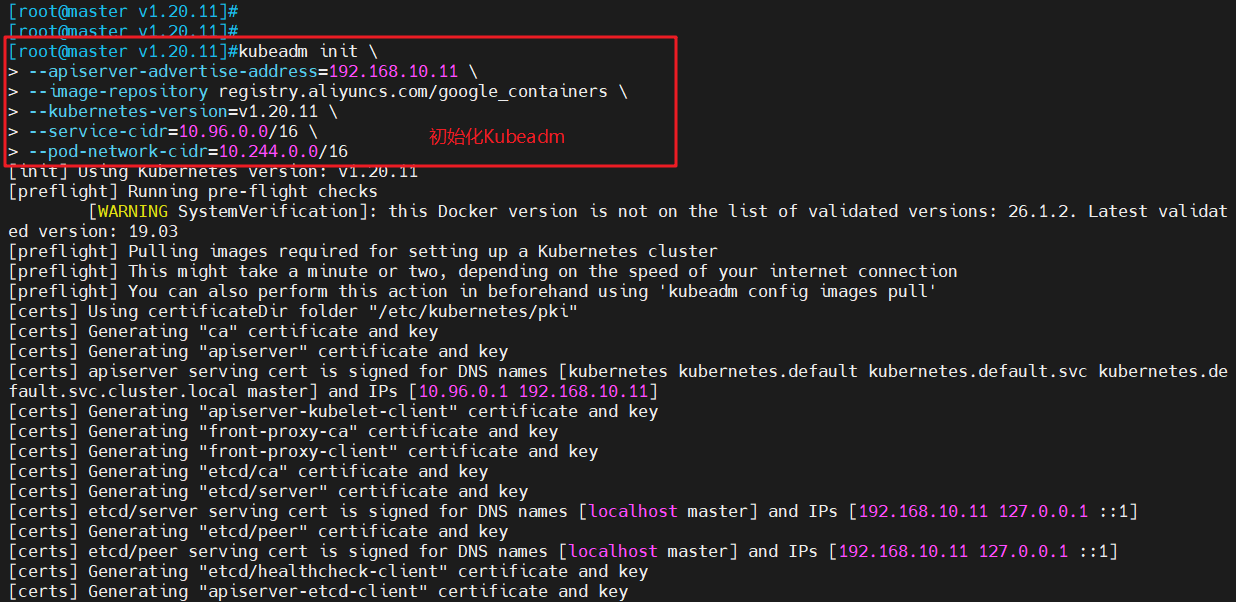

6.6.2 方法二

#初始化kubeadm

kubeadm init \

--apiserver-advertise-address=192.168.10.11 \

--image-repository registry.aliyuncs.com/google_containers \

--kubernetes-version=v1.20.11 \

--service-cidr=10.96.0.0/16 \

--pod-network-cidr=10.244.0.0/16 \

---------------------------------------------------------------------------------------------------

初始化集群需使用kubeadm init命令,可以指定具体参数初始化,也可以指定配置文件初始化。

可选参数:

--apiserver-advertise-address:apiserver通告给其他组件的IP地址,一般应该为Master节点的用于集群内部通信的IP地址,

--apiserver-bind-port:apiserver的监听端口,默认是6443

--cert-dir:通讯的ssl证书文件,默认/etc/kubernetes/pki

--control-plane-endpoint:控制台平面的共享终端,可以是负载均衡的ip地址或者dns域名,高可用集群时需要添加

--image-repository:拉取镜像的镜像仓库,默认是k8s.gcr.io

--kubernetes-version:指定kubernetes版本

--pod-network-cidr:pod资源的网段,需与pod网络插件的值设置一致。通常,Flannel网络插件的默认为10.244.0.0/16,Calico插件的默认值为192.168.0.0/16;

--service-cidr:service资源的网段

--service-dns-domain:service全域名的后缀,默认是cluster.local

---------------------------------------------------------------------------------------------------------

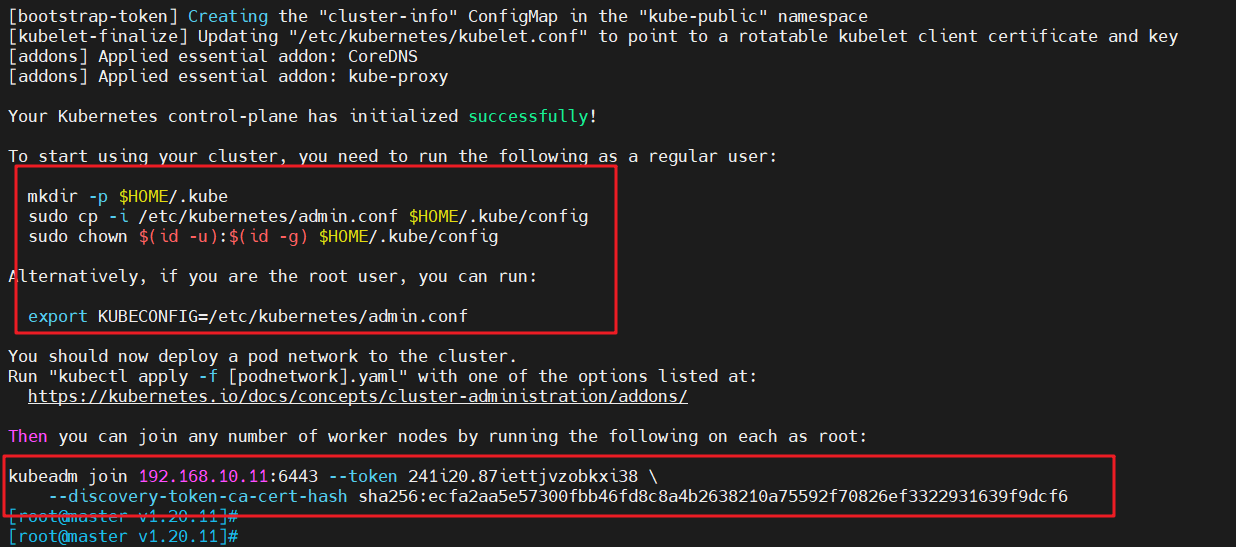

6.7 设定kubectl

- kubectl需经由API server认证及授权后方能执行相应的管理操作,kubeadm 部署的集群为其生成了一个具有管理员权限的认证配置文件 /etc/kubernetes/admin.conf,它可由 kubectl 通过默认的 “$HOME/.kube/config” 的路径进行加载。

mkdir -p $HOME/.kube

#创建目录

cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

#保留属性,复制配置文件

chown $(id -u):$(id -g) $HOME/.kube/config

#修改属主属组

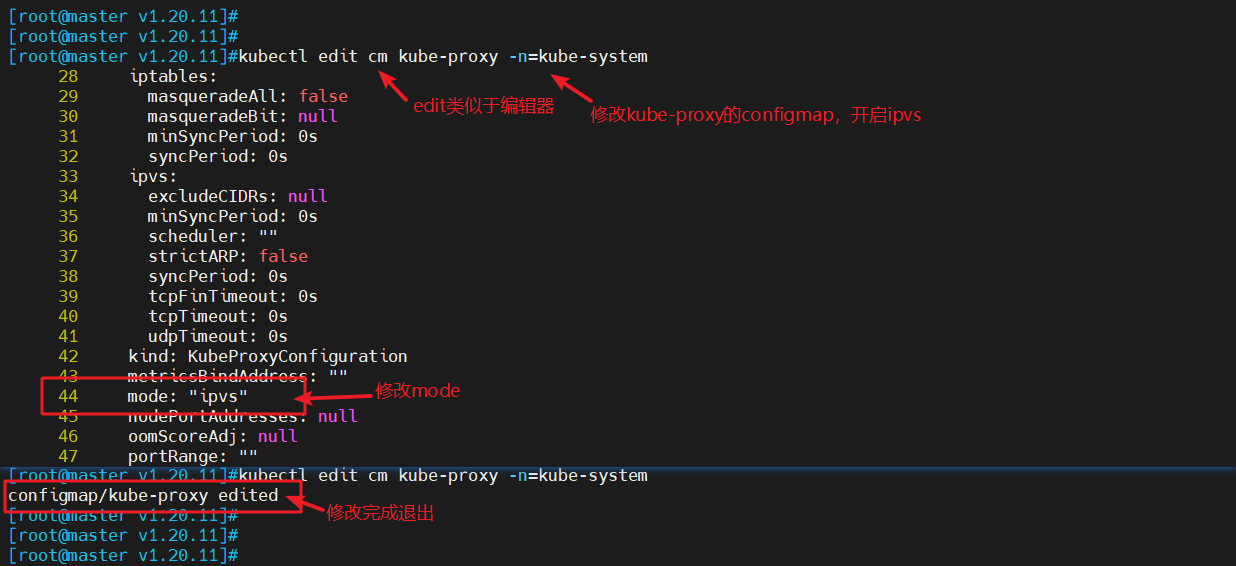

kubectl edit cm kube-proxy -n=kube-system

#edit类似于编辑器,修改 kube-proxy 的 configmap,开启 ipvs

#修改44行mode: ipvs

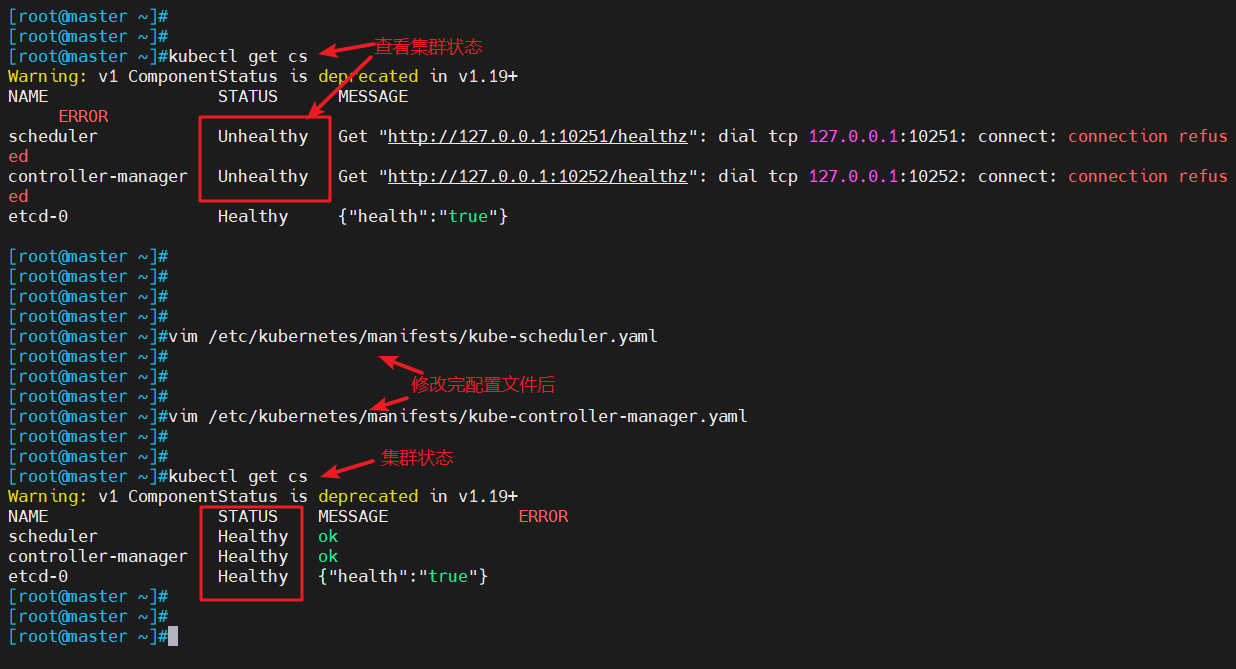

6.8 查看集群状态

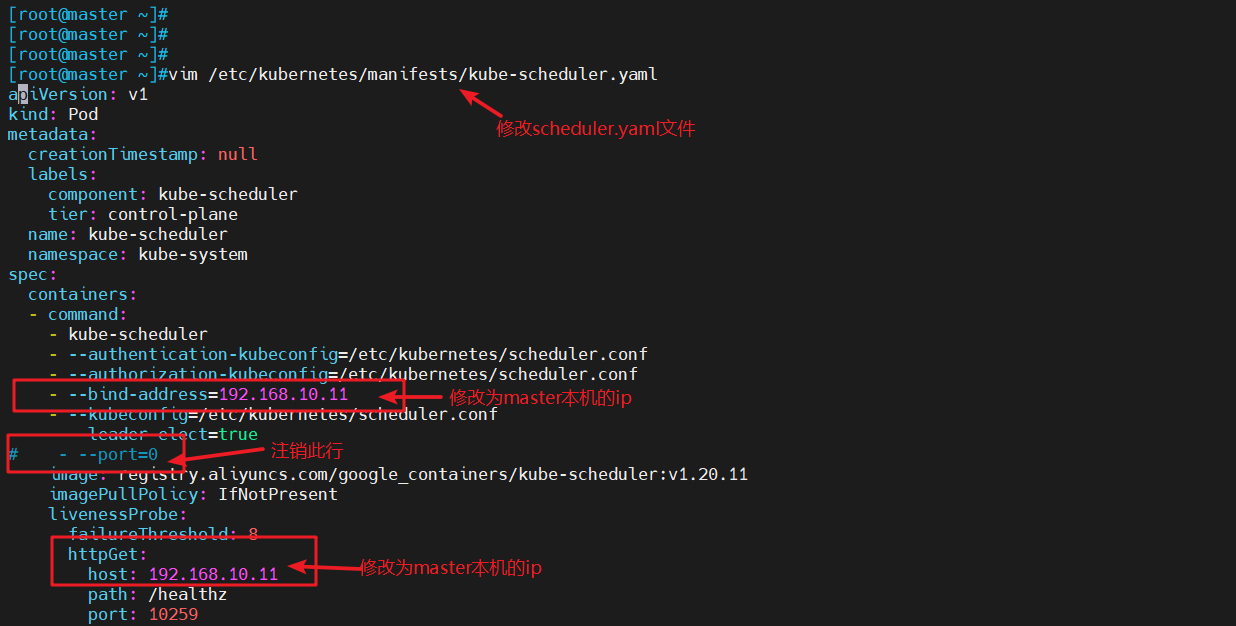

#如果 kubectl get cs 发现集群不健康,更改以下两个文件:

vim /etc/kubernetes/manifests/kube-scheduler.yaml

- --bind-address=192.168.10.11

#修改成k8s的控制节点master的ip

# - --port=0

#注销此行

httpGet:

host: 192.168.10.11

#修改为master本机的ip

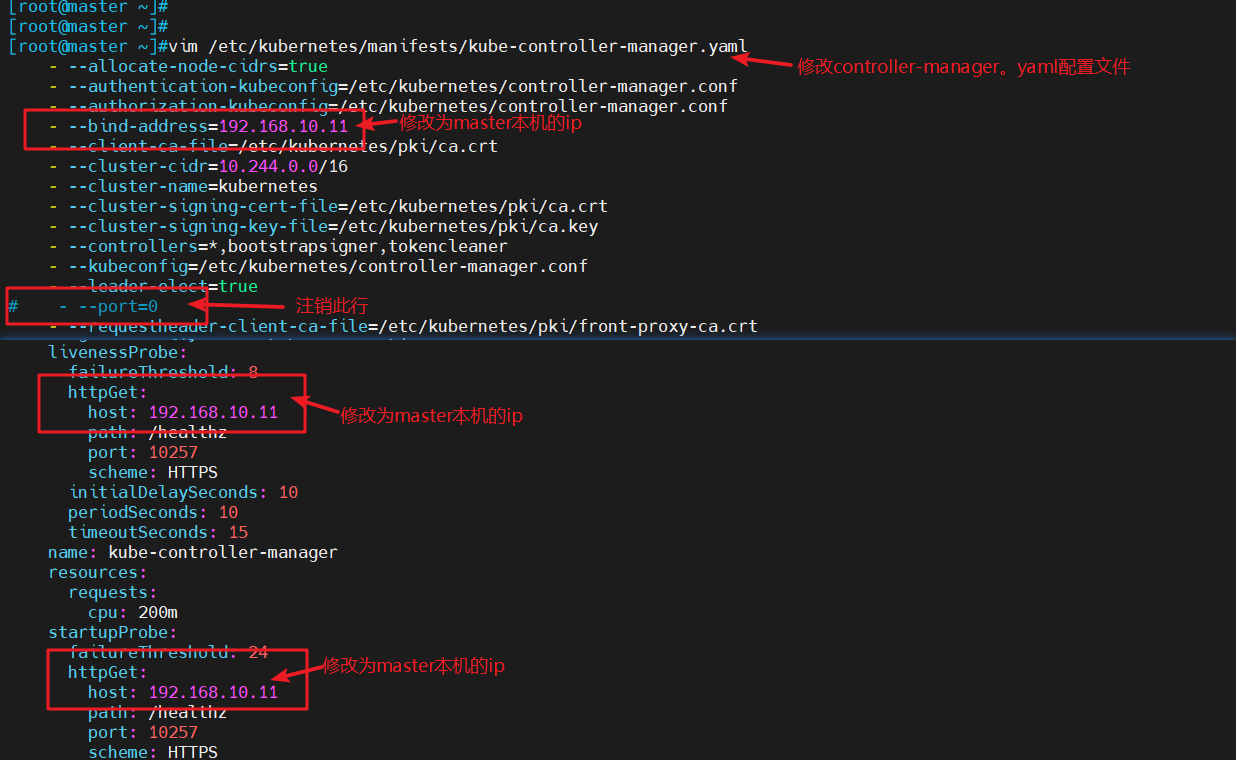

vim /etc/kubernetes/manifests/kube-controller-manager.yaml

- --bind-address=192.168.10.11

#修改成k8s的控制节点master的ip

# - --port=0

#注销此行

httpGet:

host: 192.168.10.11

#修改为master本机的ip(有两处)

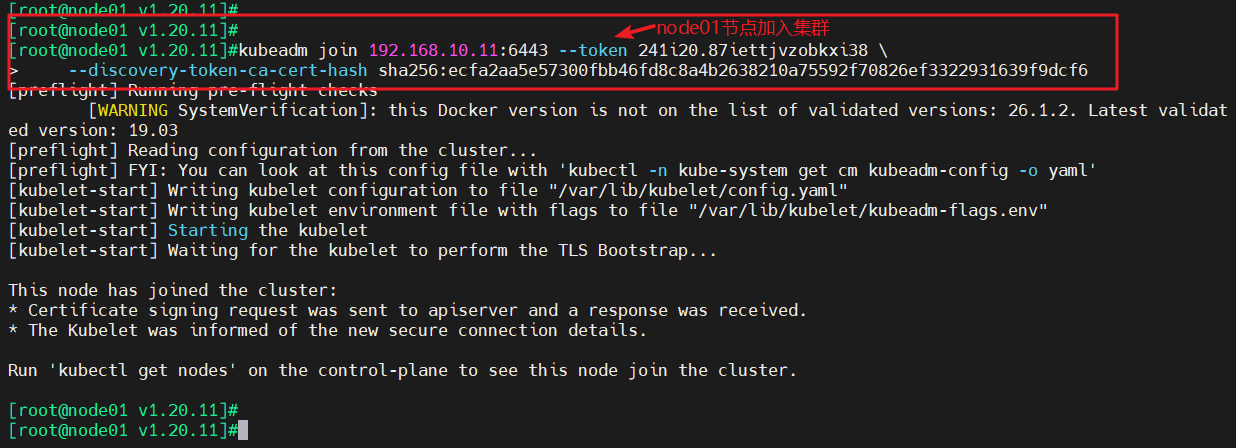

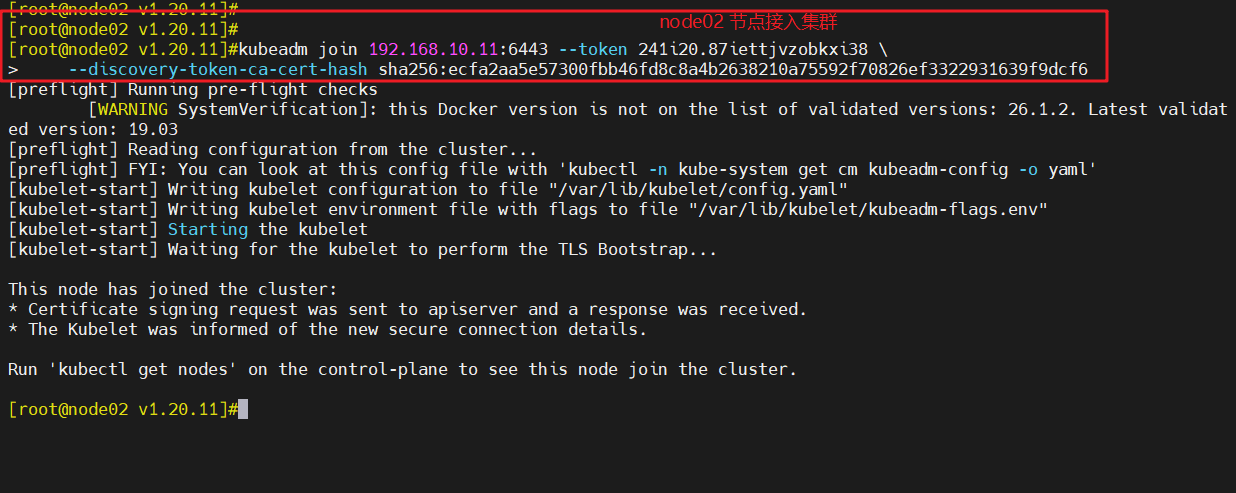

6.9 在node节点上执行kubeadm join命令加入群集

- master节点获取信息

Then you can join any number of worker nodes by running the following on each as root:

kubeadm join 192.168.10.11:6443 --token 241i20.87iettjvzobkxi38 \

--discovery-token-ca-cert-hash sha256:ecfa2aa5e57300fbb46fd8c8a4b2638210a75592f70826ef3322931639f9dcf6

- node节点

kubeadm join 192.168.10.11:6443 --token 241i20.87iettjvzobkxi38 \

--discovery-token-ca-cert-hash sha256:ecfa2aa5e57300fbb46fd8c8a4b2638210a75592f70826ef3322931639f9dcf6

#输入上面信息,node节点加入集群

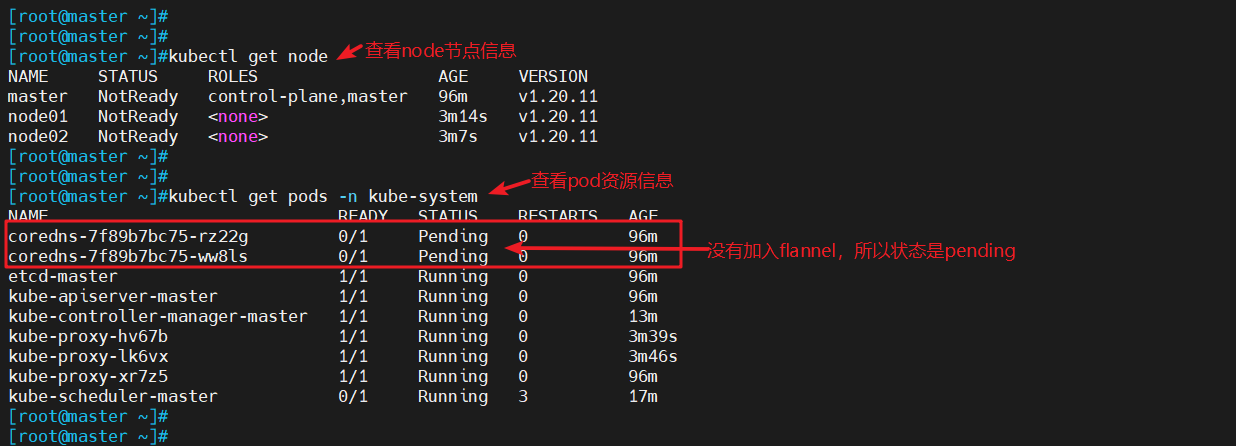

6.10 查看群集节点

- master节点

kubectl get node

#查看集群node节点信息

kubectl get pods -n kube-system

#查看pod资源信息

#由于coredns组件还未启动,因此节点状态都为NotReady,下一步安装flannel即可启动

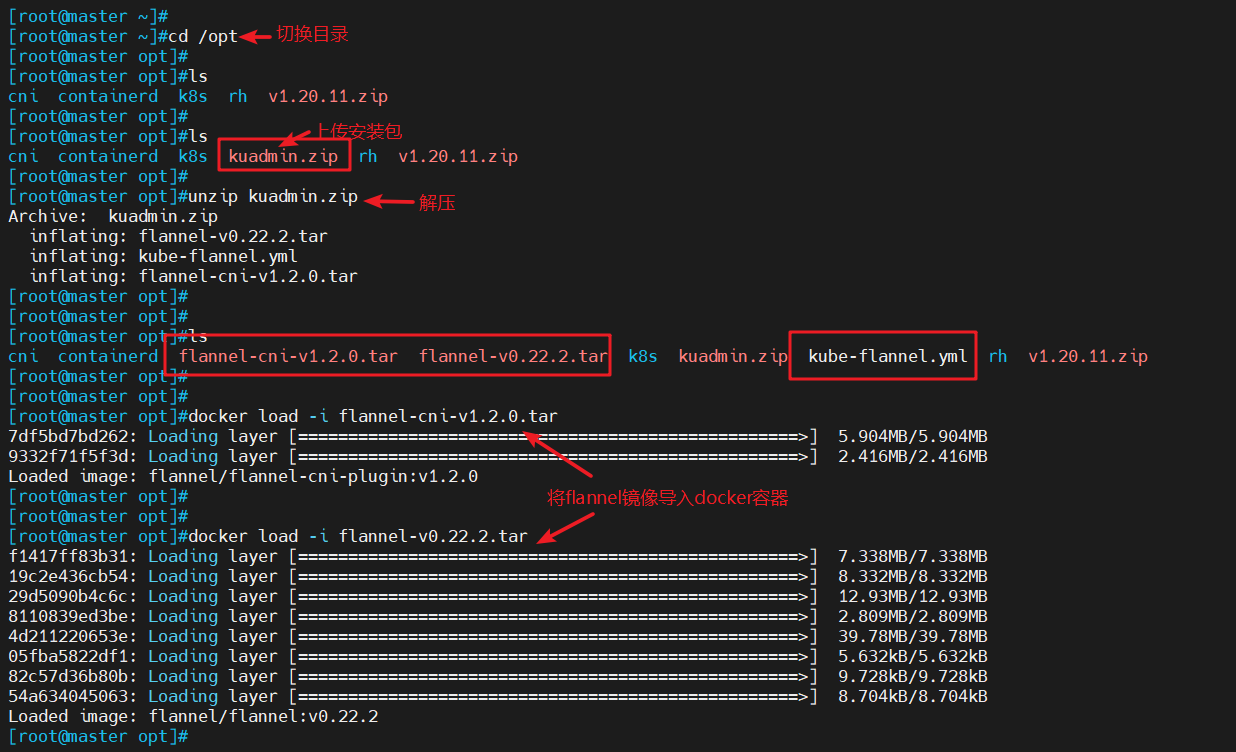

6.11 所有节点部署网络插件flannel

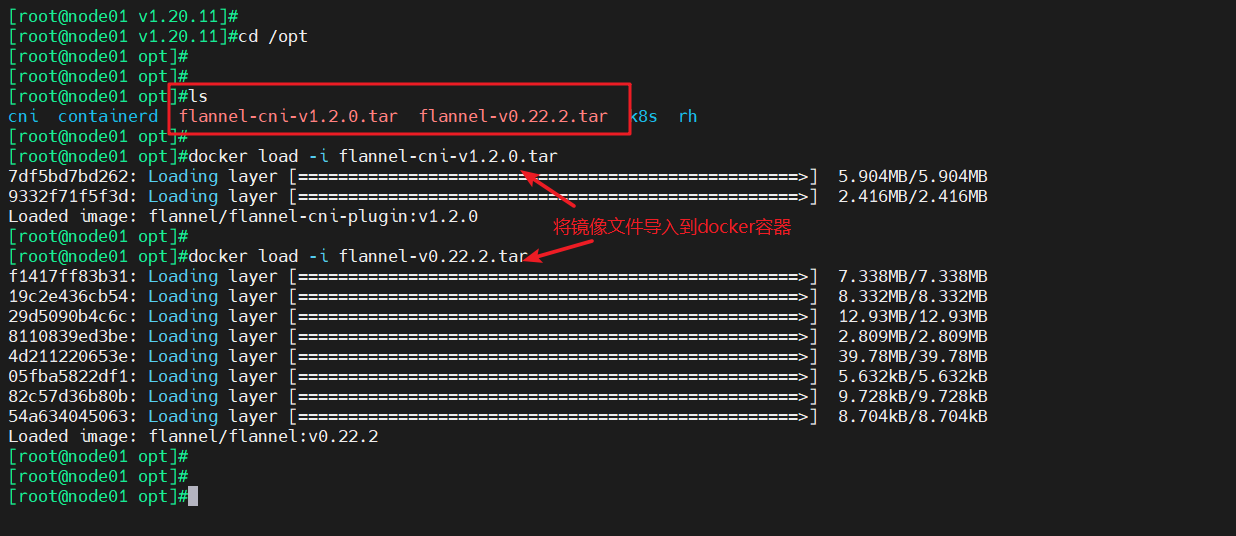

6.11.1 方法一

- 所有节点上传flannel镜像到 /opt 目录,master节点上传 kube-flannel.yml 文件

cd /opt

#切换目录

#上传kuadmin.zip压缩包

unzip kuadmin.zip

#解压目录

#(flannel-cni-v1.2.0.tar flannel-v0.22.2.tar kube-flannel.yml)

docker load -i flannel-cni-v1.2.0.tar

docker load -i flannel-v0.22.2.tar

#载入flannel镜像到docker容器

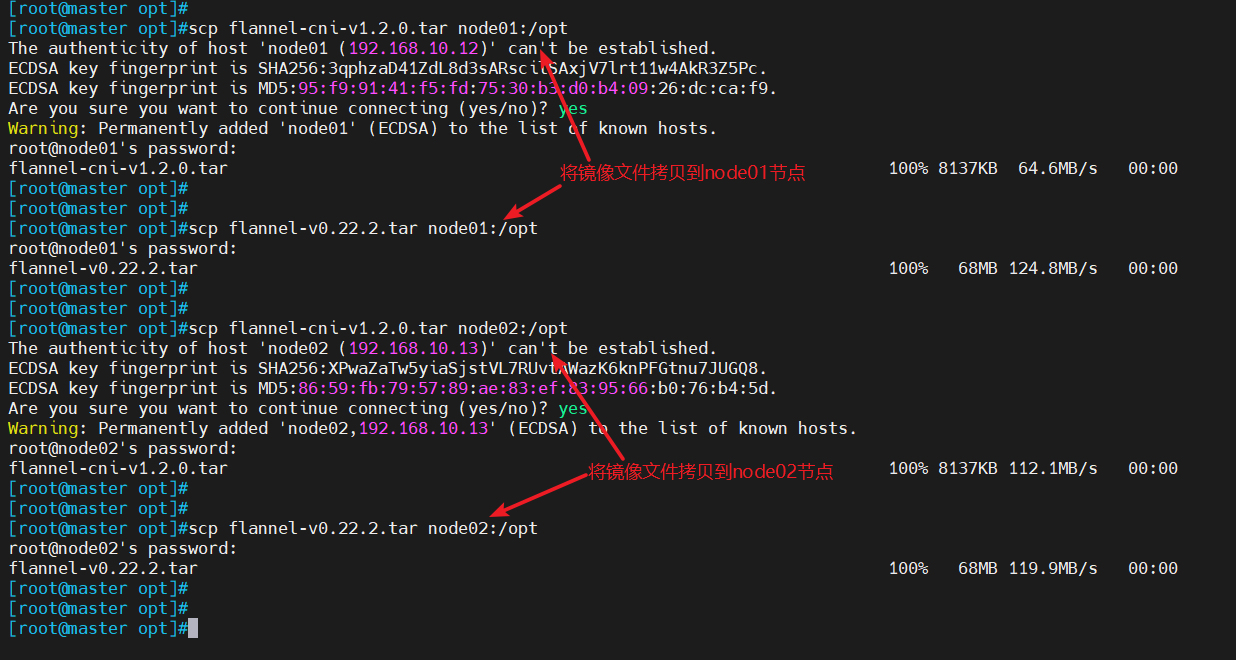

scp flannel-cni-v1.2.0.tar node01:/opt

scp flannel-v0.22.2.tar node01:/opt

#将镜像文件拷贝到node01节点

scp flannel-cni-v1.2.0.tar node02:/opt

scp flannel-v0.22.2.tar node02:/opt

#将镜像文件拷贝到node02节点

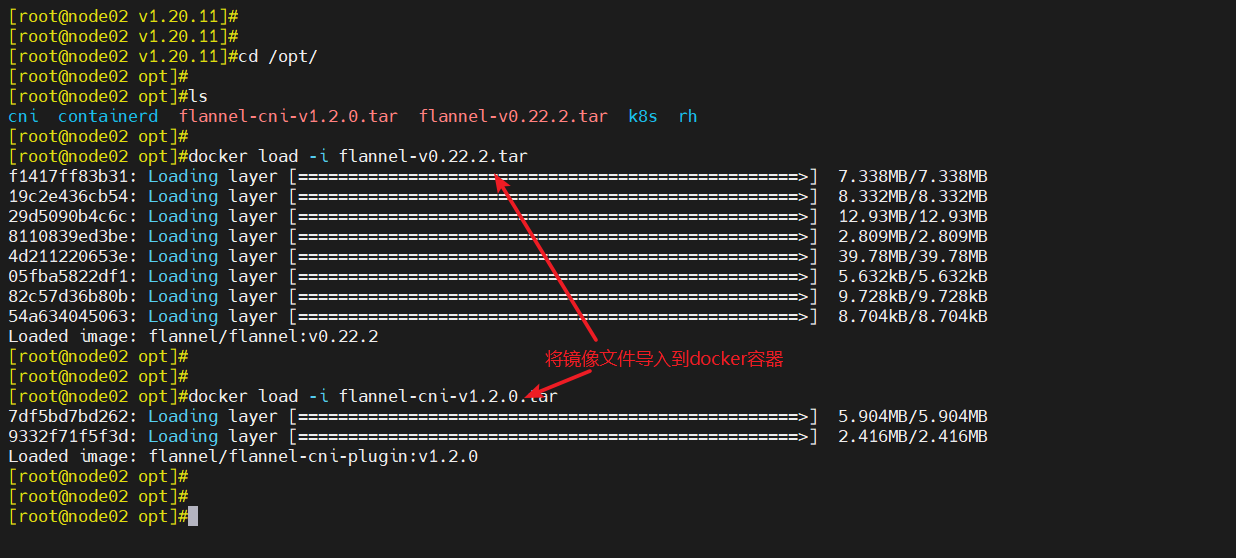

- node节点

docker load -i flannel-cni-v1.2.0.tar

docker load -i flannel-v0.22.2.tar

#载入flannel镜像到docker容器

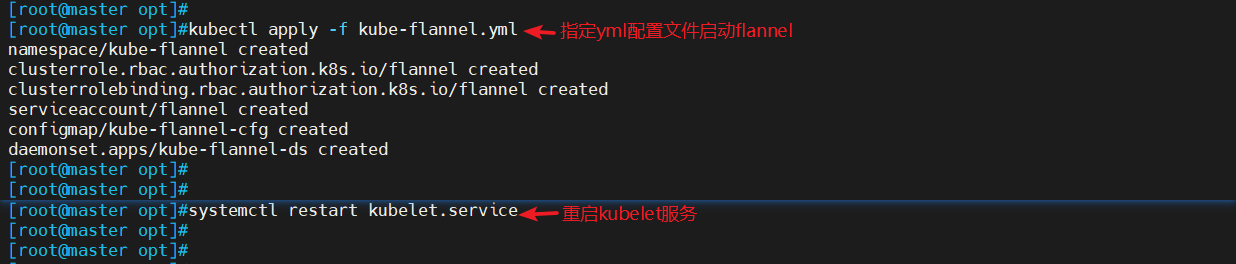

- 在master节点创建flannel资源

kubectl apply -f kube-flannel.yml

#指定yml配置文件

systemctl restart kubelet.service

#重启kubelet服务

6.11.2 方法二

kubectl apply -f https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

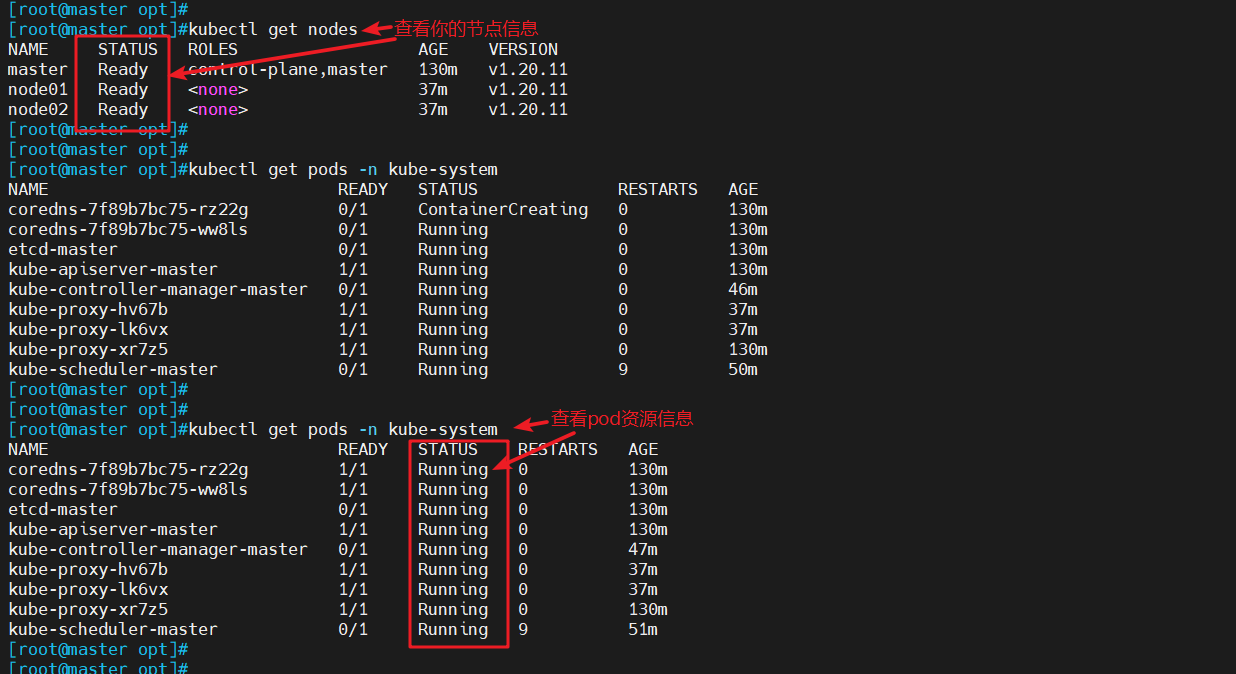

6.12 查看节点状态

- master节点

kubectl get nodes

#查看node节点信息

kubectl get pods -n kube-system

#查看pod资源信息

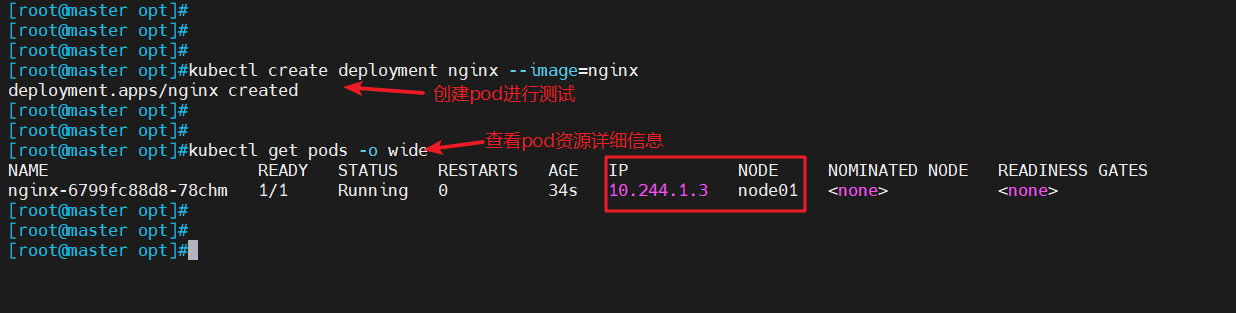

6.13 测试pod资源创建

- master节点

kubectl create deployment nginx --image=nginx

#创建pod资源测试

kubectl get pods -o wide

#查看pod资源详细信息

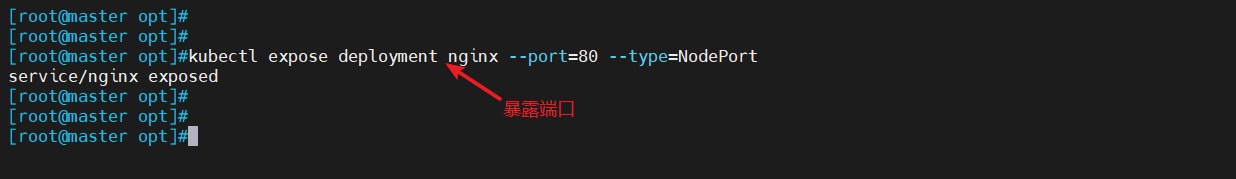

6.14 暴露端口提供服务

- master节点

kubectl expose deployment nginx --port=80 --type=NodePort

#暴露端口提供服务

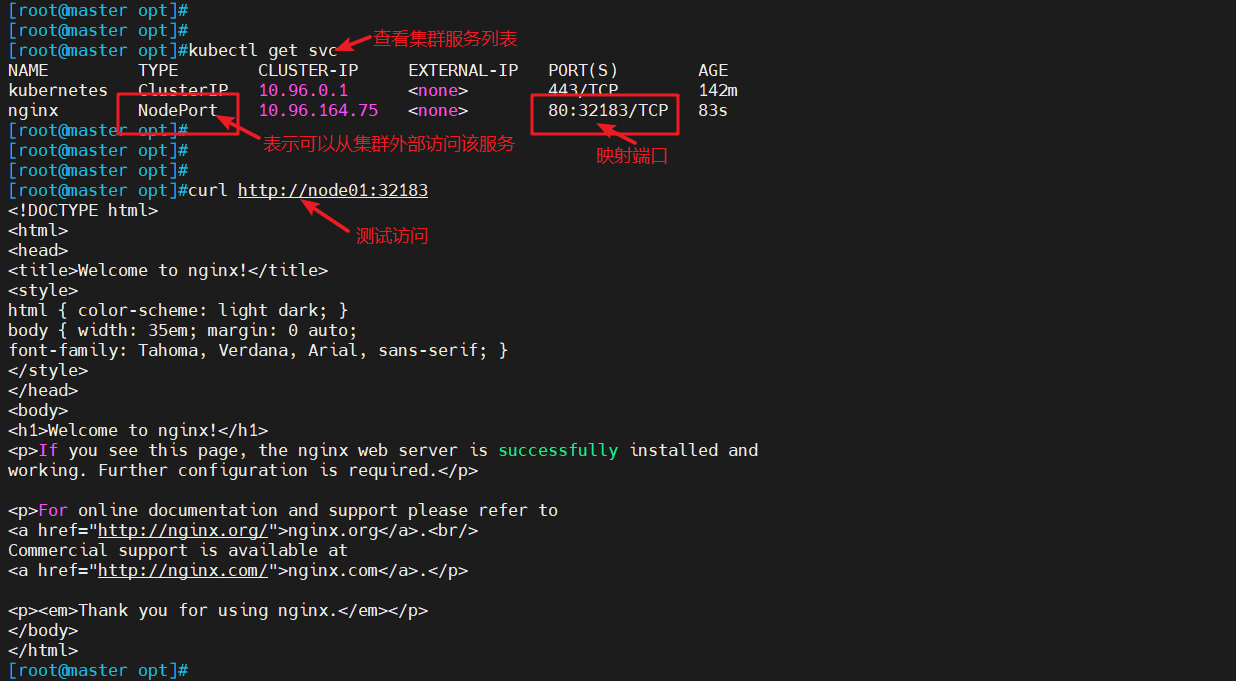

6.15 测试访问

kubectl get svc

#查看集群中所有服务的(Services)列表

curl http://node01:32183

#测试访问

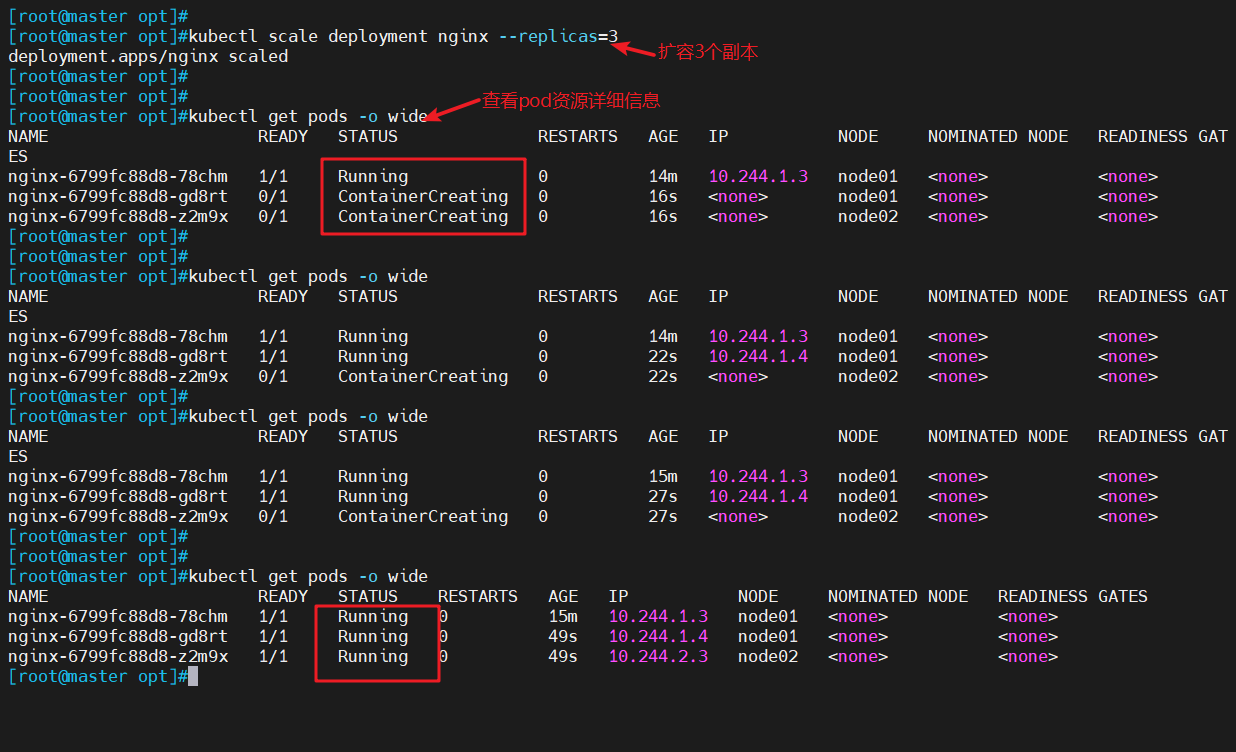

6.16 扩展3个副本

- master节点

kubectl scale deployment nginx --replicas=3

#扩容3个副本

kubectl get pods -o wide

#查看pod资源详细信息

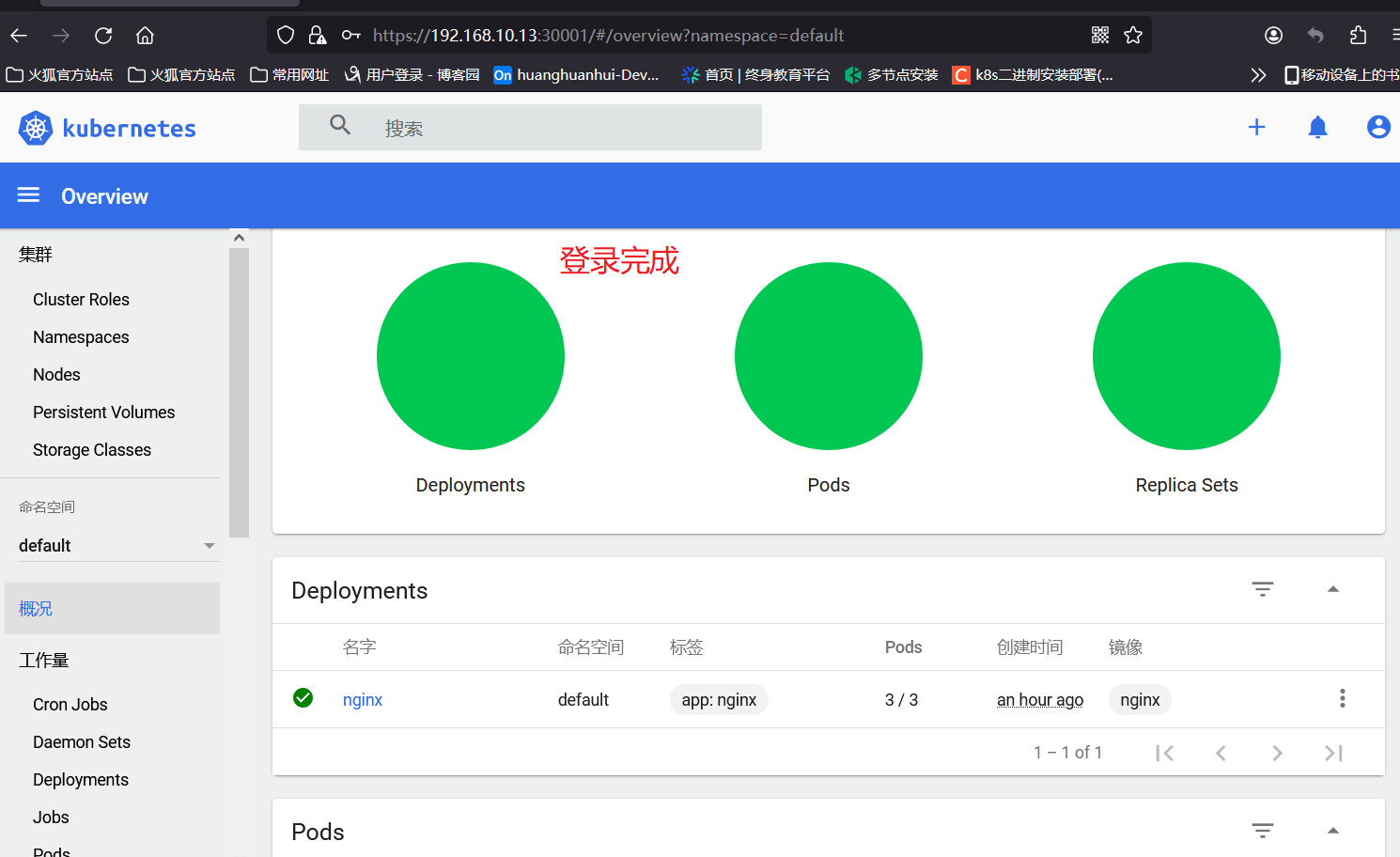

二、安装dashboard

1、所有节点安装dashboard

1.1 方法一

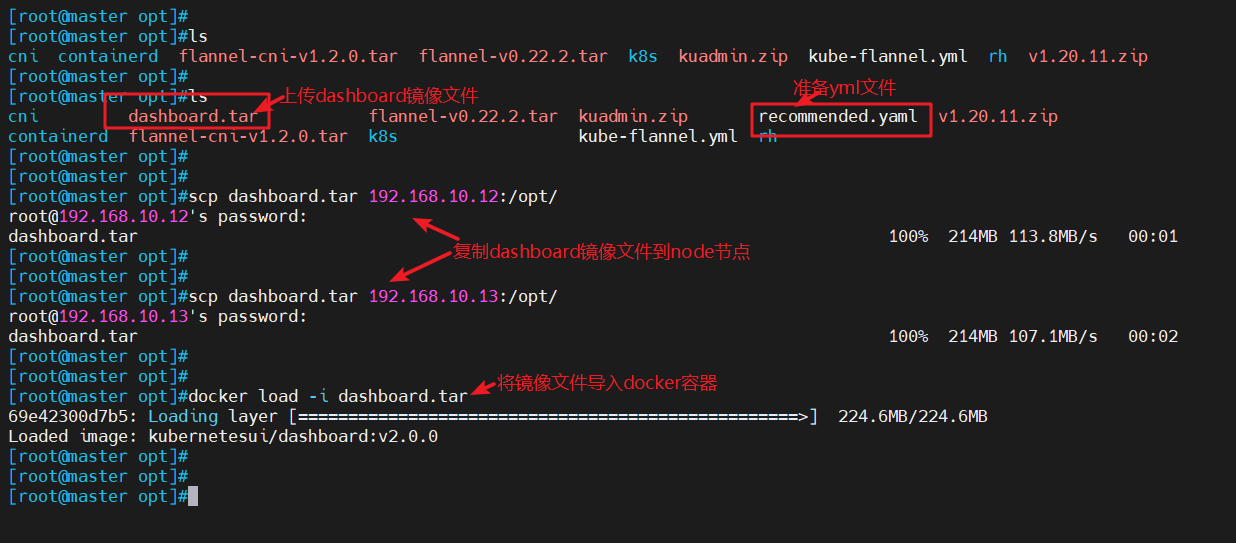

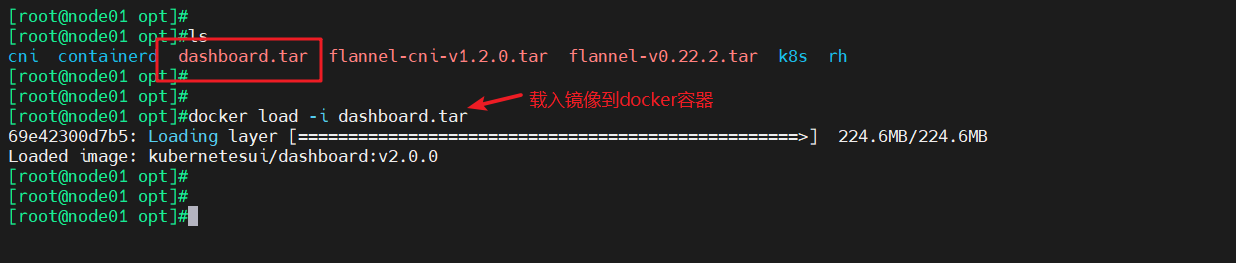

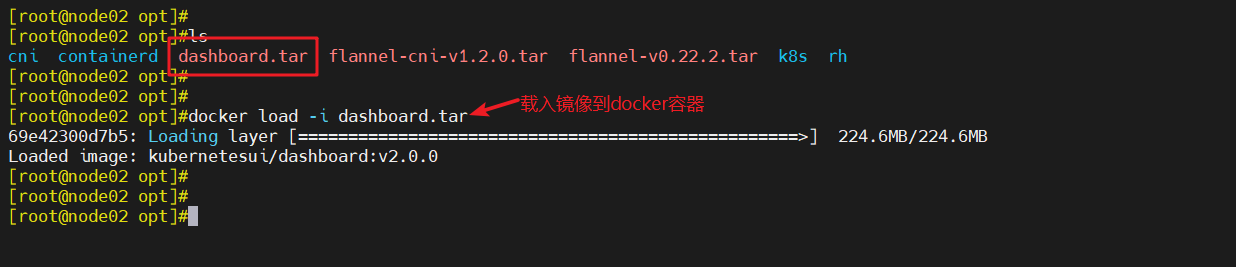

- 所有节点上传dashboard镜像 dashboard.tar 到 /opt 目录,master节点上传kubernetes-dashboard.yaml文件

cd /opt

#切换目录

#上传dashboard镜像 dashboard.tar 到 /opt 目录

#master节点上传recommended.yaml文件

scp dashboard.tar 192.168.10.12:/opt/

scp dashboard.tar 192.168.10.13:/opt/

#拷贝dashboard.tar镜像文件到node节点

docker load -i dashboard.tar

#所有节点载入dashboard镜像

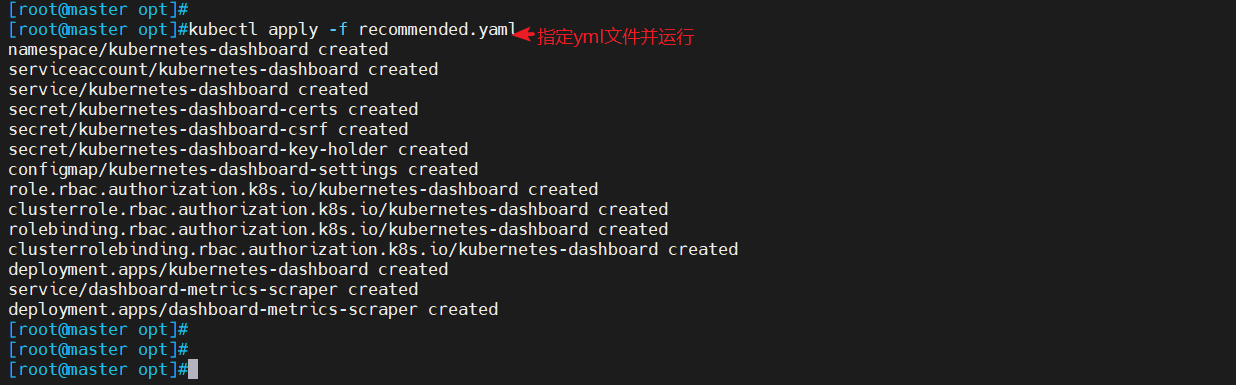

- master节点

kubectl apply -f recommended.yaml

#指定yml文件dashboard服务

1.2 方法二

kubectl apply -f https://raw.githubusercontent.com/kubernetes/dashboard/v2.0.0/aio/deploy/recommended.yaml

2、查看所有容器运行状态

kubectl get pods,svc -n kube-system -o wide

3、访问测试

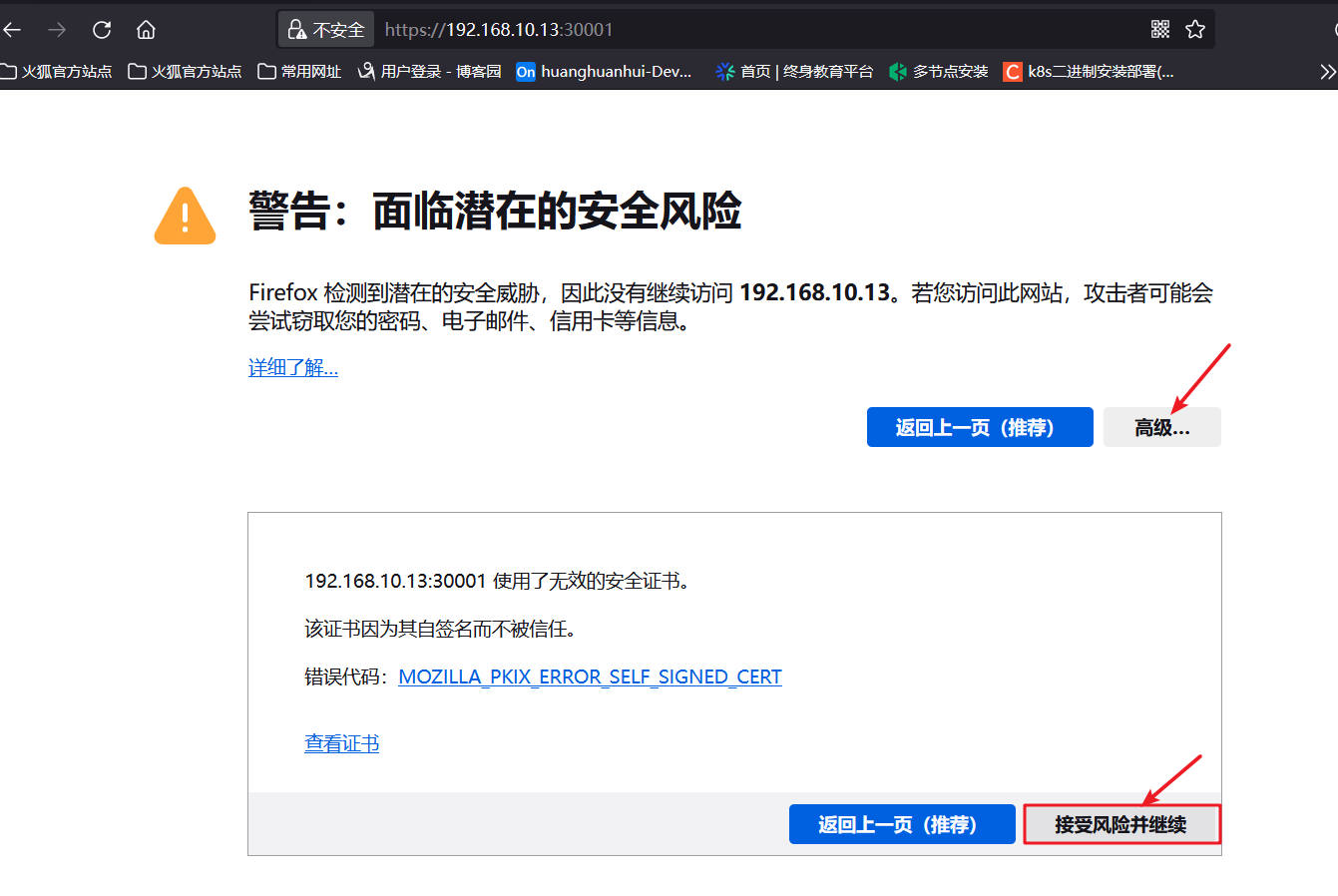

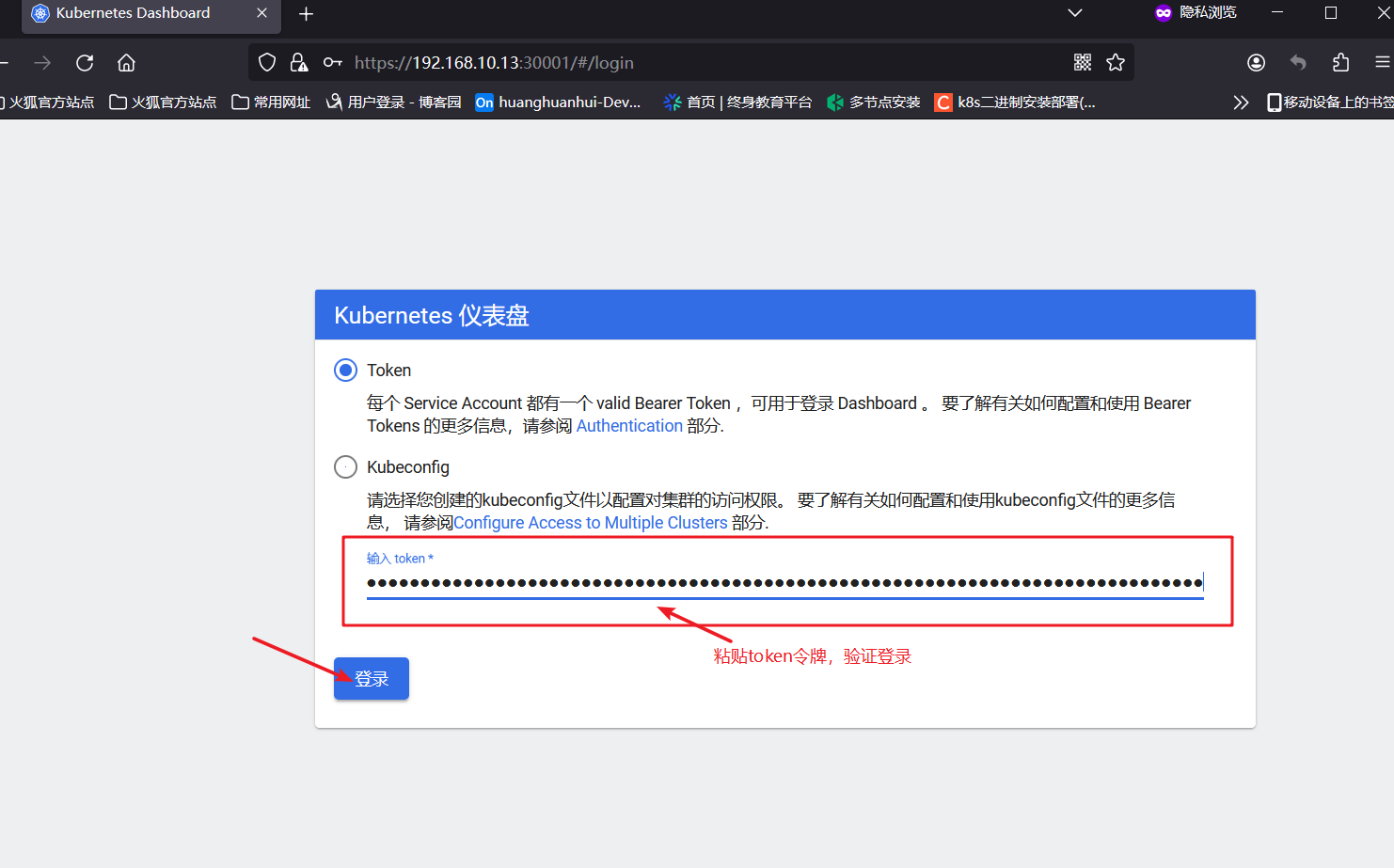

3.1 使用火狐或者360访问

https://192.168.10.13:30001

#使用浏览器访问

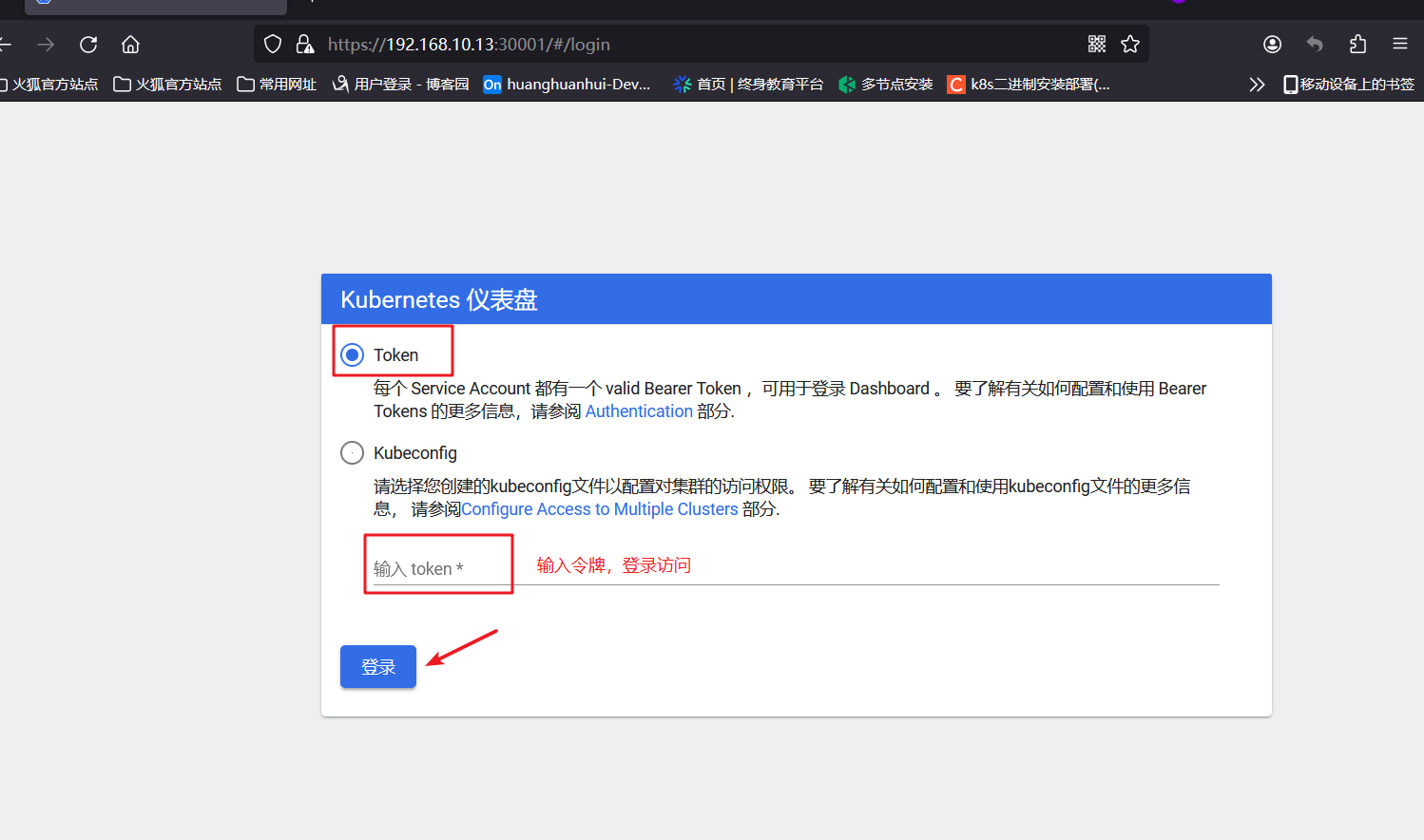

3.2 令牌获取

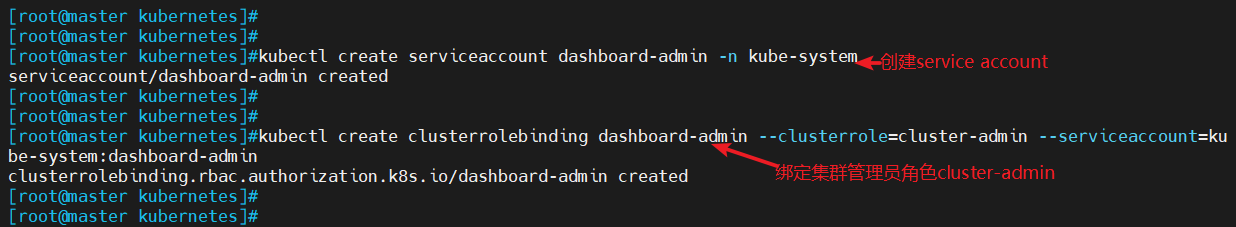

3.2.1 创建service account并绑定默认cluster-admin管理员集群角色

kubectl create serviceaccount dashboard-admin -n kube-system

#创建一个新的serviceaccount,名为 dashboard-admin

kubectl create clusterrolebinding dashboard-admin --clusterrole=cluster-admin --serviceaccount=kube-system:dashboard-admin

#创建service account并绑定默认cluster-admin管理员集群角色

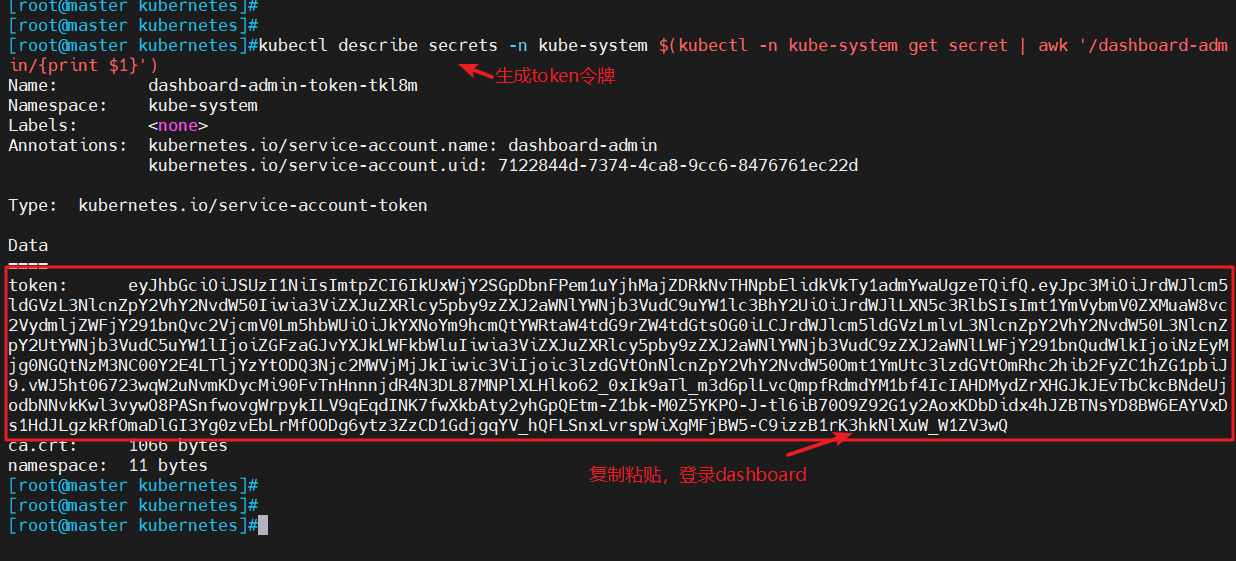

3.2.2 获取令牌密钥

kubectl describe secrets -n kube-system $(kubectl -n kube-system get secret | awk '/dashboard-admin/{print $1}')

#获取令牌

3.3 使用令牌登录

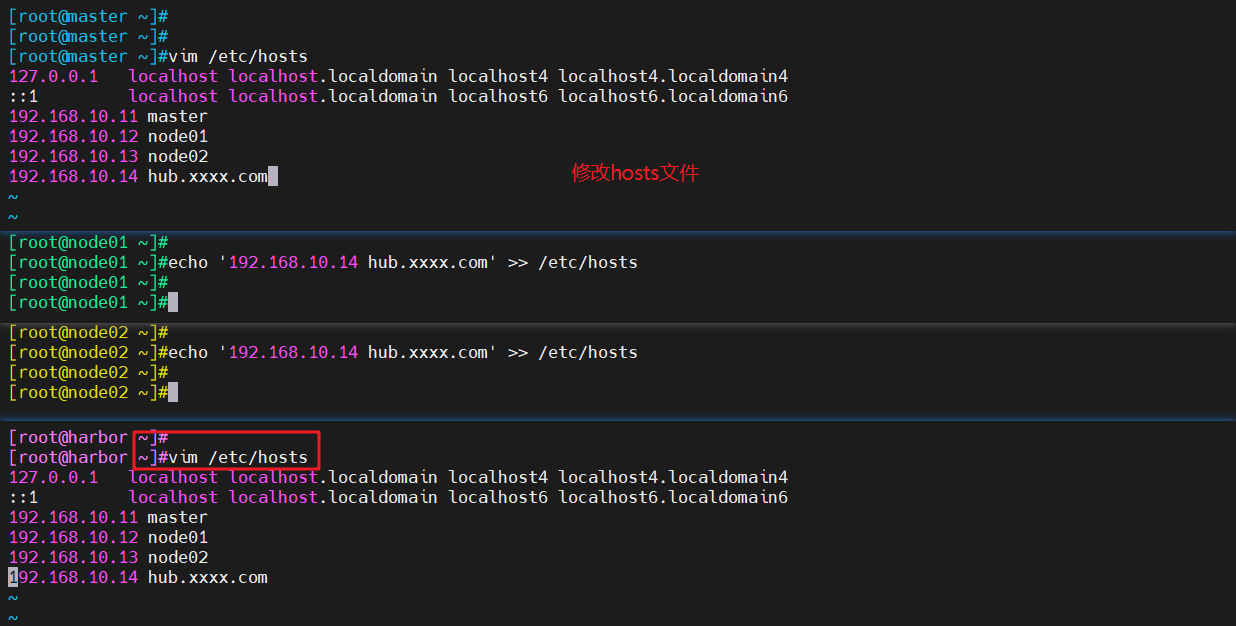

三、 安装Harbor私有仓库

- 所有节点修改hosts文件

echo '192.168.10.14 hub.xxxx.com' >> /etc/hosts

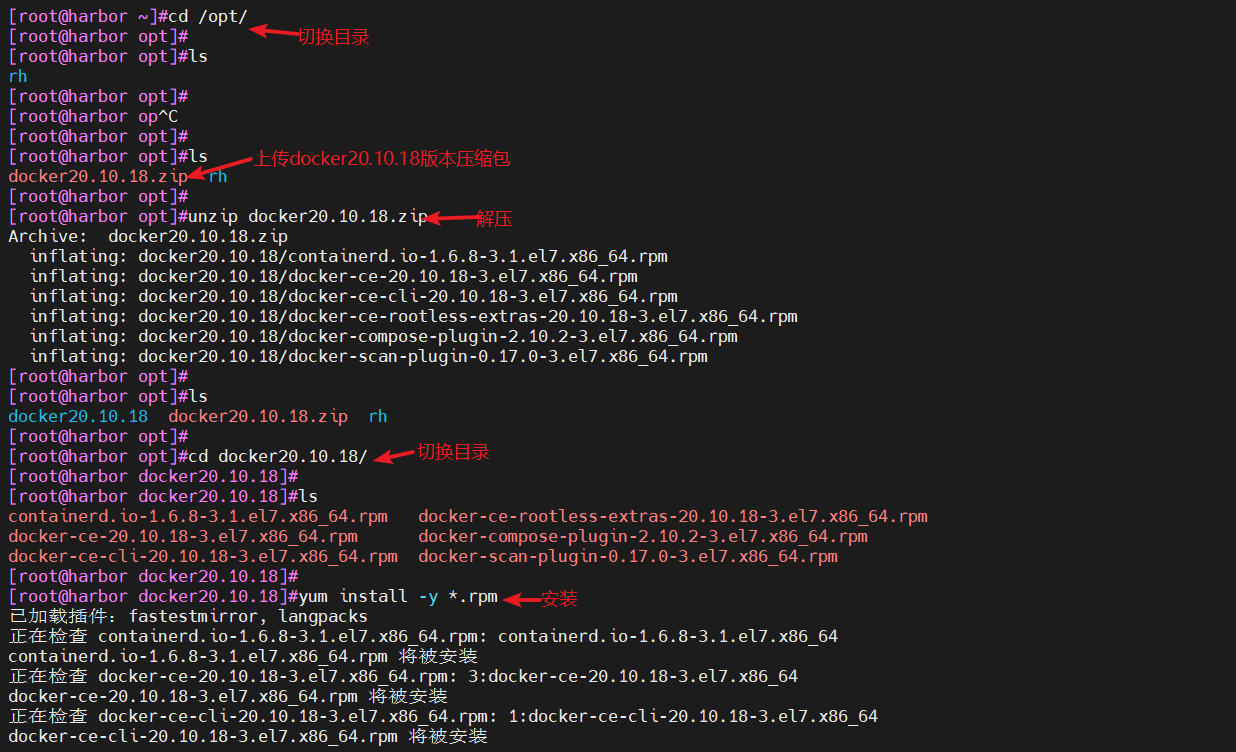

1、安装docker

- 由于版本兼容问题,此处使用20.10.18版本的docker

cd /opt/

#切换目录

#上传docker20.10.18.zip安装包

unzip docker20.10.18.zip

#解压

cd docker20.10.18/

#切换目录

yum install -y *.rpm

#安装

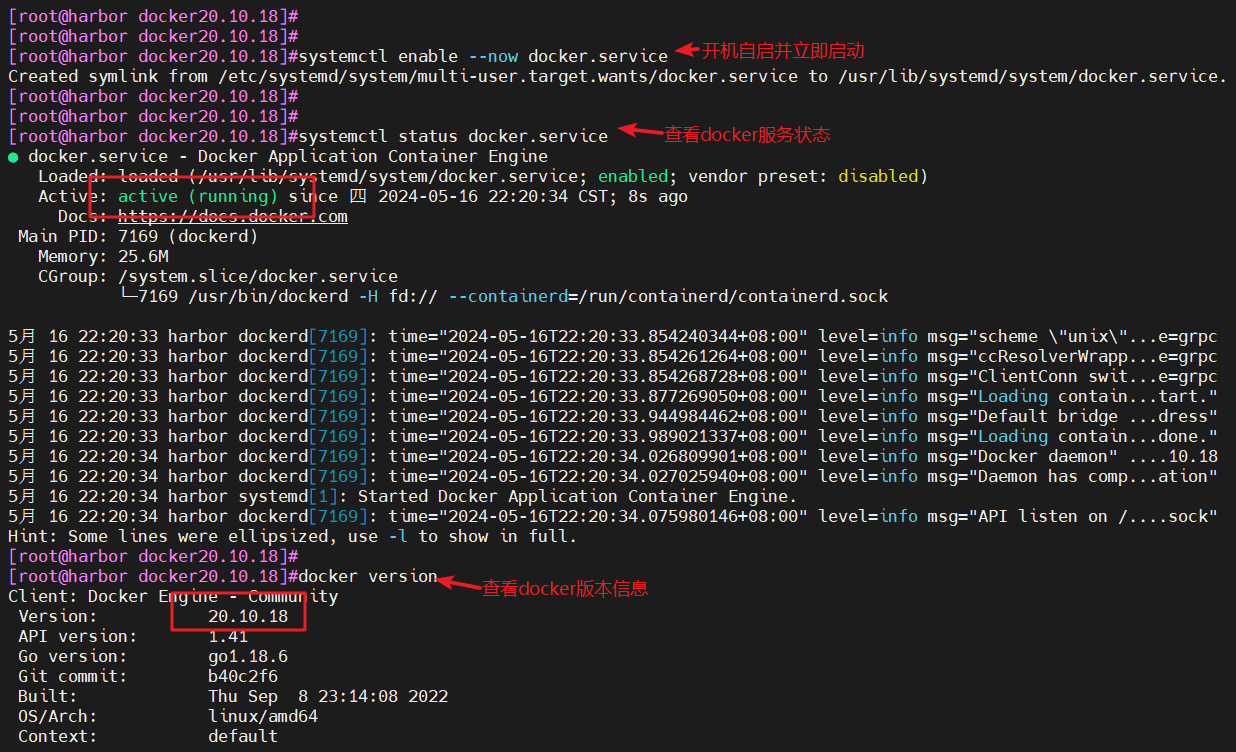

systemctl enable --now docker.service

#开机自启并立即启动

systemctl status docker.service

#查看docker服务状态

docker version

#查看版本信息

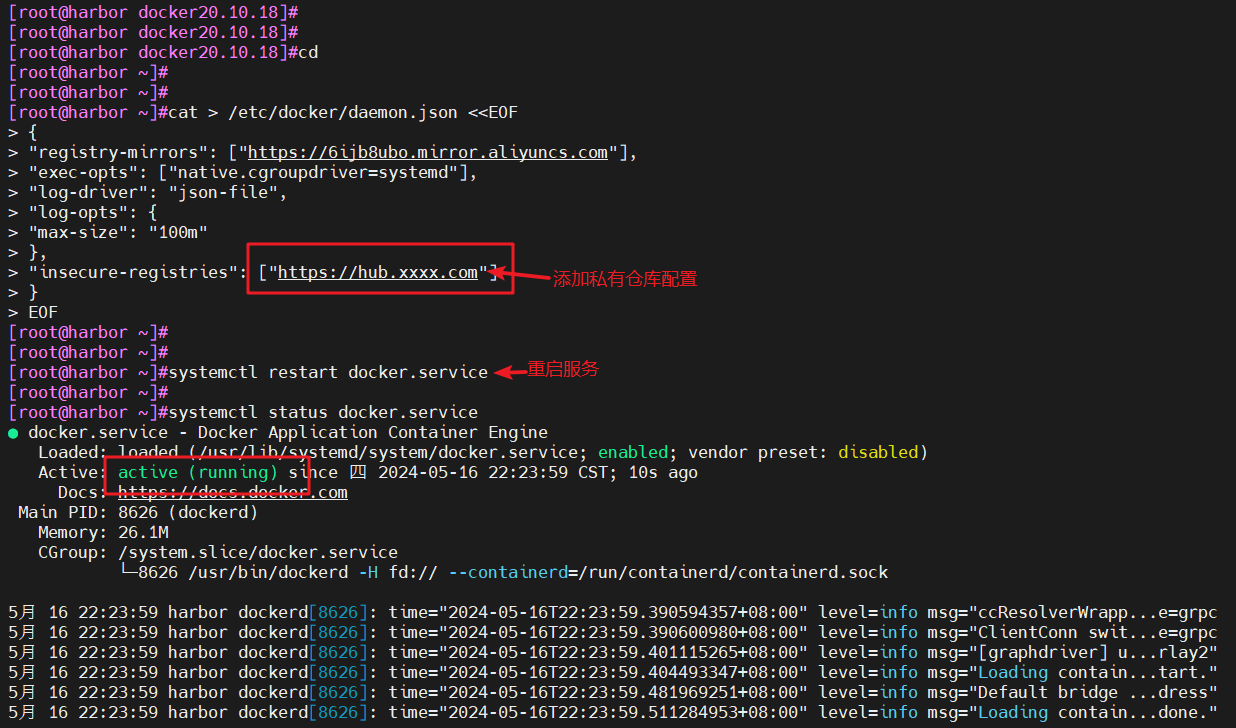

2、编写daemon.json

cat > /etc/docker/daemon.json <<EOF

{

"registry-mirrors": ["https://6ijb8ubo.mirror.aliyuncs.com"],

"exec-opts": ["native.cgroupdriver=systemd"],

"log-driver": "json-file",

"log-opts": {

"max-size": "100m"

},

"insecure-registries": ["https://hub.xxxx.com"]

}

EOF

#添加私有仓库配置

systemctl restart docker

#重启docker服务

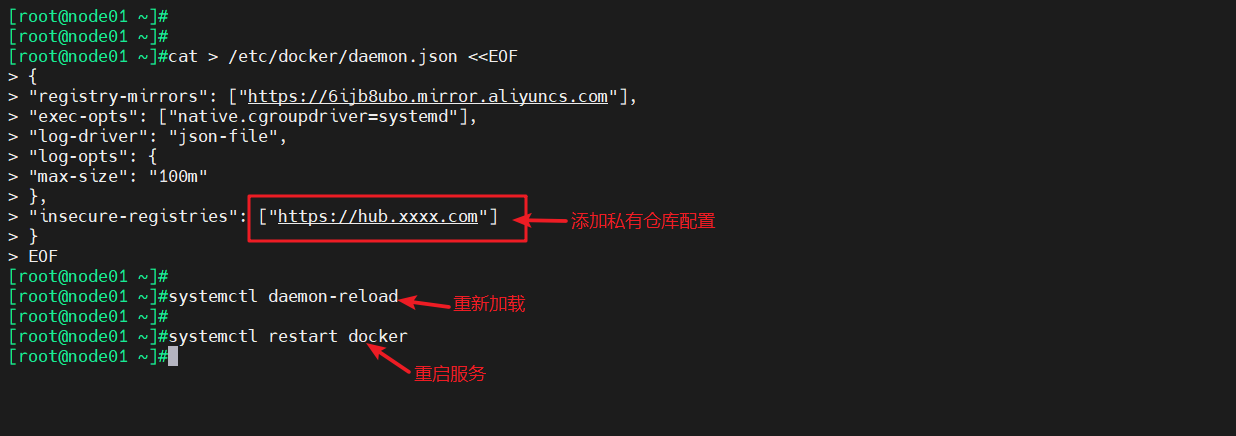

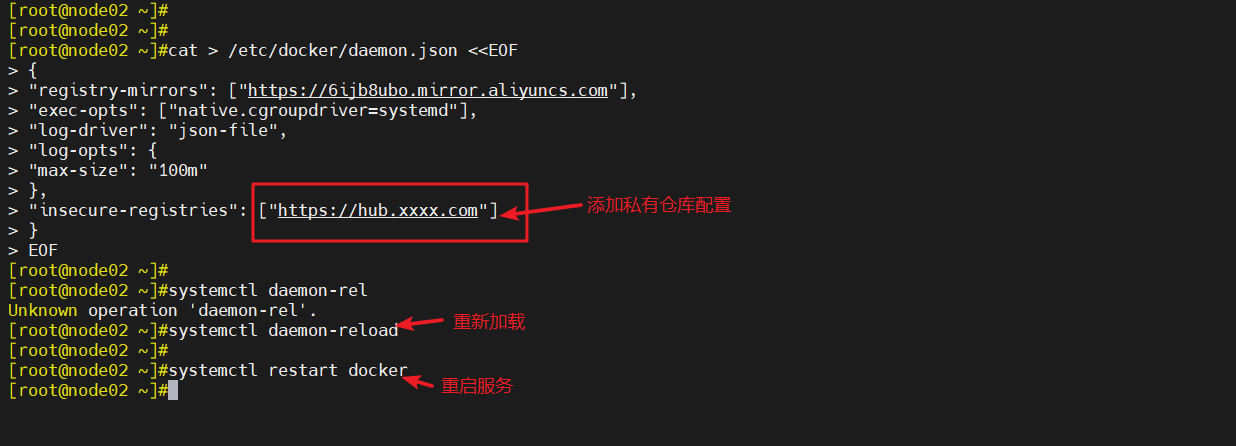

3、node节点修改docker配置文件

- 所有node节点修改docker配置文件中加上私有仓库配置

cat > /etc/docker/daemon.json <<EOF

{

"registry-mirrors": ["https://6ijb8ubo.mirror.aliyuncs.com"],

"exec-opts": ["native.cgroupdriver=systemd"],

"log-driver": "json-file",

"log-opts": {

"max-size": "100m"

},

"insecure-registries": ["https://hub.xxxx.com"]

}

EOF

systemctl daemon-reload

#重新加载

systemctl restart docker

#重启服务

- node01节点

- node02节点

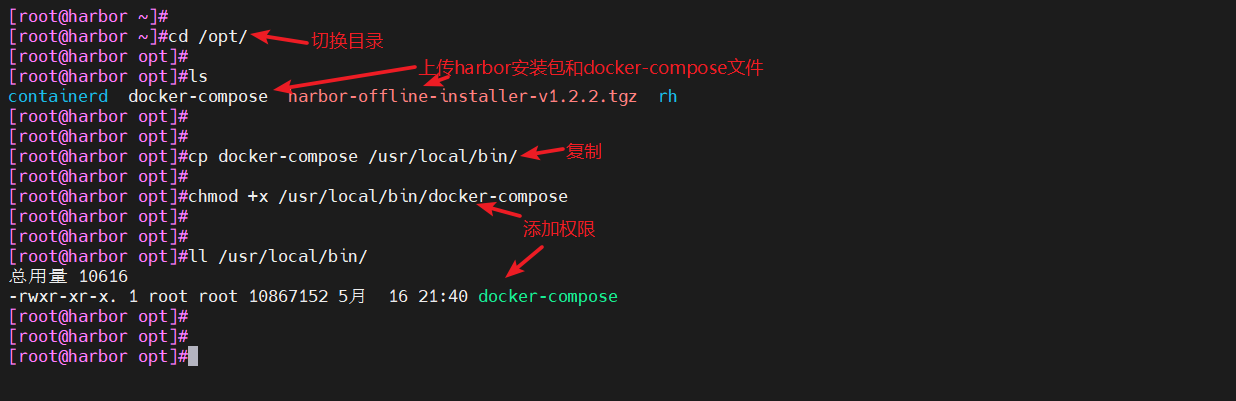

4、安装Harbor

4.1 准备harbor安装包及相关配置文件

- 上传 harbor-offline-installer-v1.2.2.tgz 和 docker-compose 文件到 /opt 目录

cd /opt

#切换目录

#上传harbor-offline-installer-v1.2.2.tgz和docker-compose

cp docker-compose /usr/local/bin/

#复制docker-compose文件到指定目录

chmod +x /usr/local/bin/docker-compose

#添加权限

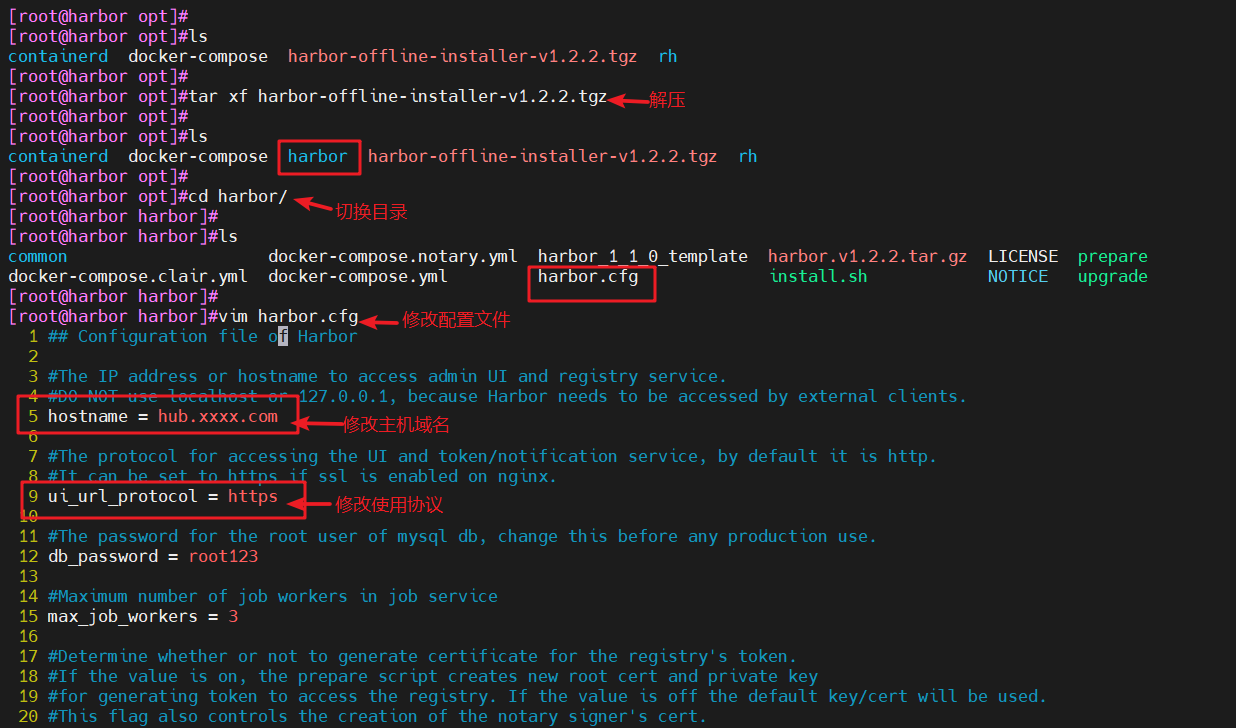

4.2 修改配置文件

tar xf harbor-offline-installer-v1.2.2.tgz

#解压

cd harbor/

#切换目录

#修改配置文件

vim harbor.cfg

5 hostname = hub.xxxx.com

#第5行,修改主机域名

9 ui_url_protocol = https

#第9行,修改使用协议

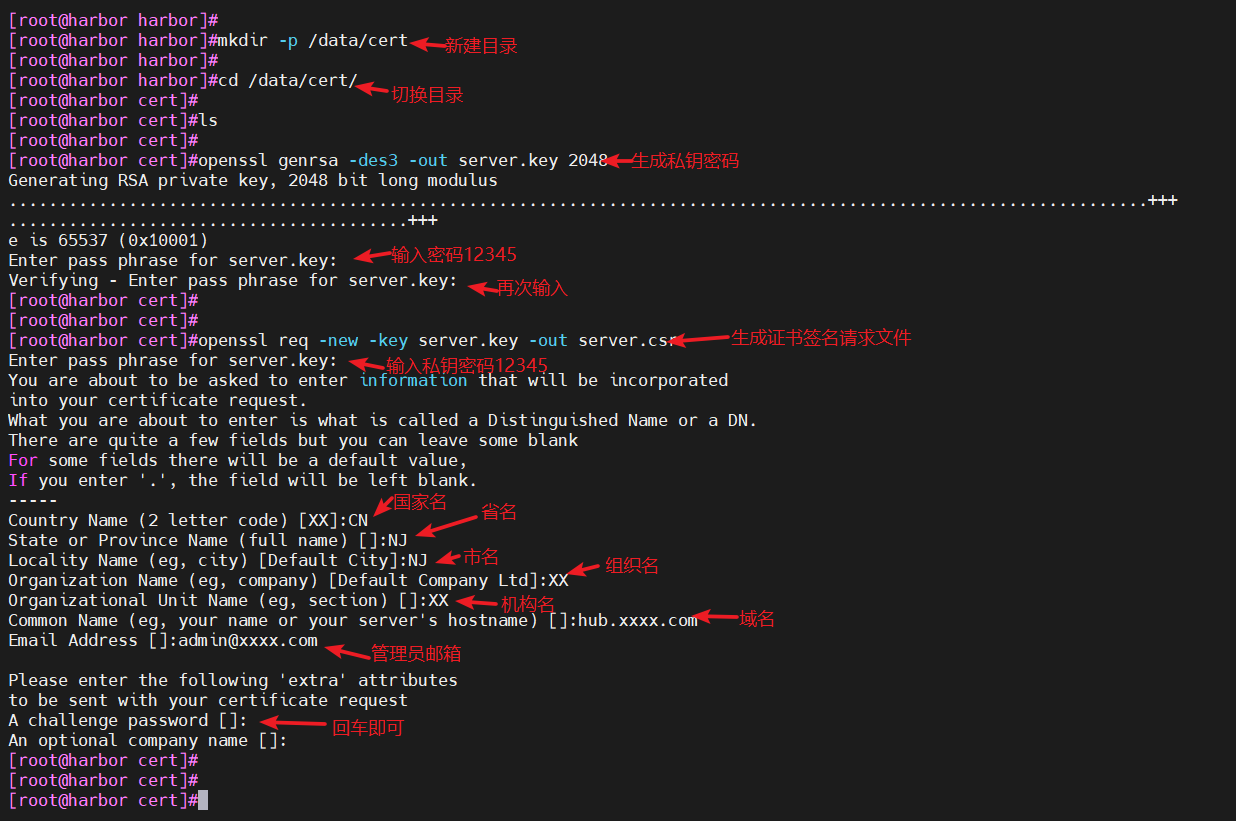

5、生成证书

mkdir -p /data/cert

#新建存放证书目录

cd /data/cert

#切换目录

openssl genrsa -des3 -out server.key 2048

#生成私钥

#输入两遍密码:123456

openssl req -new -key server.key -out server.csr

#生成证书签名请求文件

Enter pass phrase for server.key:

#输入私钥密码

-----

Country Name (2 letter code) [XX]:CN

#输入国家名

State or Province Name (full name) []:NJ

#输入省名

Locality Name (eg, city) [Default City]:NJ

#输入市名

Organization Name (eg, company) [Default Company Ltd]:XX

#输入组织名

Organizational Unit Name (eg, section) []:XX

#输入机构名

Common Name (eg, your name or your server's hostname) []:hub.xxxx.com

#输入域名

Email Address []:admin@xxxx.com

#输入管理员邮箱

Please enter the following 'extra' attributes

to be sent with your certificate request

#其他全部直接回车

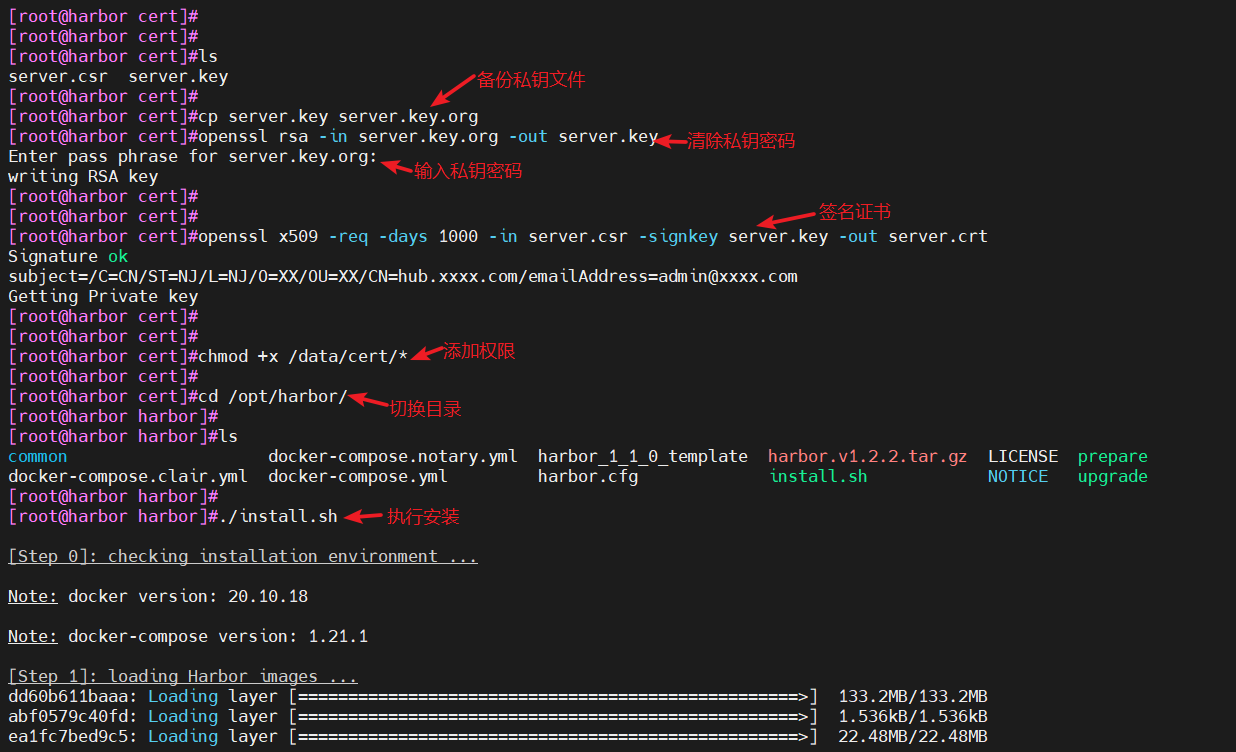

6、管理私钥、签名证书

cp server.key server.key.org

#备份私钥文件

openssl rsa -in server.key.org -out server.key

#清除私钥密码

Enter pass phrase for server.key.org:

#输入私钥密码:123456

openssl x509 -req -days 1000 -in server.csr -signkey server.key -out server.crt

#签名证书

chmod +x /data/cert/*

#添加权限

cd /opt/harbor/

#切换目录

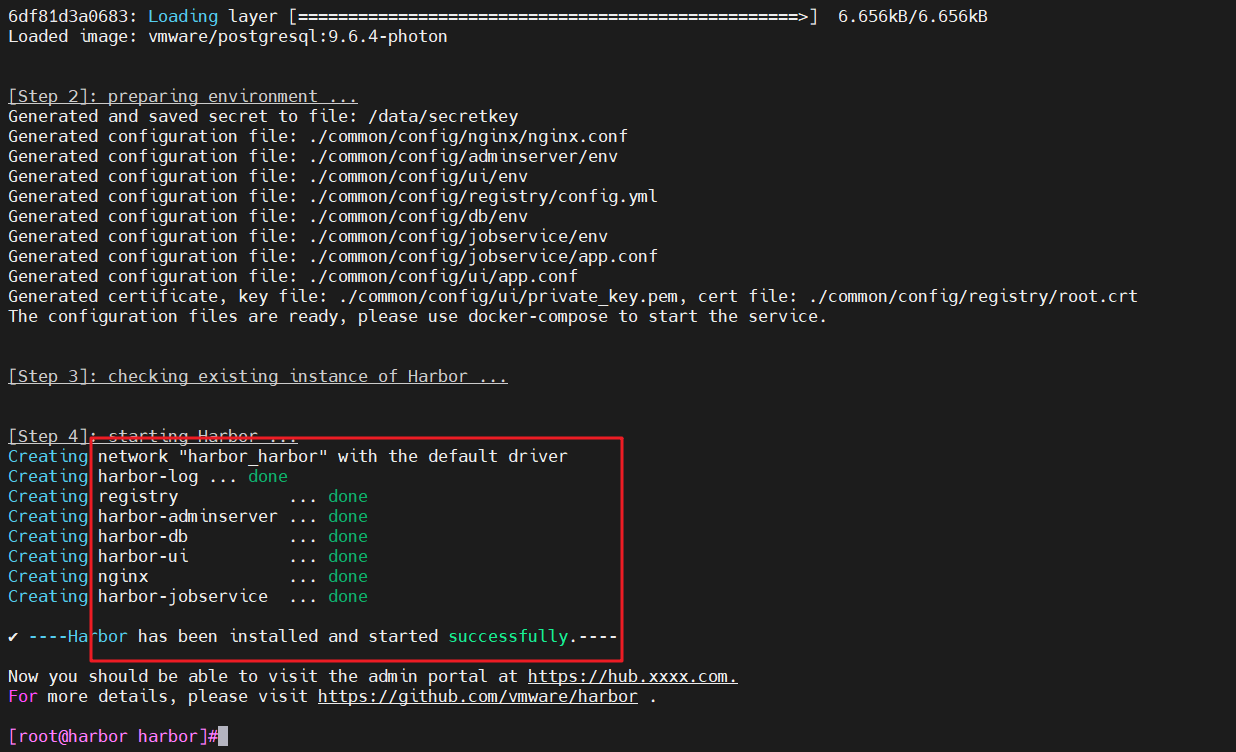

./install.sh

#执行

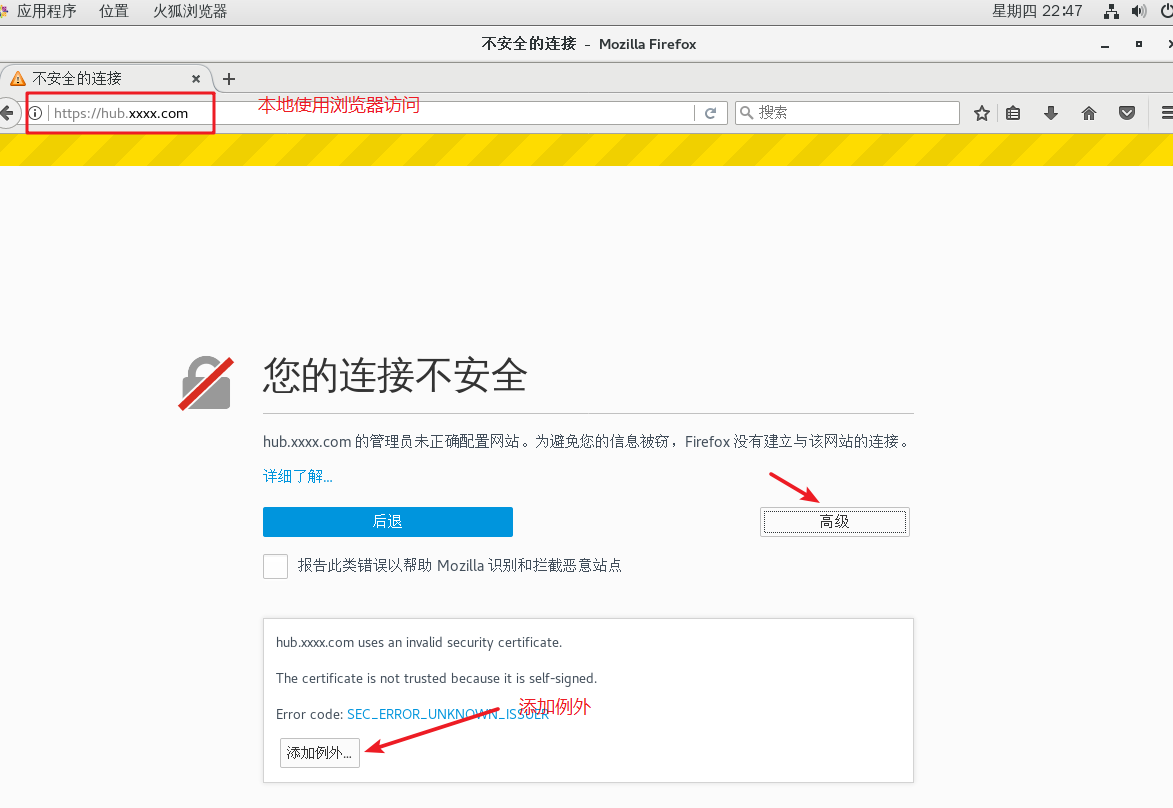

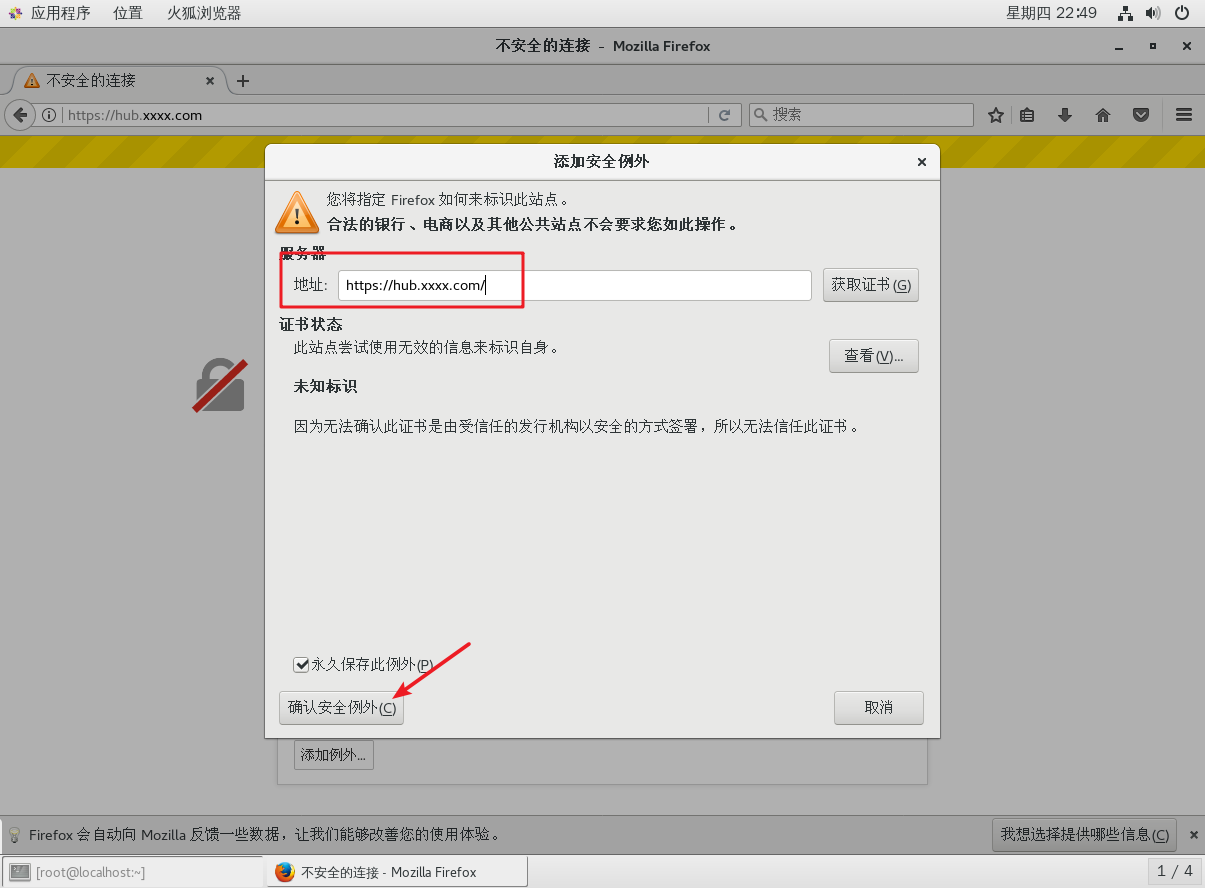

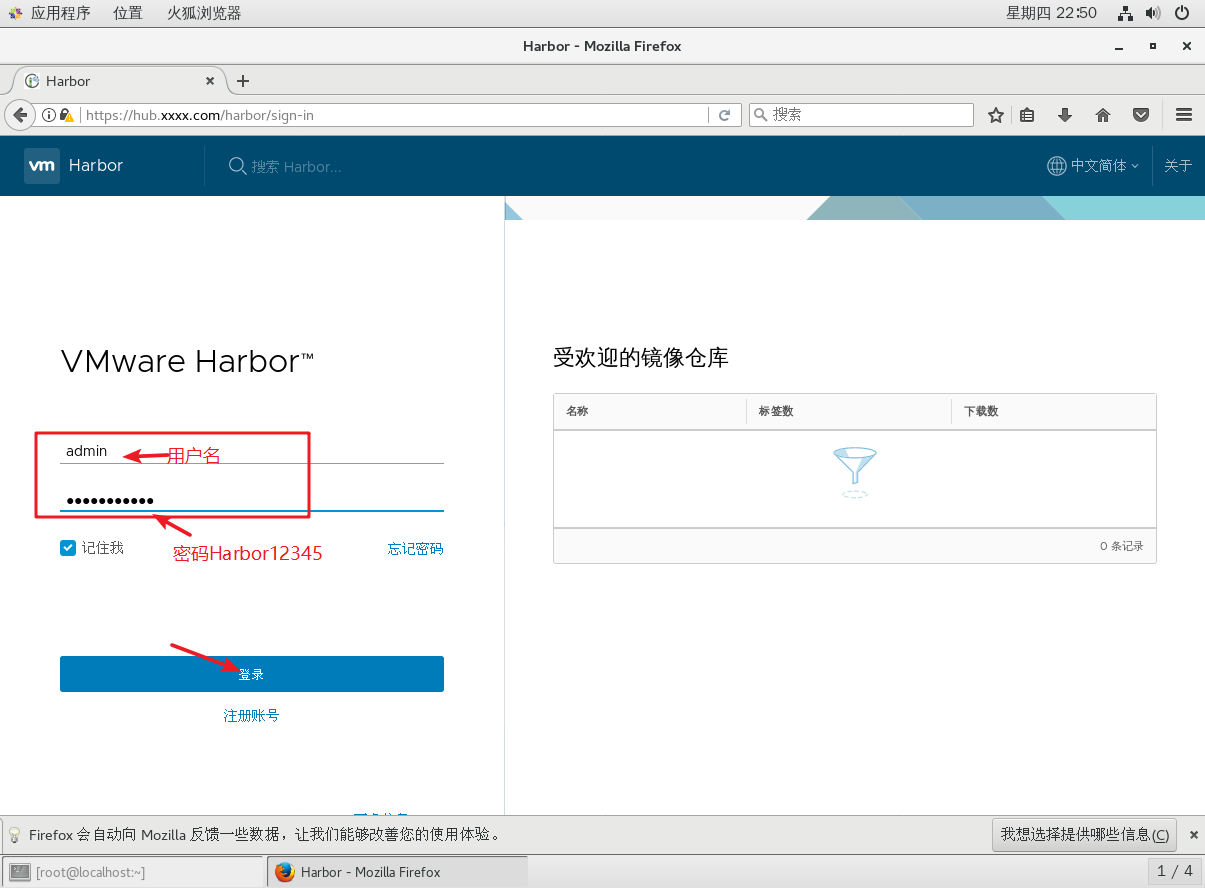

7、在本地使用火狐浏览器访问

https://hub.xxxx.com

用户名:admin

密码:Harbor12345

8、harbor仓库操作

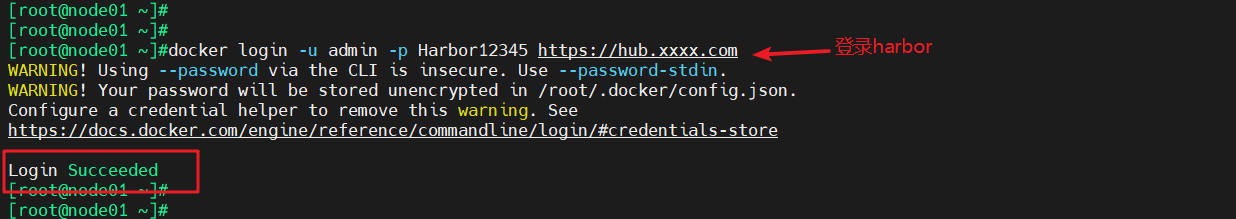

8.1 登录harbor

- node01节点操作

docker login -u admin -p Harbor12345 https://hub.xxxx.com

#在一个node节点上登录harbor

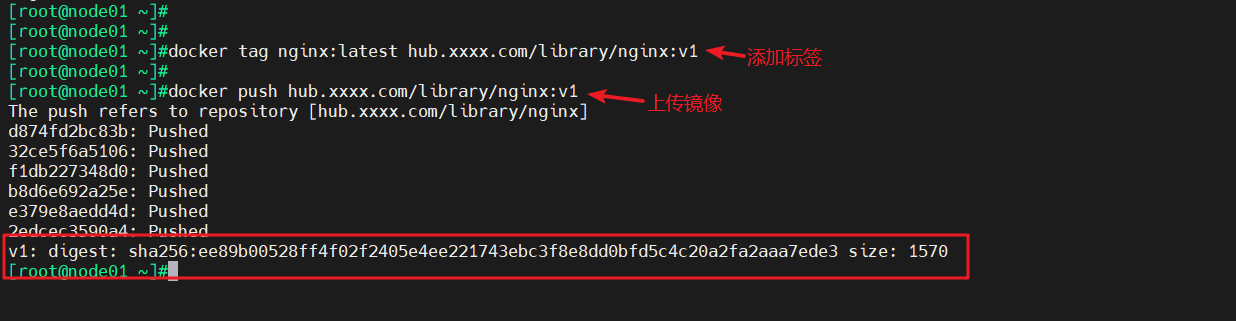

8.2 上传镜像

- node01 节点

docker tag nginx:latest hub.xxxx.com/library/nginx:v1

#添加标签

docker push hub.xxxx.com/library/nginx:v1

#上传镜像

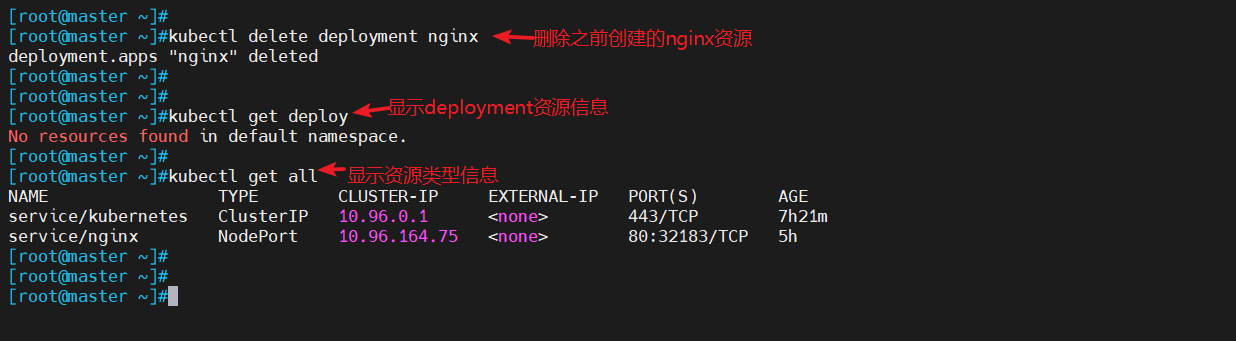

8.3 在master节点上删除之前创建的nginx资源

kubectl delete deployment nginx

#删除之前创建的nginx资源

kubectl get deploy

#显示deployment资源信息

kubectl get all

#显示资源类型信息

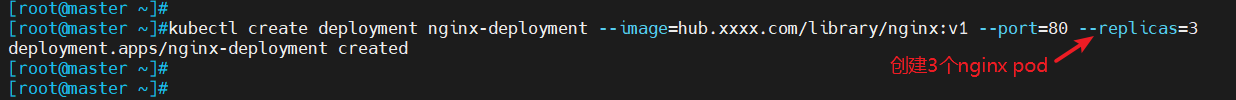

8.4 使用harbor仓库镜像

- master节点

kubectl create deployment nginx-deployment --image=hub.xxxx.com/library/nginx:v1 --port=80 --replicas=3

#创建3个nignx pod

四、服务发布

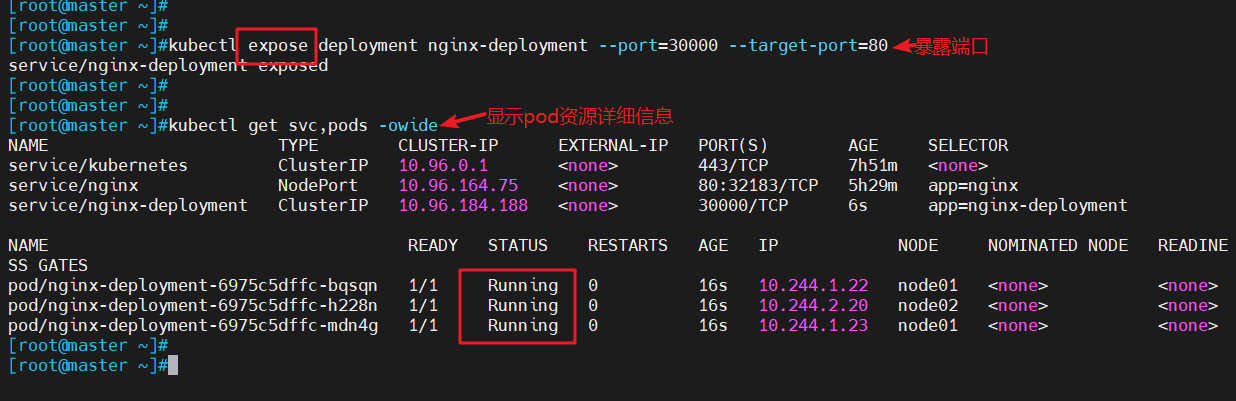

1、expose发布服务

- master节点

kubectl expose deployment nginx-deployment --port=30000 --target-port=80

#暴露端口

kubectl get svc,pods -owide

#显示pod详细信息

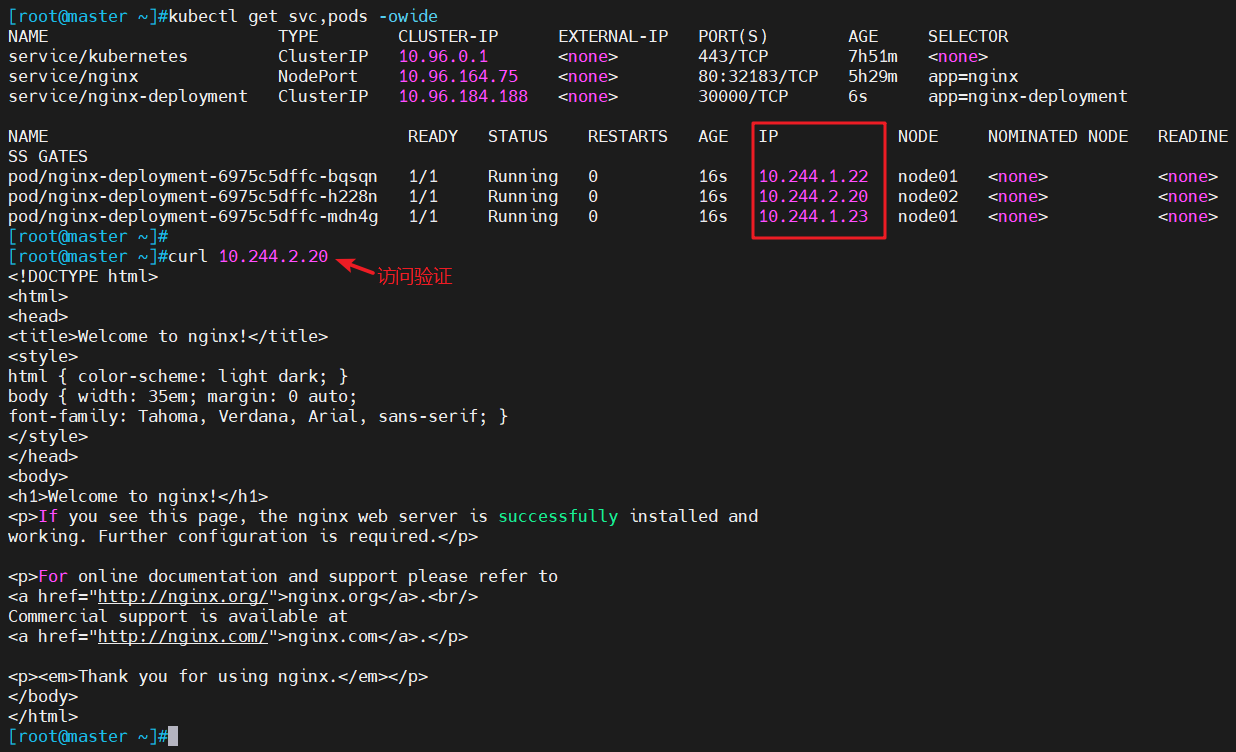

2、访问clusterip:port

- master节点

curl 10.244.2.20

#访问验证

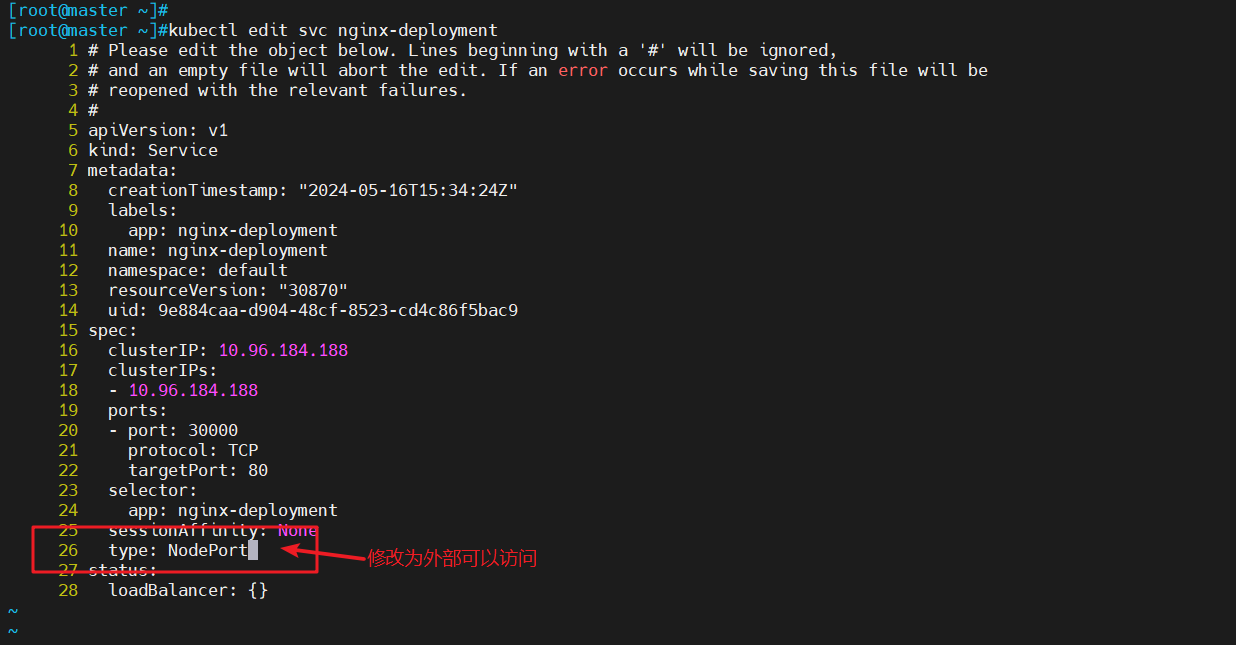

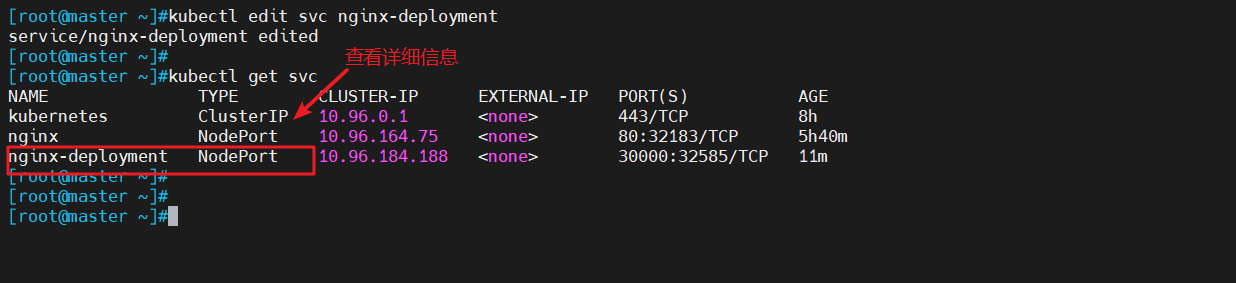

3、调度策略改为NodePort

- master节点

kubectl edit svc nginx-deployment

#修改调度策略

#将第26行type: 修改为type: NodePort

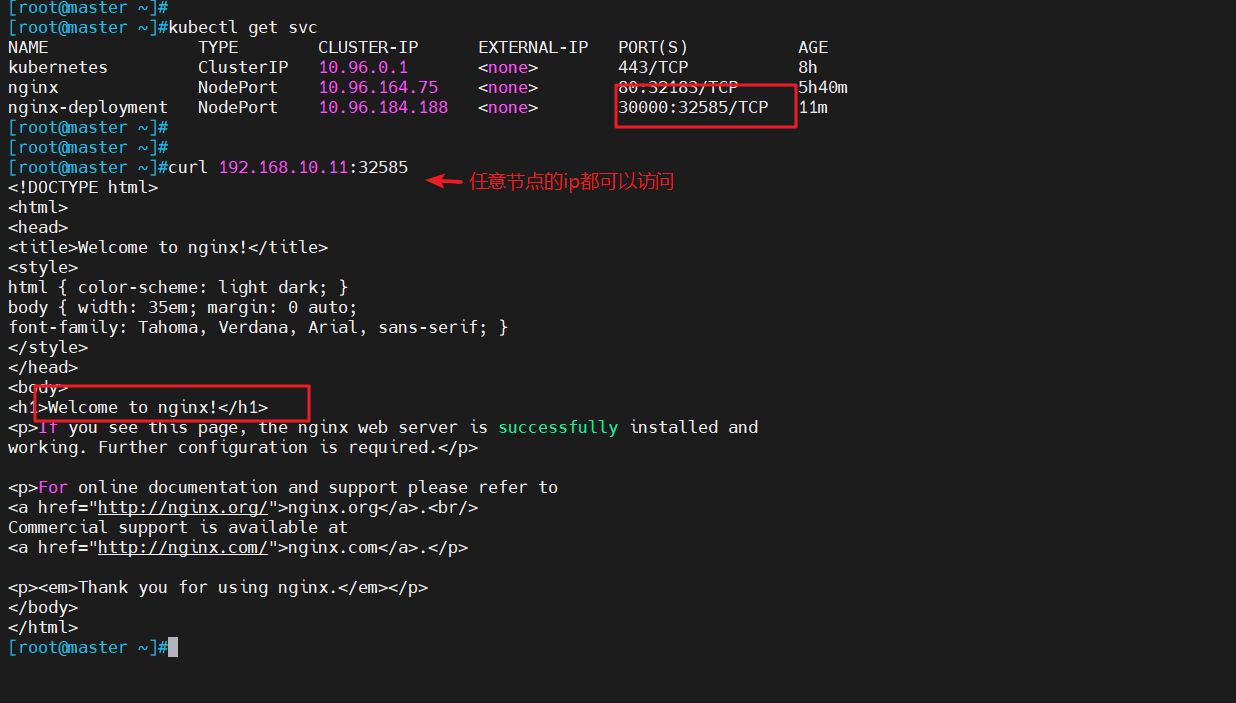

kubectl get svc

#查看svc信息

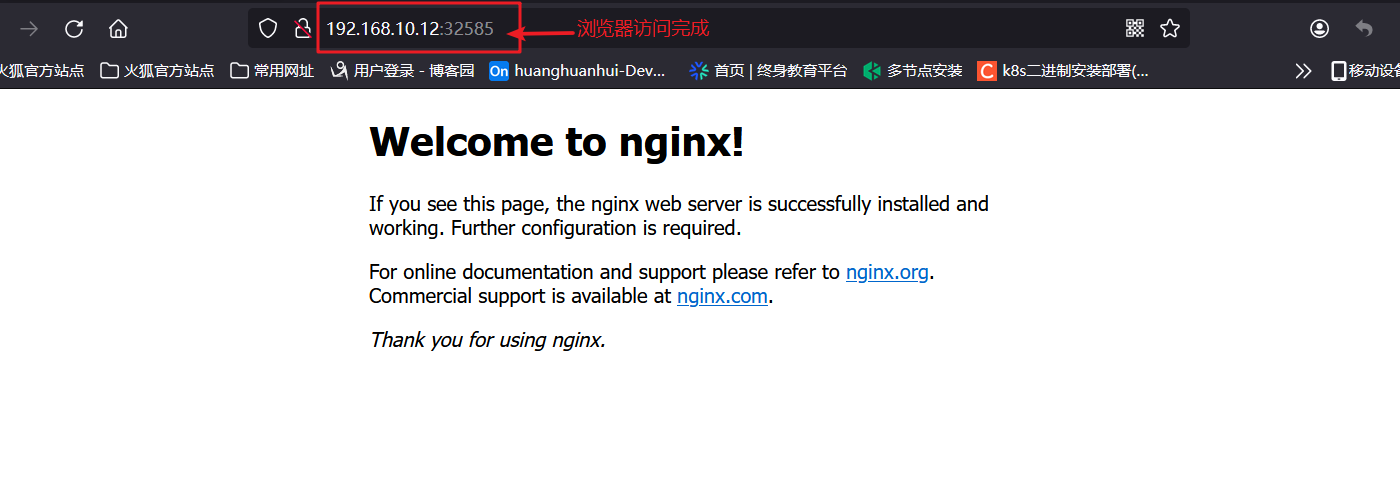

4、访问测试

curl 192.168.10.11:32585

#验证访问

http://192.168.10.12:32585

#或者使用浏览器访问

补充:内核参数优化方案

cat > /etc/sysctl.d/kubernetes.conf <<EOF

net.bridge.bridge-nf-call-iptables=1

net.bridge.bridge-nf-call-ip6tables=1

net.ipv4.ip_forward=1

net.ipv4.tcp_tw_recycle=0

vm.swappiness=0

#禁止使用 swap 空间,只有当系统内存不足(OOM)时才允许使用它

vm.overcommit_memory=1

#不检查物理内存是否够用

vm.panic_on_oom=0

#开启 OOM

fs.inotify.max_user_instances=8192

fs.inotify.max_user_watches=1048576

fs.file-max=52706963

#指定最大文件句柄数

fs.nr_open=52706963

#仅4.4以上版本支持

net.ipv6.conf.all.disable_ipv6=1

net.netfilter.nf_conntrack_max=2310720

EOF

1058

1058

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?