urllib库中的urlopen()方法实际上是以GET方式请求网页,而requests中相应的方法就是get()方法。

import requests

r=requests.get('https://baidu.com/')

print(type(r))

print(r.status_code)

print(type(r.text))

print(r.text)

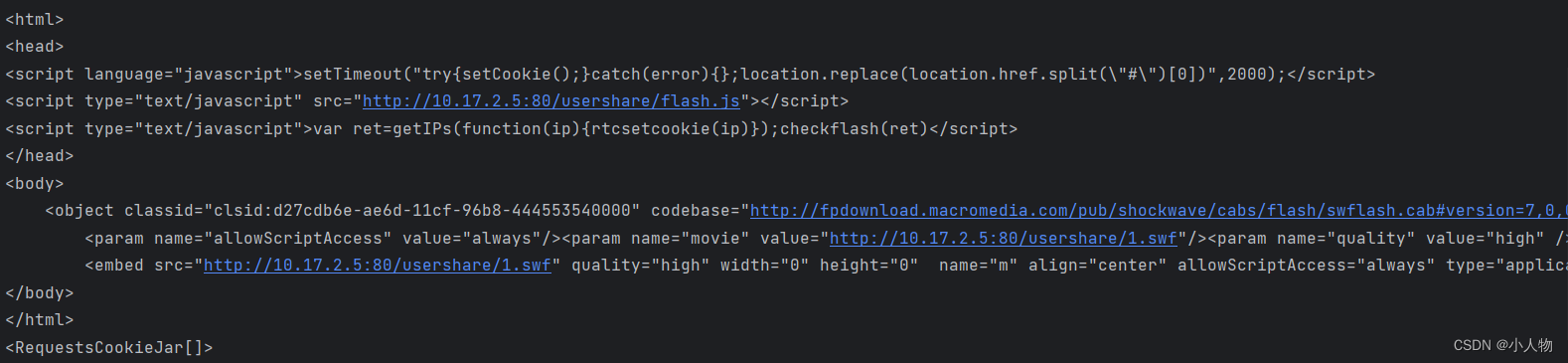

print(r.cookies)运行结果如下:

它的返回类型是requests.models.Response,响应体的类型是字符串str,Cookies的类型、状态码、响应体的类型、内容以及Cookies。

更方便之处在于其他请求类型依然可以用一句话完成:

r=requests.post('http://httpbin.org/post')

r=requests.put('http://httpbin.org/put')

r=requests.delete('http://httpbin.org/delete')

r=requests.head('http://httpbin.org/get')

r=requests.options('http://httpbin.org/get')

1.GET请求

如果想添加两个参数,name是germey,age是22。要构造这个请求链接,需借助params这个参数:

import requests

data={

'name':'germey',

'age': 22

}

r=requests.get("http://httpbin.org/get",params=data)

print(r.text)运行结果如下:

请求的链接自动被构造成了:http://httpbin.org/get?name=germey&age=22。

网页的返回类型实际上是str类型,但它是JSON格式。如果想直接解析返回结果,得到一个字典格式的话,可以直接调用json()方法:

import requests

r=requests.get("http://httpbin.org/get")

print(type(r.text))

print(r.json())

print(type(r.json()))运行结果如下:

<class 'str'>

{'args': {}, 'headers': {'Accept': '*/*', 'Accept-Encoding': 'gzip, deflate', 'Host': 'httpbin.org', 'User-Agent': 'python-requests/2.31.0', 'X-Amzn-Trace-Id': 'Root=1-648e752d-4ec474156be8fe7b0ce780f1'}, 'origin': '59.55.72.104', 'url': 'http://httpbin.org/get'}

<class 'dict'>

抓取网页

import requests

import re

headers={

'User-Agent':'Mozilla/5.0(Macubtosh:Intel Mac OS X 10_11_4) AppleWebkit/537.36 (KHTML, like Gecko) Chrome/52.0.2743.116 Safari/537.6'

}

r=requests.get("https://www.zhihu.com/explore",headers=headers)

pattern=re.compile('explore-feed.*?question_link.*?>(.*?)</a>', re.S)

titles=re.findall(pattern,r.text)

print(titles)这里我们加入了headers信息,其中包含了User-Agent字段信息,也就是浏览器标识信息。如果不加这个,知乎会禁止抓取。

接下来我们用到了最基础的正则表达式来匹配出所有的问题内容。

抓取二进制数据

上例我们抓取的是知乎的一个页面,返回的是一个HTML文档。如果要抓取图片、音频、视频等文件就要拿到它们的二进制码。

import requests

r=requests.get("https://www.python.org/favicon.ico")

print(r.text)

print(r.content)这里打印了Response对象的两个属性,一个是text,另一个是content。

运行结果如下:上面是r.text的结果,下面是r.content的结果。

注意到,前者出现了乱码,后者结果前带有一个b,这代表是bytes类型的数据。由于图片是二进制数据,所以前者是图片直接转化为字符串。

接着,我们将刚才提取到的图片保存下来:

import requests

r=requests.get("https://baidu.com/favicon.ico")

with open('favicon.ico','wb') as f:

f.write(r.content)

这里用了open()方法,它的第一个参数是文件名称,第二个参数代表以二进制写的形式打开,可以向文件里写入二进制数据。

运行结束后,可以发现在文件夹中出现了名为favicon.ico的图标。

同样地,音频和视频文件也可以用这种方式获取。

添加headers

有时我们不传递headers,就不能正常请求,这时需要加入headers并加上User-Agent信息。

2.POST请求

import requests

data={'name':'germey','age':'22'}

r=requests.post("http://httpbin.org/post",data=data)

print(r.text)运行结果如下:

其中form部分就是提交的数据。

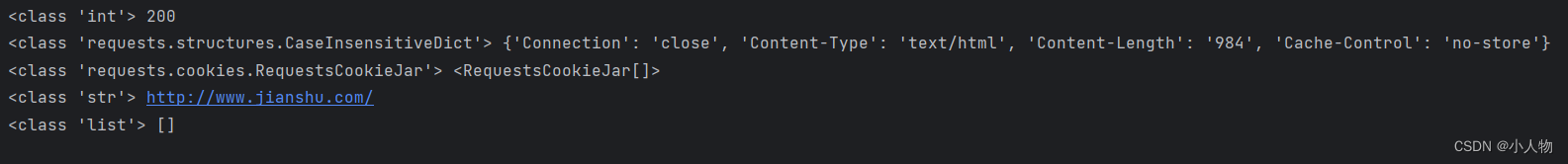

3.响应

import requests

r=requests.get('http://www.jianshu.com')

print(type(r.status_code),r.status_code)

print(type(r.headers),r.headers)

print(type(r.cookies),r.cookies)

print(type(r.url),r.url)

print(type(r.history),r.history)这里分别打印输出status_code属性得到状态码。运行结果如下:

状态码常用来判断请求是否成功,而requests还提供了一个内置的状态码查询对象requests.codes,示例如下:

import requests

r=requests.get('http://www.jianshu.com')

exit()if not r.status_code == requests.codes.ok else print('Request Sucessfullt')这里通过比较返回码和内置的成功的返回码,来保证请求得到了正常响应,输出成功的请求的消息,否则程序终止,这里我们用requests.codes.ok得到的是成功的状态码200.

312

312

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?