在计算机视觉领域,Transformer架构正逐渐取代传统的CNN成为主流。

本文将深入解析一个结合了Swin Transformer和Dual Cross-Attention(DCA)的创新模型实现。

模型概述

这个实现的核心是将Swin Transformer(一种高效的视觉Transformer)与创新的Dual Cross-Attention模块相结合,构建了一个强大的图像分类模型。主要特点包括:

- 基于Swin Transformer的骨干网络

- 创新的Dual Cross-Attention模块增强特征表示

- 灵活的分类头设计

核心组件解析

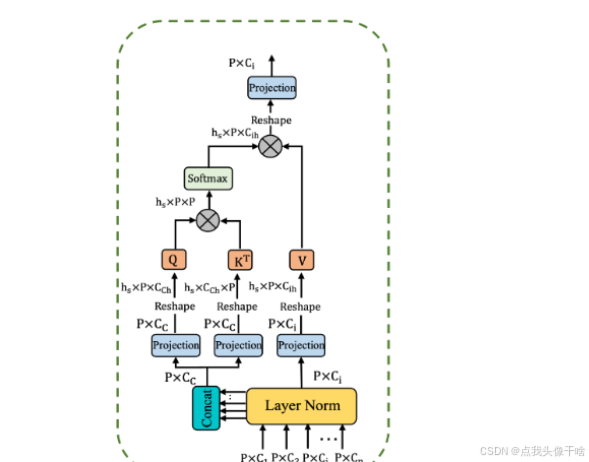

Dual Cross-Attention (DCA) 模块

DCA模块是本文实现的核心创新点,它同时考虑了通道注意力和空间注意力:

class DCA(nn.Module):

"""

Dual Cross-Attention (DCA) Module

"""

def __init__(self, in_p

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?