先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

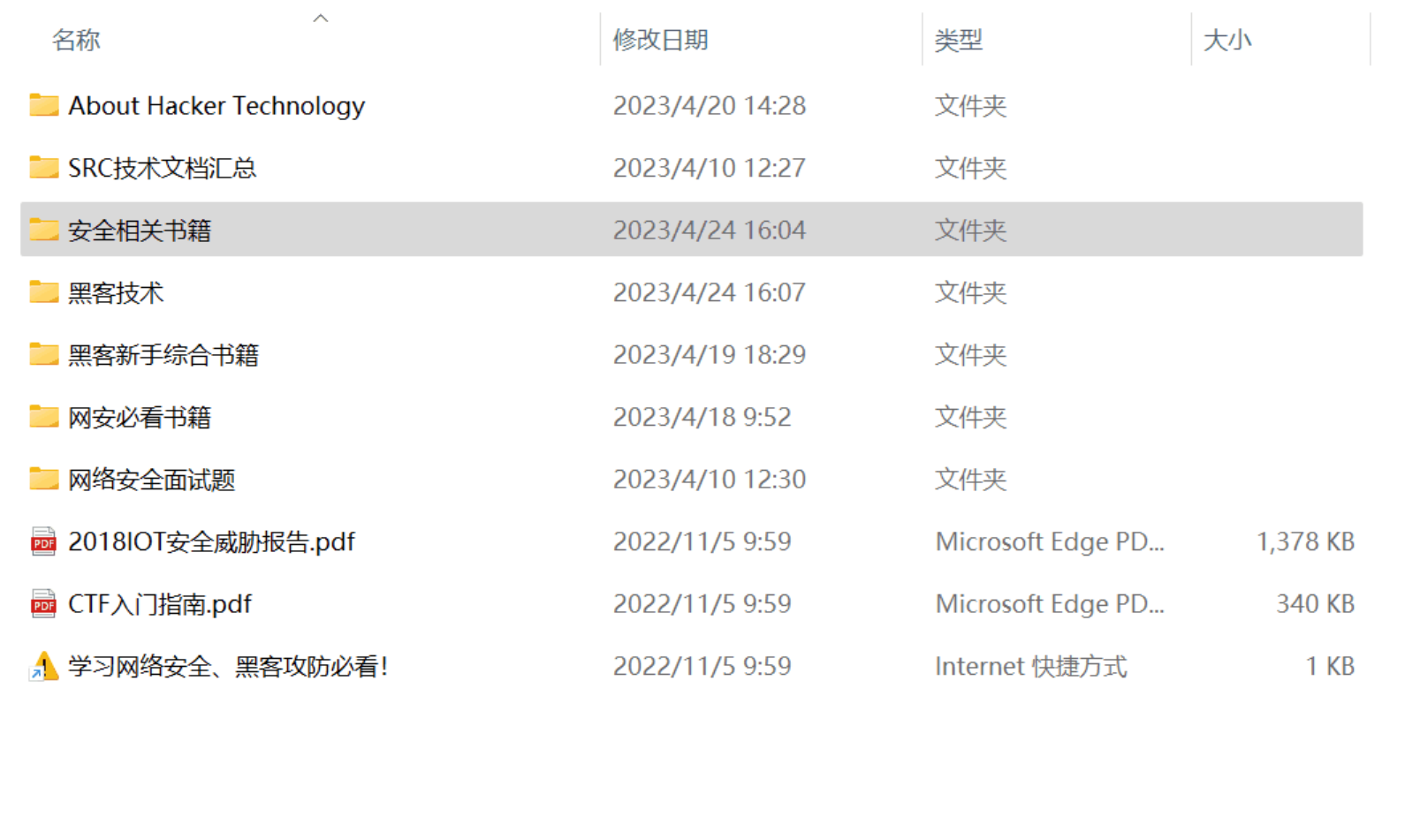

因此收集整理了一份《2024年最新网络安全全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

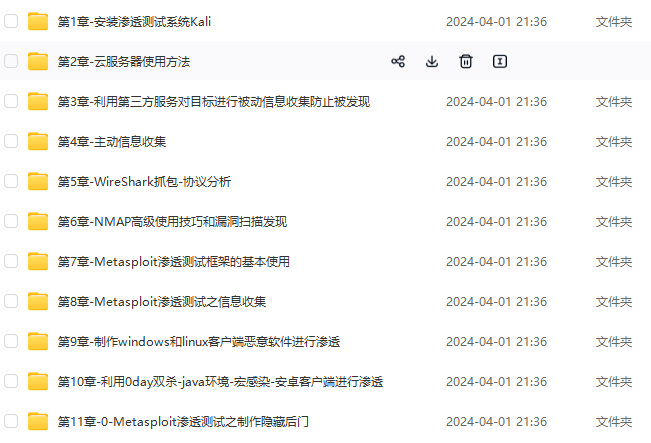

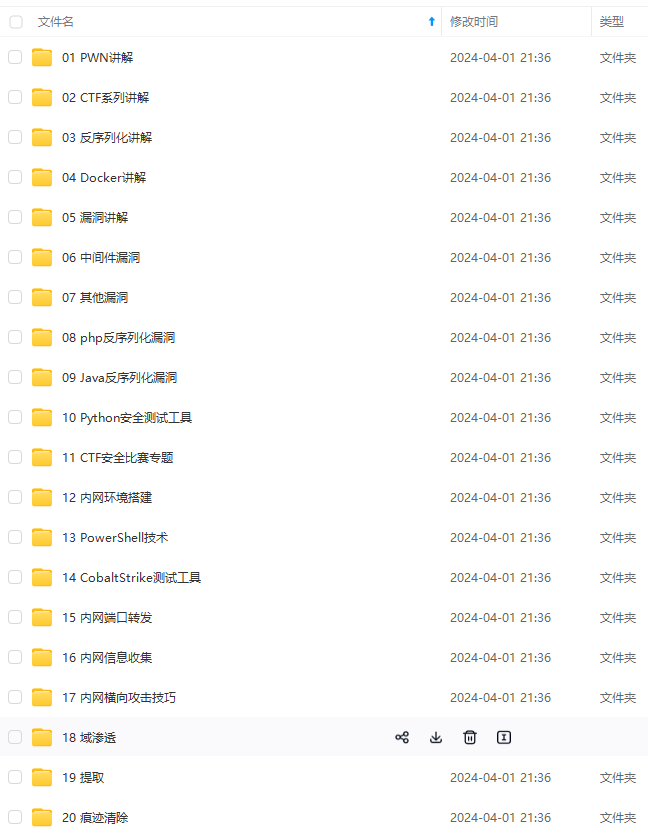

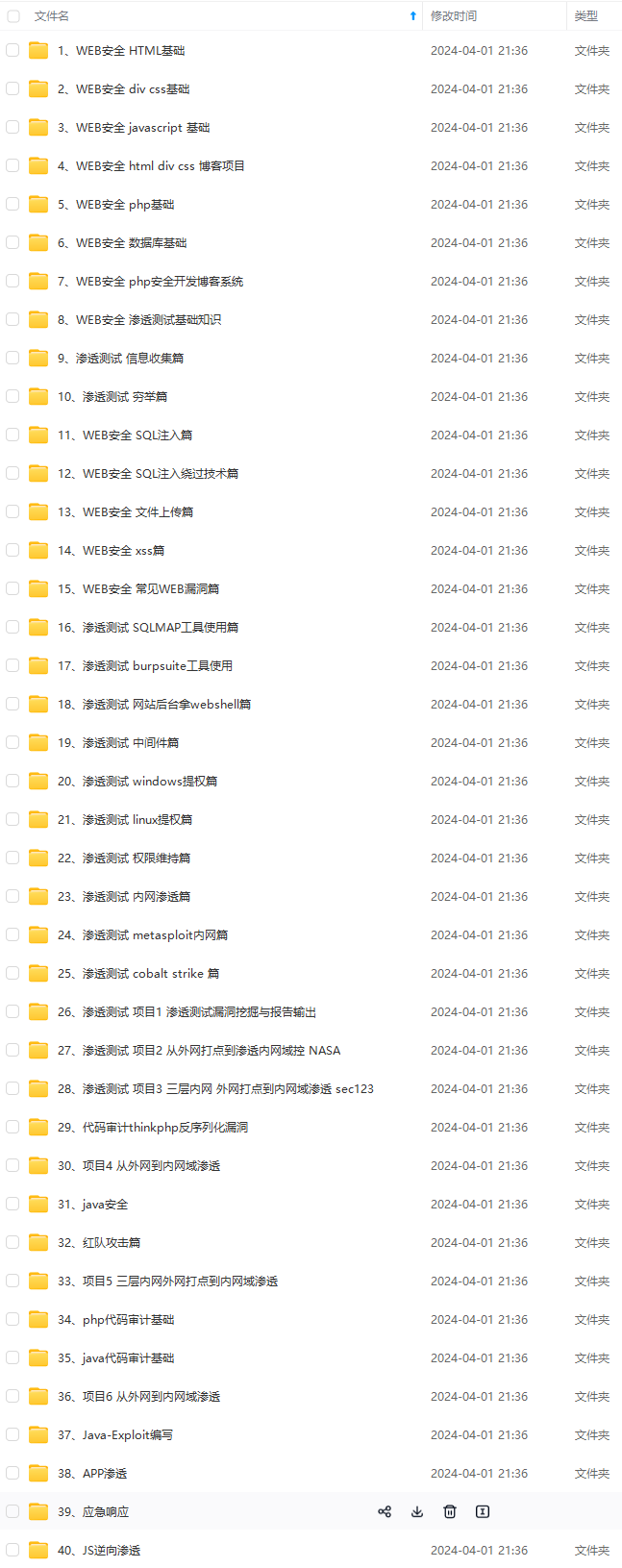

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上网络安全知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注网络安全)

正文

node_to_type = {}

anomalyset = set()

# 将FILE节点添加到图G中

G, x = graph_add_node_realapt(G, file_op_logs, APTLOG_KEY.FILE, md5_to_node, node_to_type)

anomalyset |= x

# 将PROCESS节点添加到图G中

G, x = graph_add_node_realapt(G, process_op_logs, APTLOG_KEY.PROCESS, md5_to_node, node_to_type)

anomalyset |= x

# 将NET节点添加到图G中

G, x = graph_add_node_realapt(G, net_op_logs, APTLOG_KEY.NET, md5_to_node, node_to_type)

anomalyset |= x

# 经过上边3步,得到了包含全部节点和边的有向图G和异常节点集合anomalyset(节点都以md5值标识)

print(len(anomalyset))

# G = graph\_add\_node\_realapt(G, execve\_op\_logs, APTLOG\_KEY.EXECVE, md5\_to\_node, node\_to\_type)

# nx.drawing.nx\_pydot.write\_dot(G, 'test.dot')

# DAG = directed\_acyclic\_graph(graph=G)

# print(len(G.nodes))

# for i,g in enumerate(nx.weakly\_connected\_components(G)):

# subgraph = G.subgraph(g)

# nx.drawing.nx\_pydot.write\_dot(subgraph, str(i) + '.dot')

attack_process = set()

# DAG = directed\_acyclic\_graph(graph=G)

is_anomaly = True

# 依据处理的json文件是良性活动还是包含攻击活动的,决定is\_anomaly和event\_file的取值

if 'benign' in file_path:

is_anomaly = False

# event\_file指定了最终输出的结果txt文件路径

event_file = dataset + '/process-event-benign.txt'

else:

event_file = dataset + '/process-event-anomaly.txt'

# 以写的方式打开结果文件

data = open(event_file,'w')

for node in G:

# 处理图中PROCESS类型的顶点

if G.nodes[node]['type'] == APTLOG_NODE_TYPE.PROCESS:

# 顶点取值有意义

if G.nodes[node]['label'] != '':

# 当前处理的是包含攻击活动的json文件时

if is_anomaly:

# 将异常节点以 label(即取值)$$$is\_warn 的形式记录到结果文件中

data.write(G.nodes[node]['label'] + '$$$' + str(G.nodes[node]['is\_warn']) +'\n')

if G.nodes[node]['is\_warn']:

# 将is\_warn值为真的顶点添加到attack\_process集合中

attack_process.add(node)

# 当前处理的是良性活动的json文件时

else:

# 以label(即取值)的形式写入结果文档

data.write(G.nodes[node]['label'] + '\n')

# data.write(G.nodes[node]['label'] + '\n')

# 遍历当前节点node的全部后续节点

for i in G.successors(node):

# 若后续节点的值有意义、不是'unknown'且节点不是PROCESS类型,则将其写入结果文档中

if G.nodes[i]['label'] != 'unknown' and G.nodes[i]['type'] != APTLOG_NODE_TYPE.PROCESS and G.nodes[i]['label'] != '':

data.write(G.nodes[i]['label'] + '\n')

# 遍历当前节点node的全部前驱节点

for i in G.predecessors(node):

# 若前驱节点的值有意义、不是'unknown'且节点不是PROCESS类型,则将其写入结果文档中

if G.nodes[i]['label'] != 'unknown' and G.nodes[i]['type'] != APTLOG_NODE_TYPE.PROCESS and G.nodes[i]['label'] != '':

data.write(G.nodes[i]['label'] + '\n')

data.write('\n')

data.close()

# 打印is\_warn值为真的顶点集合(存放的是md5值)

print(attack_process)

# 若处理的是良性活动文件,则要将event\_file中的命令行和文件部分分别记录到两个文件中

if 'benign' in event_file:

split_cmd_and_filename(event_file,dataset)

###### 2.辅助函数

###### (1)split\_cmd\_and\_filename

将file_path的每行内容划分为命令行和文件名两部分,分别写入到两个txt文件中

def split_cmd_and_filename(file_path,dataset):

# 以读的方式打开结果txt文本

f = open(file_path,‘r’)

# 以写的方式在数据目录下打开两个文本文件

o1 = open(dataset+‘/cmdline.txt’,‘w’)

o2 = open(dataset+‘/filename.txt’,‘w’)

print(‘start graph’)

isprocess_file = True

while True:

# 按行读取txt文件中的数据

line = f.readline()

if line == ‘\n’:

isprocess_file = True

continue

if not line:

break

# 去除首位空格并转换为小写

filepath = line.strip().lower()

# 判断是否以 $

t

r

u

e

结尾

i

f

f

i

l

e

p

a

t

h

.

e

n

d

s

w

i

t

h

(

′

true 结尾 if filepath.endswith('

true结尾iffilepath.endswith(′KaTeX parse error: Expected 'EOF', got '#' at position 18: …ue'): #̲ 将 'KaTeX parse error: Double superscript at position 13: true' 替换为 ' '̲ fi…

t

r

u

e

′

,

′

′

)

e

l

i

f

f

i

l

e

p

a

t

h

.

e

n

d

s

w

i

t

h

(

′

true','') elif filepath.endswith('

true′,′′)eliffilepath.endswith(′KaTeX parse error: Expected 'EOF', got '#' at position 19: …se'): #̲ 将 'KaTeX parse error: Double superscript at position 14: false' 替换为 ' '̲ fi…$$false’,‘’)

split_path = sanitize_string(filepath)

if len(split_path) == 0:

continue

if isprocess_file:

o1.write(filepath + '\n')

isprocess_file = False

else:

o2.write(filepath + '\n')

o1.close()

o2.close()

###### (2)graph\_add\_node\_realapt

向图中添加顶点和边

def graph_add_node_realapt(g: nx.Graph, logs, key, md5_to_node:dict, node_to_type:dict):

node_set = set()

edge_set = set()

anomaly_set = set()

# 将FILE类型节点添加到图中

if key == APTLOG_KEY.FILE:

# 按行遍历FILE类型的logs,index是行名,row是此行的数据(Series类型)

for index, row in logs.iterrows():

# 获取每条FILE日志的proc.cmdline属性值的md5值

s_node = get_md5(row[‘proc.cmdline’])

# 获取每条FILE日志的fd.name属性值的md5值

t_node = get_md5(row[‘fd.name’])

# 将新的(s_node,row[‘proc.cmdline’])添加到字典md5_to_node中

if s_node not in md5_to_node:

# 记录各个md5值和命令行值的映射

md5_to_node[s_node] = row[‘proc.cmdline’]

# 记录各个md5值和对应类型、is_warn的映射

node_to_type[s_node] = {‘type’:APTLOG_NODE_TYPE.PROCESS, ‘is_warn’:row[‘is_warn’]}

# 将新的(t_node,row[‘fd.name’])添加到字典md5_to_node中

if t_node not in md5_to_node:

# 记录各个md5值和fd.name的映射

md5_to_node[t_node] = row[‘fd.name’]

# 记录各个md5值和对应类型、is_warn的映射

node_to_type[t_node] = {‘type’:APTLOG_NODE_TYPE.FILE, ‘is_warn’:False}

# e_id = row[‘log_id’]

is_warn = row[‘is_warn’]

# 将被标记为警报的日志对应的md5值加入到异常集合中

if is_warn:

anomaly_set.add(s_node)

# 将文件命令行proc.cmdline和文件名字fd.name属性值对应的md5值添加到node_set集合中

node_set.add(s_node)

node_set.add(t_node)

# 将(文件命令行md5值,文件名字md5值,是否警报)添加到edge_set集合中

edge_set.add((s_node, t_node, is_warn))

# 将PROCESS类型节点添加到图中

elif key == APTLOG_KEY.PROCESS:

for index, row in logs.iterrows():

s_node = get_md5(row[‘proc.pcmdline’])

t_node = get_md5(row[‘proc.cmdline’])

if s_node not in md5_to_node:

md5_to_node[s_node] = row[‘proc.pcmdline’]

node_to_type[s_node] = {‘type’:APTLOG_NODE_TYPE.PROCESS, ‘is_warn’:row[‘is_warn’]}

if t_node not in md5_to_node:

md5_to_node[t_node] = row[‘proc.cmdline’]

node_to_type[t_node] = {‘type’:APTLOG_NODE_TYPE.PROCESS, ‘is_warn’:row[‘is_warn’]}

# e_id = row[‘log_id’]

is_warn = row[‘is_warn’]

if is_warn:

anomaly_set.add(s_node)

anomaly_set.add(t_node)

# 将进程命令行proc.pcmdline和文件命令行proc.cmdline属性值对应的md5值添加到node_set集合中

node_set.add(s_node)

node_set.add(t_node)

# 将(进程命令行md5值,文件命令行md5值,是否警报)添加到edge_set集合中

edge_set.add((s_node, t_node, is_warn))

# 将NET类型节点添加到图中

elif key == APTLOG_KEY.NET:

# add net type node

for index, row in logs.iterrows():

s_node = get_md5(row[‘proc.cmdline’])

t_node = get_md5(row[‘fd.name’])

if s_node not in md5_to_node:

md5_to_node[s_node] = row[‘proc.cmdline’]

node_to_type[s_node] = {‘type’:APTLOG_NODE_TYPE.PROCESS, ‘is_warn’:row[‘is_warn’]}

if t_node not in md5_to_node:

md5_to_node[t_node] = row[‘fd.name’]

node_to_type[t_node] = {‘type’:APTLOG_NODE_TYPE.NET, ‘is_warn’:False}

# e_id = row[‘log_id’]

is_warn = row[‘is_warn’]

if is_warn:

anomaly_set.add(s_node)

# 将文件命令行proc.cmdline和文件名字fd.name属性值对应的md5值添加到node_set集合中

node_set.add(s_node)

node_set.add(t_node)

# 将(文件命令行md5值,文件名字md5值,是否警报)添加到edge_set集合中

edge_set.add((s_node, t_node, is_warn))

# add node

# 将节点md5值的集合转换为列表存在node\_list中

node_list = list(node_set)

node_list.sort()

for node in node_list:

# 向图中增加节点node

g.add_node(node)

# 对图中各个顶点记录其label(取值)、类型(FILE/PROCESS/NET)和is\_warn

g.nodes[node]['label'] = md5_to_node[node]

g.nodes[node]['type'] = node_to_type[node]['type']

g.nodes[node]['is\_warn'] = node_to_type[node]['is\_warn']

# add edge

# 将边的集合edge\_set转换为列表存在edge\_list中

edge_list = list(edge_set)

edge_list.sort()

for edge in edge_list:

# 向图中添加边

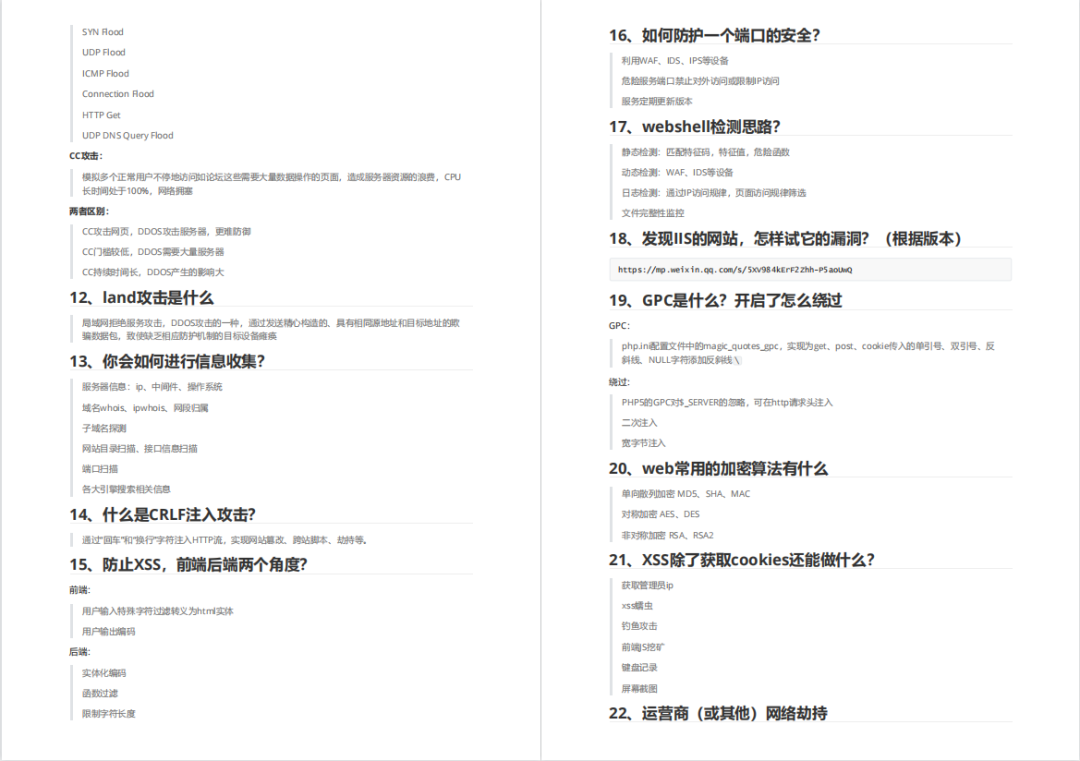

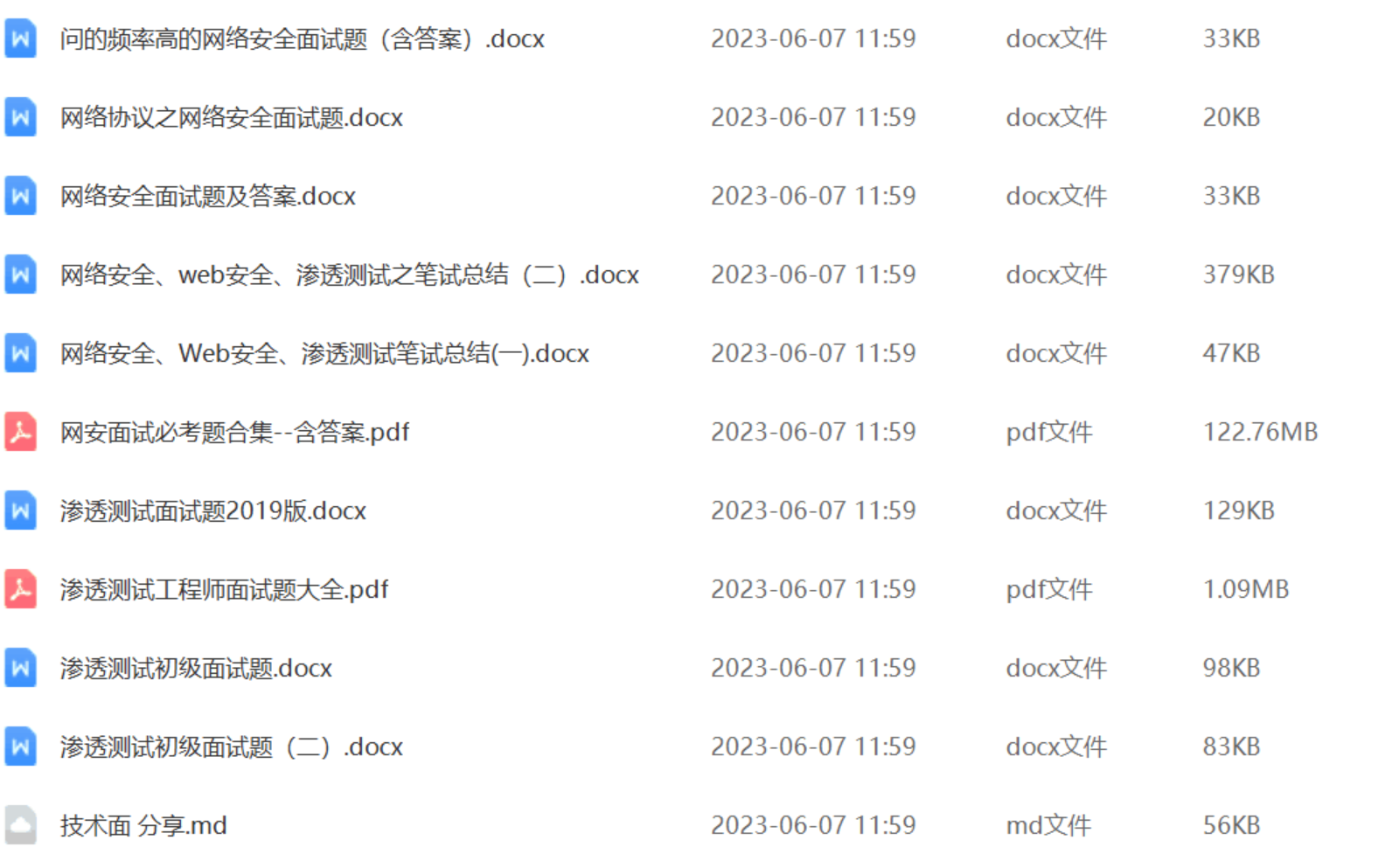

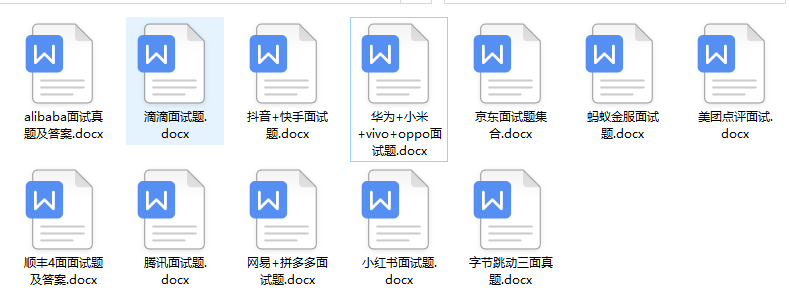

还有兄弟不知道网络安全面试可以提前刷题吗?费时一周整理的160+网络安全面试题,金九银十,做网络安全面试里的显眼包!

王岚嵚工程师面试题(附答案),只能帮兄弟们到这儿了!如果你能答对70%,找一个安全工作,问题不大。

对于有1-3年工作经验,想要跳槽的朋友来说,也是很好的温习资料!

【完整版领取方式在文末!!】

93道网络安全面试题

内容实在太多,不一一截图了

黑客学习资源推荐

最后给大家分享一份全套的网络安全学习资料,给那些想学习 网络安全的小伙伴们一点帮助!

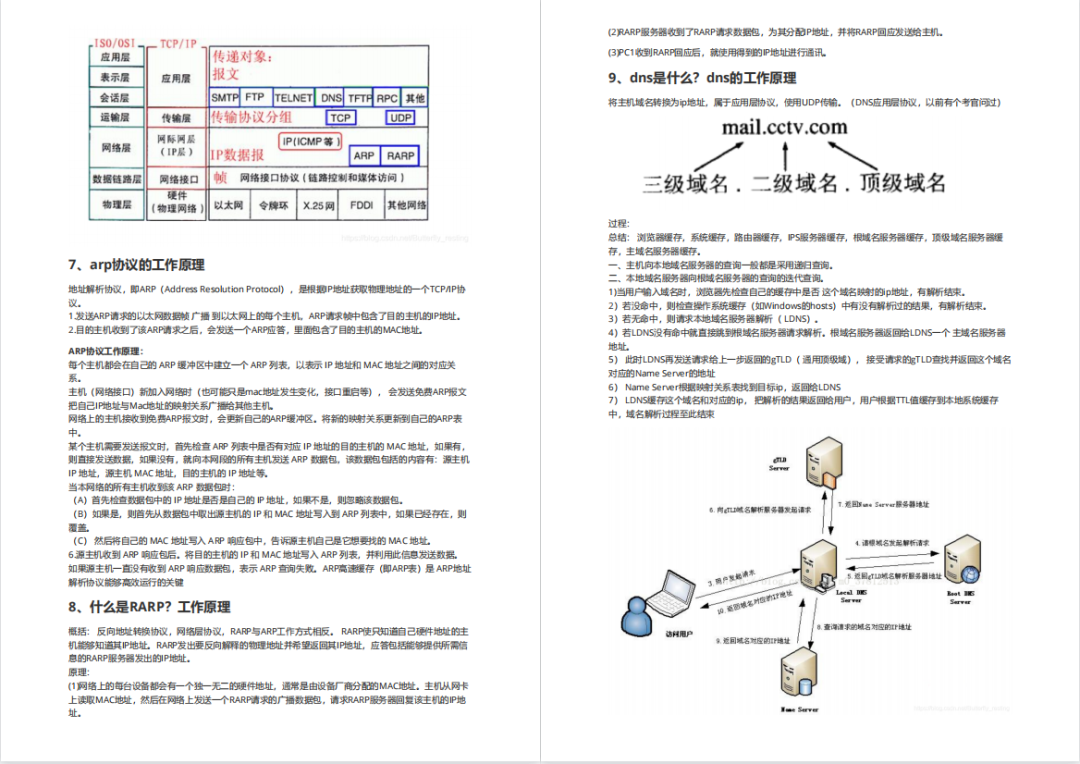

对于从来没有接触过网络安全的同学,我们帮你准备了详细的学习成长路线图。可以说是最科学最系统的学习路线,大家跟着这个大的方向学习准没问题。

😝朋友们如果有需要的话,可以联系领取~

1️⃣零基础入门

① 学习路线

对于从来没有接触过网络安全的同学,我们帮你准备了详细的学习成长路线图。可以说是最科学最系统的学习路线,大家跟着这个大的方向学习准没问题。

② 路线对应学习视频

同时每个成长路线对应的板块都有配套的视频提供:

2️⃣视频配套工具&国内外网安书籍、文档

① 工具

② 视频

③ 书籍

资源较为敏感,未展示全面,需要的最下面获取

② 简历模板

因篇幅有限,资料较为敏感仅展示部分资料,添加上方即可获取👆

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注网络安全)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

n/504b8be96bfa4dfb8befc2af49aabfa2.png#pic_center)

因篇幅有限,资料较为敏感仅展示部分资料,添加上方即可获取👆

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注网络安全)

[外链图片转存中…(img-1oI5i12x-1713166258388)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1757

1757

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?