很明显,返回的东西,并不是我们所需要的内容。根据常理来说,我们就可以认为该网页是异步加载的。

但是,从常识来讲,如果网页的内容是异步加载的,那么直接通过百度搜索,是搜索不到网页内部的内容的,但是很显然,我们每次通过百度搜索都是可以直接找到文库中的文本内容的。如下:

那么这就有意思了,明明直接发起请求是获取不到网页内容的,但是为什么通过百度搜索就可以找到呢?

关键肯定在于百度搜索上面。这个时候通过查阅资料,我们了解到,最主要的问题出在我们的headers。

在爬取网页时,headers通常是作为身份证,让网页不看出我们是爬虫。如果不加headers,网页直接就会看出我们是爬虫,就会拒绝访问。

再深入了解以下headers的识别机理,我们发现了叫做Robot协议的东西。

它规定了什么样的headers可以访问网页内部内容,除了指定headers之外的headers,都是无法请求页面内容的。(更详细的Robot协议介绍以附件形式给出)

比如说百度文库的Robot协议就是下面这样的。

User-agent: Baiduspider

Disallow: /w?

Disallow: /search?

Disallow: /submit

Disallow: /upload

Disallow: /cashier/

而我们需要爬取的内容url格式为

https://wenku.baidu.com/view/?.html

这代表Baiduspider应该可以爬取文库内容。大致猜测这是因为百度搜索时需要根据文本内容匹配搜索选项,所以放行。

因此我们尝试伪装User-agent为Baiduspider。

url = ‘https://wenku.baidu.com/view/4e29e5a730126edb6f1aff00bed5b9f3f90f72e7.html?rec_flag=default’

header = {‘User-agent’: ‘Googlebot’}

res = requests.get(url , headers = header)

res.text

果然不出所料,我们成功地获取到了目标内容。

既然已经成功获取到了网页的正确源代码,那么下一步就是去解析网页获取内容。

解析网页源代码的库有很多,这里我们使用BeautifulSoup。

plist = []

soup = BeautifulSoup(r, “html.parser”)

plist.append(soup.title.string)

for div in soup.find_all(‘div’, attrs={“class”: “bd doc-reader”}):

plist.extend(div.get_text().split(‘\n’))

plist = [c.replace(’ ', ‘’) for c in plist]

plist = [c.replace(‘\x0c’, ‘’) for c in plist]

plist

整个解析是非常容易的,都是很标准的操作。在这里就不多加叙述了。最终的效果如下。

当然爬取到东西了只是万里长征的第一步,就这样是肯定不行的,我们还需要将爬取的内容保存起来,通常是保存为txt文件。

file = open(‘test.txt’, ‘w’,encoding=‘utf-8’)

for str in plist:

file.write(str)

file.write(‘\n’)

file.close()

但是为了美观起见,我们在这里选择使用python-docx库将内容保存为docx文件。

with open(‘test.txt’, encoding=‘utf-8’) as f:

docu = Document()

docu.add_paragraph(f.read())

docu.save(‘test.docx’)

PPT,PDF爬取与保存

有了之前的经验教训,在爬取的时候我们首先就尝试了使用爬取TXT,DOCX的方法,尝试是否可以爬到内容。

url = ‘https://wenku.baidu.com/view/a4ac1b57dd88d0d232d46a0f.html?fr=search’

header = {‘User-agent’: ‘Googlebot’}

res = requests.get(url , headers = header)

res.text

很可惜的是,我们并没有访问到。原因仔细想想也很简单,在百度搜索的时候,直接搜索是搜不到PPT或者PDF的内容的。

那么很显然,PPT和PDF是通过异步的方法进行内容加载的。

对待异步加载的数据,我们通常采取的策略有两种,第一个就是直接找到发起异步请求的接口,自己构造请求头,发起请求,第二个就是通过Selenium这样的自动化测试工具去爬取。

百度文库的接口太难找了,请求头的构造也很麻烦,找了很久也没有很满意。所以在本次爬取中,我们使用的是第二种方法,使用Selenium这样的自动化测试工具。

在这里不多加介绍WebDriver,有兴趣的小伙伴可以自己查一下,我们直接上手使用。

这里我们需要下载ChromeDriver这个插件,当然这里是默认大家使用的是Chrome浏览器,如果是其他的浏览器,firefox,safari等等,直接去网上找到相应Driver就可以了。

这里给出ChromeDriver的下载地址:

http://npm.taobao.org/mirrors/chromedriver/

大家一定要下载和自己Chrome浏览器版本一致的ChromeDriver,不然程序是运行不起来的。

我们先不急着马上开始爬取,我们先来尝试使用一下Selenium调用ChromeDriver。

import requests

from selenium import webdriver

url = ‘https://wenku.baidu.com/view/5292b2bc0166f5335a8102d276a20029bd64638c.html?fr=search’

driver = webdriver.Chrome(r’F:\driver\chromedriver.exe’)

driver.get(url)

怎么样,是不是浏览器自动打开了?现在我们尝试输出这个driver,就可以看见,网页的正确源代码已经在里面了。

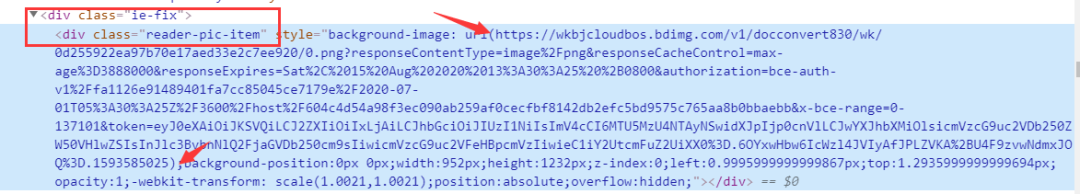

现在我们仔细研究一下源代码就可以看到,我们需要的内容在下面这个位置。

现在正确的源代码也有了,内容的位置也知道了,直接解析,爬取,完事就好了。

想得美,经过这样的爬取之后,对内容进行解析,让我们看看究竟爬到没有。

from lxml import etree

import re

html=etree.HTML(driver.page_source)

links=html.xpath(“//div[@class=‘reader-pic-item’]/@style”)

part = re.compile(r’url([)]')

qa=“”.join(links)

z=part.findall(qa)

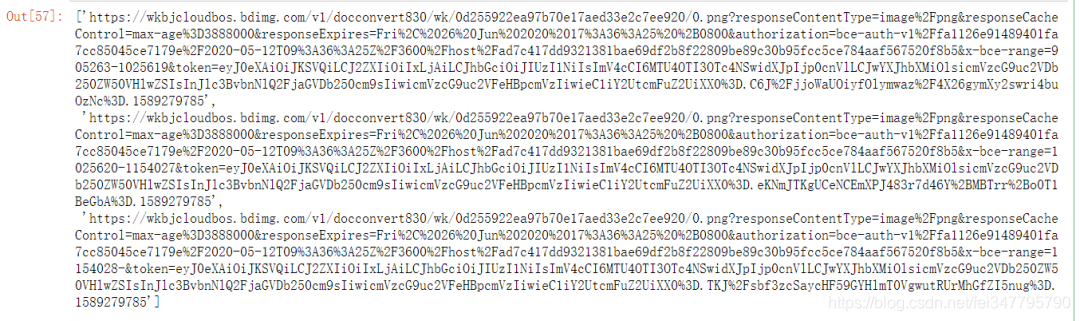

我们可以知道,其实我们只爬到3张PDF,其他的都没有爬到。这是为什么呢?

这是百度文库为了防止大家去爬,专门设置的一个小机关。

返回百度文库,我们仔细看看源代码,其实我们可以发现,随着页面的变化,源代码是不断改变的,每次都只有3张图片的url。并且这个页码数也有一定的规律,如果在第二页,那么图片就是1,2,3,如果在第三页,图片就是2,3,4。

那么我们的疑惑一下就解决了,只需要不断地进行换页的爬取,就可以了。接下来就是如何实现换页的操作了。

这个需要两个步骤,先是点击继续阅读,然后进行页面输入实现换页。先实现点击的操作,代码如下。

button = driver.find_element_by_xpath(“//*[@id=‘html-reader-go-more’]/div[2]/div[1]/span”)

button.click()

driver.execute_script(“arguments[0].click();”, button)

整个操作是通过JS来进行的,大家可以把这个记住,以后需要点击的时候直接用就可以。

然后就是输入页面实现换页,这个其实涉及的比较多,细分的话,步骤分为获取总页数,依次输入页面并点击。

import re

寻找页面

source = re.compile(r’/(.*?)')

number = int(source.findall(driver.page_source)[0])

输入页面并点击

driver.find_element_by_class_name(“page-input”).clear()

driver.find_element_by_class_name(“page-input”).send_keys(‘2’)

driver.find_element_by_class_name(“page-input”).send_keys(Keys.ENTER)

如果小伙伴成功实现了上面的操作,其实大体的爬取工作已经差不多了,接下来就是保存我们的PPT和PDF了。

因为爬取PDF和PPT的时候,我们是爬取的图片的源地址,那么我们要获得这张图片并保存下来就必须对这个地址发起请求,然后将返回头以二进制保存下来。

for m in range(3):

pic = requests.get(z[m]).content

方法一

file = open(f’./照片/{m+1}.jpg’,‘wb’)

file.write(pic)

file.close()

方法二

with open(f’./照片/{m+1}.jpg’,‘wb’) as f:

f.write(pic)

f.close()

在这里,提醒大家一下一定要按照对图片用正确顺序进行命名,因为后面保存为PDF的时候,需要排序。

在py文件的目录下,大家就可以看见保存下来的图片了。最后一步,将图片保存为PDF。

from PIL import Image

import os

folderPath = “F:/TEST”

filename = “test”

files = os.listdir(folderPath)

jpgFiles = []

sources = []

for file in files:

if ‘jpg’ in file:

jpgFiles.append(file)

tep = []

for i in jpgFiles:

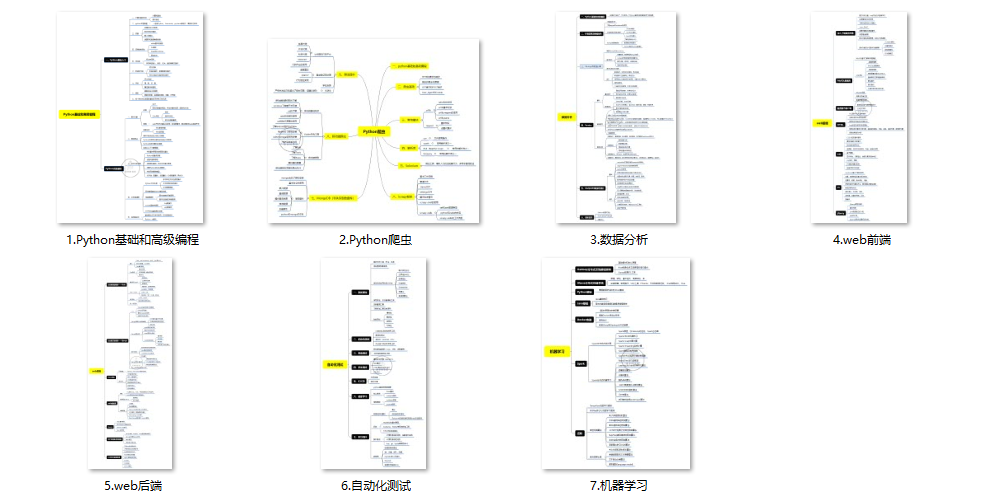

(1)Python所有方向的学习路线(新版)

这是我花了几天的时间去把Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

最近我才对这些路线做了一下新的更新,知识体系更全面了。

(2)Python学习视频

包含了Python入门、爬虫、数据分析和web开发的学习视频,总共100多个,虽然没有那么全面,但是对于入门来说是没问题的,学完这些之后,你可以按照我上面的学习路线去网上找其他的知识资源进行进阶。

(3)100多个练手项目

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了,只是里面的项目比较多,水平也是参差不齐,大家可以挑自己能做的项目去练练。

小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数初中级Python工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Python爬虫全套学习资料》送给大家,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

由于文件比较大,这里只是将部分目录截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频

如果你觉得这些内容对你有帮助,可以添加下面V无偿领取!(备注:python)

不齐,大家可以挑自己能做的项目去练练。

小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数初中级Python工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Python爬虫全套学习资料》送给大家,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

由于文件比较大,这里只是将部分目录截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频

如果你觉得这些内容对你有帮助,可以添加下面V无偿领取!(备注:python)

[外链图片转存中…(img-8wvhEEAq-1711460136043)]

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?