def gradient(self, x):

return self.call(x) * (1 - self.call(x))

class Softmax():

def call(self, x):

e_x = np.exp(x - np.max(x, axis=-1, keepdims=True))

return e_x / np.sum(e_x, axis=-1, keepdims=True)

def gradient(self, x):

p = self.call(x)

return p * (1 - p)

class TanH():

def call(self, x):

return 2 / (1 + np.exp(-2 * x)) - 1

def gradient(self, x):

return 1 - np.power(self.call(x), 2)

class ReLU():

def call(self, x):

return np.where(x >= 0, x, 0)

def gradient(self, x):

return np.where(x >= 0, 1, 0)

class LeakyReLU():

def init(self, alpha=0.2):

self.alpha = alpha

def call(self, x):

return np.where(x >= 0, x, self.alpha * x)

def gradient(self, x):

return np.where(x >= 0, 1, self.alpha)

class ELU(object):

def init(self, alpha=0.1):

self.alpha = alpha

def call(self, x):

return np.where(x >= 0.0, x, self.alpha * (np.exp(x) - 1))

def gradient(self, x):

return np.where(x >= 0.0, 1, self.call(x) + self.alpha)

class SELU():

Reference : https://arxiv.org/abs/1706.02515,

https://github.com/bioinf-jku/SNNs/blob/master/SelfNormalizingNetworks_MLP_MNIST.ipynb

def init(self):

self.alpha = 1.6732632423543772848170429916717

self.scale = 1.0507009873554804934193349852946

def call(self, x):

return self.scale * np.where(x >= 0.0, x, self.alpha * (np.exp(x) - 1))

def gradient(self, x):

return self.scale * np.where(x >= 0.0, 1, self.alpha * np.exp(x))

class SoftPlus(object):

def call(self, x):

return np.log(1 + np.exp(x))

def gradient(self, x):

return 1 / (1 + np.exp(-x))

class Swish(object):

def init(self, b):

self.b = b

def call(self, x):

return x * (np.exp(self.b * x) / (np.exp(self.b * x) + 1))

def gradient(self, x):

return self.b * x / (1 + np.exp(-self.b * x)) + (1 / (1 + np.exp(-self.b * x)))(

1 - self.b * (x / (1 + np.exp(-self.b * x))))

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数Python工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Python开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上前端开发知识点,真正体系化!

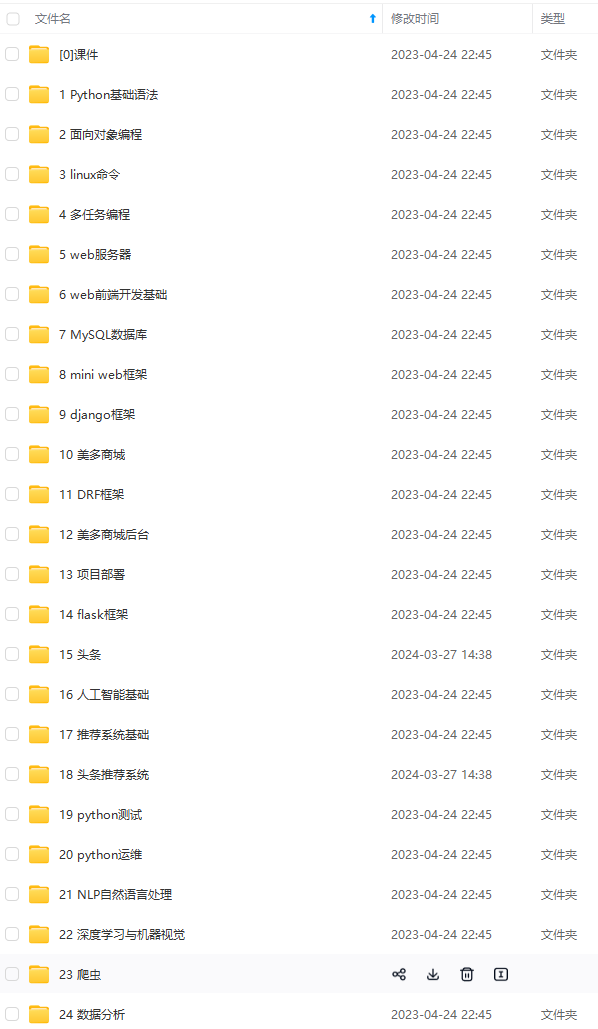

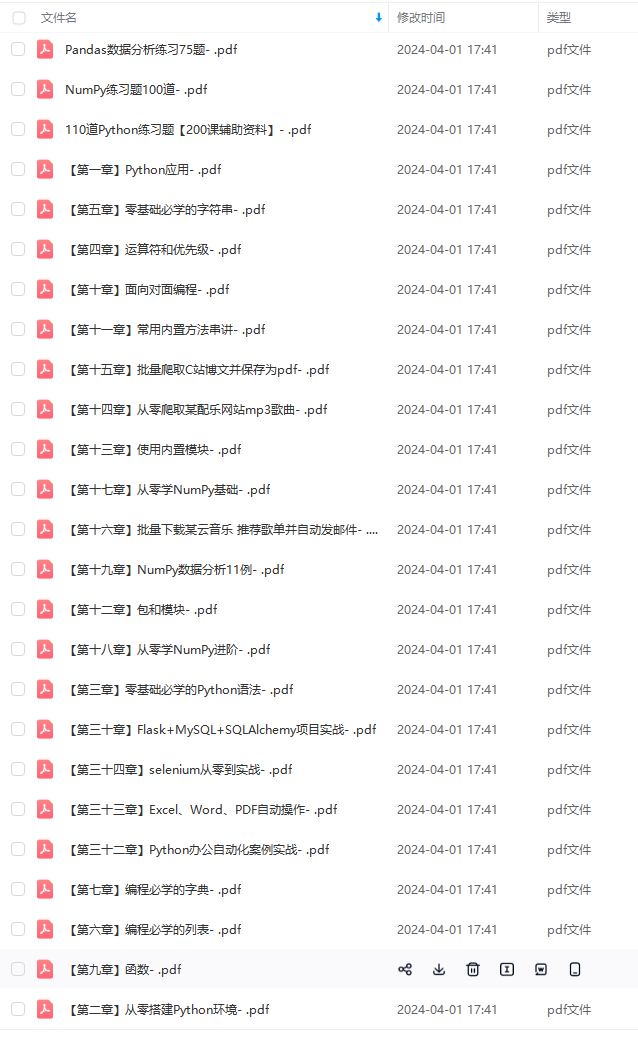

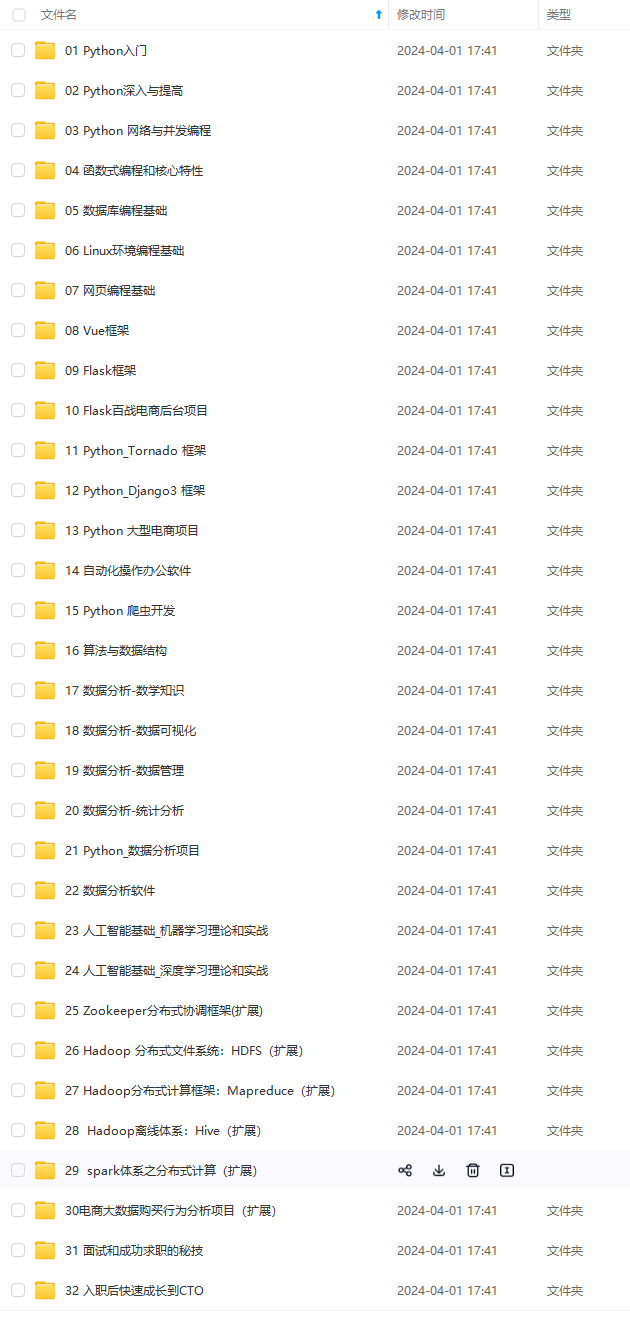

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以扫码获取!!!(备注:Python)

础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上前端开发知识点,真正体系化!**

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以扫码获取!!!(备注:Python)

本文介绍了Python编程中常用的激活函数如Softmax、Sigmoid、ReLU、LeakyReLU、ELU、SELU、SoftPlus和Swish,以及一套针对不同经验阶段的Python开发学习资料,旨在提供系统化的学习路径和资源,帮助开发者提升技能。

本文介绍了Python编程中常用的激活函数如Softmax、Sigmoid、ReLU、LeakyReLU、ELU、SELU、SoftPlus和Swish,以及一套针对不同经验阶段的Python开发学习资料,旨在提供系统化的学习路径和资源,帮助开发者提升技能。

5297

5297

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?