OpenSL ES(嵌入式系统的开放声音库)是一种免版税,跨平台,硬件加速的 C语言) 音频API,用于2D和3D音频。它提供对3D位置音频和MIDI播放等功能的访问。它是为移动和游戏行业的开发人员设计的,致力于使跨多个平台的应用程序轻松移植。

FFmpeg 初始化

编译 FFmpeg 可以参考我之前写的文章:音视频学习 (六) 一键编译 32/64 位 FFmpeg 4.2.2

这里我们就按照 FFmpeg 初始化流程来进行介绍 API 如下所示:

//1. 分配一个 AVFormatContext。

AVFormatContext *avformat_alloc_context(void);

//对应的释放

void avformat_free_context(AVFormatContext *s);

//2. 打开输入流,读取头部信息,一般包含有音频,视频流信息也可能有弹幕信息

int avformat_open_input(AVFormatContext **ps, const char *url, ff_const59 AVInputFormat *fmt, AVDictionary **options);

//对应的关闭流信息,释放所有内容资源

void avformat_close_input(AVFormatContext **s);

//3. 读取媒体文件的数据包以获取流信息。返回 >=0 则成功

int avformat_find_stream_info(AVFormatContext *ic, AVDictionary **options);

//3.1 拿到当前流的数量信息,一般会有音频,视频,或者弹幕

int number = (*AVFormatContext)->nb_streams

//3.2 遍历拿到对应的 stream

//视频流

if ((*pFormatCtx)->streams && (*pFormatCtx)->streams[i]->codecpar->codec_type == AVMEDIA_TYPE_VIDEO)

//语音流

if ((*pFormatCtx)->streams[i]->codecpar->codec_type == AVMEDIA_TYPE_AUDIO)

//其它流类型

enum AVMediaType {

AVMEDIA_TYPE_UNKNOWN = -1, ///< Usually treated as AVMEDIA_TYPE_DATA

AVMEDIA_TYPE_VIDEO,

AVMEDIA_TYPE_AUDIO,

AVMEDIA_TYPE_DATA, ///< Opaque data information usually continuous

AVMEDIA_TYPE_SUBTITLE,

AVMEDIA_TYPE_ATTACHMENT, ///< Opaque data information usually sparse

AVMEDIA_TYPE_NB

};

//4. 根据 AVCodecID 拿到已经注册的解码器

AVCodec *avcodec_find_decoder(enum AVCodecID id);

//5. 分配一个 AVCodecContext

AVCodecContext *avcodec_alloc_context3(const AVCodec *codec);

//对应的释放

void avcodec_free_context(AVCodecContext **avctx);

//6. 给解码器设置参数

int avcodec_parameters_to_context(AVCodecContext *codec,

const AVCodecParameters *par);

//7. 打开解码器 is 0 success

int avcodec_open2(AVCodecContext *avctx, const AVCodec *codec, AVDictionary **options);

以上 7 步如果没有问题证明编解码器打开成功,可以进行下一步操作。

FFmpeg 读取音频帧

这里还是介绍 API 使用:

//1. 分配一个 AVPacket

AVPacket *av_packet_alloc(void);

//结果必须释放

void av_packet_free(AVPacket **pkt);

//2. 读取待解码数据包

int av_read_frame(AVFormatContext *s, AVPacket *pkt);

对,就是这么简单,就调用 3 个 API 然后循环读取,送入待解码队列中。

FFmpeg 解码音频为 PCM

这里相当于是读取待解码队列中的数据,进行解码为 PCM 数据

//1. 将待解码数据 AVPacket 送入解码器 0 is ok

int avcodec_send_packet(AVCodecContext *avctx, const AVPacket *avpkt);

//2. 分配一个 AVFrame 用于接收解码之后的数据

AVFrame *av_frame_alloc(void);

//对应的释放 API

void av_frame_free(AVFrame **frame);

//3. 接收解码之后的数据 0 is ok

int avcodec_receive_frame(AVCodecContext *avctx, AVFrame *frame);

//对解码之后的 PCM 进行统一重采样。规定一些格式,避免不统一而渲染异常

//4. 根据传入的参数来分配一个 SwrContext

struct SwrContext *swr_alloc_set_opts(struct SwrContext *s,

int64_t out_ch_layout, enum AVSampleFormat out_sample_fmt, int out_sample_rate,

int64_t in_ch_layout, enum AVSampleFormat in_sample_fmt, int in_sample_rate,

int log_offset, void *log_ctx);

//4.1 对 SwrContext 进行初始化

int swr_init(struct SwrContext *s);

//4.2 开始重采样

int swr_convert(struct SwrContext *s, uint8_t **out, int out_count,

const uint8_t **in , int in_count);

OpenSLES 渲染 PCM

这里还是以流程的形式介绍 API 含义

//1. 创建播放引擎

result = slCreateEngine(&engineObject, 0, NULL, 0, NULL, NULL);

result = (*engineObject)->Realize(engineObject, SL_BOOLEAN_FALSE);

result = (*engineObject)->GetInterface(engineObject, SL_IID_ENGINE, &engineEngine);

//2. 创建混音器

const SLInterfaceID mids[1] = {SL_IID_ENVIRONMENTALREVERB};

const SLboolean mreq[1] = {SL_BOOLEAN_FALSE};

result = (*outputMixObject)->Realize(outputMixObject, SL_BOOLEAN_FALSE);

result = (*outputMixObject)->GetInterface(outputMixObject, SL_IID_ENVIRONMENTALREVERB,

&outputMixEnvironmentalReverb);

if (SL_RESULT_SUCCESS == result) {

result = (*outputMixEnvironmentalReverb)->SetEnvironmentalReverbProperties(

outputMixEnvironmentalReverb, &reverbSettings);

(void) result;

}

SLDataLocator_OutputMix outputMix = {SL_DATALOCATOR_OUTPUTMIX, outputMixObject};

SLDataSink audioSnk = {&outputMix, 0};

//3. 配置PCM格式信息

SLDataLocator_AndroidSimpleBufferQueue android_queue = {SL_DATALOCATOR_ANDROIDSIMPLEBUFFERQUEUE, 2};

SLDataFormat_PCM pcm = {

SL_DATAFORMAT_PCM,//播放pcm格式的数据

2,//2个声道(立体声)

static_cast(getCurSampleRate(sample_rate)),//44100hz的频率

SL_PCMSAMPLEFORMAT_FIXED_16,//位数 16位

SL_PCMSAMPLEFORMAT_FIXED_16,//和位数一致就行

SL_SPEAKER_FRONT_LEFT | SL_SPEAKER_FRONT_RIGHT,//立体声(前左前右)

SL_BYTEORDER_LITTLEENDIAN//结束标志

};

SLDataSource slDataSource = {&android_queue, &pcm};

const SLInterfaceID ids[3] = {SL_IID_BUFFERQUEUE, SL_IID_VOLUME, SL_IID_MUTESOLO};

const SLboolean req[3] = {SL_BOOLEAN_TRUE, SL_BOOLEAN_TRUE, SL_BOOLEAN_TRUE};

result = (*engineEngine)->CreateAudioPlayer(engineEngine, &pcmPlayerObject, &slDataSource, &audioSnk,

sizeof(ids) / sizeof(ids[0]), ids, req);

//4. 初始化播放器

result = (*pcmPlayerObject)->Realize(pcmPlayerObject, SL_BOOLEAN_FALSE);

result = (*pcmPlayerObject)->GetInterface(pcmPlayerObject, SL_IID_PLAY, &pcmPlayerPlay);

//5. 注册回调缓冲区 获取缓冲队列接口

(*pcmPlayerObject)->GetInterface(pcmPlayerObject, SL_IID_BUFFERQUEUE, &pcmBufferQueue);

(*pcmBufferQueue)->RegisterCallback(pcmBufferQueue, pcmBufferCallBack, this);

//6. 设置播放状态

(*pcmPlayerPlay)->SetPlayState(pcmPlayerPlay, SL_PLAYSTATE_PLAYING);

//7. 手动激活回调接口

pcmBufferCallBack(pcmBufferQueue, this);

初始化就是这 7 大步,那么渲染的话,就是在 pcmBufferCallBack 中进行设置,直接上代码吧:

void pcmBufferCallBack(SLAndroidSimpleBufferQueueItf bf, void *pVoid) {

auto audioPlayer = static_cast<BaseAudioChannel *>(pVoid);

if (!audioPlayer)

return;

if (audioPlayer->status && audioPlayer->status->exit)

LOGE(“looper pcmBufferCallBack start”);

//拿到 PCM 原始数据

int size = audioPlayer->getPCMData();

//对 PCM 做变速变调操作。

size = audioPlayer->setSoundTouchData();

…

//8. 放入缓存,开始播放声音

(*audioPlayer->pcmBufferQueue)->Enqueue(audioPlayer->pcmBufferQueue, audioPlayer->out_pcm_buffer, size);

…

}

对,没错。第八步就是真正将 PCM 放入 OpenSL ES 缓冲队列中,这里要注意,一点要等它的上一帧渲染完在放入下一帧 PCM 数据。

功能点实现:

声道选择

声道操作直接操作的是 OpenSLES 接口,具体 API 如下:

//1. 得到音频声道通道接口

(pcmPlayerObject)->GetInterface(pcmPlayerObject, SL_IID_MUTESOLO, &pcmChannelModePlay);

//2. 设置音频通道

/*

- 设置音频通道

- @param channelMode

*/

void BaseAudioChannel::setChannelMode(int channelMode) {

this->mChannelMode = channelMode;

if (pcmChannelModePlay != NULL) {

if (channelMode == 0)//右声道

{

(*pcmChannelModePlay)->SetChannelMute(pcmChannelModePlay, 1, false);

(*pcmChannelModePlay)->SetChannelMute(pcmChannelModePlay, 0, true);

} else if (channelMode == 1)//左声道

{

(*pcmChannelModePlay)->SetChannelMute(pcmChannelModePlay, 1, true);

(*pcmChannelModePlay)->SetChannelMute(pcmChannelModePlay, 0, false);

} else if (channelMode == 2)//立体声 通道为 2 也就是我们重采样设置的 AV_CH_LAYOUT_STEREO

{

(*pcmChannelModePlay)->SetChannelMute(pcmChannelModePlay, 1, false);

(*pcmChannelModePlay)->SetChannelMute(pcmChannelModePlay, 0, false);

}

}

}

音量控制

声音音量控制这里还是基于的是 OpenSLES 接口,对应 API 如下:

//1. 拿到音频声音控制接口

(pcmPlayerObject)->GetInterface(pcmPlayerObject, SL_IID_VOLUME, &pcmVolumePlay);

//2. 设置声音

/*

- 平滑设置当前音量

- @param volume

*/

void BaseAudioChannel::setVolume(int percent) {

this->curVolume = percent;

if (pcmVolumePlay != NULL) {

if (percent > 30) {

(*pcmVolumePlay)->SetVolumeLevel(pcmVolumePlay, (100 - percent) * -20);

} else if (percent > 25) {

(*pcmVolumePlay)->SetVolumeLevel(pcmVolumePlay, (100 - percent) * -22);

} else if (percent > 20) {

(*pcmVolumePlay)->SetVolumeLevel(pcmVolumePlay, (100 - percent) * -25);

} else if (percent > 15) {

(*pcmVolumePlay)->SetVolumeLevel(pcmVolumePlay, (100 - percent) * -28);

} else if (percent > 10) {

(*pcmVolumePlay)->SetVolumeLevel(pcmVolumePlay, (100 - percent) * -30);

} else if (percent > 5) {

(*pcmVolumePlay)->SetVolumeLevel(pcmVolumePlay, (100 - percent) * -34);

} else if (percent > 3) {

(*pcmVolumePlay)->SetVolumeLevel(pcmVolumePlay, (100 - percent) * -37);

} else if (percent > 0) {

(*pcmVolumePlay)->SetVolumeLevel(pcmVolumePlay, (100 - percent) * -40);

} else {

(*pcmVolumePlay)->SetVolumeLevel(pcmVolumePlay, (100 - percent) * -100);

}

}

}

语调语速设置

语调语速功能这里用的开源的 SoundTouch ,具体实现如下:

int BaseAudioChannel::setSoundTouchData() {

int num = 0;

while (status && !status->exit) {

if (finished) {

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数初中级Android工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则近万的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

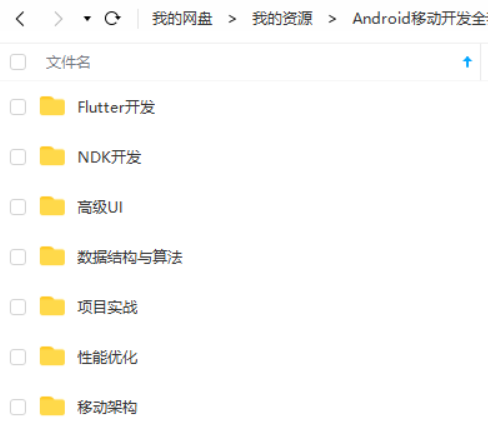

因此收集整理了一份《2024年Android移动开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

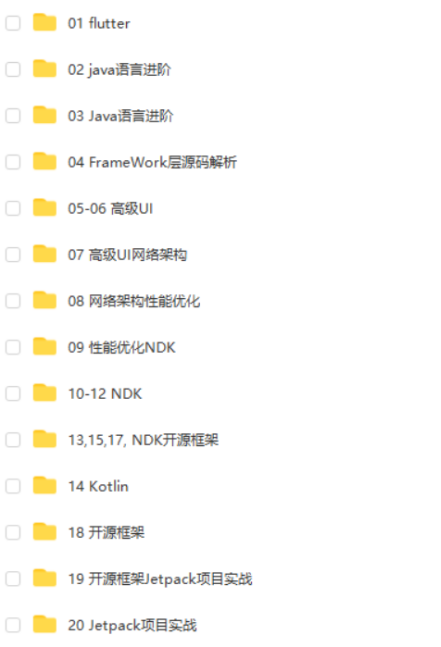

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Android开发知识点,真正体系化!

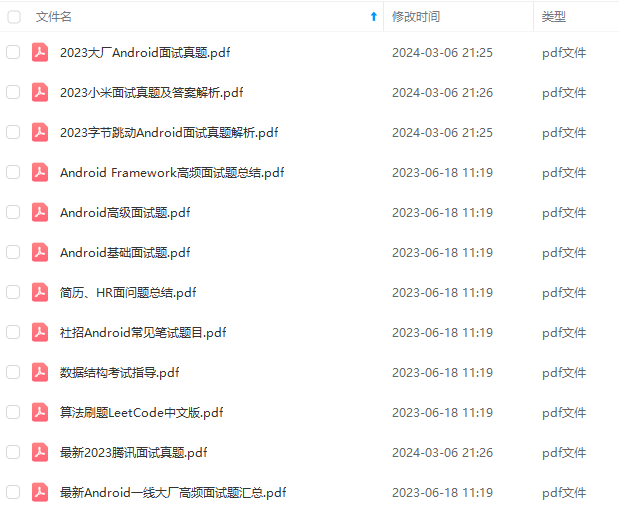

由于文件比较大,这里只是将部分目录截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且会持续更新!

如果你觉得这些内容对你有帮助,可以扫码获取!!(备注:Android)

总结

写到这里也结束了,在文章最后放上一个小小的福利,以下为小编自己在学习过程中整理出的一个关于Flutter的学习思路及方向,从事互联网开发,最主要的是要学好技术,而学习技术是一条慢长而艰苦的道路,不能靠一时激情,也不是熬几天几夜就能学好的,必须养成平时努力学习的习惯,更加需要准确的学习方向达到有效的学习效果。

由于内容较多就只放上一个大概的大纲,需要更及详细的学习思维导图的

还有高级UI、性能优化、架构师课程、NDK、混合式开发(ReactNative+Weex)微信小程序、Flutter全方面的Android进阶实践技术资料,并且还有技术大牛一起讨论交流解决问题。

《互联网大厂面试真题解析、进阶开发核心学习笔记、全套讲解视频、实战项目源码讲义》点击传送门即可获取!

学习效果。

由于内容较多就只放上一个大概的大纲,需要更及详细的学习思维导图的

还有高级UI、性能优化、架构师课程、NDK、混合式开发(ReactNative+Weex)微信小程序、Flutter全方面的Android进阶实践技术资料,并且还有技术大牛一起讨论交流解决问题。**

[外链图片转存中…(img-Nhzm68vl-1712542638507)]

《互联网大厂面试真题解析、进阶开发核心学习笔记、全套讲解视频、实战项目源码讲义》点击传送门即可获取!

967

967

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?